OpenAI đã mở rộng bộ sưu tập các mô hình AI mạnh mẽ với o1-pro, một sản phẩm mới được thiết kế cho các nhiệm vụ lý luận và giải quyết vấn đề tiên tiến. Là một phần của sự phát triển của OpenAI vượt ra ngoài chuỗi GPT, các mô hình "o" đại diện cho các hệ thống AI chuyên biệt được tối ưu hóa cho các trường hợp sử dụng cụ thể. Trong hướng dẫn toàn diện này, chúng tôi sẽ khám phá mọi thứ bạn cần biết về o1-pro, bao gồm khả năng, cấu trúc giá cả và cách triển khai nó trong các ứng dụng của bạn thông qua nhiều phương pháp khác nhau, bao gồm cả công cụ thử nghiệm API như Apidog.

o1-pro là gì? Và Nó Tốt Như Thế Nào?

o1-pro là mô hình chuyên biệt của OpenAI cho các nhiệm vụ lý luận phức tạp. Nó thuộc về gia đình mô hình "o1" nổi bật trong việc tư duy từng bước và giải quyết vấn đề. Biến thể "pro" cung cấp khả năng nâng cao hơn so với mô hình cơ sở, khiến nó phù hợp cho các ứng dụng đòi hỏi lý luận tinh vi.

Khác với các mô hình đa năng hơn như GPT-4o, o1-pro đã được điều chỉnh đặc biệt cho các nhiệm vụ đòi hỏi tiến trình logic, lý luận toán học và phân tích có cấu trúc. Sự tập trung chuyên biệt này cho phép nó hoạt động cực kỳ tốt trong các lĩnh vực mà tư duy có phương pháp và phân tích vấn đề là rất quan trọng.

o1-pro được thiết kế với những điểm mạnh sau:

- Lý luận nâng cao: Xuất sắc trong việc phân tích các vấn đề phức tạp thành các bước logic, khiến nó lý tưởng cho các nhiệm vụ yêu cầu tư duy và phân tích có cấu trúc. Nó có thể điều hướng các cây quyết định phức tạp và cung cấp các lộ trình lý luận rõ ràng.

- Giải quyết vấn đề toán học: Xử lý lý luận toán học, chứng minh và tính toán với độ chính xác cải thiện. Mô hình thể hiện sức mạnh đặc biệt trong đại số, giải tích, thống kê và logic hình thức.

- Phân tích mã: Có khả năng phân tích, gỡ lỗi và giải thích mã với sự hiểu biết chi tiết. Nó có thể hoạt động trên nhiều ngôn ngữ lập trình và xác định lỗi logic hoặc cơ hội tối ưu hóa.

- Tư duy có cấu trúc: Tạo ra các phản hồi rõ ràng hơn, có cấu trúc hơn cho các truy vấn phức tạp, với các phân tích tự nhiên về các vấn đề nhiều bước và lý luận được phân định rõ ràng.

- Nghiên cứu và phân tích: Thực hiện phân tích sâu về các chủ đề với tổ chức logic, so sánh các quan điểm khác nhau và đánh giá chứng cứ một cách có phương pháp.

- Quy trình chuỗi tư duy: Rõ ràng thể hiện quy trình lý luận của nó, giúp dễ dàng theo dõi các dòng tư duy phức tạp và xác minh các kết luận.

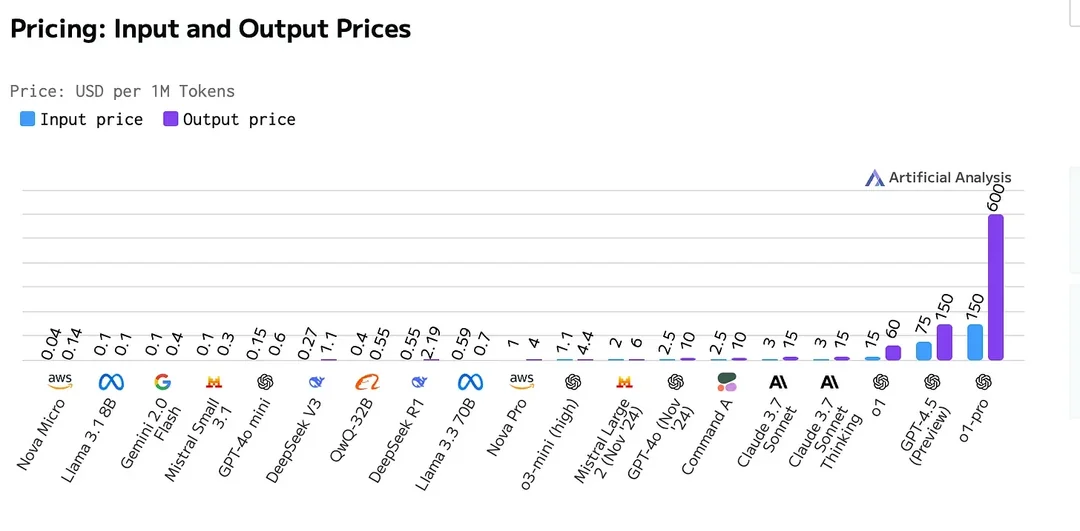

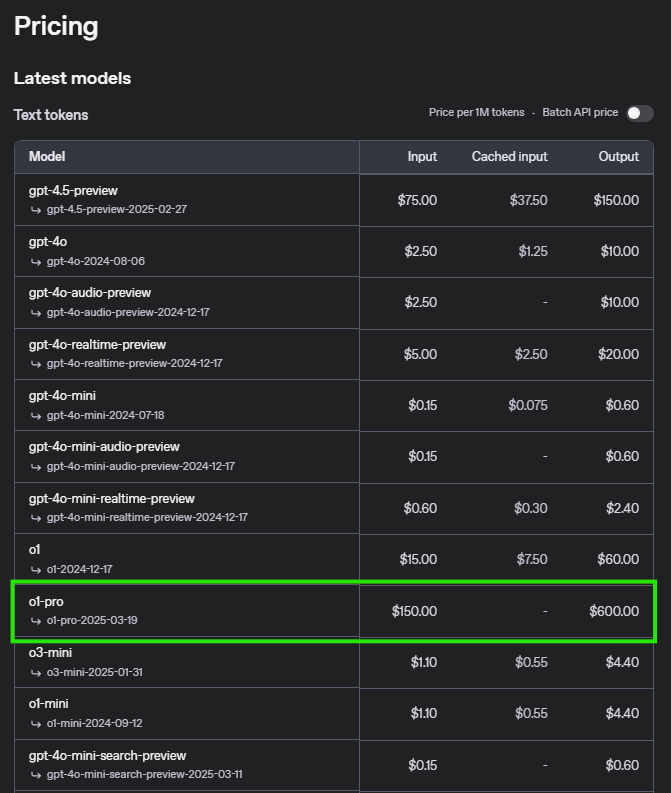

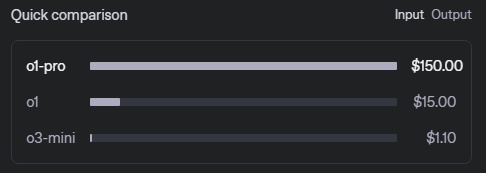

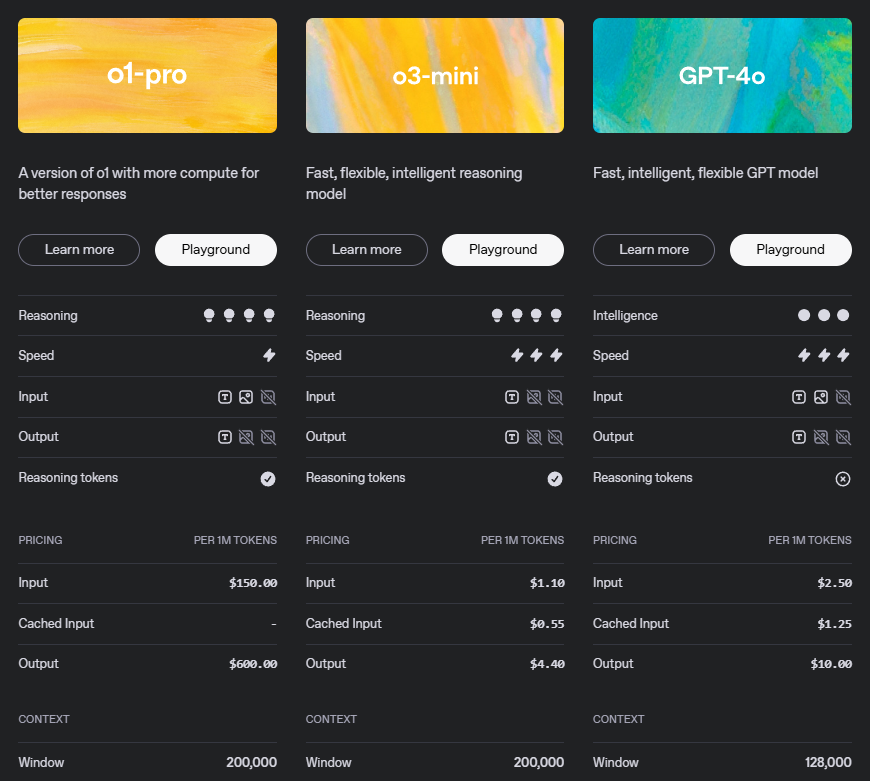

Giá cả API o1-pro

Hiểu cấu trúc giá cả là rất quan trọng để lập kế hoạch sử dụng API của bạn. Dưới đây là phân tích chi tiết cho o1-pro:

Mô hình giá này phản ánh khả năng tinh vi của o1-pro, đặc biệt là khả năng lý luận nâng cao và chất lượng đầu ra. Chi phí cao hơn cho các token đầu ra công nhận giá trị của các phản hồi có cấu trúc, lý luận rõ ràng mà mô hình tạo ra.

Các kịch bản ví dụ giá cả

| Hoạt động | Giá |

|---|---|

| Input (Lời nhắc) | $5 mỗi triệu token |

| Output (Hoàn thành) | $15 mỗi triệu token |

Kịch bản 1: Sử dụng quy mô nhỏ

Đối với một kịch bản có 500,000 token đầu vào và 200,000 token đầu ra:

- Chi phí đầu vào: 500,000 token × 5/million token = 2.50

- Chi phí đầu ra: 200,000 token × 15/million token = 3.00

- Tổng chi phí: $5.50

Kịch bản 2: Sử dụng quy mô vừa

Đối với một kịch bản có 5 triệu token đầu vào và 2 triệu token đầu ra:

- Chi phí đầu vào: 5,000,000 token × 5/million token = 25.00

- Chi phí đầu ra: 2,000,000 token × 15/million token = 30.00

- Tổng chi phí: $55.00

Kịch bản 3: Sử dụng quy mô lớn

Đối với một kịch bản có 50 triệu token đầu vào và 20 triệu token đầu ra:

- Chi phí đầu vào: 50,000,000 token × 5/million token = 250.00

- Chi phí đầu ra: 20,000,000 token × 15/million token = 300.00

- Tổng chi phí: $550.00

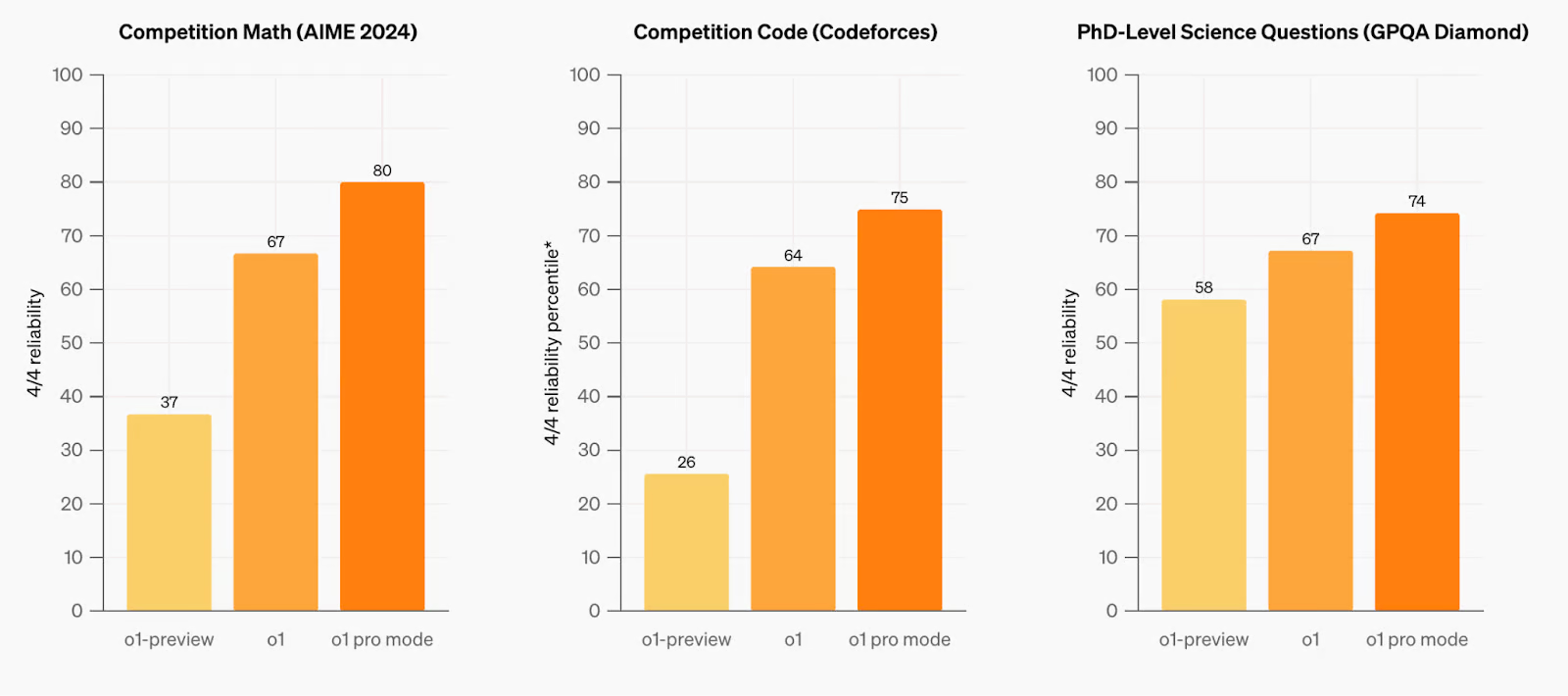

So sánh với các mô hình trước đây

o1-pro thể hiện những tiến bộ đáng kể trong lý luận, giải quyết vấn đề và hiểu ngữ cảnh dài. Mô hình đã được kiểm tra gắt gao qua nhiều tiêu chuẩn, cho thấy những cải tiến so với các mô hình trước đó trong việc xử lý các truy vấn phức tạp và các nhiệm vụ lý luận nhiều bước. Trong các lĩnh vực chính như toán học, lập trình và lập kế hoạch có cấu trúc, o1-pro thể hiện độ chính xác và độ tin cậy cao hơn, vượt trội hơn các mô hình trước về hiệu suất và hiệu quả. Kiến trúc tối ưu của nó cho phép hiểu rõ hơn các lời nhắc phức tạp, khiến nó trở thành ứng cử viên mạnh mẽ cho các ứng dụng tiên tiến yêu cầu lý luận ở mức cao và khả năng ngữ cảnh mở rộng.

Bạn có thể tìm thấy so sánh đầy đủ các mô hình OpenAI, bao gồm các thông số kỹ thuật chi tiết và tiêu chuẩn, trên trang tài liệu OpenAI chính thức.

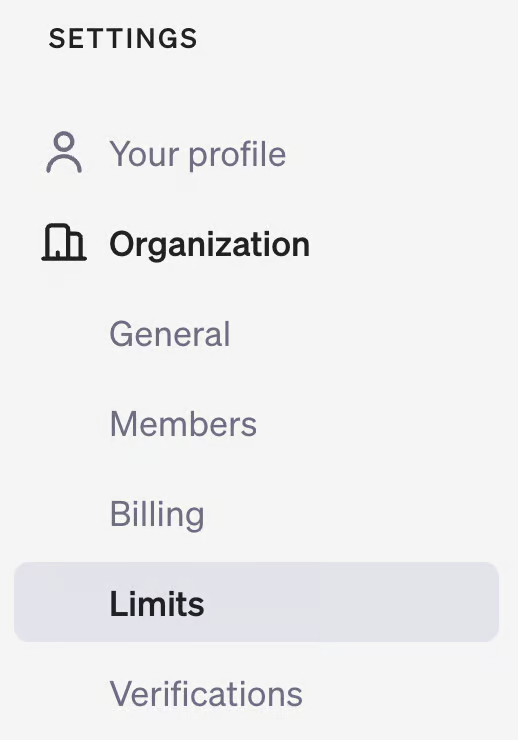

Yêu cầu và giới hạn tốc độ API OpenAI O1 Pro

| Cấp độ | Điều kiện | Giới hạn sử dụng |

|---|---|---|

| Miễn phí | Người dùng phải ở trong khu vực cho phép | $100/tháng |

| Cấp độ 1 | $5 đã thanh toán | $100/tháng |

| Cấp độ 2 | $50 đã thanh toán và đã hơn 7 ngày kể từ lần thanh toán đầu tiên thành công | $500/tháng |

| Cấp độ 3 | $100 đã thanh toán và đã hơn 7 ngày kể từ lần thanh toán đầu tiên thành công | $1,000/tháng |

| Cấp độ 4 | $250 đã thanh toán và đã hơn 14 ngày kể từ lần thanh toán đầu tiên thành công | $5,000/tháng |

| Cấp độ 5 | $1,000 đã thanh toán và đã hơn 30 ngày kể từ lần thanh toán đầu tiên thành công | $50,000/tháng |

Để kiểm tra cấp độ sử dụng của bạn, hãy truy cập trang tài khoản của bạn trên nền tảng phát triển OpenAI và kiểm tra phần "Giới hạn" dưới "Tổ chức".

Cách sử dụng API 01

Triển khai o1-pro trong các ứng dụng của bạn là rất đơn giản. Làm theo những bước sau để bắt đầu:

1. Các yêu cầu cần thiết

- Một API key OpenAI (nhận từ bảng điều khiển OpenAI của bạn)

- Một môi trường phát triển tương thích với các thư viện phù hợp

- Các tín dụng API đủ hoặc phương thức thanh toán được liên kết với tài khoản OpenAI của bạn

2. Cài đặt

Cài đặt thư viện OpenAI cho ngôn ngữ lập trình bạn ưa thích:

Đối với Python:

pip install openai

Đối với JavaScript:

npm install openai

Đối với các ngôn ngữ khác, hãy tham khảo tài liệu chính thức của OpenAI về các thư viện client.

3. Ví dụ triển khai Python

Dưới đây là cách sử dụng o1-pro trong Python với các tham số chi tiết:

from openai import OpenAI

client = OpenAI(api_key="your-api-key")

response = client.chat.completions.create(

model="o1-pro",

messages=[

{"role": "system", "content": "Bạn là một trợ lý AI chuyên biệt trong lý luận toán học. Cung cấp các giải pháp rõ ràng, từng bước với giải thích cho mỗi bước."},

{"role": "user", "content": "Giải bài toán giải tích này từng bước: tìm đạo hàm của f(x) = x^3*ln(x)."}

],

temperature=0.1, # Nhiệt độ thấp hơn để lý luận chính xác hơn

max_tokens=1024, # Điều chỉnh dựa trên độ dài phản hồi dự kiến

top_p=0.95,

frequency_penalty=0,

presence_penalty=0

)

print(response.choices[0].message.content)

4. Ví dụ triển khai JavaScript

Đối với các ứng dụng Node.js với cấu hình chi tiết hơn:

import OpenAI from 'openai';

const openai = new OpenAI({

apiKey: 'your-api-key',

});

async function askO1Pro() {

try {

const response = await openai.chat.completions.create({

model: 'o1-pro',

messages: [

{role: 'system', content: 'Bạn là một trợ lý AI chuyên biệt trong lý luận toán học. Cung cấp các giải pháp rõ ràng, từng bước với giải thích cho mỗi bước.'},

{role: 'user', content: 'Giải bài toán giải tích này từng bước: tìm đạo hàm của f(x) = x^3*ln(x).'}

],

temperature: 0.1,

max_tokens: 1024,

top_p: 0.95,

frequency_penalty: 0,

presence_penalty: 0

});

console.log(response.choices[0].message.content);

// Tùy chọn: Theo dõi việc sử dụng token

console.log("Token lời nhắc:", response.usage.prompt_tokens);

console.log("Token hoàn thành:", response.usage.completion_tokens);

console.log("Tổng token:", response.usage.total_tokens);

} catch (error) {

console.error('Lỗi:', error);

}

}

askO1Pro();

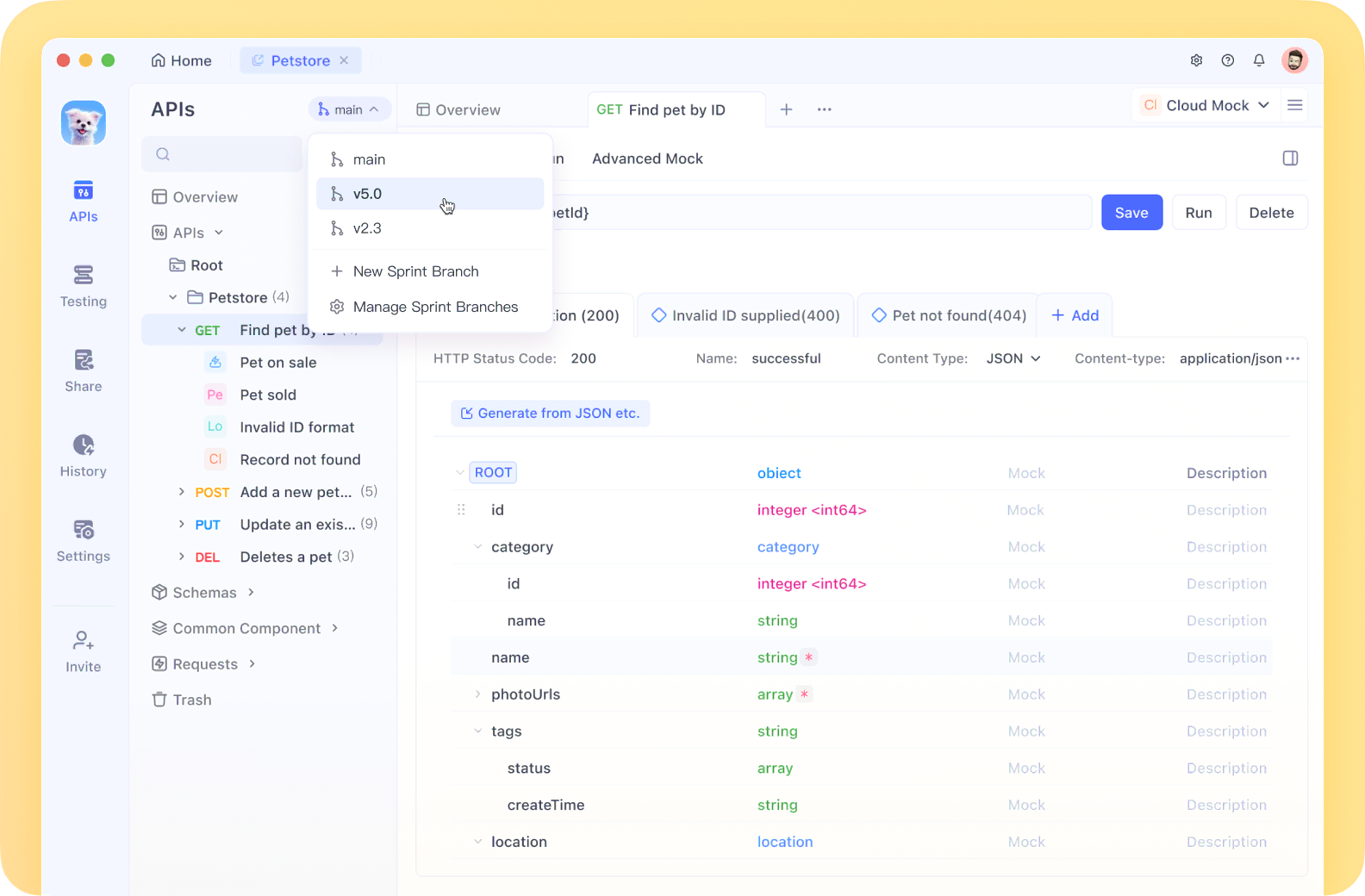

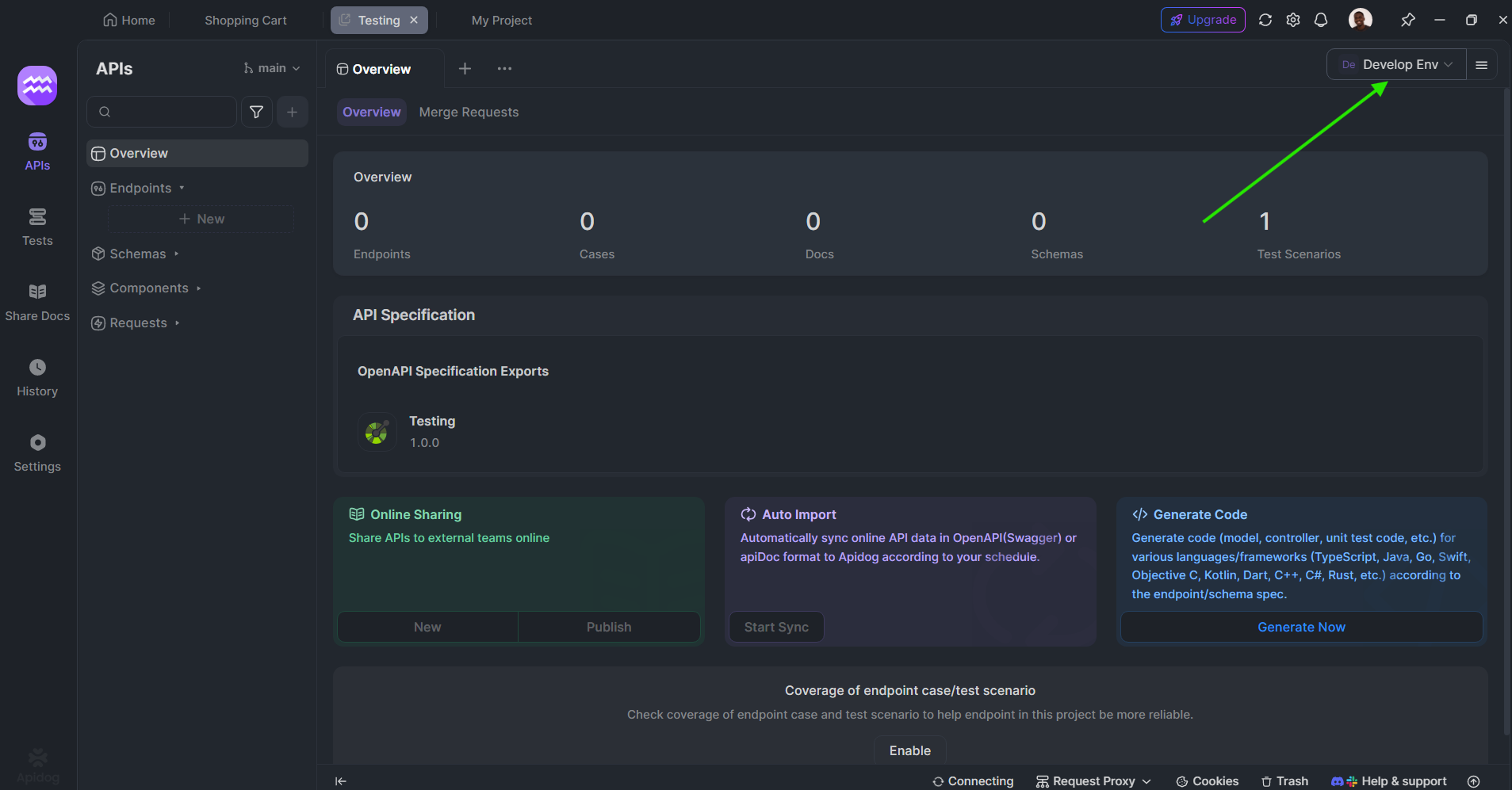

Kiểm tra API o1-pro với Apidog

Apidog là một nền tảng phát triển API toàn diện có thể giúp công việc của bạn với o1-pro và các API OpenAI khác dễ dàng hơn rất nhiều. Dưới đây là cách bạn có thể tận dụng Apidog để thử nghiệm và tích hợp o1-pro vào quy trình làm việc của mình:

Thiết lập o1-pro trong Apidog

- Tạo tài khoản: Đăng ký Apidog tại apidog.com nếu bạn chưa có tài khoản.

- Tạo một bộ API mới: Trong bảng điều khiển Apidog của bạn, hãy tạo một bộ mới đặc biệt cho các API OpenAI.

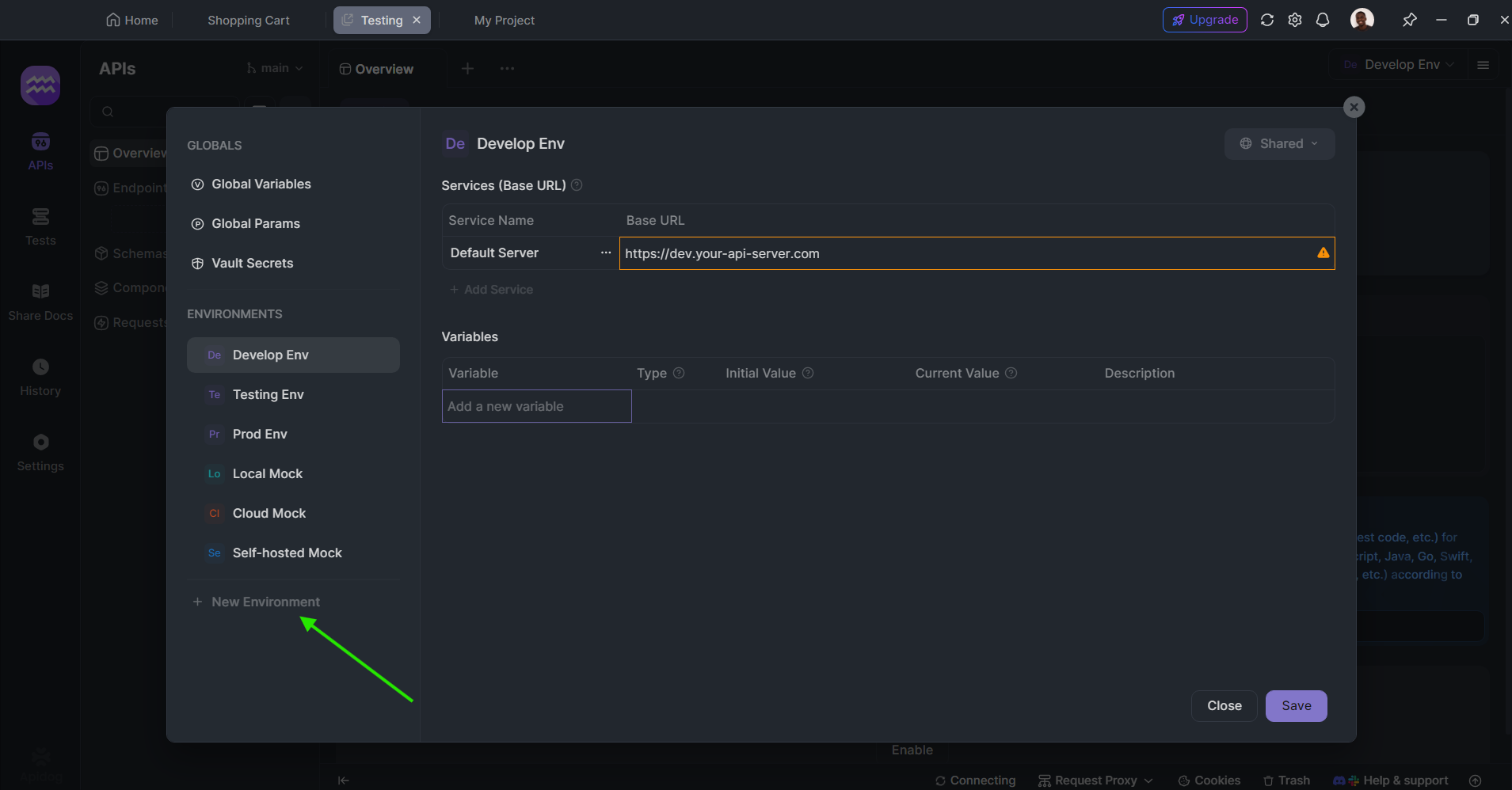

Thiết lập biến môi trường: Cấu hình API key của bạn như một biến môi trường để truy cập an toàn và thuận tiện:

- Đi đến Môi trường ở góc trên bên phải

- Tạo một môi trường mới có tên "OpenAI"

- Thêm một biến có tên "OPENAI_API_KEY" với giá trị là API key thực của bạn

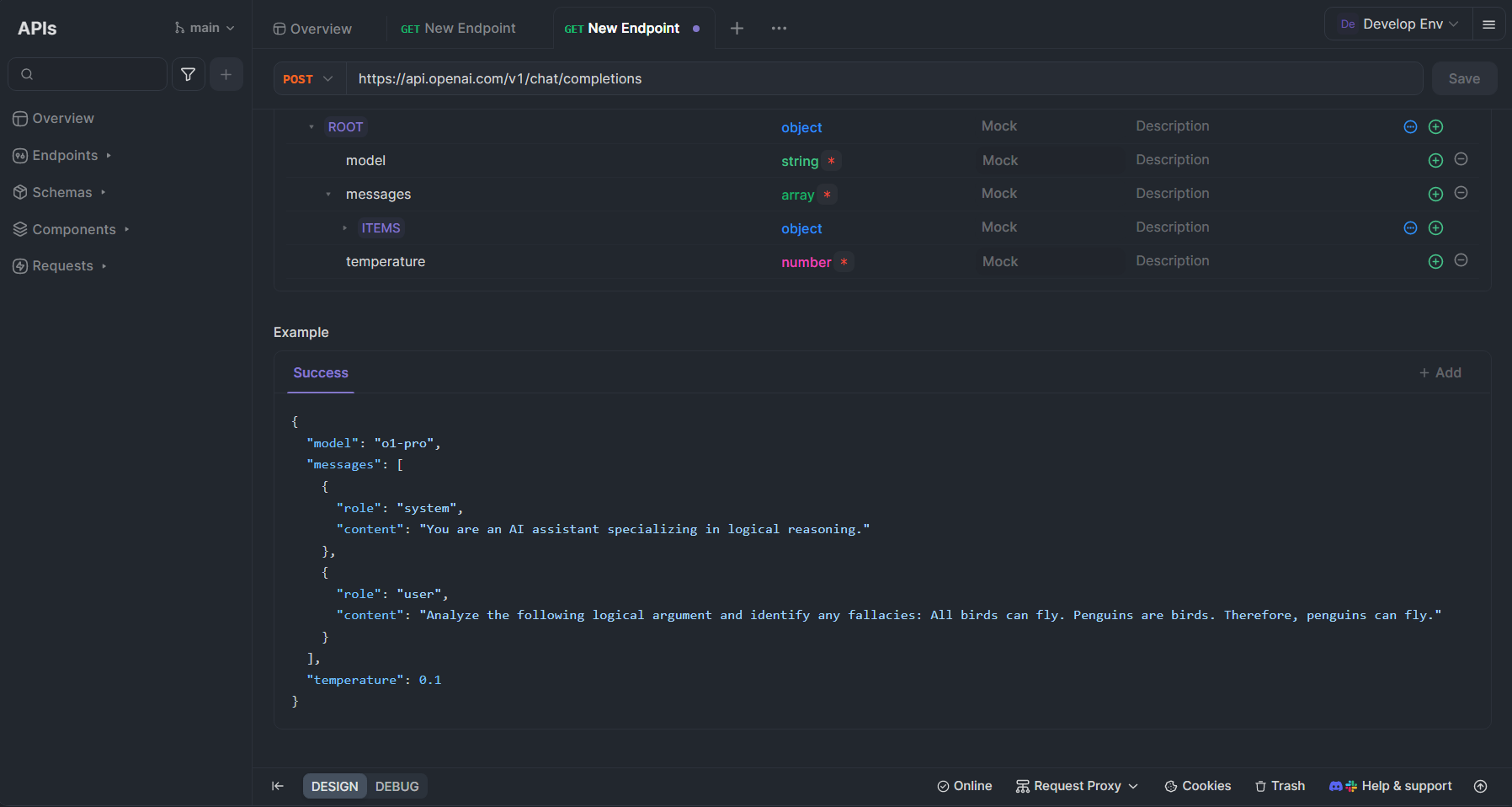

Tạo một yêu cầu cho o1-pro:

- Tạo một yêu cầu POST mới

- Đặt URL là

https://api.openai.com/v1/chat/completions - Thêm một tiêu đề Authorization với giá trị

Bearer {{OPENAI_API_KEY}} - Trong phần body của yêu cầu (JSON), sử dụng:

{

"model": "o1-pro",

"messages": [

{

"role": "system",

"content": "Bạn là một trợ lý AI chuyên biệt trong lý luận logic."

},

{

"role": "user",

"content": "Phân tích lập luận logic sau và xác định bất kỳ sai lầm nào: Tất cả các loài chim đều có thể bay. Chim cánh cụt là chim. Do đó, chim cánh cụt có thể bay."

}

],

"temperature": 0.1

}

Lợi ích của việc sử dụng Apidog với o1-pro

Apidog cung cấp nhiều lợi thế khi làm việc với o1-pro:

- Thử nghiệm tương tác: Kiểm tra các cuộc gọi API trong thời gian thực và xem phản hồi định dạng, giúp dễ dàng điều chỉnh các lời nhắc.

- Tài liệu tự động: Tài liệu thực hiện API của bạn tự động, giúp việc hợp tác giữa các thành viên trong nhóm dễ dàng hơn.

- Giả lập API: Tạo phản hồi giả cho các cuộc gọi API o1-pro trong quá trình phát triển.

- Tính năng hợp tác: Chia sẻ bộ API với các thành viên trong nhóm để phát triển hợp tác.

- Quản lý môi trường: Dễ dàng chuyển đổi giữa các môi trường phát triển, staging và sản xuất với các API key khác nhau.

- Visual hóa phản hồi: Nhận hình ảnh rõ ràng đại diện cho việc sử dụng token và chi phí để quản lý ngân sách tốt hơn.

- Lịch sử yêu cầu: Theo dõi các cuộc gọi API trước đó để tham khảo và tối ưu hóa.

Các thực tiễn tốt nhất khi sử dụng API o1-pro

Để tối ưu hóa hiệu quả của o1-pro và chi phí của bạn:

- Cấu trúc rõ ràng lời nhắc của bạn: Đối với các nhiệm vụ lý luận phức tạp, hãy cấu trúc các lời nhắc của bạn với các hướng dẫn rõ ràng và kết quả mong đợi. Xem xét việc sử dụng các điểm gạch đầu dòng hoặc hướng dẫn đánh số cho các vấn đề nhiều phần.

- Sử dụng tin nhắn hệ thống hiệu quả: Đặt ngữ cảnh với các tin nhắn hệ thống để hướng o1-pro đến phương pháp lý luận mà bạn mong muốn. Hãy cụ thể về loại lý luận (suy diễn, quy nạp, v.v.) mà bạn đang mong đợi.

Điều chỉnh các tham số nhiệt độ:

- Nhiệt độ thấp hơn (0.1-0.3) cho việc lý luận chính xác hơn, các vấn đề toán học và giải quyết vấn đề

- Nhiệt độ vừa phải (0.3-0.7) cho lý luận cân bằng với một số linh hoạt

- Nhiệt độ cao hơn cho các phương pháp giải quyết vấn đề sáng tạo hơn

- Yêu cầu tư duy từng bước: Yêu cầu rõ ràng các bước lý luận chi tiết khi giải quyết các vấn đề phức tạp. Các cụm từ như "Hãy nghĩ về vấn đề này từng bước" hoặc "Hiện lý luận của bạn" giúp kích hoạt sức mạnh của o1-pro.

- Theo dõi việc sử dụng token: Theo dõi token đầu vào và đầu ra để quản lý chi phí hiệu quả. Xem xét việc triển khai một chức năng ước lượng token trong ứng dụng của bạn.

- Kết hợp các truy vấn liên quan: Khi có thể, kết hợp các câu hỏi liên quan thành một cuộc gọi API thay vì thực hiện nhiều cuộc gọi riêng biệt.

- Triển khai lưu trữ đệm: Lưu trữ các phản hồi thường gặp để tránh các cuộc gọi API lặp lại cho thông tin thường xuyên được yêu cầu.

- Sử dụng kỹ thuật chuỗi tư duy: Đối với các vấn đề phức tạp, triển khai lời nhắc chuỗi tư duy bằng cách yêu cầu mô hình "nghĩ về vấn đề này từng bước trước khi cung cấp câu trả lời cuối cùng."

Kết luận

o1-pro đại diện cho một bước tiến lớn trong khả năng lý luận AI, cung cấp các công cụ mạnh mẽ cho các nhiệm vụ yêu cầu tư duy có cấu trúc và giải quyết vấn đề phức tạp. Với cấu trúc giá cả cạnh tranh và việc triển khai đơn giản, nó dễ tiếp cận với các nhà phát triển muốn nâng cao ứng dụng của họ với các khả năng lý luận tiên tiến.

Bằng cách tuân theo các hướng dẫn triển khai và các thực tiễn tốt nhất được phác thảo trong bài viết này, bạn có thể tích hợp hiệu quả o1-pro vào quy trình làm việc của mình và tận dụng khả năng lý luận tinh vi của nó trong khi quản lý chi phí API một cách hiệu quả. Các công cụ như Apidog làm cho quá trình phát triển và thử nghiệm trở nên dễ dàng hơn, giúp bạn khai thác tối đa tiềm năng của o1-pro cho các trường hợp sử dụng cụ thể của bạn.

Khi khả năng lý luận AI tiếp tục phát triển, các mô hình như o1-pro sẽ ngày càng trở thành những thành phần thiết yếu trong các ứng dụng yêu cầu không chỉ trí thông minh mà còn tư duy có cấu trúc, logic mà người dùng có thể theo dõi và hiểu.