OpenAI는 고급 추론 및 문제 해결 작업을 위해 설계된 새로운 제품인 o1-pro로 강력한 AI 모델의 라인업을 확장했습니다. GPT 시리즈를 넘어 진화하는 OpenAI의 일환으로 "o" 모델은 특정 사용 사례에 최적화된 전문 AI 시스템을 나타냅니다. 이 종합 안내서에서는 o1-pro에 대해 알아야 할 모든 것, 즉 기능, 가격 구조 및 API 테스트 도구인 Apidog와 같은 다양한 방법을 통해 애플리케이션에 구현하는 방법에 대해 탐구할 것입니다.

o1-pro란 무엇인가요? 그리고 얼마나 좋나요?

o1-pro는 복잡한 추론 작업을 위한 OpenAI의 전문 모델입니다. 이는 단계별 사고 및 문제 해결에서 우수한 성능을 발휘하는 "o1" 모델군의 일부입니다. "pro" 변형은 기본 모델에 비해 향상된 기능을 제공하여 정교한 추론이 필요한 까다로운 응용 프로그램에 적합합니다.

GPT-4o와 같은 더 일반적인 모델과 달리 o1-pro는 논리적 진행, 수학적 추론 및 체계적 분석이 필요한 작업을 위해 특별히 조정되었습니다. 이러한 전문적인 초점으로 인해 방법론적 사고와 문제 분해가 중요한 영역에서 뛰어난 성능을 발휘합니다.

o1-pro는 다음과 같은 강점을 가지고 설계되었습니다:

- 고급 추론: 복잡한 문제를 논리적 단계로 나누는 데 뛰어나 구조화된 사고와 분석을 요구하는 작업에 이상적입니다. 복잡한 결정 트리를 탐색하고 명시적인 추론 경로를 제공합니다.

- 수학적 문제 해결: 수학적 추론, 증명 및 계산을 향상된 정확도로 처리합니다. 이 모델은 대수학, 미적분학, 통계학 및 형식 논리에 특히 강점을 보입니다.

- 코드 분석: 코드를 분석, 디버깅 및 설명하는 능력이 뛰어나며, 여러 프로그래밍 언어에서 작동하고 논리적 오류나 최적화 기회를 식별합니다.

- 구조적 사고: 복잡한 쿼리에 대해 더 명확하고 구조화된 응답을 제공하며, 다단계 문제를 자연스럽게 나누고 명확히 구분된 추론을 제공합니다.

- 연구 및 분석: 논리적으로 구성된 주제의 심층 분석을 수행하며, 다양한 관점을 비교하고 체계적으로 증거를 평가합니다.

- 사고의 연쇄 처리: 자신의 추론 과정을 명시적으로 보여주어 복잡한 사고의 흐름을 따라가고 결론을 검증하기 쉽게 만듭니다.

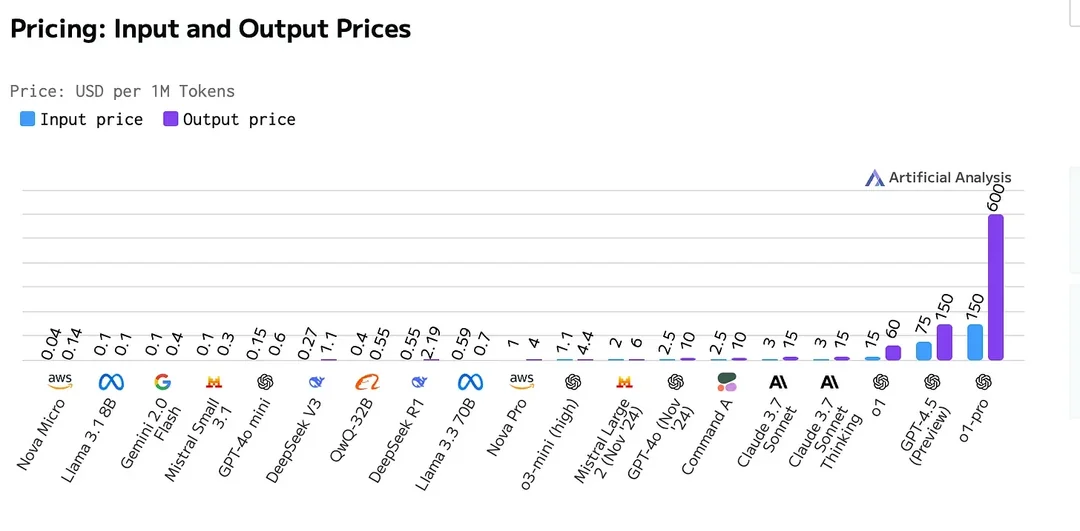

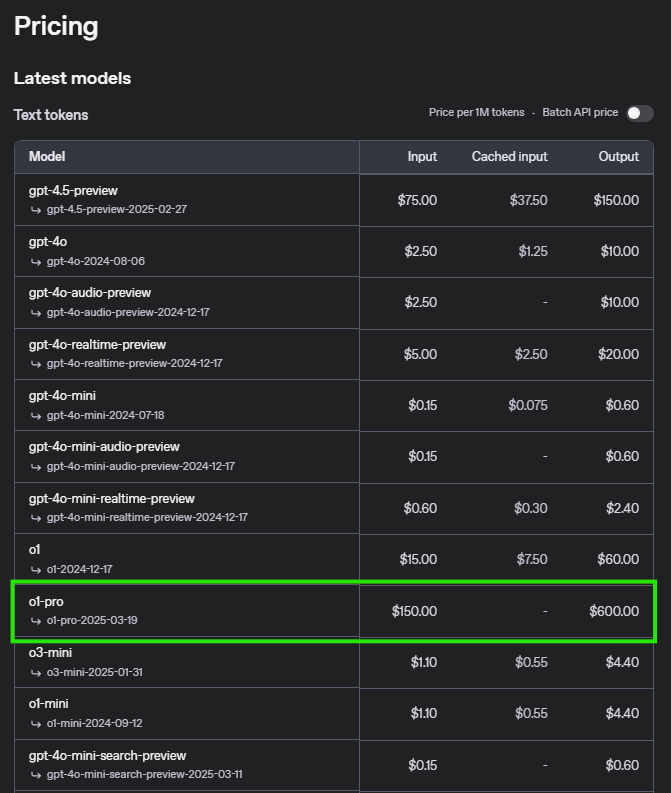

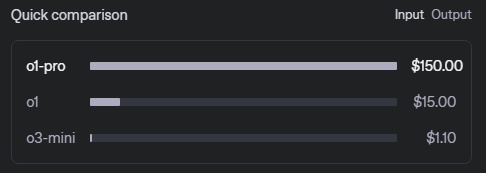

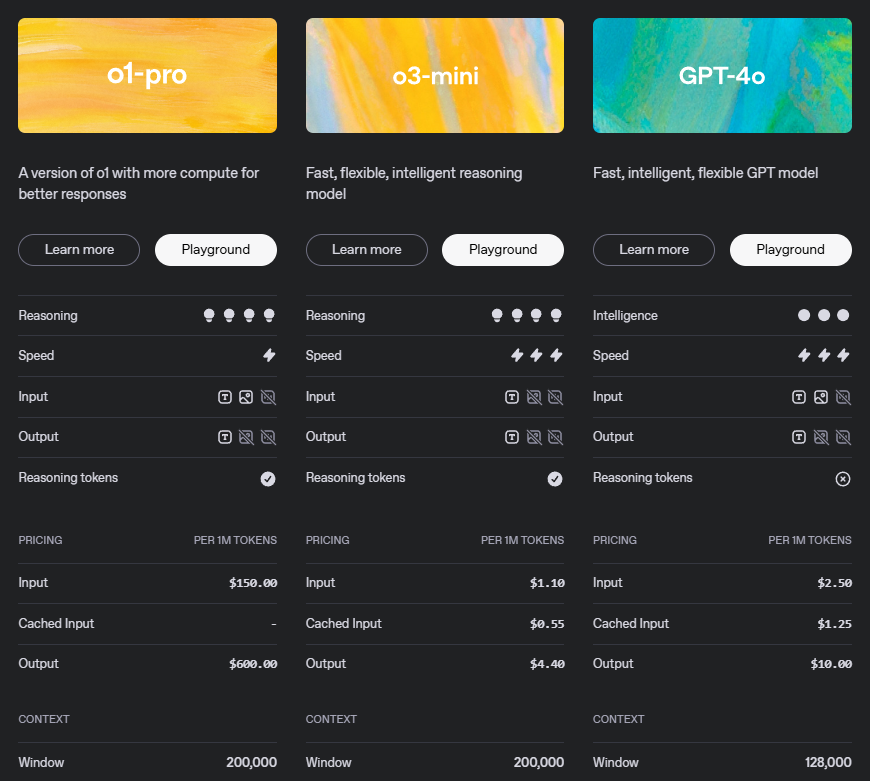

o1-pro API 가격

가격 구조를 이해하는 것은 API 사용 계획에 필수적입니다. o1-pro에 대한 자세한 가격 분류는 다음과 같습니다.

이 가격 모델은 o1-pro의 정교한 기능, 특히 고급 추론 및 출력 품질을 반영합니다. 출력 토큰에 대한 더 높은 비용은 모델이 생성하는 구조적이고 잘 정리된 응답의 가치를 인정하는 것입니다.

가격 예시 시나리오

| 작업 | 가격 |

|---|---|

| 입력 (프롬프트) | $5 per million tokens |

| 출력 (완료) | $15 per million tokens |

시나리오 1: 소규모 사용

500,000개의 입력 토큰과 200,000개의 출력 토큰이 있는 시나리오의 경우:

- 입력 비용: 500,000 토큰 × 5/백만 토큰 = 2.50

- 출력 비용: 200,000 토큰 × 15/백만 토큰 = 3.00

- 총 비용: $5.50

시나리오 2: 중간 규모 사용

5백만 개의 입력 토큰과 2백만 개의 출력 토큰이 있는 시나리오의 경우:

- 입력 비용: 5,000,000 토큰 × 5/백만 토큰 = 25.00

- 출력 비용: 2,000,000 토큰 × 15/백만 토큰 = 30.00

- 총 비용: $55.00

시나리오 3: 대규모 사용

5천만 개의 입력 토큰과 2천만 개의 출력 토큰이 있는 시나리오의 경우:

- 입력 비용: 50,000,000 토큰 × 5/백만 토큰 = 250.00

- 출력 비용: 20,000,000 토큰 × 15/백만 토큰 = 300.00

- 총 비용: $550.00

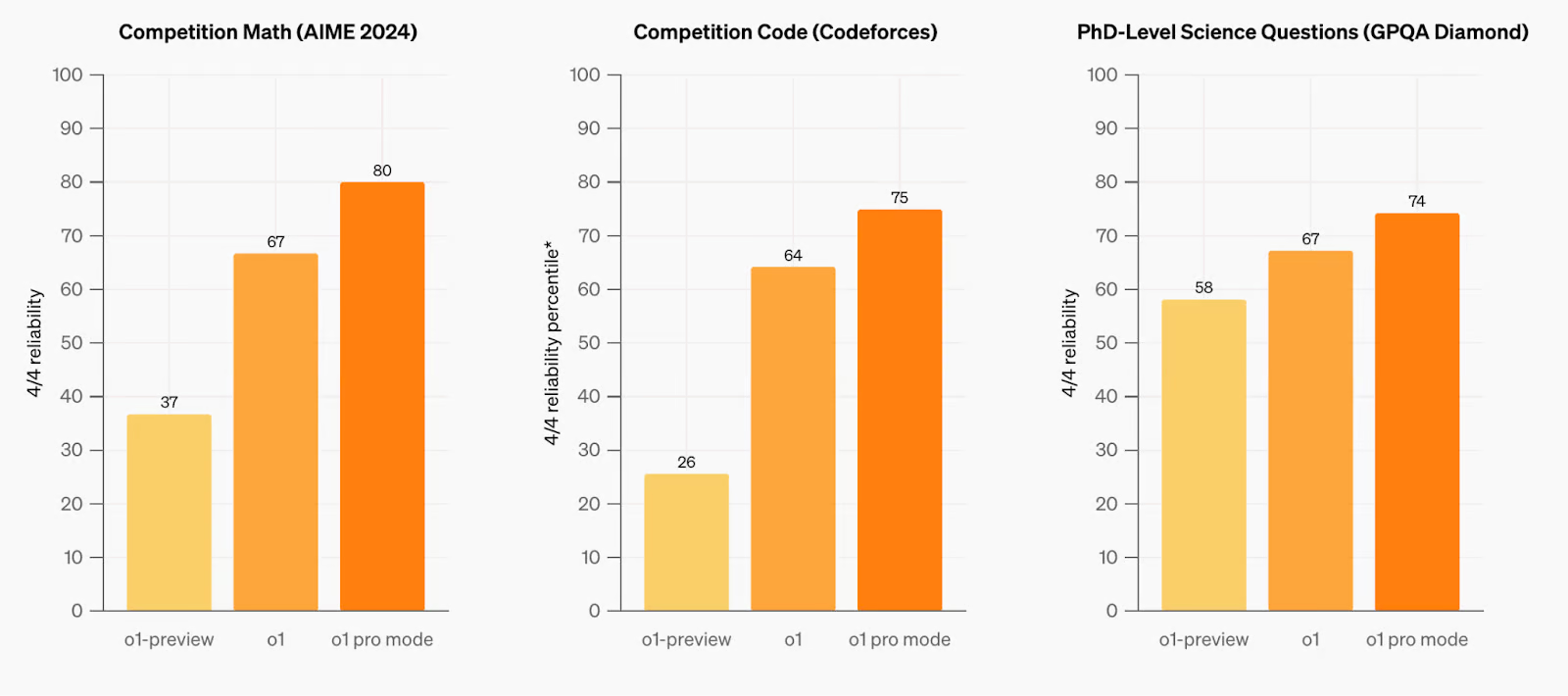

이전 모델과의 비교

o1-pro는 추론, 문제 해결 및 긴 문맥 이해에서 두드러진 발전을 보여줍니다. 이 모델은 다양한 벤치마크를 통해 엄격하게 테스트되어 복잡한 쿼리 처리 및 다단계 추론 작업에서 이전 모델에 비해 개선 사항을 입증했습니다. 수학, 코딩 및 구조적 계획과 같은 주요 분야에서 o1-pro는 이전 모델보다 성능과 효율성 모두에서 향상된 정확성과 신뢰성을 보여줍니다. 최적화된 아키텍처는 복잡한 프롬프트를 더 잘 이해할 수 있도록 하여 고급 추론 및 확장된 문맥 기능이 필요한 응용 프로그램에 적합한 강력한 경쟁자가 됩니다.

자세한 사양과 벤치마크를 포함한 OpenAI 모델의 전체 비교는 공식 OpenAI 문서 페이지에서 확인할 수 있습니다.

OpenAI O1 Pro API 요건 및 요금 제한

| 티어 | 자격 요건 | 사용 한도 |

|---|---|---|

| 무료 | 사용자는 허용된 지역에 있어야 함 | $100/월 |

| 티어 1 | $5 결제 | $100/월 |

| 티어 2 | $50 결제 및 첫 번째 성공적인 결제 후 7일 이상 경과 | $500/월 |

| 티어 3 | $100 결제 및 첫 번째 성공적인 결제 후 7일 이상 경과 | $1,000/월 |

| 티어 4 | $250 결제 및 첫 번째 성공적인 결제 후 14일 이상 경과 | $5,000/월 |

| 티어 5 | $1,000 결제 및 첫 번째 성공적인 결제 후 30일 이상 경과 | $50,000/월 |

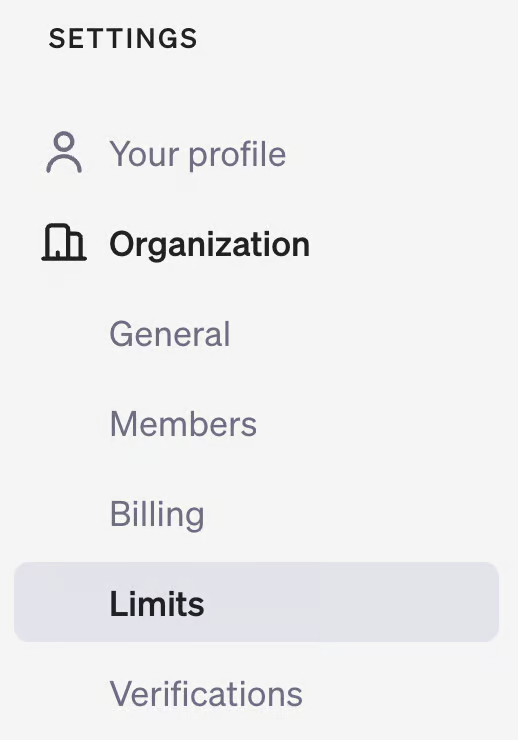

사용 티어를 확인하려면 OpenAI 개발자 플랫폼의 계정 페이지를 방문하고 "조직" 아래의 "한도" 섹션을 확인하세요.

o1 API 사용하는 방법

o1-pro를 애플리케이션에 구현하는 것은 간단합니다. 시작하려면 다음 단계를 따르세요:

1. 필수 조건

- OpenAI API 키 (여기서 받아놓으세요: OpenAI 대시보드)

- 적절한 라이브러리가 포함된 호환 개발 환경

- 충분한 API 크레딧 또는 OpenAI 계정에 연결된 결제 방법

2. 설치

선호하는 프로그래밍 언어용 OpenAI 라이브러리를 설치하세요:

파이썬의 경우:

pip install openai

자바스크립트의 경우:

npm install openai

기타 언어의 경우 OpenAI의 공식 문서에서 클라이언트 라이브러리를 참조하세요.

3. 파이썬 구현 예

다음은 세부 매개변수를 사용하여 파이썬에서 o1-pro를 사용하는 방법입니다:

from openai import OpenAI

client = OpenAI(api_key="your-api-key")

response = client.chat.completions.create(

model="o1-pro",

messages=[

{"role": "system", "content": "당신은 수학적 추론을 전문으로 하는 AI 어시스턴트입니다. 각 단계에 대한 설명과 함께 명확하고 단계별 솔루션을 제공하세요."},

{"role": "user", "content": "이 미적분 문제를 단계별로 해결하세요: f(x) = x^3*ln(x)의 미분을 구하세요."}

],

temperature=0.1, # 더 정확한 추론을 위해 낮은 온도 설정

max_tokens=1024, # 예상 응답 길이에 따라 조정

top_p=0.95,

frequency_penalty=0,

presence_penalty=0

)

print(response.choices[0].message.content)

4. 자바스크립트 구현 예

보다 자세한 구성이 필요한 Node.js 응용 프로그램의 경우:

import OpenAI from 'openai';

const openai = new OpenAI({

apiKey: 'your-api-key',

});

async function askO1Pro() {

try {

const response = await openai.chat.completions.create({

model: 'o1-pro',

messages: [

{role: 'system', content: '당신은 수학적 추론을 전문으로 하는 AI 어시스턴트입니다. 각 단계에 대한 설명과 함께 명확하고 단계별 솔루션을 제공하세요.'},

{role: 'user', content: '이 미적분 문제를 단계별로 해결하세요: f(x) = x^3*ln(x)의 미분을 구하세요.'}

],

temperature: 0.1,

max_tokens: 1024,

top_p: 0.95,

frequency_penalty: 0,

presence_penalty: 0

});

console.log(response.choices[0].message.content);

// 선택 사항: 토큰 사용 추적

console.log("프롬프트 토큰:", response.usage.prompt_tokens);

console.log("완료 토큰:", response.usage.completion_tokens);

console.log("총 토큰:", response.usage.total_tokens);

} catch (error) {

console.error('오류:', error);

}

}

askO1Pro();

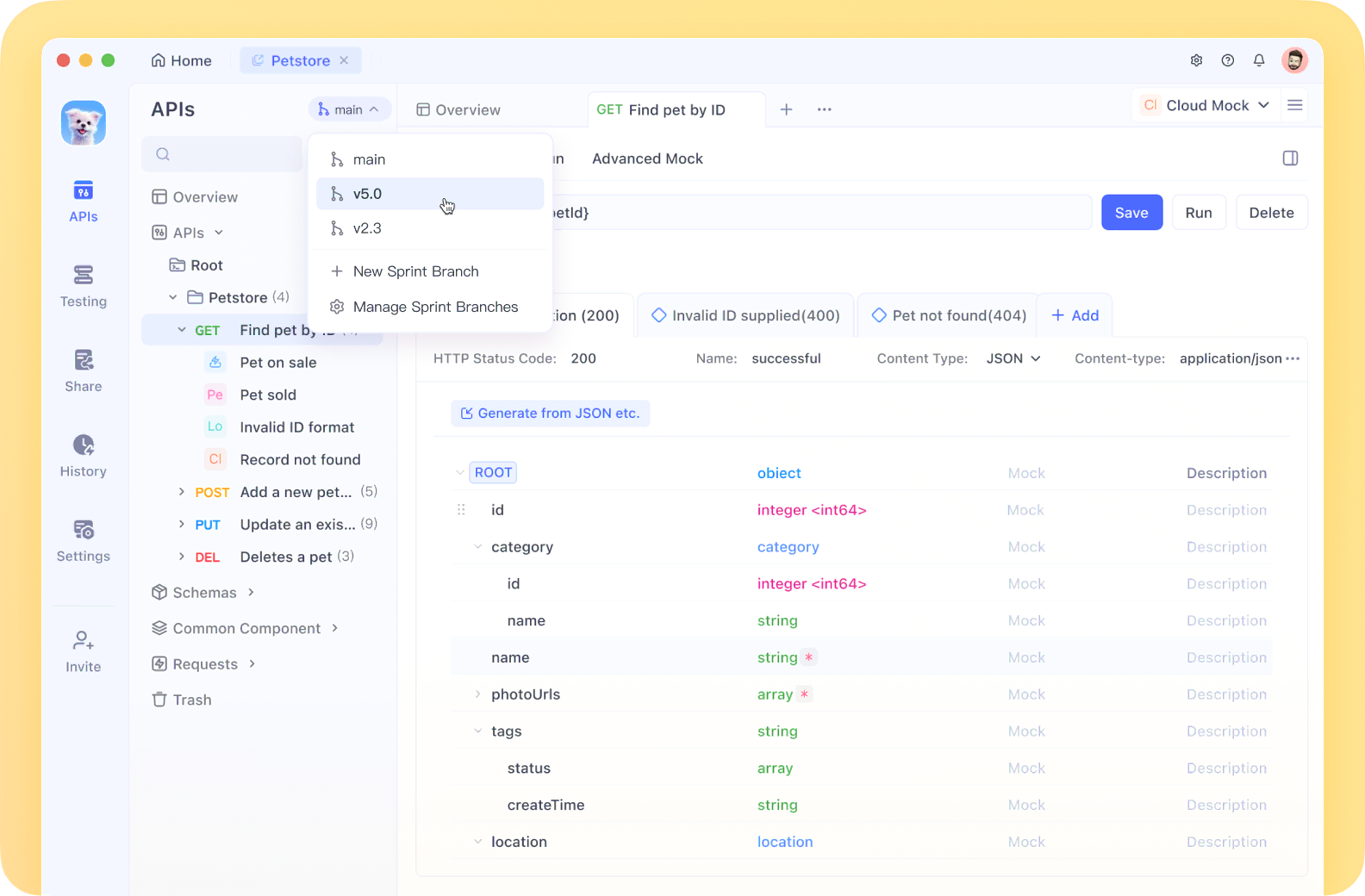

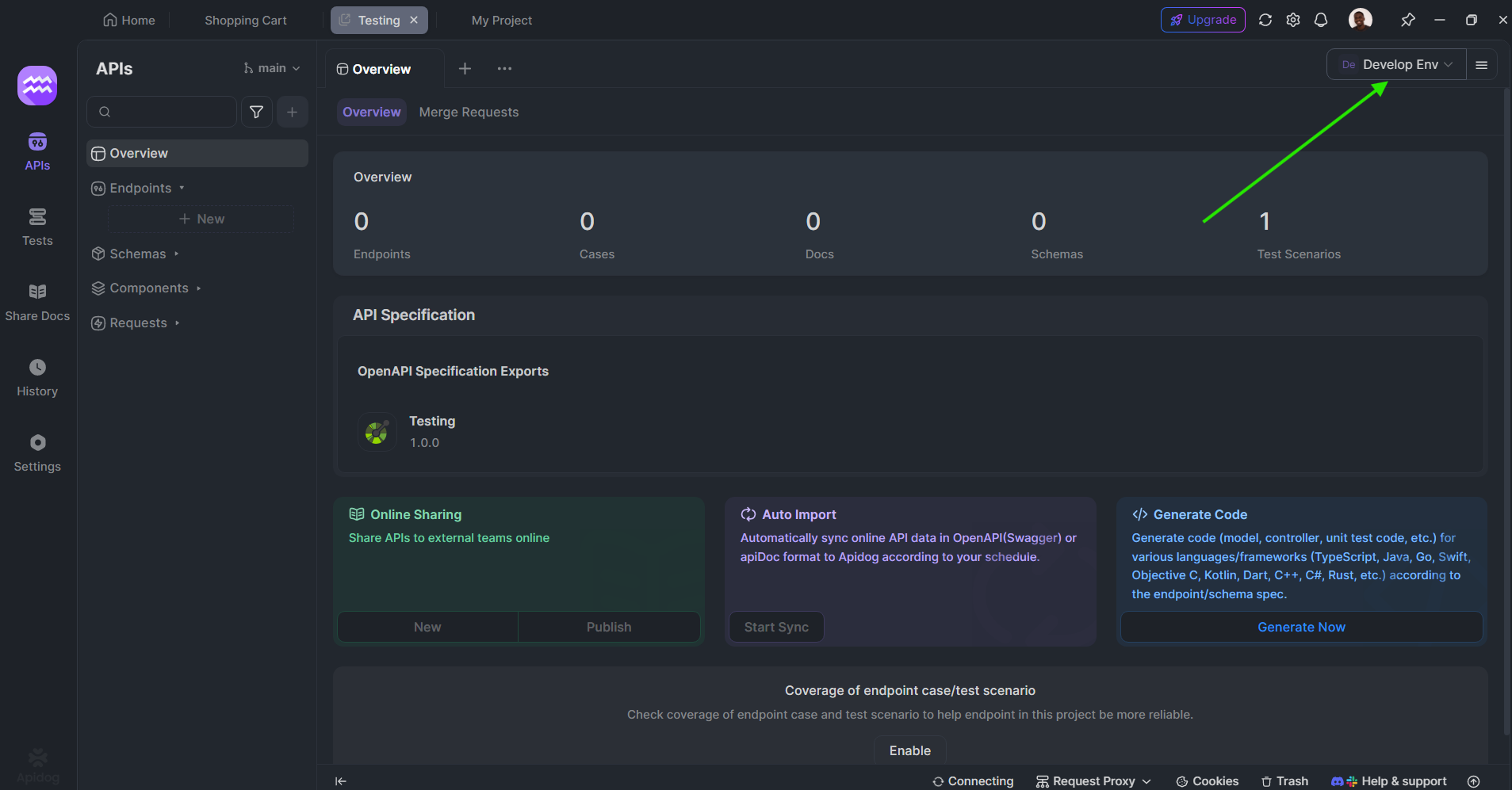

Apidog로 o1-pro API 테스트하기

Apidog는 o1-pro 및 기타 OpenAI API와 함께 작업할 때 업무를 크게 간소화할 수 있는 종합 API 개발 플랫폼입니다. Apidog를 테스트 및 통합에 활용하는 방법은 다음과 같습니다:

Apidog에서 o1-pro 설정하기

- 계정 만들기: 이미 계정이 없다면 apidog.com에서 Apidog의 가입하세요.

- 새 API 컬렉션 만들기: Apidog 대시보드에서 OpenAI API 전용의 새 컬렉션을 만듭니다.

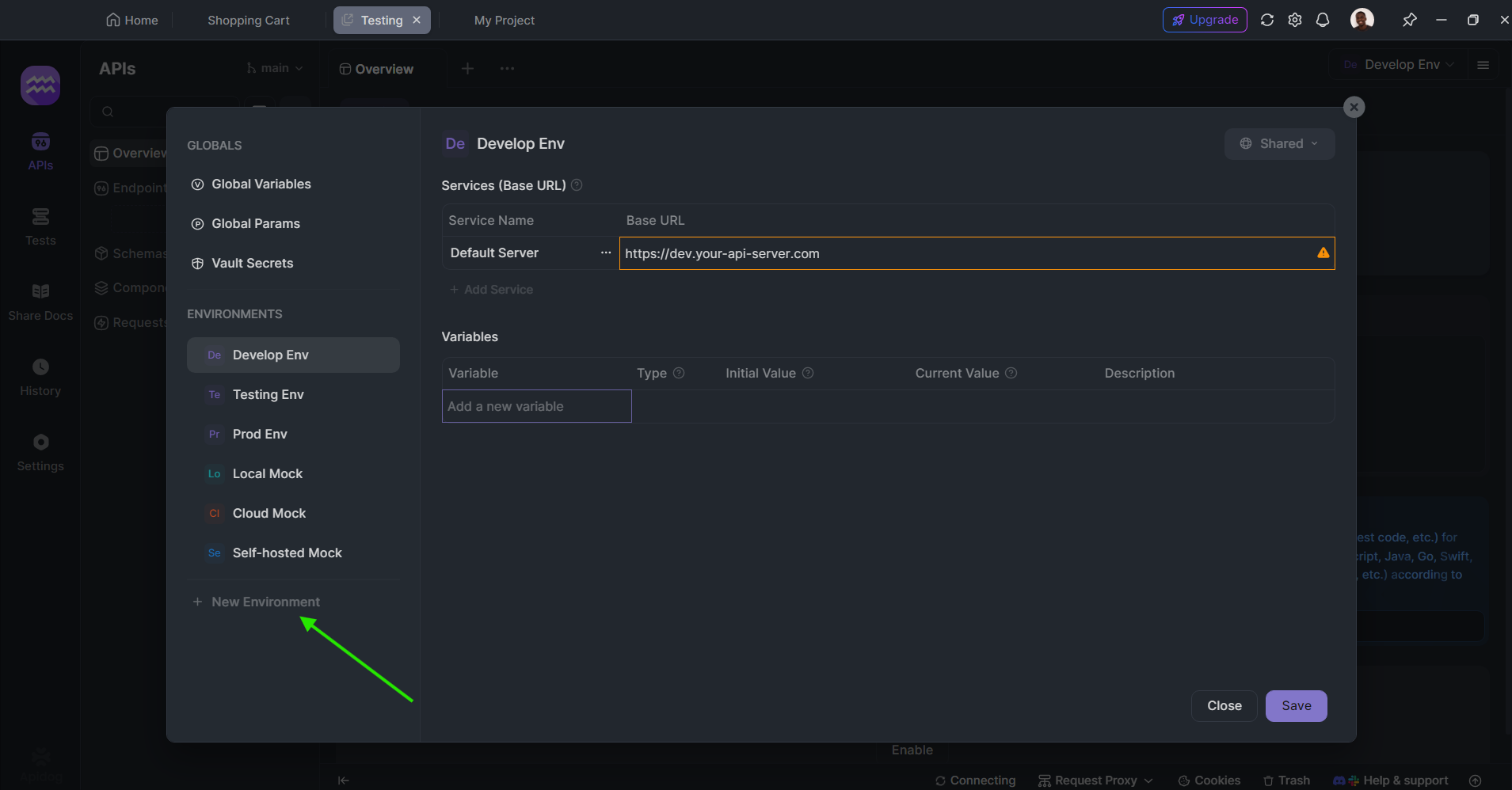

환경 변수 설정하기: OpenAI API 키를 환경 변수로 구성하여 안전하고 편리하게 접근하세요:

- 오른쪽 상단의 환경으로 이동하세요.

- "OpenAI"라는 새로운 환경을 만드세요.

- 실제 API 키를 값으로 가진 "OPENAI_API_KEY"라는 변수를 추가하세요.

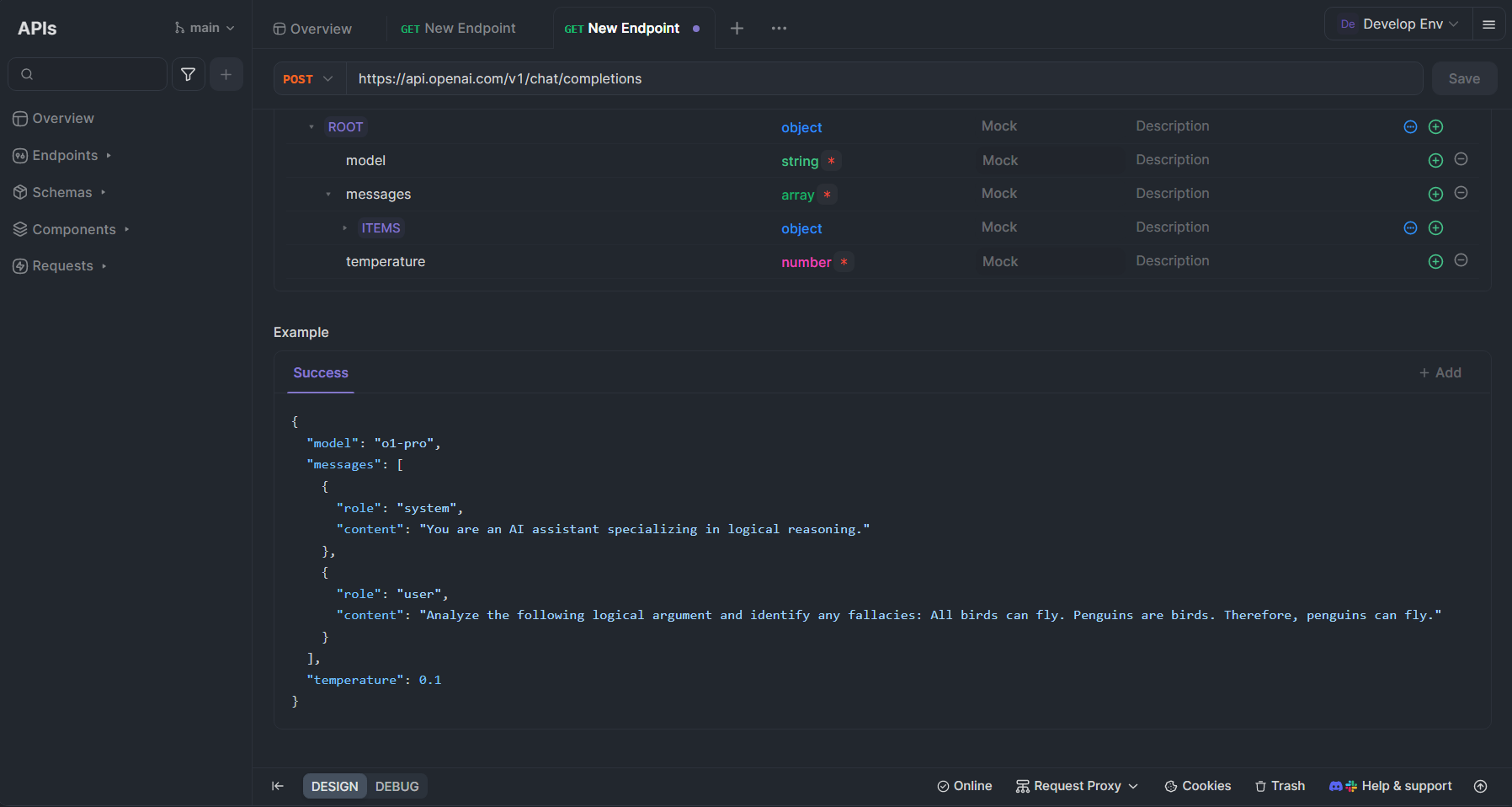

o1-pro 요청 만들기:

- 새 POST 요청을 만듭니다.

- URL을

https://api.openai.com/v1/chat/completions로 설정합니다. - 값이

Bearer {{OPENAI_API_KEY}}인 Authorization 헤더를 추가합니다. - 요청 본문 (JSON)에서 다음을 사용합니다:

{

"model": "o1-pro",

"messages": [

{

"role": "system",

"content": "당신은 논리적 추론을 전문으로 하는 AI 어시스턴트입니다."

},

{

"role": "user",

"content": "다음 논리적 주장을 분석하고 오류를 식별하세요: 모든 새는 날 수 있다. 펭귄은 새이다. 따라서 펭귄은 날 수 있다."

}

],

"temperature": 0.1

}

o1-pro와 Apidog 사용의 이점

Apidog는 o1-pro 작업에 여러 가지 이점을 제공합니다:

- 상호작용 테스트: API 호출을 실시간으로 테스트하고 형식화된 응답을 볼 수 있어 프롬프트를 반복하기 쉽습니다.

- 자동 문서화: API 구현을 자동으로 문서화하여 팀 협업을 용이하게 만듭니다.

- API 모킹: 개발 중 o1-pro API 호출에 대한 모의 응답을 생성합니다.

- 협업 기능: 팀원이 함께 개발할 수 있도록 API 컬렉션을 공유합니다.

- 환경 관리: 서로 다른 API 키로 개발, 준비 및 프로덕션 환경 간에 쉽게 전환합니다.

- 응답 시각화: 예산 관리를 위해 토큰 사용 및 비용에 대한 명확한 시각적 표현을 제공합니다.

- 요청 기록: 참고 및 최적화를 위해 이전 API 호출을 추적합니다.

o1-pro API 사용을 위한 모범 사례

o1-pro의 효과를 극대화하고 비용을 최적화하기 위해:

- 프롬프트를 명확하게 구조화하세요: 복잡한 추론 작업을 위해 명확한 지침과 예상 출력을 사용하여 프롬프트를 구조화하세요. 다중 파트 문제의 경우 글머리 기호나 번호 매기기를 고려하세요.

- 시스템 메시지를 효과적으로 사용하세요: o1-pro를 원하는 추론 접근 방식으로 안내하기 위해 시스템 메시지를 사용하여 컨텍스트를 설정하세요. 기대하는 추론 유형(연역적, 귀납적 등)에 대해 구체적으로 설명하세요.

온도 매개변수 조정:

- 더 정확하고 결정론적인 추론 및 수학적 문제를 위해 낮은 온도(0.1-0.3) 설정

- 약간의 유연성을 가진 균형 잡힌 추론을 위해 중간 온도(0.3-0.7) 설정

- 보다 창의적인 문제 해결 접근 방식에 대해 높은 온도 설정

- 단계별 사고 요청: 복잡한 문제를 해결할 때 세부적인 추론 단계를 명시적으로 요청하세요. "단계별로 이 문제를 생각하세요" 또는 "추론을 보여주세요"와 같은 문구는 o1-pro의 강점을 활성화하는 데 도움이 됩니다.

- 토큰 사용 모니터링: 비용을 효과적으로 관리하기 위해 입력 및 출력 토큰을 추적하세요. 애플리케이션에 토큰 추정 기능을 구현하는 것을 고려하세요.

- 관련 쿼리 묶기: 가능하다면 관련 질문을 단일 API 호출로 결합하여 여러 개의 개별 호출을 피하세요.

- 캐싱 구현: 자주 요청되는 정보에 대해 중복 API 호출을 피하기 위해 일반 응답을 캐싱하세요.

- 사고의 연쇄 기법 사용: 복잡한 문제의 경우 모델에게 최종 답변을 제공하기 전에 "이 문제를 단계별로 생각해보세요"라고 요청하여 사고의 연쇄 프롬프트를 구현하세요.

결론

o1-pro는 구조화된 사고 및 복잡한 문제 해결 작업을 위한 강력한 도구를 제공하는 AI 추론 기능의 중요한 발전을 나타냅니다. 경쟁력 있는 가격 구조와 간단한 구현 덕분에 고급 추론 기능으로 애플리케이션을 향상시키려는 개발자에게 접근할 수 있게 되었습니다.

이 문서에서 설명한 구현 지침 및 모범 사례를 따르면 o1-pro를 워크플로에 효과적으로 통합하고 API 비용을 효율적으로 관리하면서 정교한 추론 능력을 활용할 수 있습니다. Apidog와 같은 도구는 개발 및 테스트 프로세스를 더욱 간소화하여 특정 사용 사례에 대해 o1-pro의 모든 잠재력을 활용할 수 있도록 돕습니다.

AI 추론 능력이 지속적으로 발전함에 따라 o1-pro와 같은 모델은 단순한 지능이 아니라 사용자가 따르고 이해할 수 있는 구조화된 논리적 사고를 요구하는 응용 프로그램의 필수 구성 요소가 될 것입니다.