¿Estás ansioso por aprovechar las capacidades de los modelos de lenguaje avanzados Llama de Meta sin gastar un céntimo? En esta guía detallada, te mostraremos dos métodos prácticos para usar la API de Llama de forma gratuita: aprovechando OpenRouter y Together AI.

¿Qué es la API de Llama?

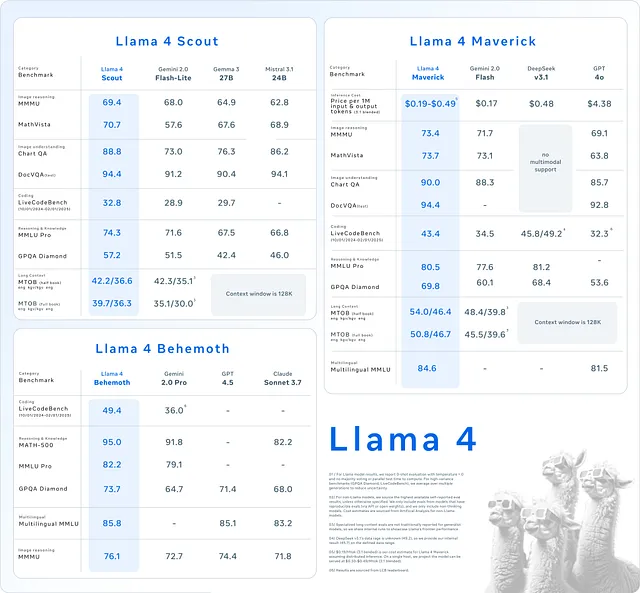

La API de Llama proporciona acceso a la familia de modelos de lenguaje de Meta, incluyendo Llama 3 y Llama 4. Estos modelos destacan en tareas como la generación de texto, la comprensión contextual e incluso aplicaciones multimodales que involucran imágenes. Los desarrolladores utilizan la API de Llama para impulsar aplicaciones que van desde chatbots hasta herramientas de generación de contenido, todo sin necesidad de entrenar modelos desde cero.

Si bien estos modelos son impresionantes, acceder a ellos generalmente implica costes, a menos que sepas dónde buscar. Afortunadamente, plataformas como OpenRouter y Together AI ofrecen acceso gratuito a ciertos modelos Llama. En esta guía, cubriremos ambos métodos, completos con instrucciones paso a paso y ejemplos de código para empezar.

¿Por qué elegir la API de Llama?

Antes de pasar a los métodos, consideremos por qué la API de Llama destaca. Primero, ofrece procesamiento de lenguaje de primer nivel, permitiendo que las aplicaciones produzcan texto coherente y similar al humano. Luego, las versiones más recientes como Llama 4 introducen características multimodales, permitiendo que el modelo maneje tanto texto como imágenes, un cambio radical para proyectos innovadores. Finalmente, usar la API ahorra tiempo y recursos en comparación con la construcción de modelos personalizados.

Con eso en mente, exploremos cómo acceder a la API de Llama de forma gratuita.

Método 1: Usar OpenRouter para acceder a la API de Llama de forma gratuita

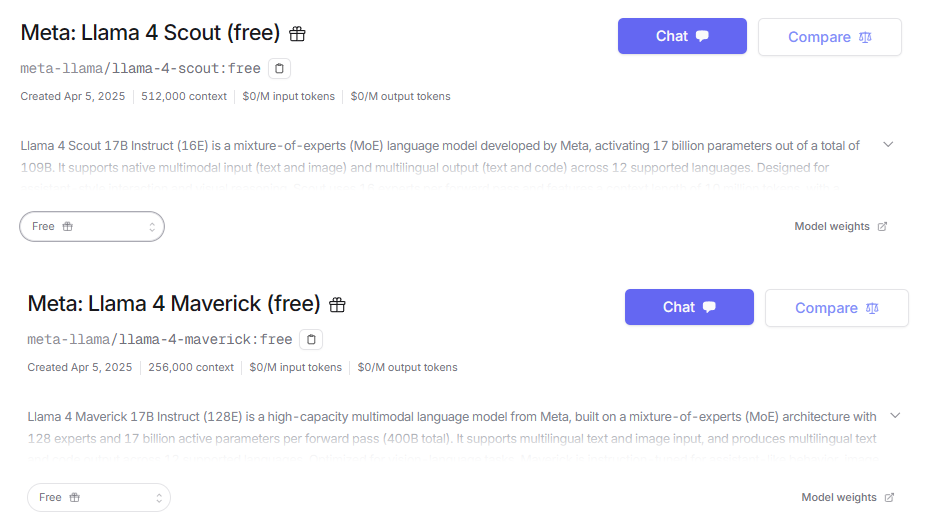

OpenRouter sirve como una plataforma API unificada, otorgando acceso a más de 300 modelos de IA, incluida la serie Llama de Meta. Lo mejor de todo es que ofrece un nivel gratuito que incluye modelos como Llama 4 Maverick y Llama 4 Scout. Esto convierte a OpenRouter en un punto de partida ideal para desarrolladores que buscan acceso gratuito a IA de vanguardia.

Paso 1: Registrarse y obtener una clave API

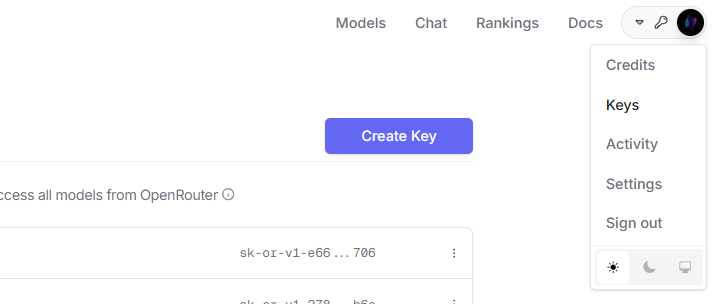

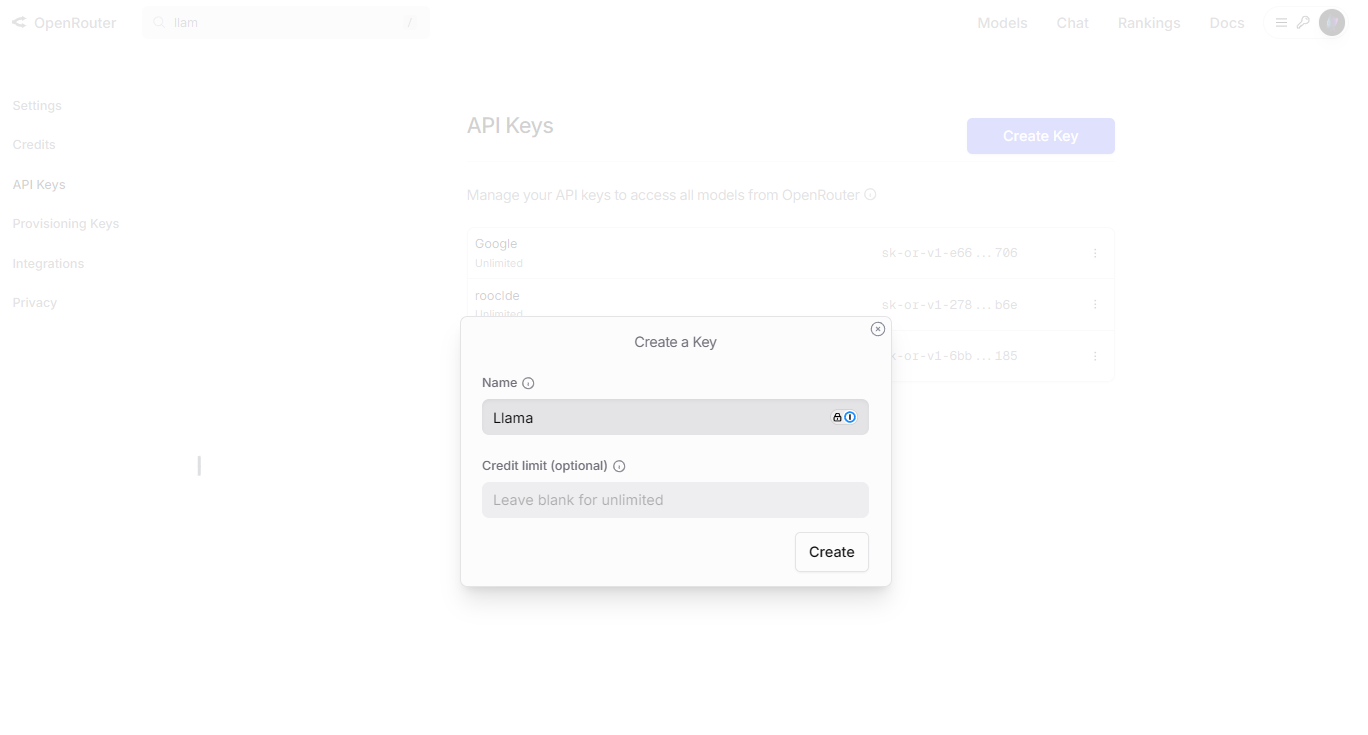

Para empezar, necesitas una cuenta de OpenRouter y una clave API. Sigue estos pasos:

Navega al sitio web de OpenRouter y haz clic en "Sign Up" (Registrarse). Inicia sesión, luego dirígete a la sección "API Keys" (Claves API) en tu panel de control.

Haz clic en "Create Key" (Crear clave), nómbrala (por ejemplo, "Llama Free Key") y copia la clave de forma segura.

Paso 2: Configurar tu entorno

Necesitarás un lenguaje de programación y una biblioteca cliente HTTP para interactuar con la API. Usaremos Python con la biblioteca requests. Instálala si aún no lo has hecho:

pip install requests

Paso 3: Enviar tu primera solicitud

Ahora, escribamos un script de Python para generar texto usando el modelo Llama 4 Scout a través de OpenRouter:

import requests

import json

# Define the endpoint and your API key

API_URL = "https://openrouter.ai/api/v1/chat/completions"

API_KEY = "your_api_key_here" # Replace with your actual key

# Set headers for authentication

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

# Create the payload with model and prompt

payload = {

"model": "meta-llama/llama-4-scout:free",

"messages": [

{"role": "user", "content": "Describe the Llama API in one sentence."}

],

"max_tokens": 50

}

# Send the request

response = requests.post(API_URL, headers=headers, data=json.dumps(payload))

# Handle the response

if response.status_code == 200:

result = response.json()

print(result["choices"][0]["message"]["content"])

else:

print(f"Error: Request failed with status {response.status_code}")

Este script envía una instrucción al modelo Llama 4 Scout e imprime la respuesta. Ajusta max_tokens para controlar la longitud de la salida.

Paso 4: Experimentar con características

OpenRouter admite personalización. Por ejemplo, ajusta el parámetro temperature para modificar la creatividad de la respuesta, o explora las capacidades multimodales con modelos como Llama 4 Maverick. Consulta la página de modelos de OpenRouter para obtener detalles sobre las opciones disponibles.

Método 2: Usar Together AI para acceder a la API de Llama de forma gratuita

Together AI es otra plataforma que aloja modelos Llama, ofreciendo acceso gratuito a modelos de Llama 3 como Llama 3.2 11B. Sin embargo, ten en cuenta que Llama 4 no es gratuito en Together AI en este momento; solo los planes de pago lo desbloquean. Si Llama 3 satisface tus necesidades, este método funciona bien.

Paso 1: Registrarse y obtener una clave API

Comienza configurando una cuenta de Together AI:

Visita el sitio web de Together AI y ve a la sección "API Keys" (Claves API) y genera una nueva clave.

Guarda la clave de forma segura para usarla en tus solicitudes.

Paso 2: Preparar tu entorno

Al igual que con OpenRouter, usaremos Python y requests. Instálalo si es necesario:

pip install requests

Paso 3: Realizar una llamada API

Aquí tienes un script de Python para generar texto con el modelo Llama 3 en Together AI:

import requests

import json

# Define the endpoint and your API key

API_URL = "https://api.together.xyz/inference"

API_KEY = "your_api_key_here" # Replace with your actual key

# Set headers for authentication

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

# Create the payload with model and prompt

payload = {

"model": "llama-3-2-11b-free",

"prompt": "What does the Llama API do?",

"max_tokens": 50,

"temperature": 0.7

}

# Send the request

response = requests.post(API_URL, headers=headers, data=json.dumps(payload))

# Handle the response

if response.status_code == 200:

result = response.json()

print(result["output"]["text"])

else:

print(f"Error: Request failed with status {response.status_code}")

Este script consulta el modelo Llama 3 y muestra la salida. La configuración de temperature equilibra la creatividad y la coherencia.

Paso 4: Conocer los límites

El nivel gratuito de Together AI tiene restricciones, como límites de tasa y no acceso a Llama 4. Revisa la página de modelos de Together AI para entender qué está disponible y planificar en consecuencia.

Optimizando tu experiencia con la API de Llama

Para maximizar tu éxito con la API de Llama, adopta estas prácticas:

- Elabora Instrucciones Precisas: Las instrucciones claras producen mejores resultados. Prueba variaciones para refinar las salidas.

- Seguimiento del Uso: Monitoriza tus llamadas API a través de los paneles de OpenRouter o Together AI para mantenerte dentro de los límites del nivel gratuito.

- Manejo de Errores: Añade bloques try-except en tu código para gestionar los fallos de manera elegante.

- Caché de Respuestas: Almacena los resultados de consultas frecuentes para reducir el uso de la API y acelerar tu aplicación.

Estos pasos aseguran eficiencia y fiabilidad en tus proyectos.

Solución de problemas comunes

Pueden surgir problemas al usar la API de Llama. Aquí te mostramos cómo solucionarlos:

- 401 No autorizado: Verifica que tu clave API sea correcta y esté incluida en los encabezados.

- 429 Demasiadas solicitudes: Has alcanzado el límite de tasa; espera o actualiza tu plan.

- Modelo inválido: Confirma que el nombre del modelo coincide con la documentación del proveedor.

- Carga útil incorrecta: Revisa tu sintaxis JSON. Herramientas como Apidog pueden ayudarte a depurar esto.

Hablando de herramientas, descarga Apidog gratis para simplificar las pruebas y la solución de problemas de tus llamadas API; es imprescindible para los desarrolladores.

Comparando OpenRouter y Together AI

Ambas plataformas ofrecen acceso gratuito, pero difieren:

- Disponibilidad de modelos: OpenRouter incluye Llama 4 de forma gratuita; Together AI limita el acceso gratuito a Llama 3.

- Facilidad de uso: Ambas proporcionan APIs sencillas, pero la selección más amplia de modelos de OpenRouter destaca.

- Escalabilidad: Together AI puede impulsar planes de pago para características avanzadas, mientras que el nivel gratuito de OpenRouter es más generoso.

Elige según las necesidades de tu proyecto: el acceso a Llama 4 se inclina hacia OpenRouter, mientras que Together AI es adecuado para usuarios de Llama 3.

Casos de uso para la API de Llama

La API de Llama destaca en varios escenarios:

- Chatbots: Crea agentes conversacionales con respuestas naturales.

- Creación de contenido: Genera artículos, resúmenes o subtítulos.

- Aplicaciones multimodales: Combina el procesamiento de texto e imágenes con Llama 4 (a través de OpenRouter).

Estas aplicaciones muestran la versatilidad de la API, todas alcanzables de forma gratuita con la configuración adecuada.

Conclusión

En esta guía, hemos demostrado cómo usar la API de Llama de forma gratuita a través de OpenRouter y Together AI. OpenRouter otorga acceso a modelos Llama 4, mientras que Together AI ofrece Llama 3 en su nivel gratuito. Con instrucciones detalladas y fragmentos de código, ahora estás equipado para integrar estos modelos en tus proyectos. Comienza a experimentar hoy mismo y no olvides aprovechar herramientas como Apidog para mejorar tu flujo de trabajo. El poder de Llama es tuyo, ¡úsalos sabiamente!