お気に入りのコーディングIDE内で最も先進的なオープンソースAIモデルを使いたいと思ったことはありませんか?しかし、ドロップダウンにそのモデルがないと気づいたことは?Moonshot AIの強力なマルチモーダルでエージェント対応モデルであるKimi K2.5を使えば、ネイティブにサポートされていなくてもCursorに統合できるようになります。公式サポートを待つ代わりに、このガイドでは、Kimi K2.5をCursorに接続する方法を正確に示し、エディターから直接、コーディング、推論、ツール駆動のワークフローに利用できるようにします。

Kimi K2.5をCursorに追加する理由

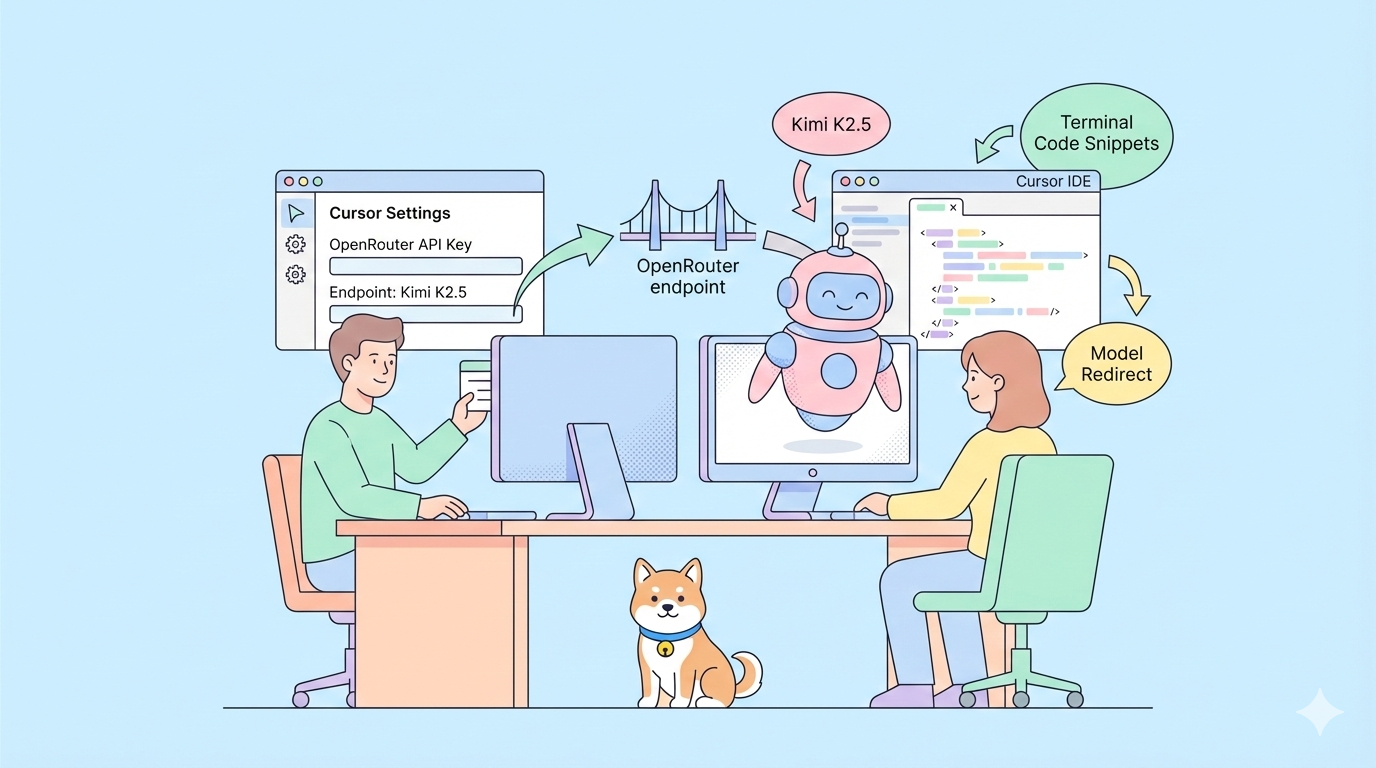

Cursorは、AIモデルとエディター内で直接対話できる人気のAI支援開発環境です。しかし、特にKimi K2.5のような新しくリリースされた、または登場しつつあるオープンモデルは、すべてのモデルが組み込みのモデルセレクターで利用できるわけではありません。K2.5の強力なコーディングおよび推論機能を活用したいのに、Cursorのドロップダウンに表示されない場合でも、あなたは一人ではありません。幸いなことに、OpenRouterのようなプロバイダーエンドポイントや直接のMoonshot APIアクセスを使用して、Kimi K2.5をカスタムモデルとして追加するという実用的な回避策があります。

これは重要です。なぜなら、開発者はますます柔軟性を求めており、IDEにバンドルされているものに縛られるのではなく、AIワークフローを動かすモデルを選択する能力を求めているからです。このガイドでは、Cursorの設定、カスタムモデルのサポート、APIキーを使用して、その接続を機能させる方法を詳しく説明します。

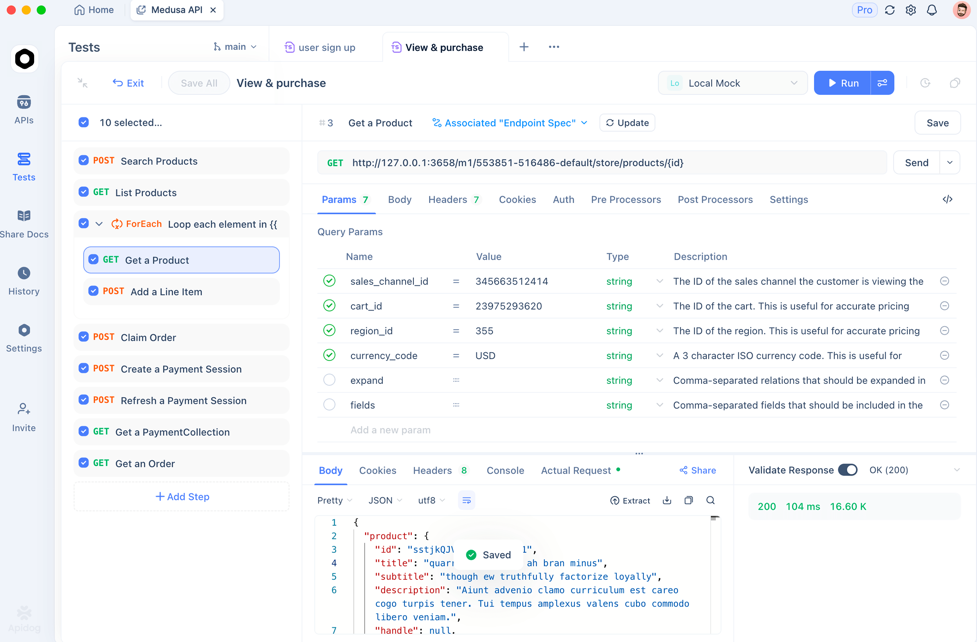

💡プロのヒント: Cursorで設定する前に、ApidogでAPIエンドポイントをテストしてください。これにより認証エラーを防ぎ、カスタムモデルの統合が最初から機能することを保証します。

開発チームが最大限の生産性で協力できる、統合されたオールインワンプラットフォームをお探しですか?

Apidogはあなたのすべての要求に応え、Postmanをはるかに手頃な価格で置き換えます!

Kimi K2.5の機能について

統合する前に、Kimi K2.5がCursorのワークフローで価値を発揮する理由を以下に示します。

- マルチモーダル機能: テキスト、コード、視覚データをネイティブに処理

- エージェント設計: 推論、ツール呼び出し、複数ステップのワークフロー向けに構築

- オープンAPIアクセス: MoonshotのAPIエンドポイントやOpenRouterのようなサードパーティプロバイダーを通じて利用可能

- 大規模なコンテキストウィンドウ: 複雑なプロジェクト理解のために最大256Kトークン

- コスト効率: 同等のパフォーマンスで西洋の代替品よりも手頃な価格

Kimi K2.5はCursorでまだネイティブにサポートされていませんが、OpenAI互換のAPIであるため、手動で接続し、まるでネイティブであるかのように使用できます。

Kimi K2.5 APIプロバイダーの選択

✅ オプションA(OpenRouter経由)

OpenRouterは、一つのインターフェースを通じて複数のAIモデルにアクセスできるユニバーサルAPIゲートウェイとして機能します。

- OpenRouter.aiでサインアップする

- API使用のためのクレジットを追加する

- 設定 → キー でAPIキーを生成する

このキーはOpenRouterへのリクエストを認証し、Kimi K2.5へのルーティングをサポートします。

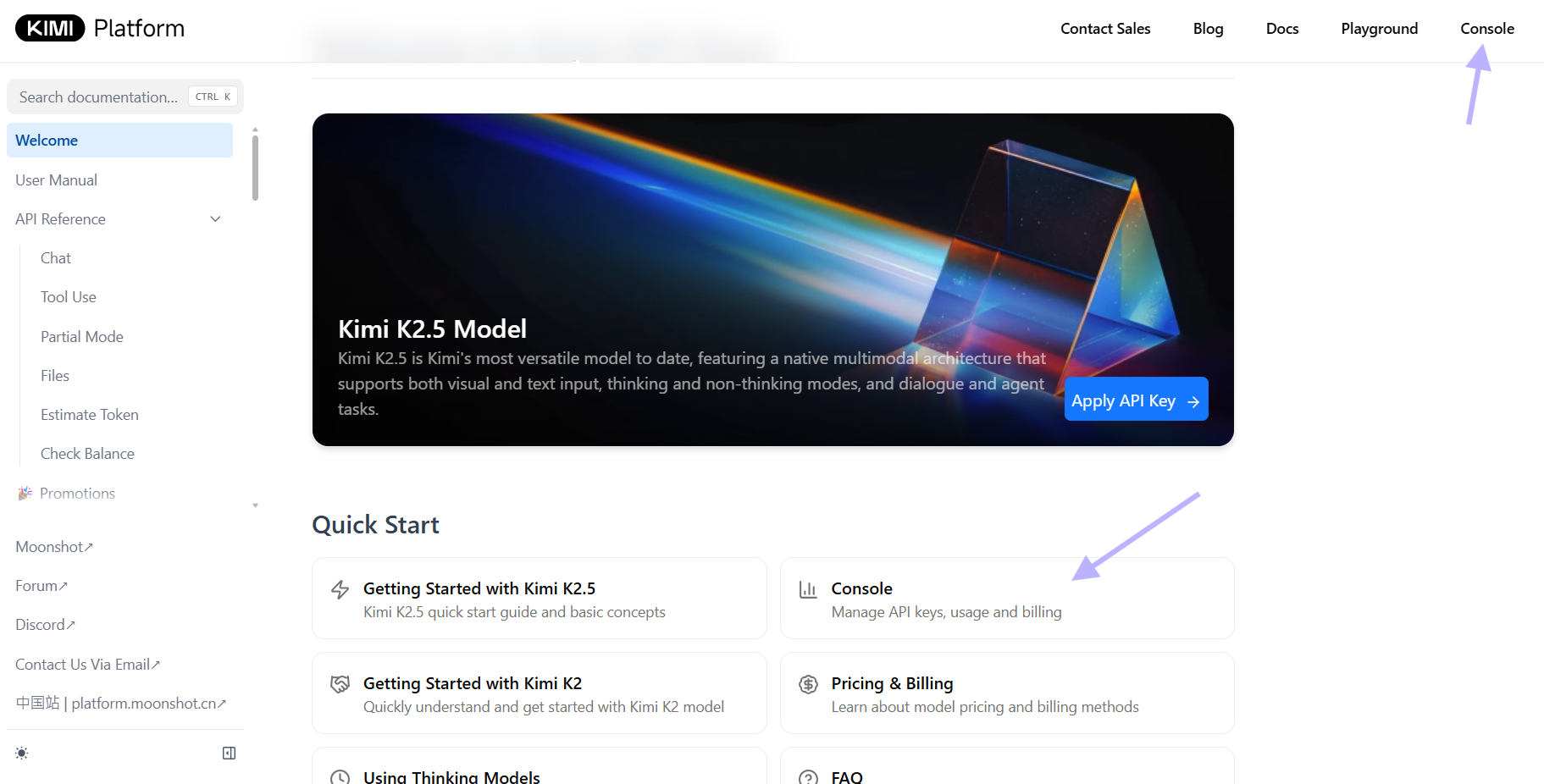

✅ オプションB(Moonshot API経由)

Moonshotの開発者ポータルにアクセスできる場合:

- Moonshotのプラットフォームにログインする

- エンドポイント用のAPIキーを作成または取得する

- OpenAI互換エンドポイントを使用する - Moonshotは `moonshot/kimi-k2.5` をサポートしています

Moonshotのエンドポイントは、直接API接続のシンプルさで、完全な256Kコンテキストとマルチモーダルサポートを提供します。

💡プロのヒント: Moonshotの公式エンドポイントはOpenAI互換フォーマットを使用しているため、Cursorのカスタムモデル設定に最適です。

Cursorでのカスタムモデル設定

プロバイダーを設定したら、Cursorを適切なエンドポイントに向ける時が来ました。

🧩 Cursor設定を開く

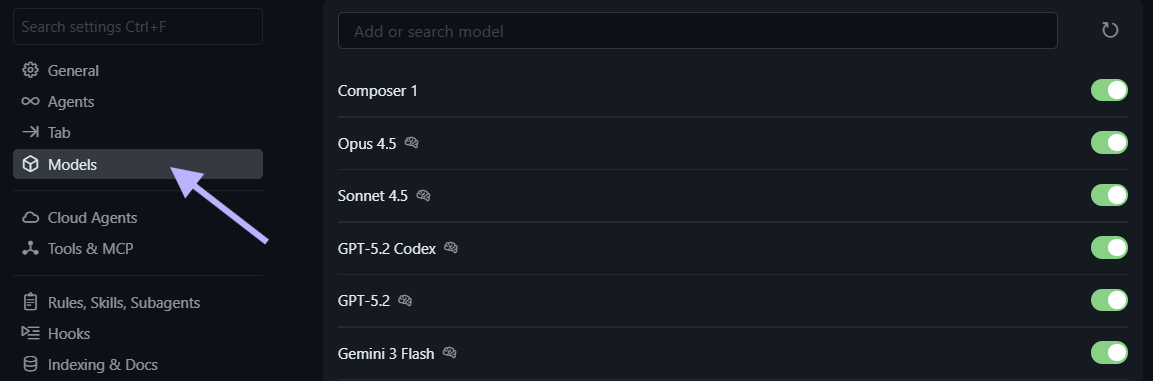

- Cursorを開く

- 設定 → モデルに移動する。

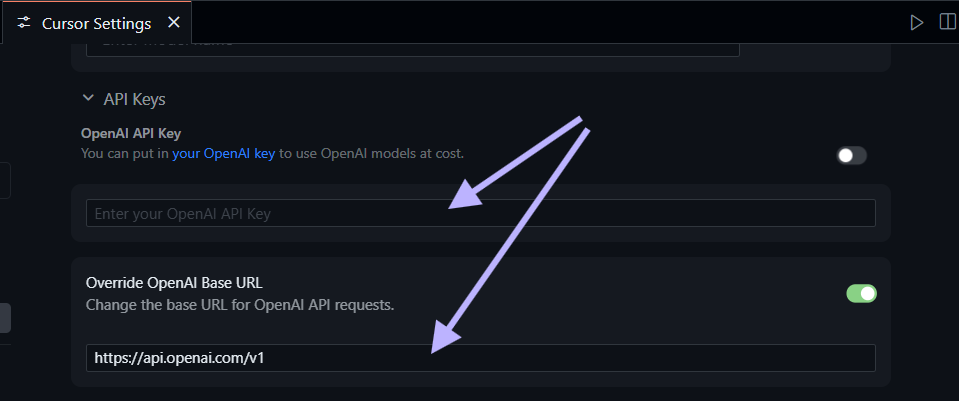

🔌 ベースAPI URLを更新する

お使いのプロバイダーに応じて

OpenRouter設定:

Base URL: https://openrouter.ai/api/v1

認証: あなたのOpenRouter APIキーMoonshot設定:

Base URL: https://api.moonshot.cn/v1

認証: あなたのMoonshot APIキー⚠️重要: 「プロバイダーがサポートされていません」エラーが発生した場合、ベースURLがKimi K2.5を明示的にサポートするプロバイダーを指していることを確認してください。

Kimi K2.5をカスタムモデルとして追加する

CursorのカスタムモデルUIを使用すると、ネイティブにリストされていないモデルを追加できます。

Kimi K2.5モデルを追加する

- 設定 → モデルで、カスタムモデルを追加を選択する

- モデルスラッグ(名前)に、以下を入力する:

moonshot/kimi-k2.5

- OpenRouter経由でアクセスする場合は `moonshotai/kimi-k2.5` を使用

- Moonshot経由で直接アクセスする場合は `moonshot/kimi-k2.5` を使用

3. モデル設定を保存する

4. リストにモデルが表示されない場合は、Cursorの設定を更新する

✅クイックウィン: モデルを追加した後、ネイティブモデルとともにドロップダウンに表示されるはずです。

トラブルシューティング

- モデルが表示されない? ベースURLが正しく、APIキーが有効であることを確認してください

- 認証エラー? APIキーの有効期限が切れておらず、十分なクレジットがあることを確認してください

- レート制限? 一部のプロバイダーは1分あたりのリクエスト数を制限する場合があります

Kimi K2.5統合のテスト

CursorがKimi K2.5を指すようになったので、すべてが機能していることを確認するために、簡単なプロンプトでテストしてください。

# 例のプロンプト

Pythonで、組み込み関数と型ヒントを使用して2つの大きなリストを効率的に交差させる関数を記述してください。Cursorはこれを設定されたプロバイダー経由でKimi K2.5に送信し、応答を表示します。何も表示されない場合、またはモデルがデフォルトに戻る場合は、カスタムモデル設定を見直し、モデルスラッグまたはAPIエンドポイントにタイプミスがないことを確認してください。

💡プロのヒント: 複雑な複数ファイルプロジェクトに進む前に、簡単なコーディングタスクから始めてください。これにより、モデルの推論機能が正しく機能していることを確認できます。

Cursorでの実用的なアプリケーション

Kimi K2.5を設定すると、一般的なAIを活用した開発タスクに利用できます。

💡コード生成とリファクタリング

- 明確に定義されたドキュメント文字列と型アノテーションを持つ関数を生成する

- 整理と可読性を向上させて複雑なモジュールをリファクタリングする

- 最新のPythonのベストプラクティスに沿ったパターンとイディオムを提案する

# 例のプロンプト

このクラスを、明確な単一責任を持つより小さな関数にリファクタリングしてください。🧠推論とデバッグ

- 密集したロジックやアルゴリズムを明確な例で説明する

- パフォーマンスのボトルネックに対する最適化の提案を得る

- アーキテクチャ上の決定をレビューし、改善を提案する

# 例のプロンプト

この再帰アルゴリズムがスタック制限を超える可能性がある理由を説明し、反復バージョンを提案してください。🔄ワークフロー自動化

- 一般的なプロジェクト構造のボイラープレートコードを生成する

- API仕様からテストスイートを自動的に作成する

- 自動テストのためのCI/CDパイプラインを設定する

💡Apidog統合: APIワークフローをテストする際、Apidogの視覚的なインターフェースを使用して、リクエストのデバッグ、レスポンスの検証、本番環境対応コードの生成を行ってください。

高度な設定オプション

🌐環境変数管理

本番環境設定では、ハードコードされた認証情報ではなく環境変数を使用してください。

# シェルプロファイル (.zshrc, .bashrc) に追加

export OPENROUTER_API_KEY="your-key-here"

export MOONSHOT_API_KEY="your-key-here"その後、Cursorの設定で標準の${ENV_VAR}形式を使用してこれらを参照します。

🚀パフォーマンス最適化

- 不要な場合は応答を高速化するためにコンテキスト長を短縮する

- 温度設定を調整する(創造的な場合は0.7、分析的な場合は0.3)

- 長い生成においてリアルタイムフィードバックのためにストリーミング応答を使用する

- 繰り返しタスクを扱う際には一般的なクエリをキャッシュする

🔒セキュリティのベストプラクティス

- APIキーをバージョン管理にコミットしない

- HTTPSエンドポイントのみを使用する

- プロバイダーのダッシュボードで使用状況を監視し、支出制限を設定する

- 本番環境ではAPIキーを定期的にローテーションする

⚠️セキュリティに関する注意: APIテストにApidogを使用すると、本番デプロイメント前にセキュリティ設定を検証できます。

一般的な問題のトラブルシューティング

問題: 「モデルが応答しません」

- 原因: APIエンドポイントが間違っているか、認証に失敗している

- 解決策: ベースURLとAPIキーを確認し、Cursorを再起動する

問題: 「レート制限を超過しました」

- 原因: 短時間にプロバイダーへのリクエストが多すぎる

- 解決策: 60秒待ってから再試行するか、プロバイダープランをアップグレードする

問題: 「コンテキストウィンドウが小さすぎます」

- 原因: Kimi K2.5の256Kではなく、プロバイダーがデフォルトで4Kコンテキストを使用している

- 解決策: プロバイダー設定を確認し、完全なコンテキストが有効になっていることを確認する

問題: 「認証トークンの有効期限が切れました」

- 原因: APIキーの有効期限が切れている

- 解決策: 新しいAPIキーを生成し、設定を更新する

結論

Kimi K2.5をCursorに統合することで、ネイティブサポートがなくても、お気に入りの開発環境で柔軟で強力なAIモデルを利用できるようになります。OpenRouterまたはMoonshotを通じてカスタムAPIエンドポイントを設定することで、K2.5のマルチモーダル機能、256Kのコンテキストウィンドウ、およびエージェントの動作にアクセスできます。

このアプローチにより、プロジェクトのニーズ、予算、プライバシー要件に基づいてモデルを選択する能力という、AIワークフローを完全に制御できます。数分でセットアップし、設定を検証して、コードを記述する場所で直接Kimi K2.5の高度な推論とコーディング機能を活用し始めてください。

次のステップ:

- プロバイダーを選択する(柔軟性のためにはOpenRouter、直接アクセスのためにはMoonshot)

- 環境またはCursor設定でAPI認証情報を設定する

- 正しいスラッグを使用してKimi K2.5をカスタムモデルとして追加する

- 重要なプロジェクトを開始する前に、簡単なコーディングタスクで統合をテストする

- Apidogを使用して、APIワークフローを検証し、問題を効率的にデバッグする

💡最後のヒント: カスタムAIモデルを使用している開発者コミュニティに参加して、ワークフロー、トラブルシューティングのヒント、およびCursorでKimi K2.5の可能性を最大限に引き出すための創造的なソリューションを共有しましょう。