Pengembang terus mencari model AI canggih untuk meningkatkan penalaran, pengodean, dan pemecahan masalah dalam aplikasi mereka. API Qwen3-Max-Thinking menonjol sebagai versi pratinjau yang mendorong batas-batas di area ini. Panduan ini menjelaskan bagaimana insinyur mengakses dan mengimplementasikan API ini secara efektif. Selain itu, panduan ini menyoroti alat-alat yang menyederhanakan prosesnya.

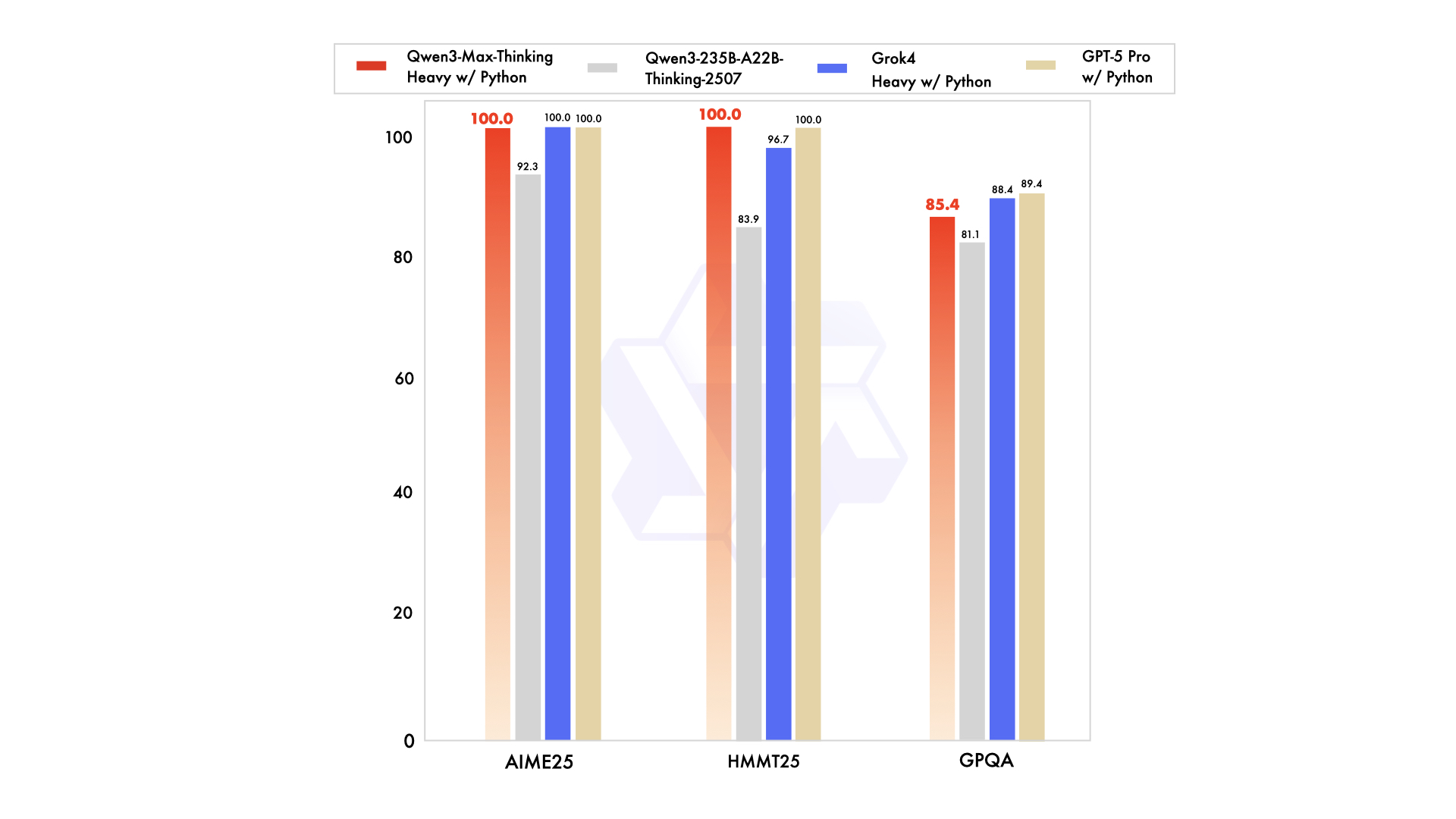

Alibaba Cloud mendukung API Qwen3-Max-Thinking, menyediakan pratinjau awal kemampuan berpikir yang ditingkatkan. Dirilis sebagai titik pemeriksaan menengah selama pelatihan, model ini mencapai kinerja luar biasa pada tolok ukur seperti AIME 2025 dan HMMT ketika digabungkan dengan penggunaan alat dan komputasi berskala. Selanjutnya, pengguna mengaktifkan mode berpikir dengan mudah melalui parameter seperti enable_thinking=True. Seiring kemajuan pelatihan, harapkan fitur yang lebih kuat. Artikel ini mencakup segala hal mulai dari pendaftaran hingga penggunaan tingkat lanjut, memastikan Anda mengintegrasikan API Qwen3-Max-Thinking dengan lancar ke dalam alur kerja Anda.

Memahami API Qwen3-Max-Thinking

Para insinyur mengakui API Qwen3-Max-Thinking sebagai evolusi dari seri Qwen Alibaba, yang secara khusus dirancang untuk tugas penalaran superior. Tidak seperti model standar, pratinjau ini menggabungkan "anggaran berpikir" yang memungkinkan pengguna mengontrol kedalaman penalaran di area seperti matematika, pengodean, dan analisis ilmiah. Alibaba merilis versi ini untuk menunjukkan kemajuan, bahkan saat pelatihan berlanjut.

Model dasar Qwen3-Max memiliki lebih dari satu triliun parameter dan pelatihan pada 36 triliun token, menggandakan volume data pendahulunya, Qwen2.5. Ini mendukung jendela konteks besar 262.144 token, dengan input maksimum 258.048 token dan output 65.536 token. Selain itu, ia menangani lebih dari 100 bahasa, menjadikannya serbaguna untuk aplikasi global. Namun, varian Qwen3-Max-Thinking menambahkan fitur agen, mengurangi halusinasi dan memungkinkan proses multi-langkah melalui panggilan alat Qwen-Agent.

Metrik kinerja menggarisbawahi kekuatannya. Misalnya, ia mencetak 74,8 pada LiveCodeBench v6 untuk pengodean dan 81,6 pada AIME25 untuk matematika. Ketika ditingkatkan, ia mencapai 100% pada tolok ukur yang menantang seperti AIME 2025 dan HMMT. Namun demikian, pratinjau ini beroperasi sebagai model instruksi non-pemikir pada awalnya, dengan peningkatan penalaran diaktifkan melalui tanda-tanda khusus. Pengembang mengaksesnya melalui API Alibaba Cloud, yang mempertahankan kompatibilitas dengan standar OpenAI untuk migrasi yang mudah.

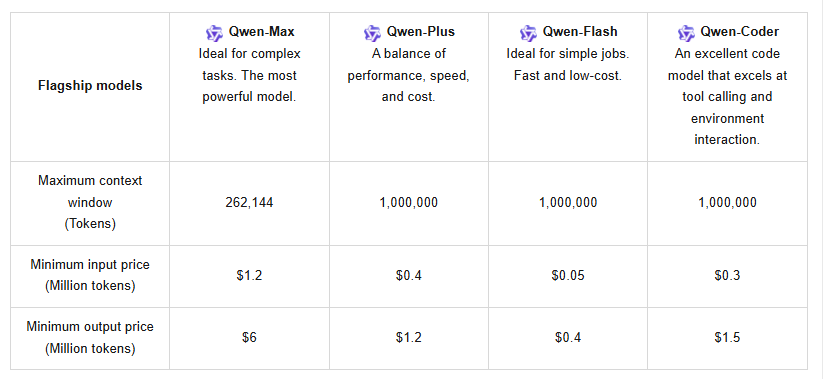

Selain itu, API mendukung caching konteks, yang mengoptimalkan kueri berulang dan memangkas biaya. Penetapan harga mengikuti struktur berjenjang: untuk 0–32K token, input berharga $1,2 per juta dan output $6 per juta; untuk 32K–128K, input naik menjadi $2,4 dan output menjadi $12; dan untuk 128K–252K, input mencapai $3 dengan output $15. Pengguna baru mendapatkan keuntungan dari kuota gratis satu juta token, berlaku selama 90 hari, mendorong pengujian awal.

Dibandingkan dengan pesaing seperti Claude Opus 4 atau DeepSeek-V3.1, Qwen3-Max-Thinking unggul dalam tugas-tugas agen, seperti SWE-Bench Verified pada 72,5. Namun, status pratinjaunya berarti beberapa fitur, seperti anggaran berpikir penuh, masih dalam pengembangan. Pengguna mencobanya melalui Qwen Chat untuk sesi interaktif atau API untuk akses terprogram. Pengaturan ini menempatkan API Qwen3-Max-Thinking sebagai alat utama untuk pengembangan perangkat lunak, pendidikan, dan otomatisasi perusahaan.

Prasyarat untuk Mengakses API Qwen3-Max-Thinking

Sebelum pengembang melanjutkan, mereka mengumpulkan persyaratan penting. Pertama, buat akun Alibaba Cloud jika belum ada. Kunjungi situs web Alibaba Cloud dan daftar menggunakan alamat email atau nomor telepon. Verifikasi akun melalui tautan atau kode yang disediakan untuk mengaktifkan akses penuh.

Selanjutnya, pastikan Anda memahami konsep API, termasuk endpoint RESTful dan payload JSON. API Qwen3-Max-Thinking menggunakan protokol HTTPS, jadi koneksi yang aman itu penting. Selain itu, siapkan alat pengembangan: Python 3.x atau bahasa serupa dengan pustaka seperti requests untuk panggilan HTTP. Untuk integrasi tingkat lanjut, pertimbangkan kerangka kerja seperti vLLM atau SGLang, yang mendukung penyajian yang efisien pada beberapa GPU.

Autentikasi memerlukan kunci API dari Alibaba Cloud. Navigasikan ke konsol setelah login dan buat kunci di bagian manajemen API. Simpan kunci ini dengan aman, karena kunci ini memberikan akses ke endpoint model. Selain itu, patuhi kebijakan penggunaan—hindari panggilan berlebihan untuk mencegah pembatasan laju. Sistem menawarkan versi terbaru dan snapshot; pilih snapshot untuk kinerja yang stabil di bawah beban tinggi.

Pertimbangan perangkat keras berlaku untuk pengujian lokal, meskipun akses cloud menguranginya. Model ini membutuhkan komputasi yang signifikan, tetapi infrastruktur Alibaba menanganinya. Terakhir, unduh alat pendukung seperti Apidog untuk menyederhanakan pengujian. Apidog mengelola permintaan, lingkungan, dan kolaborasi, menjadikannya ideal untuk bereksperimen dengan parameter API Qwen3-Max-Thinking.

Dengan ini, para insinyur menghindari jebakan umum seperti kesalahan autentikasi atau kehabisan kuota. Persiapan ini memastikan transisi yang mulus ke implementasi yang sebenarnya.

Panduan Langkah demi Langkah untuk Mendapatkan dan Menyiapkan API Qwen3-Max-Thinking

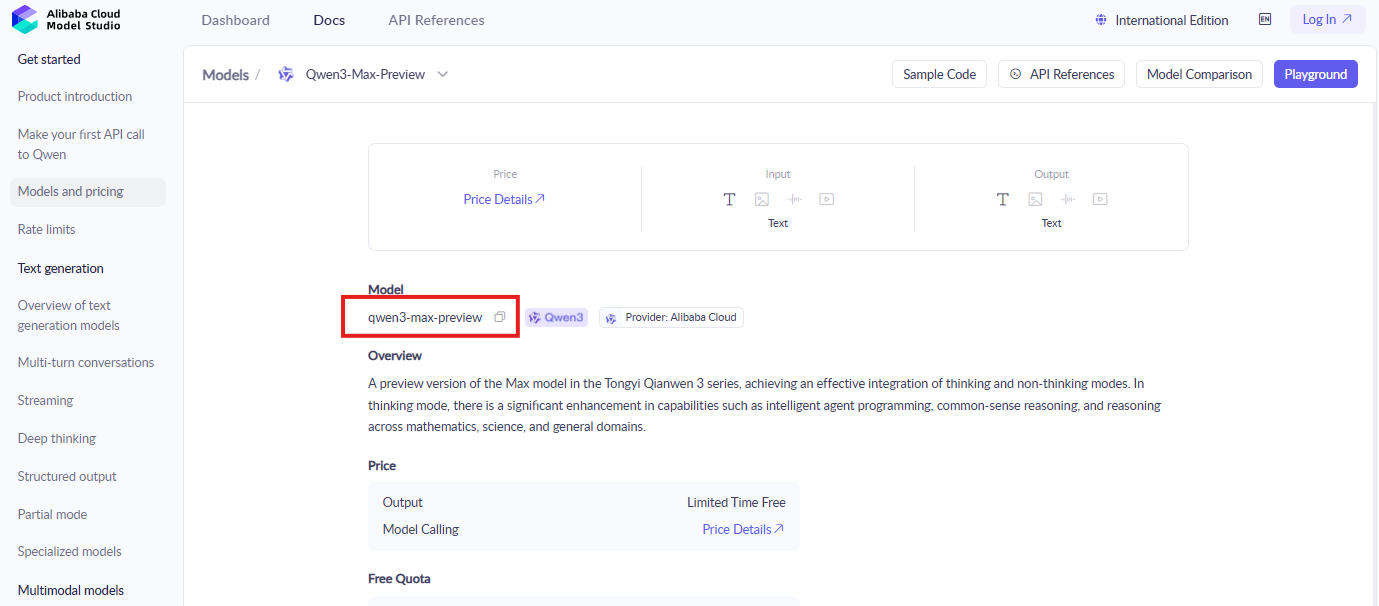

Pengembang memulai dengan masuk ke konsol Alibaba Cloud. Temukan bagian ModelStudio, tempat model Qwen berada. Cari "qwen3-max-preview" atau pengidentifikasi serupa untuk menemukan dokumentasi dan halaman aktivasi.

Aktifkan model selanjutnya. Klik tombol aktifkan untuk Qwen3-Max-Thinking, menyetujui persyaratan jika diminta. Langkah ini memberikan akses ke fitur pratinjau. Selanjutnya, tukarkan kuota token gratis dengan mengikuti instruksi di layar—akun baru secara otomatis memenuhi syarat.

Buat kredensial API kemudian. Di area manajemen kunci API, buat pasangan kunci baru. Catat ID kunci akses dan rahasianya; ini mengautentikasi permintaan. Hindari membagikannya secara publik untuk menjaga keamanan.

Konfigurasikan lingkungan pengembangan Anda setelahnya. Instal pustaka yang diperlukan melalui pip, seperti pip install requests openai. Meskipun kompatibel dengan OpenAI, sesuaikan endpoint ke URL dasar Alibaba, biasanya sesuatu seperti "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation".

Uji panggilan dasar untuk memverifikasi pengaturan. Buat payload JSON dengan nama model "qwen3-max-preview", prompt input, dan parameter penting "enable_thinking": true. Kirim permintaan POST ke endpoint. Contohnya:

import requests

url = "https://dashscope.aliyuncs.com/api/v1/services/aigc/text-generation/generation"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": "qwen3-max-preview",

"input": {

"messages": [{"role": "user", "content": "Selesaikan soal matematika ini: Berapa 2+2?"}]

},

"parameters": {

"enable_thinking": True

}

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

Pantau respons untuk langkah-langkah berpikir dalam output. Jika berhasil, ini menunjukkan penalaran aktif. Namun, tangani kesalahan seperti 401 untuk kunci yang tidak valid dengan memeriksa ulang kredensial.

Perluas ke konfigurasi tingkat lanjut. Gabungkan panggilan alat dengan menambahkan fungsi dalam payload. API mendukung Qwen-Agent untuk alur kerja agen, memungkinkan eksekusi multi-langkah. Selain itu, gunakan caching konteks dengan menyertakan ID cache dalam permintaan untuk menggunakan kembali konteks sebelumnya secara efisien.

Selesaikan masalah dengan cepat. Batas laju memicu kesalahan 429; beralih ke versi snapshot atau optimalkan kueri. Masalah jaringan memerlukan koneksi yang stabil. Dengan mengikuti langkah-langkah ini, pengembang mendapatkan akses yang andal ke API Qwen3-Max-Thinking.

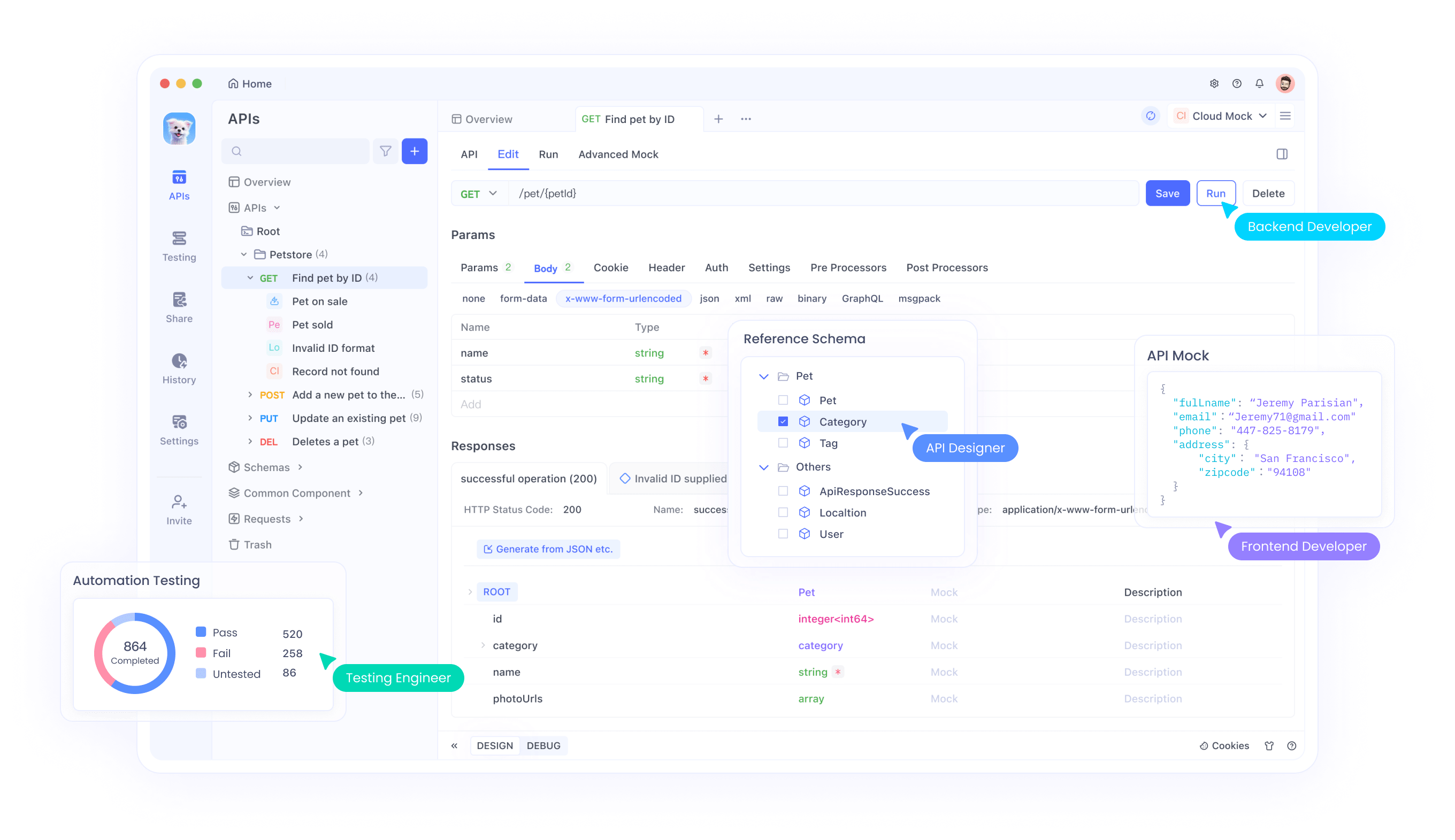

Mengintegrasikan API Qwen3-Max-Thinking dengan Apidog

Apidog menyederhanakan interaksi API, dan pengembang memanfaatkannya untuk API Qwen3-Max-Thinking. Mulailah dengan mengunduh Apidog dari situs resminya—ini gratis dan dapat diinstal dengan cepat di platform utama.

Impor spesifikasi API selanjutnya. Apidog mendukung format OpenAPI; unduh spesifikasi Alibaba untuk model Qwen dan unggah. Tindakan ini mengisi endpoint secara otomatis, termasuk yang menghasilkan teks.

Siapkan lingkungan kemudian. Buat lingkungan baru di Apidog, tambahkan variabel untuk kunci API dan URL dasar. Pengaturan ini memungkinkan peralihan yang mudah antara pengujian dan produksi.

Uji permintaan setelahnya. Gunakan antarmuka Apidog untuk membuat panggilan POST. Masukkan model, prompt, dan parameter enable_thinking. Kirim permintaan dan periksa respons secara real-time, dengan fitur seperti penyorotan sintaks dan pencatatan kesalahan.

Rantai permintaan untuk alur kerja yang kompleks. Apidog memungkinkan urutan panggilan, ideal untuk tugas agen di mana satu respons memberi makan yang lain. Selain itu, simulasikan beban tinggi untuk menguji kinerja.

Berkolaborasi dengan tim menggunakan alat berbagi Apidog. Ekspor koleksi agar rekan kerja dapat mereplikasi pengaturan. Selain itu, pantau penggunaan token melalui analitik terintegrasi untuk tetap berada dalam kuota.

Optimalkan integrasi lebih lanjut. Apidog menangani payload besar secara efisien, mendukung jendela konteks 262K. Debug halusinasi dengan menyesuaikan anggaran berpikir setelah sepenuhnya tersedia.

Menjelajahi Endpoint dan Parameter API

API Qwen3-Max-Thinking mengekspos beberapa endpoint, terutama untuk pembuatan teks. Yang utama, /api/v1/services/aigc/text-generation/generation, menangani tugas penyelesaian. Pengembang POST data JSON di sini.

Parameter kunci meliputi "model", yang menentukan "qwen3-max-preview". Objek "input" berisi pesan dalam format obrolan. Selanjutnya, "parameter" mendikte perilaku: atur "enable_thinking" ke True untuk mode penalaran.

- Opsi lain meningkatkan kontrol. "max_tokens" membatasi panjang output, hingga 65.536. "temperature" menyesuaikan kreativitas, defaultnya 0,7. "top_p" menyaring pengambilan sampel.

- Untuk penggunaan alat, sertakan array "tools" dengan definisi fungsi. API merespons dengan panggilan, memungkinkan alur agen.

- Caching konteks menggunakan "cache_prompt" untuk menyimpan dan mereferensikan input sebelumnya, mengurangi biaya. Tentukan ID cache dalam permintaan berikutnya.

- Parameter penanganan kesalahan seperti "retry" mengelola transien. Selain itu, versi melalui "snapshot" memastikan konsistensi.

Memahami ini memungkinkan penyetelan yang tepat. Untuk masalah matematika, pemikiran yang lebih tinggi memungkinkan langkah-langkah terperinci; untuk pengodean, ini menghasilkan solusi yang kuat. Pengembang bereksperimen untuk menemukan pengaturan optimal.

Contoh Praktis Penggunaan API Qwen3-Max-Thinking

Insinyur menerapkan API dalam berbagai skenario. Pertimbangkan pengodean: Prompt "Tulis fungsi Python untuk mengurutkan daftar." Dengan pemikiran diaktifkan, ia menguraikan logika sebelum kode.

- Dalam matematika, kueri "Selesaikan integral dari x^2 dx." Respons memecah langkah-langkah, menunjukkan aturan integrasi.

- Untuk tugas agen, tentukan alat seperti pencarian web. Model merencanakan tindakan, mengeksekusi melalui panggilan balik, dan mensintesis hasil.

- Penggunaan perusahaan: Analisis dokumen panjang dengan memasukkan konteks. Jendela besar memproses riwayat pengguna untuk rekomendasi.

- Pendidikan: Hasilkan penjelasan untuk topik kompleks, menyesuaikan kedalaman melalui parameter.

- Perawatan kesehatan: Dukung keputusan etis dengan output yang beralasan, meskipun selalu verifikasi.

- Penulisan kreatif: Hasilkan cerita dengan plot logis.

Contoh-contoh ini mengilustrasikan keserbagunaan. Pengembang menskalakannya menggunakan Apidog untuk pengujian.

Praktik Terbaik untuk Penggunaan yang Efisien

Optimalkan konsumsi token terlebih dahulu. Buat prompt yang ringkas untuk menghindari pemborosan. Gunakan caching untuk elemen yang berulang.

Pantau kuota dengan cermat. Lacak penggunaan di konsol; tingkatkan jika diperlukan.

Amankan kunci dengan variabel lingkungan atau brankas. Rotasi secara berkala.

Tangani batas laju dengan menerapkan backoff eksponensial dalam kode.

Uji secara menyeluruh dengan Apidog sebelum produksi. Simulasikan kasus ekstrem.

Perbarui ke snapshot baru saat dirilis, periksa changelog.

Gabungkan dengan alat lain untuk sistem hibrida.

Ikuti ini untuk memaksimalkan potensi API Qwen3-Max-Thinking.

Kesimpulan

API Qwen3-Max-Thinking mengubah aplikasi AI dengan penalaran canggih. Dengan mengikuti panduan ini, pengembang mengakses dan mengintegrasikannya secara efektif, memanfaatkan Apidog untuk efisiensi. Seiring berkembangnya fitur, ini tetap menjadi pilihan utama untuk proyek-proyek inovatif.