In der Welt der modernen Webentwicklung und des API-Designs haben sich zwei beliebte Kommunikationsprotokolle herauskristallisiert: gRPC und REST. Sowohl gRPC als auch REST werden häufig für den Aufbau verteilter Systeme und die Erleichterung der Kommunikation zwischen Client- und Serveranwendungen verwendet. In diesem Artikel werden wir uns mit den Unterschieden und Anwendungsfällen von gRPC und REST befassen und Einblicke geben, wann man sich für das eine oder das andere entscheiden sollte.

Was ist gRPC

gRPC, was für "Google Remote Procedure Call" steht, ist ein Open-Source-RPC-Framework, das von Google entwickelt wurde. Es ermöglicht eine nahtlose Kommunikation zwischen Client- und Serveranwendungen, sodass diese Methoden aufrufen und strukturierte Daten austauschen können.

gRPC verwendet die sprachunabhängige Schnittstellendefinitionssprache Protocol Buffers (Protobuf), um die Dienste und Nachrichten für die Kommunikation zu definieren. Daher umfassen die Vorteile von gRPC natürlich die Vorteile von HTTP2:

- Binäre Framing für die Datenübertragung.

- Multiplexing für effiziente gleichzeitige Anfragen.

- Die Server-Push-Funktion zur Initiierung der Kommunikation vom Server.

- Header-Komprimierung zur Reduzierung des Overheads.

Beim Vergleich von gRPC mit REST ist zu beachten, dass gRPC mit der Kombination aus HTTP und RESTful-Prinzipien verglichen werden kann, da gRPC sowohl das Transportprotokoll als auch das Nachrichtenformat umfasst. Ein Vergleich kann jedoch dennoch zwischen den beiden angestellt werden.

Was ist REST

What is REST? REST (Representational State Transfer) ist ein Architekturstil, der dazu dient, verteilte Systeme zu erstellen und zu organisieren. Alles begann im Jahr 2000 mit Fielding, der sich der Entwicklung einer einzigartigen, standardisierten Methode für die Client-Server-Kommunikation widmete.

REST verwendet das HTTP-Protokoll für die Kommunikation und wird häufig in Webanwendungen eingesetzt. REST bietet lediglich Richtlinien, wie Backend-Daten über JSON/XML-Nachrichtenformate in einer High-Level-Architekturimplementierung für Clients verfügbar gemacht werden.

APIs verwenden REST-Richtlinien, um zugängliche Webdienste bereitzustellen. Diese RESTful APIs bieten diese Webdienste innerhalb von Ressourcen an. Ressourcen stellen einzelne Zustände auf dem Server dar, auf die über eine gemeinsame Schnittstelle zugegriffen werden kann und die mithilfe von HTTP-Verben abgerufen oder manipuliert werden können: GET, POST, DELETE und PUT.

Die Gemeinsamkeiten von gRPC VS REST

GRPC sollte mit HTTP + RESTful verglichen werden, da gRPC sowohl das Transportprotokoll als auch die Nachrichtenspezifikation umfasst. Vergleichen wir nun gRPC und REST in verschiedenen Aspekten: Obwohl gRPC und REST nicht dasselbe sind, gibt es auch einige Gemeinsamkeiten zwischen ihnen. Gehen wir weiter.

- Client-Server-Architektur: Sowohl gRPC als auch REST folgen einer Client-Server-Architektur, bei der Clients Anfragen an Server senden und Server diese Anfragen verarbeiten und Antworten zurücksenden.

- Netzwerkkommunikation: Sowohl gRPC als auch REST verlassen sich auf Netzwerkkommunikationsprotokolle wie HTTP/1.1 oder HTTP/2, um den Datenaustausch zwischen Clients und Servern zu erleichtern.

- Plattform- und Sprachunabhängigkeit: Sowohl gRPC als auch REST können auf verschiedenen Plattformen und Programmiersprachen implementiert werden, was die Interoperabilität zwischen verschiedenen Systemen ermöglicht.

Die Unterschiede von RPC VS REST

Dies sind einige der wichtigsten Gemeinsamkeiten und Unterschiede zwischen gRPC und REST. Wenn Sie die Unterschiede kennenlernen möchten, gehen wir sie durch:

Schnittstellendefinition:

In gRPC wird die Dienstschnittstelle mithilfe der Protocol Buffer Definition Language (protobuf) definiert, die einen strengen Vertrag zwischen Client und Server bereitstellt. REST hingegen hat keine formale Schnittstellendefinition, und der Vertrag wird typischerweise durch Dokumentation oder andere Mittel definiert.

Kommunikationsflexibilität: Protobuf und JSON

| Kommunikationsflexibilität | Protobuf | JSON |

|---|---|---|

| Format zum Senden und Empfangen von Antworten | Binäres Format | Textformat |

| Plattformunabhängigkeit | Ja | Ja |

| Übertragungsgeschwindigkeit | Schneller durch Serialisierung | Langsamer im Vergleich zu Protobuf |

| Best Practices und Tutorials Standard | Nein | Ja |

| Flexibilität | Keine Unterstützung für dynamische Schemaentwicklung | Unterstützt dynamische Schemaentwicklung |

gRPC und REST verwenden unterschiedliche Formate zum Senden und Empfangen von Antworten. REST verwendet JSON, ein textbasiertes Format, das flexibel, effizient, plattformneutral und sprachunabhängig ist. gRPC hingegen verwendet Protobuf, ein binäres Format, das aufgrund der Serialisierung eine schnellere Nachrichtenübermittlung bietet. Beide Formate sind plattformunabhängig, aber JSON wird häufiger in Best Practices und Tutorials verwendet. Darüber hinaus unterstützt JSON die dynamische Schemaentwicklung, während Protobuf dies nicht tut.

gRPC und REST haben unterschiedliche Formate zum Senden und Empfangen von Antworten.

REST verwendet das JSON-Format zum Empfangen von Nachrichten. Obwohl es möglich ist, Nachrichten in anderen Formaten wie XML oder rohem Binärformat zu empfangen, hat sich JSON aufgrund seiner Flexibilität, Effizienz, Plattformneutralität und Sprachunabhängigkeit zum De-facto-Standard in Best Practices und Tutorials entwickelt.

gRPC verwendet das Protobuf (Protocol Buffers)-Nachrichtenformat, um Anfragen zu senden und Antworten in einem binären Format zu empfangen. Sowohl JSON als auch Protobuf sind plattformunabhängig, was bedeutet, dass sie entwickelt und verwendet werden können, ohne an eine bestimmte Plattform gebunden zu sein.

Beim Übertragen von Daten zwischen Systemen ist JSON tendenziell langsamer. Auf der anderen Seite bietet Protobuf eine schnellere Nachrichtenübermittlung, da die Nachrichten vor dem Senden über das Netzwerk serialisiert (codiert) werden. Serialisierung ist der Prozess des Verpackens der Parameter und der Remote-Funktion in eine binäre Nachricht.

Code-Generierung:

gRPC verwendet Code-Generierungstools, die automatisch Client- und Server-Code-Stubs basierend auf der Dienstdefinition erstellen. Dies kann die Entwicklung vereinfachen und die Konsistenz über verschiedene Programmiersprachen hinweg sicherstellen.

REST hat keinen integrierten Code-Generierungsmechanismus und verlässt sich häufig auf Bibliotheken oder Frameworks für die Client- und Server-Implementierung.

Leistung und Effizienz: HTTP/1.1 VS HTTP/2

| Leistung und Effizienz | HTTP/1.1 | HTTP/2 |

|---|---|---|

| Kommunikationsprotokoll | Wird von REST verwendet | Wird von gRPC verwendet |

| Anfrage-Antwort-Geschwindigkeit | Langsamer im Vergleich zu HTTP/2 | Schneller durch Multiplexing |

| Multiplexing | Nicht unterstützt | Unterstützt |

| Server-Push | Nicht unterstützt | Unterstützt |

| Header-Komprimierung | Nicht unterstützt | Unterstützt |

REST verwendet HTTP/1.1 für die Kommunikation, das Senden von Anfragen und den Empfang von Antworten. gRPC hingegen verwendet HTTP/2, das noch schneller für die Interprozesskommunikation ist.

HTTP/1.1 ist langsamer im Vergleich zu HTTP/2. HTTP/2 wurde entwickelt, um die Einschränkungen von HTTP/1.1 zu überwinden, wodurch gRPC in Bezug auf die Anforderungsantwort im Vergleich zu REST schneller wird.

REST mangelt es an Multiplexing. Es lädt Ressourcen nacheinander, wobei eine Ressource warten muss, bis die vorherige Ressource mit dem Laden fertig ist. gRPC, das HTTP/2 verwendet, nutzt TCP-Verbindungen, um mehrere Datenströme zu senden, die in binär codierte Nachrichten aufgeteilt und nummeriert werden, sodass der Client weiß, welche binäre Nachricht zu welchem Stream gehört, wodurch sichergestellt wird, dass keine Ressourcen blockiert werden.

Somit sehen wir, dass HTTP/1.1 für mehrere Anfragen ineffizient ist.

Durch Server-Push und Header-Komprimierung übertrifft gRPC mit HTTP/2 REST mit HTTP/1.1 in Bezug auf die Leistung. Server-Push ermöglicht es HTTP/2, Inhalte vom Server an den Client zu pushen, bevor sie angefordert werden, während HTTP/1.1 nur Inhalte auf Anfrage bereitstellen kann. Header-Komprimierung, die HTTP/2 erfordert, ermöglicht es, unnötige Nachrichten mithilfe der HPACK-Komprimierungsmethode aus den Headern zu entfernen.

Kommunikationsmuster: Streaming vs. Anfrage/Antwort:

In REST können wir nur Aktionen wie das Stellen von Anfragen und den Empfang von Antworten ausführen. Dies ist auf das für die Kommunikation verwendete HTTP/1.1-Protokoll zurückzuführen, das in verschiedenen Aspekten eingeschränkt ist.

Auf der anderen Seite verwendet gRPC, wie wir wissen, HTTP/2 für die Kommunikation. Mit TCP-Verbindungen unterstützt HTTP/2 mehrere Datenströme vom Server und die traditionelle Anfrage-Antwort. Mit gRPC können wir Folgendes ausführen:

- Client-Streaming: Dies beinhaltet, dass der Client einen Datenstrom an den Server sendet. Der Server registriert sich, um Datenströme vom Client zu empfangen, und antwortet mit einer einzelnen Nachricht.

- Server-Streaming: Der Client sendet eine einzelne Anfrage an den Server, und der Server öffnet eine Streaming-Verbindung und sendet im Laufe der Zeit Datenströme an den Client. Der Client registriert ein Ereignis, um zu lauschen, wenn die Streams eintreffen.

- Bidirektionales Streaming: Dies ist bidirektional. Sowohl der Server als auch der Client können Datenströme voneinander senden und empfangen.

Wofür wird gRPC verwendet?

gRPC ist ein weit verbreitetes Framework für den Aufbau effizienter und skalierbarer verteilter Systeme. Es wird häufig verwendet, um APIs (Application Programming Interfaces) zu entwickeln, die die Kommunikation zwischen verschiedenen Komponenten eines Softwaresystems erleichtern. Mit gRPC können Entwickler Dienstschnittstellen definieren und diese verwenden, um Code für Clients und Server in verschiedenen Programmiersprachen zu generieren.

Wofür wird REST verwendet?

REST wird häufig für den Aufbau skalierbarer, wartbarer und standardbasierter APIs verwendet, die die Kommunikation zwischen verschiedenen Systemen über das Internet ermöglichen. REST wird häufig für den Aufbau von Webdiensten, die Entwicklung von APIs, die Integration von Anwendungen, den Aufbau mobiler Apps, die Ermöglichung von Internet of Things (IoT)-Systemen und die Bereitstellung von Cloud-Computing-Diensten verwendet.

gRPC in Apidog

Apidog ist ein API-Verwaltungstool, das gRPC für die nahtlose Kommunikation zwischen Clients und Servern verwendet. Es bietet Funktionen zum Generieren von Code in mehreren Programmiersprachen, zum Entwerfen von Dienstschnittstellen mithilfe der gRPC-Schnittstellendefinitionssprache (IDL), zum Erstellen von Mock-Servern zum Testen, zum Verwalten von Testfällen und zum Generieren automatischer API-Dokumentation. Mit Apidog und gRPC können Entwickler ihren API-Entwicklungsprozess rationalisieren, die Zusammenarbeit verbessern und qualitativ hochwertige APIs liefern.

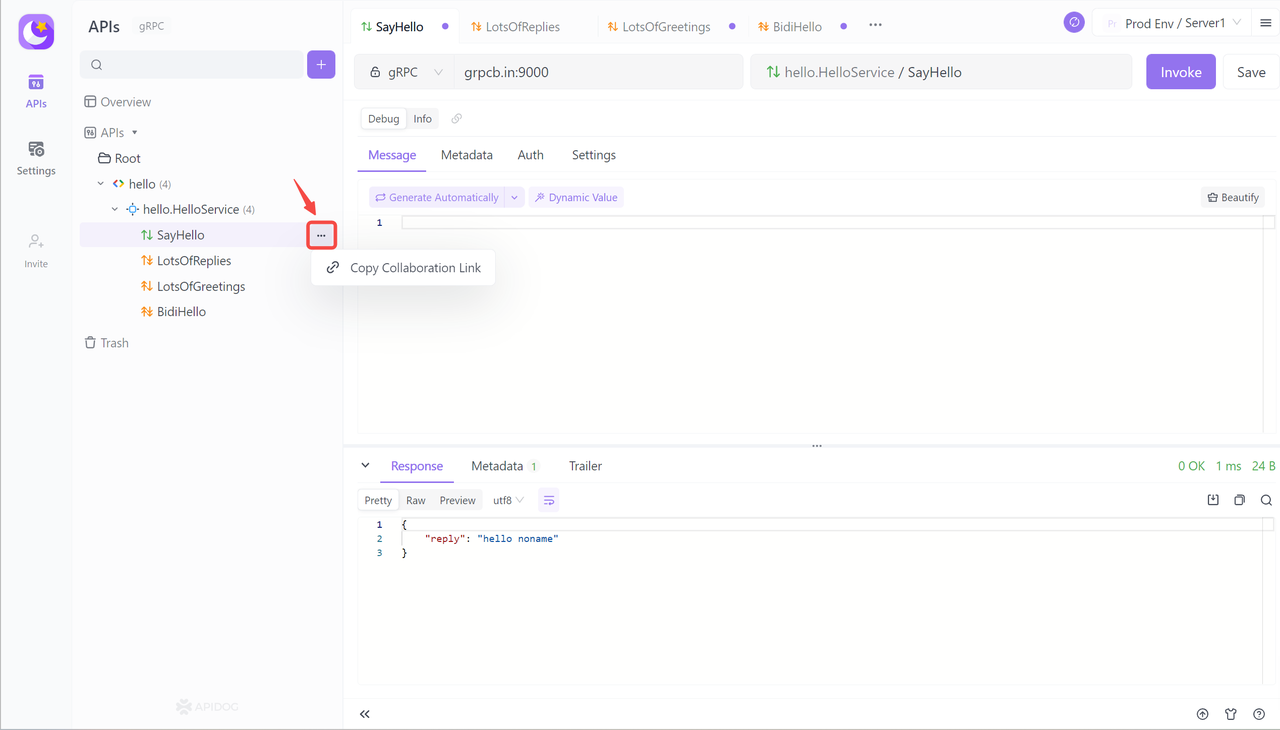

gRPC API-Zusammenarbeit in Apidog

Apidog kann gRPC-Schnittstellendokumente rendern, die für das menschliche Lesen besser geeignet sind, basierend auf .proto-Dateien, wodurch die Zusammenarbeit an Schnittstellen innerhalb eines Teams erleichtert wird. Sie können auf die Menüschaltfläche auf der rechten Seite der Schnittstelle klicken, um den Kooperationslink zu erhalten und ihn mit anderen Teammitgliedern zu teilen, um die Debugging-Methode der Schnittstelle abzustimmen.

Um einen Unary-Aufruf zu initiieren, wählen Sie die Methode "SayHello" aus und geben Sie "grpcb.in:9000" in die API-Adresse ein. Klicken Sie dann auf die Schaltfläche "Automatisch generieren", um den Anfragetext zu generieren, und klicken Sie auf "Aufrufen", um die Antwort anzuzeigen.

In Apidog können Sie die API-Adresse einfach in die "Umgebungen" extrahieren, sodass andere Teammitglieder oder andere Schnittstellen im Projekt Aufrufanforderungen initiieren können.

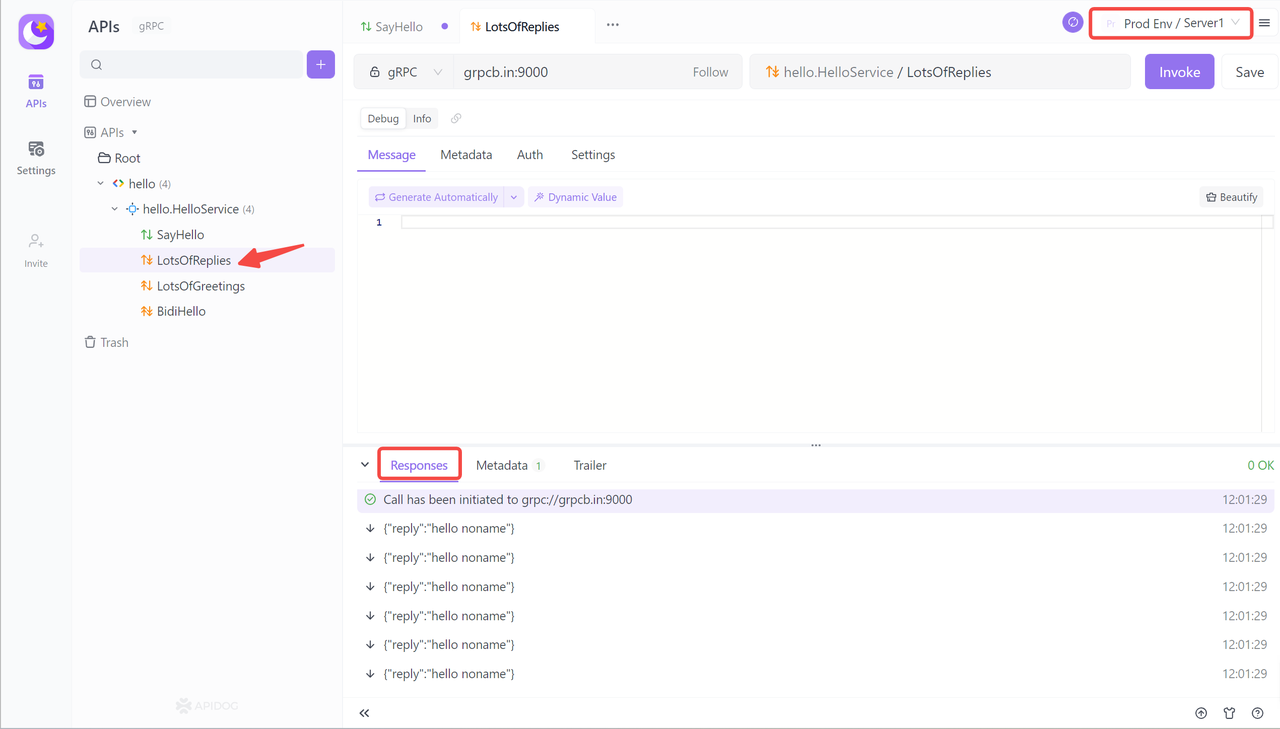

Server-Streaming

Wie das Symbol andeutet, bedeutet Server-Streaming, dass mehrere Antwortdaten in einer Anfrage gesendet werden. Zum Beispiel das Abonnieren aller Transaktionspreisdaten von Aktien innerhalb einer Minute.

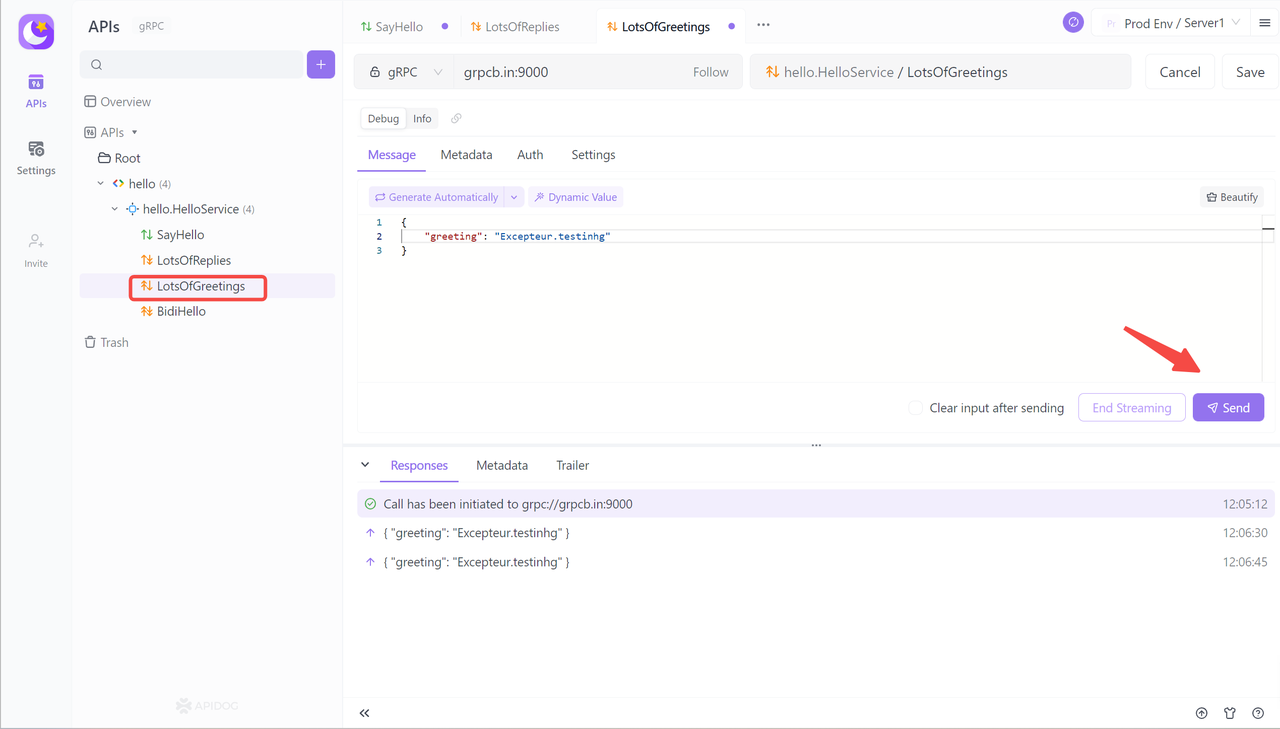

Client-Streaming

In diesem Modus kann der Client kontinuierlich mehrere Anfragenachrichten an den Server senden, ohne auf eine sofortige Antwort vom Server zu warten. Nach dem Initiieren des Aufrufs können Sie die Anforderungsinformationen kontinuierlich in die Nachricht eingeben und dann auf die Schaltfläche "Senden" klicken. Nach der Verarbeitung aller Anfragen sendet der Server eine einzelne Antwortnachricht an den Client.

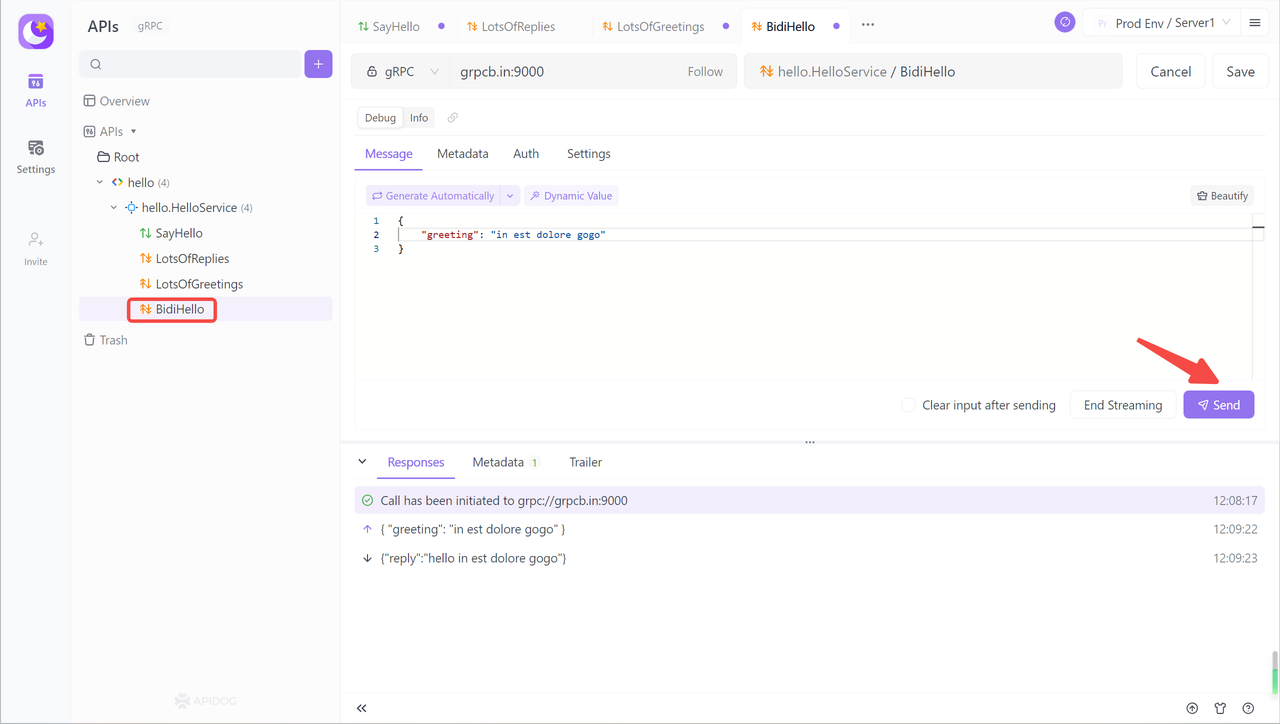

Bidirektionales Streaming

Bidirektionales Streaming ermöglicht es Clients und Servern, eine dauerhafte bidirektionale Kommunikation herzustellen und kann mehrere Nachrichten gleichzeitig übertragen.

Es wird häufig in Online-Spielen und Echtzeit-Videoanrufsoftware verwendet und eignet sich für Echtzeitkommunikation und groß angelegte Datenübertragungsszenarien. Nach dem Initiieren des Aufrufs behalten der Client und der Server eine Sitzung zwischen sich bei und empfangen Echtzeitantworten, nachdem sie verschiedene Anforderungsinhalte gesendet haben.