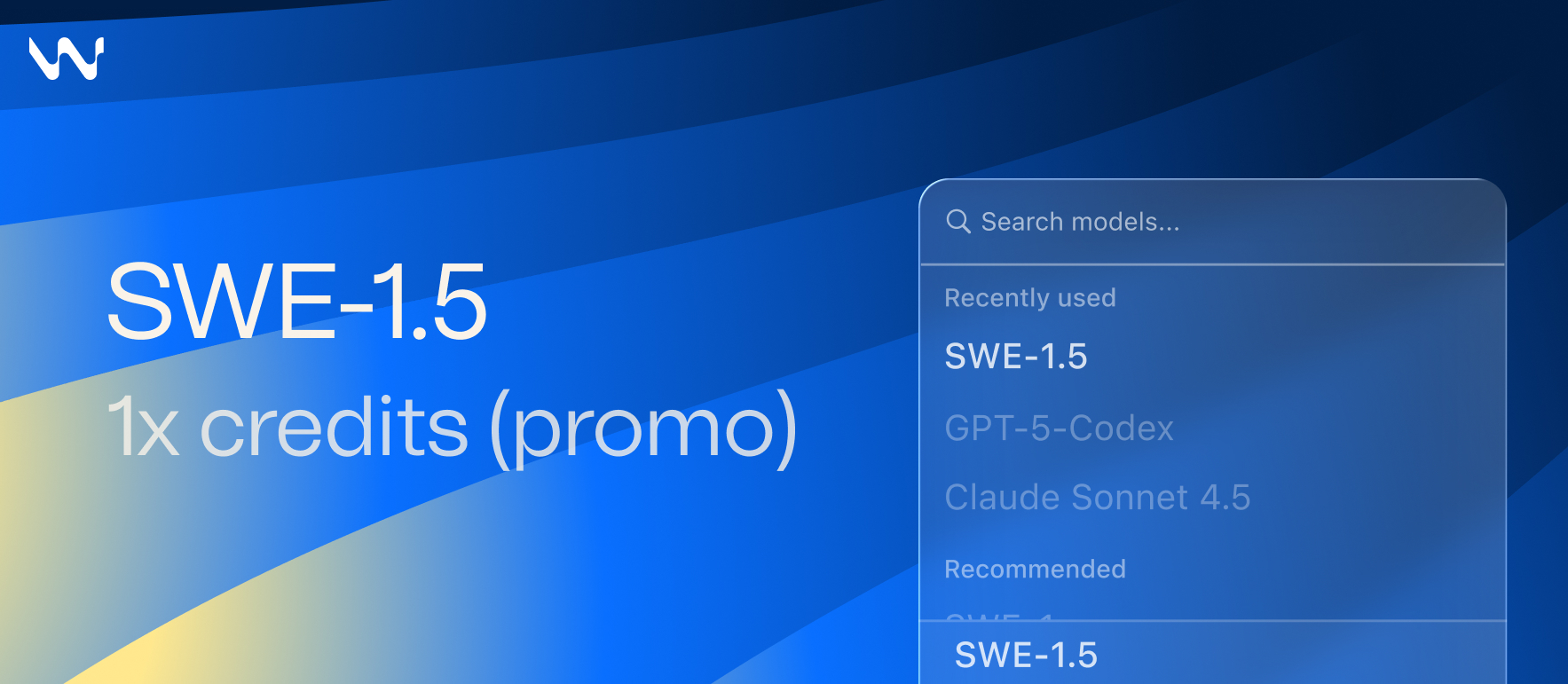

Desenvolvedores buscam constantemente ferramentas que aceleram os fluxos de trabalho sem sacrificar a qualidade. A Cognition entrega exatamente isso com o lançamento do SWE-1.5, agora disponível no Windsurf. Este modelo avançado de IA otimiza tarefas de engenharia de software, permitindo uma geração de código e resolução de problemas mais rápidas. Engenheiros integram esses modelos em seus ambientes por meio de APIs, garantindo interações suaves e desempenho confiável.

Os engenheiros da Cognition projetaram o SWE-1.5 para abordar um desafio central na codificação assistida por IA: o equilíbrio entre tempos de resposta rápidos e saídas inteligentes. Além disso, este modelo marca um avanço significativo em sistemas baseados em agentes, onde a velocidade impacta diretamente a experiência do usuário. À medida que as equipes adotam o SWE-1.5 no Windsurf, elas experimentam latência reduzida em tarefas que vão desde a depuração até a construção de aplicativos full-stack. No entanto, alcançar isso exigiu parcerias inovadoras e atualizações de infraestrutura, que exploraremos a seguir.

Compreendendo o SWE-1.5: Um Modelo de Tamanho de Fronteira Adaptado para Engenharia de Software

A Cognition constrói o SWE-1.5 como um modelo especializado com centenas de bilhões de parâmetros, focado exclusivamente em aplicações de engenharia de software. Os desenvolvedores se beneficiam de sua capacidade de lidar com bases de código complexas de forma eficiente. Por exemplo, o modelo processa consultas e gera respostas em velocidades que rivalizam com os processos de pensamento humano, tornando-o ideal para colaboração em tempo real.

O SWE-1.5 incorpora aprendizado por reforço de ponta a ponta, treinado em ambientes de tarefas do mundo real. Essa abordagem garante que o modelo se adapte a diversas linguagens de programação e cenários. Os engenheiros da Cognition iteraram continuamente na arquitetura do modelo, refinando seu sistema e ferramentas para maximizar o desempenho. Consequentemente, os usuários do Windsurf acessam um sistema que não apenas pensa rapidamente, mas também oferece soluções precisas.

O design do modelo enfatiza a unificação: ele combina a IA central com motores de inferência e orquestração de agentes. Essa integração elimina gargalos comuns em sistemas desconexos. Como resultado, o SWE-1.5 supera modelos de propósito geral em tarefas especializadas. Desenvolvedores que o implementam notam melhorias imediatas na produtividade, como a edição de arquivos de configuração em segundos, em vez de minutos.

A Parceria com a Cerebras: Impulsionando Velocidades de Inferência Incomparáveis

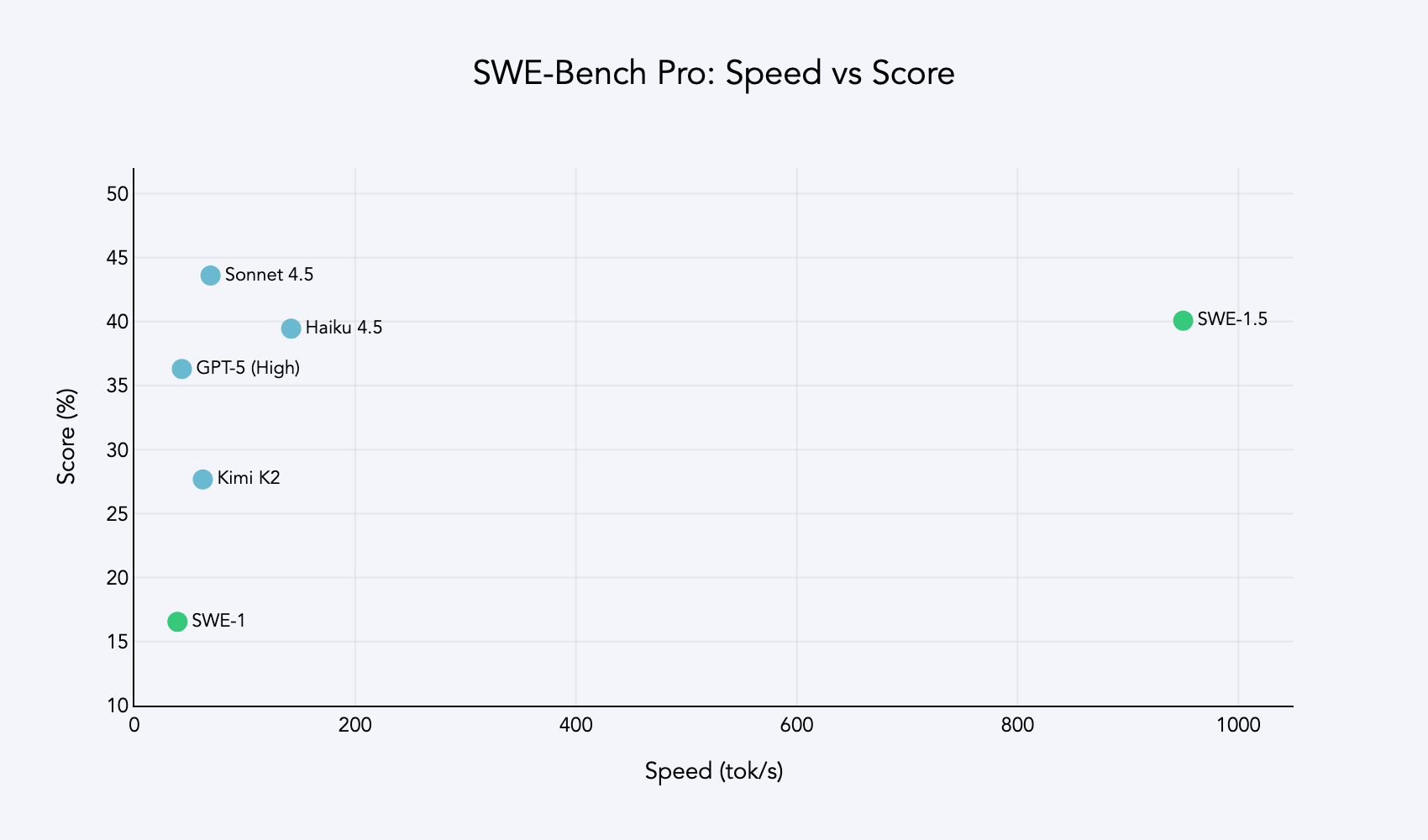

A Cognition faz parceria com a Cerebras para alcançar velocidades de inferência de até 950 tokens por segundo no SWE-1.5. Essa colaboração aproveita hardware avançado para expandir os limites do desempenho da IA. Especificamente, a tecnologia da Cerebras permite decodificação especulativa e geração otimizada de tokens, o que acelera a saída do modelo sem comprometer a qualidade.

Além disso, essa vantagem de velocidade posiciona o SWE-1.5 como 6x mais rápido que o Haiku 4.5 e 13x mais rápido que o Sonnet 4.5. Os engenheiros medem esses ganhos em termos práticos: tarefas que antes levavam 20 segundos agora são concluídas em menos de cinco. Tal eficiência se encaixa na "janela de fluxo", onde os desenvolvedores mantêm a concentração sem interrupções.

No entanto, a realização dessas velocidades exigiu otimizações em todo o sistema. A Cognition reescreveu ferramentas essenciais do zero, reduzindo a sobrecarga na verificação de lint e na execução de comandos. Essas melhorias beneficiam todos os modelos no Windsurf, criando um ecossistema mais responsivo. Consequentemente, os usuários experimentam interações contínuas, seja explorando grandes repositórios ou automatizando correções de rotina.

Benchmarks Que Diferenciam o SWE-1.5: Dominando o SWE-Bench Pro

O SWE-1.5 se destaca no benchmark SWE-Bench Pro da Scale AI, alcançando resultados próximos ao estado da arte em tarefas desafiadoras. Este conjunto de dados testa modelos em diversas bases de código, simulando problemas reais de engenharia de software. O modelo da Cognition completa essas avaliações em uma fração do tempo exigido pelos concorrentes, destacando sua eficiência.

Além disso, benchmarks internos na Cognition revelam vantagens práticas. Por exemplo, os engenheiros usam o SWE-1.5 para construir aplicativos full-stack rapidamente, integrando componentes de frontend e backend com intervenção manual mínima. O desempenho do modelo em métricas como retweets mínimos ou filtros de engajamento em ferramentas relacionadas sublinha sua robustez.

Adicionalmente, comparações com modelos anteriores mostram melhorias notáveis. O SWE-1.5 reduz as taxas de erro em chamadas de ferramentas e aprimora a qualidade do código por meio de avaliação baseada em rubricas. Desenvolvedores apreciam como ele lida com casos extremos, como edições de manifestos Kubernetes, com precisão. Como resultado, equipes no Windsurf o adotam para projetos de missão crítica, confiantes em sua confiabilidade.

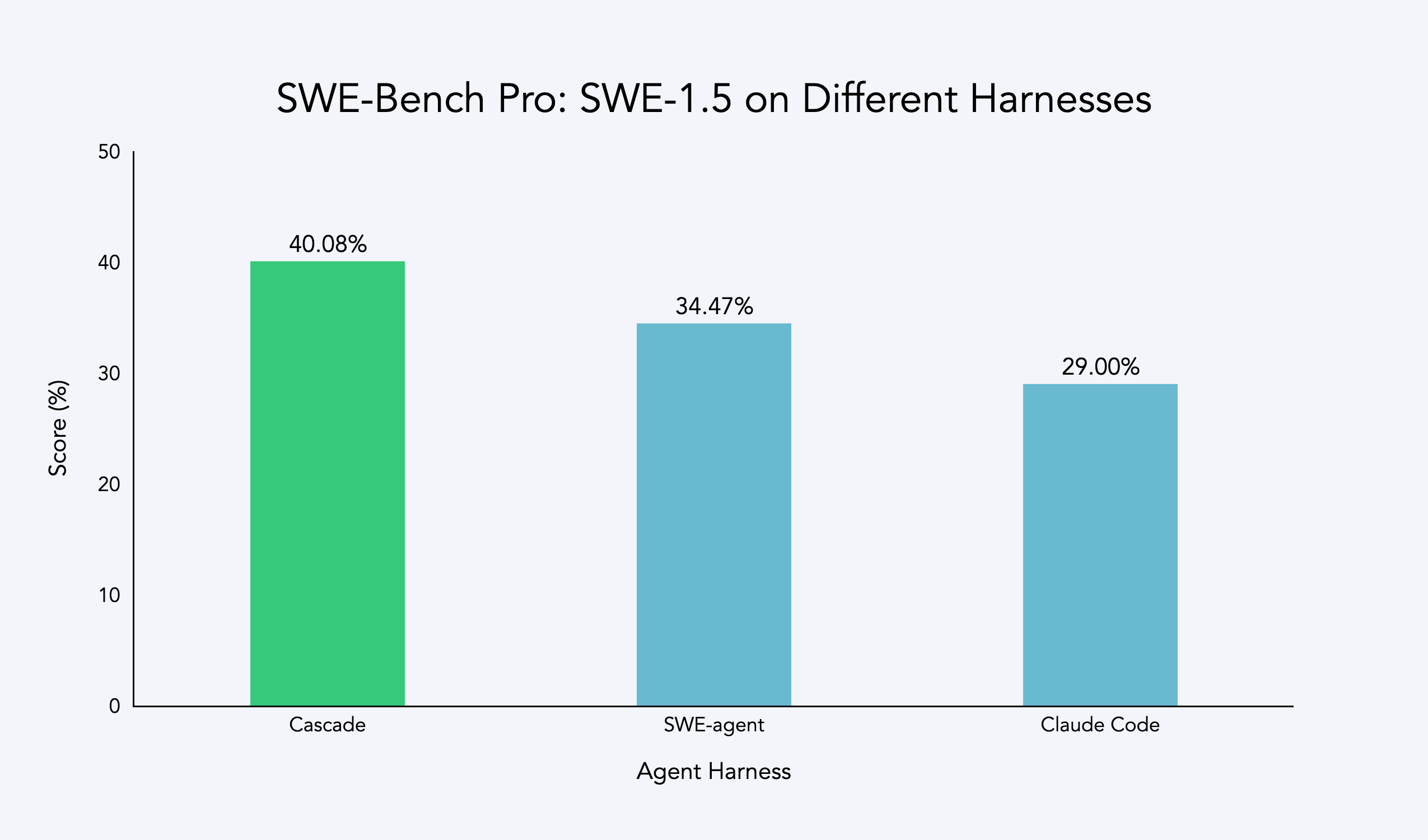

O Cascade Agent Harness: Fundação da Inteligência do SWE-1.5

A Cognition desenvolve o Cascade agent harness especificamente para o SWE-1.5, permitindo a co-otimização do modelo e da orquestração. Este harness facilita o aprendizado por reforço em trajetórias de múltiplas interações, garantindo que a IA lide com interações estendidas de forma eficaz.

Além disso, o harness incorpora ferramentas reescritas para velocidade, acomodando o tempo de execução 10x mais rápido do modelo. Os engenheiros monitoram o desempenho por meio de implantações beta, coletando dados sobre métricas como taxa de transferência de tokens e precisão da resposta. Este processo iterativo refina o sistema, eliminando as fraquezas identificadas em versões anteriores.

No entanto, surgiram desafios durante o desenvolvimento, como falhas de chamadas de ferramentas em configurações alternativas. A Cognition abordou isso aprimorando a compatibilidade do harness, levando a avaliações superiores. Consequentemente, o SWE-1.5 tem um desempenho ideal no Windsurf, onde os usuários aproveitam todas as suas capacidades para tarefas como exploração de bases de código via Codemaps.

Infraestrutura de Treinamento: Escalando com Chips GB200 e Otterlink

A Cognition treina o SWE-1.5 em milhares de chips GB200 NVL72, marcando um dos primeiros usos de produção desse hardware. O acesso antecipado em junho de 2025 permitiu à equipe construir sistemas tolerantes a falhas e otimizar as comunicações NVLink.

Além disso, o hipervisor Otterlink VM escala ambientes para dezenas de milhares de máquinas concorrentes, alinhando o treinamento com as realidades de produção. Essa configuração espelha as cargas de trabalho do Devin e do Windsurf, garantindo que o modelo generalize bem.

Adicionalmente, o processo de treinamento emprega um gradiente de política imparcial para estabilidade em sequências longas. Os engenheiros selecionam modelos base por meio de avaliações rigorosas, aplicando RL pós-treinamento para ajustar a engenharia de software. Como resultado, o SWE-1.5 surge como uma ferramenta robusta, pronta para implantação no Windsurf.

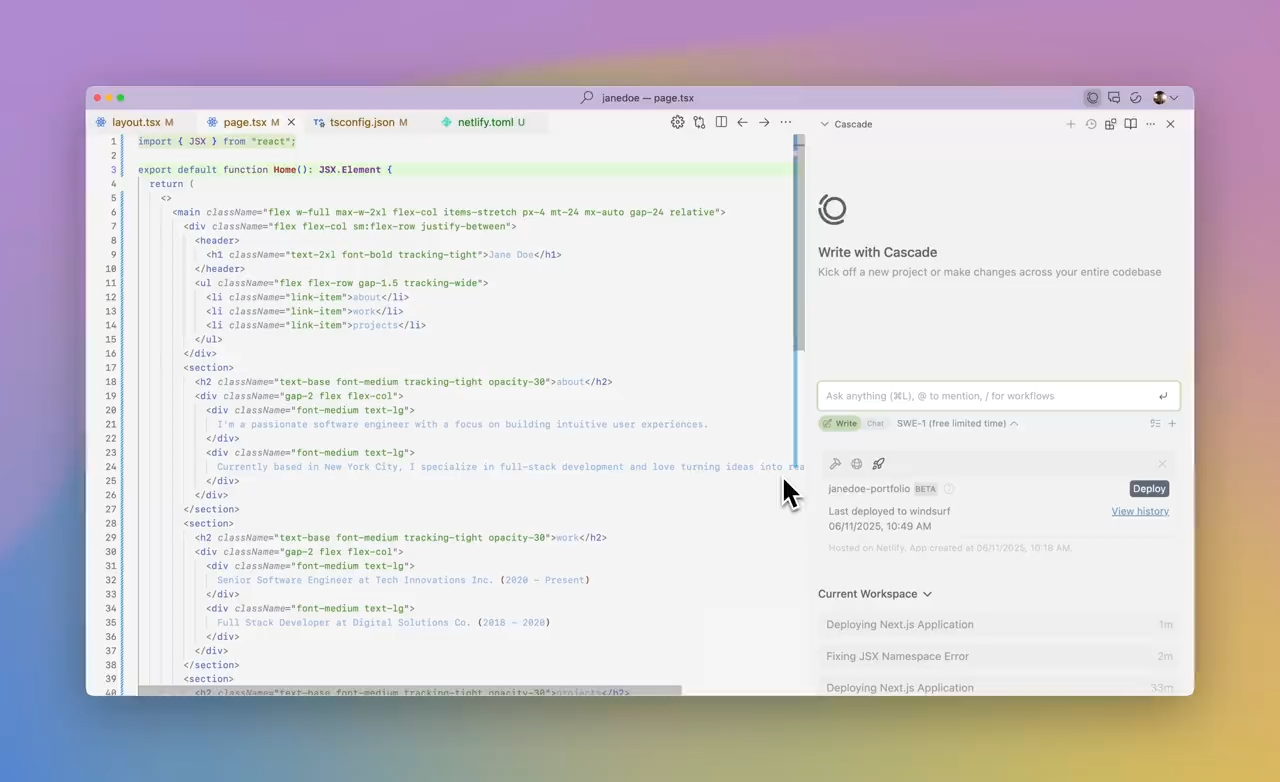

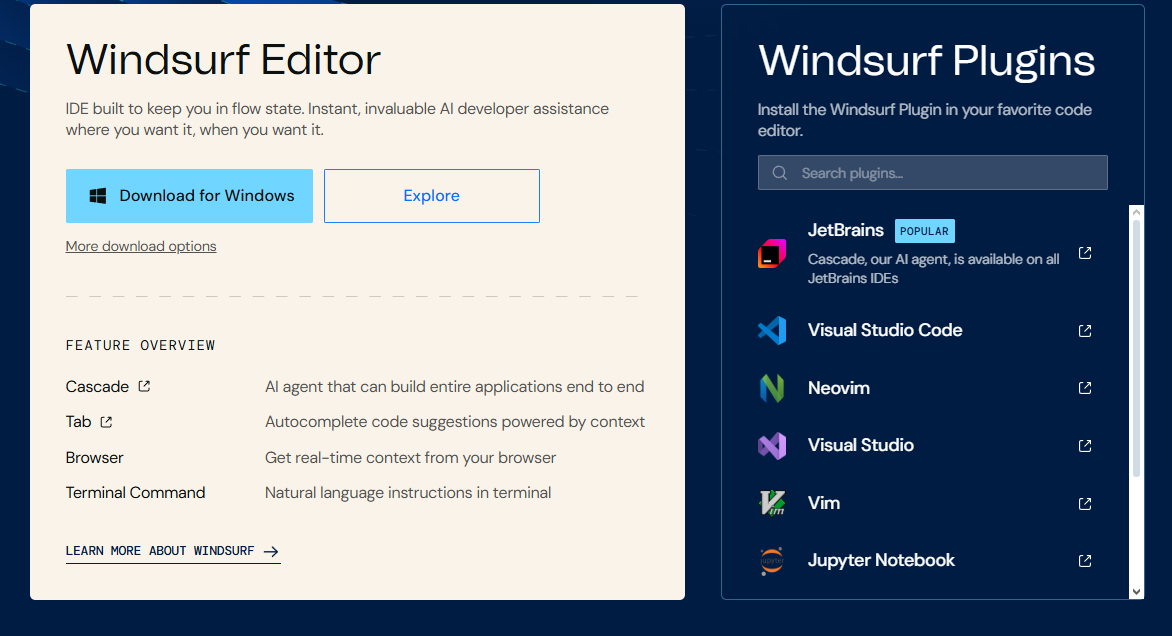

Disponibilidade no Windsurf: Integração Perfeita para Desenvolvedores

A Cognition disponibiliza o SWE-1.5 no Windsurf hoje. Esta plataforma integra profundamente o modelo, oferecendo recursos como Codemaps para navegar em grandes bases de código.

Além disso, a aquisição do Windsurf pela Cognition aprimora a compatibilidade, permitindo que os usuários implementem o SWE-1.5 em ambientes familiares. Os desenvolvedores o baixam e configuram facilmente, beneficiando-se de sistemas de prioridade de solicitação personalizados para sessões suaves.

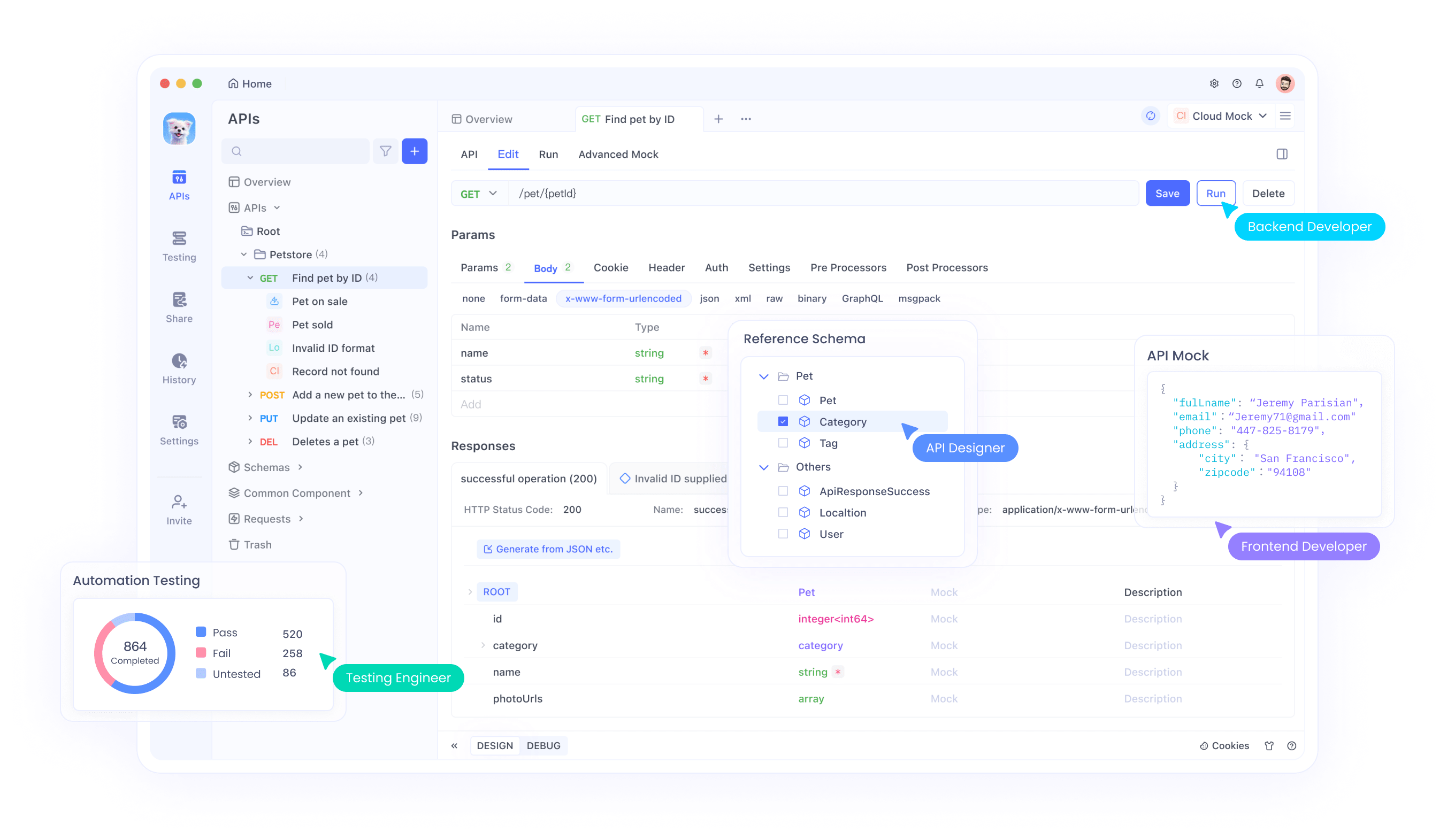

No entanto, para maximizar seu potencial, as equipes o combinam com ferramentas de API. Como mencionado anteriormente, baixar o Apidog gratuitamente ajuda a gerenciar integrações, garantindo que as APIs conectadas ao SWE-1.5 funcionem perfeitamente.

Superando Desafios: Do Teste Beta à Produção

A Cognition implanta múltiplas versões beta do SWE-1.5, nomeadas "Falcon Alpha", para coletar feedback do mundo real. Engenheiros testam o modelo internamente, identificando áreas para melhoria.

Além disso, o endurecimento de recompensas impede a manipulação de avaliadores, garantindo ganhos de desempenho genuínos. Especialistas humanos examinam as saídas, refinando os avaliadores para maior precisão.

No entanto, obstáculos iniciais, como atrasos no sistema, levaram a reescritas, fortalecendo a plataforma. Consequentemente, o SWE-1.5 é lançado no Windsurf como um produto polido, pronto para adoção generalizada.

O Impacto da Velocidade na Experiência do Desenvolvedor

A velocidade define o valor do SWE-1.5 no Windsurf, permitindo a codificação em "estado de fluxo". Engenheiros concluem tarefas sem esperar, impulsionando a criatividade e a produção.

Além disso, essa capacidade de resposta incentiva a experimentação, pois ciclos de feedback rápidos refinam ideias rapidamente.

No entanto, manter a qualidade juntamente com a velocidade exige um equilíbrio cuidadoso, que a Cognition alcança por meio de testes rigorosos.

Comparando o SWE-1.5 com Seus Pares da Indústria

O SWE-1.5 supera o Haiku 4.5 e o Sonnet 4.5 em velocidade, mantendo a inteligência. Benchmarks confirmam sua vantagem em tarefas específicas de software.

Além disso, ao contrário dos modelos gerais, ele se especializa em engenharia, oferecendo soluções personalizadas.

Adicionalmente, o ecossistema do Windsurf amplifica essas vantagens, proporcionando um ambiente coeso.

Considerações de Segurança e Ética na Implantação do SWE-1.5

A Cognition prioriza a segurança no SWE-1.5, implementando salvaguardas contra vulnerabilidades. Usuários no Windsurf se beneficiam de interações criptografadas e controles de acesso.

Além disso, o treinamento ético garante saídas imparciais, promovendo o uso justo no desenvolvimento.

No entanto, as equipes devem monitorar as integrações, usando ferramentas como o Apidog para verificar a segurança da API.

Integrando o SWE-1.5 com Conjuntos de Ferramentas Existentes

Desenvolvedores conectam o SWE-1.5 a IDEs e pipelines CI/CD no Windsurf. APIs facilitam isso, permitindo automações personalizadas.

Além disso, a compatibilidade com linguagens como Python e JavaScript amplia o apelo.

Adicionalmente, contribuições da comunidade aprimoram recursos, fomentando a inovação.

Otimizando o Desempenho: Dicas para Usuários no Windsurf

Para maximizar o SWE-1.5, otimize os prompts para clareza. Use Codemaps para contexto.

Além disso, monitore as métricas de uso para ajustar as interações.

Adicionalmente, integre com o Apidog para tarefas relacionadas à API, garantindo eficiência.

O Papel do Aprendizado por Reforço no Sucesso do SWE-1.5

O aprendizado por reforço molda o SWE-1.5, recompensando ações corretas em simulações.

Além disso, o treinamento de múltiplas interações lida com conversas de forma eficaz.

No entanto, a escalabilidade do RL exige uma infraestrutura robusta, que a Cognition oferece.

Inovações de Hardware Habilitando o SWE-1.5

Chips GB200 impulsionam o treinamento, oferecendo alta taxa de transferência.

Além disso, a inferência Cerebras acelera a implantação.

Adicionalmente, o Otterlink escala ambientes, alinhando-se às necessidades do mundo real.

Considerações Ambientais no Treinamento de Modelos de IA

A Cognition otimiza o uso de energia no treinamento do SWE-1.5.

Além disso, a inferência eficiente reduz a pegada de carbono.

No entanto, a escalabilidade exige práticas sustentáveis.

Tendências de Adoção Global para IA na Engenharia de Software

Desenvolvedores em todo o mundo adotam modelos como o SWE-1.5.

Além disso, o Windsurf facilita o acesso em diversas regiões.

Adicionalmente, esforços de localização expandem o alcance.

Desenvolvimento Colaborativo: Como as Equipes Usam o SWE-1.5

Grupos colaboram por meio de sessões compartilhadas no Windsurf.

Além disso, edições em tempo real aprimoram o trabalho em equipe.

Adicionalmente, a integração de controle de versão otimiza os fluxos de trabalho.

Conclusão: Por Que o SWE-1.5 no Windsurf Importa Agora

A Cognition lança o SWE-1.5 no Windsurf, redefinindo a IA na engenharia de software. Sua velocidade e inteligência capacitam os desenvolvedores, fomentando a inovação. Ao explorar, lembre-se de que pequenas otimizações geram grandes impactos — comece baixando o Apidog gratuitamente para gerenciar APIs de forma contínua.