Desenvolvedores buscam constantemente ferramentas que otimizem fluxos de trabalho complexos, e o Devstral 2 da Mistral AI surge como um divisor de águas nesse cenário. Esta família de modelos de código open-source, composta pelo Devstral 2 e Devstral Small 2, se destaca em tarefas como exploração de base de código, correção de bugs e edições multifile. O que o diferencia? Sua integração com a Mistral API permite acesso contínuo à geração de código de alta performance diretamente em suas aplicações. Além disso, ao combiná-lo com a ferramenta Vibe CLI, é possível automatizar tarefas baseadas em terminal de forma intuitiva e poderosa.

Entendendo o Devstral 2: Uma Análise Técnica da Família de Modelos

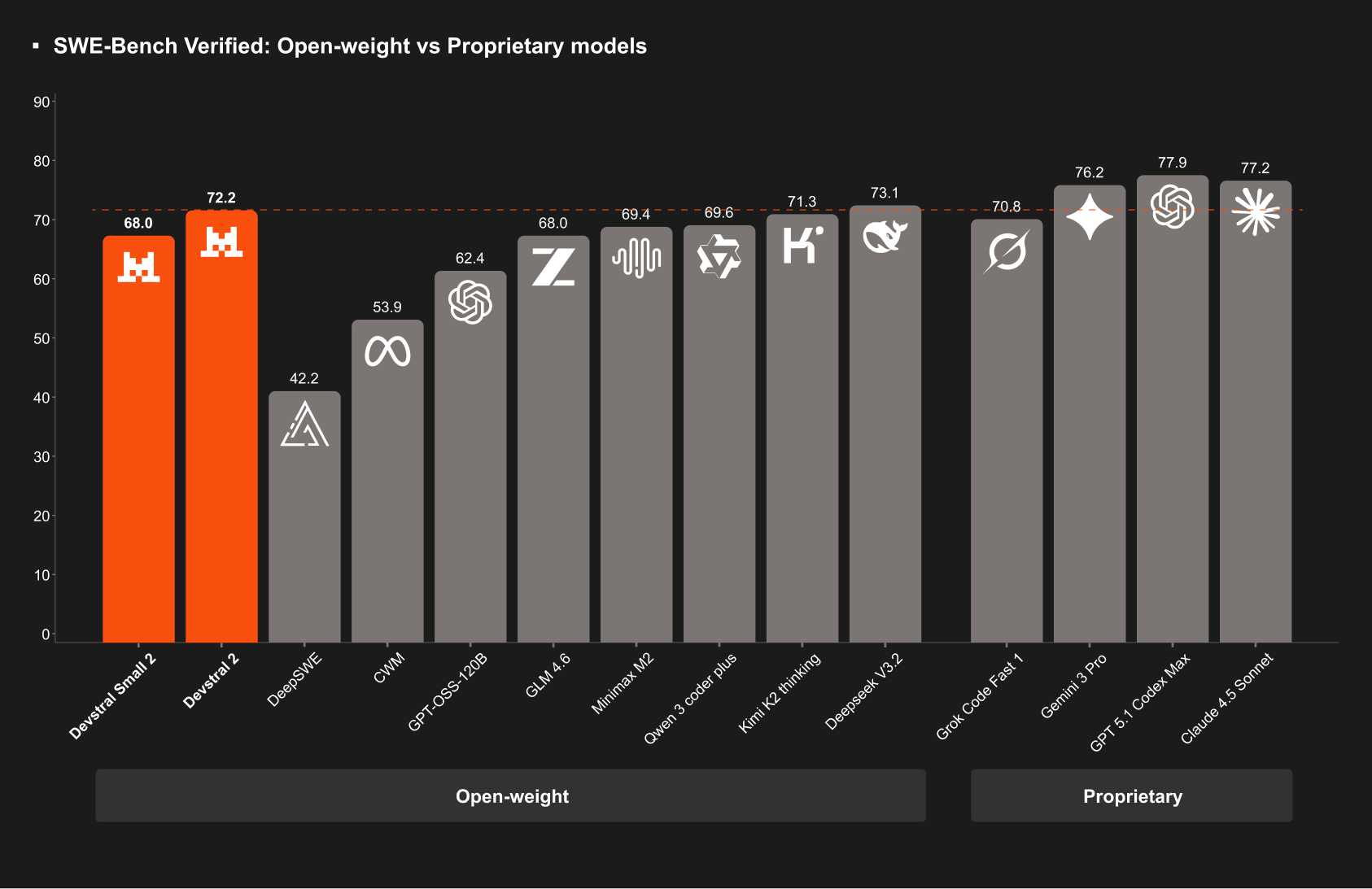

Os engenheiros da Mistral AI projetaram o Devstral 2 para enfrentar diretamente os desafios reais da engenharia de software. Em sua essência, o Devstral 2 — um transformador denso de 123 bilhões de parâmetros — processa código com precisão, alcançando 72,2% no benchmark SWE-bench Verified. Este resultado reflete sua capacidade de resolver problemas do GitHub autonomamente, superando modelos como DeepSeek V3.2 com uma taxa de vitória de 42,8% em avaliações humanas. Consequentemente, as equipes o adotam para tarefas de nível de produção sem a sobrecarga de concorrentes maiores.

Enquanto isso, o Devstral Small 2, com 24 bilhões de parâmetros, é focado em ambientes com recursos limitados. Ele atinge 68,0% no SWE-bench e introduz suporte multimodal, aceitando entradas de imagem para tarefas como geração de código baseada em screenshots. Ambos os modelos operam sob licenças permissivas: o Devstral 2 via uma MIT modificada, e o Devstral Small 2 sob Apache 2.0. Essa abertura incentiva contribuições da comunidade e fine-tuning personalizado.

Tecnicamente, esses modelos utilizam uma janela de contexto de 256K tokens, permitindo que ingiram repositórios inteiros para análise holística. Por exemplo, o Devstral 2 rastreia dependências de framework entre arquivos, detecta falhas e sugere novas tentativas — recursos que reduzem a depuração manual em até 50% nos benchmarks. Além disso, sua arquitetura otimiza a eficiência de custos; desenvolvedores relatam economias de 7x em comparação com o Claude Sonnet para saídas equivalentes.

Considere as implicações para o uso empresarial. O Devstral 2 lida com o raciocínio em nível de arquitetura, modernizando sistemas legados ao refatorar código monolítico em microsserviços. Em contraste, o Devstral Small 2 funciona em configurações de GPU única, tornando-o ideal para implantações de borda. Como resultado, as organizações escalam a codificação assistida por IA sem grandes reestruturações de infraestrutura.

Para quantificar o desempenho, examine as principais métricas:

| Modelo | Parâmetros | Pontuação SWE-bench | Janela de Contexto | Suporte Multimodal | Licença |

|---|---|---|---|---|---|

| Devstral 2 | 123B | 72.2% | 256K | Não | MIT Modificada |

| Devstral Small 2 | 24B | 68.0% | 256K | Sim | Apache 2.0 |

Essas especificações posicionam o Devstral 2 como uma espinha dorsal versátil para agentes de código. A seguir, vamos abordar o Vibe CLI, que traz esse poder para sua linha de comando.

Explorando o Vibe CLI: Interface de Linha de Comando para Automação do Devstral 2

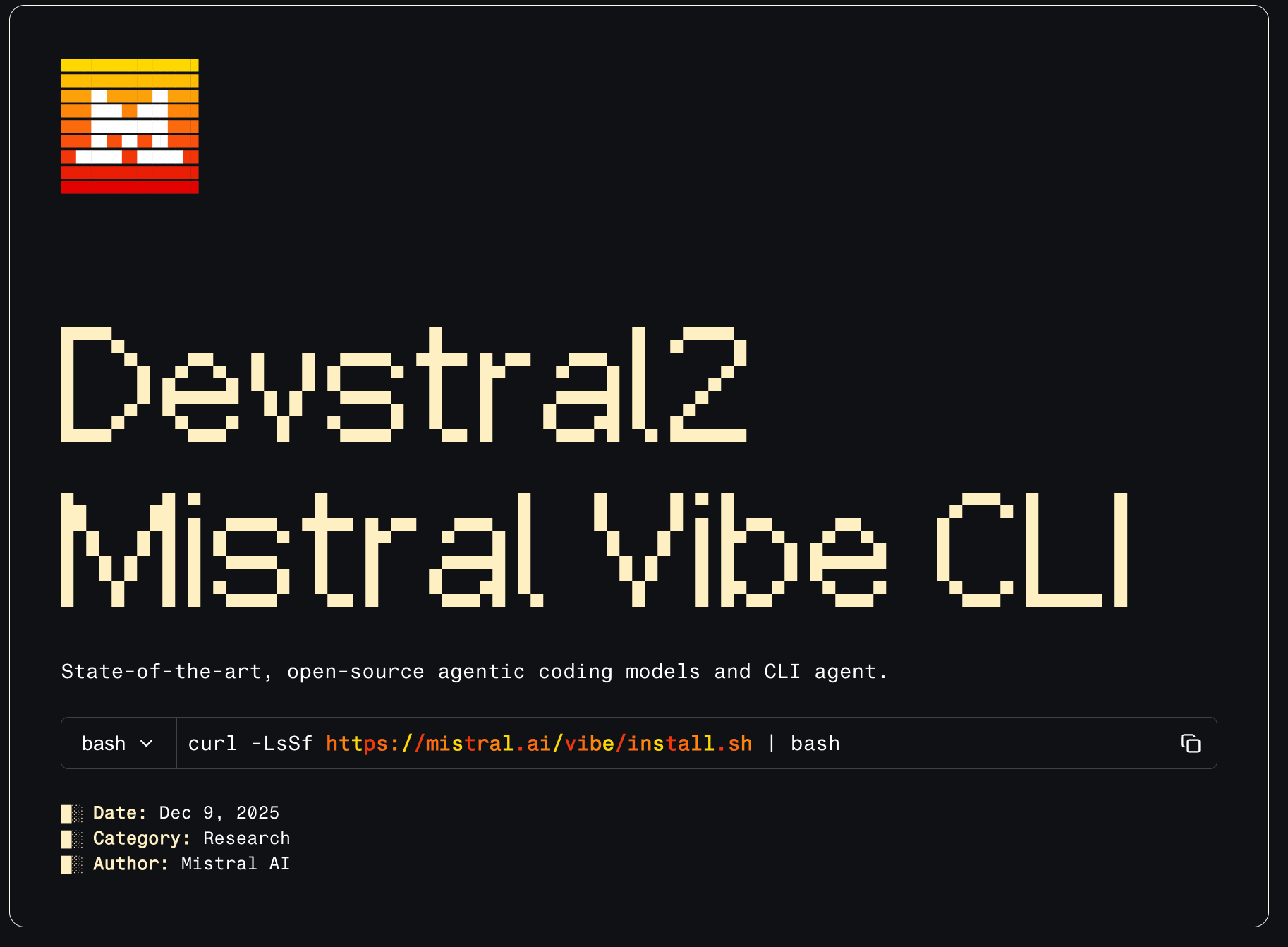

O Vibe CLI se apresenta como o companheiro open-source da Mistral AI para o Devstral 2, transformando prompts de linguagem natural em alterações de código executáveis. Desenvolvedores o instalam através de um comando curl simples: curl -LsSf https://mistral.ai/vibe/install.sh | bash. Uma vez configurado, ele inicia uma interface de chat interativa no terminal, completa com autocompletar e histórico persistente.

O que torna o Vibe CLI eficaz? Ele incorpora contexto consciente do projeto, escaneando diretórios para referenciar arquivos com a notação @. Por exemplo, digite @main.py para puxar um script para análise. Além disso, execute comandos shell usando !, como !git status, para integrar o controle de versão de forma contínua. Comandos de barra aprimoram ainda mais a usabilidade: /config ajusta as configurações, enquanto /theme personaliza a interface.

Por baixo do capô, o Vibe CLI adere ao Protocolo de Comunicação de Agentes, permitindo extensões de IDE como o plugin do Zed. Configure-o através de um arquivo config.toml, onde você especifica provedores de modelo (por exemplo, instâncias Devstral locais ou chaves da Mistral API), permissões de ferramentas e regras de aprovação automática para execuções. Essa flexibilidade evita excessos; para projetos sensíveis, desative a escrita de arquivos por padrão.

Na prática, o Vibe CLI se destaca em fluxos de trabalho iterativos. Suponha que você mantenha um aplicativo web Python. Dê o prompt: "Refatore o módulo de autenticação em @auth.py para usar JWT em vez de sessões." O Vibe CLI explora dependências, gera diffs e aplica alterações via !git apply. Se surgirem conflitos, ele os detecta e propõe alternativas — espelhando os mecanismos de nova tentativa do Devstral 2.

Benchmarks mostram que o Vibe CLI completa tarefas de ponta a ponta 3x mais rápido do que a edição manual em cenários multifile. Além disso, seu modo de script suporta scripts de automação, como processamento em lote de revisões de PR. Para execuções locais, combine-o com o Devstral Small 2 em hardware de consumo; os tempos de inferência caem para segundos por resposta.

No entanto, a verdadeira força do Vibe CLI reside em sua sinergia com a API. Ele serve como proxy para requisições à Mistral API, armazenando em cache as respostas para eficiência. Conforme prosseguimos, essa ponte se torna crucial para integrações personalizadas.

Acessando a API Devstral 2: Guia de Implementação Passo a Passo

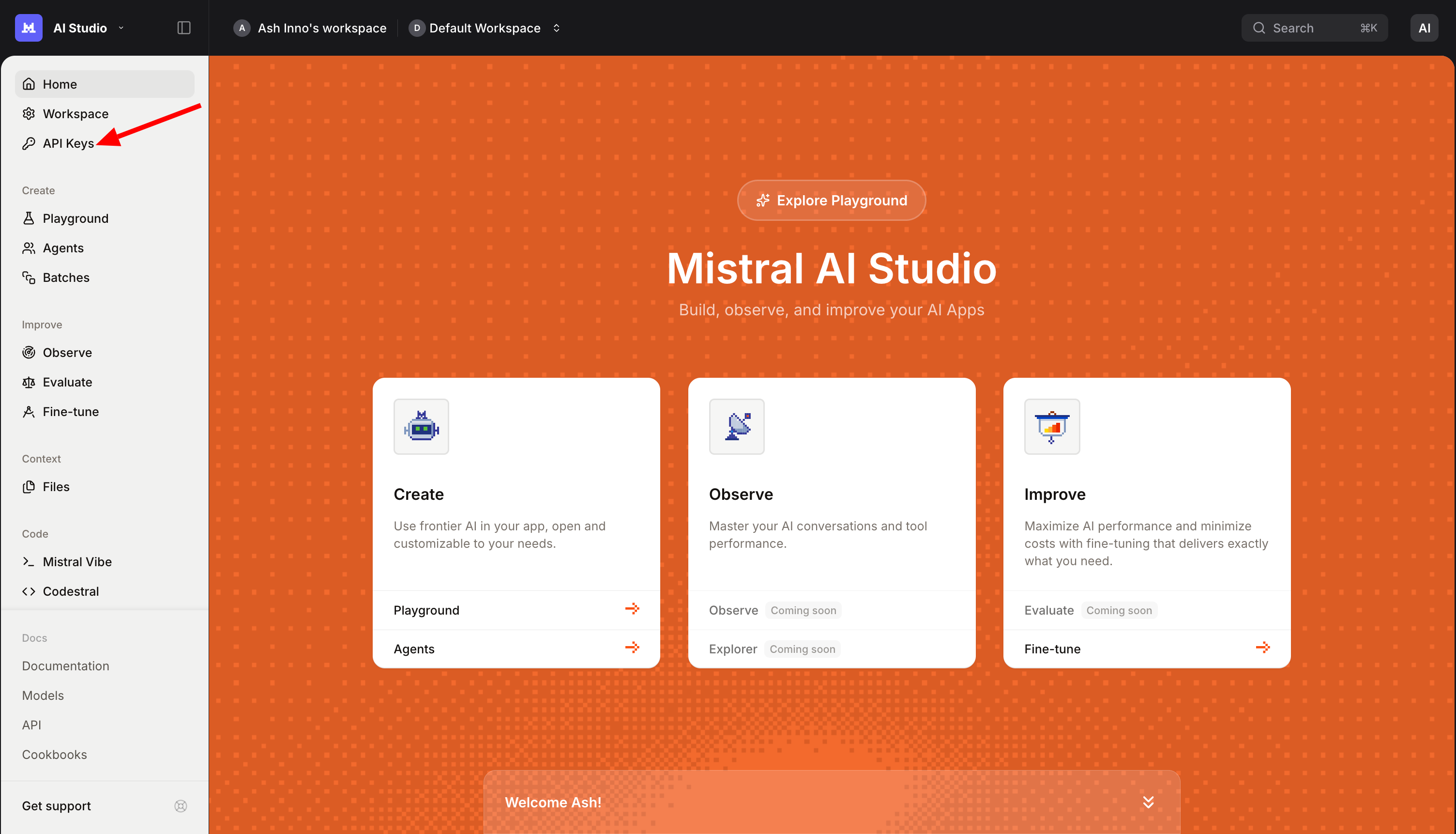

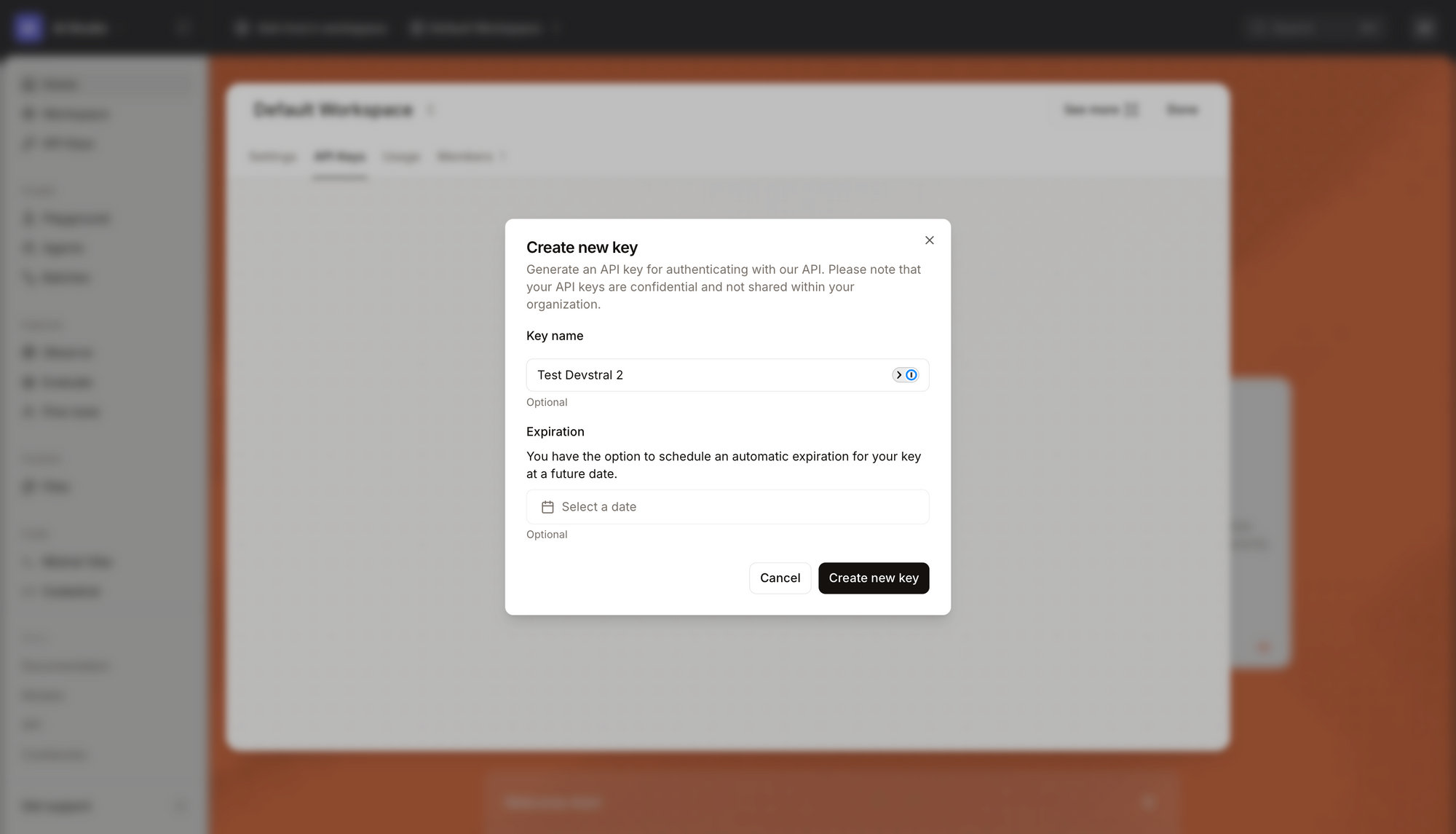

Acessar a API Devstral 2 requer uma conta Mistral AI, disponível no console. O registro concede acesso gratuito imediato durante o período introdutório, com transição para precificação pay-as-you-go: $0,40 de entrada / $2,00 de saída por milhão de tokens para o Devstral 2, e $0,10 / $0,30 para o Devstral Small 2. A autenticação utiliza chaves de API, geradas no painel do console.

Comece obtendo sua chave. Navegue até a seção API, crie uma nova chave e armazene-a com segurança.

A API segue as convenções RESTful sobre HTTPS, com endpoints hospedados em https://api.mistral.ai/v1. As operações principais incluem chat completions, fine-tuning e embeddings, mas para codificação, foque em /v1/chat/completions.

Crie requisições em formato JSON. Um exemplo básico de curl para o Devstral 2:

curl https://api.mistral.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $MISTRAL_API_KEY" \

-d '{

"model": "devstral-2",

"messages": [{"role": "user", "content": "Escreva uma função Python para analisar configurações JSON."}],

"max_tokens": 512,

"temperature": 0.1

}'

Essa chamada retorna o código gerado no campo choices[0].message.content. Ajuste a temperature para criatividade (0.0 para saídas determinísticas) e max_tokens para o comprimento da resposta. Para tarefas de base de código, inclua contexto no prompt: preceda o conteúdo do arquivo ou use mensagens do sistema para instruções.

O uso avançado envolve streaming de respostas com "stream": true, ideal para plugins de IDE em tempo real. A API suporta até 256K tokens, então processe grandes entradas em lotes. O tratamento de erros é importante; códigos comuns incluem 401 (não autorizado) e 429 (limites de taxa). Implemente retentativas com backoff exponencial:

import requests

import time

import os

def call_devstral(prompt, model="devstral-2"):

url = "https://api.mistral.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.getenv('MISTRAL_API_KEY')}",

"Content-Type": "application/json"

}

data = {

"model": model,

"messages": [{"role": "user", "content": prompt}],

"max_tokens": 1024,

"temperature": 0.2

}

while True:

response = requests.post(url, json=data, headers=headers)

if response.status_code == 429:

time.sleep(2 ** attempt) # Exponential backoff

attempt += 1

elif response.status_code == 200:

return response.json()["choices"][0]["message"]["content"]

else:

raise Exception(f"API error: {response.status_code}")

# Exemplo de uso

code = call_devstral("Otimize esta consulta SQL: SELECT * FROM users WHERE age > 30;")

print(code)

Este trecho de Python demonstra chamadas resilientes. Para multimodal com Devstral Small 2, faça upload de imagens via codificação base64 no array de conteúdo.

Os limites de taxa variam por nível; monitore o uso através do console. Os endpoints de fine-tuning (/v1/fine_tuning/jobs) permitem personalização em conjuntos de dados proprietários, exigindo arquivos JSONL com pares de prompt-completion.

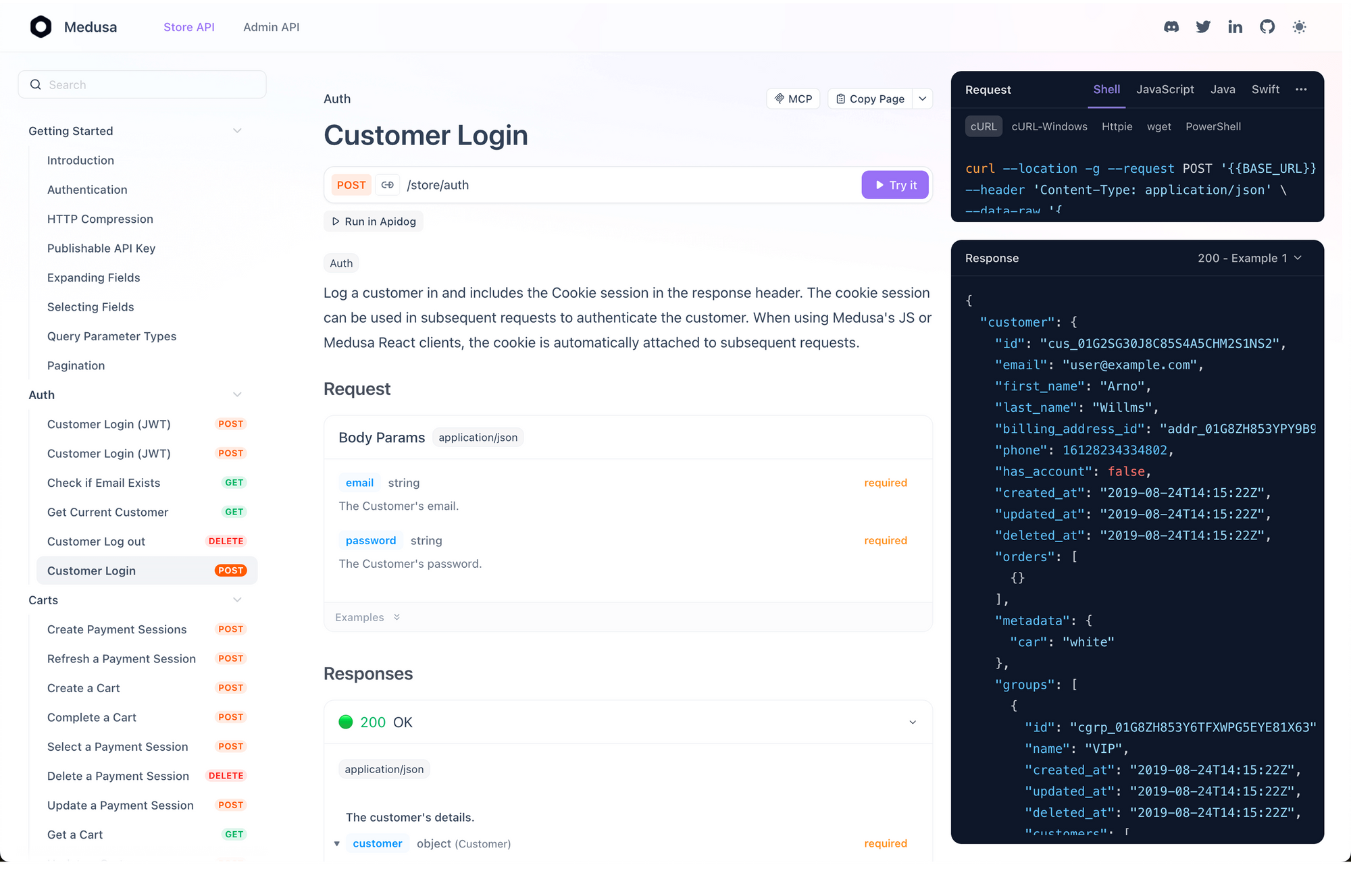

Na transição para testes, o Apidog simplifica a validação. Importe a especificação OpenAPI da Mistral para o Apidog, simule ambientes e execute coleções para simular fluxos de trabalho. Essa abordagem detecta casos extremos precocemente.

Integrando a API Devstral 2 com Apidog: Melhores Práticas para Desenvolvimento Orientado a API

O Apidog eleva o uso da API Devstral 2, fornecendo uma plataforma unificada para design, teste e documentação. Comece baixando o Apidog — gratuito para indivíduos — e criando um novo projeto. Cole o esquema da Mistral API (disponível no console) para gerar automaticamente os endpoints.

Por que Apidog? Ele suporta OpenAPI 3.0, alinhando-se com a especificação da Mistral, e oferece construtores visuais de requisições. Teste uma conclusão de chat: Defina o método como POST, adicione seu token Bearer e insira payloads JSON. O visualizador de respostas do Apidog analisa JSON, destacando as saídas de código para revisão rápida.

Para automação, utilize o scripting do Apidog. Scripts pré-requisição buscam contextos dinâmicos, como diffs recentes do Git, antes de acessar a API. Scripts pós-resposta analisam as gerações e acionam comandos Vibe CLI. Exemplo de script em JavaScript:

// Pré-requisição: Busca contexto do repositório

pm.sendRequest({

url: 'https://api.github.com/repos/user/repo/contents/',

method: 'GET',

header: {

'Authorization': 'token {{github_token}}'

}

}, (err, res) => {

if (!err) {

pm.variables.set('context', res.json().map(f => f.name).join('\n'));

}

});

// A requisição principal usa {{context}} no prompt

Essa integração garante que os prompts permaneçam relevantes. Além disso, os recursos de colaboração do Apidog permitem que as equipes compartilhem coleções, padronizando o uso do Devstral 2.

Casos de Uso Avançados: Aproveitando Devstral 2 e Vibe CLI em Produção

Além do básico, a API Devstral 2 impulsiona agentes sofisticados. Combine-a com o Vibe CLI para fluxos de trabalho híbridos: use o CLI para prototipagem local e, em seguida, implante endpoints da API em pipelines CI/CD. Por exemplo, integre com GitHub Actions:

name: Code Review

on: [pull_request]

jobs:

review:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Run Devstral Review

run: |

curl -X POST https://api.mistral.ai/v1/chat/completions \

-H "Authorization: Bearer ${{ secrets.MISTRAL_API_KEY }}" \

-d '{

"model": "devstral-2",

"messages": [{"role": "user", "content": "Revise as alterações em ${{ github.event.pull_request.diff_url }}"}]

}' | jq '.choices[0].message.content' > review.md

- name: Comment PR

uses: actions/github-script@v6

with:

script: |

github.rest.pulls.createReview({

owner: context.repo.owner,

repo: context.repo.repo,

pull_number: context.payload.pull_request.number,

body: fs.readFileSync('review.md', 'utf8')

})

Este YAML automatiza revisões, puxando diffs e gerando feedback. O Vibe CLI complementa ao lidar com mesclagens locais: vibe "Aplique as alterações sugeridas de review.md".

Em cenários multimodais, a API Devstral Small 2 processa screenshots de UI. Alimente imagens base64: {"type": "image_url", "image_url": {"url": "data:image/png;base64,iVBOR..."}}. As aplicações incluem auditorias de acessibilidade, onde o modelo sugere melhorias de texto alternativo.

Para escala empresarial, faça fine-tuning em dados específicos do domínio. Faça upload de conjuntos de dados para /v1/fine_tuning/jobs, especificando épocas e taxas de aprendizado. Pós-treinamento, a API serve modelos personalizados em endpoints dedicados, reduzindo a latência em 30%.

A computação de borda se beneficia do tempo de execução on-device do Devstral Small 2. Implante via ONNX, integrando fallbacks da API para tráfego em excesso. Ferramentas como Kilo Code ou Cline estendem isso, incorporando a lógica do Vibe CLI no VS Code.

Métricas de adotantes mostram ganhos de produtividade de 5x: Uma startup refatorou um monolito de 100K linhas em semanas, creditando o rastreamento de dependências do Devstral 2.

Conclusão: Transforme Sua Codificação com a API Devstral 2 Hoje

O Devstral 2 redefine o desenvolvimento assistido por IA através de sua robusta família de modelos, o intuitivo Vibe CLI e uma API acessível. Desenvolvedores utilizam esses recursos para tudo, desde correções rápidas até refatorações completas, apoiados por benchmarks impressionantes e economias de custo.

Implemente as estratégias delineadas — comece com as instalações do Vibe CLI, chaves de API seguras e testes via Apidog. Pequenas otimizações, como prompts precisos ou contextos em cache, geram aumentos substanciais de eficiência. À medida que a IA evolui, o Devstral 2 o posiciona na vanguarda.

Pronto para experimentar? Acesse o console da Mistral, ative o Vibe CLI e baixe o Apidog gratuitamente. Seu próximo avanço o aguarda.