Google Geminiは、高度なAIを活用して自然言語のアイデアを完全に機能するアプリケーションに変換する「vibe coding(バイブコーディング)」を導入することで、開発者や愛好家のコーディングへのアプローチを変革します。開発者は対話形式のプロンプトを通じてコードを生成し、従来の障壁なしに迅速なプロトタイピングを可能にします。

エンジニアは、トランジションのわずかな調整がコードの可読性と保守性の大幅な向上につながることを認識しています。Google Geminiは複雑なセットアップを自動化することでこれを促進し、開発者はコアロジックに集中できます。さらに、このシステムはマルチモーダル機能を組み込んでおり、テキスト、画像などを処理できるアプリを可能にします。ユーザーはGoogle AI Studioを介してこれにアクセスし、Geminiモデルがプロンプトをインテリジェントに処理します。

Vibeコーディングとは何か、そしてGoogle Geminiはどのようにそれを可能にするのか?

Vibeコーディングは、ソフトウェア開発におけるパラダイムシフトを意味します。開発者はアプリケーションのアイデアを自然言語で記述し、Google GeminiのようなAIシステムがその記述を解釈して実行可能なコードを生成します。2025年初頭に初めて普及したこのアプローチは、人間の直感とAIの精度との間のコラボレーションを重視します。Google Geminiは、コアモデルとして、プロンプトを分析して、ユーザーインターフェース、バックエンドロジック、統合などの必要なコンポーネントを特定します。

Google Geminiは、そのマルチモーダルな推論能力を活用してvibeコーディングを強化します。モデルはプロンプトからコンテキストを理解し、適切なAPIと機能を自動的に選択します。例えば、プロンプトが画像編集アプリを要求した場合、Google Geminiは生成タスクのためにImagenのようなツールを組み込みます。これにより手動設定が不要になり、開発時間が数時間から数分に短縮されます。

さらに、vibeコーディングは、完璧さよりも反復を優先するという点で従来のコーディングとは異なります。ユーザーは連続するプロンプトを通じて出力を洗練させ、最終製品が彼らのビジョンと一致するようにします。Google Geminiは、インタラクション間で状態を維持し、以前の生成物に基づいて構築するため、この点で優れています。

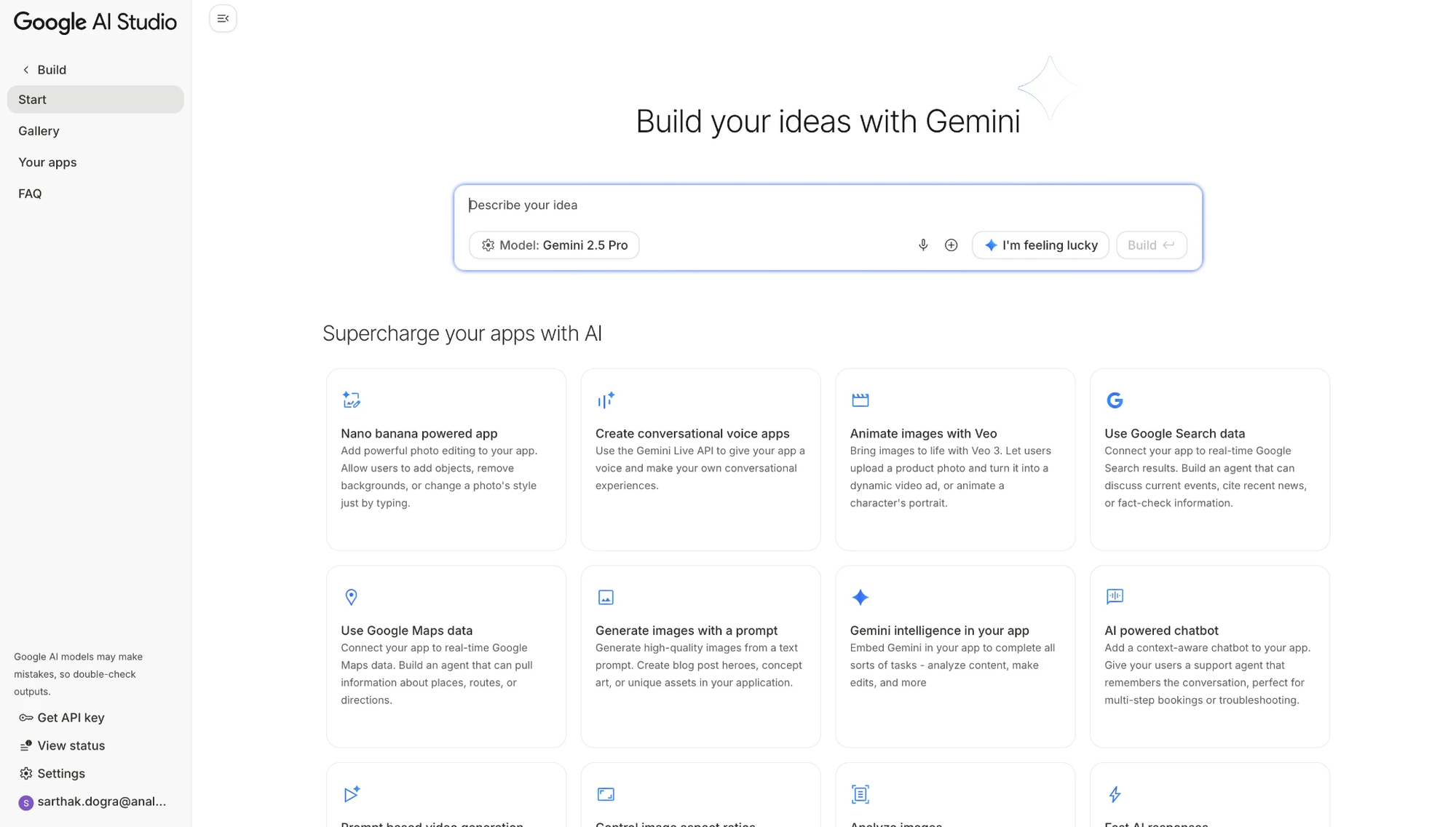

Google Geminiは、トランスフォーマーベースのアーキテクチャを使用して入力を処理します。プロンプトをトークン化し、関連性を評価するためにアテンションメカニズムを適用し、JavaScriptやPythonのような言語でコードを生成します。このシステムとGoogle AI Studioの統合により、開発者は高度な推論のためにGemini 2.5 Proのようなモデルを選択できる、ユーザーフレンドリーなインターフェースが提供されます。

しかし、vibeコーディングには責任ある使用が必要です。エンジニアはAIが生成したコードのセキュリティ脆弱性と効率性をレビューします。Google Geminiは、出力と並行して説明を提供することでこれをサポートし、透明性を促進します。

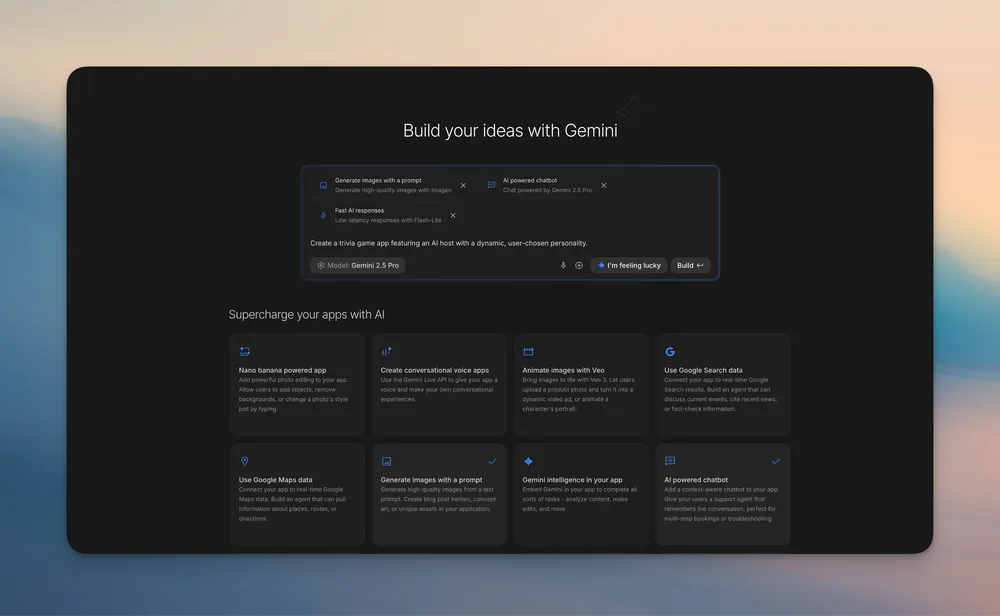

このビジュアルは、アイデアを直接入力する合理化されたセットアップを示しています。

Google GeminiのVibeコーディングを支える技術アーキテクチャ

Google Geminiは、膨大なデータセットでトレーニングされた大規模言語モデルを含む洗練されたスタック上で動作します。アーキテクチャは、入力処理、推論エンジン、出力生成の複数のレイヤーを特徴としています。プロンプトを送信すると、Google Geminiはそれを埋め込みにトークン化し、意味的な意味を捉えます。

その後、モデルは複雑な要求を分解するために思考連鎖推論を適用します。例えば、「写真変換アプリを構築して」というプロンプトは、Google Geminiがカメラアクセス、画像処理、UI要素の必要性を特定するようにトリガーします。そして、事前に定義されたテンプレートとAPIを使用してコードを組み立てます。

主要なコンポーネントは次のとおりです。

- マルチモーダル統合: Google Geminiは、統合された埋め込みを介してテキスト、画像、ビデオを処理します。

- API自動接続: システムは、ビデオ生成のためのVeoやデータ検証のためのGoogle検索などのサービスに接続します。

- クォータ管理: Google Geminiは使用状況を監視し、無料制限が尽きるとユーザー提供のAPIキーに切り替えます。

さらに、読み込み中のブレインストーミング機能は、Google Geminiを使用してリアルタイムで改善案を提案します。これは、メインのビルドを遅らせることなくアイデアを生成するために並列処理を利用します。

エンジニアは、Google Geminiがパフォーマンスを最適化する方法を高く評価しています。一般的なパターンをキャッシュすることでレイテンシを最小限に抑え、応答性の高いインタラクションを保証します。ただし、限界も存在し、高度に専門化されたドメインでは手動での微調整が必要になる場合があります。

機能を拡張するには、外部ツールと統合します。例えばApidogは、Google Geminiが組み込むAPIをテストし、信頼性のためにエンドポイントを検証します。

Google AI StudioでVibeコーディングを始める

Google AI Studioにアクセスしてvibeコーディングを開始します。必要であればアカウントを作成し、次に「Build」タブにアクセスします。ここで、Google Geminiはモデル選択と機能アクティベーションのオプションを提示します。

まず、迅速な反復にはGemini 2.5 Flash、深みのある作業にはProのようなモデルを選択します。次に、写真編集にはNano Banana、アニメーションにはVeoのような機能を有効にします。

その後、プロンプトを作成します。効果的なプロンプトは、「画像生成機能を備えた庭園デザイン用のインタラクティブなチャットボットを開発する」のように機能を具体的に指定します。Google Geminiはこれを処理し、アプリの骨格を生成します。

さらに、ランダムなアイデアを得るには「I'm Feeling Lucky」ボタンを使用します。これはGoogle Geminiの創造性を活用して、配線された機能を含むコンセプトを提案します。

構築が完了すると、アプリは編集可能なインターフェースに表示されます。スタジオ内で直接テストし、動作を確認します。

APIを多用するアプリでは、Apidogが非常に貴重です。Google Geminiが組み込む呼び出しをモックアップしてテストでき、シームレスな操作を保証します。

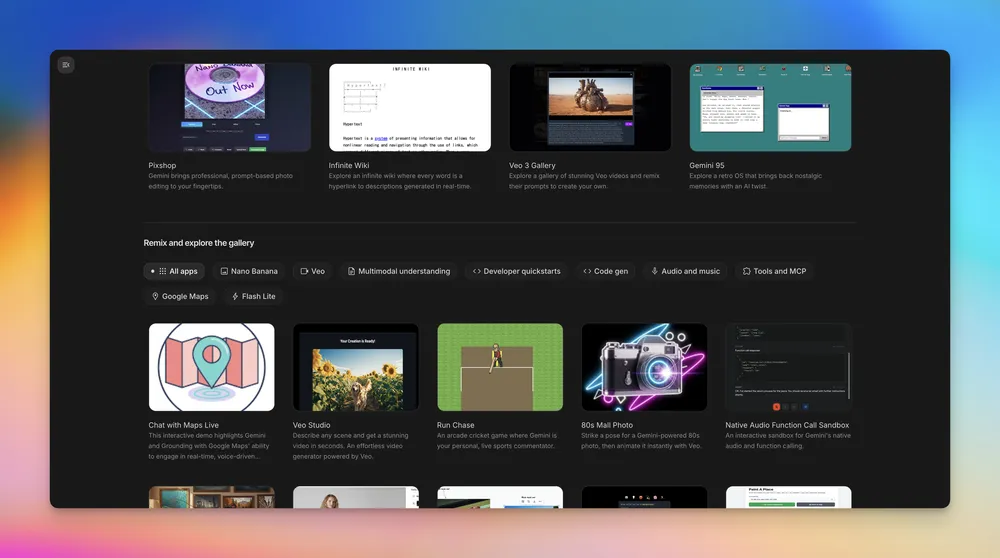

このギャラリーは発見を助け、開始点を最適化します。

Google Geminiで初めてのアプリをVibeコーディングするステップバイステップガイド

Google AI Studioにログインし、vibeコーディングモードを選択することから始めます。「nano bananaを使って、オブジェクトの写真をアップロードし、それをシーンにドラッグして、そのオブジェクトをシーン内に生成できるアプリを作成してください。これは家具のアイデアをテストするために使いたいです」のような説明的なプロンプトを入力します。

Google Geminiはプロンプトを分析し、カメラ入力と画像操作の要件を特定します。その後、APIを自動的に統合しながらコードを組み立てます。

構築中、ブレインストーミング画面には、音声コマンドの追加など、Google Geminiが生成したアイデアが表示されます。

完了後、アプリをレビューします。要素をハイライトして注釈モードをアクティブにし、Google Geminiに「このボタンを青色に変更してアニメーション化してください」と指示します。

Google Gemini Vibeコーディングの高度な機能を探索する

Google Geminiは、正確な修正のために注釈モードを提供します。UIの一部を選択し、自然言語の指示を提供すると、Google Geminiがそれをコード更新に変換します。

例えば、「画像を左からアニメーション化する」という指示は、Google Geminiの理解を通じてCSSアニメーションをトリガーします。

さらに、アプリギャラリーはリポジトリとして機能します。既存のプロジェクトを閲覧し、リミックスし、そこから学ぶことで、開発を加速させます。

クォータ処理は継続性を保証します。Google Geminiは制限が近づくと通知し、APIキーの追加を促します。

他のGoogleサービスとの統合は、その力を増幅させます。Veoはビデオを生成し、Imagenは画像を処理します。これらはすべてGoogle Geminiによって接続されます。

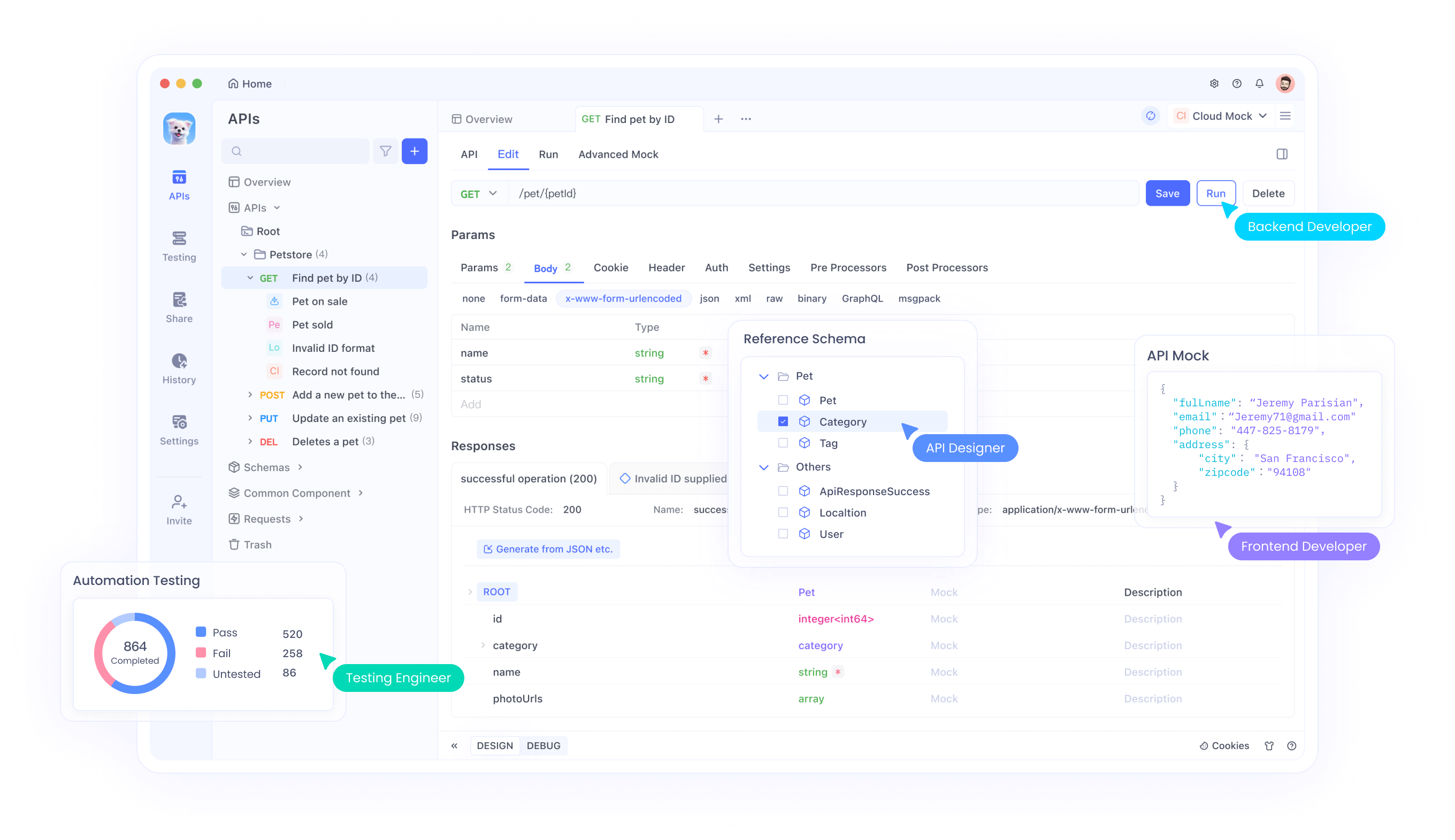

しかし、カスタムAPIの場合、Apidogは設計とテストを容易にし、Google Geminiの出力を補完します。

強化されたAPI管理のためにApidogをGoogle Geminiと統合する

ApidogはAPI設計とテストに優れており、Google Geminiからのvibeコーディングされたアプリに完全に適合します。

Gemini APIキーを取得し、その後Apidogでエンドポイントを呼び出すプロジェクトを作成します。

例えば、アプリがAPI経由でVeoを使用する場合、Apidogはリクエストをモックアップし、パラメータを検証します。

ApidogのインターフェースはOpenAPI仕様のインポートを可能にし、Google Geminiの生成物と整合します。

さらに、Apidogでのデバッグセッションは、Google Geminiが見落とす可能性のある問題を明らかにします。

エンジニアはApidogを使用して呼び出しを連鎖させ、マルチモーダルアプリが連携して機能するようにします。

この相乗効果を体験するために、Apidogを無料でダウンロードしてください。

Google GeminiでのVibeコーディングのベストプラクティス

言語と機能を指定して、明確なプロンプトを作成します。

コードをレビューする: Google Geminiは一般的に最適化しますが、常に完璧ではないため、非効率な箇所を探します。

段階的にテストする: 小さく構築し、拡張します。

クォータを管理する: 使用状況を監視し、個人のキーを統合します。

反復を文書化する: 再現性のためにプロンプトを追跡します。

APIレイヤーにはApidogを活用し、テストを自動化します。

過度な依存を避ける: コードを所有するために出力を理解します。

Google Geminiが推進するVibeコーディングの未来

Google Geminiは進化し、より深い統合とより速い生成を約束します。

将来のアップデートには、リアルタイムコラボレーションや高度なデバッグが含まれる可能性があります。

AIの進歩に伴い、vibeコーディングは初心者と専門家の境界線を曖昧にします。

しかし、倫理的な考慮事項は依然として存在します: バイアスのない出力を確保します。

Apidogのようなツールにより、エコシステムは強化され、複雑なデプロイメントをサポートします。

要約すると、Google Geminiはvibeコーディングを通じて開発を民主化します。あなたは今、それを効果的に実装するための知識を持っています。今日から実験し、反復し、革新的なアプリを作成してください。