AIの力を活用して真に深い研究ができたらいいと思ったことはありませんか?しかし、クローズドソースのソリューションやデータプライバシーの懸念に制限を感じていたら?さて、この記事では、自分自身のオープンソースの深い研究ツールをGemini APIを利用して構築します!

その通りです、完全にあなたのコントロール下にある研究のためのパワーハウスを作成しています。これを、必要なときにいつでも利用できる専任のAI研究アシスタントを手元に持つようなものと考えてください。そして、最も素晴らしい点は?正確で洞察に満ちた分析を得るためにGemini APIを活用します。それでは、始めましょう!

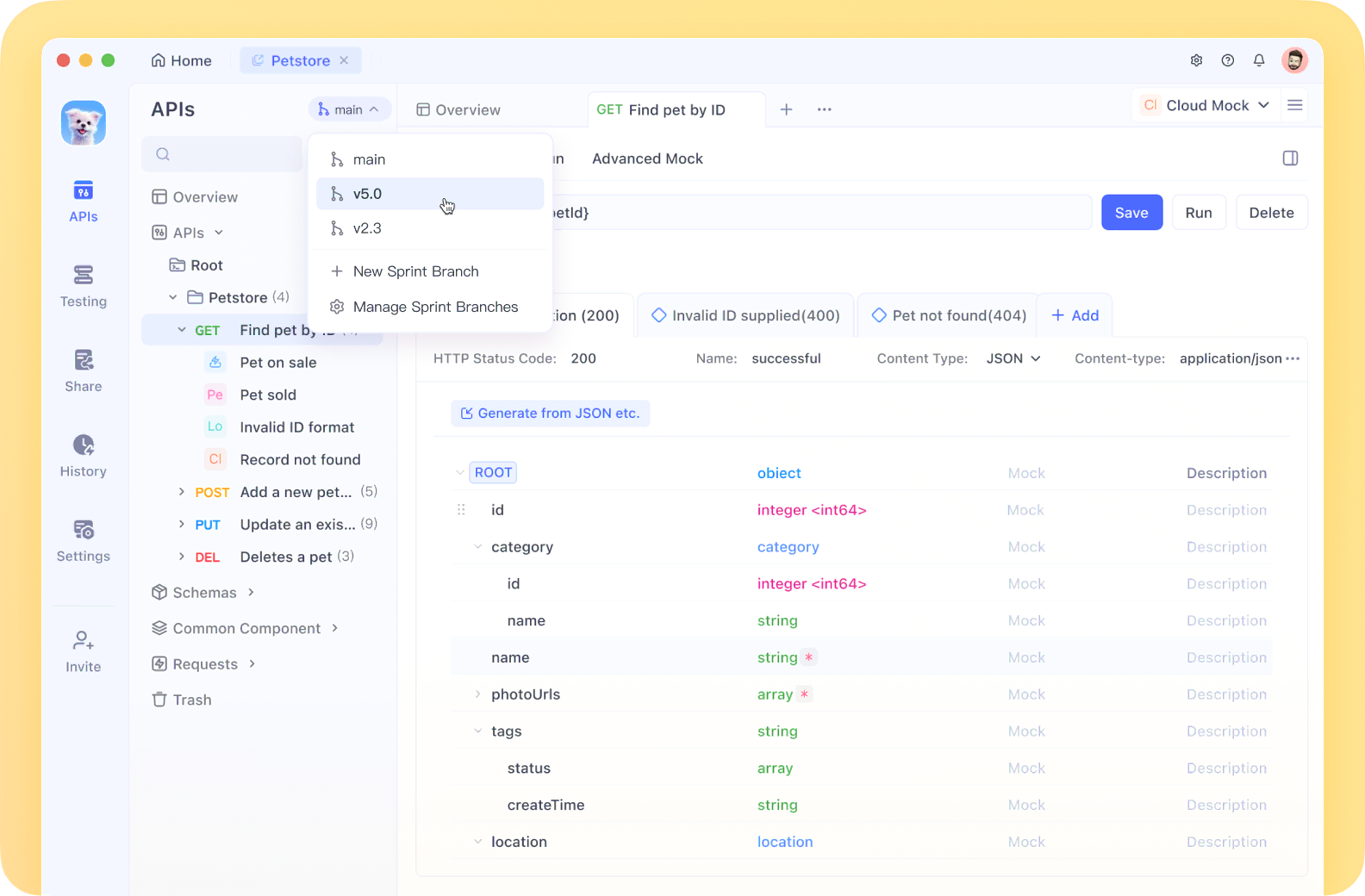

MCPサポートがApidogに近日登場することをお知らせできてとても嬉しいです!🚀

— Apidog (@ApidogHQ) 2025年3月19日

Apidog MCPサーバーを使用すると、APIドキュメントを直接Agentic AIにフィードし、コーディング体験を強化することができます!Cursor、Cline、Windsurfを使用しているかどうかにかかわらず、開発プロセスをより迅速かつスムーズにします。… pic.twitter.com/ew8U38mU0K

オープンソースの深い研究とは何ですか?

オープンソースの深い研究は、研究プロセスを自分でコントロールすることです。それは、透明性やプライバシーを維持し、自分の特定のニーズに合ったツールをカスタマイズする力を活用することです。独自の研究ツールを構築することで、クローズドソースのソリューションの制約や可能性のあるバイアスを避け、自分のデータを安全に保つことができます。MCPは、このプロセスを促進し、さまざまなAPIや機能との正しい統合を保証し、パフォーマンスを向上させます。

なぜ深い研究にGemini APIを使用するのでしょうか?

Gemini APIは、人工知能に対する最先端のアプローチを提供し、より直感的で効果的な人間と機械のインタラクションを可能にします。それは、テキストベースの洞察だけでなく、マルチモーダル入力もサポートし、画像、動画、音声を通じて研究資料のより豊かな理解を提供します。これは、多様なデータタイプの分析を必要とする包括的な研究プロジェクトに特に価値があります。さらに、APIの柔軟な設計と強力な開発者サポートは、イノベーションとカスタマイズを促進し、研究者がツールを特定のニーズや文脈に合わせて調整できるようにし、最終的には複雑な主題に対するより深く、より微妙な理解を育むことができます。

私たちのオープンソースの深い研究ツールの主な機能

ビルドプロセスに入る前に、私たちが実現する機能のいくつかを見てみましょう:

- 迅速な深い研究による迅速な洞察。

- マルチプラットフォームサポートによるシームレスなアクセス。

- Google Geminiによって強化された高度なAI機能。

- 思考&ネットワーキングモデルによるインテリジェントな分析。

- キャンバスサポートによる視覚的な整理。

- 研究履歴による進捗の追跡。

- ローカル&サーバーAPIサポートによる柔軟性。

- プライバシー重視の設計による安全な研究。

- マルチキーのペイロードサポートによる機能拡張。

- 多言語サポート:英語、简体中文。

- 現代的な技術で構築された効率性とパフォーマンス。

オープンソースの深い研究ツールを始めるには

AI対応の研究アシスタントを自分で構築する準備はできましたか?始めるために必要なものは以下の通りです:

1. Gemini APIキーを取得:まず第一に、GoogleのAIモデルの力にアクセスするためにはGemini APIキーが必要です。Google AI StudioにアクセスしてAPIキーにサインアップしてください。このキーを安全に保管してください—それはGeminiの世界へのパスポートです!

2. ワンクリックデプロイ(オプション):最も迅速に始めるためには、ワンクリックデプロイオプションを使用できます:

- Vercelでデプロイ(Vercelの手順は通常簡単で、GitHubリポジトリとVercelアカウントをリンクさせる必要があります)。

- Cloudflareでデプロイ(現在、プロジェクトはCloudflareへのデプロイをサポートしていますが、Cloudflare Pagesへのデプロイ方法に従う必要があります)。

これらのオプションを使用すると、数分で研究ツールを稼働させることができますが、完全にカスタマイズされた体験を得るために、ローカル開発に重点を置いていきます。

オープンソースの深い研究ツールを開発する

ビルドプロセスの核心に入りましょう!以下の手順に従って、ローカルブラウザでDeep Researchを実行しましょう。

前提条件

始める前に、システムに以下のものがインストールされていることを確認してください:

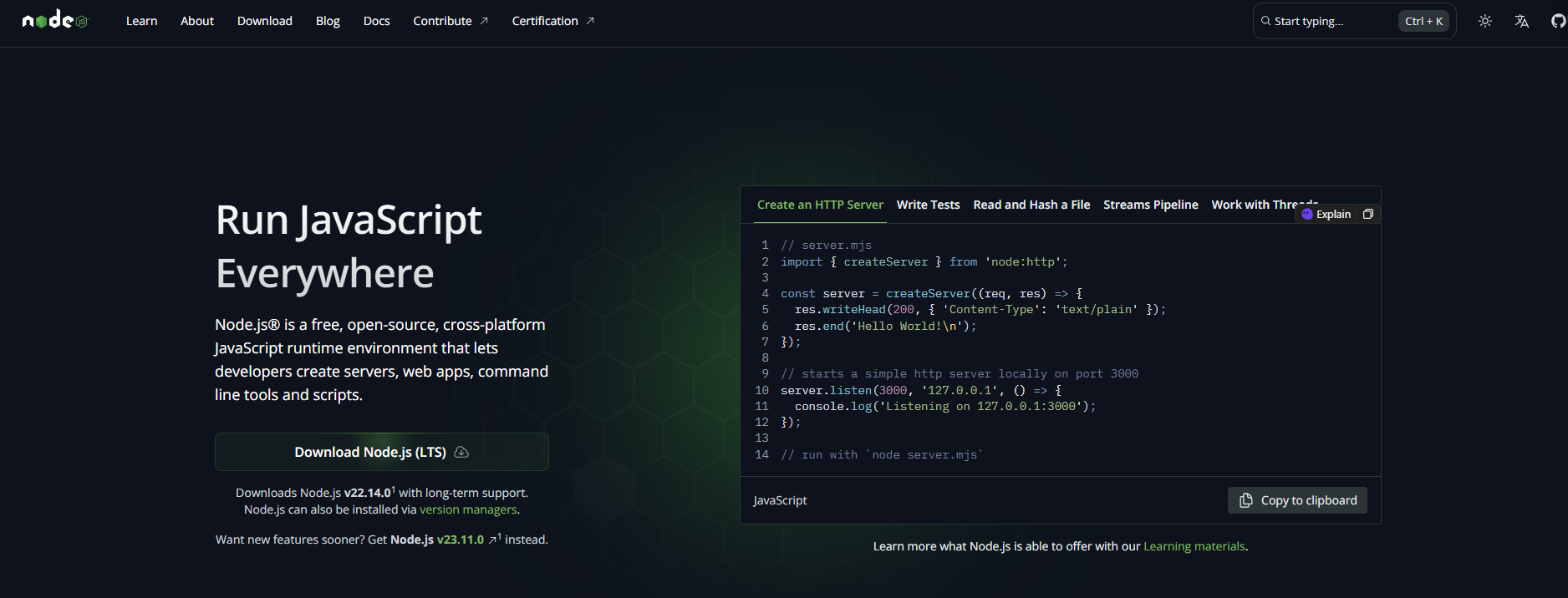

- Node.js:(バージョン18.18.0以降推奨)。公式Node.jsサイトからダウンロードできます。

- pnpmまたはnpmまたはyarn:これらはNode.js用のパッケージマネージャーです。このチュートリアルではpnpmを使用しますが、お好きなものを使用できます。

インストール

1. リポジトリをクローンする:

git clone https://github.com/u14app/deep-research.git

cd deep-researchこれにより、GitHubからコードがダウンロードされ、プロジェクトディレクトリに移動します。

2. 依存関係をインストール:

pnpm install # または npm install または yarn installこのコマンドは、プロジェクトに必要なすべてのパッケージをインストールします。

3. 環境変数を設定:

これは重要な手順です!プロジェクトのルートディレクトリに.envファイルを作成し、以下の環境変数を設定する必要があります:

# (オプション) サーバーサイドGemini APIキー(サーバーAPI通話に必要)

GOOGLE_GENERATIVE_AI_API_KEY=YOUR_GEMINI_API_KEY

# (オプション) サーバーAPIプロキシURL。デフォルト、`https://generativelanguage.googleapis.com`

API_PROXY_BASE_URL=

# (オプション) 強化されたセキュリティのためのサーバーAPIアクセスパスワード

ACCESS_PASSWORD=

# (オプション) 統計やエラー追跡のために使用できる注入されたスクリプトコード。

HEAD_SCRIPTS=YOUR_GEMINI_API_KEYを、Google AI Studioから取得した実際のAPIキーに置き換えてください。

環境変数に関する重要な注意事項:

- GOOGLE_GENERATIVE_AI_API_KEY:オプションですが、サーバーサイドAPIを使用するには必要です。Google AI StudioからGoogle Generative AI APIキーを取得する必要があります。このキーは秘密に保持し、公開リポジトリにコミットしないでください。

- API_PROXY_BASE_URL:オプション。APIリクエストにプロキシサーバーを使用する必要がある場合は、proxyサーバーの基本URLでこの変数を設定します。これはサーバーサイドAPI通話に関連しています。

- ACCESS_PASSWORD:オプションですが、サーバーサイドのデプロイメントに強く推奨されます。サーバーサイドAPIエンドポイントを保護するための強力なパスワードを設定してください。このパスワードはサーバーサイドAPI機能にアクセスするために必要です。

- HEAD_SCRIPTS:オプション。統計やエラー追跡のために使用できる注入されたスクリプトコードです。

プライバシーのリマインダー:これらの環境変数は主にサーバーサイドAPI通話に使用されます。ローカルAPIモードを使用する際には、APIキーやサーバーサイドの設定は必要なく、あなたのプライバシーをさらに強化します。

マルチキーサポート:複数のキーをサポートしており、それぞれのキーは,,で区切ります。すなわち、key1,key2,key3。Cloudflareは、公式のビルドスクリプトがNext.js 15をサポートしていないため、現時点ではマルチキーを使用できません。

4. 開発サーバーを実行:

pnpm dev # または npm run dev または yarn devこれにより、開発サーバーがスタートし、ブラウザでhttp://localhost:3000でDeep Researchにアクセスできます。

- 必要なリサーチのための質問を始めてください。

- そして、結果を確認してください!

オープンソースの深い研究ツールをデプロイする

ローカル設定が満足の場合、研究ツールをクラウドにデプロイできます!いくつかの人気オプションは以下の通りです:

1. Vercel:Vercelでデプロイ(通常、これが最も簡単なオプションです)。

2. Cloudflare:現在、プロジェクトはCloudflareへのデプロイをサポートしていますが、Cloudflare Pagesへのデプロイ方法に従う必要があります。

3. Docker:

- Dockerのバージョンは20以上が必要です。

- プリビルトイメージをプルします:

docker pull xiangfa/deep-research:latest- コンテナを実行:

docker run -d --name deep-research -p 3333:3000 xiangfa/deep-research環境変数を指定することもできます:

docker run -d --name deep-research \

-p 3333:3000 \

-e GOOGLE_GENERATIVE_AI_API_KEY=AIzaSy... \

-e ACCESS_PASSWORD=your-password \

xiangfa/deep-research- または、自分のDockerイメージをビルド:

docker build -t deep-research .

docker run -d --name deep-research -p 3333:3000 deep-research- docker-compose.ymlを使用してデプロイ:

version: '3.9'

services:

deep-research:

image: xiangfa/deep-research

container_name: deep-research

environment:

- GOOGLE_GENERATIVE_AI_API_KEY=AIzaSy...

- ACCESS_PASSWORD=your-password

ports:

- 3333:3000その後、自分のDockerコンポーズをビルド:

docker compose -f docker-compose.yml build4. 静的デプロイ:

- 静的ページバージョンを直接ビルドし、outディレクトリ内のすべてのファイルをGithub PageやCloudflare、Vercelなどの静的ページをサポートするウェブサイトサービスにアップロードすることもできます。

pnpm build:exportオープンソースの深い研究ツールの構成

「オープンソースの深い研究ツールを始めるには」セクションで述べたように、Deep ResearchではサーバーサイドAPI構成のために以下の環境変数を利用します:

- GOOGLE_GENERATIVE_AI_API_KEY

- API_PROXY_BASE_URL

- ACCESS_PASSWORD

これらの変数は、サーバーサイドAPI呼び出し機能を使用するつもりでない限り、必要ありません。ローカルAPI呼び出しの場合は、プロジェクトを設定する以外に構成は必要ありません。

APIキーやパスワードを常に安全に保管してください!

結論:AIであなたの研究を強化する

あなたは今、自分自身のオープンソースの深い研究ツールをGemini APIで成功裏に構築しました!これは、あなたの研究プロセスにおけるAIの全潜在能力を解放するための大きなステップです。

独自のツールを構築することにより、データの完全なコントロールを得て、ワークフローをカスタマイズし、オープンソースコミュニティに貢献します。さまざまな研究モデルを試し、Gemini APIの機能を探り、カスタムツールを作成して研究体験を本当に個別化しましょう。

研究の未来は知的でオープンです。オープンソースの深い研究を採用し、必要な知識を身につけましょう!