Mistral AIはその高性能な言語モデルで迅速に名を馳せました。チャットボットを構築したり、創造的なテキストを生成したり、データを分析したり、コードを書いたり、意味検索のためにテキストを埋め込んだりする場合、Mistral APIは必要なツールを提供します。しかし、どの強力なツールにもゲートウェイがあります。それはAPIキーです。

APIキーを秘密のパスワードや一意の識別子として考えてください。それはMistralに対して「こんにちは、私です!あなたのサービスを使用する許可があります」と伝えます。これがなければ、APIサーバーは誰がリクエストを行っているか、また彼らが許可されているかどうかわからなくなります。

このガイドは、初期設定をナビゲートし、Mistralモデルの状況を理解し、初めてのAPI呼び出しを行い、さらにはAPidogのようなツールを使ってAPIと対話するためのステップバイステップのコンパニオンです。すべてを対話形式で分解し、あなたがゼロから成功したAPI呼び出しを行えるように目指します。

推定時間: 読み進めるのに30〜45分かかるかもしれません。

前提条件: APIが何であるかの基本的な理解が助けになりますが、厳密に必要ありません。進むにつれて概念を説明します。また、インターネット接続とウェブブラウザが必要です。

準備はいいですか?APIキーを手に入れましょう!

開発チームが最大限の生産性で協力して作業できる統合されたオールインワンプラットフォームが欲しいですか?

APidogはすべての要求を満たし、はるかに手頃な価格でPostmanを置き換えます!

ステップ1: Mistral AIアカウントの設定

まず最初に、Mistralのプラットフォーム「La Plateforme」にアカウントを作成する必要があります。

- コンソールに移動: ウェブブラウザを開き、console.mistral.aiに移動します。

- サインアップまたはサインイン:

- 新規の場合は、サインアップオプションをクリックします。おそらくメールアドレスを提供し、パスワードを作成する必要があります。または、既存のGoogleまたはGitHubアカウントでサインアップできるかもしれません。画面の指示に従い、メールアドレスの確認が含まれる場合があります。

- すでにアカウントを持っている場合は、資格情報を使ってサインインしてください。

3. 請求情報 (重要!): これは多くの人がつまずく重要なステップです。実際にAPIを使用するためには(最初に無料のティアモデルを使う場合でも、プラットフォームは通常、キーをアクティブ化するために請求情報を要求します)、請求を設定する必要があります。

- ログインしたら、通常は「Workspace」またはアカウント名とラベル付けされたセクションをサイドバーまたはナビゲーションメニューで探してください。

- そのセクション内で「Billing」を見つけます。

- それをクリックし、支払い情報を追加するための指示に従ってください(通常はクレジットカード)。心配しないでください、使用した分だけしか請求されず、多くのモデルには無料のティアや初回クレジットがあるかもしれませんが、一般的な使用のためにAPIキーを有効にするために支払いのアクティブ化が必要です。Mistralの価格ページには詳細が記載されています(後述します)。

- 支払いが「アクティブ」または「有効」とマークされていることを確認します。詳細を追加した後、ステータスが更新されるまで数分かかる場合があります。

これでMistral AIアカウントが設定されました!次のステップは、その重要なキーを生成することです。

ステップ2: あなたの秘密のAPIキーを生成する

アカウントを設定し、請求がアクティブになったので、実際にキーを作成しましょう。

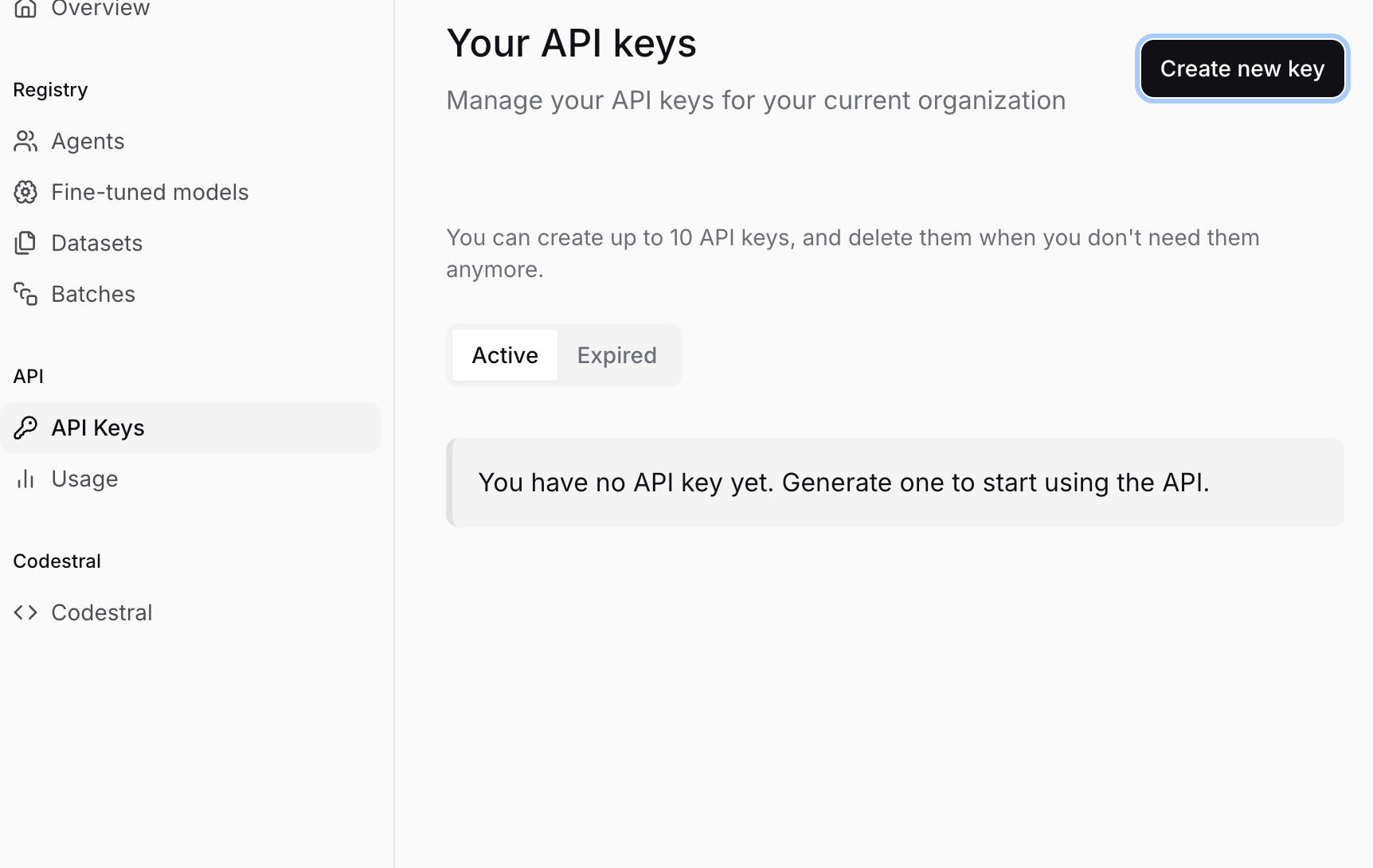

- APIキーに移動: Mistralコンソールにログインしたまま(console.mistral.ai)、サイドバーやナビゲーションメニューで「APIキー」という名前のセクションを探してクリックします。

- 新しいキーを作成: 「新しいキーを作成」または「+ 新しいキー」のようなボタンが表示されるはずです。それをクリックします。

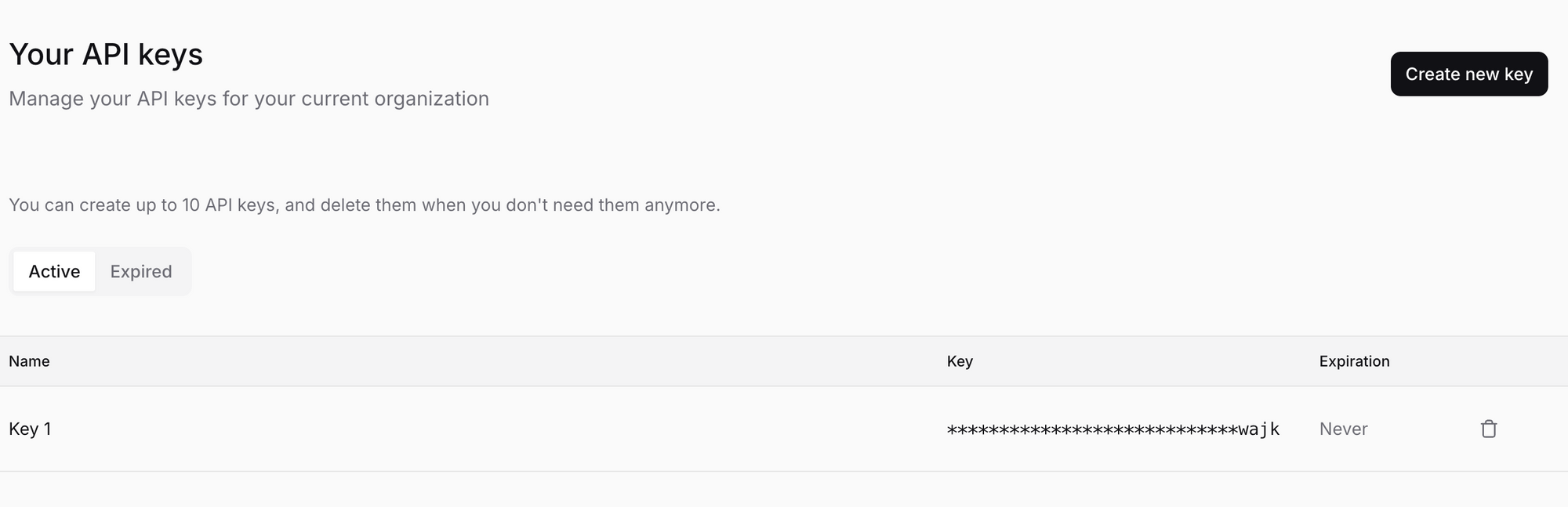

- キーに名前を付ける (オプションですが推奨): キーに名前を付けるよう求められる場合があります。これは組織のために非常に役立ちます、特に後で複数のキーを作成する予定がある場合(たとえば、「私のチャットボットプロジェクト」用に1つ、「データ分析スクリプト」用に別の)。わかりやすい名前を選択してください。

- キーを生成し、コピーします: 最終確認ボタン(例:「作成」、「生成」)をクリックします。Mistralはあなたのために一意のAPIキーを生成します。それは長いランダムな文字列のように見え、

sk-aBcDeFgHiJkLmNoPqRsTuVwXyZ1234567890......のようになります。 - !!! 重要なステップ: キーを安全に保存してください !!!

- Mistralはこのキーをあなたに一度だけ表示します。 ウィンドウを閉じるか、コピーせずに別のページに移動すると、もう二度と見ることはできません。新しいキーを生成しなければなりません。

- すぐにキーをコピーしてください。 コピーアイコンをクリックするか、手動で文字列全体を選択してコピーします。

- 安全に保管してください。 パスワードマネージャー(1Password、Bitwarden、Dashlaneなど)や安全なメモアプリケーションを使用します。鍵を直接デスクトップのプレーンテキストファイルに保存したり、無防備に自分のメールに送信したり、コードに直接埋め込んだりしないでください(後述します)。 このキーはあなたの銀行口座のパスワードのように扱ってください – 持っている者は誰でも、あなたのアカウントに請求されるAPI呼び出しを行うことができます。

- 他人と共有しないでください。 本当に。

やりました!あなたは今、Mistral AI APIキーを持っています。それを安全に保管し、それを使用する方法を考えてみましょう。

ステップ3: Mistralモデルの状況を理解する

API呼び出しを行う前に、Mistralにどのモデルを使用したいかを伝える必要があります。Mistralは、パフォーマンス、コスト、および能力のバランスを取り、さまざまなタスクに合わせた多様なモデルを提供しています。正しいものを選ぶことが鍵です。

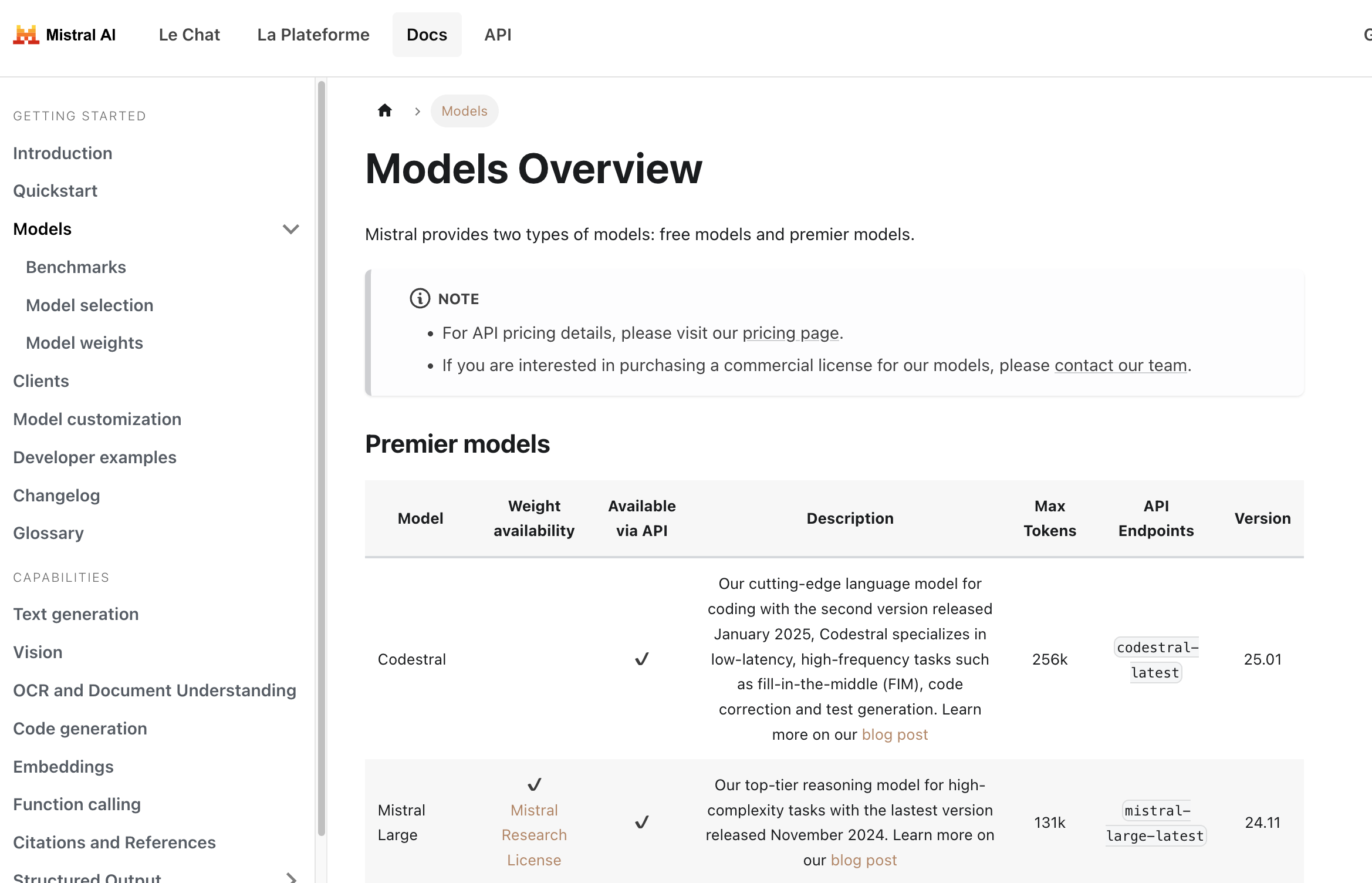

ここでモデルの詳細な概要を見つけることができます: Mistralモデルの概要

遭遇するモデルの種類の簡単な内訳は次のとおりです:

プレミアモデル: これはMistralの最高性能モデルで、通常は支払いが必要です。

Mistral Large: 複雑な推論タスクのために設計されたフラッグシップモデルです。大きなコンテキストウィンドウを持ち(多くのテキストを処理可能)、さまざまなベンチマークで強力なパフォーマンスを発揮します。Codestral: コード生成、補完、および説明タスク専用に微調整されたモデル。開発者に最適です。Pixtral Large: テキストと画像の両方を理解できる強力なマルチモーダルモデルです。Mistral Embed: 意味検索、クラスタリング、分類などのタスクに対してテキストの数値表現(埋め込み)を作成するために特別に設計された非常に効率的なモデルです。Mistral Moderation: テキスト内の有害または望ましくないコンテンツを検出するツールです。Mistral OCR: ドキュメントから画像に埋め込まれたテキストを抽出するサービスです。- 中東/南アジア語用の

Mistral Sabaや効率的なエッジモデルのMinistralのような専門モデル。

無料モデル(オープンウェイトのことが多い): これらのモデルは、許可されたライセンスの下にウェイトが利用可能である場合があります(例: Apache 2.0)。これはAIコミュニティがそれらを調査し、構築するのに役立ちます。APIを介しても利用可能なことが多く、より寛大な無料ティアや低コストのものもあります。

Mistral Small: パフォーマンスと効率のバランスをとる非常に能力のある小型モデル。素晴らしい出発点です。- 古いモデル(例:

Mistral 7BやMixtral 8x7B)はまだリストにありますが、レガシーステータスに移行する可能性があります(下記参照)。

モデルのバージョン管理とlatestタグ:

モデルは通常、mistral-large-latestやmistral-large-2411のような名前を持っています。

*-latest: このタグは常にそのモデルの最新の安定バージョンを指しています(例:mistral-large-latestは現在mistral-large-2411を指します)。latestを使用することは、新しい機能を常に利用できるため便利ですが、根本的なモデルが変更される可能性があることに注意してください。これにより、時間の経過とともに行動や出力がわずかに変化することがあります。*-YYYYMM(例:mistral-large-2411): これは特定の日付のモデルバージョンを指し示します(この例では2024年11月にリリース)。日付付きのバージョンを使用することで一貫性を確保できます。アプリケーションは常に正確なモデルバージョンにヒットし、予測可能な表現が重要な本番環境において非常に重要です。

推奨: 開発と探索のために、latestで問題ありません。本番アプリケーションに対しては、柔軟性のために日付付きのバージョンの使用を強く検討してください。

モデルの非推奨:

AIは急速に進化しています!Mistralは常に新しい、より良いモデルをリリースします。このサイクルの一部として、古いモデルは最終的に非推奨とされ、引退させられます。モデルの概要ページには、レガシーモデルの非推奨および引退日が含まれています。古いモデルを依存している場合は必ずこれを確認し、新しい代替手段への移行についての計画を事前に立ててください。

モデルの選択:

- タスク: 何をする必要がありますか?(チャット、コード、埋め込み、画像分析?)

- 複雑さ: タスクの難しさはどのくらいですか?(単純なQ&Aと微妙な推論?)

- コスト: 価格ページを確認してください!大きなモデルは通常、より高いコストがかかります。

- 速度: 小さいモデルは通常早いです。

小型の安価なモデル(mistral-small-latestのような)から始めて、要件を満たしているか確認してください。満たさない場合は、より大きなモデルや特殊なモデルにスケールアップしてください。

ステップ4: Pythonを使用した最初のAPI呼び出し(チャット補完)

何かを作りましょう!最も一般的なユースケースはチャット補完です – モデルにプロンプトまたは会話の履歴を提供し、応答を取得します。Mistralの主要なエンドポイントは/v1/chat/completionsです。

この例ではmistral-large-latestモデルを使用しますが、適切なチャットモデル名を代入できます。

重要なセキュリティノート: 以下の例では、私たちはよくos.environ["MISTRAL_API_KEY"](Python)やprocess.env.MISTRAL_API_KEY(TypeScript)を使用します。これは、あなたがAPIキーをという名前の環境変数として設定していると仮定します。これはコードにキーを直接貼り付けるよりもはるかに推奨されます。

- 環境変数を設定する方法(ターミナルセッションの一時的な方法):

- Mac/Linux:

export MISTRAL_API_KEY='あなたの実際のAPIキー' - Windows(コマンドプロンプト):

set MISTRAL_API_KEY=あなたの実際のAPIキー - Windows(PowerShell):

$env:MISTRAL_API_KEY='あなたの実際のAPIキー' あなたの実際のAPIキーを保存したキーに置き換えます。Windowsのコマンドプロンプトを使用する場合、引用符は省くことに注意してください。より恒久的なセットアップについては、オペレーティングシステム上での環境変数の永続的な設定方法を検索してください。

ライブラリをインストール:

pip install mistralai

Pythonファイル(例: mistral_test.py)を作成:

import os

from mistralai.client import MistralClient

from mistralai.models.chat_completion import ChatMessage

# 環境変数からAPIキーをロード

api_key = os.environ.get("MISTRAL_API_KEY")

if not api_key:

raise ValueError("MISTRAL_API_KEY環境変数が設定されていません!")

# 使用したいモデルを定義

model_name = "mistral-large-latest" # または別のモデルを選択

# Mistralクライアントを初期化

client = MistralClient(api_key=api_key)

print(f"モデルにリクエストを送信中: {model_name}")

# 会話メッセージを定義

# 'messages'リストにはチャット履歴または単一のユーザープロンプトが含まれます

messages = [

ChatMessage(role="user", content="最高のフランスのチーズは何ですか?")

# 会話履歴のために他のメッセージを追加できます:

# ChatMessage(role="assistant", content="素晴らしいフランスのチーズがたくさんあります!あなたの好みによります。柔らかいチーズ、固いチーズ、青チーズのどれが好きですか?"),

# ChatMessage(role="user", content="柔らかいチーズが好きです。")

]

try:

# チャット補完エンドポイントにAPI呼び出しを行う

chat_response = client.chat(

model=model_name,

messages=messages,

# オプションのパラメータ:

# temperature=0.7, # ランダム性を制御(0.0 = 決定論的、1.0 = よりランダム)

# max_tokens=150 # 応答の長さを制限

)

# モデルからの応答を表示

if chat_response.choices:

print("モデルの応答:")

print(chat_response.choices[0].message.content)

else:

print("応答が受信されませんでした。")

# 使用状況の詳細を確認するためにフル応答オブジェクトを表示することもできます。

# print("\nフル応答オブジェクト:")

# print(chat_response)

except Exception as e:

print(f"エラーが発生しました: {e}")

スクリプトを実行:

python mistral_test.py

モデルの回答がターミナルに表示されるはずです!

ステップ5: Mistral AI埋め込みをAPIでテストする

Mistralはチャットだけではありません!もう一つの重要な機能である埋め込みを見てみましょう。埋め込みは、テキストをその意味を捉えた数値ベクトルに変換します。類似の意味を持つテキストは、ベクトル空間で近くにあるベクトルを持ちます。これはRAG(Retrieval-Augmented Generation)、意味検索、推薦システムなどにおいて基本的です。

Mistralの埋め込みモデルには、通常/v1/embeddingsエンドポイントを介してアクセスし、mistral-embedモデル識別子を使用します。

Pythonを使用していくつかの文の埋め込みを取得する方法を見てみましょう:

import os

from mistralai.client import MistralClient

api_key = os.environ.get("MISTRAL_API_KEY")

if not api_key:

raise ValueError("MISTRAL_API_KEY環境変数が設定されていません!")

model_name = "mistral-embed"

client = MistralClient(api_key=api_key)

print(f"モデルを使用して埋め込みを要求しています: {model_name}")

texts_to_embed = [

"Mistral AIは強力な言語モデルを提供します。",

"埋め込みはテキストの数値表現です。",

"今日はどんな天気ですか?"

]

try:

embeddings_response = client.embeddings(

model=model_name,

input=texts_to_embed

)

# 応答には埋め込みオブジェクトのリストが含まれ、それぞれにベクトルがあります

print(f"{len(embeddings_response.data)}の埋め込みを受信しました。")

# 最初の埋め込みの最初の数次元を例として表示

if embeddings_response.data:

first_embedding_vector = embeddings_response.data[0].embedding

print(f"各埋め込みの次元数: {len(first_embedding_vector)}")

print(f"最初の埋め込みの最初の5次元: {first_embedding_vector[:5]}")

# これらのベクトルを後で使用するために保存します。

# print("\nフル埋め込み応答:")

# print(embeddings_response)

except Exception as e:

print(f"エラーが発生しました: {e}")

このPythonスクリプトを実行すると、埋め込みの次元と最初の埋め込みのスニペットが表示されます。

他の機能:

Mistralはさらに多くの機能を提供しています!ここではコードの詳細を提供しませんが、公式ドキュメントで以下を必ず探索してください:

- 補完(レガシー): チャットが好まれることが多いですが、以下で議論されているようなよりシンプルな補完エンドポイントもあるかもしれません: Mistral補完機能

- 文書理解(OCR): 文書からテキストを抽出し、レイアウトや画像を処理する可能性があります: Mistral文書機能

- 関数呼び出し: モデルが外部ツールやAPIと対話することを可能にします。

- ファインチューニング: 自分のデータに基づいてモデルをカスタマイズします(企業機能である場合が多い)。

常にMistral AIの公式ドキュメントを参照して、最新のエンドポイント、パラメータ、および機能についての情報を得るようにしてください。

ステップ6: 価格設定と使用状況の監視を理解する

強力なAIモデルの使用は、しばしばコストがかかります。MistralがそのAPI使用についてどのように価格を設定しているかを理解することが重要です。

- モデルによって価格が異なる: 大きくて能力のあるモデルは、通常、より小さいモデルよりもトークンあたりのコストが高くなります。埋め込みモデルは通常、処理されたトークンの数に基づいて独自の価格設定を持っています。

- トークン: AIモデルは、トークンと呼ばれるチャンクでテキストを処理します。トークンは厳密には単語ではありません。それは単語の一部、単語、または句読点であることがあります。大まかに言えば、1000トークンは約750単語に相当しますが、これは変動します。価格は通常「1百万入力トークンあたりのコスト」と「1百万出力トークンあたりのコスト」として指定されます。

- 公式価格ページを確認: 価格は変わる可能性があります。常に公式Mistral AI価格ページ を参照して最新の詳細を確認してください。通常、これに関するリンクはメインウェブサイトまたはモデルの概要ドキュメント内に見つかります。

- 使用状況を監視: Mistral AIコンソール(console.mistral.ai)には、通常「請求」または「使用状況」の項目があり、ここでAPI呼び出しと関連コストを追跡できます。定期的にこれを確認して、驚きを避けてください。

- 予算/アラートを設定: プラットフォームが許可する場合、支出制限やアラートを設定して、使用状況が特定の閾値を超えた場合に通知を受けるようにしてください。

特に多くの呼び出しを行うアプリケーションを開発する際には、使用状況に注意を払い、プロンプトを最適化し、ニーズを満たす最もコスト効率の高いモデルを選ぶようにしてください。

ステップ7: APidogを使用してAPI呼び出しを行う

コーディングは一般的ですが、時にはAPIエンドポイントを迅速にテストするためのグラフィカルインターフェースが欲しい時もあります。Postman、Insomnia、またはAPidogのようなツールはこれに非常に優れています。それではAPidogを使用して、前と同じチャット補完呼び出しを行う手順を見てみましょう。

APidogをダウンロードしてインストール: まだの場合は、公式ウェブサイトからAPidogをダウンロードし、コンピュータにインストールしてください。

APidogを起動: アプリケーションを開きます。

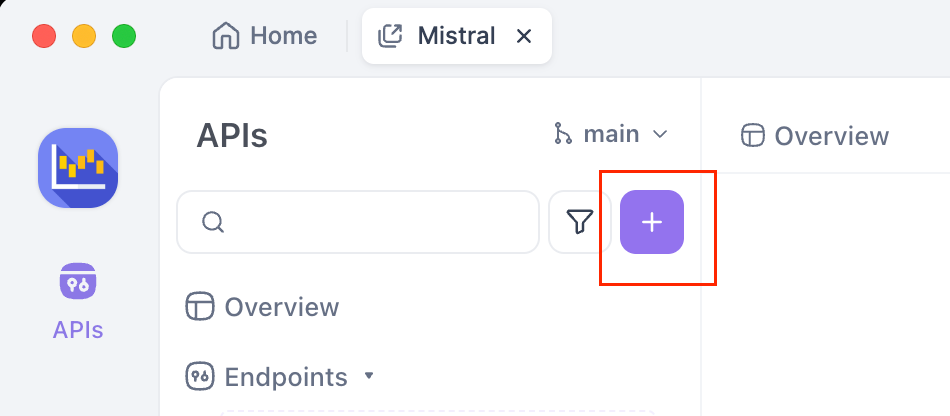

新しいリクエストを作成: 「+」ボタンや「新しいリクエストを作成」オプションが表示されるはずです。それをクリックします。

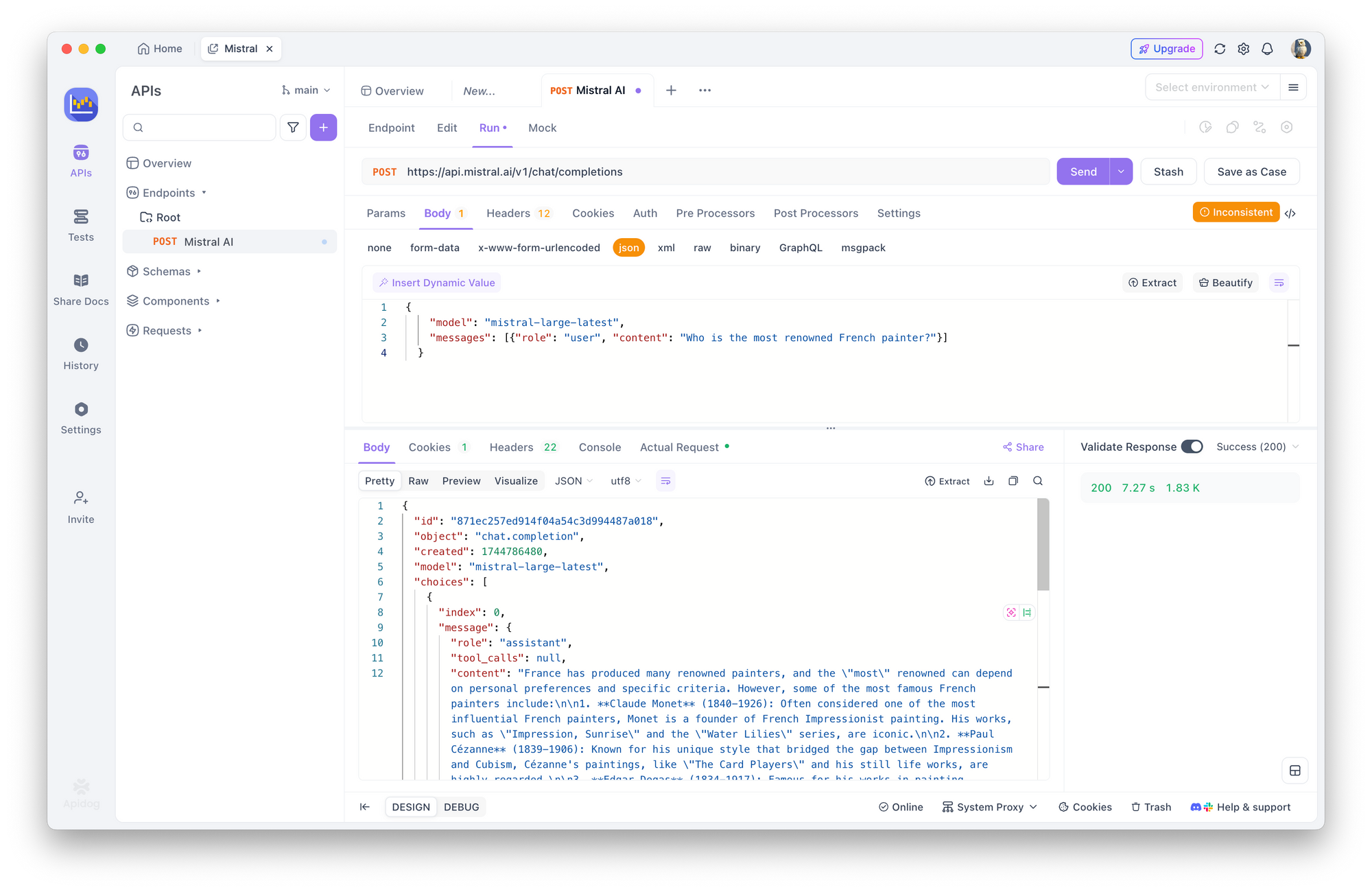

HTTPメソッドとURLを設定:

- リクエストエリアで、HTTPメソッドのドロップダウンを見つけます(通常、デフォルトは

GETです)。これをPOSTに変更します。 - その横のURL入力フィールドに、Mistralチャット補完エンドポイント:

https://api.mistral.ai/v1/chat/completionsを入力します。

認証を設定:

- URLバーの下に「Params」、「Authorization」、「Headers」、「Body」のタブがあることを探してください。「Authorization」タブをクリックします。

- このタブ内の「タイプ」ドロップダウンで「Bearer Token」を選択します。

- 右側に「トークン」とラベル付けされたフィールドが表示されます。保存したMistral APIキーをこのフィールドに貼り付けてください。

リクエストヘッダーを設定:

- 「Headers」タブをクリックします。

- 2つのヘッダーを追加する必要があります:

- 最初の空の行に「Key」として

Content-Typeと入力し、「Value」列にapplication/jsonと入力します。 - 次の空の行には、キーとして

Acceptを入力し、値としてapplication/jsonを入力します。 Authorization:Bearer $MISTRAL_API_KEYも設定してください。

リクエストボディを提供:

- 「Body」タブをクリックします。

- 「raw」ラジオボタンを選択します。

- 「raw」のすぐ右側にあるドロップダウンメニューで形式(例:「テキスト」)を表示します。このドロップダウンを「JSON」に変更します。

- その下の大きなテキストエリアにリクエストのJSONペイロードを貼り付けます:

{

"model": "mistral-large-latest",

"messages": [{"role": "user", "content": "最も有名なフランスの画家は誰ですか?"}]

}

リクエストを送信: 「送信」ボタンを見つけてクリックします(通常、URLバーの近くに目立って表示されます)。

応答を表示: APidogはMistral APIに呼び出しを行います。サーバーからの応答は通常、「応答」または「ボディ」タブの下にAPidogウィンドウの下部に表示されます。JSON応答が表示されるはずで、モデルの答えはchoices[0].message.content内に含まれます。応答ヘッダやステータスコード(希望的には200 OK!)も確認できます。

APidogのようなツールを使用すると、コードを書かずにさまざまなモデル、プロンプト、パラメータを試してみるのにとても便利です。

ステップ8: ベストプラクティス & セキュリティ(まとめ)

APIキーを扱う際には責任が求められます。重要な点を再度強調しましょう:

- ハードコーディングキーは絶対に行わない: APIキーをソースコードに直接貼り付けないでください(

my_key = "sk-...")。これをパブリックリポジトリ(GitHubなど)にコミットすると、キーが公開され、他の人が使用してあなたのアカウントに請求を発生させる可能性があります。 - 環境変数を使用: コードの例のように、環境変数(

os.environやprocess.env)からキーをロードするのは、はるかに安全な標準的なプラクティスです。 - シークレット管理ツール: 特にチーム環境やクラウドデプロイの場合、より堅牢なアプリケーションのために、専用のシークレット管理サービス(AWS Secrets Manager、Google Secret Manager、HashiCorp Vaultなど)を使用してください。

- 最小特権: Mistralが特定の権限を持つキーの作成を許可する場合(これは常に利用可能ではありません)、特定のアプリケーションに必要な許可のみを持つキーを作成してください。

- キーのローテーション: セキュリティを強化するために、新しいキーを定期的に生成し古いキーを引退させることを検討してください(例: 数ヶ月ごとに)。ただし、これにはアプリケーションの更新が必要です。

- 定期的に監視: Mistralコンソールの使用状況ダッシュボードに注意を向けてください。異常な活動は、キーが侵害されている可能性を示唆します。

結論: 前進して構築しましょう!

あなたはMistral AI APIキーを入手し使用するプロセスを成功裏にナビゲートしました!私たちは以下をカバーしました:

- Mistralアカウントの設定と請求のアクティブ化。

- ユニークなAPIキーの生成と安全な保存。

- Mistralのさまざまなモデルの理解と選択方法。

- Python、TypeScript、curlを使用してチャット補完と埋め込みのためのAPI呼び出しを行う。

- 価格設定を確認し、使用状況を監視する。

- APidogのようなGUIツールを使用して簡単にAPIテストを行う。

- 重要なセキュリティベストプラクティスを強化する。

Mistral APIは非常に強力なAI機能へのゲートウェイです。あなたのAPIキーはその潜在能力を解放するための文字通りの鍵です。ここで説明した手順とベストプラクティスに従うことで、最新のAIを自分のプロジェクトに統合する道をしっかりと歩んでいます。

公式Mistralドキュメントをさらに探索してください – すべての利用可能なパラメータ、モデル、および高度な機能の最終的な真実のソースです。

楽しいビルドを!

開発チームが最大限の生産性で協力して作業できる統合されたオールインワンプラットフォームが欲しいですか?

APidogはすべての要求を満たし、はるかに手頃な価格でPostmanを置き換えます!