OpenAIは、gpt-realtimeの導入とRealtime APIへの大幅な機能強化により、人工知能の能力を向上させています。この開発は、インタラクティブな音声アプリケーションを構築する開発者を対象としており、声のトーンや非言語的な手がかりなどのニュアンスを捉える直接的な音声間処理を提供します。エンジニアは現在、音声入力を処理し、低遅延で応答を生成するモデルにアクセスできるようになり、AIがリアルタイムの会話を処理する方法に変化をもたらしています。

さらに、このアップデートはマルチモーダルAIシステムへの高まる需要と一致しています。開発者は音声、テキスト、画像をシームレスに統合し、顧客サービス、バーチャルアシスタント、インタラクティブエンターテイメントにおけるアプリケーションの可能性を広げます。これらの進歩を探求する中で、API設計における小さな改善がユーザーエクスペリエンスにどれほど大きな向上をもたらすかを考えてみてください。

GPT-Realtimeの理解:コアモデル

OpenAIは、エンドツーエンドの音声間インタラクション向けに設計された特殊モデルとしてgpt-realtimeをリリースしました。このモデルは、音声認識、言語処理、テキスト読み上げ合成を分離する従来のパイプラインを排除します。代わりに、すべてを統一されたフレームワークで処理し、遅延を削減し、人間の音声の微妙なニュアンスを保持します。

gpt-realtimeは、自然な響きの音声出力を生成することに優れています。例えば、「速く、プロフェッショナルに話してください」や「フランス語のアクセントで共感的なトーンを採用してください」といった指示に応答します。このようなきめ細かい制御により、開発者はAIの音声を特定のシナリオに合わせて調整し、実世界のアプリケーションでのエンゲージメントを高めることができます。

さらに、このモデルはネイティブな音声入力の処理において優れた知能を示します。笑い声や一時停止などの非言語要素を検出し、それに応じて適応します。ユーザーが文の途中で言語を切り替えても、gpt-realtimeは中断することなく追随します。

この機能は、多様なデータセットでの高度なトレーニングに由来しており、MultiChallengeオーディオベンチマークで30.5%のスコアを達成しました。これは以前のバージョンからの顕著な改善です。

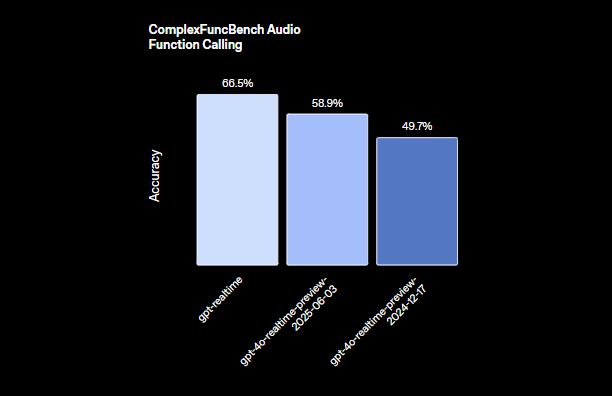

エンジニアは、gpt-realtimeが関数呼び出しを統合する方法を高く評価しています。ComplexFuncBenchで66.5%のスコアを達成し、ツールを非同期で実行するため、長時間の計算中でも会話がスムーズに進行します。例えば、AIがデータベースクエリを処理している間でも、フィラー応答や更新でユーザーとの対話を継続します。

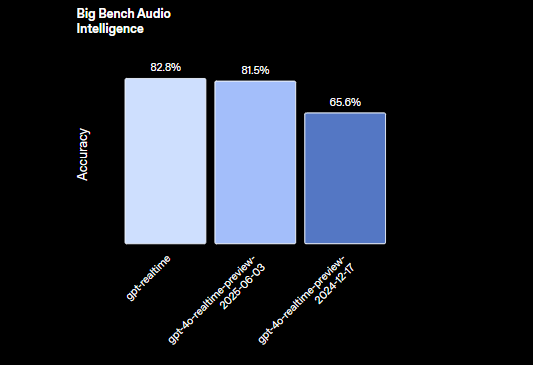

さらに、gpt-realtimeはBig Bench Audio評価で82.8%の精度で推論タスクをサポートしています。これにより、テキスト変換を完全にバイパスして、音声入力から直接論理的推論を伴う複雑なクエリを処理できます。

OpenAIは、このモデル専用の新しい2つの音声「Marin」と「Cedar」を導入し、既存の8つの音声も更新して、より表現豊かな出力を実現しました。これらの強化により、AIとのインタラクションがより人間らしく感じられ、スクリプト化された応答と真の対話との間のギャップを埋めます。

実用的な意味合いに目を向けると、開発者はgpt-realtimeを活用して、ライブ翻訳サービスやインタラクティブなストーリーテリングツールなど、リアルタイムで応答するアプリケーションを構築できます。このモデルの効率性により、計算オーバーヘッドが最小限に抑えられ、エッジデバイスやクラウドインフラストラクチャへの展開に適しています。

Realtime APIの主な機能

Realtime APIは、gpt-realtimeの機能を補完する大幅なアップグレードを受けました。OpenAIは、信頼性、スケーラビリティ、統合の容易さに焦点を当て、本番環境に対応した音声エージェントを促進する機能を搭載しています。

まず、リモートMCP(マルチクラウドプロバイダー)サーバーのサポートが際立っています。開発者は、Stripeとの決済統合など、ツール呼び出しのために外部サーバーを設定できます。この設定により、特定の機能を専門サービスにオフロードすることでワークフローが簡素化されます。APIセッション内で、サーバーURL、認証トークン、承認要件を直接指定します。

次に、画像入力機能がAPIのマルチモーダルな範囲を拡大します。アプリケーションは、進行中のセッションに画像、写真、またはスクリーンショットを追加でき、視覚に基づいた会話を可能にします。例えば、ユーザーが図をアップロードすると、AIがそれを説明したり、その内容に関する質問に答えたりします。この機能は画像を静的要素として扱い、コンテキストを維持するためにアプリケーションロジックによって制御されます。

さらに、SIP(Session Initiation Protocol)サポートにより、APIを公衆電話網、PBXシステム、固定電話に接続できます。これにより、デジタルAIと従来の電話通信が橋渡しされ、音声エージェントが固定電話や携帯電話からの通話をシームレスに処理できるようになります。

再利用可能なプロンプトも重要な追加機能です。開発者は、開発者メッセージ、ツール、変数、および例を複数のセッションで保存および再利用できます。これにより、一貫性が促進され、標準的な顧客サポートスクリプトなどの繰り返し発生するインタラクションのセットアップ時間が短縮されます。

このAPIは低遅延のインタラクションに最適化されており、本番環境での高い信頼性を確保します。セッション状態を維持しながらマルチモーダル入力(音声と画像)を処理するため、長時間の会話でのコンテキスト損失を防ぎます。

音声処理に関して、Realtime APIはgpt-realtimeと直接連携して表現豊かな音声を生成します。従来のシステムでは見過ごされがちなニュアンスを捉えることで、より魅力的なユーザーエクスペリエンスにつながります。

開発者は、コンプライアンスのためのEUデータレジデンシーや、機密データを保護するためのプライバシーコミットメントなど、エンタープライズグレードの機能からも恩恵を受けます。

パフォーマンス指標に焦点を移すと、これらのアップデートはAPIの有用性を総合的に向上させます。例えば、非同期関数呼び出しはボトルネックを防ぎ、AIがフローを中断することなくマルチタスクを実行できるようにします。

GPT-Realtime APIの使用方法:ステップバイステップガイド

開発者は、簡単なエンドポイントと設定を通じてgpt-realtime APIを統合します。まず、OpenAIプラットフォームからAPIキーを取得し、アカウントがRealtime APIをサポートしていることを確認します。

セッションを開始するには、リアルタイムクライアントシークレットを作成するためのPOSTリクエストを送信します。ツールやタイプなどのセッションパラメータを含めます。リモートMCP統合の場合、ペイロードは次のようになります。

// POST /v1/realtime/client_secrets

{

"session": {

"type": "realtime",

"tools": [

{

"type": "mcp",

"server_label": "stripe",

"server_url": "https://mcp.stripe.com",

"authorization": "{access_token}",

"require_approval": "never"

}

]

}

}

このコードはStripe決済用のツールを設定します。APIは、毎回ユーザーの承認を必要とせずに、指定されたサーバーに呼び出しをルーティングします。

セッションが開始されたら、WebSocket接続を介してリアルタイムインタラクションを処理します。Realtime APIエンドポイントへのWebSocketを確立し、音声ストリームをバイナリデータとして送信します。APIは入力を処理し、音声出力をリアルタイムで返します。

音声入力の場合、ユーザーの音声をエンコードして送信します。gpt-realtimeは音声を分析し、セッションコンテキストに基づいて応答を生成します。画像を組み込むには、会話アイテム作成イベントを使用します。

{

"type": "conversation.item.create",

"previous_item_id": null,

"item": {

"type": "message",

"role": "user",

"content": [

{

"type": "input_image",

"image_url": "data:image/png;base64,{base64_image_data}"

}

]

}

}

`{base64_image_data}`を実際のbase64エンコードされた画像に置き換えます。これにより視覚的なコンテキストが追加され、AIが応答でそれを参照できるようになります。

コストを管理するために、トークン制限を設定し、古いターンを切り詰めることでセッション状態を管理します。長時間の会話では、重要な詳細を保持しながら、不要な履歴を定期的にクリアします。

関数呼び出しを処理するには、セッション設定でツールを定義します。AIが関数を呼び出すと、APIはそれを非同期で実行し、会話を継続させるための中間更新を送信します。

SIP統合の場合、互換性のあるゲートウェイを介して通話をルーティングするようにアプリケーションを設定します。これには、SIPトランクを設定し、それらをRealtime APIセッションにリンクすることが含まれます。

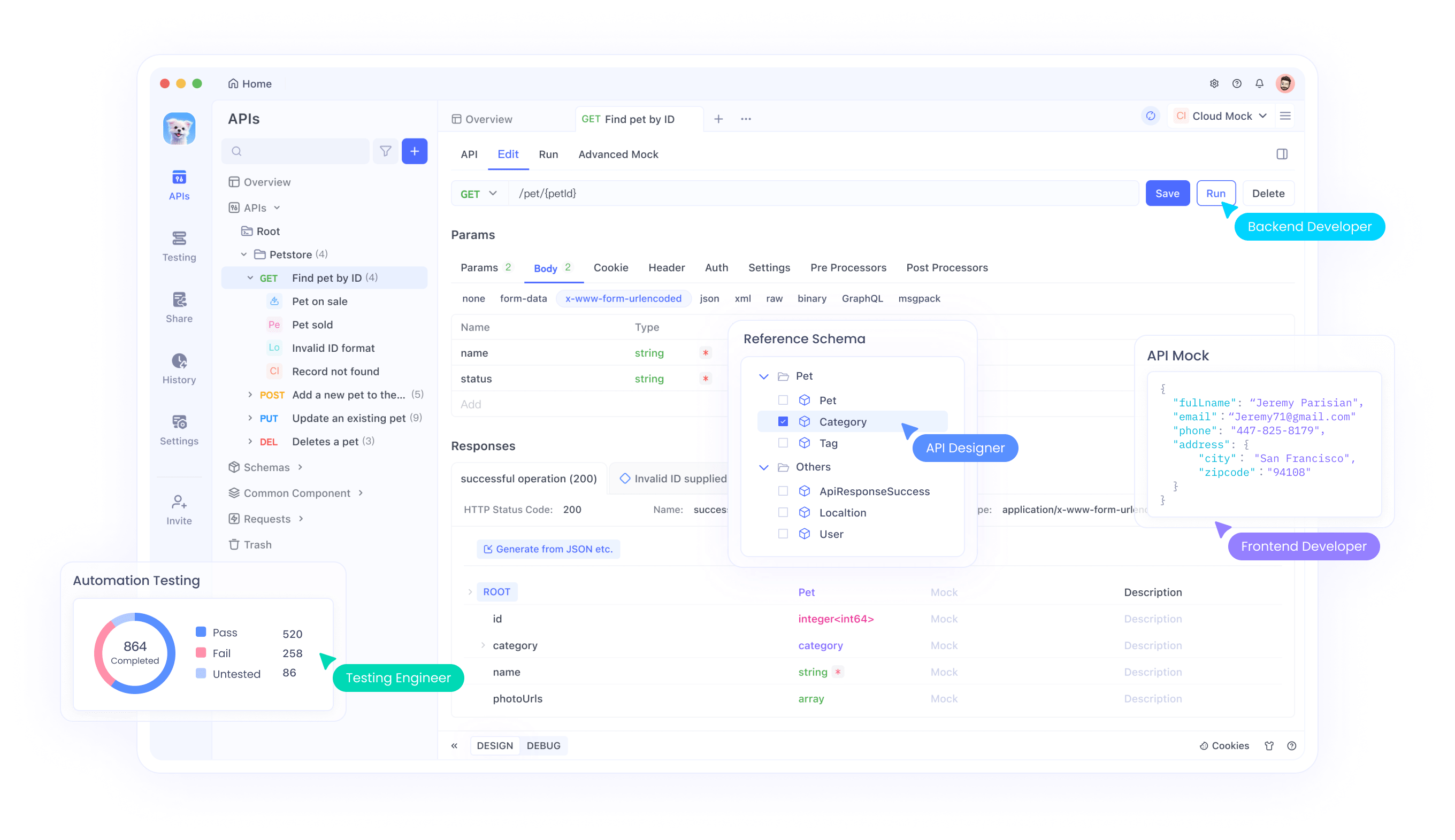

これらの統合をテストすることは非常に重要です。ここで、ApidogはAPI管理ツールとしてその真価を発揮します。WebSocketテストをサポートしており、リアルタイムの音声交換をシミュレートし、応答を検査することができます。Apidogを無料でダウンロードして、エンドポイントのモック、ペイロードの検証、gpt-realtimeとのシームレスな接続を確保してください。

実際には、これらの要素を組み合わせてシンプルな音声エージェントを構築します。マイク入力をキャプチャし、APIにストリーミングし、生成された音声を再生します。JavaScriptのWebSocketやPythonのwebsocketsモジュールのようなライブラリがこれを容易にします。

ラウンドトリップ応答の時間を計ることで遅延を監視します。OpenAIの最適化により、ほとんどの場合で1秒未満の遅延が保証されますが、ネットワーク状況がパフォーマンスに影響を与えます。

接続失敗の再試行や、音声処理に問題が発生した場合のテキストベースのインタラクションへのフォールバックなど、エラーを適切に処理します。

これを拡張して、再利用可能なプロンプトを組み込みます。「常に共感的に応答する」などの指示を含むプロンプトテンプレートを保存し、APIパラメータを介して新しいセッションに適用します。

高度な使用法として、gpt-realtimeを他のOpenAIモデルと組み合わせます。複雑な推論はGPT-4oにルーティングし、音声I/Oにはgpt-realtimeを使用することで、ハイブリッドシステムを作成します。

セキュリティ上の考慮事項には、転送中のデータの暗号化とアクセスキーの安全な管理が含まれます。OpenAIのプライバシーコミットメントは役立ちますが、機密性の高いアプリケーションには追加の保護策を実装してください。

効率的なAPI管理のためのApidogの統合

Apidogは、gpt-realtime APIを扱う開発者にとって不可欠なツールとして登場します。このプラットフォームは、リアルタイムWebSocketのような複雑な統合向けに調整された、包括的なAPIテスト、ドキュメント、およびコラボレーション機能を提供します。

エンジニアはApidogを使用して、APIリクエストを視覚的に設計し、OpenAPI仕様をインポートし、自動テストを実行します。Realtime APIの場合、広範なコードを書くことなく、音声ストリームをシミュレートし、マルチモーダル入力を検証できます。

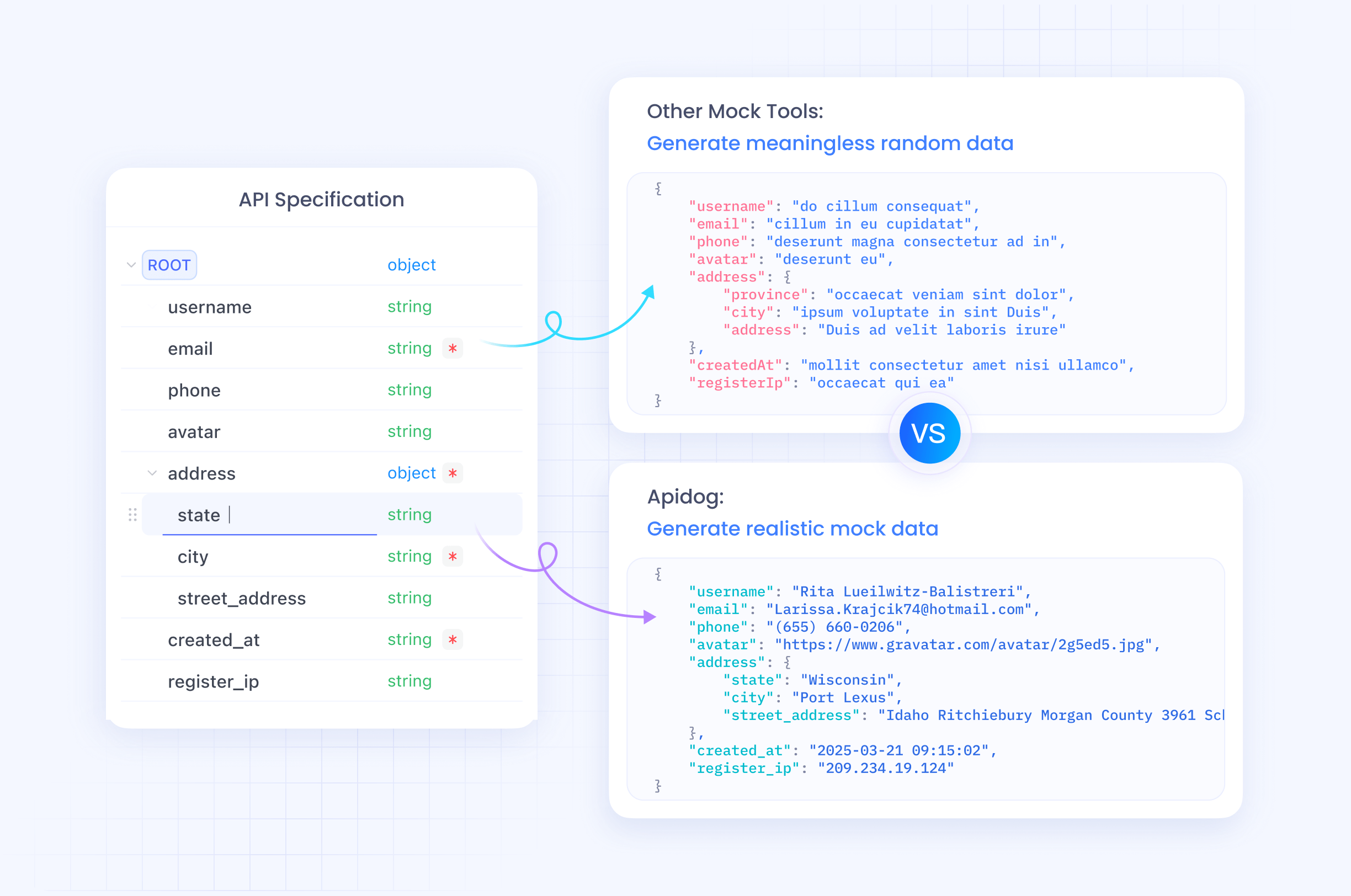

さらに、Apidogのモック機能により、本格的な実装前にプロトタイピングが可能です。gpt-realtimeの応答を模倣するモックサーバーを作成し、開発サイクルを加速させます。

このツールはチームコラボレーションをサポートし、テストケースと環境を共有できます。これは、音声エージェントを構築する分散チームにとって非常に貴重です。

Apidogは画像のbase64エンコーディングと音声のバイナリデータを処理するため、デバッグを簡素化します。リアルタイムでリクエスト/レスポンスサイクルを追跡し、ボトルネックを早期に特定します。

デプロイメントに移行する際には、Apidogのモニタリングを使用して、ローンチ後のAPIの稼働時間とパフォーマンスを確保します。

価格、提供状況、および将来への影響

OpenAIはgpt-realtimeを競争力のある価格で提供し、プレビュー版からコストを20%削減しました。音声入力トークン100万あたり32ドル(キャッシュされたものは0.40ドル)、出力トークン100万あたり64ドルです。この構造は、コンテキストを制限しセッションを切り詰める制御により、効率的な使用を促進します。

このAPIは、2025年8月28日にすべての開発者が利用可能になり、EU地域を含むグローバルアクセスが提供されます。

今後、これらの進歩はユビキタスな音声AIへの道を開きます。医療分野では患者とのインタラクションに採用され、教育分野ではインタラクティブな個別指導に利用されます。

しかし、倫理的な使用の確保や音声処理におけるバイアスの軽減など、課題は残っています。

要約すると、OpenAIのgpt-realtimeとRealtime APIは、リアルタイムAIを再定義し、開発者が革新的なアプリケーションに活用できるツールを提供します。統合におけるわずかな調整が大きな成果をもたらし、正確な実装の重要性を強調しています。