もしあなたが開発者であれば、AIコーディングツールが驚異的なスピードで進化していることに気づいているでしょう。しかし、数多く登場するプラットフォームの中でも、特に注目を集めているツールが2つあります。それは、Googleがこれまでに開発した中で最も強力なコーディング指向モデルであるGemini 3.0 Proと、まるでVisual Studio Codeにペアプログラマーが内蔵されているかのような感覚で使えるAI搭載コードエディタ、Cursorです。

そして、ここからがエキサイティングな部分です。これらを組み合わせることができるのです。

Cursor内でGemini 3.0 Proを使用することで、未来のようなコーディング体験が得られます。スマートなIDE、強力な推論優先のAIモデル、コードベースの深い理解、そして迅速なプロトタイピングがすべて1か所で手に入ります。

Gemini 3.0 Proとは? (そしてなぜ開発者に愛されるのか)

Gemini 3.0 Proは、Googleがこれまでに開発した中で最も高度な開発者向け大規模言語モデルです。次のように考えてみてください。

- 推論優先のAIモデル

- 以前のGeminiバージョンよりも多段階ロジックに強い

- 大規模なコードベースを非常に得意とする

- アーキテクチャレベルの質問理解に非常に優れている

- より長いコンテキストウィンドウを処理するように構築されている

- デモではなく、実際のエンジニアリング作業のために設計されている

言い換えれば、これは次のようなことができるモデルです。

- リポジトリ全体を読み込み、理解する

- 最小限のプロンプトで新機能の構築を支援する

- エッジケースやバグを見つける

- より構造化されたコードを生成する

- OpenAPIスキーマを使用してAPIを操作する

- 複雑なバックエンドワークフローを構築する

そして、AIがコードを直接編集できるCursorと組み合わせることで、大幅にアップグレードされたワークフローが得られます。

なぜGeminiとCursorを組み合わせるのか?

まず、「Cursorにはすでに素晴らしいAI機能があるのに、なぜGeminiをわざわざ設定するのか?」と疑問に思うかもしれません。それはもっともな質問です。この組み合わせがなぜそれほど強力なのかを説明します。

Cursorの強み:

- コードベースに対する深い認識とコンテキスト理解

- 優れたファイルナビゲーションと編集

- スムーズなIDE統合

- プロジェクト構造を理解するチャット機能

Geminiのスーパーパワー:

- 高度な推論と問題解決能力

- 複雑な多段階タスクでの強力なパフォーマンス

- Googleの最新AI技術

- コーディング問題に対する異なる「視点」を提供する可能性

これらを組み合わせることで、両方の良いとこ取りができます。つまり、プロジェクト全体のコンテキストを理解し、Googleの最先端の推論能力をテーブルにもたらすAIが手に入ります。

ステップバイステップ:CursorでGemini 3.0 Proを使用する方法

ステップ1:Gemini APIキーを取得する

何かを接続する前に、Geminiへのアクセスが必要です。設定方法は次のとおりです。

- Google AI Studioにアクセス: aistudio.google.comにアクセスします。これにはGoogleアカウントが必要です。

- 新しいAPIキーの作成: ログイン後、「Get API key」オプションを探します。Googleは通常、テストに最適な無料枠を十分に提供しています。

- キーをコピーして安全に保管する: APIキーが生成されたら、すぐにコピーしてください。すぐに必要になるので、安全な場所に保管してください。このキーはパスワードのように扱ってください。これを持っている人は誰でもあなたのアカウントでリクエストを作成できます。

プロヒント: 無料枠はかなり寛大ですが、Geminiでヘビーなコーディングセッションを開始する場合は、使用状況に注意してください。

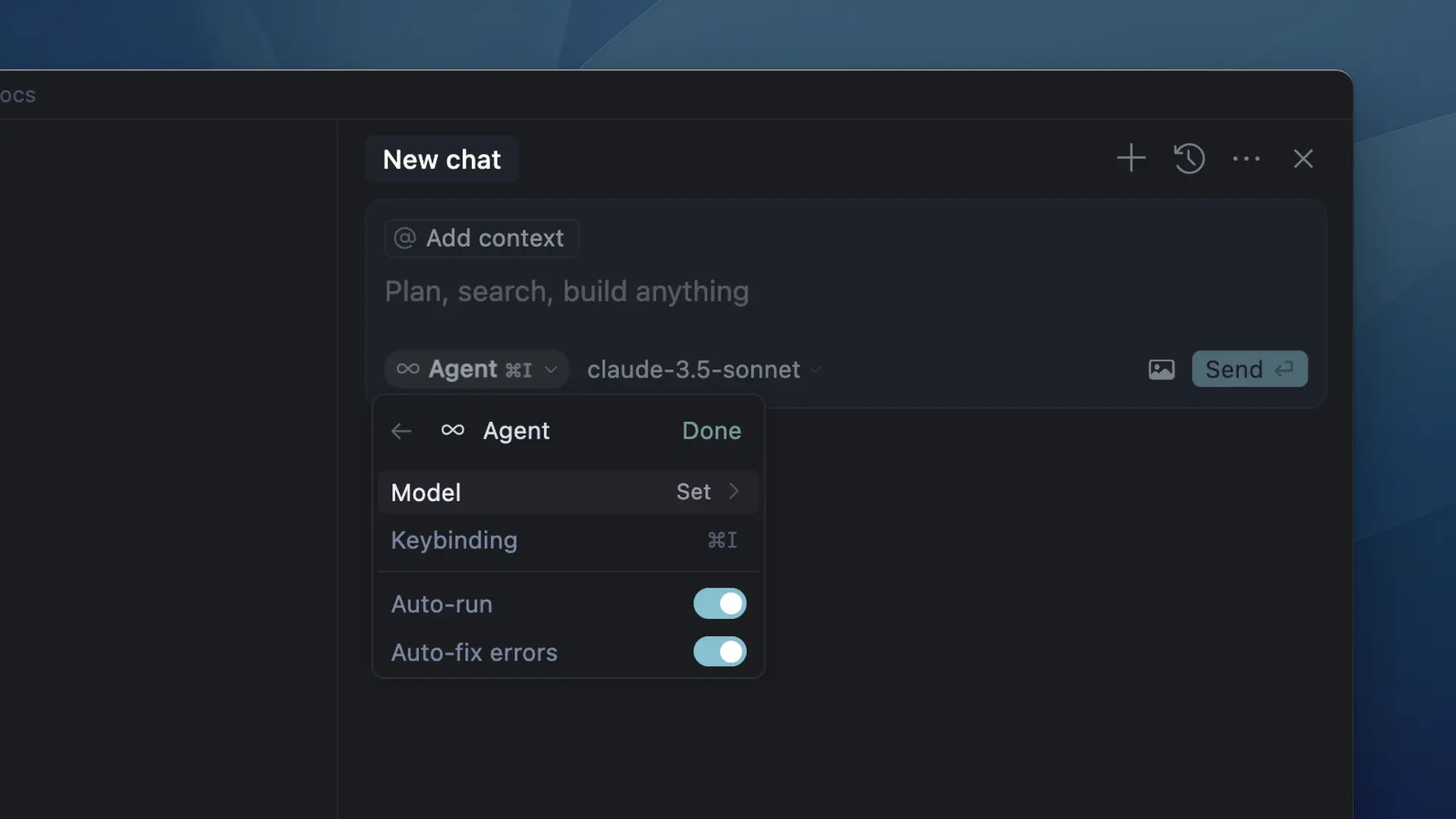

ステップ2:カスタムモデル用にCursorを設定する

ここで魔法が起こります。Cursorには、やや隠されていますが信じられないほど強力な機能があります:カスタムモデル設定です。

- Cursor設定を開く:

Ctrl + ,(Macの場合はCmd + ,)を押して設定を開くか、メニューから探します。 - モデル設定を検索: 検索バーに「model」と入力します。AIモデルまたはカスタムモデルに関連する設定を探します。

- settings.jsonを開く: 完全なsettings JSONファイルを開く必要がある場合があります。「Open Settings (JSON)」または類似のオプションを探してください。

- カスタムモデル設定を追加: ここが重要な部分です。CursorにGemini APIと通信する方法を伝える設定を追加する必要があります。次のようになります。

{

"cursor.gemini.model": "gemini-3.0-pro",

"cursor.gemini.apiKey": "your-actual-api-key-here",

"cursor.gemini.baseURL": "<https://generativelanguage.googleapis.com/v1beta>"

}

重要事項: 正確な設定はCursorのバージョンによって異なる場合があります。最新のカスタムモデル設定構文については、Cursorのドキュメントを確認してください。

ステップ3:代替アプローチ:Cursorのカスタムモデル機能を使用する

直接設定が機能しない場合、Cursorには通常、設定に専用の「カスタムモデル」セクションがあります。

- 設定でカスタムモデルを見つける: 設定パネルで「Custom Models」または「External Models」を探します。

- Gemini設定を追加: 通常、次のオプションで新しいモデルを追加する選択肢が表示されます。

- モデル名: 「Gemini 3.0 Pro」(または好きな名前)

- APIベースURL:

https://generativelanguage.googleapis.com/v1beta - APIキー: あなたのGemini APIキー

- モデル識別子:

models/gemini-3.0-pro

3. 接続をテストする: 設定を保存し、Cursorのチャットで質問を試してみてください。すべてが機能していれば、CursorのデフォルトAIではなくGeminiからの応答が表示されるはずです。

Apidogでセットアップをテストする

複雑なコーディングタスクに飛び込む前に、Gemini APIが正しく機能していることを確認するのは賢明です。ここでApidogが輝きます。

Apidogを使用すると、次のことができます。

- APIキーのテスト: Gemini APIへの簡単なリクエストを作成して、キーが有効で機能していることを確認します。

- プロンプトの実験: Cursorで使用する前に、さまざまなコーディング関連のプロンプトをテストして、Geminiがどのように応答するかを確認します。

- 使用状況の監視: 予期せぬ事態を避けるために、API呼び出しとトークン使用量を追跡します。

- リクエストテンプレートの作成: 成功したプロンプトを将来使用するためにテンプレートとして保存します。

Apidogで実行できる簡単なテストを次に示します。

POST <https://generativelanguage.googleapis.com/v1beta/models/gemini-3.0-pro:generateContent?key=YOUR_API_KEY>

Content-Type: application/json

{

"contents": [{

"parts": [{

"text": "フィボナッチ数を計算するPython関数を記述してください。そのアプローチを説明してください。"

}]

}]

}

一貫性のある応答が得られれば、APIセットアップは完璧に機能しています!

トラブルシューティング:発生する可能性のある問題

1. CursorにGeminiが表示されない

考えられる原因:

- APIキーが間違っている

- サポートされていない地域

- 課金が有効になっていない

- Cursorのバージョンが古い

修正方法:

- Cursorを更新する

- Geminiキーを再生成する

- サポートされているモデルを使用していることを確認する

2. Geminiが遅い

モデルが非常に需要が高い可能性があります。

使用方法:

- 簡単なタスクにはGemini Flashを使用する

- 推論タスクにはGemini Proを使用する

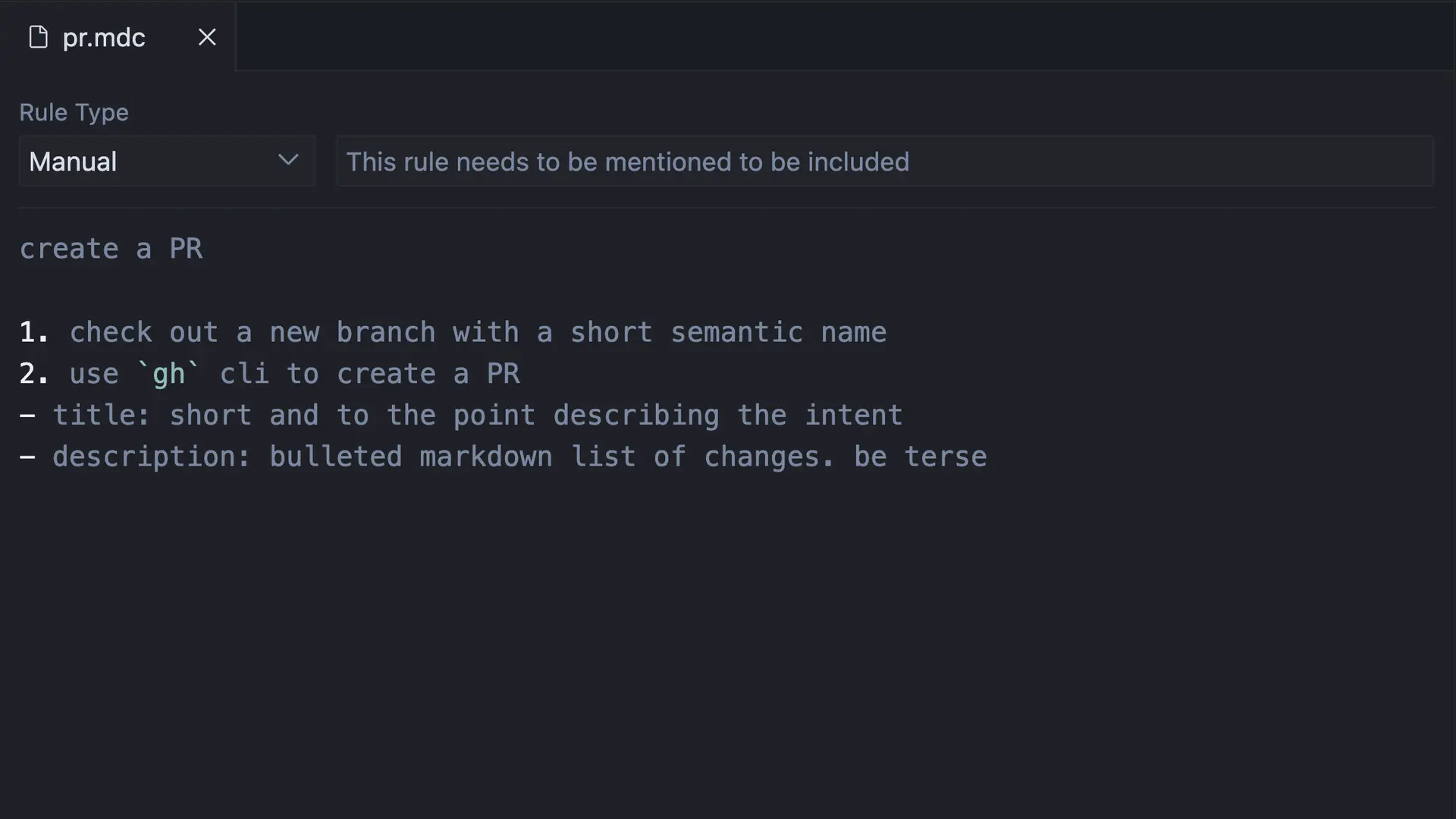

3. AI生成コードがあなたのスタイルに合わない

スタイルを強制するプロンプトを使用します。

プロジェクトの慣例に従って書き直してください。参照として@src/example.tsのスタイルを使用してください。

4. Geminiが古いパターンを生成する

明確な指示を与えます。

NestJS v10パターンを使用してください。

React 19 + Server Componentsを使用してください。

Express + TypeScript + Zod検証を使用してください。

Geminiはそれに応じて調整します。

高度なヒントとベストプラクティス

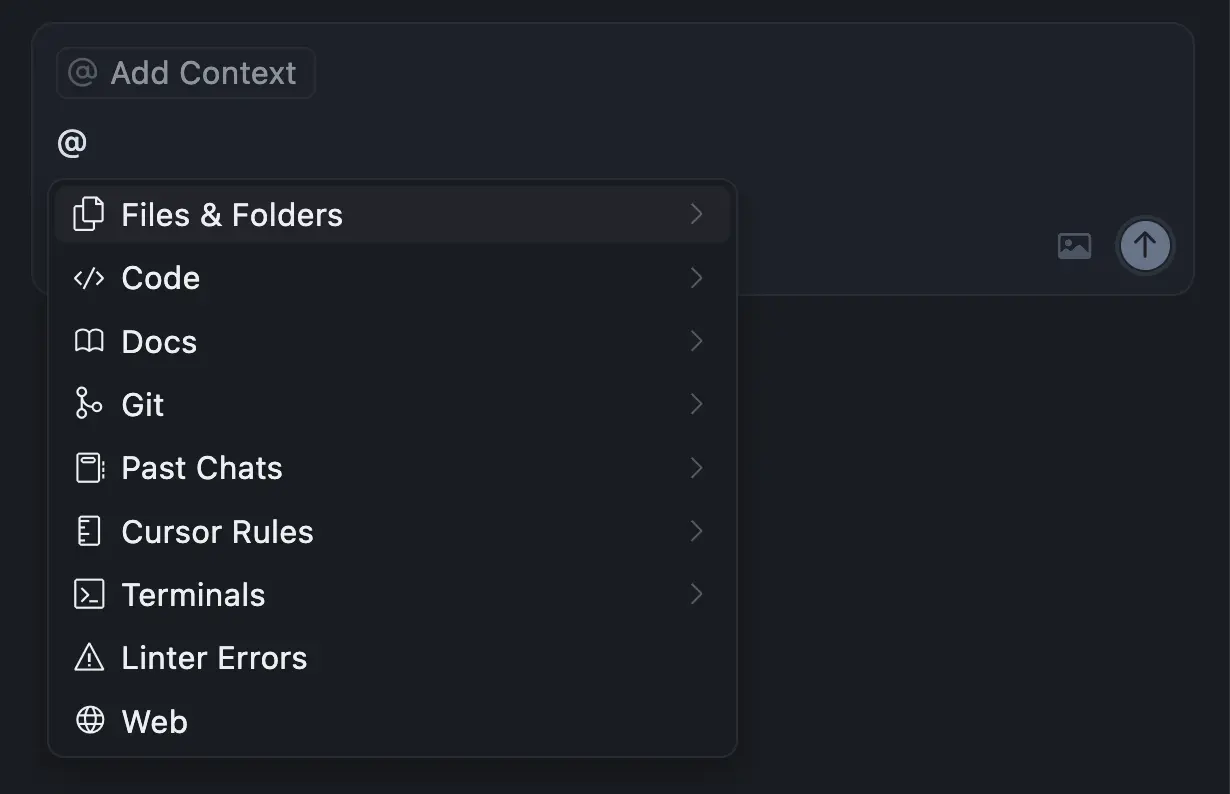

1. コンテキストを効果的に提供する

Geminiは、プロジェクトのコンテキストを理解しているときに最もよく機能します。質問するときは、次の点に留意してください。

- プログラミング言語とフレームワークについて言及する

- 関連するファイルパスやアーキテクチャの決定を含める

- エラーメッセージとスタックトレースを共有する

- コードベースの特定の部分を参照する

2. 反復的な改善を利用する

最初から完璧なコードを期待しないでください。反復的に作業しましょう。

- 最初の実装を求める

- 具体的なニーズに基づいて改善を要求する

- 複雑な部分の説明を求める

- 生成されたコードのテストを要求する

3. Geminiの専門的な強みを活用する

Geminiは特に次の点で優れています。

- アルゴリズムの設計と最適化

- アーキテクチャの計画

- 複雑な問題の分解

- 多言語ソリューション

- 数学的および科学的計算

4. APIの使用状況を管理する

特に長い会話では、トークンの使用状況に注意してください。Geminiのコンテキストウィンドウは大きいですが、無限ではありません。

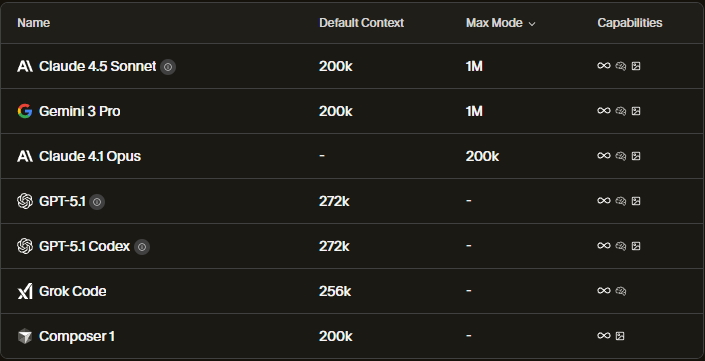

GeminiとデフォルトのCursorモデルの比較

GeminiとCursorの組み込みモデルをいつ使い分けるか疑問に思うかもしれません。私の経験を次に示します。

Geminiを使うべきとき:

- 複雑な問題について洗練された推論が必要な場合

- アルゴリズム設計やアーキテクチャに取り組んでいる場合

- 困難な問題に対して異なる視点が欲しい場合

- 新しい概念を学習中で、詳細な説明が欲しい場合

Cursorのデフォルトモデルを使うべきとき:

- 迅速で簡単なコード補完が必要な場合

- 単純なリファクタリングタスクを行っている場合

- より速い応答時間が欲しい場合

- トークン/レート制限内で作業している場合

Cursor内でGeminiを使うべきか、それとも他のモデルを使うべきか?

簡単な比較を以下に示します。

| タスクの種類 | 最適なモデル |

|---|---|

| 深い推論、アーキテクチャ | Gemini 3.0 Pro |

| リファクタリング、コードの整理 | Claude 3.7 |

| 高速なコードスタブ | GPT-4.1またはFlash |

| ローカルでのオフラインコーディング | Llama 3またはQwenローカル |

| 大規模なコードベースの要約 | Gemini ProまたはClaude |

ほとんどの開発者は、2つまたは3つのモデルをローテーションで使用しています。

AIを活用した開発の未来

このセットアップは、ソフトウェア開発が向かっている方向を示しています。開発者は、さまざまなタスクに特化した複数のAIツールを使用するようになるでしょう。Geminiは、GoogleのAIへの大規模な研究投資をコーディングワークフローにもたらし、Cursorは、その知能を特定のプロジェクトに適用するための完璧な環境を提供します。

両ツールが進化し続けるにつれて、この統合はさらに強力になるでしょう。AIが単なる簡単なタスクを支援するだけでなく、ソフトウェアの設計と開発における真の協力パートナーとなる未来が待っています。

結論:あなたの新しいAIペアプログラマー

GeminiをCursorで機能させるには数分かかるかもしれませんが、その見返りは計り知れません。本質的に、あなたはGoogleの最も高度なAIを開発チームの専任メンバーとして追加することになります。

Cursorの深いコード理解とGeminiの洗練された推論能力の組み合わせは、まるでベテランエンジニアが肩越しに見てくれているような開発体験を生み出します。しかも、そのエンジニアは決して疲れることがなく、これまでに記録されたすべてのプログラミング概念を瞬時に思い出せるのです。

目標はあなたの思考を置き換えることではなく、それを増強することであることを忘れないでください。Geminiをあなたの武器庫の強力なツールとして使用し、すべてがスムーズに機能していることを確認するためにApidogでAPI統合をテストすることを忘れないでください。

あなたの新しいAIペアプログラマーとのコーディングを楽しんでください!開発の未来はここにあり、これまで以上にエキサイティングです。