Googleがシャドウデプロイメントとプレビューエンドポイントを通じてGemini 3.0を静かに展開する中、開発者はその強化された推論とマルチモーダル性能を早期にテストする機会を得ています。

Google DeepMindの研究者とエンジニアは、Gemini 3.0をこれまでで最も高性能なモデルファミリーとして位置づけています。さらに、これはネイティブのエージェント的な振る舞いとより深いツール統合を導入することにより、漸進的なアップデートを超えて進化しています。

Gemini 3.0のリリーススケジュールと展開戦略

Googleは主要なモデルアップグレードに段階的な展開アプローチを採用しています。その結果、従来の基調講演での発表なしに、Gemini 3.0は最初に管理された環境で登場しました。

このモデルは、2025年11月中旬頃にAI Studioで「gemini-3-pro-preview」という識別子で初めて登場しました。さらに、一部のGemini Advanced購読者には、「以前のモデルから、これまでで最もスマートなモデルである3.0 Proにアップグレードしました」というアプリ内通知が届きました。このシャドウリリースにより、Googleはインターフェースの連続性を保ちながら、本番環境のテレメトリーを収集できます。

Vertex AIおよびGemini APIの変更履歴には、現在gemini-3-pro-preview-11-2025などのプレビューエンドポイントがリストされています。さらに、2025年10月にLM Arenaのリーダーボードを席巻した「lithiumflow」や「orionmist」といった内部コードネームが、初期のGemini 3.0のチェックポイントとして確認されています。

Google DeepMindは2025年11月のスレッドでこのモデルファミリーを公に認め、Gemini 3が「最先端の推論能力、世界をリードするマルチモーダル理解、そして新しいエージェント的なコーディング体験」を提供すると説明しました。より広範なGemini 3 APIの利用可能性を含む完全な安定版リリースは、2025年末までに予定されています。

Gemini 3.0における主要なアーキテクチャの進歩

Gemini 3.0は、以前の世代で確立された混合エキスパート(MoE)の基盤を構築しています。しかし、推論の品質と効率に直接影響を与えるいくつかの重要な機能強化が組み込まれています。

まず、このモデルはGemini 2.5 Proで利用可能な200万トークンを超えるコンテキストウィンドウサポートを拡張し、プレビューインスタンスでは拡張されたセッションをより首尾一貫して処理します。第二に、はるかに大規模なマルチモーダルデータセットでのトレーニングにより、クロスモーダルアライメントが改善され、モデルは現在、テキスト、コード、画像、構造化データをインターリーブして、モダリティ損失を低減しながら処理します。

研究者たちは、推論チェーン中の長距離依存関係を優先する洗練されたアテンションメカニズムを導入しました。その結果、Gemini 3.0は100回を超える複数ターンの対話において、コンテキストドリフトの問題が少なくなります。

このファミリーには、プレビュー版として少なくとも2つの主要なバリアントが含まれます。

- Gemini 3.0 Pro: 最高の知能と複雑な問題解決のために最適化された主力モデル。

- Gemini 3.0 Flash: 高い能力を維持しつつ、TPUインフラストラクチャ上で1秒未満の応答時間を達成する、遅延を重視した蒸留版。

初期の計測によると、Proはデフォルトで温度1.0で動作し、低い値では思考連鎖のパフォーマンスが低下する可能性があるとドキュメントで警告されています。これは、温度0.7が最適な結果をもたらすことが多かった以前のモデルとは異なる点です。

マルチモーダル理解と生成能力

Gemini 3.0は、ネイティブのマルチモーダル処理を大幅に強化しています。エンジニアは、モデルを多様なデータタイプでエンドツーエンドにトレーニングし、個別のエンコーダーなしで視覚、音声、テキストにわたる推論を可能にしています。

例えば、このモデルはユーザーインターフェースのスクリーンショットを分析し、機能仕様を抽出し、組み込みアニメーションを含む完全なReactまたはFlutterコードを1回のパスで生成します。さらに、科学的な図を解釈し、基になる方程式を導き出し、組み込みの物理知識を使用して結果をシミュレートします。

プレビューユーザーは、視覚推論タスクにおいて画期的なパフォーマンスを報告しています。

- オーバーレイされた注釈を含む複雑なチャートの正確な解釈

- 数学的な制約(例:完全な円、比例スケーリング)を尊重するSVGコードの生成

- 散文、コード実行、視覚出力を組み合わせたインタラクティブなCanvas体験の作成

さらに、エージェント的な拡張機能により、モデルはツール呼び出しを自律的に調整できます。開発者たちは、Gemini 3.0 Proが明示的なプロンプトなしに多段階のブラウザ操作やAPIシーケンスを計画するのを確認しており、これは以前は実験モードに限定されていた機能です。

推論とエージェント的振る舞いの改善

Googleは、Gemini 3.0における核となるパラダイムとして「Deep Think」を強調しています。モデルは内部で問題をサブ問題に分解し、複数の解決経路を評価し、最終出力を出す前に自己修正を行います。

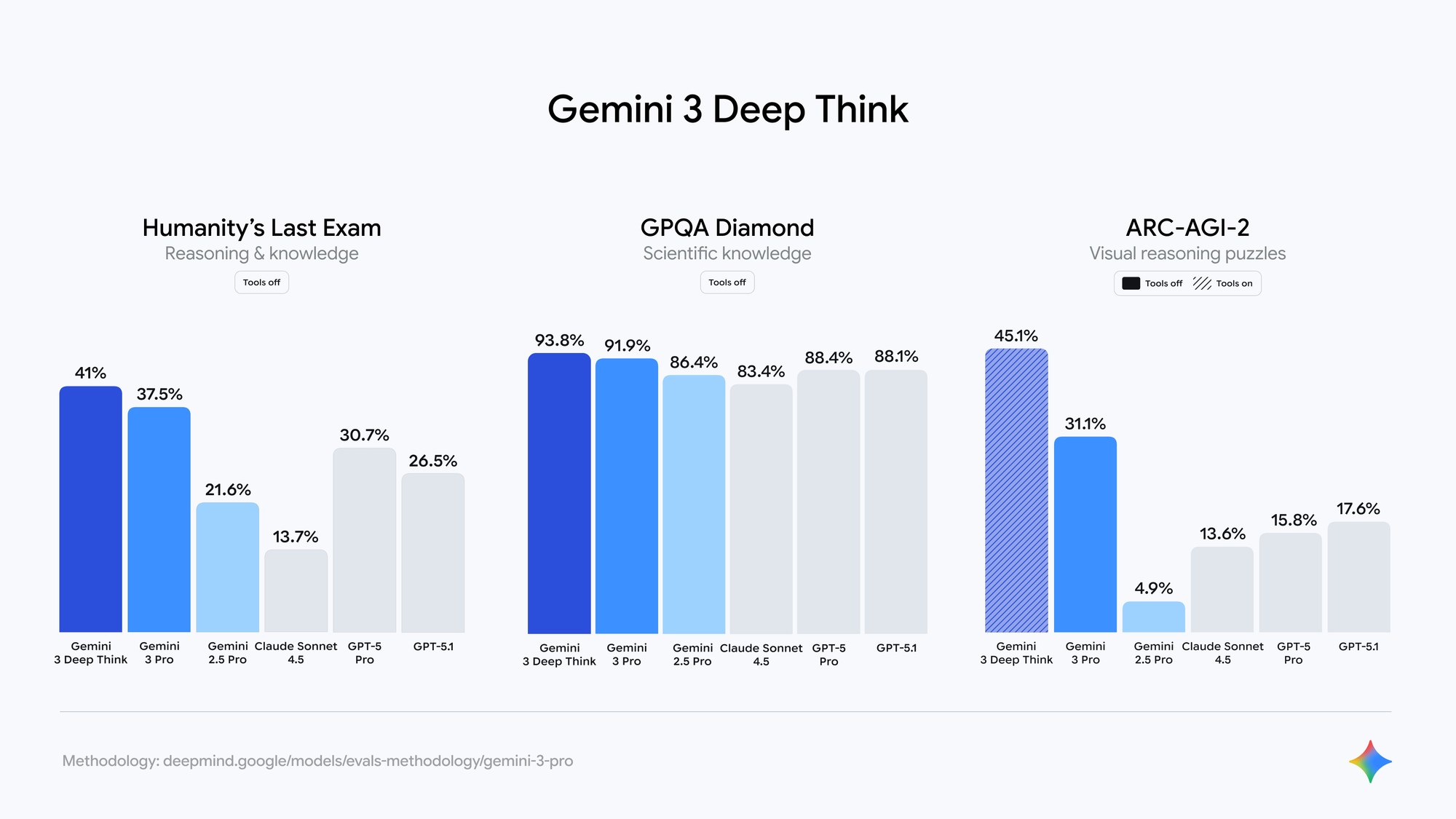

閉鎖されたLM Arenaチェックポイント(Gemini 3.0のバリアントとして広く受け入れられている)に関する独立した評価は以下を示しています。

- SimpleBenchスコアが90~100%に近づく(Gemini 2.5 Proの62.4%と比較して)

- GPQA Diamond、AIME 2024、SWE-bench Verifiedで大幅な向上

- 長文生成における事実の一貫性の改善

さらに、モデルは創発的な計画能力を示します。システム設計のタスクを与えられた際、エッジケースを予測しながら、完全なアーキテクチャ図、API契約、デプロイスクリプトを生成します。

プレビュー版Gemini 3 APIへのアクセス

開発者は現在、Gemini APIプレビューエンドポイントを通じてGemini 3.0にアクセスしています。Googleは既存のSDKとの後方互換性を維持しており、必要なのはモデル名の更新のみです。

主なエンドポイントの変更点は次のとおりです。

# 既存のGemini 2.5コードは引き続き機能します

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

# プレビューモデルに切り替える

model = genai.GenerativeModel("gemini-3-pro-preview-11-2025")

response = model.generate_content(

"量子もつれを動作するPythonシミュレーションで説明してください",

generation_config=genai.types.GenerationConfig(

temperature=1.0,

max_output_tokens=8192

)

)

Gemini 3 APIは、以前のバージョンと同じ安全設定、関数呼び出し、およびグラウンディング機能をサポートしています。ただし、プレビューのクォータは控えめであり、プロジェクトごとにレート制限が適用されます。

本番環境レベルのテストでは、Apidogのようなツールは非常に貴重であることが証明されています。ApidogはGemini OpenAPI仕様を自動的にインポートし、オフライン開発用のリクエストモックを有効にし、詳細な応答検証を提供します。これは、可変長の出力を生成する可能性のある新しい推論動作を試す際に不可欠です。

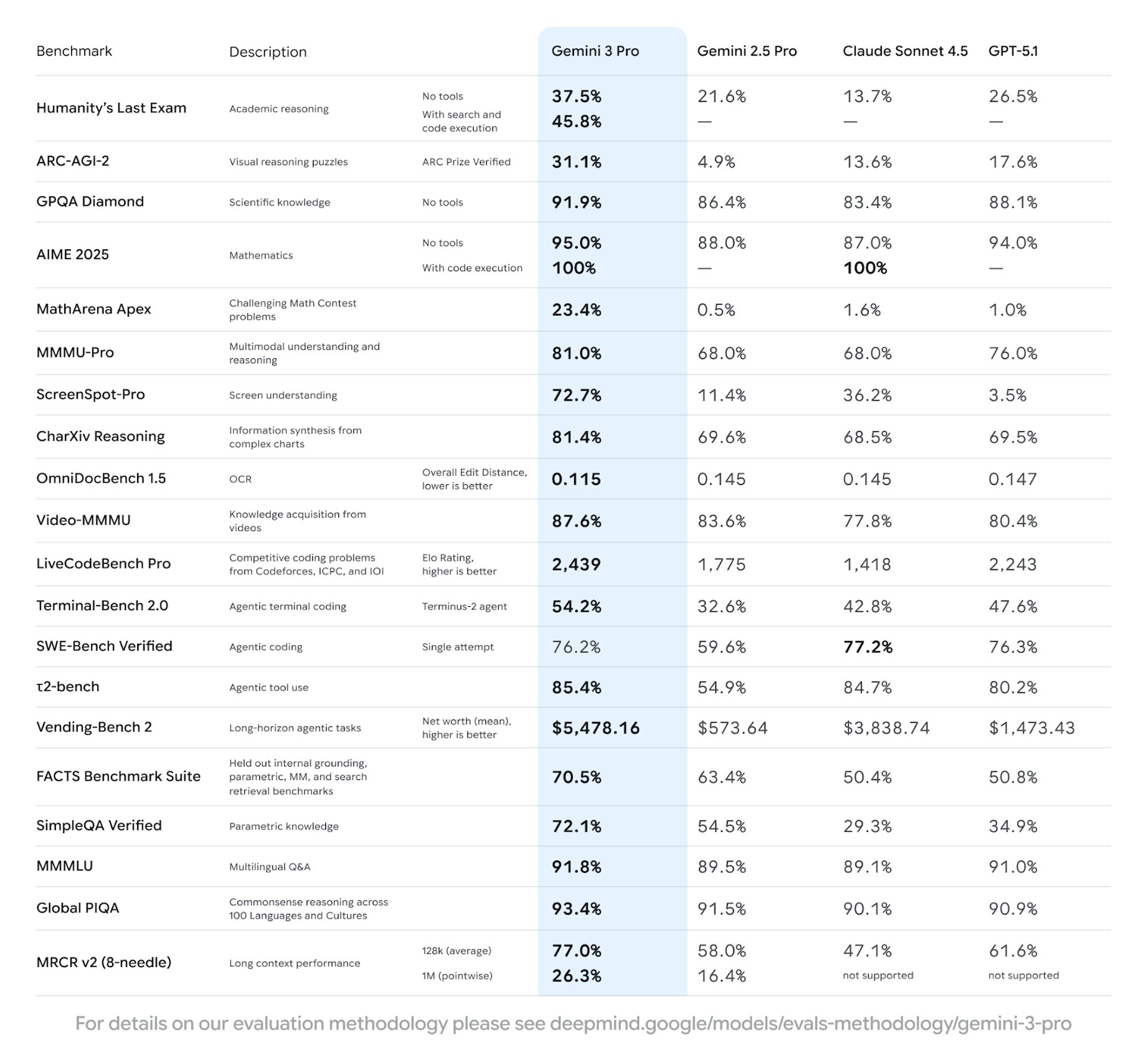

ベンチマーク性能と競争上の位置づけ

Googleはまだ公式の比較表を公開していませんが、プレビューアクセスとシャドウデプロイメントからのコミュニティ検証済みの結果は、Gemini 3.0 Proがいくつかの分野で現在の公開モデルをリードしていることを示しています。

これらの数値は、推論密度とコード品質において、Gemini 3.0が現代のClaude 4 OpusおよびGPT-4.1相当のモデルよりも優位に立っていることを示しています。

Gemini 3 APIとの実用的な統合パターン

導入を成功させるには、新しい行動特性を理解する必要があります。開発者は、複雑なプロンプトに対する思考時間が長くなることを考慮しなければなりません。モデルは、応答する前に内部的な熟考に追加のトークンを費やすことがよくあります。

プレビュー使用から明らかになったベストプラクティス:

- 推論が重視されるタスクでは温度を1.0に設定する

- 構造化された出力(JSON、YAML)を強制するためにシステム指示を使用する

- 完全なコードベースのアップロードに拡張されたコンテキストを活用する

- 決定論的な動作が必要な場合はツール呼び出しを明示的に連結する

さらに、信頼性の高いエージェントループのために、Gemini 3 APIと外部のオーケストレーションレイヤーを組み合わせます。Apidogは、gemini-2.5-proとgemini-3-pro-previewのエンドポイント間でシームレスに切り替えられる環境固有のコレクションを提供することで、ここで優れています。

プレビュー版における制限と既知の問題

プレビュービルドは時折不安定性を示します。ユーザーは、極めて長いセッション(15万トークン以上)でのコンテキスト損失や、ニッチな分野での稀なハルシネーションに遭遇します。さらに、画像生成はネイティブ統合ではなく、別個のImagen/Nano Bananaエンドポイントに結びついています。

Googleはテレメトリーに基づいて積極的に反復しています。報告された問題のほとんどは発見から数日以内に解決され、シャドウデプロイメントの利点が反映されています。

将来の展望とエコシステムへの影響

Gemini 3.0は、マルチモーダルエージェントの新しいベースラインを確立します。Gemini 3 APIが安定版になると、Google Workspace、Android、Vertex AIエージェント全体での迅速な統合が期待されます。

企業はカスタムアライメントを備えたプライベートインスタンスから恩恵を受ける一方、開発者はこれまで複数のモデル呼び出しを必要とした推論の深さにアクセスできるようになります。

生の知能、ネイティブなツール理解、および効率的なデプロイメントの組み合わせにより、Gemini 3.0は次世代AIアプリケーションの基盤として位置づけられます。

これらの機能を試す準備ができている開発者は、直ちにテストスイートをGemini 3 APIプレビューに移行し始めるべきです。Apidogのようなツールは、ワンクリックのエンドポイント切り替えと包括的なデバッグを提供することで、この移行中の摩擦を劇的に軽減します。

Googleの段階的な展開は、大規模モデルのデプロイメントにおける成熟度を示しています。その結果、Gemini 3.0が一般提供される際には、エコシステムは即座の生産的な利用に向けて準備が整うでしょう。