Tokenisierung ist der Prozess, bei dem sensible Daten gegen nicht-sensible Platzhalter, sogenannte Tokens, ausgetauscht werden. Diese Tokens behalten das Format oder die Länge der Originaldaten bei, haben aber für sich genommen keinen verwertbaren Wert. Im Kontext der API-Sicherheit dient die Tokenisierung als ein beeindruckender Abwehrmechanismus. Wenn ein Benutzer Zahlungsdetails, medizinische Aufzeichnungen oder persönliche Informationen über eine Programmierschnittstelle übermittelt, ersetzt das System diese kritischen Daten nahtlos durch ein digitales Token, bevor die tatsächliche Speicherung oder weitere Verarbeitung erfolgt.

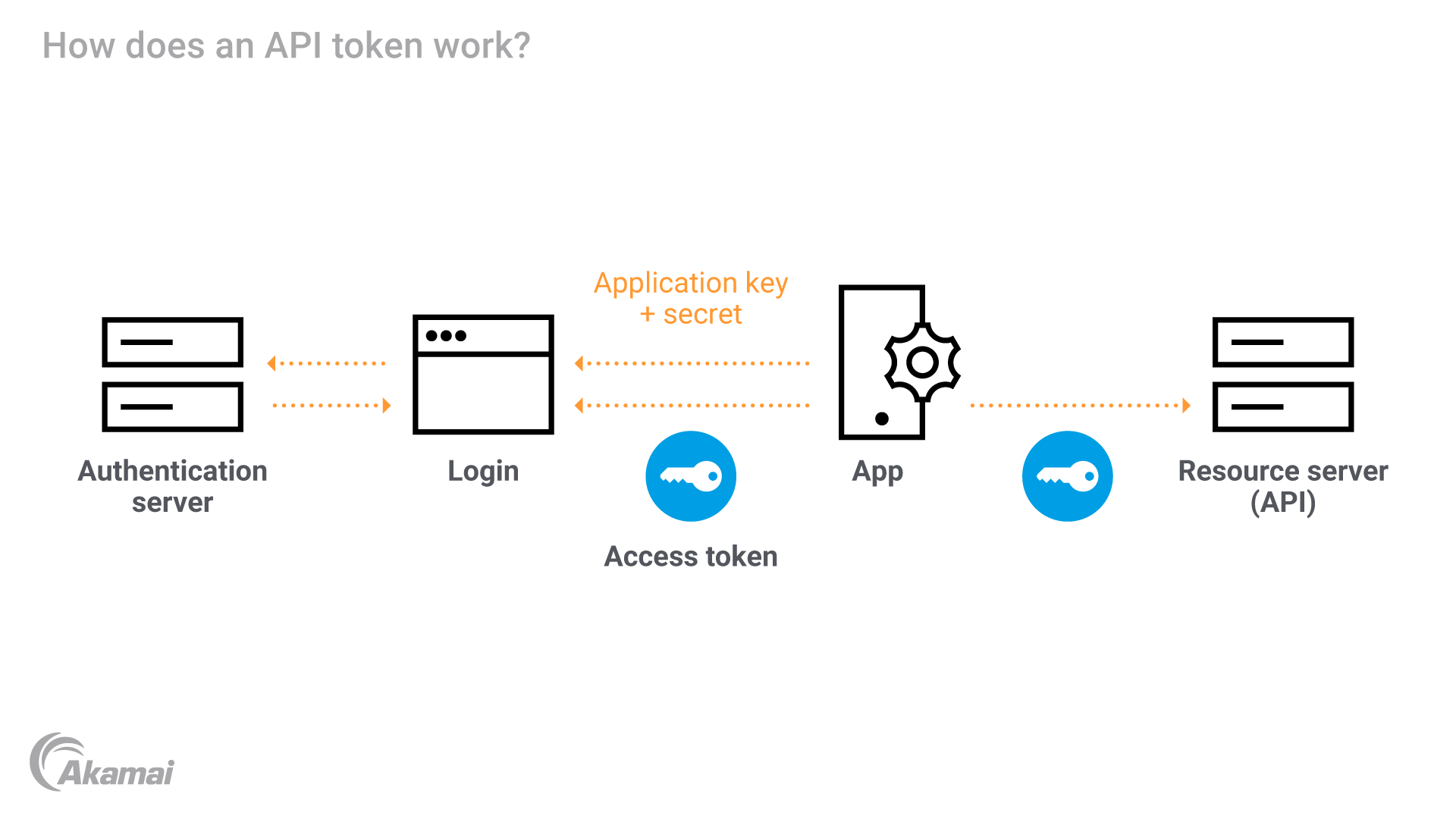

Wie genau funktioniert Tokenisierung, um digitale Umgebungen zu sichern? Der Standard-Workflow umfasst im Allgemeinen vier Hauptschritte, die streng kontrolliert werden:

- Datenerfassung: Sensible Informationen gelangen über eine sichere API-Anfrage von einem Benutzer oder einer Anwendung in das System.

- Token-Generierung: Ein sicherer Token-Generator erstellt eine zufällige Zeichenfolge – das Token – um die tatsächlichen, sensiblen Daten zu ersetzen. Dieses generierte Token hat keinerlei Bezug zur ursprünglichen Eingabe.

- Sichere Speicherung: Die Originaldaten werden direkt an eine hochsichere, isolierte Datenbank gesendet, die allgemein als Token-Vault (Tokenspeicher) bekannt ist. Dieser Speicher ordnet das nicht-sensible Token den realen Daten zu und nichts anderem.

- Datenaustausch: Das System entfernt die sensiblen Daten vollständig von internen Servern und Datenbanken und verwendet für alle nachfolgenden Operationen ausschließlich das neu generierte Token.

Tokens haben für Cyberkriminelle praktisch keinen Wert, da sie ohne expliziten, kontrollierten Zugriff auf den sicheren Token-Vault (Tokenspeicher) nicht entschlüsselt oder mathematisch umgekehrt werden können. Dies macht die Tokenisierungs-Sicherheit zu einer absoluten Notwendigkeit und einer wesentlichen Praxis für Organisationen, die Zahlungsabwicklungen, Gesundheitsdaten oder sensible Finanzwerte verwalten. Darüber hinaus stellt die Anwendung von Best Practices der Tokenisierung sicher, dass interne Netzwerke außerhalb des Geltungsbereichs strenger Compliance-Vorschriften wie PCI DSS und DSGVO bleiben. Durch den Einsatz von Tokenisierung in der API-Sicherheit können Unternehmen einen reibungslosen täglichen Betrieb effektiv aufrechterhalten, ohne jemals wertvolle Informationen preiszugeben.

Tokenisierung vs. Verschlüsselung: Was bietet bessere API-Sicherheit?

Bei der Diskussion über Datenschutz verwechseln Entwickler und Unternehmensleiter Tokenisierung oft mit Verschlüsselung. Obwohl beide mächtige Methoden den Schutz sensibler Informationen zum Ziel haben, unterscheiden sich ihre Kernmechanismen erheblich. Das Erfassen der genauen Unterschiede zwischen Tokenisierung und Verschlüsselung bleibt für den Aufbau einer robusten, undurchdringlichen Sicherheitsarchitektur von entscheidender Bedeutung.

Verschlüsselung beinhaltet die Umwandlung der ursprünglichen Klartextdaten in ein unlesbares Format mithilfe komplexer mathematischer Algorithmen. Dieser Prozess erfordert stark einen kryptografischen Schlüssel. Jeder, der den richtigen Entschlüsselungsschlüssel besitzt, kann den Prozess umkehren und die Originaldaten lesen. Wenn es einem Hacker gelingt, den kryptografischen Schlüssel zu stehlen, wird die gesamte Datenbank anfällig für Ausnutzung. Verschlüsselung eignet sich hervorragend zum Schutz von Daten während der Übertragung, birgt jedoch zugrunde liegende Schwachstellen, wenn das Schlüsselmanagement fehlschlägt.

Tokenisierung hingegen ersetzt sensible Daten aktiv durch ein zufällig generiertes Token, das absolut keine mathematische Beziehung zu den ursprünglichen Eingabedaten aufweist. Ein Token kann weder physisch noch algorithmisch entschlüsselt werden, da bei seiner Erstellung kein Algorithmus und kein Schlüssel beteiligt sind. Die einzige Möglichkeit, die Originaldaten abzurufen, besteht darin, auf den geschützten Token-Vault (Tokenspeicher) zuzugreifen, in dem die Zuordnung gespeichert ist.

Hier ist ein direkter Vergleich der beiden:

| Merkmal | Tokenisierung | Verschlüsselung |

|---|---|---|

| Reversibilität | Irreversibel ohne Zugriff auf den vorgesehenen Token-Vault | Reversibel mit dem korrekten Entschlüsselungsschlüssel |

| Datenbeziehung | Zufällig generiert, ohne jegliche mathematische Verbindung | Mathematisch transformiert und strukturell verändert |

| Compliance-Umfang | Reduziert den erforderlichen Compliance-Umfang erheblich | Daten bleiben vollständig im Compliance-Umfang |

| Geschwindigkeit und Effizienz | Extrem schnell für Transaktionsverarbeitungsaufgaben | Kann manchmal aufwendig und ressourcenintensiv sein |

| Primäre Anwendungsfälle | Zahlungsabwicklung, API-Sicherheit und lokale Datenbanken | Sichere Dateiübertragungen, E-Mails und Daten während der Übertragung |

Die Wahl zwischen Tokenisierung und Verschlüsselung hängt von den spezifischen organisatorischen Anforderungen ab. Für den aktiven Schutz von Kreditkartendaten und API-Endpunkten bietet die Tokenisierungs-Sicherheit jedoch eine weitaus überlegene, unknackbare Verteidigungsebene, die Sicherheitsverletzungen völlig harmlos macht.

Wichtige Anwendungsfälle, Vorteile und Beispiele der Tokenisierung

Die weltweite Einführung von Tokenisierungs-Tools ist in den letzten Jahren in zahlreichen schnelllebigen Branchen massiv gewachsen. Unternehmen nutzen die Vorteile der Tokenisierung kontinuierlich, um den strengen Schutz der Verbraucherdaten zu gewährleisten, interne Abläufe zu optimieren und die katastrophalen Auswirkungen massiver Datenlecks zu minimieren. Es gibt mehrere prominente Anwendungsfälle der Tokenisierung, die die extreme Flexibilität dieser modernen Technologie deutlich hervorheben.

Eines der häufigsten Beispiele für Tokenisierung findet im Einzelhandel und E-Commerce-Sektor statt. Wenn ein Stammkunde seine Kreditkarteninformationen auf einer beliebten Einkaufswebsite für zukünftige Einkäufe speichert, speichert der Händler nicht die tatsächliche Kartennummer. Stattdessen speichert er sicher ein minimales Token. Wenn die Kundendatenbank des Händlers kompromittiert wird, stehlen Hacker völlig nutzlose Tokens, was die tatsächlichen finanziellen Vermögenswerte des Kunden perfekt schützt.

Ein weiterer massiver Anwendungsfall betrifft das komplexe Gesundheitssystem. Medizinische Einrichtungen verarbeiten täglich große Mengen geschützter Gesundheitsinformationen. Durch die sorgfältige Tokenisierung wichtiger Patienten-IDs, vertraulicher Sozialversicherungsnummern und sensibler medizinischer Aufzeichnungen können Krankenhäuser Daten sicher über ausgedehnte Netzwerke übertragen, ohne gegen HIPAA-Vorschriften zu verstoßen.

Zu den klaren Vorteilen der Tokenisierung gehören insbesondere:

- Verbessertes Sicherheitsprofil: Cyberkriminelle können einfache Tokens schlichtweg nicht monetarisieren oder ausnutzen. Das Speichern von leeren Tokens anstelle von Rohdaten senkt das intensive Risiko, das mit Datendiebstahl verbunden ist, drastisch.

- Kostengünstige Compliance: Die Tokenisierung begrenzt systematisch die Systeme, die sensible Daten berühren. Dies reduziert den Umfang und die Kosten von Compliance-Audits für strenge Standards wie PCI DSS.

- Verbesserte Kundenerfahrung: Dynamische Unternehmen bieten selbstbewusst nahtlose Checkout-Erlebnisse, wiederkehrende Abrechnungen und schnelle Ein-Klick-Zahlungen an, ohne die grundlegende Sicherheit zu opfern.

- Operationelle Agilität: Tokens bewahren das exakte Format der Originaldaten, was bedeutet, dass sie reibungslos durch Altsysteme und moderne APIs geleitet werden können, ohne kostspielige Überarbeitungen zu erfordern.

Die Integration einer ordnungsgemäßen Tokenisierungs-Sicherheit direkt in Ihre Architektur macht sensible Daten für Angreifer effektiv unsichtbar. Dies verändert grundlegend die Funktionsweise Ihrer gesamten Organisation und schützt letztendlich sowohl Ihren Geschäftsruf als auch das unerschütterliche Vertrauen Ihrer Benutzer.

Apidog: Die ultimative Plattform für das Design und Testen von APIs mit Authentifizierung

Die Implementierung einer leistungsstarken Tokenisierung in der API-Sicherheit erfordert hochzuverlässige Software, um den vollständigen Erfolg zu gewährleisten. Wenn Sie undurchdringliche digitale Systeme aufbauen möchten, benötigen Sie grundlegend eine robuste Plattform, um Ihre Endpunkte sorgfältig zu entwerfen, aktiv zu debuggen und akribisch zu testen. Genau hier tritt Apidog als erste und unbestreitbare Wahl unter den modernen Lösungen für API-Entwicklung und automatisiertes Testen auf den Plan.

Apidog präsentiert sich als umfassende Plattform, die speziell für das API-Design, die Dokumentation, das Debugging und reaktionsschnelles Mock-Testing entwickelt wurde. Beim Aufbau von Tokenisierungs-Tools oder der Integration von Tokenisierungs-Diensten müssen Entwickler unbedingt überprüfen, ob ihre aktiven APIs generierte Tokens korrekt handhaben. Apidog bietet eine unglaublich intuitive visuelle Oberfläche, die diesen genauen Prozess völlig mühelos macht. Sie können ganz einfach strenge Endpunktstrukturen definieren, erweiterte Sicherheitsschemata skizzieren und notwendige Anfrageparameter für alle tokenisierten Interaktionen festlegen.

Mit Apidog konfigurieren Sie schnell komplexe Authentifizierungsmethoden, einschließlich Standard-OAuth 2.0, sichere Bearer-Tokens und benutzerdefinierte API-Schlüssel. Die Plattform bildet visuell genau ab, wie Ihre robuste API einen sensiblen Token erwarten und verarbeiten soll, was sie zu einem völlig unverzichtbaren Gut für fokussierte Engineering-Teams weltweit macht.

Darüber hinaus zeichnet sich Apidog einzigartig durch schnelles automatisiertes Testen aus. Sie können umfangreiche Testszenarien erstellen, um zu überprüfen, ob Ihre API sensible Rohdaten korrekt gegen sichere Tokens austauscht. Die detaillierte Plattform unterstützt nativ dynamische Umgebungsvariablen, was bedeutet, dass Sie Tokens während Ihrer Testphase problemlos zwischen verschiedenen API-Anfragen übergeben können. Dies simuliert reale, komplexe Benutzerabläufe ordnungsgemäß und beweist, dass Ihre sichere Tokenisierungslogik vollständig standhält.

Die Wahl von Apidog bedeutet sofort die Entscheidung für erstklassige Effizienz und dauerhafte Zuverlässigkeit. Die Anwendung stellt sicher, dass Ihr genaues API-Design perfekt mit strengen OpenAPI-Spezifikationen übereinstimmt, indem KI-gesteuerte Prüfungen eingesetzt werden, um Fehler sehr frühzeitig zu erkennen. Verwenden Sie Apidog, um robuste APIs unter Nutzung der Best Practices der Tokenisierung zu entwerfen, zu testen und erfolgreich bereitzustellen. Melden Sie sich noch heute bei Apidog an, um Ihren Workflow schnell zu optimieren.

Fazit

Tokenisierung stellt im Wesentlichen einen monumentalen, entscheidenden Fortschritt im Rohdatenschutz und der modernen Cybersicherheit dar. Da aggressive Cyberbedrohungen kontinuierlich weitaus raffinierter und schädlicher werden, können traditionelle Sicherheitsmaßnahmen wie die grundlegende Verschlüsselung einfach nicht mehr vollständig alleine bestehen. Durch ein tiefes Verständnis dessen, was Tokenisierung genau ist, können kluge Unternehmen hochsensible Daten aktiv aus ihren internen Computernetzwerken entfernen und diese schnell durch völlig harmlose, nutzlose Platzhalter ersetzen.

In diesem Leitfaden haben wir genau untersucht, wie Tokenisierung funktioniert, die entscheidenden Unterschiede zwischen Tokenisierung und Verschlüsselung hervorgehoben und die massiven Vorteile der Tokenisierung zusammengefasst, die sich über E-Commerce, komplexe Gesundheitsversorgung und globale Finanzen erstrecken. Die vielfältigen diskutierten Anwendungsfälle der Tokenisierung beweisen aktiv, dass diese fortschrittliche Methode nicht nur den täglichen Betrieb gründlich sichert, sondern auch die hohen Kosten und die schwere Last strenger regulatorischer Compliance drastisch reduziert. Die konsequente Integration von Tokenisierungs-Best-Practices in Ihre grundlegende Infrastruktur ist kein optionaler Luxus mehr; sie ist eine fundamentale, dringende Anforderung für absolut jede Organisation, die den Datenschutz der Benutzer und die API-Sicherheit schätzt.

Darüber hinaus fungieren Ihre Web-APIs, wenn Sie sich fest dazu entschließen, eine robuste Tokenisierungs-Sicherheit zu implementieren, als das primäre Rückgrat dieser komplexen Integration. Sie müssen unbedingt von Grund auf fehlerfrei entworfen und vor der Bereitstellung rigoros getestet werden. Apidog bietet erfolgreich die ultimative, umfassende Lösung für genau dieses technische Szenario. Seine unglaublich leistungsstarke Suite von API-Design, hochdetaillierter Dokumentation und automatisierten Testfunktionen befähigt Softwareentwicklungsteams einzigartig, schnell sichere und konstant zuverlässige Verbindungen aufzubauen. Indem Sie Apidog als Ihr Hauptwerkzeug wählen, stellen Sie sicher, dass tokenisierte Workflows immer perfekt funktionieren.

Übernehmen Sie noch heute die volle Kontrolle über Ihre Unternehmensdatensicherheit. Schützen Sie Ihre hochsensiblen Informationen, verteidigen Sie Ihre treuen Kunden vehement und bauen Sie schnell erstklassige APIs mit unerschütterlichem Vertrauen auf. Laden Sie Apidog jetzt herunter und melden Sie sich gerne an, um die absolut beste verfügbare API-Plattform vollständig zu erleben.