Entwickler und KI-Enthusiasten wenden sich zunehmend leistungsstarken generativen Modellen wie Wan 2.2 zu, um aus einfachen Eingaben filmische Videos zu erstellen. Dieses Modell zeichnet sich durch seine Mixture-of-Experts-Architektur aus, die die Kapazität steigert, ohne die Geschwindigkeit zu beeinträchtigen. Wenn Sie die Wan 2.2 API (mit LoRA) kombinieren, erhalten Sie die Möglichkeit, Ausgaben für spezifische Stile oder Bewegungen zu optimieren, was sie ideal für die maßgeschneiderte Videogenerierung macht.

Was ist Wan 2.2?

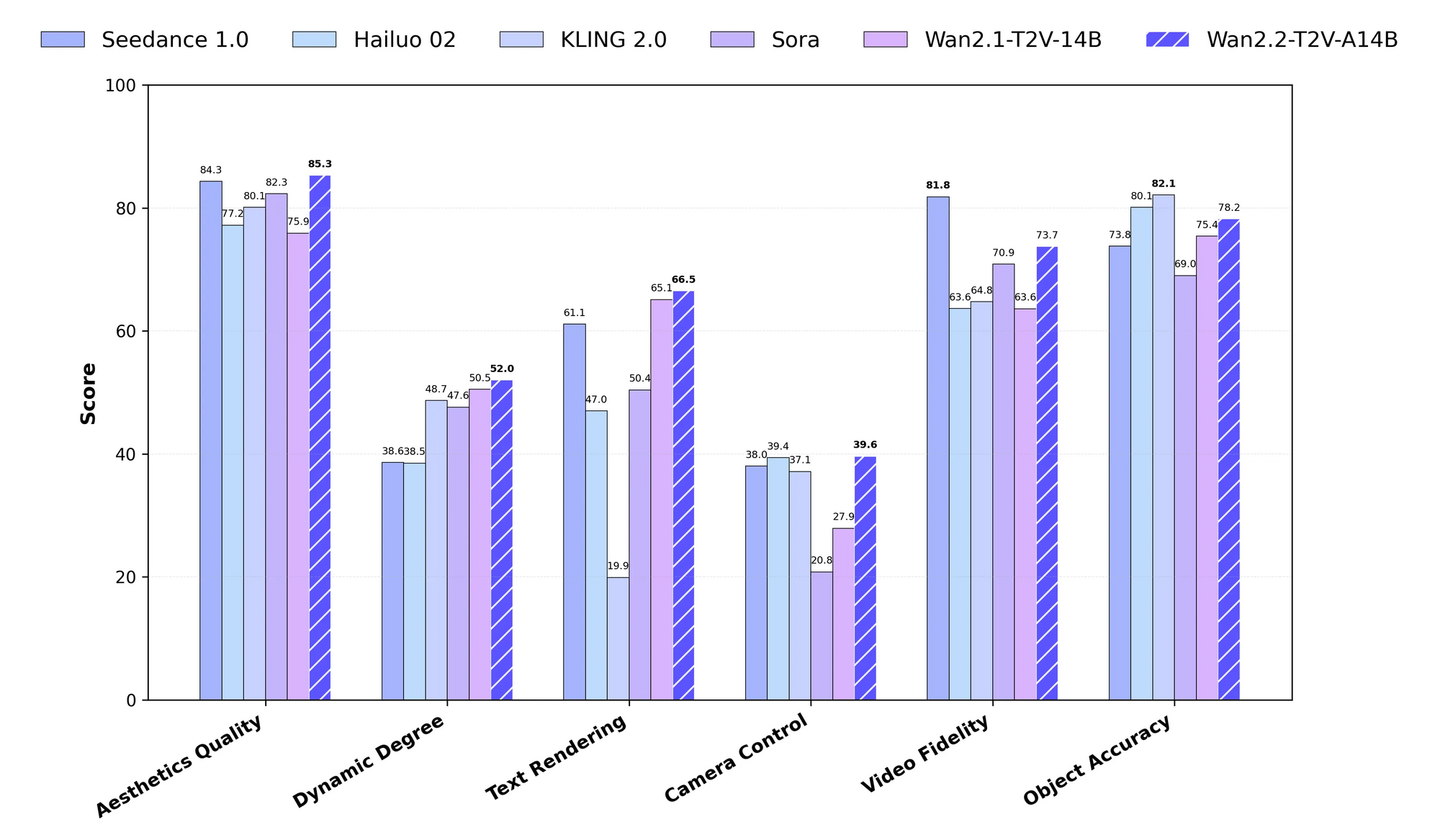

Wan 2.2 stellt ein fortschrittliches Open-Source-Modell zur großskaligen Videogenerierung dar, das vom Wan-Team entwickelt wurde. Ingenieure haben es entwickelt, um komplexe Aufgaben wie Text-zu-Video (T2V), Bild-zu-Video (I2V) und Sprache-zu-Video (S2V)-Generierung zu bewältigen. Das Modell verwendet ein Mixture-of-Experts (MoE)-Framework, das den Entrauschungsprozess in Diffusionsmodellen auf spezialisierte Experten aufteilt. Zum Beispiel verwalten Experten mit hohem Rauschen frühe Zeitschritte, während Experten mit geringem Rauschen spätere Stadien verfeinern. Dieser Ansatz führt zu insgesamt 27 Milliarden Parametern, wobei pro Inferenzschritt nur 14 Milliarden aktiv sind, was die Effizienz gewährleistet.

Darüber hinaus integriert Wan 2.2 filmische Ästhetik durch kuratierte Datensätze, die Beleuchtung, Komposition und Farbtöne betonen. Die Trainingsdaten wurden im Vergleich zu früheren Versionen erheblich erweitert, darunter 65,6 % mehr Bilder und 83,2 % mehr Videos, was die Bewegungskomplexität und das semantische Verständnis verbessert. Sie greifen auf Varianten wie das 5B-Parameter-TI2V-Modell zu, das 720P-Videos mit 24 FPS auf Consumer-Hardware wie einer RTX 4090 generiert.

Der API-Aspekt manifestiert sich hauptsächlich durch Skripte wie generate.py im offiziellen Repository, aber gehostete Plattformen erweitern ihn auf webbasierte Endpunkte. Daher wählen Sie zwischen lokaler Ausführung für die volle Kontrolle oder Cloud-Diensten für Skalierbarkeit, wenn Sie mit der Wan 2.2 API (mit LoRA) arbeiten.

Was ist LoRA im Kontext von Wan 2.2?

LoRA, oder Low-Rank Adaptation, dient als parametereffiziente Feinabstimmungsmethode für große Modelle wie Wan 2.2. Entwickler wenden LoRA an, um das Basismodell an spezifische Datensätze anzupassen, ohne die gesamte Architektur neu zu trainieren. In Wan 2.2 zielt LoRA auf die Gewichte des Transformers ab, sodass Sie benutzerdefinierte Stile, Charaktere oder Bewegungen in Videogenerierungen injizieren können.

Sie trainieren beispielsweise ein LoRA auf einem Datensatz von Orbitalschüssen, um die I2V-Variante auf die Erstellung rotierender Kamerabewegungen zu spezialisieren. Die offizielle Dokumentation warnt vor der Verwendung von LoRA, das auf Wan 2.2 trainiert wurde, für bestimmte Aufgaben wie Animation aufgrund potenzieller Instabilität, aber Community-Tools überwinden dies. Plattformen wie fal.ai integrieren LoRA direkt in ihre API, wo Sie Pfade zu LoRA-Gewichten und Skalierungsfaktoren angeben.

Folglich reduziert die Integration von LoRA in die Wan 2.2 API (mit LoRA) die Trainingskosten und ermöglicht eine schnelle Anpassung. Sie führen LoRA-Adapter zur Inferenzzeit zusammen, wodurch die Effizienz des Basismodells erhalten bleibt, während zielgerichtete Ausgaben erzielt werden.

Warum die Wan 2.2 API mit LoRA verwenden?

Sie entscheiden sich für die Wan 2.2 API (mit LoRA), um ein Gleichgewicht zwischen Leistung und Flexibilität in Video-KI-Anwendungen zu finden. Traditionelle Feinabstimmung erfordert massive Ressourcen, aber LoRA minimiert dies, indem nur Low-Rank-Matrizen aktualisiert werden. Diese Methode reduziert den Speicherverbrauch und die Trainingszeit, wodurch sie für einzelne Entwickler zugänglich wird.

Darüber hinaus ergänzt die MoE-Struktur von Wan 2.2 LoRA, indem sie expertenpezifische Anpassungen ermöglicht. Sie generieren Videos mit verbesserter Ästhetik oder Bewegungen, die Vanilla-Modelle nur schwer erzeugen können. In der Inhaltserstellung verwenden Sie LoRA beispielsweise, um konsistente Charakterstile über Szenen hinweg beizubehalten.

Gehostete APIs verstärken diese Vorteile, indem sie die Berechnungen in die Cloud verlagern. Dienste wie fal.ai übernehmen die Schwerstarbeit, sodass Sie sich auf Prompts und Parameter konzentrieren können. Daher eignet sich diese Kombination für Prototyping, Produktion und Experimente, insbesondere wenn Sie Tools wie Apidog für ein nahtloses API-Management integrieren.

Wie richte ich meine Umgebung für die lokale Nutzung der Wan 2.2 API ein?

Sie beginnen mit dem Klonen des Wan 2.2-Repositories von GitHub. Führen Sie den Befehl git clone https://github.com/Wan-Video/Wan2.2.git in Ihrem Terminal aus und navigieren Sie dann mit cd Wan2.2 in das Verzeichnis. Installieren Sie als Nächstes die Abhängigkeiten mit pip install -r requirements.txt. Für S2V-Aufgaben fügen Sie pip install -r requirements_s2v.txt hinzu.

Stellen Sie sicher, dass Ihr System PyTorch Version 2.4.0 oder höher ausführt. Installieren Sie auch die Hugging Face CLI mit pip install "huggingface_hub[cli]" für Modelldownloads. Legen Sie Umgebungsvariablen fest, wenn Sie die Prompt-Erweiterung verwenden möchten, z. B. export DASH_API_KEY=your_key für die Dashscope-Integration.

Für Multi-GPU-Setups konfigurieren Sie Fully Sharded Data Parallel (FSDP) und DeepSpeed Ulysses. Sie aktivieren diese mit Flags wie --dit_fsdp und --ulysses_size 8. Einzel-GPU-Benutzer aktivieren Speicheroptimierungen über --offload_model und --convert_model_dtype. Dieses Setup bereitet Sie darauf vor, das generate.py-Skript auszuführen, den Kern der lokalen Wan 2.2 API (mit LoRA).

Wie lade und installiere ich Wan 2.2 Modelle?

Sie laden Modelle von Hugging Face oder ModelScope herunter. Für die T2V-A14B-Variante verwenden Sie huggingface-cli download Wan-AI/Wan2.2-T2V-A14B --local-dir ./Wan2.2-T2V-A14B. Wiederholen Sie dies für andere Varianten wie I2V-A14B oder TI2V-5B.

Platzieren Sie die Checkpoints in entsprechenden Verzeichnissen. Die 14B-Modelle erfordern erheblichen VRAM – etwa 80 GB für die Multi-GPU-Inferenz – während das 5B-TI2V auf eine 24-GB-Karte passt. Überprüfen Sie nach dem Herunterladen die Dateien, um Beschädigungen zu vermeiden.

Wenn Sie Probleme haben, wechseln Sie zu ModelScope-Mirror für Regionen mit Zugriffsbeschränkungen. Dieser Schritt stellt sicher, dass Sie die Basismodelle bereit haben, bevor Sie LoRA-Adapter in der Wan 2.2 API (mit LoRA) anwenden.

Wie verwende ich das generate.py-Skript für grundlegende Aufgaben in Wan 2.2?

Sie rufen das Skript generate.py auf, um Generierungen durchzuführen. Für eine einfache T2V-Aufgabe auf einer einzelnen GPU führen Sie python generate.py --task t2v-A14B --size 1280x720 --ckpt_dir ./Wan2.2-T2V-A14B --offload_model True --convert_model_dtype --prompt "Zwei anthropomorphe Katzen in bequemer Boxkleidung kämpfen intensiv auf einer beleuchteten Bühne." aus.

Passen Sie die Parameter für andere Modi an. In I2V fügen Sie --image examples/i2v_input.JPG hinzu. Für S2V fügen Sie --audio examples/audio_input.wav hinzu und aktivieren TTS mit --enable_tts. Die Multi-GPU-Ausführung verwendet torchrun --nproc_per_node=8 generate.py mit FSDP-Flags.

Diese Befehle bilden das Rückgrat der lokalen Wan 2.2 API (mit LoRA). Sie experimentieren mit Prompts und Größen, um die Ausgaben zu verfeinern und reibungslos zur LoRA-Integration für erweiterte Anpassungen überzugehen.

Wie trainiere ich ein LoRA für Wan 2.2?

Sie trainieren LoRA mit Community-Tools wie AI Toolkit oder Trooper.AI Trainern. Zuerst bereiten Sie Ihren Datensatz vor – kuratieren Sie Videos oder Bilder, die Ihrem Zielstil entsprechen. Für ein I2V LoRA konzentrieren Sie sich auf bewegungsspezifische Clips wie Orbitalschüsse.

Richten Sie die Trainerumgebung auf Plattformen wie RunPod für den GPU-Zugriff ein. Laden Sie die Wan 2.2 Basisgewichte in die erwarteten Verzeichnisse. Konfigurieren Sie Hyperparameter: Setzen Sie die Lernrate auf 1e-5, die Batchgröße auf 1 und die Epochen auf 10-20, abhängig von der Datensatzgröße.

Führen Sie das Trainingsskript aus und überwachen Sie die Verlustmetriken. Tools wie die PEFT-Bibliothek von Hugging Face erleichtern dies und ermöglichen es Ihnen, das LoRA als .safetensors-Datei zu speichern. Nach dem Training wenden Sie diesen Adapter in Generierungen an, wodurch die Wan 2.2 API (mit LoRA) für spezialisierte Aufgaben verbessert wird.

Wie wende ich LoRA in der lokalen Wan 2.2 Generierung an?

Sie integrieren LoRA in lokalen Setups über ComfyUI oder benutzerdefinierte Skripte. Verwenden Sie in ComfyUI den LoadLoRAModelOnly-Knoten zwischen dem Modelllader und dem Sampler. Geben Sie den LoRA-Pfad und die Stärke an (z. B. 0,8).

Für generate.py fügen Community-Forks oder Erweiterungen LoRA-Unterstützung hinzu, da die offizielle Version keine direkte Integration bietet. Alternativ können Sie die Diffusers-Pipeline für Animationsmodi verwenden, wobei LoRA mit pipe.load_lora_weights("path/to/lora") geladen wird.

Diese Anwendung wandelt Standardausgaben in maßgeschneiderte Videos um. Daher erreichen Sie Konsistenz in Stilen oder Bewegungen, wodurch die Wan 2.2 API (mit LoRA) vielseitiger für den Produktionseinsatz wird.

Was sind die besten gehosteten Dienste für die Wan 2.2 API mit LoRA?

Sie greifen über Plattformen wie fal.ai auf die gehostete Wan 2.2 API (mit LoRA) zu. Ihr Endpunkt unter https://api.fal.ai/v1/fal-ai/wan/v2.2-a14b/text-to-video/lora unterstützt LoRA nativ. Melden Sie sich für einen API-Schlüssel an und konfigurieren Sie ihn in Ihrem Client.

Weitere Dienste sind WaveSpeed.ai für I2V LoRA und Trooper.AI für das Training. Diese eliminieren die Notwendigkeit lokaler Hardware und skalieren mühelos auf hohe Auflösungen. Folglich prototypisieren Sie schneller und integrieren Tools wie Apidog für das Anfragemanagement.

Wie authentifiziere ich mich und sende Anfragen an die fal.ai Wan 2.2 API?

Sie authentifizieren sich, indem Sie die Umgebungsvariable FAL_KEY festlegen. Installieren Sie den fal-ai-Client mit npm install --save @fal-ai/client für JavaScript oder verwenden Sie Python-Äquivalente.

Senden Sie eine POST-Anfrage mit JSON-Payload, die prompt und ein loras-Array enthält. Zum Beispiel: {"prompt": "Eine Cyberpunk-Großstadt bei Nacht", "loras": [{"path": "https://example.com/loras/cyberpunk.safetensors", "scale": 0.8}]}.

Überwachen Sie die Antworten auf Video-URLs. Dieser Prozess nutzt die Wan 2.2 API (mit LoRA) in Cloud-Umgebungen und gewährleistet eine zuverlässige Leistung.

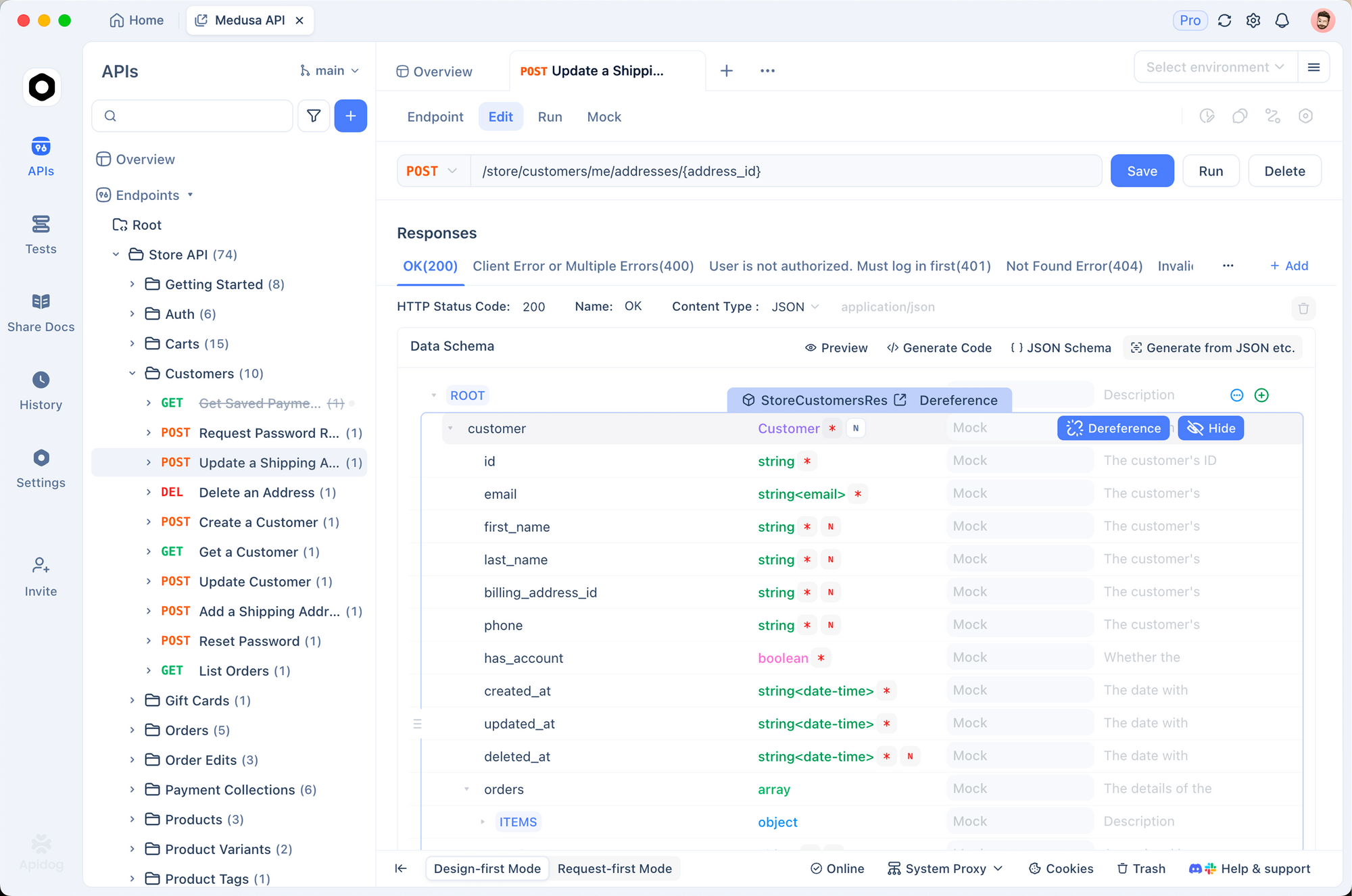

Wie verwende ich Apidog zum Testen der Wan 2.2 API mit LoRA?

Sie beginnen mit der Installation von Apidog und der Erstellung eines neuen API-Projekts. Importieren Sie die fal.ai-Endpunktdetails, stellen Sie die Methode auf POST und die URL auf den Text-zu-Video-LoRA-Pfad ein.

Fügen Sie Header zur Authentifizierung hinzu, wie z. B. Authorization: Key your_fal_key. Erstellen Sie im Body-Tab JSON mit Prompt- und LoRA-Parametern. Senden Sie die Anfrage und überprüfen Sie die Antwort, die den generierten Videolink enthält.

Apidogs Funktionen wie Umgebungsvariablen und Antwortvalidierung optimieren das Debugging. Sie speichern beispielsweise gängige LoRA-Konfigurationen als Sammlungen. Somit verbessert Apidog Ihren Workflow beim Testen der Wan 2.2 API (mit LoRA) und ermöglicht schnelle Iterationen.

Welche Parameter sollten Sie in der Wan 2.2 API mit LoRA optimieren?

Sie passen wichtige Parameter an, um die Ausgaben zu optimieren. Setzen Sie num_inference_steps auf 27 für ein Gleichgewicht oder höher für Qualität. Guidance-Skalen wie 3.5 beeinflussen die Einhaltung der Prompts.

Für LoRA passen Sie die scale zwischen 0,5 und 1,0 an, um die Adapterstärke zu steuern. Zu den Auflösungsoptionen gehört 720p, während die FPS-Bereiche von 4 bis 60 reichen. Aktivieren Sie die Beschleunigung für schnellere Generierungen, obwohl dies die Wiedergabetreue verringern kann.

Verwenden Sie zusätzlich negative Prompts, um unerwünschte Elemente zu vermeiden. Diese Optimierungen verfeinern die Wan 2.2 API (mit LoRA) und passen sie an spezifische Projektanforderungen an.

Wie gehe ich mit multimodalen Eingaben in Wan 2.2 mit LoRA um?

Sie integrieren Bilder oder Audio, indem Sie --image oder --audio in lokalen Skripten oder entsprechende Felder in gehosteten APIs angeben. Wenden Sie LoRA an, um diese zu verbessern, z. B. durch das Stylen von I2V-Ausgaben.

In fal.ai fügen Sie image_url für TI2V-Modi hinzu. LoRA passt die Fusion an und sorgt für kohärente Videos. Daher erstellen Sie dynamische Inhalte wie animierte Charaktere und nutzen so das volle Potenzial der Wan 2.2 API (mit LoRA).

Was sind fortgeschrittene Optimierungstechniken für die Wan 2.2 Inferenz?

Sie verwenden Speicheroptimierungen wie Modell-Offloading und Dtype-Konvertierung, um auf begrenzter Hardware zu laufen. Für Multi-GPU verteilt FSDP Shards effizient.

In gehosteten Setups stellen Sie asynchrone Anfragen in eine Warteschlange, um Batches zu verarbeiten. Verwenden Sie Prompt-Erweiterung mit LLMs, um Eingaben zu bereichern. Diese Techniken beschleunigen die Wan 2.2 API (mit LoRA) und machen sie für Echtzeitanwendungen geeignet.

Wie integriere ich die Wan 2.2 API mit LoRA in Anwendungen?

Sie erstellen Anwendungen, indem Sie API-Aufrufe in Backend-Diensten wrappen. Erstellen Sie beispielsweise einen Node.js-Server, der fal.ai-Anfragen proxyt und LoRA basierend auf Benutzereingaben hinzufügt.

Verarbeiten Sie Webhooks für langlaufende Aufgaben und benachrichtigen Sie Benutzer bei Abschluss. Integrieren Sie Frontends für interaktive Videogenerierung. Diese Integration bettet die Wan 2.2 API (mit LoRA) in Tools wie Content-Plattformen ein.

Welche Beispiele zeigen Wan 2.2 mit LoRA in Aktion?

Erwägen Sie die Generierung einer Cyberpunk-Szene: Verwenden Sie den Prompt "Neonbeleuchtete Straßen mit fliegenden Autos" und ein LoRA, das auf dystopische Kunst trainiert wurde. Die Ausgabe liefert stilisierte Videos mit verbesserten Details.

Ein weiteres Beispiel: Trainieren Sie LoRA auf Tanzbewegungen für S2V, um Audio mit Choreografie zu synchronisieren. Diese Fälle veranschaulichen die praktischen Anwendungen der Wan 2.2 API (mit LoRA).

Wie behebe ich häufige Probleme mit der Wan 2.2 API und LoRA?

Sie beheben Out-of-Memory-Fehler, indem Sie Offload-Flags aktivieren oder die Auflösung reduzieren. Wenn LoRA Instabilität verursacht, verringern Sie die Skalen oder trainieren Sie mit stabilen Datensätzen neu.

Bei API-Fehlern überprüfen Sie die Authentifizierung und die Gültigkeit der Parameter in Apidog. Netzwerkprobleme erfordern eine Wiederholungslogik. So lösen Sie Probleme effizient und gewährleisten einen reibungslosen Betrieb mit der Wan 2.2 API (mit LoRA).

Welche zukünftigen Entwicklungen könnten Wan 2.2 mit LoRA beeinflussen?

Forscher treiben die Entwicklung von Diffusionsmodellen weiter voran und könnten effizientere LoRA-Varianten integrieren. Community-Beiträge könnten native LoRA-Unterstützung zu offiziellen Skripten hinzufügen.

Gehostete Dienste könnten Modalitäten erweitern. Auf dem Laufenden zu bleiben stellt sicher, dass Sie die Entwicklungen in der Wan 2.2 API (mit LoRA) nutzen.

Fazit

Sie haben nun ein umfassendes Verständnis für den Zugriff und die Verwendung der Wan 2.2 API (mit LoRA). Von lokalen Setups bis hin zu gehosteten APIs und mit Tools wie Apidog generieren Sie beeindruckende Videos. Wenden Sie diese Techniken an, um Innovationen in der KI-gesteuerten Inhaltserstellung voranzutreiben.