OpenAIs Sora 2 zeichnet sich als leistungsstarkes Tool aus, das Text-Prompts mit fortschrittlicher Audiosynchronisation kombiniert, um realistische Clips zu erstellen. Entwickler suchen häufig nach Möglichkeiten, diese Technologie zu nutzen und dabei visuelle Ablenkungen wie Wasserzeichen zu vermeiden, die von professionellen Anwendungen ablenken können. Glücklicherweise bietet die Verwendung der Sora 2 API einen Weg zu saubereren Ausgaben, insbesondere wenn sie mit robusten API-Management-Tools integriert wird.

Button

Dieser Artikel beleuchtet die technischen Aspekte von Sora 2, wobei der Schwerpunkt auf der API-Nutzung und Strategien zur Entfernung von Wasserzeichen liegt. Sie erfahren, wie Sie Ihre Umgebung einrichten, API-Aufrufe ausführen und Nachbearbeitungsmethoden anwenden. Darüber hinaus enthält der Leitfaden praktische Beispiele und Optimierungstipps zur Verbesserung Ihrer Projekte.

Sora 2 und seine Funktionen verstehen

OpenAI veröffentlichte Sora 2 am 30. September 2025, was einen bedeutenden Fortschritt in der Videogenerierungstechnologie darstellt. Dieses Modell baut auf dem ursprünglichen Sora auf, indem es genauere Physiksimulationen, realistische Animationen und synchronisiertes Audio integriert. Zum Beispiel rendert Sora 2 komplexe Szenarien wie einen Basketball, der vom Brett abprallt, oder eine Turnerin, die komplizierte Routinen ausführt, präzise. Entwickler nutzen diese Funktionen, um dynamische Inhalte für Anwendungen in Unterhaltung, Bildung und Marketing zu erstellen.

Sora 2 arbeitet als diffusionsbasiertes Modell, das Text-Prompts in Videos von bis zu 20 Sekunden Länge umwandelt, mit Auflösungen von bis zu 1080p in höheren Stufen. Es unterstützt Stile, die von filmischem Realismus bis hin zu Anime-Ästhetik reichen. Offizielle Ausgaben der Sora-App und -Website enthalten jedoch oft sichtbare Wasserzeichen, um die KI-Generierung gemäß den verantwortungsvollen KI-Richtlinien von OpenAI anzuzeigen. Diese Wasserzeichen erscheinen als bewegliche Überlagerungen oder eingebettete Metadaten, was die Verwendbarkeit in kommerziellen Umgebungen einschränken kann.

Beim Übergang zur API-Version bietet Sora 2 größere Flexibilität. Die API, die Entwicklern als Vorschau zur Verfügung steht, ermöglicht den programmatischen Zugriff auf Generierungs-Endpunkte ohne die Einschränkungen der Consumer-App. Sie greifen über die Plattform von OpenAI darauf zu, wofür ein API-Schlüssel und möglicherweise ein Pro-Abonnement für erweiterte Funktionen wie höhere Auflösungen und keine integrierten Wasserzeichen in bestimmten Konfigurationen erforderlich sind. Laut Entwicklerdokumentation konzentrieren sich die API-Endpunkte auf Text-zu-Video-Anfragen, bei denen Sie Parameter wie Prompt, Dauer und Stil angeben.

Plattformen wie Replicate und ComfyUI bieten gehostete Versionen der Sora 2 API an, die über ihre Schnittstellen wasserzeichenfreie Ausgaben ermöglichen. Diese Alternativen lassen sich nahtlos in Tools wie Apidog integrieren, das die Authentifizierung und Anforderungsformatierung übernimmt. Durch die Verwendung der API umgehen Sie die standardmäßige Wasserzeichen-Anwendung in der kostenlosen App-Ebene, obwohl einige Implementierungen immer noch Metadaten einbetten. Dennoch ermöglicht Ihnen dieser Ansatz, saubere Videos zu generieren, die auf Ihre Bedürfnisse zugeschnitten sind.

Zugriff auf die Sora 2 API: Voraussetzungen und Einrichtung

Bevor Sie Videos generieren können, müssen Sie den Zugriff auf die Sora 2 API sicherstellen. OpenAI stellt die API-Verfügbarkeit für Entwickler mit aktiven Konten bereit, wobei oft diejenigen mit Pro- oder Unternehmensabonnements priorisiert werden. Melden Sie sich zunächst auf der OpenAI-Entwicklerplattform unter platform.openai.com an. Dort erstellen Sie einen API-Schlüssel im Bereich "API keys". Stellen Sie sicher, dass Ihr Konto die Anforderungen für den Sora 2-Vorschauzugriff erfüllt, was das Beitreten einer Warteliste oder die Überprüfung Ihres Anwendungsfalls beinhalten kann.

Nach der Genehmigung konfigurieren Sie Ihre Entwicklungsumgebung. Installieren Sie die notwendigen Bibliotheken, wie das OpenAI Python SDK, mithilfe von pip: pip install openai. Diese Bibliothek vereinfacht API-Interaktionen. Für JavaScript-Benutzer bietet das Node.js-Paket ähnliche Funktionen. Wenn Sie sich für Drittanbieter-Hosts wie Replicate entscheiden, registrieren Sie sich auf deren Website und erhalten Sie ein API-Token.

Sicherheit spielt hier eine entscheidende Rolle. Speichern Sie Ihren API-Schlüssel immer in Umgebungsvariablen, anstatt ihn fest zu codieren, um eine Offenlegung zu verhindern. Verwenden Sie beispielsweise in Python os.environ['OPENAI_API_KEY'] = 'your-key'. Diese Praxis schützt Ihre Anmeldeinformationen bei kollaborativen Projekten.

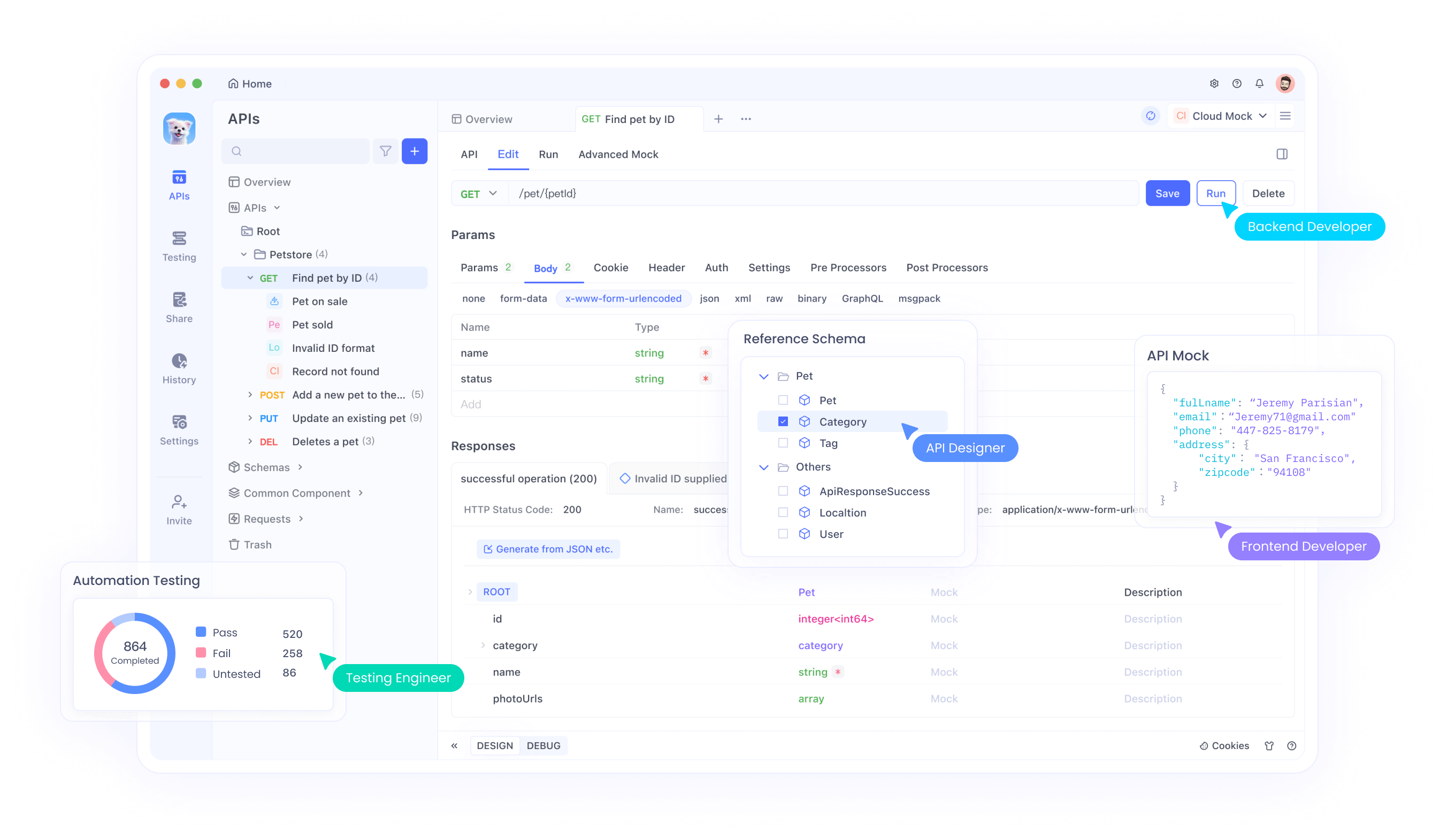

Integrieren Sie nun Apidog in Ihr Setup. Als umfassender API-Client zeichnet sich Apidog durch das Testen und Dokumentieren von OpenAI-Endpunkten, einschließlich Sora 2, aus. Laden Sie Apidog von der offiziellen Website herunter und installieren Sie es. Erstellen Sie nach dem Start ein neues Projekt und importieren Sie die OpenAI API-Spezifikation, indem Sie die OpenAPI-Schema-URL einfügen oder eine JSON-Datei hochladen. Apidog generiert automatisch Endpunkte für Modelle wie Sora 2, sodass Sie Anfragen mit Parametern wie Modellname ("sora-2") und Eingabe-Prompts anpassen können.

Die Oberfläche von Apidog ähnelt Postman, bietet aber erweiterte Funktionen wie automatisiertes Testen und Mocking. Sie fügen Ihren API-Schlüssel dem Autorisierungs-Header hinzu, typischerweise als Bearer-Token. Testen Sie einen einfachen Endpunkt, wie die Modellliste, um die Konnektivität zu überprüfen: Senden Sie eine GET-Anfrage an /v1/models und bestätigen Sie, dass Sora 2 in der Antwort erscheint. Dieser Schritt stellt sicher, dass Ihr Setup korrekt funktioniert, bevor Sie mit der Videogenerierung fortfahren.

Apidog für Sora 2 API-Anfragen konfigurieren

Mit Ihrer vorbereiteten Umgebung tauchen Sie in die Funktionen von Apidog für Sora 2 ein. Erstellen Sie eine neue API-Sammlung, die der Videogenerierung gewidmet ist. Fügen Sie darin eine POST-Anfrage an den Sora 2-Endpunkt hinzu, der normalerweise /v1/video/generations oder ähnlich lautet, basierend auf der OpenAI-Dokumentation. Stellen Sie den Anfragetext auf JSON-Format ein.

Wichtige Parameter sind:

model: Geben Sie "sora-2" an, um die neueste Version aufzurufen.prompt: Eine detaillierte Textbeschreibung, z.B. "Eine Katze, die einen dreifachen Axel auf dem Eis mit synchronisiertem Miauen ausführt."duration: In Sekunden, bis zu 20.resolution: Optionen wie "720p" oder "1080p" für Pro-Benutzer.style: "realistisch", "filmisch" oder "Anime".

Apidog ermöglicht es Ihnen, diese für die Wiederverwendbarkeit zu parametrisieren. Verwenden Sie beispielsweise Variablen wie {{prompt}}, um schnell mehrere Szenarien zu testen. Aktivieren Sie außerdem Umgebungsvariablen, um zwischen Test- und Produktions-API-Schlüsseln zu wechseln.

Um asynchrone Antworten zu verarbeiten – da die Videogenerierung Minuten dauern kann – konfigurieren Sie Webhooks oder Polling in Apidog. Richten Sie ein Skript ein, um den Generierungsstatus über eine GET-Anfrage an den Job-ID-Endpunkt zu überprüfen. Diese Automatisierung spart Zeit und stellt sicher, dass Sie abgeschlossene Videos effizient abrufen.

Darüber hinaus unterstützt Apidog Skripte mit JavaScript für Aktionen vor und nach der Anfrage. Schreiben Sie ein Skript, um die Länge des Prompts vor dem Senden zu validieren und Fehler zu vermeiden. Zum Beispiel:

if (pm.variables.get('prompt').length > 1000) {

throw new Error('Prompt zu lang');

}

Diese technische Schutzmaßnahme erhöht die Zuverlässigkeit. Sobald konfiguriert, senden Sie Ihre erste Anfrage und überwachen Sie die Antwort, die typischerweise eine Video-URL oder eine base64-kodierte Datei enthält.

Videos mit der Sora 2 API generieren: Schritt-für-Schritt-Beispiele

Sie führen nun tatsächliche Generierungen aus. Beginnen Sie mit einem einfachen Prompt, um die Grundlagen zu testen. Füllen Sie in Apidog den Body aus:

{

"model": "sora-2",

"prompt": "Eine belebte Stadtstraße in der Dämmerung mit Fußgängern und Autos, inklusive Umgebungsgeräuschen der Straße.",

"duration": 10,

"resolution": "720p"

}

Senden Sie die Anfrage. Die API verarbeitet sie und gibt eine Job-ID zurück. Fragen Sie den Status-Endpunkt alle 10 Sekunden ab, bis "completed" (abgeschlossen) zurückgegeben wird. Rufen Sie die Video-URL aus der Antwort ab.

Für fortgeschrittene Anwendungen integrieren Sie Cameos – eine Funktion, die reale Elemente wie das Abbild einer Person ermöglicht. Laden Sie ein Referenzvideo über eine Multipart-Formularanfrage in Apidog hoch. Der Body könnte so aussehen:

{

"model": "sora-2",

"prompt": "Die hochgeladene Person hält einen TED-Vortrag über KI.",

"cameo_video": "base64-encoded-video",

"audio_sync": true

}

Apidog verarbeitet Dateiuploads nativ, was dies nahtlos macht.

Ausgaben können jedoch immer noch Wasserzeichen enthalten, wenn Sie die Standardstufe verwenden. Der Pro-API-Zugriff, der ChatGPT Pro-Abonnenten zur Verfügung steht, bietet oft Optionen für wasserzeichenfreie Downloads. Überprüfen Sie Ihr Abonnementlevel; ein Upgrade schaltet dies frei.

Um Prompts zu optimieren, experimentieren Sie mit Details. Fügen Sie physikalische Beschreibungen wie "schwerkrafttrotzender Sprung" hinzu, um die Simulationsstärken von Sora 2 zu nutzen. Verfolgen Sie Nutzungsmetriken in den Apidog-Analysen, um innerhalb der Ratenbegrenzungen zu bleiben, die typischerweise 500 Generierungen pro Monat für den bevorzugten Zugriff betragen.

Strategien zur Entfernung von Wasserzeichen aus Sora 2 Videos

Selbst mit API-Zugriff enthalten einige Videos Wasserzeichen. Sie können dies durch Nachbearbeitung beheben. Zuerst müssen Sie die Arten von Wasserzeichen verstehen: sichtbare Überlagerungen (bewegliche Logos) und unsichtbare Metadaten (C2PA-Standards).

Für die sichtbare Entfernung verwenden Sie KI-basierte Tools. Vmake AI, ein kostenloser Online-Dienst, nutzt Deep Learning, um bewegliche Wasserzeichen zu erkennen und zu entfernen. Laden Sie Ihr Sora 2 Video hoch, wählen Sie den Wasserzeichenbereich aus und verarbeiten Sie es. Das Tool bewahrt die Qualität, indem es entfernte Bereiche mit kontextuellen Pixeln "inpainting" (auffüllt).

Alternativ können Sie Open-Source-Bibliotheken wie OpenCV in Python verwenden. Laden Sie das Video:

import cv2

cap = cv2.VideoCapture('sora_video.mp4')

width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

out = cv2.VideoWriter('clean_video.mp4', cv2.VideoWriter_fourcc(*'mp4v'), fps, (width, height))

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# Wasserzeichen erkennen und maskieren (benutzerdefinierte Logik, z.B. ROI-Zuschneiden oder ML-Modell)

clean_frame = remove_watermark(frame) # Funktion implementieren

out.write(clean_frame)

cap.release()

out.release()

Implementieren Sie remove_watermark mithilfe eines vortrainierten Modells von Hugging Face, z.B. einem Segmentierungsnetzwerk, das auf Wasserzeichen-Datensätzen trainiert wurde.

Für Metadaten entfernen Sie C2PA-Tags mit FFmpeg: ffmpeg -i input.mp4 -codec copy -bsf:v "filter_units=remove_types=6" output.mp4. Dieser Befehl entfernt spezifische Bitstream-Filter ohne Neukodierung.

Beachten Sie jedoch die rechtlichen Auswirkungen. Die Bedingungen von OpenAI verbieten das Manipulieren von Herkunftssignalen, aber für den internen Gebrauch oder wo erlaubt, gelten diese Methoden. Geben Sie KI-generierte Inhalte immer ethisch korrekt an.

Integrieren Sie dies in Apidog-Workflows, indem Sie die Nachbearbeitung über Skripte automatisieren. Nach dem Abrufen der Video-URL laden Sie den Entfernungscode herunter und führen ihn aus.

Fortgeschrittene Techniken zur Sora 2 API-Optimierung

Um Ihre Nutzung zu verbessern, verketten Sie mehrere API-Aufrufe. Generieren Sie ein Basisvideo und remixen Sie es dann mit einem Folge-Prompt: "Erweitern Sie die vorherige Szene mit einer dramatischen Wendung." Verwenden Sie die Job-ID als Referenz in nachfolgenden Anfragen.

Zusätzlich integrieren Sie Audioverbesserungen. Sora 2 synchronisiert Soundeffekte automatisch, aber Sie können dies feinabstimmen, indem Sie "orchestrale Hintergrundmusik einbeziehen" in den Prompts angeben.

Leistungsoptimierung beinhaltet das Batching von Anfragen. Apidog unterstützt Sammlungen zum gleichzeitigen Ausführen mehrerer Tests, ideal für A/B-Prompting-Experimente.

Überwachen Sie außerdem die Kosten. Die Sora 2 API-Preise beginnen bei 0,05 $ pro Videosekunde für die Standardversion, wobei Pro für Premium-Funktionen höhere Tarife hat. Verfolgen Sie dies über das OpenAI-Dashboard und richten Sie Benachrichtigungen in Apidog ein.

Für Skalierbarkeit stellen Sie in Produktionsumgebungen bereit. Verwenden Sie Cloud-Funktionen wie AWS Lambda, um API-Aufrufe zu verarbeiten, die durch Benutzereingaben ausgelöst werden. Sichern Sie diese mit API-Gateways.

Best Practices und Fehlerbehebung für Sora 2 mit Apidog

Wenden Sie diese Praktiken an, um die Effizienz zu maximieren. Validieren Sie zunächst die Eingaben streng – schlechte Prompts führen zu minderwertigen Videos. Verwenden Sie die Assertions-Tests von Apidog, um die Statuscodes der Antwort zu überprüfen (200 für Erfolg).

Beheben Sie häufige Probleme: Wenn die Authentifizierung fehlschlägt, generieren Sie Ihren Schlüssel neu. Für Ratenbegrenzungen implementieren Sie exponentielles Backoff in Skripten:

import time

def api_call_with_retry(func, max_retries=5):

for attempt in range(max_retries):

try:

return func()

except Exception as e:

if 'rate_limit' in str(e):

time.sleep(2 ** attempt)

else:

raise

Netzwerkfehler? Wechseln Sie zu den Proxy-Einstellungen von Apidog.

Darüber hinaus arbeiten Sie zusammen, indem Sie Apidog-Projekte über Links teilen, um die Teamabstimmung bei Sora 2-Konfigurationen sicherzustellen.

Fallstudien: Reale Anwendungen von wasserzeichenfreiem Sora 2

Stellen Sie sich eine Marketingfirma vor, die die Sora 2 API verwendet, um Werbeclips zu erstellen. Sie generieren Videos ohne Wasserzeichen für Kundenpräsentationen und integrieren Apidog für schnelle Iterationen.

Im Bildungsbereich erstellen Lehrer animierte Lektionen. Nach der Entfernung lassen sich die Videos sauber in Plattformen wie YouTube einbetten.

Diese Beispiele veranschaulichen die Vielseitigkeit von Sora 2, wenn es nicht durch Wasserzeichen behindert wird.

Zukunftsaussichten und Updates für die Sora 2 API

OpenAI entwickelt Sora 2 ständig weiter, mit geplanten Erweiterungen wie längeren Dauern und besseren Integrationen. Bleiben Sie über deren Blog auf dem Laufenden.

Apidog fügt regelmäßig Funktionen hinzu, wie die KI-gestützte Anfragengenerierung, die die Fortschritte von Sora 2 ergänzen.

Zusammenfassend lässt sich sagen, dass das Beherrschen von Sora 2 ohne Wasserzeichen den API-Zugriff, die Unterstützung durch Apidog und gezielte Entfernungstechniken erfordert. Implementieren Sie diese Schritte, um effizient Videos in professioneller Qualität zu produzieren.

Button