Für die KI-Industrie sind OCR-Fähigkeiten (Optical Character Recognition) für die Dokumentenverarbeitung, Datenextraktion und Automatisierungs-Workflows immer wichtiger geworden. Unter den heute verfügbaren Open-Source-Vision-Language-Modellen (VLMs) hat sich Qwen-2.5-72b als leistungsstarker Anwärter erwiesen, insbesondere für OCR-Aufgaben.

Dieses Tutorial untersucht, warum sich Qwen-2.5-72b als potenziell das beste Open-Source-Modell für OCR-Aufgaben auszeichnet, indem es seine Leistungsbenchmarks, technischen Fähigkeiten und die lokale Bereitstellung mit Ollama untersucht.

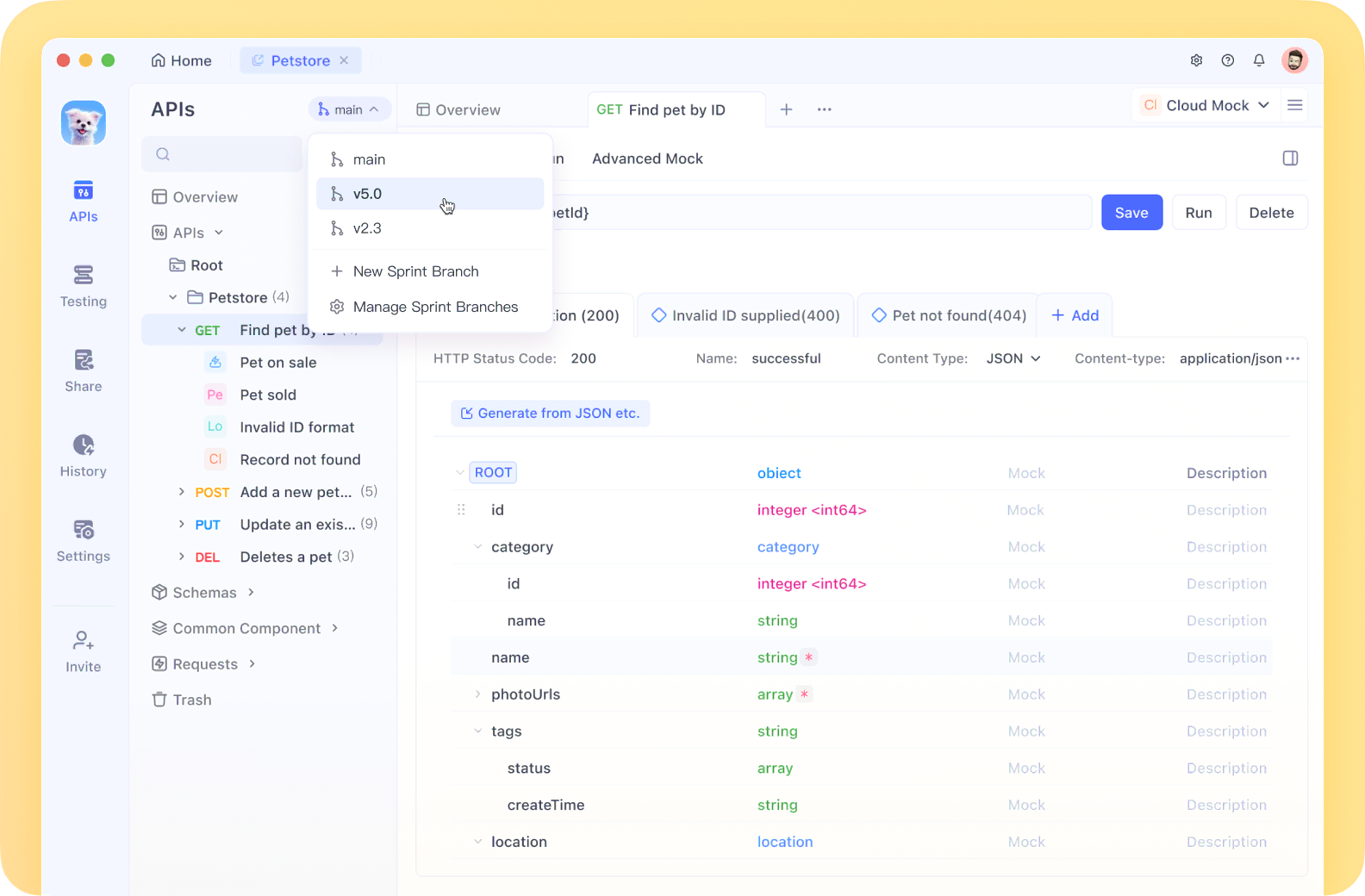

Mit seiner intuitiven Benutzeroberfläche und leistungsstarken Kollaborationsfunktionen rationalisiert Apidog den gesamten API-Entwicklungslebenszyklus und hilft Teams, effizienter zu arbeiten und gleichzeitig die Konsistenz über Projekte hinweg zu gewährleisten.

Egal, ob Sie ein einzelner Entwickler oder Teil eines großen Unternehmens sind, die nahtlose Workflow-Integration und das robuste Toolset von Apidog machen es zum perfekten Begleiter für die moderne API-Entwicklung.

Qwen-2.5 Models Benchmarks: Ein kurzer Überblick

Qwen-2.5 repräsentiert die neueste Serie großer Sprachmodelle von Alibaba Cloud, die im September 2024 veröffentlicht wurde. Es ist eine bedeutende Weiterentwicklung gegenüber seinem Vorgänger, Qwen-2, mit mehreren wichtigen Verbesserungen:

- Vortrainiert auf einem riesigen Datensatz von bis zu 18 Billionen Tokens

- Erweiterte Wissenskapazität und Domänenexpertise

- Überlegene Fähigkeiten zur Befolgung von Anweisungen

- Erweiterte Verarbeitung langer Texte (bis zu 8K Token-Generierung)

- Verbessertes Verständnis strukturierter Daten und Generierung von Ausgaben

- Unterstützung für Kontextlängen von bis zu 128K Tokens

- Mehrsprachige Unterstützung in 29 Sprachen

Die Qwen-2.5-Familie umfasst Modelle von 0,5B bis 72B Parametern. Für OCR-Aufgaben liefert das größte 72B-Modell die beeindruckendste Leistung, obwohl die 32B-Variante ebenfalls außergewöhnlich gut abschneidet.

Warum Qwen-2.5-72B das beste Open-Source-OCR-Modell ist

Benchmark-Ergebnisse

Laut umfassenden Benchmarks, die von OmniAI durchgeführt wurden und Open-Source-Modelle für OCR bewerteten, zeigten Qwen-2.5-VL-Modelle (sowohl 72B- als auch 32B-Varianten) bemerkenswerte Leistungen:

- Genauigkeit: Beide Qwen-2.5-VL-Modelle erreichten bei JSON-Extraktionsaufgaben aus Dokumenten eine Genauigkeit von etwa 75 % und entsprachen damit der Leistung von GPT-4o.

- Wettbewerbsvorteil: Qwen-2.5-VL-Modelle übertrafen mistral-ocr (72,2 %), das speziell für OCR-Aufgaben trainiert wurde.

- Überlegene Leistung: Sie übertrafen andere beliebte Open-Source-Modelle, darunter Gemma-3 (27B), das nur eine Genauigkeit von 42,9 % erreichte, und Llama-Modelle, deutlich.

Was dies besonders beeindruckend macht, ist, dass Qwen-2.5-VL-Modelle nicht ausschließlich für OCR-Aufgaben entwickelt wurden, aber dennoch spezialisierte OCR-Modelle übertrafen. Dies zeigt ihre vielseitigen und robusten Fähigkeiten zur Bildverarbeitung.

Wichtige Vorteile für OCR-Aufgaben

Mehrere Faktoren tragen zur außergewöhnlichen OCR-Leistung von Qwen-2.5-72b bei:

- Erweiterte Verarbeitung strukturierter Daten: Qwen-2.5-Modelle zeichnen sich durch das Verständnis strukturierter Datenformate wie Tabellen und Formulare aus, die in Dokumenten, die OCR erfordern, üblich sind.

- Verbesserte JSON-Ausgabegenerierung: Das Modell wurde speziell optimiert, um strukturierte Ausgaben in Formaten wie JSON zu generieren, was für die Extraktion und Organisation von Informationen aus gescannten Dokumenten entscheidend ist.

- Großes Kontextfenster: Mit Kontextunterstützung von bis zu 128K Tokens kann das Modell ganze Dokumente oder mehrere Seiten gleichzeitig verarbeiten und dabei Kohärenz und kontextuelles Verständnis beibehalten.

- Mehrsprachige OCR-Fähigkeiten: Die Unterstützung von 29 Sprachen macht es vielseitig für internationale Dokumentenverarbeitungsanforderungen.

- Visuell-textuelle Integration: Das 72B-Modell nutzt seine enorme Parameteranzahl, um visuelle Elemente besser mit dem Textverständnis zu verbinden und das Verständnis von Dokumentenlayouts, Tabellen und gemischten Text-Bild-Inhalten zu verbessern.

- Resistenz gegen Dokumentenvariationen: Das Modell arbeitet konsistent über verschiedene Dokumenttypen, -qualitäten und -formate hinweg und demonstriert robuste OCR-Fähigkeiten in realen Szenarien.

Qwen-2.5-72b lokal mit Ollama ausführen

Ollama bietet eine einfache Möglichkeit, große Sprachmodelle lokal auszuführen, einschließlich Qwen-2.5-72b. Hier ist eine Schritt-für-Schritt-Anleitung zur Bereitstellung dieses leistungsstarken OCR-Modells auf Ihrem eigenen Rechner:

Systemanforderungen

Bevor Sie fortfahren, stellen Sie sicher, dass Ihr System diese Mindestanforderungen erfüllt:

- RAM: 64 GB+ empfohlen (47 GB Modellgröße plus Overhead)

- GPU: NVIDIA GPU mit mindestens 48 GB VRAM für volle Präzision oder 24 GB+ mit Quantisierung

- Speicher: Mindestens 50 GB freier Speicherplatz für das Modell und temporäre Dateien

- Betriebssystem: Linux, macOS oder Windows (mit WSL2)

Installationsschritte

Ollama installieren

Besuchen Sie ollama.com/download und laden Sie die entsprechende Version für Ihr Betriebssystem herunter. Befolgen Sie die Installationsanweisungen.

Das Qwen-2.5-72b-Modell abrufen

Öffnen Sie ein Terminal oder eine Eingabeaufforderung und führen Sie Folgendes aus:

ollama pull qwen2.5:72b

Dadurch wird das Modell heruntergeladen, das mit Q4_K_M-Quantisierung etwa 47 GB groß ist. Der Download kann je nach Ihrer Internetverbindung einige Zeit dauern.

Das Modell starten

Nach dem Herunterladen können Sie das Modell mit Folgendem starten:

ollama run qwen2.5:72b

Verwendung des Modells für OCR-Aufgaben

Sie können direkt über die Befehlszeile mit dem Modell interagieren oder die Ollama-API für komplexere Anwendungen verwenden. Für OCR-Aufgaben müssen Sie Bilder an das Modell senden.

API-Integration für OCR-Aufgaben

So verwenden Sie Qwen-2.5-72b für OCR über die Ollama-API:

Starten Sie den Ollama-Server

Wenn er noch nicht ausgeführt wird, starten Sie den Ollama-Dienst.

Richten Sie eine API-Anfrage ein

Hier ist ein Python-Beispiel mit der requests-Bibliothek:

import requests

import base64

# Funktion zum Codieren des Bildes

def encode_image(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

# Pfad zu Ihrem Dokumentbild

image_path = "path/to/your/document.jpg"

base64_image = encode_image(image_path)

# Konstruieren Sie die API-Anfrage

api_url = "<http://localhost:11434/api/generate>"

payload = {

"model": "qwen2.5:72b",

"prompt": "Extrahiere Text aus diesem Dokument und formatiere ihn als JSON.",

"images": [base64_image],

"stream": False

}

# Senden Sie die Anfrage

response = requests.post(api_url, json=payload)

result = response.json()

# Drucken Sie den extrahierten Text

print(result['response'])

Optimieren Sie OCR-Prompts

Verwenden Sie für bessere OCR-Ergebnisse spezifische Prompts, die auf Ihren Dokumenttyp zugeschnitten sind:

- Für Rechnungen: "Extrahiere alle Rechnungsdetails einschließlich Rechnungsnummer, Datum, Lieferant, Einzelpositionen und Gesamtbeträge als strukturiertes JSON."

- Für Formulare: "Extrahiere alle Felder und ihre Werte aus diesem Formular und formatiere sie als JSON."

- Für Tabellen: "Extrahiere diese Tabellendaten und konvertiere sie in eine JSON-Array-Struktur."

Erweiterte OCR-Workflows

Für anspruchsvollere OCR-Workflows können Sie Qwen-2.5-72b mit Vorverarbeitungstools kombinieren:

- Dokumentenvorverarbeitung

- Verwenden Sie OpenCV oder andere Bildverarbeitungsbibliotheken, um Dokumentenbilder zu verbessern

- Wenden Sie Deskewing, Kontrastverbesserung und Rauschunterdrückung an

2. Seitensegmentierung

- Teilen Sie mehrseitige Dokumente auf und verarbeiten Sie jede Seite einzeln

- Verwenden Sie das Kontextfenster des Modells, um die Kohärenz über die Seiten hinweg aufrechtzuerhalten

3. Nachbearbeitung

- Implementieren Sie Validierungs- und Bereinigungslogik für extrahierten Text

- Verwenden Sie reguläre Ausdrücke oder sekundäre LLM-Durchläufe, um häufige OCR-Fehler zu beheben

Optimierung der OCR-Leistung

Um die besten OCR-Ergebnisse von Qwen-2.5-72b zu erzielen, sollten Sie diese Best Practices berücksichtigen:

- Bildqualität ist wichtig: Stellen Sie Bilder mit der höchstmöglichen Auflösung innerhalb der API-Limits bereit.

- Seien Sie spezifisch in Prompts: Sagen Sie dem Modell genau, welche Informationen extrahiert werden sollen und in welchem Format.

- Nutzen Sie strukturierte Ausgabe: Nutzen Sie die JSON-Generierungsfunktionen des Modells, indem Sie explizit strukturierte Formate anfordern.

- Verwenden Sie Systemnachrichten: Richten Sie geeignete Systemnachrichten ein, um das OCR-Verhalten des Modells zu steuern.

- Temperatureinstellungen: Niedrigere Temperaturwerte (0,0-0,3) führen in der Regel zu genaueren OCR-Ergebnissen.

Fazit

Qwen-2.5-72b stellt einen bedeutenden Fortschritt in den Open-Source-OCR-Fähigkeiten dar. Seine außergewöhnliche Leistung in Benchmarks, die selbst spezialisierte OCR-Modelle übertrifft, macht es zu einer überzeugenden Wahl für Entwickler und Organisationen, die nach leistungsstarken Dokumentenverarbeitungslösungen suchen.

Die Kombination aus visuellem Verständnis, strukturierter Datenverarbeitung und mehrsprachigen Fähigkeiten des Modells schafft eine vielseitige OCR-Lösung, die verschiedene Dokumenttypen in verschiedenen Sprachen verarbeiten kann. Obwohl es erhebliche Rechenressourcen erfordert, rechtfertigen die Ergebnisse die Investition für viele Anwendungsfälle.

Durch die Nutzung von Ollama für die lokale Bereitstellung können Entwickler dieses leistungsstarke Modell einfach in ihre Workflows integrieren, ohne sich auf externe APIs verlassen zu müssen. Dies eröffnet Möglichkeiten für sichere, lokale Dokumentenverarbeitungslösungen, die die Datenprivatsphäre wahren und gleichzeitig modernste OCR-Leistung erbringen.

Egal, ob Sie eine automatisierte Dokumentenverarbeitungspipeline erstellen, Daten aus Formularen und Rechnungen extrahieren oder gedruckte Materialien digitalisieren, Qwen-2.5-72b bietet eine der leistungsfähigsten Open-Source-Lösungen, die heute für OCR-Aufgaben verfügbar sind.