Perplexity AI hat aufgrund seiner Konversations-KI-Fähigkeiten erhebliche Popularität erlangt, insbesondere seine Stärke bei der Bereitstellung aktueller, quellenbelegter Antworten durch die Integration von Echtzeit-Websuche in seine Antworten. Für Entwickler und Unternehmen, die diese leistungsstarken Modelle in ihren eigenen Anwendungen nutzen möchten, bietet Perplexity eine Application Programming Interface (API) an.

Die Perplexity AI API ermöglicht den programmgesteuerten Zugriff auf die großen Sprachmodelle (LLMs) von Perplexity, einschließlich ihrer Online-Modelle (wie sonar-small-online und sonar-medium-online), die das Web durchsuchen können, um Fragen zu beantworten, und ihrer Offline-Chat-Modelle (wie sonar-small-chat und sonar-medium-chat).

Dieses Tutorial untersucht zwei primäre Wege für die Interaktion mit dem Perplexity AI API-Ökosystem:

- Direkter Zugriff mit einem offiziellen Perplexity API-Schlüssel: Dies ist die Standardmethode von Perplexity. Während es möglicherweise eine sehr begrenzte kostenlose Testversion oder Einführungs-Credits gibt, erfordert eine dauerhafte oder volumenstarke Nutzung in der Regel ein Perplexity Pro-Abonnement oder spezielle Unternehmensvereinbarungen, um einen API-Schlüssel mit ausreichenden Credits zu erhalten und zu nutzen.

- Indirekter Zugriff über Drittanbieterdienste (OpenRouter): Plattformen wie OpenRouter fungieren als Aggregatoren und bieten über ihre eigene API-Infrastruktur Zugriff auf verschiedene LLMs, einschließlich der Modelle von Perplexity. Dies kann eine alternative Möglichkeit sein, Perplexity-Modelle zu verwenden, möglicherweise ohne ein direktes Perplexity Pro-Abonnement zu benötigen, obwohl Ihnen weiterhin Kosten durch den Drittanbieter entstehen.

Wir werden auch die Situation in Bezug auf Groq, eine weitere beliebte Inferenzplattform, und ihre Beziehung (oder das Fehlen derselben) zu den proprietären Modellen von Perplexity klären.

Zugriff auf die offizielle Perplexity AI API mit einem Pro-Konto

Dieser Abschnitt beschreibt, wie Sie die offizielle API verwenden, die direkt von Perplexity bereitgestellt wird. Diese Methode bietet in der Regel den direktesten Zugriff und möglicherweise die neuesten Funktionen oder Modelle, erfordert aber in der Regel ein kostenpflichtiges Perplexity-Abonnement (Pro) für eine sinnvolle Nutzung über die erste Erkundung hinaus.

Voraussetzungen:

- Ein Perplexity-Konto.

- Ein Perplexity Pro-Abonnement (in der Regel für den wesentlichen API-Zugriff und die Schlüsselgenerierung erforderlich).

- Grundlegendes Verständnis von REST-APIs und wie man HTTP-Anfragen stellt (mit Tools wie

curloder Programmiersprachen wie Python).

Schritt 1: Abrufen Ihres offiziellen Perplexity AI API-Schlüssels

- Melden Sie sich bei Perplexity an: Gehen Sie auf die Perplexity-Website (

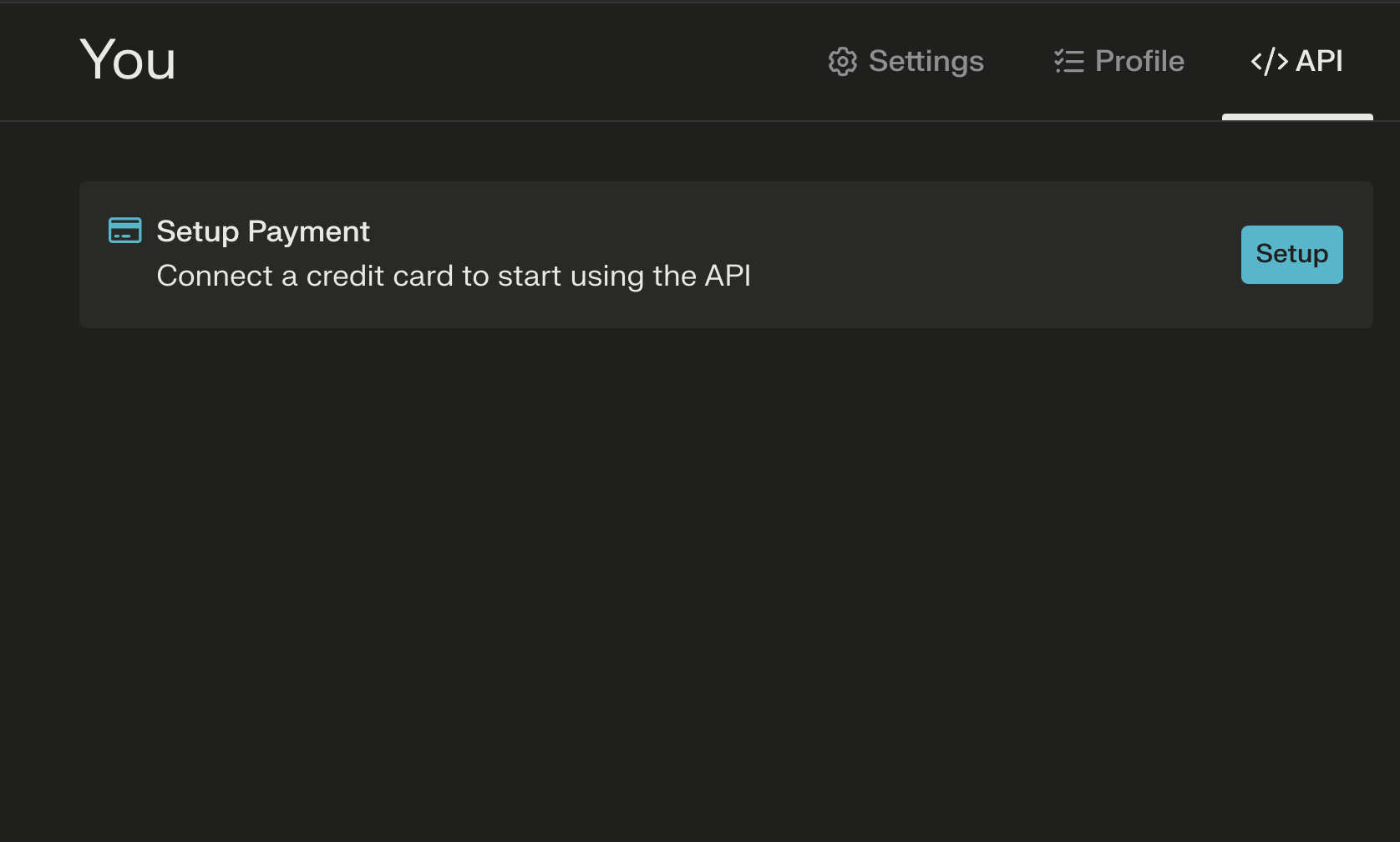

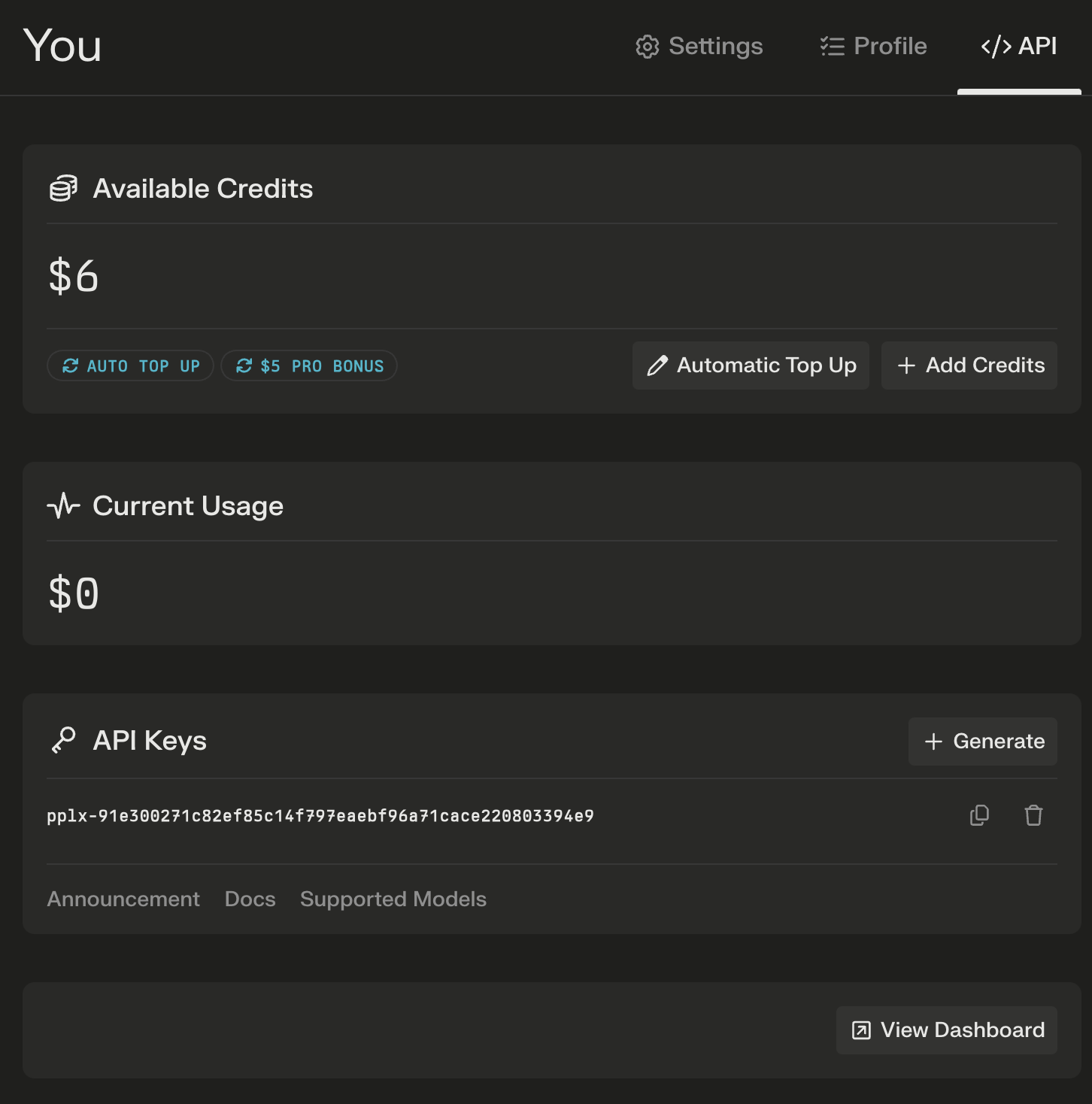

perplexity.ai) und melden Sie sich bei Ihrem Konto an. Stellen Sie sicher, dass es auf Pro aktualisiert wurde, falls dies für die API-Schlüsselgenerierung/-verwendung erforderlich ist. - Richten Sie eine Zahlungsmethode ein: Suchen Sie nach Kontoeinstellungen, Profiloptionen oder einem dedizierten "API"-Bereich in Ihrem Perplexity-Dashboard. Der genaue Ort kann sich ändern, befindet sich aber in der Regel unter Ihrem Kontoverwaltungsbereich.

3. API-Schlüssel generieren: In den API-Einstellungen sollten Sie eine Option zum Generieren eines neuen API-Schlüssels finden. Klicken Sie auf diese Schaltfläche.

4. Kopieren und Sichern Ihres Schlüssels: Perplexity generiert eine eindeutige alphanumerische Zeichenfolge. Dies ist Ihr API-Schlüssel. Behandeln Sie diesen Schlüssel wie ein Passwort. Teilen Sie ihn nicht öffentlich mit oder übertragen Sie ihn direkt in Ihre Code-Repositories. Speichern Sie ihn sicher, z. B. mithilfe von Umgebungsvariablen oder einem System zur Geheimnisverwaltung.

Schritt 2: Verstehen des Perplexity AI API-Endpunkts

Der primäre Endpunkt für die Interaktion mit den Chat-Modellen von Perplexity über die API lautet:

https://api.perplexity.ai/chat/completions

Dieser Endpunkt folgt einer Struktur, die der API von OpenAI ähnelt, was ihn für Entwickler, die mit anderen LLM-APIs gearbeitet haben, relativ vertraut macht.

Schritt 3: Auswählen eines Perplexity AI API-Modells

Perplexity bietet über seine API mehrere Modelle an. Sie müssen angeben, welches Modell Sie in Ihrer API-Anfrage verwenden möchten. Häufige Modelle sind:

Online-Modelle (mit Websuche):

sonar-small-onlinesonar-medium-online- (Zuvor

pplx-7b-online,pplx-70b-online- aktuelle Dokumentation für verfügbare Modelle prüfen)

Chat-Modelle (ohne Websuche):

sonar-small-chatsonar-medium-chat- (Zuvor

pplx-7b-chat,pplx-70b-chat- aktuelle Dokumentation prüfen) - Andere spezialisierte oder ältere Modelle sind möglicherweise ebenfalls verfügbar. Beziehen Sie sich immer auf die offizielle Perplexity API-Dokumentation, um die aktuellste Liste der Modelle und ihrer Fähigkeiten zu erhalten.

Schritt 4: Stellen Ihrer ersten Perplexity AI API-Anfrage

Sie können mit der API mit verschiedenen Tools oder Programmiersprachen interagieren. Hier sind Beispiele mit curl (Befehlszeilentool) und Python (requests-Bibliothek).

Verwenden von curl:

curl -X POST <https://api.perplexity.ai/chat/completions> \\\\

-H "Authorization: Bearer YOUR_PERPLEXITY_API_KEY" \\\\

-H "Content-Type: application/json" \\\\

-d '{

"model": "sonar-medium-online",

"messages": [

{

"role": "system",

"content": "Be precise and concise."

},

{

"role": "user",

"content": "What are the main benefits of using the Perplexity AI API?"

}

],

"max_tokens": 500,

"temperature": 0.7

}'

Erklärung:

curl -X POST ...: Stellt eine HTTP POST-Anfrage an den angegebenen Endpunkt.H "Authorization: Bearer YOUR_PERPLEXITY_API_KEY": Dieser Header stellt Ihre Authentifizierungsanmeldeinformationen bereit. Ersetzen SieYOUR_PERPLEXITY_API_KEYdurch den von Ihnen generierten Schlüssel.H "Content-Type: application/json": Informiert den Server, dass der Anfragetext im JSON-Format vorliegt.d '{...}': Gibt die gesendete JSON-Nutzlast (Daten) an."model": Das spezifische Perplexity-Modell, das verwendet werden soll (z. B.sonar-medium-online)."messages": Eine Liste von Nachrichtenobjekten, die den Konversationsverlauf definieren."role": Kann"system"(legt das Verhalten der KI fest),"user"(Ihre Eingabe) oder"assistant"(vorherige KI-Antworten) sein."content": Der Text der Nachricht."max_tokens"(optional): Maximale Anzahl von Tokens, die in der Antwort generiert werden sollen."temperature"(optional): Steuert die Zufälligkeit (0 = deterministisch, höher = kreativer/zufälliger).

Verwenden von Python (requests-Bibliothek):

Stellen Sie zunächst sicher, dass Sie die requests-Bibliothek installiert haben: pip install requests

import requests

import json

import os

# Laden Sie Ihren API-Schlüssel sicher (z. B. aus einer Umgebungsvariablen)

api_key = os.environ.get("PERPLEXITY_API_KEY")

# Oder auskommentieren und direkt ersetzen (weniger sicher für die Produktion):

# api_key = "YOUR_PERPLEXITY_API_KEY"

if not api_key:

print("Error: PERPLEXITY_API_KEY environment variable not set.")

else:

url = "<https://api.perplexity.ai/chat/completions>"

payload = {

"model": "sonar-medium-online",

"messages": [

{

"role": "system",

"content": "Provide detailed explanations and cite sources."

},

{

"role": "user",

"content": "Explain the concept of Retrieval-Augmented Generation (RAG)."

}

],

"max_tokens": 800,

"temperature": 0.5,

# Add other parameters like 'frequency_penalty', 'presence_penalty' if needed

}

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

try:

response = requests.post(url, headers=headers, json=payload)

response.raise_for_status() # Raise an exception for bad status codes (4xx or 5xx)

response_data = response.json()

print(json.dumps(response_data, indent=2))

# Extract the assistant's reply

if response_data.get("choices"):

assistant_message = response_data["choices"][0]["message"]["content"]

print("\\\\nAssistant's Response:\\\\n", assistant_message)

except requests.exceptions.RequestException as e:

print(f"An error occurred: {e}")

if e.response is not None:

print("Error details:", e.response.text)

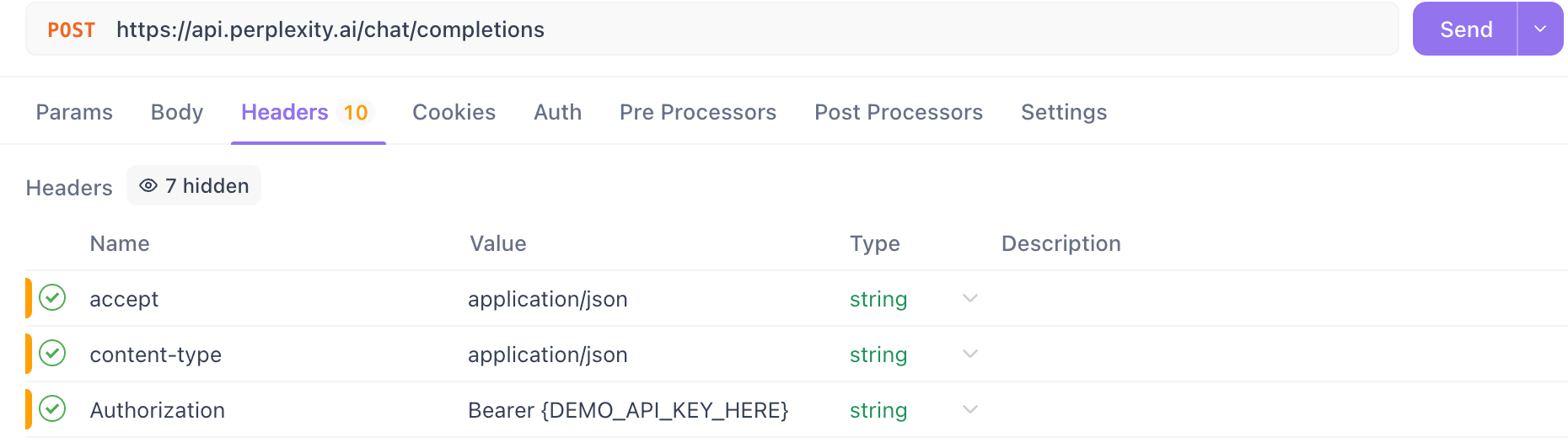

Schritt 5: Testen Ihres Perplexity AI API-Schlüssels mit APIdog

Bevor Sie den API-Schlüssel in Ihre Anwendung integrieren, ist es ratsam, ihn zu testen, um sicherzustellen, dass er ordnungsgemäß funktioniert. APIdog ist ein benutzerfreundliches Tool zum Testen von APIs. So verwenden Sie es, um Ihren Perplexity-Schlüssel zu testen:

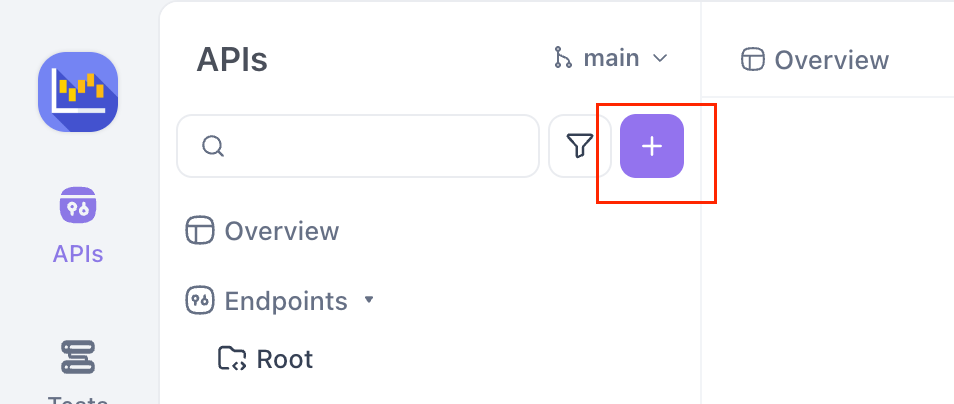

Laden Sie APIdog herunter und öffnen Sie es: Starten Sie die APIdog-Anwendung oder verwenden Sie die Webversion.

Erstellen Sie eine neue Anfrage: Klicken Sie auf die Schaltfläche "+" oder eine ähnliche Option, um eine neue API-Anfrage zu erstellen.

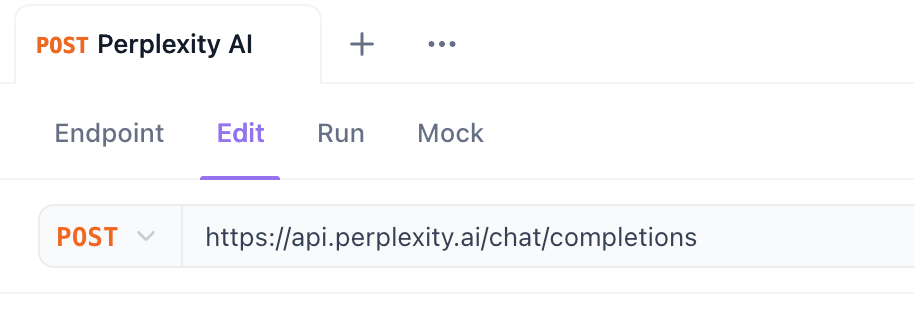

Legen Sie die Methode auf POST fest: Ändern Sie die HTTP-Methoden-Dropdown-Liste in POST.

Geben Sie die Endpunkt-URL ein: Fügen Sie im URL-Eingabefeld den Perplexity-Chat-Completions-Endpunkt ein: https://api.perplexity.ai/chat/completions

Autorisierung konfigurieren:

- Gehen Sie zur Registerkarte "Autorisierung" unterhalb der URL-Leiste.

- Wählen Sie "Bearer Token" aus der Typ-Dropdown-Liste.

- Fügen Sie im Feld "Token" Ihren Perplexity AI API-Schlüssel ein, der in Schritt 1 abgerufen wurde.

Content-Type-Header festlegen:

- Gehen Sie zur Registerkarte "Header".

- Fügen Sie einen neuen Header hinzu. Setzen Sie den Schlüssel auf

Content-Typeund den Wert aufapplication/json.

Anfragetext erstellen:

- Gehen Sie zur Registerkarte "Body".

- Wählen Sie die Option "raw" und wählen Sie "JSON" aus der Dropdown-Liste daneben.

- Fügen Sie die folgende JSON-Struktur in den Textbereich ein, ersetzen Sie

"sonar-medium-online"durch das Modell, das Sie testen möchten, und passen Sie den"content"nach Bedarf an:

{

"model": "sonar-medium-online",

"messages": [

{

"role": "system",

"content": "Be precise and factual."

},

{

"role": "user",

"content": "How many moons does Mars have?"

}

]

}

Senden Sie die Anfrage: Klicken Sie auf die Schaltfläche "Senden".

Überprüfen Sie die Antwort: APIdog zeigt die Antwort von der Perplexity API an. Suchen Sie nach einem 200 OK-Statuscode und einer JSON-Antwort, die die Antwort der KI im Feld choices[0].message.content enthält. Wenn Sie einen Fehler erhalten (z. B. einen 401 Unauthorized oder 403 Forbidden), überprüfen Sie nochmals, ob Ihr API-Schlüssel in der Registerkarte "Autorisierung" korrekt eingefügt wurde und ob Ihr Perplexity-Konto/Schlüssel die erforderlichen Berechtigungen und Credits hat.

Möchten Sie eine integrierte All-in-One-Plattform für Ihr Entwicklerteam, um mit maximaler Produktivität zusammenzuarbeiten?

Apidog liefert alle Ihre Anforderungen und ersetzt Postman zu einem viel günstigeren Preis!

Verwenden von Perplexity AI API-Modellen ohne ein direktes Pro-Konto (mit Openrouter)

Wenn Sie kein Perplexity Pro-Abonnement haben oder ein anderes Abrechnungs-/Zugriffsmodell bevorzugen, können Sie die Modelle von Perplexity häufig über API-Drittanbieter verwenden. OpenRouter ist ein beliebtes Beispiel.

OpenRouter bietet einen einheitlichen API-Endpunkt für den Zugriff auf eine Vielzahl von LLMs von verschiedenen Anbietern, einschließlich Perplexity. Sie zahlen OpenRouter basierend auf Ihrer Nutzung, und sie kümmern sich um die Backend-Aufrufe an die jeweiligen Modellanbieter.

Sie können die verfügbare Perplexity AI API hier überprüfen:

Voraussetzungen:

- Ein OpenRouter-Konto (

openrouter.ai). - Finanzierung, die Ihrem OpenRouter-Konto hinzugefügt wurde, oder Einrichtung der Abrechnung.

- Grundlegendes Verständnis von REST-APIs.

Schritt 1: Holen Sie sich Ihren OpenRouter API-Schlüssel

- Registrieren/Anmelden: Gehen Sie zu

openrouter.aiund erstellen Sie ein Konto oder melden Sie sich an. - Navigieren Sie zu Schlüsseln: Suchen Sie den Abschnitt "Schlüssel" oder "API-Schlüssel" in Ihren Kontoeinstellungen.

- Schlüssel erstellen: Generieren Sie einen neuen API-Schlüssel.

- Kopieren und Sichern: Kopieren Sie den generierten Schlüssel und speichern Sie ihn sicher, genau wie den offiziellen Perplexity-Schlüssel.

Schritt 2: Identifizieren Sie Perplexity AI API-Modelle auf OpenRouter

OpenRouter verwendet eine eigene Namenskonvention, die häufig den Anbieternamen voranstellt. Perplexity-Modelle auf OpenRouter könnten so aussehen:

perplexity/sonar-small-chatperplexity/sonar-small-onlineperplexity/sonar-medium-chatperplexity/sonar-medium-online- (Überprüfen Sie die /models-Seite von OpenRouter auf die aktuelle Liste und die genauen Namen)

Schritt 3: Stellen Sie eine API-Anfrage über den OpenRouter-Endpunkt für Perplexity AI API-Modelle

OpenRouter verwendet einen OpenAI-kompatiblen API-Endpunkt:

https://openrouter.ai/api/v1/chat/completions

Sie strukturieren Ihre Anfrage ähnlich wie die offizielle Perplexity API oder OpenAI API, verwenden aber Ihren OpenRouter-Schlüssel und den OpenRouter-Modellnamen.

Verwenden von curl:

curl -X POST <https://openrouter.ai/api/v1/chat/completions> \\\\

-H "Authorization: Bearer YOUR_OPENROUTER_API_KEY" \\\\

-H "Content-Type: application/json" \\\\

-H "HTTP-Referer: YOUR_SITE_URL" \\\\ # Optional, but recommended by OpenRouter

-H "X-Title: YOUR_APP_NAME" \\\\ # Optional, but recommended by OpenRouter

-d '{

"model": "perplexity/sonar-medium-online",

"messages": [

{"role": "user", "content": "How does OpenRouter provide access to the Perplexity AI API models?"}

]

}'

Hinweis: OpenRouter empfiehlt das Hinzufügen von HTTP-Referer- und X-Title-Headern, um Ihre Anwendung zu identifizieren. Ersetzen Sie YOUR_OPENROUTER_API_KEY, YOUR_SITE_URL und YOUR_APP_NAME entsprechend.

Schritt 4: Behandeln Sie die OpenRouter-Antwort für Perplexity AI API-Modelle

Die Antwortstruktur von OpenRouter ist im Allgemeinen identisch mit dem OpenAI/Perplexity-Standard, einschließlich der Felder choices, message, content und usage. Der Hauptunterschied besteht darin, dass die Kosten basierend auf den Preisen von OpenRouter für das von Ihnen verwendete spezifische Perplexity-Modell berechnet werden.

Vorteile der Verwendung von OpenRouter:

- Greifen Sie auf Perplexity-Modelle zu, ohne ein direktes Perplexity Pro-Abonnement zu benötigen.

- Konsolidierte Abrechnung für mehrere LLMs von verschiedenen Anbietern.

- Einzelner API-Schlüssel und Endpunkt für verschiedene Modelle.

Überlegungen:

- Die Preise können von den direkten API-Kosten von Perplexity abweichen.

- Potenzial für eine etwas höhere Latenz aufgrund des zusätzlichen Hops.

- Abhängig von der Plattformverfügbarkeit von OpenRouter und deren Integration mit Perplexity.

Fazit

Dieses Tutorial bietet eine detaillierte Anleitung für den Zugriff auf die leistungsstarken Modelle hinter Perplexity AI über verschiedene API-Methoden. Denken Sie daran, sich immer an die offizielle Dokumentation für Perplexity, OpenRouter für die aktuellsten Modellnamen, Endpunkte, Preise und Funktionen zu wenden. Sichern Sie Ihre API-Schlüssel und wählen Sie die Zugriffsmethode, die Ihren Projektanforderungen und Ihrem Budget am besten entspricht.