Google hat kürzlich Nano Banana vorgestellt, einen Durchbruch in der KI-gesteuerten Bildbearbeitung, der neue Maßstäbe für Konsistenz und Kreativität setzt. Diese Funktion, offiziell bekannt als Gemini 2.5 Flash Image Preview, ermöglicht es Benutzern, Bilder mit bemerkenswerter Präzision zu generieren und zu bearbeiten, wobei die Ähnlichkeit des Motivs über mehrere Modifikationen hinweg erhalten bleibt. Ingenieure und Entwickler greifen nun über die Gemini API auf diese Funktion zu, was die Integration in benutzerdefinierte Anwendungen für Aufgaben von einfachen Fotoverbesserungen bis hin zu komplexen Szenenkompositionen ermöglicht.

Während sich KI-Modelle weiterentwickeln, ermöglichen Tools wie Nano Banana Kreativen, die Grenzen der digitalen Bildgebung zu erweitern. Dieser Artikel führt Sie durch die technischen Aspekte der Nutzung von Nano Banana über die API, von der Ersteinrichtung bis zu fortgeschrittenen Techniken. Entwickler nutzen dieses Modell, um Anwendungen zu erstellen, die Textaufforderungen in visuell kohärente Bearbeitungen umwandeln, und die folgenden Abschnitte erläutern jeden Schritt im Detail.

Nano Banana und Gemini 2.5 Flash Image Preview verstehen

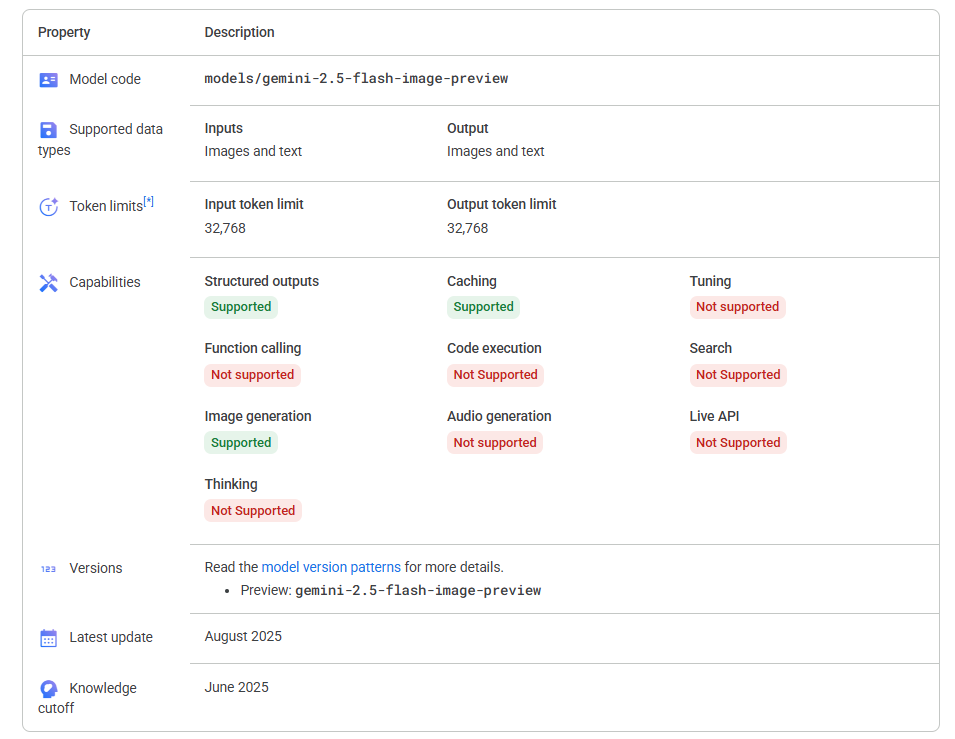

Nano Banana stellt Googles neueste Entwicklung in der multimodalen KI dar, die speziell für die Bilderzeugung und -bearbeitung zugeschnitten ist. Der Begriff "Nano Banana" dient als spielerischer Spitzname für das Gemini 2.5 Flash Image-Modell und unterstreicht sein effizientes, leichtgewichtiges Design, das hochauflösende Ergebnisse ohne übermäßige Rechenanforderungen liefert. Im Gegensatz zu herkömmlichen Bildbearbeitungsprogrammen zeichnet sich dieses Modell durch die Beibehaltung der Charakterkonsistenz aus – es stellt sicher, dass Gesichter, Posen und Details auch nach umfangreichen Änderungen dem Originalmotiv treu bleiben.

Darüber hinaus integriert Gemini-2-5-flash-image-preview Denkfähigkeiten, die es dem Modell ermöglichen, Bearbeitungen zu "durchdenken", bevor sie angewendet werden. Dies führt zu Ausgaben, die häufige Fallstricke wie verzerrte Merkmale oder unpassende Beleuchtung vermeiden. Zum Beispiel weisen Sie das Modell an, die Kleidung einer Person von lässig zu formell zu ändern, und es bewahrt dabei nahtlos Gesichtsausdrücke und Körperproportionen.

Die Architektur des Modells baut auf früheren Gemini-Iterationen auf und integriert Verbesserungen in der Bild-Sprach-Verarbeitung. Es unterstützt Eingaben wie Textaufforderungen in Kombination mit Bildern, was Multi-Turn-Interaktionen ermöglicht, bei denen Sie Bearbeitungen iterativ verfeinern. Google positioniert Nano Banana als führend in Bildbearbeitungs-Benchmarks und übertrifft Konkurrenten in Konsistenz und Qualität.

Darüber hinaus enthält das Modell integrierte Schutzmaßnahmen, wie sichtbare und unsichtbare Wasserzeichen (SynthID), um KI-generierte Inhalte zu kennzeichnen. Dies fördert den ethischen Gebrauch, insbesondere in professionellen Umgebungen, wo Authentizität wichtig ist. Entwickler setzen Nano Banana für Anwendungen im E-Commerce, Design und der Inhaltserstellung ein, wo schnelles Prototyping von Visuals Arbeitsabläufe beschleunigt.

Voraussetzungen für die Nutzung der Nano Banana API

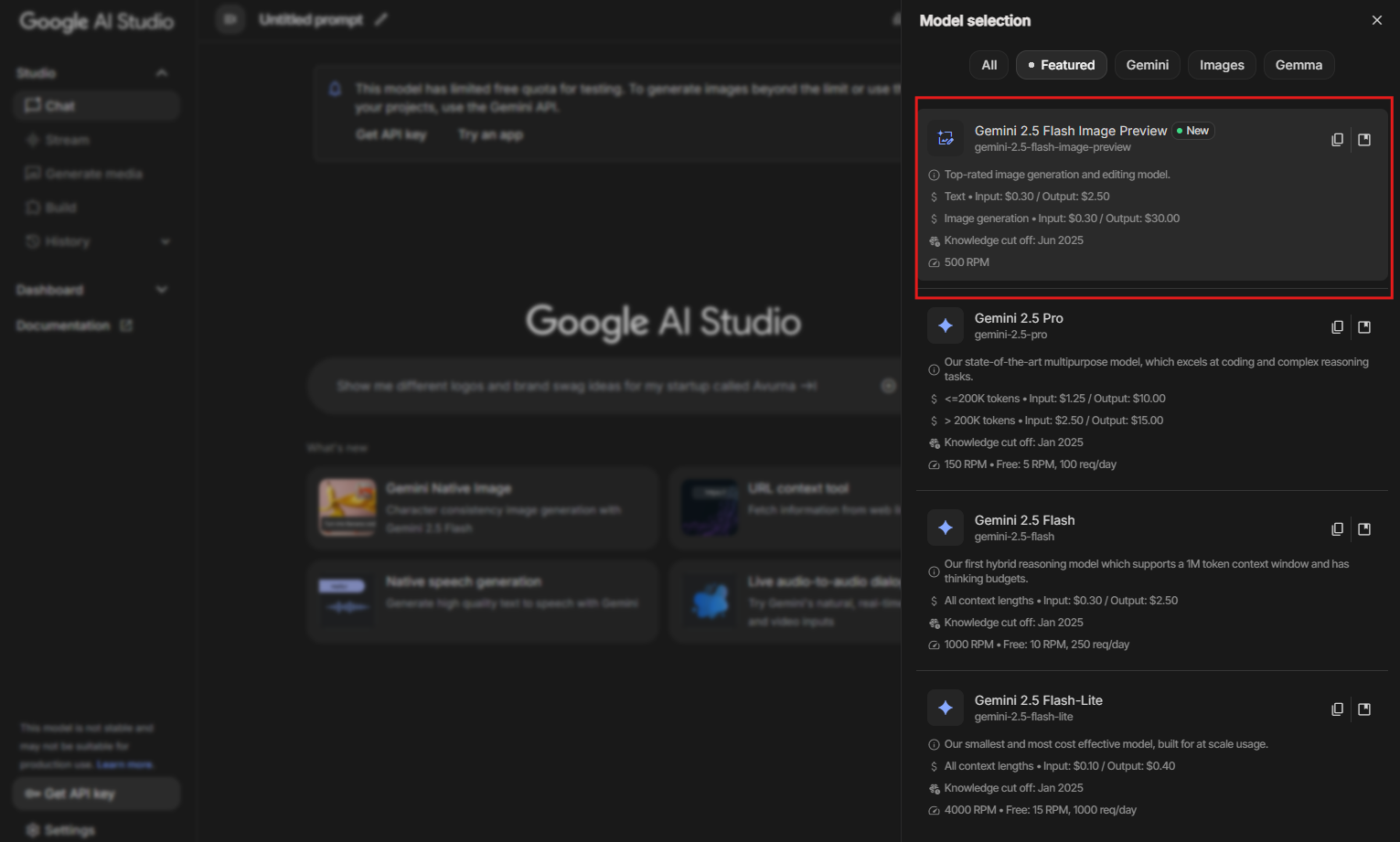

Bevor Sie Nano Banana implementieren, stellen Sie sicher, dass Ihr Setup die wesentlichen Anforderungen erfüllt. Zuerst benötigen Sie ein Google Cloud-Konto, da die Gemini API über Vertex AI oder Google AI Studio betrieben wird. Diese Plattform bietet Zugriff auf Gemini-2-5-flash-image-preview sowie Quotenverwaltung für API-Aufrufe.

Als Nächstes überprüfen Sie die Unterstützung der Programmiersprache. Die API unterstützt Python, JavaScript, Java, Go und REST, aber Python bleibt für Anfänger aufgrund seiner umfangreichen Bibliotheken am einfachsten. Installieren Sie das Google Generative AI SDK über pip: pip install google-generativeai.

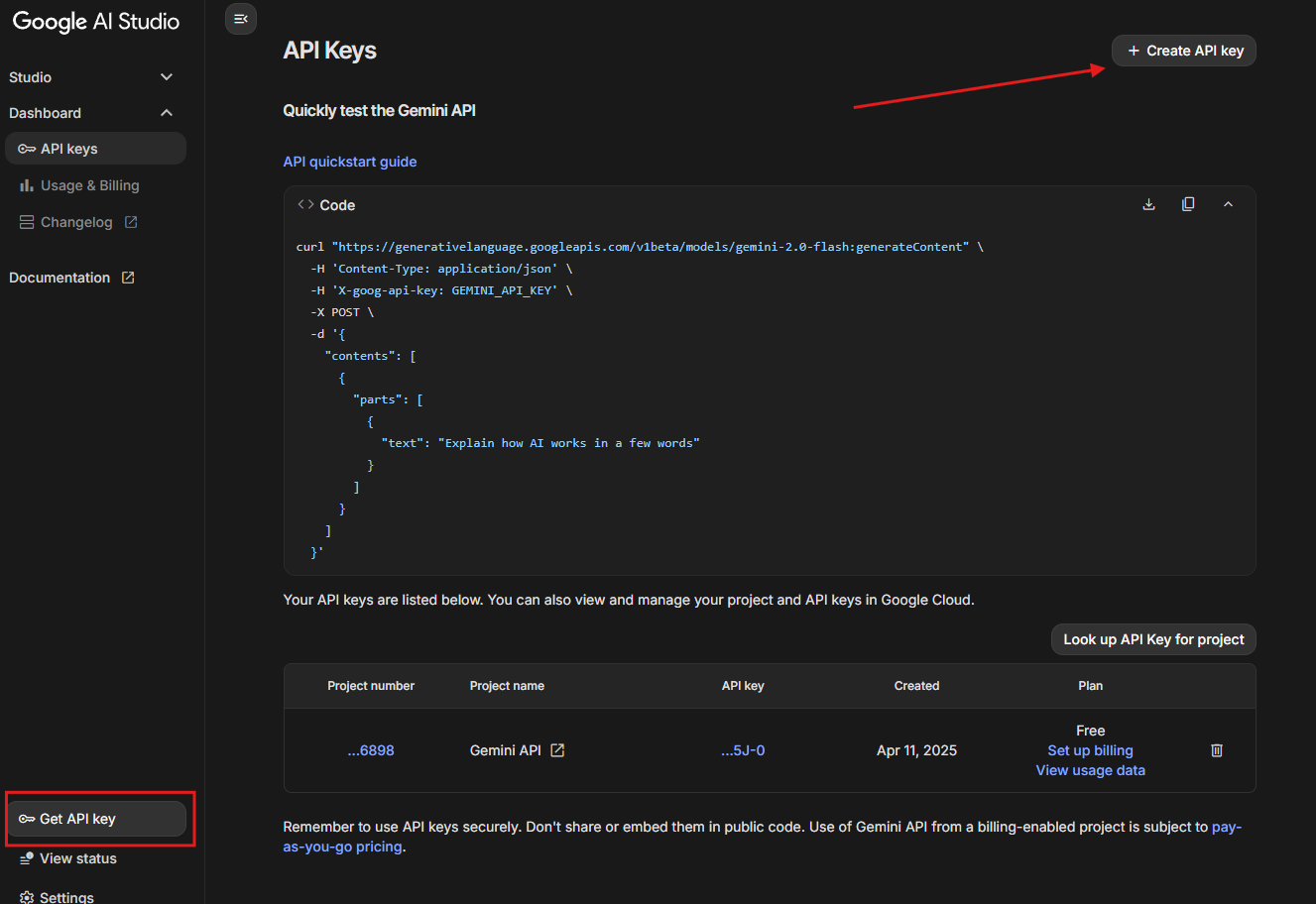

Bereiten Sie außerdem Ihre Umgebung mit einem API-Schlüssel vor. Navigieren Sie zu Google AI Studio und generieren Sie einen Schlüssel, der auf Gemini-Dienste beschränkt ist.

Sicherheits-Best Practices schreiben vor, Umgebungsvariablen zur Speicherung dieses Schlüssels zu verwenden, um eine Offenlegung in Code-Repositories zu verhindern.

Machen Sie sich außerdem mit Bildformaten vertraut. Nano Banana akzeptiert JPEG-, PNG- und base64-kodierte Bilder als Eingaben, mit Ausgaben in ähnlichen Formaten. Stellen Sie sicher, dass Ihr System die Datei-I/O effizient handhabt, insbesondere bei der Stapelverarbeitung.

Überprüfen Sie schließlich die Nutzungslimits. Kostenlose Stufen bieten begrenzte Anfragen pro Minute, während kostenpflichtige Pläne für die Produktion skalieren. Überwachen Sie diese, um Drosselung während der Entwicklung zu vermeiden.

Einrichtung Ihrer Entwicklungsumgebung für Gemini-2-5-Flash-Image-Preview

Ingenieure konfigurieren ihre Umgebungen methodisch, um Nano Banana effektiv zu integrieren. Beginnen Sie mit dem Klonen eines Starter-Repositorys, falls verfügbar, wie z.B. Googles Quickstart für die Bildbearbeitung. Dies bietet Boilerplate-Code für Authentifizierung und grundlegende Aufrufe.

Importieren Sie dann die notwendigen Module. In Python verwenden Sie import google.generativeai as genai und konfigurieren es mit genai.configure(api_key=os.getenv('API_KEY')). Dieser Schritt authentifiziert Ihre Sitzung.

Wählen Sie außerdem das Modell explizit aus: model = genai.GenerativeModel('gemini-2.5-flash-image-preview'). Dies zielt auf die für Bilder optimierte Nano Banana-Variante ab.

Um das Testen zu verbessern, integrieren Sie Apidog. Laden Sie es von der offiziellen Website herunter und installieren Sie es, und erstellen Sie dann ein neues Projekt für Gemini API-Endpunkte. Apidog ermöglicht es Ihnen, Anfragen zu mocken, Header zu inspizieren und Fehler zu simulieren, was sich beim Debuggen von Nano Banana-Interaktionen als unschätzbar erweist.

In der Praxis richten Sie eine virtuelle Umgebung mit venv ein, um Abhängigkeiten zu isolieren. Dies verhindert Konflikte mit anderen Projekten und gewährleistet die Reproduzierbarkeit.

API-Zugriff auf Nano Banana erhalten

Google vereinfacht den API-Zugriff für Entwickler. Beginnen Sie in Google AI Studio, wo Sie mit Gemini-2-5-flash-image-preview in einer No-Code-Oberfläche experimentieren, bevor Sie zu Code übergehen.

Sobald Sie bereit sind, aktivieren Sie die Vertex AI API in Ihrer Google Cloud-Konsole. Weisen Sie Ihrem Dienstkonto Rollen wie "Vertex AI-Benutzer" für sicheren Zugriff zu.

Zusätzlich kümmern Sie sich um die Abrechnung. Während anfängliche Testphasen kostenlos sind, aktivieren Sie die Abrechnung für die dauerhafte Nutzung. Google bietet Gutschriften für neue Benutzer an, was die Einstiegshürde senkt.

Für Unternehmens-Setups sollten Sie die verwalteten Endpunkte von Vertex AI in Betracht ziehen, die Nano Banana für Anwendungen mit hohem Durchsatz skalieren.

Grundlegende API-Aufrufe zur Bilderzeugung mit Gemini-2-5-Flash-Image-Preview

Entwickler initiieren die Bilderzeugung mit einfachen Prompts. Erstellen Sie eine Anfrage: response = model.generate_content(["Generate an image of a nano banana in a futuristic setting."]). Das Modell verarbeitet Text und gibt base64-kodierte Bilder zurück.

Als Nächstes dekodieren und speichern Sie die Ausgabe: import base64; with open('output.png', 'wb') as f: f.write(base64.b64decode(response.parts[0].inline_data.data)).

Integrieren Sie außerdem Sicherheitseinstellungen, um unangemessene Inhalte zu filtern: safety_settings = [{'category': 'HARM_CATEGORY_HATE_SPEECH', 'threshold': 'BLOCK_MEDIUM_AND_ABOVE'}].

Testen Sie diese Aufrufe in Apidog, indem Sie den Endpunkt auf https://generativelanguage.googleapis.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent setzen und Ihren API-Schlüssel in den Headern hinzufügen.

Fortgeschrittene Bildbearbeitungstechniken mit Nano Banana

Nano Banana glänzt in Bearbeitungsszenarien. Laden Sie ein Bild hoch und fordern Sie auf: response = model.generate_content([{'inline_data': {'mime_type': 'image/png', 'data': base64.b64encode(open('input.png', 'rb').read()).decode()}}, "Change the background to a beach."]).

Aktivieren Sie außerdem die Multi-Turn-Bearbeitung, indem Sie den Konversationsverlauf beibehalten: Verwenden Sie chat = model.start_chat(history=[previous_response]) für iterative Verfeinerungen.

Bilder mischen: Geben Sie mehrere Eingaben an und weisen Sie das Mischen an, z.B. das Zusammenführen eines Porträts mit einer Landschaft.

Stile anwenden: Fordern Sie "Wenden Sie die Textur von Bananenschalen auf dieses Objekt an" an, um die kreativen Kontrollen von Nano Banana zu nutzen.

Integrieren Sie die Videogenerierung, indem Sie Frames sequenziell bearbeiten, obwohl dies benutzerdefinierte Skripterstellung erfordert.

Apidog für effizientes API-Testen integrieren

Apidog verbessert Ihren Nano Banana-Workflow. Erstellen Sie Sammlungen für Gemini-Endpunkte, parametrieren Sie Prompts und führen Sie automatisierte Tests durch.

Skripten Sie zum Beispiel einen Testfall in Apidog, um Bildbearbeitungsantworten zu validieren und nach SynthID-Wasserzeichen zu suchen.

Diese Integration reduziert die Entwicklungszeit, da Apidog JSON-Antworten visualisiert und die Authentifizierung nahtlos handhabt.

Code-Beispiele in Python für Gemini-2-5-Flash-Image-Preview

Hier demonstriert ein vollständiges Skript die Bearbeitung:

import os

import base64

import google.generativeai as genai

genai.configure(api_key=os.getenv('GEMINI_API_KEY'))

model = genai.GenerativeModel('gemini-2.5-flash-image-preview')

with open('banana.jpg', 'rb') as img_file:

img_data = base64.b64encode(img_file.read()).decode()

prompt = "Edit this banana image to make it nano-sized in a lab setting."

response = model.generate_content([{'inline_data': {'mime_type': 'image/jpeg', 'data': img_data}}, prompt])

generated_img = base64.b64decode(response.parts[0].inline_data.data)

with open('edited_nano_banana.png', 'wb') as out:

out.write(generated_img)

Dieser Code lädt ein Bananenbild hoch, wendet die Bearbeitung an und speichert das Ergebnis.

Erweitern Sie es für die Stapelverarbeitung: Iterieren Sie über eine Liste von Bildern und Prompts.

Behandeln Sie Fehler elegant mit try-except-Blöcken bei Quotenüberschreitungen oder ungültigen Eingaben.

Best Practices und Einschränkungen der Nano Banana API

Implementieren Sie Ratenbegrenzungen in Ihrem Code, um API-Quoten einzuhalten. Cachen Sie Antworten für wiederholte Abfragen, um Kosten zu optimieren.

Validieren Sie außerdem die Eingaben: Stellen Sie sicher, dass Bilder unter den Größenbeschränkungen (typischerweise 4MB) liegen und Prompts prägnant sind, um bessere Ergebnisse zu erzielen.

Einschränkungen umfassen gelegentliche Inkonsistenzen in komplexen Szenen und regionale Verfügbarkeitsbeschränkungen. Nano Banana funktioniert am besten mit klaren, beschreibenden Prompts.

Verfolgen Sie Updates über die Kanäle von Google DeepMind, da sich Modelle wie Gemini-2-5-flash-image-preview schnell weiterentwickeln.

Fazit

Nano Banana revolutioniert über die Gemini 2.5 Flash Image Preview API die Bildbearbeitung für Entwickler. Indem Sie diesem Leitfaden folgen, implementieren Sie robuste Lösungen, die ihre Stärken in Konsistenz und Kreativität nutzen. Denken Sie daran, dass Tools wie Apidog Ihre Effizienz steigern – laden Sie es noch heute herunter, um Ihre API-Interaktionen zu verbessern.

Während Sie experimentieren, führen kleine Anpassungen in den Prompts zu erheblichen Verbesserungen der Ausgaben. Erkunden Sie weiter, um das volle Potenzial von Nano Banana in Ihren Projekten auszuschöpfen.