Entwickler suchen zunehmend nach robusten APIs, die komplexe multimodale Eingaben verarbeiten und intelligente Ausgaben liefern. Die Kimi K2.5 API von Moonshot AI zeichnet sich als vielseitiges Werkzeug aus, das Anwendungen ermöglicht, Text, Bilder und Videos mit fortschrittlichen Denkfähigkeiten zu verarbeiten. Diese API befähigt Sie, hochentwickelte KI-gesteuerte Lösungen zu entwickeln, vom visuellen Debugging in Code bis zur Orchestrierung von Agentenschwärmen für die parallele Aufgabenbearbeitung.

Was ist Kimi K2.5?

Kimi K2.5 ist das fortschrittlichste quelloffene multimodale Modell von Moonshot AI, das durch kontinuierliches Vortraining mit etwa 15 Billionen gemischten visuellen und Text-Tokens auf der Kimi-K2-Base-Architektur aufgebaut wurde. Im Gegensatz zu seinem Vorgänger integriert K2.5 nahtlos das Verständnis von Vision und Sprache mit fortschrittlichen agentischen Fähigkeiten, was es besonders leistungsfähig für Entwickler macht, die KI-gesteuerte Anwendungen erstellen.

Das Modell führt mehrere bahnbrechende Funktionen ein, die es von anderen KI-APIs abheben. Seine native Multimodalität bedeutet, dass es von Grund auf mit Bild-Sprach-Tokens vortrainiert wurde, anstatt visuelle Fähigkeiten nachträglich anzufügen. Dieser Ansatz führt zu überlegener Leistung bei visuellem Wissen, cross-modalem Denken und der Nutzung agentischer Tools, die auf visuellen Eingaben basieren.

Warum Kimi K2.5 für Entwickler wichtig ist:

- Open-Source-Verfügbarkeit: Im Gegensatz zu vielen Frontier-Modellen sind die Gewichte von K2.5 öffentlich auf Hugging Face verfügbar.

- OpenAI-kompatible API: Direkter Ersatz, der minimale Codeänderungen erfordert.

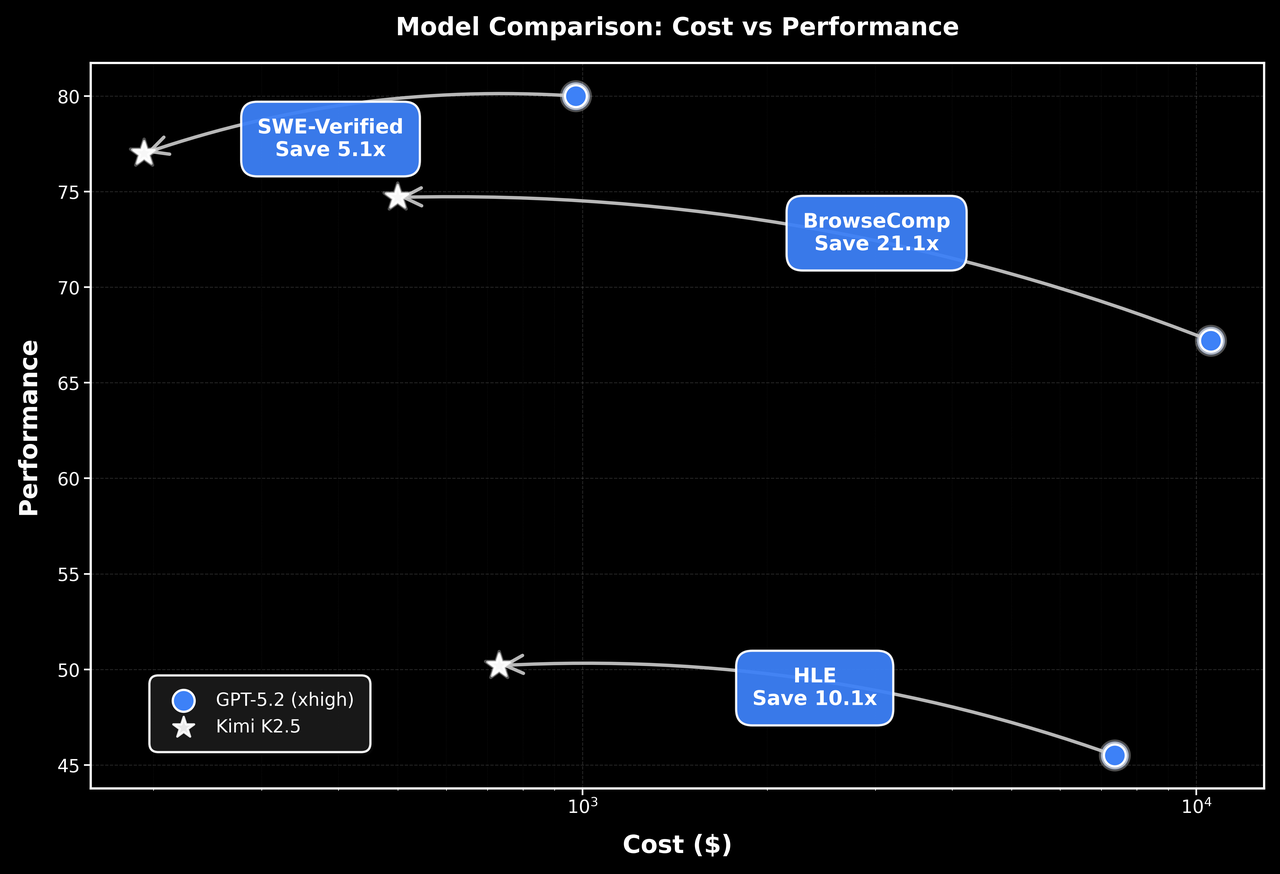

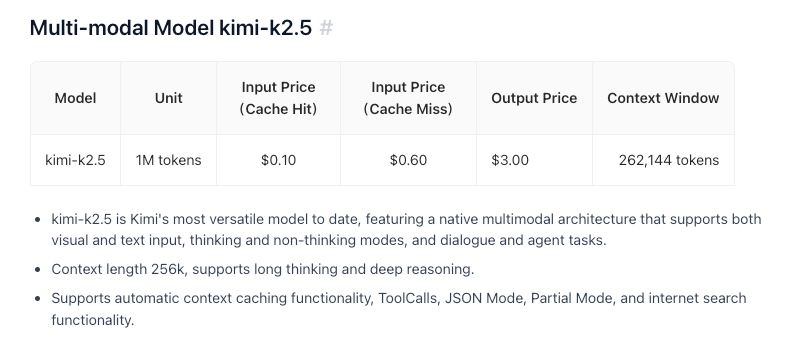

- Kosteneffizient: Wettbewerbsfähige Preise von 0,60 $/M Input-Tokens.

- 256K Kontextfenster: Ermöglicht die Verarbeitung umfangreicher Dokumente und Konversationen.

- Agenten-Schwarm-Fähigkeit: Zerlegt komplexe Aufgaben in parallele Unteraufgaben.

Schlüsselfunktionen und -fähigkeiten

Native Multimodale Intelligenz

K2.5 zeichnet sich durch visuelles Wissen, cross-modales Denken und agentische Werkzeugnutzung aus, die auf visuellen Eingaben basiert. Das ist nicht nur Bilderkennung, sondern ein tiefes Verständnis des visuellen Kontexts, das komplexe Entscheidungsfindungen unterstützen kann.

Programmierung mit Vision

Eine der herausragenden Fähigkeiten von K2.5 ist die Generierung von Code aus visuellen Spezifikationen. Zeigen Sie ihm ein UI-Design-Mockup, und es kann funktionalen Front-End-Code erzeugen. Zeigen Sie ihm einen Video-Workflow, und es kann Tools für die visuelle Datenverarbeitung orchestrieren. Dies macht es besonders wertvoll für:

- Konvertierung von Figma-Designs in React-Komponenten

- Generierung von HTML/CSS aus Wireframes

- Erstellung von Datenvisualisierungs-Pipelines aus Diagrammbeispielen

- Automatisierung von Bildverarbeitungs-Workflows

Agenten-Schwarm-Architektur

K2.5 wechselt von der Skalierung einzelner Agenten zu einem selbstgesteuerten, koordinierten schwarmartigen Ausführungsschema. Bei komplexen Aufgaben kann es:

- Das Problem in parallele Unteraufgaben zerlegen

- Domänenspezifische Agenten dynamisch instanziieren

- Die Ausführung über mehrere Agenten hinweg koordinieren

- Ergebnisse zu kohärenten Ausgaben synthetisieren

Diese Architektur ermöglicht es K2.5, Aufgaben zu bewältigen, die einzelne Agentensysteme überfordern würden, wie z.B. umfassendes Code-Refactoring, die Generierung von Multi-Datei-Dokumentationen oder komplexe Datenanalyse-Pipelines.

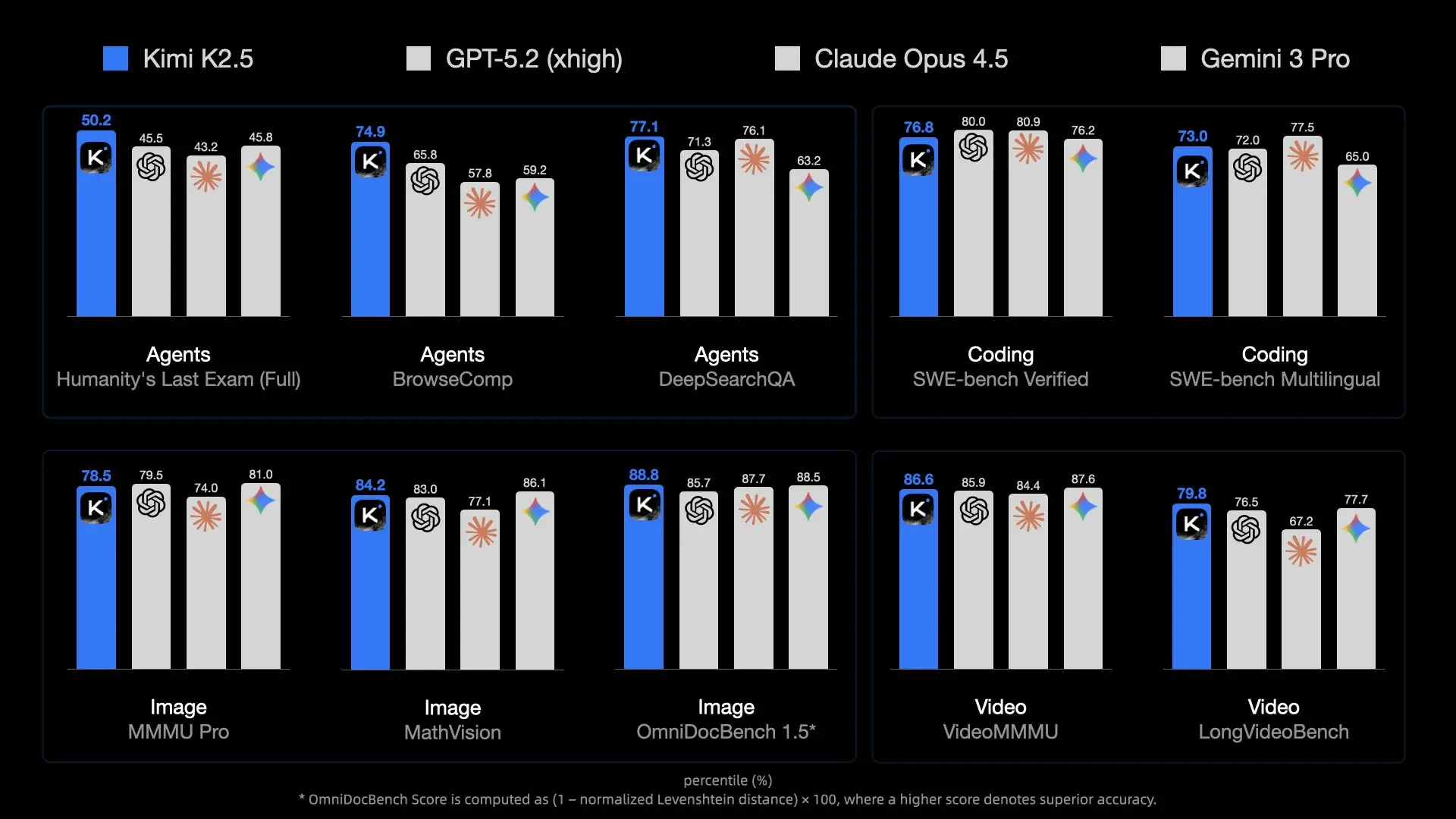

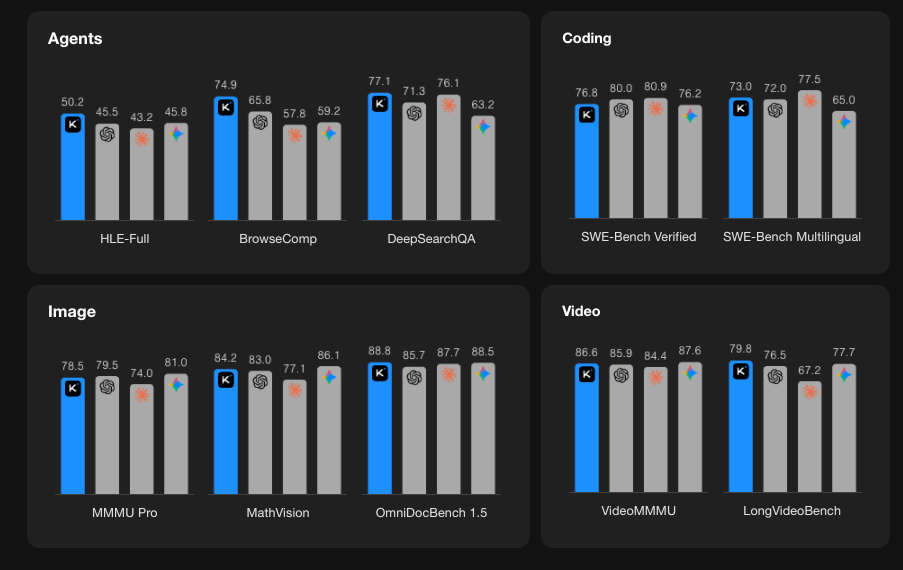

Benchmark-Leistung

Erste Schritte mit der Kimi K2.5 API

Schritt 1: Erstellen Sie Ihr Moonshot AI-Konto

Besuchen Sie platform.moonshot.ai und registrieren Sie sich für ein Konto. Der Registrierungsprozess ist unkompliziert:

- Klicken Sie auf "Anmelden" oder "Registrieren"

- Geben Sie Ihre E-Mail-Adresse ein und erstellen Sie ein Passwort

- Bestätigen Sie Ihre E-Mail-Adresse

- Füllen Sie alle erforderlichen Profilinformationen aus

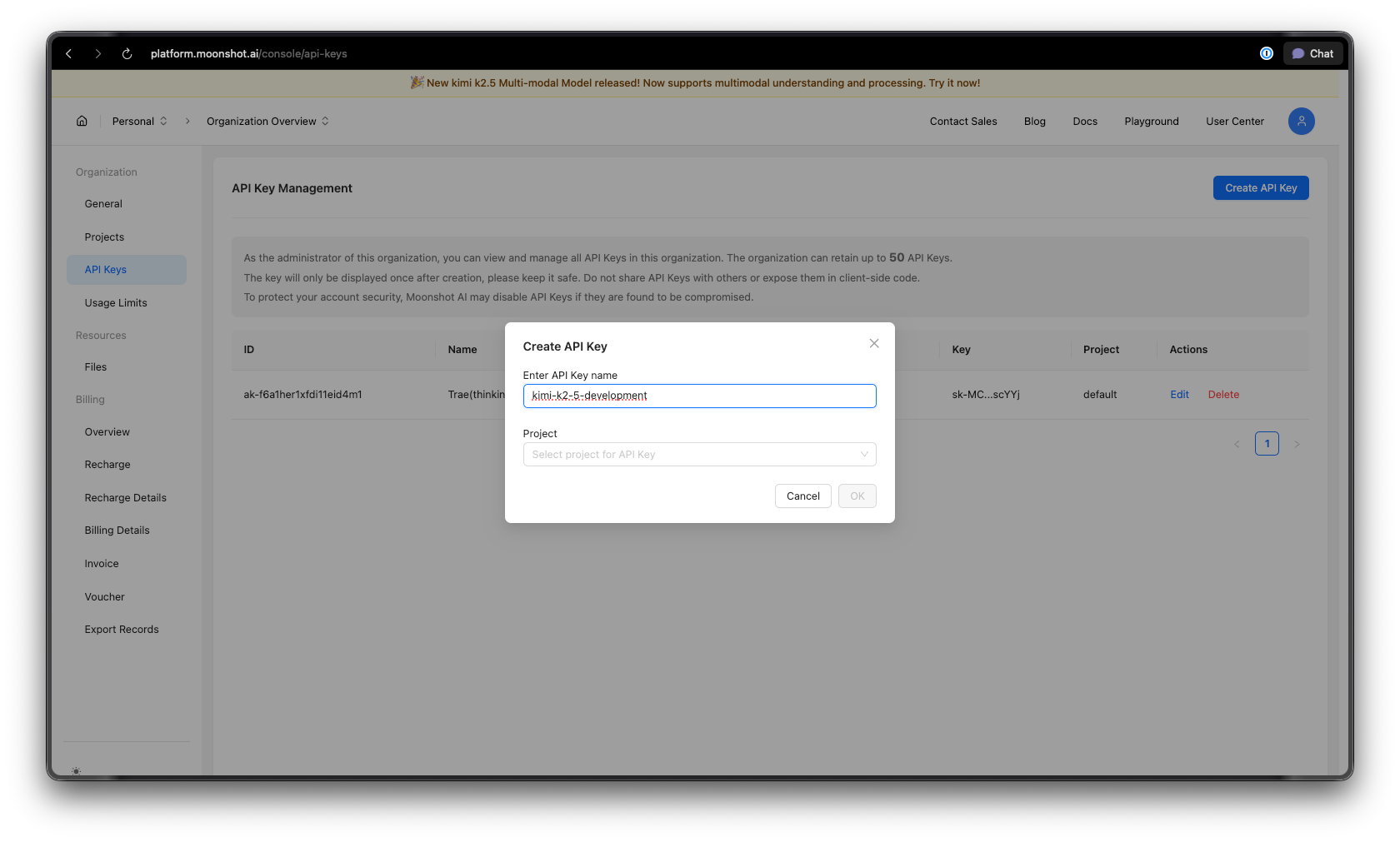

Schritt 2: Generieren Sie Ihren API-Schlüssel

Nach dem Login:

- Navigieren Sie zum Bereich API-Schlüssel in Ihrem Dashboard

- Klicken Sie auf "Neuen API-Schlüssel erstellen"

- Geben Sie Ihrem Schlüssel einen aussagekräftigen Namen (z.B. "kimi-k2-5-development")

- Kopieren und speichern Sie Ihren API-Schlüssel sicher – Sie werden ihn nicht wiedersehen

Sicherheitstipp: Übertragen Sie niemals API-Schlüssel in die Versionskontrolle. Verwenden Sie Umgebungsvariablen oder einen Secrets Manager.

Schritt 3: Richten Sie Ihre Umgebung ein

Für Python:

pip install --upgrade 'openai>=1.0'

Für Node.js:

npm install openai@latest

Schritt 4: Konfigurieren Sie Ihren API-Schlüssel

Legen Sie Ihren API-Schlüssel als Umgebungsvariable fest:

macOS/Linux:

export MOONSHOT_API_KEY="your-api-key-here"

Windows (PowerShell):

[System.Environment]::SetEnvironmentVariable("MOONSHOT_API_KEY", "your-api-key-here", "User")

Windows (Eingabeaufforderung):

setx MOONSHOT_API_KEY "your-api-key-here"

Python Code-Beispiele

Grundlegende Chat-Vervollständigung

Hier ist ein einfaches Beispiel, um mit Kimi K2.5 zu beginnen:

import os

from openai import OpenAI

# Initialize the client with Moonshot AI endpoint

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

# Create a chat completion

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[

{

"role": "system",

"content": "You are Kimi, an AI assistant developed by Moonshot AI. You are helpful, harmless, and honest."

},

{

"role": "user",

"content": "Explain the concept of mixture-of-experts architecture in neural networks."

}

],

temperature=0.6,

max_tokens=2048,

)

print(response.choices[0].message.content)

Streaming von Antworten

Für Echtzeitanwendungen verwenden Sie Streaming, um Antworten anzuzeigen, während sie generiert werden:

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

# Stream the response

stream = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[

{"role": "user", "content": "Write a Python function to implement binary search."}

],

stream=True,

temperature=0.3,

)

# Process the stream

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

Mehrstufige Konversation

Behalten Sie den Kontext über mehrere Austausche hinweg bei:

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

conversation_history = [

{"role": "system", "content": "You are a helpful coding assistant."}

]

def chat(user_message):

conversation_history.append({"role": "user", "content": user_message})

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=conversation_history,

temperature=0.6,

)

assistant_message = response.choices[0].message.content

conversation_history.append({"role": "assistant", "content": assistant_message})

return assistant_message

# Example conversation

print(chat("How do I create a REST API in Python?"))

print(chat("Can you show me how to add authentication to that?"))

print(chat("What about rate limiting?"))

Asynchrone Implementierung

Für Hochleistungsanwendungen verwenden Sie async/await:

import os

import asyncio

from openai import AsyncOpenAI

async def main():

client = AsyncOpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

# Run multiple requests concurrently

tasks = [

client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[{"role": "user", "content": f"What is {topic}?"}],

)

for topic in ["REST API", "GraphQL", "gRPC"]

]

responses = await asyncio.gather(*tasks)

for response in responses:

print(response.choices[0].message.content[:200])

print("-" * 50)

asyncio.run(main())

JavaScript/Node.js Beispiele

Grundlegende Chat-Vervollständigung

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MOONSHOT_API_KEY,

baseURL: 'https://api.moonshot.ai/v1',

});

async function chat(userMessage) {

const response = await client.chat.completions.create({

model: 'kimi-k2.5-preview',

messages: [

{

role: 'system',

content: 'You are Kimi, a helpful AI assistant.',

},

{

role: 'user',

content: userMessage,

},

],

temperature: 0.6,

});

return response.choices[0].message.content;

}

// Usage

const answer = await chat('How do I implement a binary search tree in JavaScript?');

console.log(answer);

Streaming mit Node.js

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MOONSHOT_API_KEY,

baseURL: 'https://api.moonshot.ai/v1',

});

async function streamChat(userMessage) {

const stream = await client.chat.completions.create({

model: 'kimi-k2.5-preview',

messages: [{ role: 'user', content: userMessage }],

stream: true,

});

for await (const chunk of stream) {

const content = chunk.choices[0]?.delta?.content;

if (content) {

process.stdout.write(content);

}

}

}

await streamChat('Explain microservices architecture');

Verwendung der Fetch API (Browser-/Edge-Funktionen)

async function callKimiAPI(prompt) {

const response = await fetch('https://api.moonshot.ai/v1/chat/completions', {

method: 'POST',

headers: {

'Authorization': `Bearer ${process.env.MOONSHOT_API_KEY}`,

'Content-Type': 'application/json',

},

body: JSON.stringify({

model: 'kimi-k2.5-preview',

messages: [{ role: 'user', content: prompt }],

temperature: 0.6,

}),

});

const data = await response.json();

return data.choices[0].message.content;

}

// Usage

const result = await callKimiAPI('What are the best practices for API design?');

console.log(result);

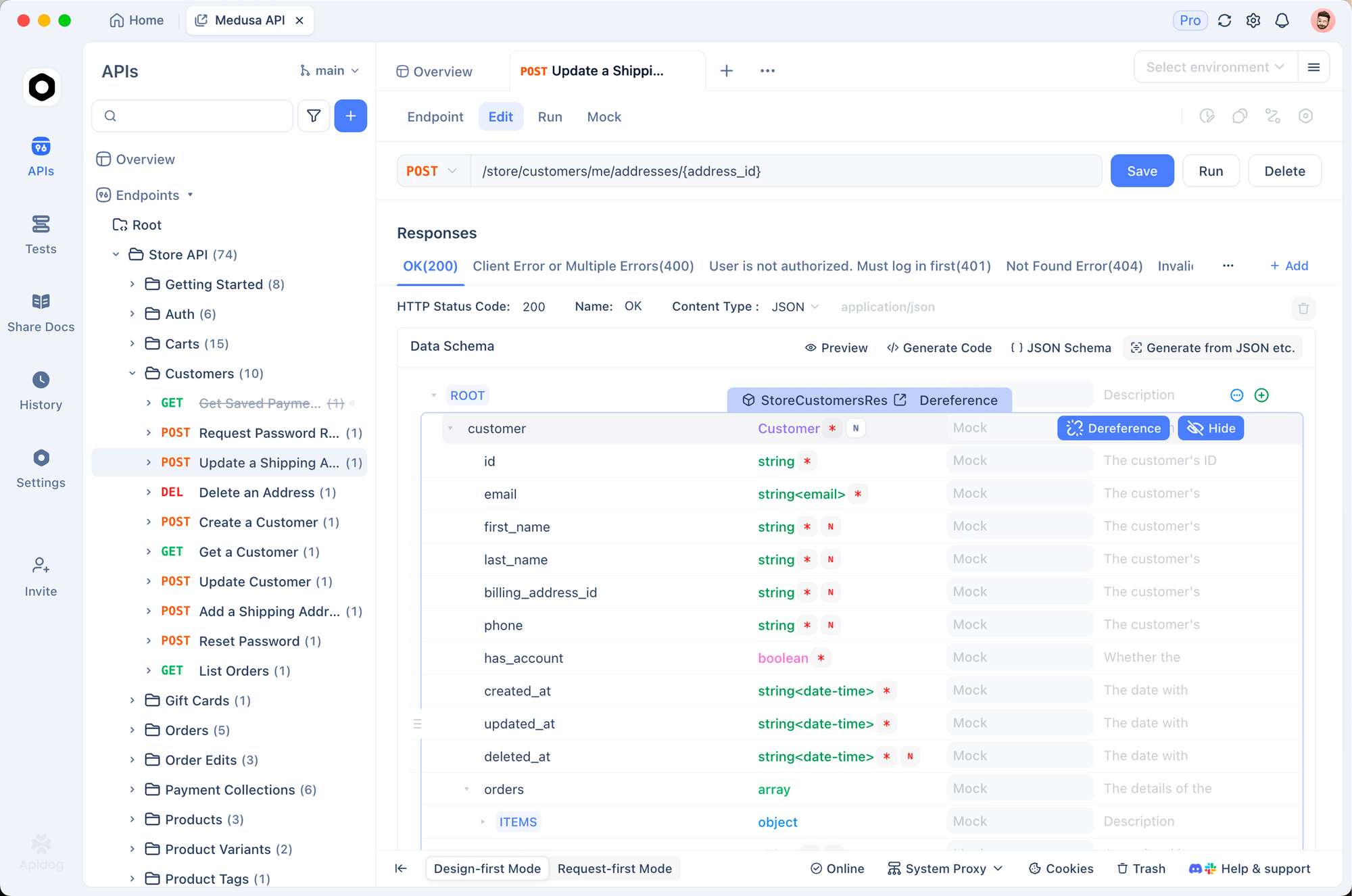

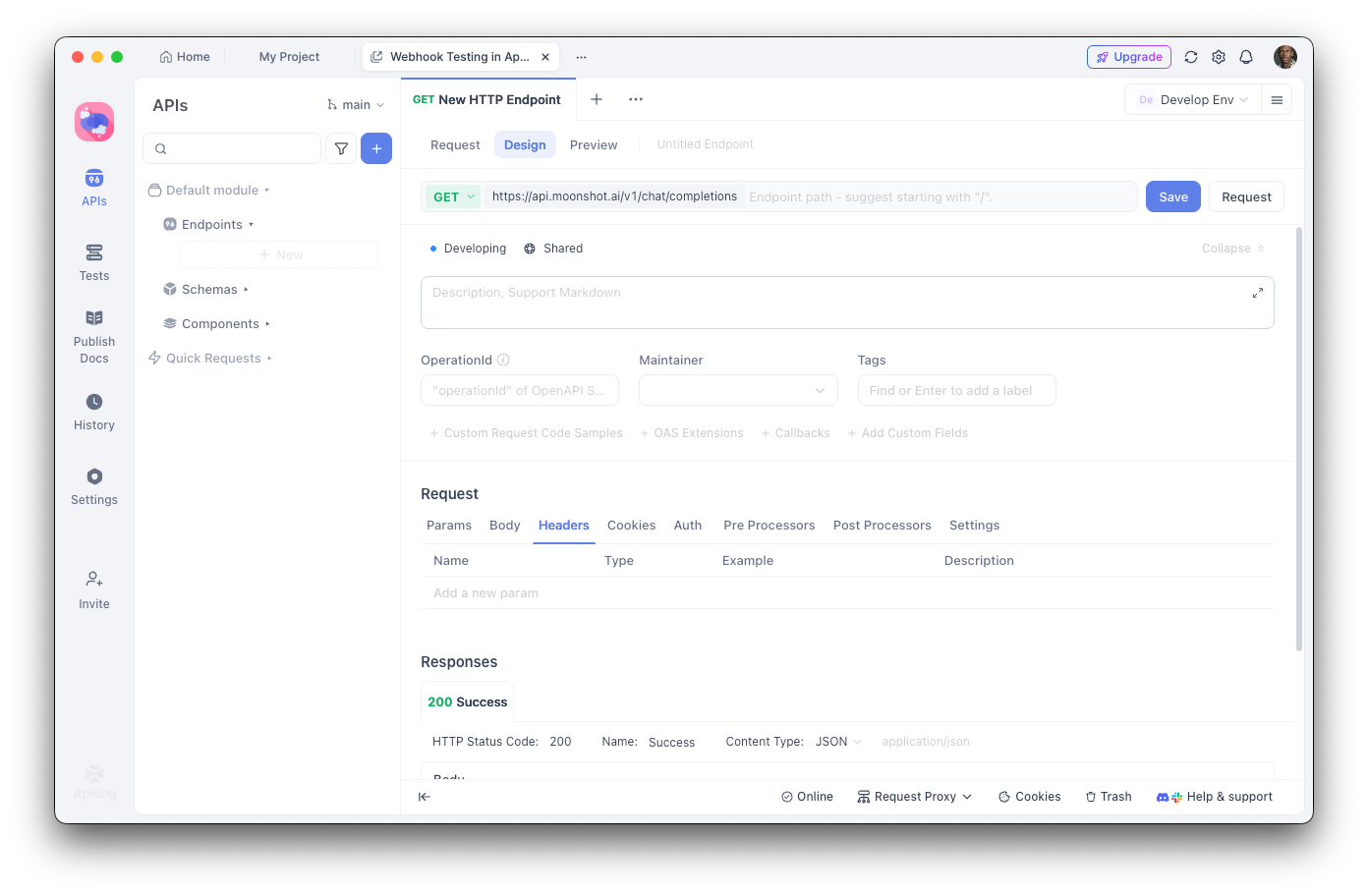

Testen der Kimi K2.5 API mit Apidog

Das effektive Testen von KI-APIs erfordert das Verständnis von Anfrage-/Antwortstrukturen, die Handhabung von Streaming, die Verwaltung der Authentifizierung und das Debuggen von Problemen. Apidog bietet eine umfassende Lösung für die API-Entwicklung, die die Arbeit mit Kimi K2.5 unkompliziert macht.

Einrichtung von Kimi K2.5 in Apidog

Schritt 1: Ein neues Projekt erstellen

- Öffnen Sie Apidog und erstellen Sie ein neues Projekt namens "Kimi K2.5 Integration"

- Dies organisiert alle Ihre Kimi-bezogenen Endpunkte an einem Ort

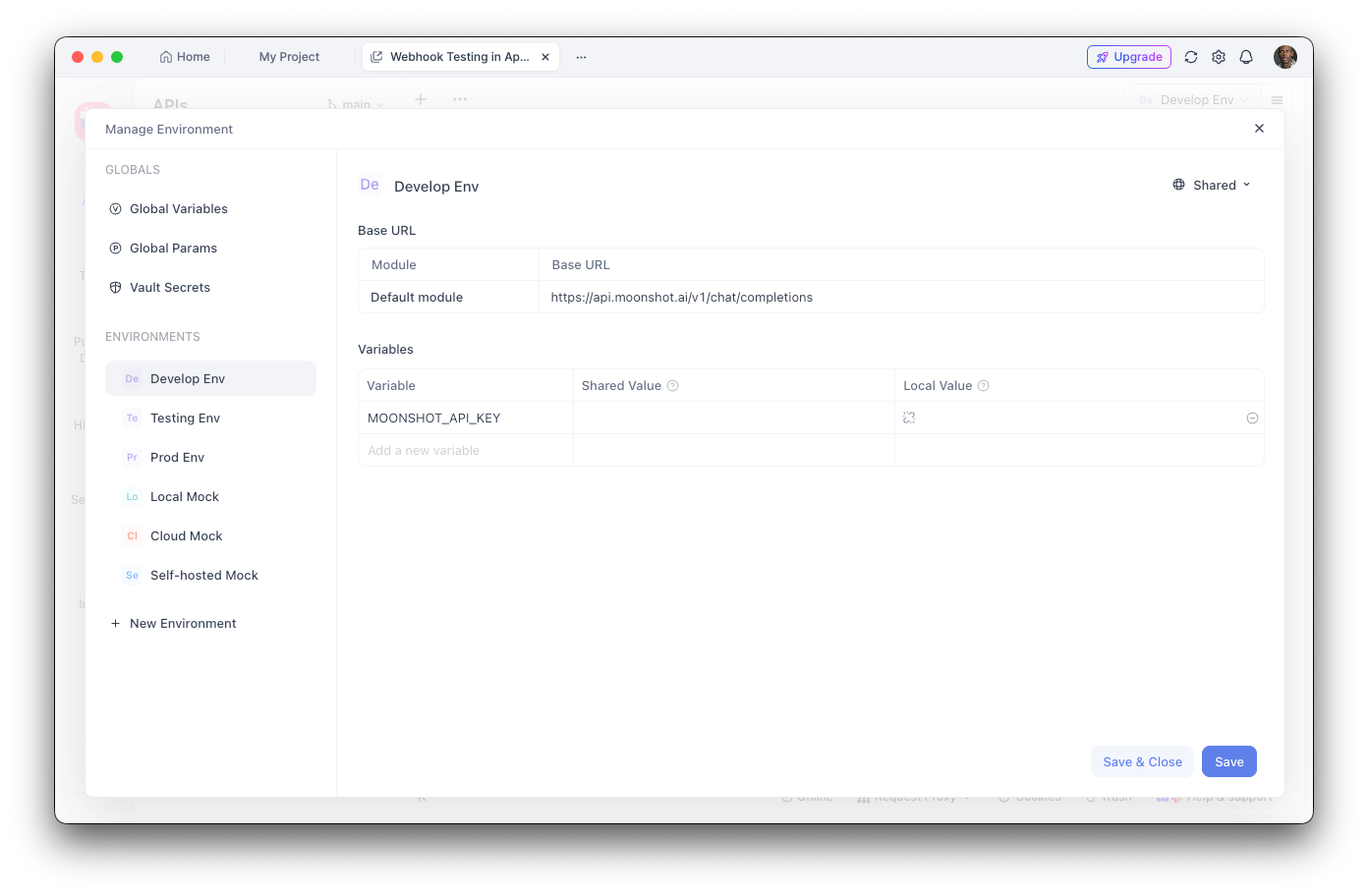

Schritt 2: Umgebungsvariablen konfigurieren

- Navigieren Sie zu den Umgebungseinstellungen

- Fügen Sie eine neue Umgebungsvariable hinzu:

- Name:

MOONSHOT_API_KEY - Wert: Ihr API-Schlüssel

- Als "Sensitiv" markieren, um den Wert zu verbergen

Schritt 3: Den Chat-Vervollständigungs-Endpunkt erstellen

- Fügen Sie eine neue POST-Anfrage hinzu

- URL:

https://api.moonshot.ai/v1/chat/completions - Header:

Authorization:Bearer {{MOONSHOT_API_KEY}}Content-Type:application/json

Schritt 4: Den Anfragetext konfigurieren

{

"model": "kimi-k2.5-preview",

"messages": [

{

"role": "system",

"content": "You are a helpful AI assistant."

},

{

"role": "user",

"content": "Hello, how can you help me today?"

}

],

"temperature": 0.6,

"max_tokens": 2048,

"stream": false

}

Debugging mit Apidog

Die visuelle Oberfläche von Apidog hilft Ihnen dabei:

- Antwortstruktur überprüfen: Sehen Sie die vollständige JSON-Antwort mit Syntaxhervorhebung

- Latenz messen: Verfolgen Sie Antwortzeiten zur Leistungsoptimierung

- Header anzeigen: Debuggen Sie Authentifizierungs- und Ratenbegrenzungsprobleme

- Testfälle speichern: Erstellen Sie wiederverwendbare Anfragenerfassungen für Regressionstests

- Code generieren: Exportieren Sie funktionierenden Code in Python, JavaScript, cURL und mehr

Automatisierte Tests erstellen

Mit dem Test-Runner von Apidog können Sie Ihre Kimi K2.5-Integration überprüfen:

// Testskript nach der Antwort in Apidog

pm.test("Response status is 200", function () {

pm.response.to.have.status(200);

});

pm.test("Response contains choices", function () {

const response = pm.response.json();

pm.expect(response.choices).to.be.an('array');

pm.expect(response.choices.length).to.be.greaterThan(0);

});

pm.test("Response content is not empty", function () {

const response = pm.response.json();

pm.expect(response.choices[0].message.content).to.not.be.empty;

});

Werkzeugaufruf und Agentenfähigkeiten

Eine der mächtigsten Funktionen von Kimi K2.5 ist seine Fähigkeit, externe Tools aufzurufen. Dies ermöglicht den Aufbau hochentwickelter KI-Agenten, die mit externen Systemen interagieren können.

Tools definieren

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

# Define available tools

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get the current weather for a location",

"parameters": {

"type": "object",

"properties": {

"location": {

"type": "string",

"description": "City and country, e.g., 'London, UK'"

},

"unit": {

"type": "string",

"enum": ["celsius", "fahrenheit"],

"description": "Temperature unit"

}

},

"required": ["location"]

}

}

},

{

"type": "function",

"function": {

"name": "search_database",

"description": "Search a database for information",

"parameters": {

"type": "object",

"properties": {

"query": {

"type": "string",

"description": "Search query"

},

"limit": {

"type": "integer",

"description": "Maximum number of results"

}

},

"required": ["query"]

}

}

}

]

# Make a request with tools

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[

{"role": "user", "content": "What's the weather like in Tokyo?"}

],

tools=tools,

tool_choice="auto",

)

# Handle tool calls

if response.choices[0].message.tool_calls:

for tool_call in response.choices[0].message.tool_calls:

print(f"Tool: {tool_call.function.name}")

print(f"Arguments: {tool_call.function.arguments}")

Werkzeugaufrufe ausführen

import json

def execute_tool_call(tool_call):

"""Führt einen Werkzeugaufruf aus und gibt das Ergebnis zurück."""

name = tool_call.function.name

args = json.loads(tool_call.function.arguments)

if name == "get_weather":

# Simulate weather API call

return json.dumps({

"location": args["location"],

"temperature": 22,

"unit": args.get("unit", "celsius"),

"condition": "sunny"

})

elif name == "search_database":

# Simulate database search

return json.dumps({

"results": [

{"id": 1, "title": "Result 1"},

{"id": 2, "title": "Result 2"}

]

})

return json.dumps({"error": "Unknown tool"})

# Complete the conversation with tool results

messages = [

{"role": "user", "content": "What's the weather in Tokyo?"}

]

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=messages,

tools=tools,

)

if response.choices[0].message.tool_calls:

# Add assistant message with tool calls

messages.append(response.choices[0].message)

# Execute each tool and add results

for tool_call in response.choices[0].message.tool_calls:

result = execute_tool_call(tool_call)

messages.append({

"role": "tool",

"tool_call_id": tool_call.id,

"content": result

})

# Get final response

final_response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=messages,

tools=tools,

)

print(final_response.choices[0].message.content)

Vision und multimodale Funktionen

Die nativen multimodalen Fähigkeiten von K2.5 ermöglichen die Verarbeitung von Bildern zusammen mit Text:

import os

import base64

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

def encode_image(image_path):

"""Bild in Base64 kodieren."""

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode("utf-8")

# Bild analysieren

image_base64 = encode_image("screenshot.png")

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "Analyze this UI design and suggest improvements."

},

{

"type": "image_url",

"image_url": {

"url": f"data:image/png;base64,{image_base64}"

}

}

]

}

],

max_tokens=2048,

)

print(response.choices[0].message.content)

Codegenerierung aus visueller Eingabe

# Code aus einem Wireframe generieren

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[

{

"role": "system",

"content": "You are an expert frontend developer. Generate clean, production-ready code."

},

{

"role": "user",

"content": [

{

"type": "text",

"text": "Convert this wireframe into a React component with Tailwind CSS styling."

},

{

"type": "image_url",

"image_url": {

"url": f"data:image/png;base64,{encode_image('wireframe.png')}"

}

}

]

}

],

temperature=0.3,

)

print(response.choices[0].message.content)

Preise und Ratenbegrenzungen

Wichtige Punkte:

- Der kostenlose Tarif umfasst 1,5 Mio. Tokens/Tag

- Tier 1+ hat unbegrenzte tägliche Tokens

- Token-Caching erfolgt automatisch ohne Konfiguration

- Websuche kostet zusätzlich 0,005 $ pro Aufruf

Best Practices und Tipps

Token-Nutzung optimieren

# System-Prompts effizient nutzen

system_prompt = """Sie sind ein prägnanter technischer Assistent.

Regeln: 1) Seien Sie kurz 2) Verwenden Sie Codeblöcke 3) Überspringen Sie Höflichkeiten"""

# Caching für wiederholte Kontexte aktivieren

# Moonshot cacht ähnliche Prompts automatisch

Temperatureinstellungen

- 0.0-0.3: Codegenerierung, faktenbasierte Antworten

- 0.4-0.6: Ausgewogenheit zwischen Kreativität und Genauigkeit

- 0.7-1.0: Kreatives Schreiben, Brainstorming

Fehlerbehandlung

from openai import OpenAI, APIError, RateLimitError

client = OpenAI(

api_key=os.environ.get("MOONSHOT_API_KEY"),

base_url="https://api.moonshot.ai/v1",

)

def safe_chat(message, retries=3):

for attempt in range(retries):

try:

response = client.chat.completions.create(

model="kimi-k2.5-preview",

messages=[{"role": "user", "content": message}],

)

return response.choices[0].message.content

except RateLimitError:

if attempt < retries - 1:

time.sleep(2 ** attempt) # Exponentieller Backoff

else:

raise

except APIError as e:

print(f"API-Fehler: {e}")

raise

result = safe_chat("Hello, Kimi!")

Fehlerbehebung bei häufigen Problemen

Authentifizierungsfehler

Problem: 401 Unauthorized Fehler

Lösungen:

- Überprüfen Sie, ob Ihr API-Schlüssel korrekt ist

- Stellen Sie sicher, dass der Schlüssel nicht abgelaufen ist

- Stellen Sie sicher, dass das Format des

Authorization-Headers korrekt ist:Bearer IHR_SCHLÜSSEL

Ratenbegrenzung

Problem: 429 Too Many Requests

Lösungen:

- Implementieren Sie einen exponentiellen Backoff

- Werten Sie Ihren Tarif durch Hinzufügen von Guthaben auf

- Überwachen Sie die

X-RateLimit-RemainingHeader

Kontextlänge überschritten

Problem: Anfrage überschreitet das 256K Token-Limit

Lösungen:

- Fassen Sie lange Konversationen zusammen

- Verwenden Sie einen Gleitfenster-Ansatz

- Teilen Sie die Anfrage in mehrere auf

Timeout-Probleme

Problem: Anfragen laufen ins Timeout

Lösungen:

- Verwenden Sie Streaming für lange Antworten

- Erhöhen Sie die Client-Timeout-Einstellungen

- Teilen Sie komplexe Prompts in kleinere Aufgaben auf

Bereit, mit Kimi K2.5 zu bauen? Laden Sie Apidog herunter, um Ihren API-Entwicklungsworkflow mit visuellen Tests, automatischer Dokumentation und Teamkollaborationsfunktionen zu optimieren, die die Integration von KI-APIs schneller und zuverlässiger machen.