Hallo, lieber Entwicklerkollege! Wenn Sie schon einmal mit automatisierten Tests gearbeitet haben, kennen Sie das mulmige Gefühl, wenn ein Test fehlschlägt, obwohl sich am Code nichts geändert hat. Lassen Sie uns eine Szene skizzieren, ich wette, sie ist nur allzu vertraut. Sie pushen Ihren wunderschön erstellten Code, zuversichtlich, dass es Ihre bisher beste Arbeit ist. Sie starten die Continuous-Integration-Pipeline (CI) und warten auf das befriedigende grüne Häkchen. Doch stattdessen erhalten Sie ein großes, wütendes rotes X. Ihr Herz sinkt. „Was habe ich kaputt gemacht?!“ Sie überprüfen hektisch die Protokolle, nur um festzustellen... einen zufälligen Testfehler. Sie führen ihn erneut aus: manchmal besteht er, manchmal nicht.

Klingt vertraut? Sie, mein Freund, sind gerade Opfer eines Flaky Tests geworden.

Und hier ist die Wahrheit: Flaky Tests verschwenden Entwicklerzeit, verlangsamen CI/CD-Pipelines und führen zu massiver Frustration in Teams. Flaky Tests sind die spukenden Poltergeister der Softwareentwicklung. Sie schlagen unvorhersehbar und scheinbar zufällig fehl, untergraben das Vertrauen in Ihren gesamten Testprozess, verschwenden unzählige Stunden für Untersuchungen und verlangsamen die Auslieferung erheblich. Tatsächlich sind sie ein so universelles Problem, dass Branchenführer wie Google umfangreiche Forschung zur Beseitigung dieser Tests veröffentlicht haben.

Aber hier ist die gute Nachricht: Flaky Tests sind keine Magie. Sie haben spezifische, identifizierbare Ursachen. Und was identifiziert werden kann, kann auch behoben werden. Sie können mit ihnen umgehen, sobald Sie ihre Ursachen verstehen.

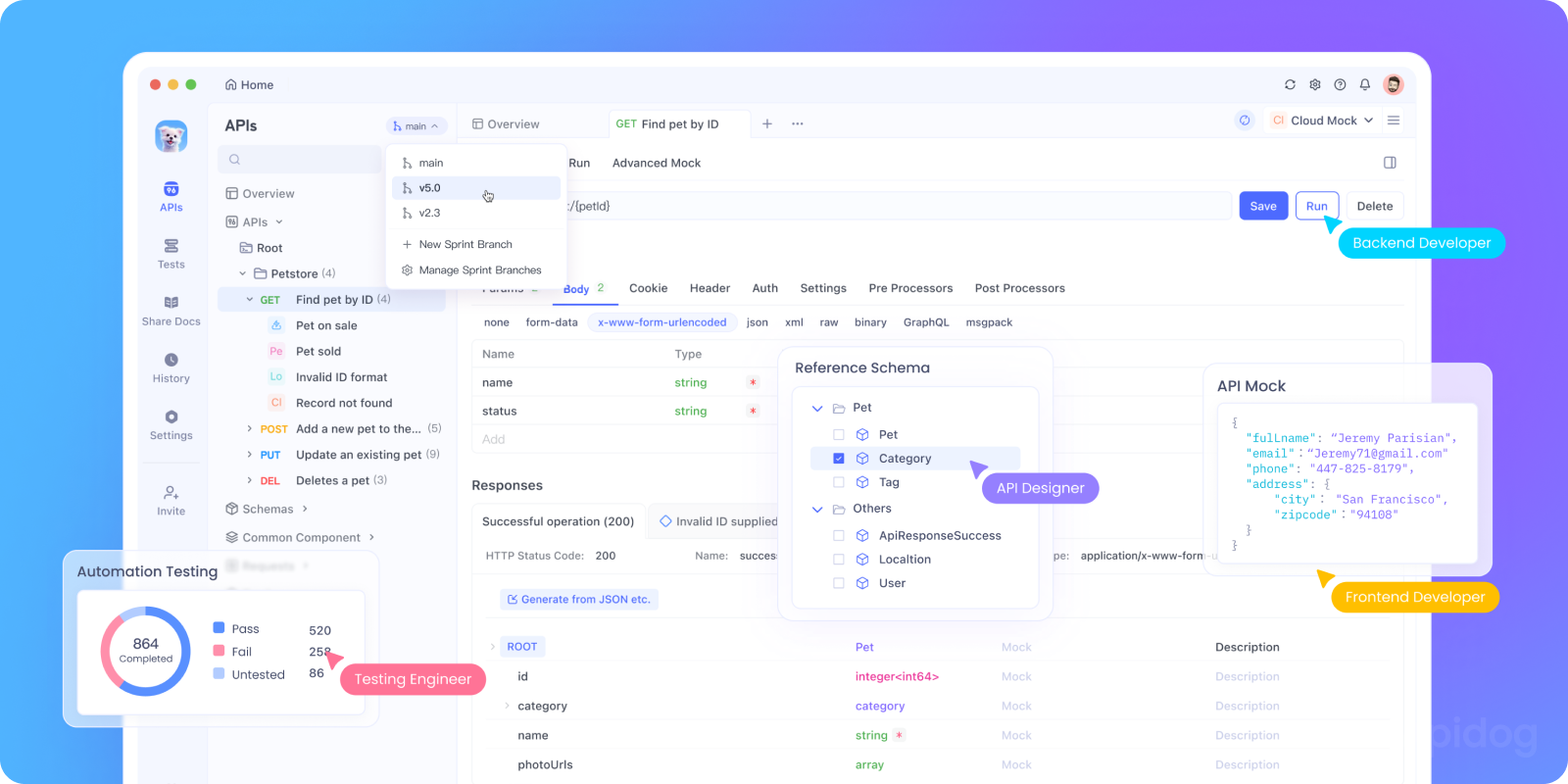

Möchten Sie eine integrierte All-in-One-Plattform, damit Ihr Entwicklerteam mit maximaler Produktivität zusammenarbeiten kann?

Apidog erfüllt all Ihre Anforderungen und ersetzt Postman zu einem wesentlich günstigeren Preis!

Was genau ist eigentlich ein Flaky Test?

Bevor wir die Übeltäter auflisten, lassen Sie uns unseren Erzfeind definieren. Ein Flaky Test ist ein Test, der sowohl bestanden als auch fehlgeschlagen ist, wenn er mehrmals mit derselben, *identischen Version des Codes* ausgeführt wird. Es ist kein Test, der aufgrund eines Fehlers konsistent fehlschlägt. Es ist ein Test, der inkonsistent fehlschlägt, was ihn zu einem lauten und unzuverlässigen Indikator für die Code-Gesundheit macht.

Zum Beispiel:

- Lauf #1 → ✅ Bestanden

- Lauf #2 → ❌ Fehlgeschlagen

- Lauf #3 → ✅ Wieder bestanden

Die Kosten dieser Tests sind immens. Sie führen zu:

- Dem „Erneut ausführen und Beten“-Zyklus: Verschwendung von Entwickler- und CI-Ressourcen.

- Alarmmüdigkeit: Wenn Tests oft grundlos fehlschlagen, beginnen Teams, Fehler zu ignorieren, was bedeutet, dass echte Fehler durchrutschen.

- Langsamerer Entwicklungsgeschwindigkeit: Kaputte Builds und Untersuchungszeiten verlangsamen das gesamte Team.

Warum Flaky Tests für Teams gefährlich sind

Sie könnten denken: „Es ist nur ein Test, der fehlschlägt, ich werde ihn erneut ausführen.“ Aber hier ist das Problem:

- Verlorenes Vertrauen → Entwickler vertrauen Testergebnissen nicht mehr.

- Langsamere CI/CD → Pipelines werden durch Wiederholungsversuche verstopft.

- Versteckte Fehler → Echte Probleme werden ignoriert, weil die Leute annehmen: „Ach, das ist nur ein Flaky Test.“

- Erhöhte Kosten → Mehr Wiederholungen bedeuten mehr Zeit, Ressourcen und Infrastruktur.

Laut Branchenstudien verbringen einige Unternehmen bis zu 40 % der Testzeit mit der Beseitigung von Flakiness. Das ist enorm!

Nun, lernen wir die üblichen Verdächtigen kennen.

Die Ursachen und Behebungen von Flaky Tests

1. Asynchrone Operationen und Race Conditions

Dies ist wohl der König der Flaky Tests. In modernen Anwendungen ist alles asynchron – API-Aufrufe, Datenbankoperationen, UI-Updates. Wenn Ihr Test nicht richtig wartet, bis diese Operationen abgeschlossen sind, rät er im Wesentlichen. Manchmal rät er richtig (die Operation ist schnell abgeschlossen), und manchmal rät er falsch (sie ist langsam), was zu einem Fehler führt.

Warum es passiert: Ihr Testcode wird synchron ausgeführt, der von ihm getestete Anwendungscode jedoch nicht.

Beispiel: Ein Test, der auf einen „Speichern“-Button klickt und sofort die Datenbank auf den neuen Datensatz überprüft, ohne auf den Abschluss der Netzwerkanfrage des Speichervorgangs zu warten.

Die Lösung:

- Verwenden Sie explizite Wartezeiten: Verwenden Sie niemals statische

sleep()- odersetTimeout()-Aufrufe. Diese sind eine Hauptursache für Flakiness, da Sie entweder zu lange warten (was Tests verlangsamt) oder nicht lange genug (was zu Fehlern führt). - Wartestrategien anwenden: Verwenden Sie Tools, die es Ihnen ermöglichen, auf eine bestimmte Bedingung zu warten. Zum Beispiel:

- UI-Tests: Warten Sie, bis ein Element sichtbar, anklickbar ist oder bestimmten Text enthält.

- API-Tests: Warten Sie auf einen bestimmten HTTP-Antwortstatus oder darauf, dass eine Payload in der Datenbank erscheint.

- Selenium/WebDriver: Verwenden Sie

WebDriverWaitmitexpected_conditions. - Cypress: Cypress verfügt über eine integrierte automatische Wartefunktion für die meisten Befehle, was fantastisch ist, um dieses Problem zu vermeiden.

2. Probleme mit der Testisolation

Tests sollten wie höfliche Fremde sein: Sie sollten kein Chaos für die nächste Person hinterlassen. Wenn Tests den Zustand teilen und sich nicht selbst aufräumen, können sie sich leicht gegenseitig stören. Test A erstellt einen Benutzer „test@example.com“, besteht, löscht ihn aber nicht. Test B versucht dann, denselben Benutzer zu erstellen, und schlägt aufgrund einer Verletzung der Eindeutigkeitsbedingung fehl.

Warum es passiert: Gemeinsam genutzte Ressourcen wie Datenbanken, Caches oder Dateisysteme werden von einem Test geändert, wodurch der Ausgangszustand für den nächsten Test verändert wird.

Die Lösung:

- Sorgen Sie für vollständige Isolation: Jeder Test sollte seine eigenen erforderlichen Daten einrichten und diese anschließend vollständig wieder entfernen. Dies ist die goldene Regel.

- Verwenden Sie Transaktionen: Ein leistungsstarkes Muster ist es, jeden Test innerhalb einer Datenbanktransaktion auszuführen und diese am Ende rückgängig zu machen. Dadurch bleibt die Datenbank vollständig unberührt.

- Generieren Sie eindeutige Daten: Verwenden Sie eindeutige Bezeichner (wie UUIDs oder Zeitstempel) in den Testdaten, um Konflikte zu vermeiden. Zum Beispiel:

test.user.<timestamp>@example.com.

3. Abhängigkeiten von externen Diensten

Ruft Ihre Testsuite eine Drittanbieter-API für die Zahlungsabwicklung, Wetterdaten oder E-Mail-Validierung auf? Wenn ja, haben Sie eine massive Fehlerquelle eingeführt, die vollständig außerhalb Ihrer Kontrolle liegt. Diese API könnte langsam sein, Sie ratenbegrenzen, wegen Wartungsarbeiten nicht verfügbar sein oder ihr Antwortformat leicht geändert haben – all dies führt dazu, dass Ihre Tests ohne Ihr Verschulden fehlschlagen.

Warum es passiert: Der Erfolg des Tests ist an die Gesundheit und Leistung eines externen Systems gekoppelt.

Die Lösung:

- Externe Dienste mocken und stubben: Dies ist die wichtigste Strategie. Anstatt einen echten HTTP-Aufruf zu tätigen, fangen Sie die Anfrage ab und geben Sie eine gefälschte, vordefinierte Antwort zurück, die einen Erfolgs- oder Fehlerfall simuliert.

- Verwenden Sie Tools zum Mocking: Hier glänzt Apidog. Apidog ermöglicht es Ihnen, leistungsstarke Mocks für Ihre APIs zu erstellen. Sie können genau definieren, welche Antwort eine API für eine bestimmte Anfrage zurückgeben soll, wodurch die Abhängigkeit vom echten, unzuverlässigen externen Dienst vollständig entfällt. Ihre Tests werden schnell, zuverlässig und vorhersehbar.

- Service Virtualization verwenden: Für komplexere Szenarien können Tools verwendet werden, die das Verhalten ganzer externer Systeme simulieren.

4. Unverwaltete Testdaten

Ähnlich wie bei Isolationsproblemen, aber umfassender. Wenn Ihre Tests einen bestimmten Zustand der Datenbank annehmen (z. B. „es müssen genau 5 Benutzer vorhanden sein“ oder „ein Produkt mit der ID 123 muss existieren“), schlagen sie in dem Moment fehl, in dem diese Annahme falsch ist. Dies geschieht häufig bei Tests, die gegen eine gemeinsam genutzte Entwicklungs- oder Staging-Datenbank ausgeführt werden, die sich ständig ändert.

Warum es passiert: Tests treffen implizite Annahmen über den Datenzustand der Umgebung.

Die Lösung:

- Alle Daten explizit verwalten: Ein Test sollte niemals etwas über die Welt annehmen. Er sollte alle Daten erstellen, die er zum Ausführen benötigt.

- Verwenden Sie Factories und Fixtures: Bibliotheken wie

factory_bot(Ruby) oder ähnliche Muster in anderen Sprachen helfen Ihnen, die genauen Daten, die für jeden Test benötigt werden, einfach zu generieren. - Vermeiden Sie fest codierte IDs: Verlassen Sie sich niemals darauf, dass eine bestimmte Datensatz-ID existiert. Erstellen Sie den Datensatz und verwenden Sie dessen generierte ID in Ihren Testzusicherungen.

5. Parallelität und parallele Testausführung

Tests parallel auszuführen ist entscheidend für die Geschwindigkeit. Wenn Ihre Tests jedoch nicht dafür ausgelegt sind, werden sie sich gegenseitig behindern. Zwei gleichzeitig ausgeführte Tests könnten versuchen, auf dieselbe Datei zuzugreifen, denselben Port auf einem lokalen Server zu verwenden oder denselben Datenbankdatensatz zu ändern.

Warum es passiert: Tests werden gleichzeitig ausgeführt, wurden aber unter der Annahme geschrieben, dass sie einzeln laufen würden.

Die Lösung:

- Von Anfang an auf Parallelität ausgelegen: Gehen Sie davon aus, dass Tests parallel ausgeführt werden.

- Ressourcen isolieren: Stellen Sie sicher, dass jeder parallele Test-Runner seine eigene isolierte Umgebung hat: ein einzigartiges Datenbankschema, einen einzigartigen Port für lokale Server usw.

- Verwenden Sie Thread-sichere Operationen: Achten Sie auf jeden gemeinsam genutzten In-Memory-Zustand.

6. Abhängigkeit von der Systemzeit

„Schlägt dieser Test nach 17 Uhr fehl?“ Es klingt albern, aber es passiert. Tests, die die reale Systemzeit verwenden (new Date(), DateTime.Now), können sich je nach Ausführungszeit unterschiedlich verhalten. Ein Test, der überprüft, ob ein „Tagesbericht“ generiert wurde, könnte beim einmaligen Ausführen um 23:59 Uhr bestehen und dann fehlschlagen, wenn er zwei Minuten später um 00:01 Uhr erneut ausgeführt wird.

Warum es passiert: Die Systemuhr ist eine externe, sich ändernde Eingabe.

Die Lösung:

- Die Zeit mocken: Verwenden Sie Bibliotheken, die es Ihnen ermöglichen, die Zeit „einzufrieren“ oder „zu reisen“. Bibliotheken wie

timecop(Ruby),freezegun(Python) oderMockitosmockStaticfürjava.time(Java) ermöglichen es Ihnen, eine bestimmte Zeit für Ihren Test festzulegen, wodurch dieser vollständig deterministisch wird.

7. Nicht-deterministischer Code in Tests

Dieser Punkt ist subtil. Wenn der zu testende Code nicht-deterministisch ist (z. B. einen Zufallszahlengenerator verwendet oder eine Liste mischt), kann Ihr Test keine konsistente Aussage über seine Ausgabe treffen.

Warum es passiert: Die Anwendungslogik selbst enthält Zufälligkeit.

Die Lösung:

- Zufallszahlengeneratoren seeden: Die meisten Zufallszahlengeneratoren können mit einem festen Wert initialisiert werden. Dadurch ist die Reihenfolge der „zufälligen“ Zahlen jedes Mal identisch, was den Test deterministisch macht.

- Verhalten testen, nicht Implementierung: Anstatt eine genaue Aussage über die Ausgabe einer

shuffle()-Funktion (die per Definition zufällig ist) zu treffen, machen Sie eine Aussage über das Verhalten. Beispielsweise können Sie zusichern, dass die Ausgabeliste alle Elemente der Eingabeliste enthält, nur in einer anderen Reihenfolge. Oder mocken Sie die shuffle-Funktion, um während des Tests eine feste Reihenfolge zurückzugeben.

8. Anfällige UI-Selektoren

Dies ist die klassische Flakiness bei Frontend-Tests. Ihr Test findet ein Element auf der Seite mithilfe eines CSS-Selektors wie #main > div > div > div:nth-child(3) > button. Ein Entwickler passt dann die HTML-Struktur leicht an, indem er ein neues div für das Styling hinzufügt, und schon ist Ihr Selektor kaputt, obwohl die Funktionalität einwandfrei ist.

Warum es passiert: Selektoren sind zu eng an die DOM-Struktur gekoppelt, die volatil ist.

Die Lösung:

- Robuste Locators verwenden: Priorisieren Sie Selektoren, die sich weniger wahrscheinlich ändern.

- Am besten: Verwenden Sie ein dediziertes

data-testid-Attribut (z. B.<button data-testid="sign-up-button">). Dies entkoppelt das Testen von Styling und Struktur. - Gut: Verwenden Sie IDs (

#submit-button), aber nur, wenn sie stabil sind und nicht für CSS verwendet werden. - Okay: Verwenden Sie ARIA-Rollen oder Textinhalte, aber Vorsicht bei Internationalisierung und Textänderungen.

- Vermeiden: Komplexe, verschachtelte CSS-/XPath-Pfade basierend auf der Struktur.

9. Ressourcenlecks und Fehler bei der Bereinigung

Tests, die Ressourcen nicht ordnungsgemäß schließen, können dazu führen, dass nachfolgende Tests auf seltsame Weise fehlschlagen. Dies könnte das Offenlassen von Datenbankverbindungen, das Nicht-Schließen von Browserinstanzen oder das Nicht-Löschen temporärer Dateien sein. Schließlich gehen dem System die Ressourcen aus, was zu Timeouts oder Abstürzen führt.

Warum es passiert: Der Testcode verfügt nicht über eine ordnungsgemäße Teardown-/Bereinigungslogik.

Die Lösung:

- Verwenden Sie

beforeEach/afterEachHooks: Strukturieren Sie Ihre Tests so, dass sie immer in einer dedizierten Teardown-Phase bereinigt werden, auch wenn der Test fehlschlägt. Die meisten Test-Frameworks bieten Hooks dafür. - Verwenden Sie die richtigen Muster: Verwenden Sie Muster wie die

using-Anweisung (C#) odertry-with-resources(Java), um sicherzustellen, dass Ressourcen automatisch geschlossen werden.

10. Umgebungsinkonsistenzen

„Der Test funktioniert auf meinem Rechner!“ Dieser klassische Ausruf wird oft durch Umgebungs-Flakiness verursacht. Unterschiede in Betriebssystemen, Browserversionen, Node.js-Versionen, installierten Bibliotheken oder Umgebungsvariablen zwischen dem lokalen Rechner eines Entwicklers und dem CI-Server können dazu führen, dass Tests unvorhersehbar fehlschlagen.

Warum es passiert: Die Testumgebung ist nicht reproduzierbar.

Die Lösung:

- Alles containerisieren: Verwenden Sie Docker, um Ihre Testumgebung zu definieren. Ein

Dockerfilestellt sicher, dass jeder Testlauf – lokal und CI – in einer identischen, kontrollierten Umgebung stattfindet. - Alles versionieren: Verwenden Sie

package-lock.json,Gemfile.lock,Pipfile.lockusw., um die genauen Versionen all Ihrer Abhängigkeiten festzulegen. - Konfiguration sicher verwalten: Verwenden Sie eine konsistente und sichere Methode zur Handhabung von Umgebungsvariablen und Geheimnissen, die für Tests benötigt werden.

So erkennen Sie Flaky Tests in Ihrer Pipeline

Flaky Tests frühzeitig zu erkennen ist entscheidend. Hier sind Strategien:

- Tests automatisch erneut ausführen → Wenn ein Test nach der erneuten Ausführung besteht, markieren Sie ihn als flaky.

- Fehlermuster verfolgen → CI/CD-Protokolle zeigen oft wiederkehrende Flaky Tests.

- Flaky Tests isolieren → Markieren Sie sie und führen Sie sie separat aus, bis sie behoben sind.

- Überwachungstools verwenden → Tools wie Jenkins, CircleCI und GitHub Actions können Test-Flakiness melden.

Flaky Tests mit Apidog reduzieren

Da viele Flaky Tests mit APIs und externen Abhängigkeiten zusammenhängen, hilft Ihnen Apidog dabei:

- Mock-Server zu erstellen, damit Sie sich nicht auf instabile echte APIs verlassen müssen.

- Testszenarien mit vorhersehbaren Ergebnissen zu automatisieren.

- Performance-Tests durchzuführen, um zu sehen, wie sich APIs unter Last verhalten.

- Alle Ihre API-Tests zu zentralisieren, damit Sie Flaky-Verhalten frühzeitig erkennen können.

Anstatt um 2 Uhr morgens zufällige Fehler zu debuggen, wissen Sie genau, ob es an Ihrem Code oder an einer unzuverlässigen externen Abhängigkeit liegt.

Best Practices zur Vermeidung von Flaky Tests

Hier ist eine schnelle Checkliste, um Test-Flakiness zu reduzieren:

- Schreiben Sie deterministische Tests mit vorhersehbaren Ergebnissen.

- Verwenden Sie Mocks/Stubs für APIs und Netzwerke.

- Vermeiden Sie fest codierte Verzögerungen – verwenden Sie ereignisgesteuerte Wartezeiten.

- Setzen Sie Testumgebungen zwischen den Läufen zurück.

- Überwachen Sie Tests im Laufe der Zeit, um Flaky-Muster zu erkennen.

- Dokumentieren Sie bekannte Flaky Tests, damit das Team Bescheid weiß.

Eine Kultur gegen Flakiness aufbauen

Einzelne Tests zu beheben ist eine Sache; sie zu verhindern, eine andere. Es erfordert eine Teamkultur, die Testzuverlässigkeit schätzt.

- Dulden Sie keine Flakiness: Wenn ein Test flaky ist, isolieren Sie ihn sofort. Verschieben Sie ihn in eine separate, nicht-blockierende Suite, damit er keine Bereitstellungen blockiert, aber planen Sie so schnell wie möglich Zeit für die Behebung ein.

- Flaky Tests verfolgen: Führen Sie eine sichtbare Liste bekannter Flaky Tests und priorisieren Sie deren Behebung.

- Tests in Code Reviews überprüfen: Behandeln Sie Testcode mit der gleichen Ernsthaftigkeit wie Produktionscode. Achten Sie während der Reviews auf die von uns besprochenen Anti-Muster.

Fazit: Von Flaky zu Robust

Flaky Tests sind eines der frustrierendsten Probleme in der Softwareentwicklung, sie sind ein Ärgernis, aber sie sind lösbar. Sie verschwenden Zeit, schaffen Misstrauen und verlangsamen Releases. Indem Sie diese Top 10 Ursachen – von asynchronen Wartezeiten und Testisolation bis hin zu externen Mocks und anfälligen Selektoren – verstehen, erhalten Sie die Macht, sie nicht nur zu beheben, sondern auch von Anfang an robustere, zuverlässigere Tests zu schreiben; Sie können sie systematisch beheben.

Denken Sie daran, eine Testsuite ist ein kritisches Frühwarnsystem für die Gesundheit Ihrer Anwendung. Ihr Wert ist direkt proportional zum Vertrauen, das das Entwicklungsteam in sie setzt. Durch die rücksichtslose Eliminierung von Flakiness bauen Sie dieses Vertrauen wieder auf und schaffen einen schnelleren, selbstbewussteren Entwicklungsworkflow. Die beste Strategie? Determinierte, isolierte und gut strukturierte Tests entwerfen.

Und für diese besonders kniffligen API-bezogenen Flakes: Denken Sie daran, dass ein Tool wie Apidog Ihr stärkster Verbündeter sein kann. Seine Mocking- und Testfunktionen sind speziell darauf ausgelegt, die stabile, vorhersehbare Umgebung zu schaffen, die Ihre Tests zum Gedeihen benötigen. Apidog kann Sie vor einer Welt voller Flaky-Test-Schmerzen bewahren, indem es stabile Umgebungen simuliert. Gehen Sie nun und machen Sie Ihre Testsuite unzerbrechlich.