Daten treiben moderne Geschäftsentscheidungen voran, aber nur, wenn sie genau, vollständig und zeitnah sind. ELT-Tests stellen sicher, dass die Daten, die durch Ihre Pipelines fließen – sei es in Data Lakes, Warehouses oder Analyseplattformen – die festgelegten Standards erfüllen. ELT (Extract, Load, Transform) ist zum dominierenden Muster für die moderne Datenintegration geworden, doch viele Teams tun sich schwer, es effektiv zu testen. Dieser Leitfaden bietet ein praktisches Framework zur Validierung von ELT-Pipelines in jeder Phase.

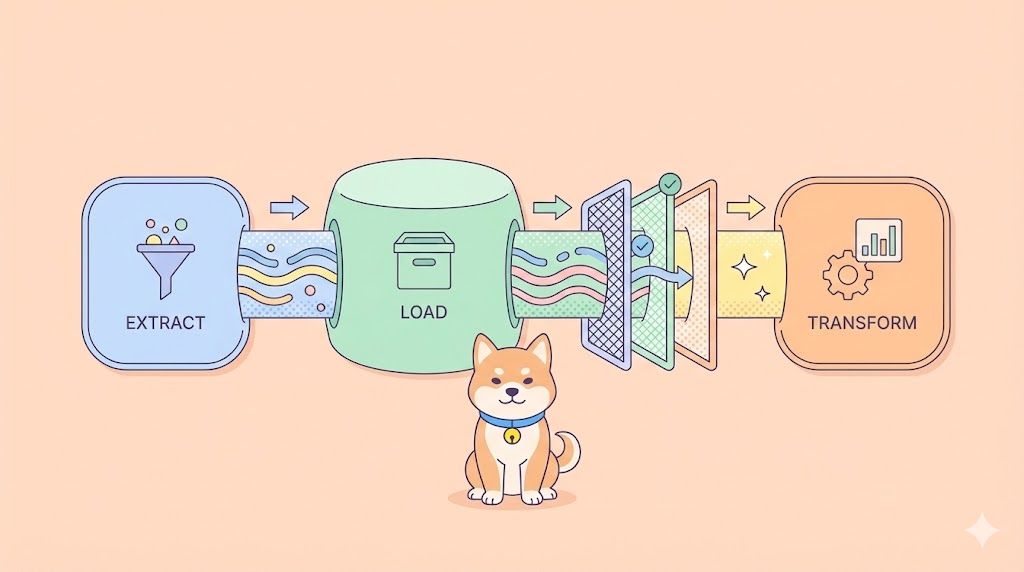

Was ist ELT und wie unterscheidet es sich von ETL

ELT (Extract, Load, Transform) kehrt die traditionelle ETL-Sequenz um. Anstatt Daten vor dem Laden zu transformieren, extrahieren Sie Rohdaten aus Quellsystemen, laden sie direkt in Ihr Zielsystem (Data Lake oder Warehouse) und transformieren sie dann vor Ort unter Nutzung der Rechenleistung des Zielsystems.

| Phase | ETL-Muster | ELT-Muster |

|---|---|---|

| Extrahieren | Daten aus Quellen ziehen | Daten aus Quellen ziehen |

| Transformieren | Bereinigen/Modifizieren im Staging-Bereich | Findet im Zielsystem statt |

| Laden | Transformierte Daten übertragen | Zuerst Rohdaten übertragen |

ELT-Tests müssen jede Phase validieren: die Vollständigkeit der Extraktion, die Integrität des Ladens und die Genauigkeit der Transformation – all dies unter Gewährleistung von Leistung und Datenqualität.

Warum ELT-Tests wichtig sind: Die geschäftlichen Auswirkungen

Schlecht getestete ELT-Pipelines verursachen kaskadierende Probleme:

- Datenkorruption: Ein einziger Transformationsfehler kann falsche Metriken an Executive Dashboards weiterleiten und zu Fehlentscheidungen in Millionenhöhe führen.

- Compliance-Risiko: DSGVO und HIPAA verlangen den Nachweis der Datenherkunft und -genauigkeit. ELT-Tests liefern Audit-Trails.

- Leistungsabfall: Ungestestete Pipelines, die täglich Terabytes verarbeiten, können unbemerkt langsamer werden und SLA-Fenster verpassen.

- Vertrauensverlust: Wenn Geschäftsteams Datenqualitätsprobleme entdecken, verlieren sie das Vertrauen in die Analyseplattform komplett.

Ein Einzelhandelsunternehmen entdeckte einmal, dass 15% seiner Verkaufsdaten in Berichten fehlten, weil eine ELT-Testlücke eine Schemaänderung in ihrem Quellsystem nicht erfasst hatte. Die Auswirkung: inkorrekte Bestandsplanung und Engpässe während der Hochsaison.

Wie ELT-Tests durchgeführt werden: Ein phasenweiser Ansatz

ELT-Tests folgen dem Datenfluss von der Quelle bis zur Nutzung. So validieren Sie jede Phase:

Phase 1: Extraktionstests

Überprüfen Sie, ob Daten vollständig und präzise aus Quellsystemen abgerufen werden.

Testfälle:

- Vollständigkeit: Anzahl der extrahierten Datensätze vs. Quellsystem

- Schema-Validierung: Sicherstellen, dass sich das Quellschema nicht unerwartet geändert hat

- Korrektheit der Datentypen: Zahlen bleiben Zahlen, Daten bleiben Daten

- Inkrementelle Extraktion: Es werden nur neue/geänderte Datensätze abgerufen

# Extraction completeness test

def test_extraction_completeness():

source_count = source_db.query("SELECT COUNT(*) FROM orders WHERE date = '2024-01-01'")

extracted_count = staging_area.query("SELECT COUNT(*) FROM raw_orders WHERE date = '2024-01-01'")

assert extracted_count == source_count, f"Missing {source_count - extracted_count} records"

Phase 2: Ladetests

Validieren Sie, dass Rohdaten korrekt und ohne Beschädigung im Zielsystem landen.

Testfälle:

- Ladeerfolg: Alle extrahierten Datensätze werden geladen

- Datenintegrität: Keine Kürzung, Kodierungsprobleme oder Beschädigung

- Partitionierung: Daten landen in korrekten Partitionen/Buckets

- Duplikaterkennung: Keine doppelten Datensätze eingefügt

-- Loading integrity test

SELECT

source_table,

COUNT(*) as loaded_records,

SUM(CASE WHEN loaded_at IS NULL THEN 1 ELSE 0 END) as failed_records

FROM raw_data_audit

WHERE load_date = CURRENT_DATE

GROUP BY source_table

HAVING failed_records > 0;

Phase 3: Transformationstests

Überprüfen Sie, dass die Geschäftslogik Rohdaten korrekt in ein analysefertiges Format transformiert.

Testfälle:

- Genauigkeit der Geschäftsregeln: Berechnungen entsprechen den Spezifikationen

- Referentielle Integrität: Fremdschlüssel werden korrekt aufgelöst

- Datenqualität: Umgang mit Nullwerten, Standardwerte, Bereinigung

- Aggregationslogik: Summen, Zählungen, Durchschnitte sind mathematisch korrekt

-- Transformation accuracy test

SELECT

order_id,

raw_amount,

calculated_tax,

(raw_amount * 0.08) as expected_tax

FROM transformed_orders

WHERE ABS(calculated_tax - (raw_amount * 0.08)) > 0.01

Phase 4: End-to-End-Validierung

Führen Sie die gesamte Pipeline aus und validieren Sie die Endergebnisse anhand der Geschäftserwartungen.

Testfälle:

- Berichtsgenauigkeit: Endgültige Dashboards zeigen korrekte KPIs

- Abgleich: Aggregierte Summen stimmen mit dem Quellsystem überein

- Zeitrahmen: Datenaktualität erfüllt SLA (z.B. innerhalb von 2 Stunden)

- Downstream-Auswirkungen: BI-Tools können transformierte Daten fehlerfrei abfragen

ELT-Tests vs. traditionelle Datentests

ELT-Tests unterscheiden sich in wesentlichen Punkten von traditionellen Data-Warehouse-Tests:

| Aspekt | Traditionelle ETL-Tests | ELT-Tests |

|---|---|---|

| Testort | Staging-Schicht | Zielsystem (Snowflake, BigQuery) |

| Leistungsfokus | Transformations-Engine | Effizienz der Zielsystem-Berechnung |

| Schema-Änderungen | Im ETL-Tool gehandhabt | Im Zielsystem getestet |

| Tools | ETL-native Testwerkzeuge | SQL-basierte + API-basierte Tools |

Moderne ELT-Tests erfordern die Validierung von SQL-Transformationen in Cloud-Warehouses, die Überwachung von API-Datenerfassungsendpunkten und die Verfolgung der Datenherkunft über Schema-on-Read-Architekturen hinweg.

Tools für ELT-Tests

SQL-basierte Tests:

- dbt (data build tool) mit integrierten Tests

- Great Expectations für Datenqualität

- benutzerdefinierte SQL-Skripte im Ziel-Warehouse

API-basierte Tests (entscheidend für ELT):

- Apidog für die Validierung von Ingestions-APIs und Ad-hoc-API-Prüfungen

- benutzerdefinierte Skripte für die Webhook-Überwachung

Orchestrierungstests:

- Apache Airflow Aufgabenvalidierung

- Prefect Flow-Tests

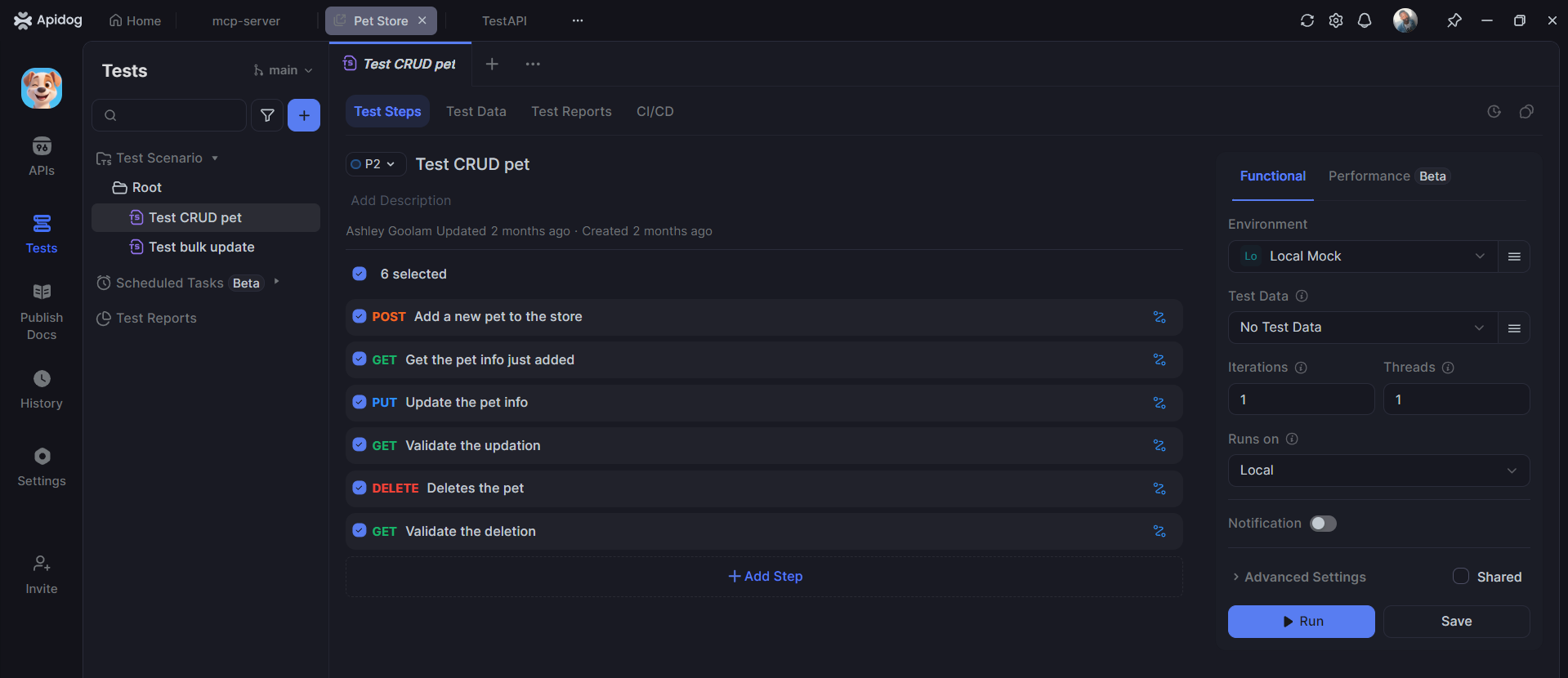

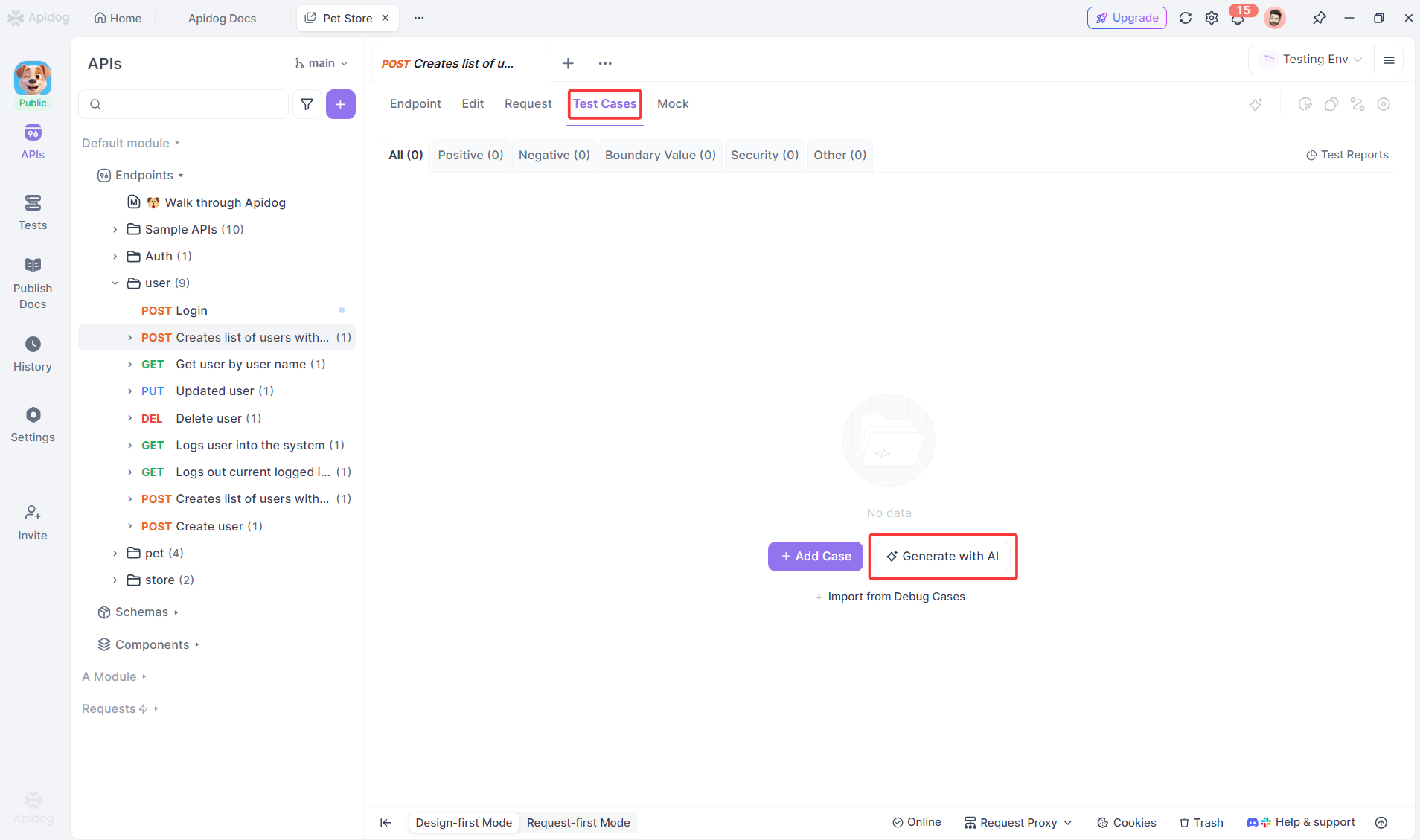

Wie Apidog bei ELT-Tests hilft

Während SQL-Tools Transformationen handhaben, zeichnet sich Apidog durch das Testen der API-Schicht von ELT-Pipelines aus – entscheidend für die moderne Datenerfassung und -überwachung.

Testen von Datenerfassungs-APIs

Die meisten ELT-Pipelines verwenden APIs, um Daten zu extrahieren. Apidog automatisiert die Validierung dieser Endpunkte:

# Apidog test for data ingestion API

Test: POST /api/v1/extract/orders

Given: Valid API key and date range

When: Request sent with parameters {"start_date": "2024-01-01", "end_date": "2024-01-31"}

Test 1: Response status 202 (accepted for processing)

Test 2: Response contains job_id for tracking

Test 3: Webhook notification received within 5 minutes

Test 4: Data appears in staging table

Apidogs Vorteile für ELT-Tests:

- Automatische Testerstellung aus OpenAPI-Spezifikationen

- Visueller Workflow-Builder für komplexe Pipelines

- Umgebungsmanagement für Entwicklungs-/Staging-/Produktions-Data-Warehouses

- CI/CD-Integration zur planmäßigen Durchführung von Datenqualitätsprüfungen

- Detaillierte Protokollierung für Audit-Trails

Best Practices für ELT-Tests

- Inkrementell testen: Extraktion vor dem Laden validieren, Laden vor der Transformation

- Kontinuierlich überwachen: Datenqualitätsprüfungen jede Stunde durchführen, nicht nur einmal

- Tests versionieren: SQL-Tests in Git zusammen mit dem Transformationscode speichern

- In produktionsähnlicher Umgebung testen: Produktionsdatenvolumen im Staging verwenden

- Abgleich automatisieren: Quell- und Zielzählungen automatisch vergleichen

- Bei Anomalien alarmieren: Benachrichtigen, wenn Zeilenanzahl >5% vom historischen Durchschnitt abweicht

- Datenherkunft dokumentieren: Verfolgen, wie sich jedes Feld von Rohdaten zu Enddaten transformiert

Häufig gestellte Fragen

F1: Wie oft sollten wir ELT-Tests durchführen?

Antw: Extraktionstests werden bei jeder Pipeline-Ausführung durchgeführt. Datenqualitätsprüfungen laufen kontinuierlich (stündlich). Eine vollständige End-to-End-Validierung erfolgt mindestens einmal täglich.

F2: Wer ist für ELT-Tests verantwortlich – Dateningenieure oder QA?

Antw: Dateningenieure sind für die Tests zuständig, da sie die Transformationen verstehen. QA stellt Frameworks bereit und validiert die Geschäftsergebnisse.

F3: Kann Apidog SQL-basierte ELT-Tests ersetzen?

Antw: Nein. Apidog ergänzt SQL-Tests, indem es die API-Schicht (Ingestion, Überwachung, Orchestrierung) validiert. SQL-Tests für Transformationen innerhalb des Warehouse sind weiterhin erforderlich.

F4: Wie testen wir ELT-Pipelines, die Terabytes an Daten verarbeiten?

Antw: Testen Sie mit einer statistisch signifikanten Stichprobe (z.B. 1% der Daten) anstelle des gesamten Volumens. Verwenden Sie Datenprofiling, um sicherzustellen, dass die Verteilungen den Erwartungen entsprechen.

F5: Welcher ist der wichtigste ELT-Test, der zuerst implementiert werden sollte?

Antw: Der **End-to-End-Abgleich der Zeilenanzahl**. Wenn die Datensatzanzahlen von Quelle und Ziel nicht übereinstimmen, spielt alles andere keine Rolle. Dieser Test fängt die Mehrheit der Pipeline-Fehler ab.

Fazit

ELT-Tests sind für datengesteuerte Organisationen unverzichtbar. Im Gegensatz zu traditionellen Softwaretests, bei denen Fehler Funktionen betreffen, wirken sich Fehler in Datenpipelines auf Geschäftsentscheidungen, Compliance und Umsatz aus. Ein systematischer Ansatz – das Testen von Extraktion, Laden, Transformation und End-to-End-Flüssen – verhindert kostspielige Datenkorruption und schafft Vertrauen in Ihre Analyseplattform.

Moderne ELT-Pipelines verlassen sich stark auf APIs für die Datenerfassung und Überwachung. Apidog automatisiert die mühsame Arbeit des Testens dieser APIs, sodass Dateningenieure sich auf die Transformationslogik konzentrieren können, während die Eingangs- und Ausgangspunkte der Pipeline kontinuierlich validiert werden. Die Kombination aus SQL-basierten Transformationstests und Apidogs API-Automatisierung schafft ein umfassendes Sicherheitsnetz für Ihr wichtigstes Geschäftsgut: Daten.

Beginnen Sie mit Abgleichstests. Fügen Sie Datenqualitätsprüfungen hinzu. Automatisieren Sie die API-Validierung. Ihr zukünftiges Ich – und Ihre Geschäftspartner – werden es Ihnen danken, wenn die Vorstandspräsentation genaue Zahlen zeigt.