Möchten Sie Ihr Lieblings-Large Language Model (LLM) mit einer Toolbox von Superkräften wie Web Scraping oder Dateioperationen verbinden, ohne sich in Code zu verstricken? Hier kommt MCP-Use ins Spiel – eine elegante Open-Source-Python-Bibliothek, mit der Sie jedes LLM mit jedem MCP-Server problemlos verbinden können. Stellen Sie es sich als universellen Adapter für Ihre API-gestützten KI-Träume vor! In diesem Leitfaden für Anfänger führe ich Sie durch die Verwendung von MCP-Use, um LLMs und Model Context Protocol (MCP)-Server zu verbinden. Egal, ob Sie Programmierer sind oder einfach nur neugierig, dieses Tutorial hat alles, was Sie brauchen. Sind Sie bereit, Ihr LLM zu einem Multitasking-Rockstar zu machen? Lasst uns eintauchen!

Lassen Sie uns nun in die MCP-Use-Magie eintauchen…

Was ist MCP-Use? Ihr KI-zu-Tool-Connector

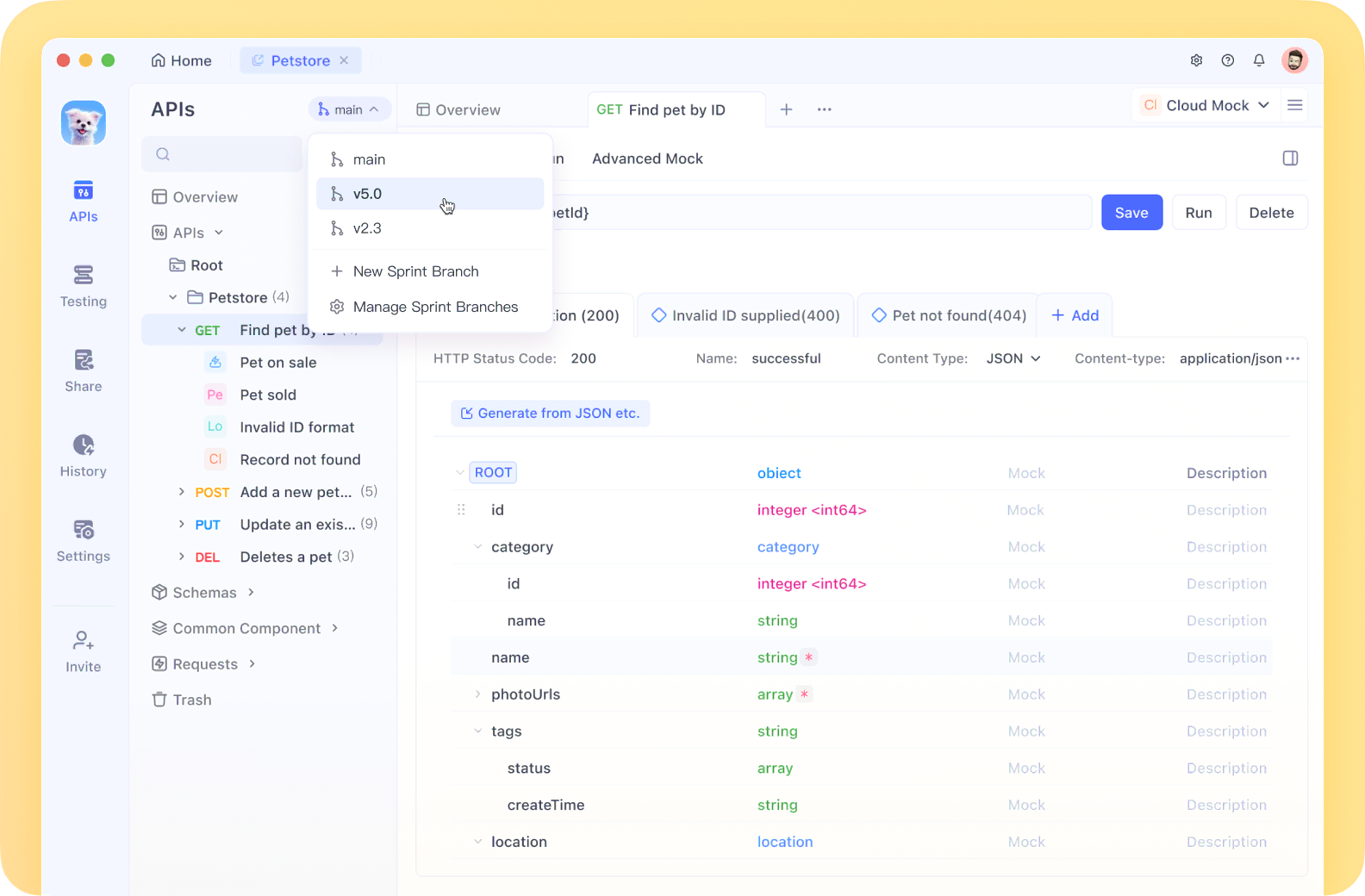

Was ist also MCP-Use? Es ist eine Python-Bibliothek, die wie eine Brücke fungiert und es jedem LLM (denken Sie an Claude, GPT-4o oder DeepSeek) ermöglicht, mit MCP-Servern zu kommunizieren – spezialisierten Tools, die der KI Zugriff auf Dinge wie Webbrowser, Dateisysteme oder sogar Airbnb-Suchen gewähren. MCP-Use basiert auf LangChain-Adaptern und vereinfacht die Verbindung der API Ihres LLM mit diesen Servern, sodass Sie benutzerdefinierte Agents erstellen können, die mehr als nur chatten. Benutzer nennen es „die Open-Source-Methode zum Erstellen lokaler MCP-Clients“, und sie liegen nicht falsch – es ist 100 % kostenlos und flexibel.

Warum sich die Mühe machen? MCP-Server sind wie USB-Anschlüsse für KI, mit denen Ihr LLM Funktionen aufrufen, Daten abrufen oder Aufgaben über standardisierte API-ähnliche Schnittstellen automatisieren kann. Mit MCP-Use müssen Sie sich nicht mit benutzerdefinierten Integrationen herumschlagen – einfach anschließen und loslegen. Lassen Sie uns Sie einrichten!

MCP-Use installieren: Schnell und schmerzlos

MCP-Use zum Laufen zu bringen, ist ein Kinderspiel, besonders wenn Sie mit Python vertraut sind. Das GitHub-Repo (github.com/pietrozullo/mcp-use) erklärt es deutlich. So geht's.

Schritt 1: Voraussetzungen

Sie benötigen:

- Python: Version 3.11 oder höher. Überprüfen Sie mit

python --version. Kein Python? Holen Sie es sich von python.org.

- pip: Pythons Paketmanager (normalerweise im Lieferumfang von Python enthalten).

- Git (optional): Zum Klonen des Repos, wenn Sie den neuesten Code wünschen.

- API Keys: Für Premium-LLMs wie OpenAI oder Anthropic. Wir werden dies später behandeln.

Schritt 2: MCP-Use installieren

Verwenden wir pip in einer virtuellen Umgebung, um die Dinge übersichtlich zu halten:

Erstellen Sie einen Projektordner:

mkdir mcp-use-project

cd mcp-use-project

Richten Sie eine virtuelle Umgebung ein:

python -m venv mcp-env

Aktivieren Sie sie:

- Mac/Linux:

source mcp-env/bin/activate - Windows:

mcp-env\Scripts\activate

MCP-Use installieren:

pip install mcp-use

Oder, wenn Sie die Cutting-Edge-Version wünschen, klonen Sie das Repo:

git clone https://github.com/pietrozullo/mcp-use.git

cd mcp-use

pip install .

Fügen Sie LangChain-Provider hinzu:

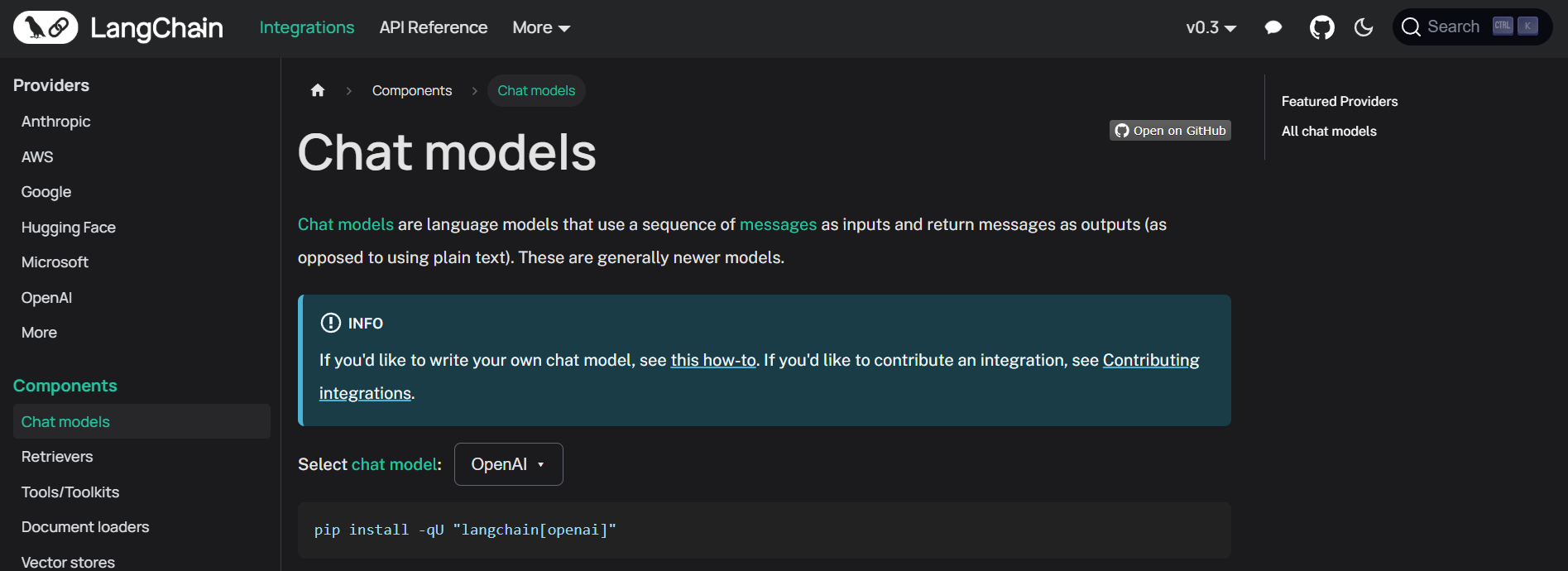

MCP-Use basiert für LLM-Verbindungen auf LangChain. Installieren Sie den Provider für Ihr LLM:

- OpenAI:

pip install langchain-openai - Anthropic:

pip install langchain-anthropic - Andere: Überprüfen Sie LangChains Chat-Modell-Dokumente.

Installation überprüfen:

Führen Sie aus:

python -c "import mcp_use; print(mcp_use.__version__)"

Sie sollten eine Versionsnummer sehen (z. B. 0.42.1 ab April 2025). Wenn nicht, überprüfen Sie Ihre Python-Version oder pip.

Das ist es! MCP-Use ist bereit, Ihr LLM mit MCP-Servern zu verbinden. Ich habe etwa fünf Minuten gebraucht – wie läuft Ihr Setup?

Verbinden eines LLM mit einem MCP-Server mit MCP-Use

Lassen Sie uns nun die Magie geschehen lassen: Verbinden eines LLM mit einem MCP-Server mit MCP-Use. Wir verwenden ein einfaches Beispiel – die Verbindung von OpenAIs GPT-4o mit einem Playwright MCP-Server zum Surfen im Web.

Schritt 1: Holen Sie sich Ihren LLM-API-Schlüssel

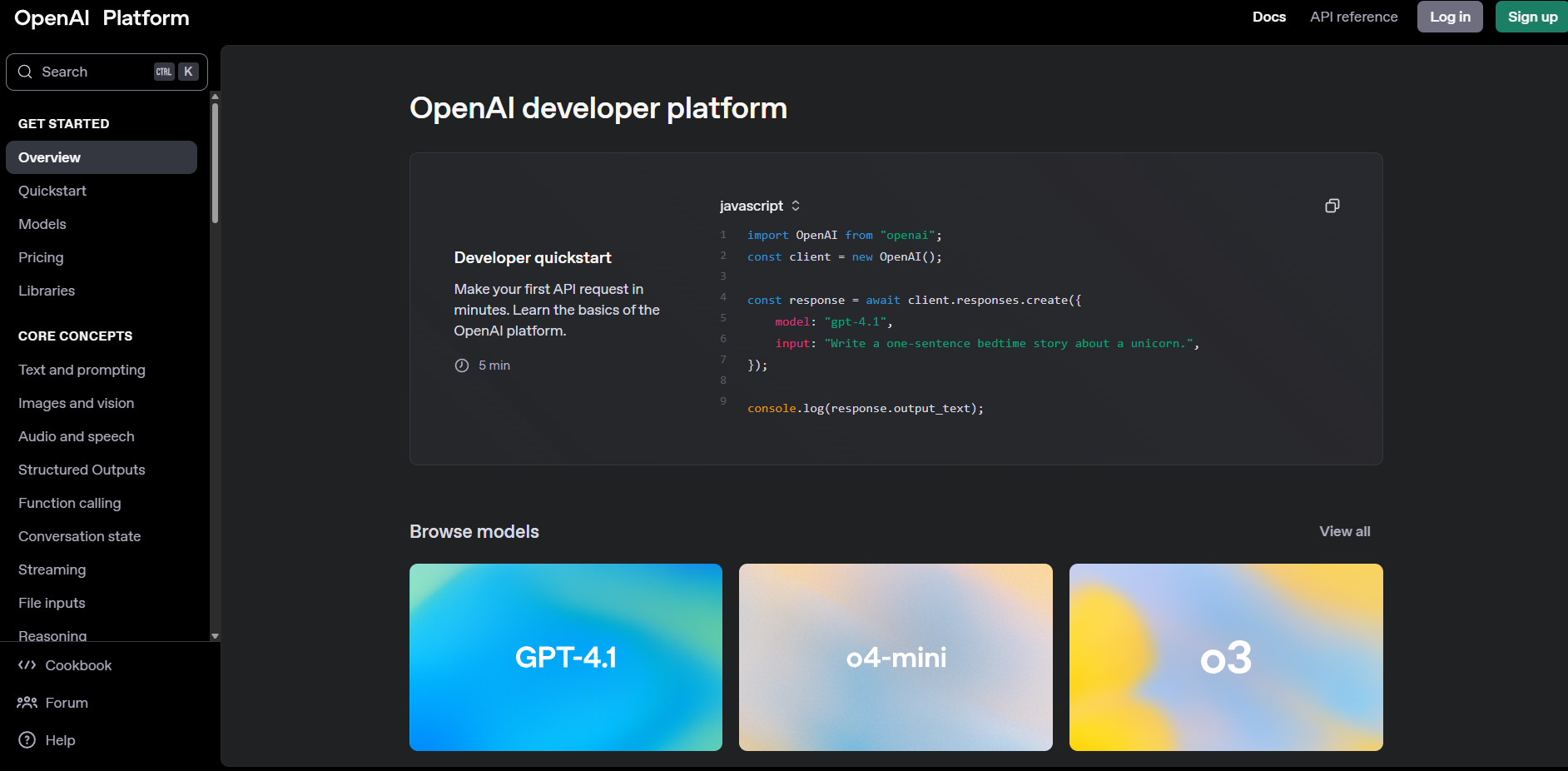

Für GPT-4o holen Sie sich einen API-Schlüssel von platform.openai.com. Melden Sie sich an, erstellen Sie einen Schlüssel und speichern Sie ihn sicher. Andere LLMs wie Claude (über console.anthropic.com) oder DeepSeek (auf der deepseek platform) funktionieren ebenfalls.

Schritt 2: Richten Sie Umgebungsvariablen ein

MCP-Use liebt .env-Dateien für die sichere Speicherung von API-Schlüsseln. Erstellen Sie eine .env-Datei in Ihrem Projektordner:

touch .env

Fügen Sie Ihren Schlüssel hinzu und speichern Sie ihn:

OPENAI_API_KEY=sk-xxx

Wichtig: Halten Sie Ihre API_Keys aus Git, indem Sie die .env-Datei zu .gitignore hinzufügen.

Schritt 3: Konfigurieren Sie den MCP-Server

MCP-Server stellen Tools bereit, die Ihr LLM verwenden kann. Wir verwenden den Playwright MCP-Server für die Browserautomatisierung. Erstellen Sie eine Konfigurationsdatei namens browser_mcp.json:

{

"mcpServers": {

"playwright": {

"command": "npx",

"args": ["@playwright/mcp@latest"],

"env": {

"DISPLAY": ":1"

}

}

}

}

Dies weist MCP-Use an, den MCP-Server von Playwright auszuführen. Speichern Sie es in Ihrem Projektordner.

Schritt 4: Schreiben Sie Ihr erstes MCP-Use-Skript

Lassen Sie uns ein Python-Skript erstellen, um GPT-4o mit dem Playwright-Server zu verbinden und ein Restaurant zu finden. Erstellen Sie mcp_example.py:

import asyncio

import os

from dotenv import load_dotenv

from langchain_openai import ChatOpenAI

from mcp_use import MCPAgent, MCPClient

async def main():

# Load environment variables

load_dotenv()

# Create MCPClient from config file

client = MCPClient.from_config_file("browser_mcp.json")

# Create LLM (ensure model supports tool calling)

llm = ChatOpenAI(model="gpt-4o")

# Create agent

agent = MCPAgent(llm=llm, client=client, max_steps=30)

# Run a query

result = await agent.run("Find the best restaurant in San Francisco")

print(f"\nResult: {result}")

if __name__ == "__main__":

asyncio.run(main())

Dieses Skript:

- Lädt Ihren API-Schlüssel von

.env. - Richtet einen MCP-Client mit dem Playwright-Server ein.

- Verbindet GPT-4o über LangChain.

- Führt eine Abfrage aus, um nach Restaurants zu suchen.

Schritt 5: Führen Sie es aus

Stellen Sie sicher, dass Ihre virtuelle Umgebung aktiv ist, und dann:

python mcp_example.py

MCP-Use startet den Playwright-Server, lässt GPT-4o im Web surfen und gibt so etwas wie aus: „Result: The best restaurant in San Francisco is Gary Danko, known for its exquisite tasting menu.“ (Ihre Ergebnisse können variieren!) Ich habe dies ausgeführt und in weniger als einer Minute eine solide Empfehlung erhalten – ziemlich cool, oder?

Verbinden mit mehreren MCP-Servern

MCP-Use glänzt, wenn Sie sich für komplexe Aufgaben mit mehreren Servern verbinden. Fügen wir unserer Konfiguration einen Airbnb MCP-Server für die Suche nach Unterkünften hinzu. Aktualisieren Sie browser_mcp.json:

{

"mcpServers": {

"playwright": {

"command": "npx",

"args": ["@playwright/mcp@latest"],

"env": {

"DISPLAY": ":1"

}

},

"airbnb": {

"command": "npx",

"args": ["-y", "@openbnb/mcp-server-airbnb", "--ignore-robots-txt"]

}

}

}

Führen Sie mcp_example.py mit einer neuen Abfrage erneut aus:

result = await agent.run("Find a restaurant and an Airbnb in San Francisco")

MCP-Use lässt das LLM beide Server verwenden – Playwright für die Restaurantsuche, Airbnb für die Unterkunft. Der Agent entscheidet, welchen Server er aufrufen soll, wodurch Ihre KI super vielseitig wird.

Warum MCP-Use für Anfänger großartig ist

MCP-Use ist ein Traum für Anfänger, denn:

- Einfache Einrichtung: Ein

pip installund ein kurzes Skript bringen Sie zum Laufen. - Flexibel: Funktioniert mit jedem LLM und MCP-Server, von Claude bis zum Issue-Tracker von GitHub.

- Open-Source: Kostenlos und anpassbar, mit einer einladenden GitHub-Community.

Im Vergleich zu benutzerdefinierten API-Integrationen ist MCP-Use viel weniger Kopfschmerzen, sodass Sie sich auf das Erstellen cooler Dinge konzentrieren können.

Profi-Tipps für MCP-Use-Erfolg

- Modellkompatibilität prüfen: Es funktionieren nur LLMs mit Tool-Calling (wie GPT-4o oder Claude 3.7 Sonnet).

- Verwenden Sie Scalar für Spezifikationen: Validieren Sie die Server-API-Spezifikationen, um Überraschungen zu vermeiden.

- Entdecken Sie MCP-Server: Durchsuchen Sie mcp.so nach Servern wie Firecrawl (Web Scraping) oder ElevenLabs (Text-to-Speech).

- Treten Sie der Community bei: Melden Sie Fehler oder schlagen Sie Funktionen auf dem MCP-Use GitHub vor.

Fazit: Ihr MCP-Use-Abenteuer erwartet Sie

Herzlichen Glückwunsch – Sie sind jetzt bereit, jedes LLM mit MCP-Use aufzuladen! Von der Verbindung von GPT-4o mit einem Playwright-Server haben Sie die Tools, um KI-Agents zu erstellen, die surfen, suchen und mehr. Versuchen Sie als Nächstes, einen GitHub MCP-Server hinzuzufügen, oder bitten Sie Ihren Agenten, eine ganze Reise zu planen. Das MCP-Use-Repo enthält weitere Beispiele, und die MCP-Community ist auf X in aller Munde. Und für zusätzliches API-Flair vergessen Sie nicht, apidog.com zu besuchen.