Der Ausdruck „KI-gestütztes Testen“ geistert seit Jahren durch die Branche, die meisten Tools erfordern jedoch immer noch, dass Menschen Testfälle schreiben, Szenarien definieren und Ergebnisse interpretieren. Agentic AI Testing stellt einen grundlegenden Wandel dar, bei dem autonome KI-Agenten Teststrategien ohne ständige menschliche Anleitung/Intervention planen, ausführen und anpassen können. Dies sind nicht nur intelligente Assistenten; es sind digitale Tester, die sich wie erfahrene Qualitätssicherungsingenieure verhalten, Entscheidungen treffen, aus Fehlern lernen und Risiken auf der Grundlage von Echtzeitanalysen priorisieren.

Dieser Leitfaden beleuchtet Agentic AI Testing von Grund auf: was es anders macht, wie es den gesamten Softwareentwicklungslebenszyklus verbessert und warum es für moderne Entwicklungsteams, die in der Komplexität versinken, unerlässlich wird.

Was genau ist Agentic AI Testing?

Agentic AI Testing nutzt autonome KI-Agenten – Systeme, die ihre Umgebung wahrnehmen, Entscheidungen treffen und Maßnahmen ergreifen können, um spezifische Ziele zu erreichen – zur Durchführung von Softwaretests. Im Gegensatz zur traditionellen Testautomatisierung, die starre Skripte befolgt, tun diese Agenten:

- Dynamisch planen: Analysieren Codeänderungen, frühere Fehler und Nutzungsmuster, um zu entscheiden, was getestet werden soll

- Intelligent ausführen: Interagieren mit Anwendungen wie Menschen, erkunden Grenzfälle und passen sich an UI-Änderungen an

- Kontinuierlich lernen: Merken sich, welche Tests Fehler gefunden haben, und passen zukünftige Strategien entsprechend an

- Selbstheilung: Wenn sich die Benutzeroberfläche ändert, aktualisieren Agenten ihre eigenen Lokalisatoren und Testschritte

Stellen Sie es sich so vor, als würden Sie einen erfahrenen QA-Ingenieur einstellen, der niemals schläft, Tests mit Maschinengeschwindigkeit schreibt und mit jeder Veröffentlichung intelligenter wird.

Wie Agentic AI den Softwareentwicklungslebenszyklus verbessert

Agentic AI Testing automatisiert nicht nur das Testen – es verbessert grundlegend, wie Teams Software über jede SDLC-Phase hinweg entwickeln und ausliefern:

Anforderungsanalyse

Agenten analysieren User Stories und generieren automatisch Akzeptanzkriterien in Gherkin-Syntax:

# Automatisch vom KI-Agenten aus Story generiert: "Benutzer kann Passwort zurücksetzen"

Szenario: Passwort zurücksetzen mit gültiger E-Mail

Angenommen, der Benutzer befindet sich auf der Anmeldeseite

Wenn er "user@example.com" in das Zurücksetzungsformular eingibt

Und auf "Link zum Zurücksetzen senden" klickt

Dann sollte er "Überprüfen Sie Ihre E-Mails" sehen

Und innerhalb von 2 Minuten eine E-Mail erhalten

Testdesign

Agenten erstellen umfassende Testsuiten durch die Kombination von:

- Code-Coverage-Analyse

- Historische Fehlerbilder

- API-Vertragsdefinitionen

- Benutzerpfad-Analysen

Testausführung

Agenten führen Tests rund um die Uhr aus und priorisieren risikoreiche Bereiche basierend auf:

- Aktuelle Codeänderungen

- Komplexitätsmetriken

- Frühere Fehlerdichte

- Produktionsnutzungsmuster

Fehleranalyse

Wenn Tests fehlschlagen, melden die Agenten nicht nur – sie untersuchen:

- Grundursache isolieren (API vs. UI vs. Datenbank)

- Potenzielle Fehlerbehebungen auf Basis ähnlicher früherer Probleme vorschlagen

- Vorhersagen, welche anderen Funktionen betroffen sein könnten

Kontinuierliche Verbesserung

Agenten analysieren die Testeffektivität und stellen Tests mit geringem Wert ein, während sie neue für ungedeckte Bereiche erstellen.

Agentic AI Testing vs. manuelles Testen: Ein klarer Vergleich

| Aspekt | Manuelles Testen | Agentic AI Testing |

|---|---|---|

| Geschwindigkeit | Stunden/Tage für Regression | Minuten für die vollständige Suite |

| Konsistenz | Anfällig für menschliche Fehler | Deterministische Ausführung |

| Abdeckung | Zeitlich begrenzt | Umfassend, adaptiv |

| Exploration | Ad-hoc, erfahrungsbasiert | Datengesteuert, intelligent |

| Lernen | Individueller Wissensverlust | Institutionelles Gedächtnis |

| Kosten | Hoch (Gehalt × Zeit) | Niedrig nach Einrichtung |

| Skalierbarkeit | Linear (Personal aufstocken) | Exponentiell (Rechenleistung erhöhen) |

| Anpassungsfähigkeit | Manuelle Aktualisierungen erforderlich | Selbstheilende Lokalisatoren |

Die Kernerkenntnis: Agentic AI Testing ersetzt keine menschlichen Tester – es wertet sie auf. Tester werden zu Testarchitekten, die sich auf die Strategie konzentrieren, während Agenten die sich wiederholende Ausführung übernehmen.

Tools und Frameworks für Agentic AI Testing

Kommerzielle Plattformen

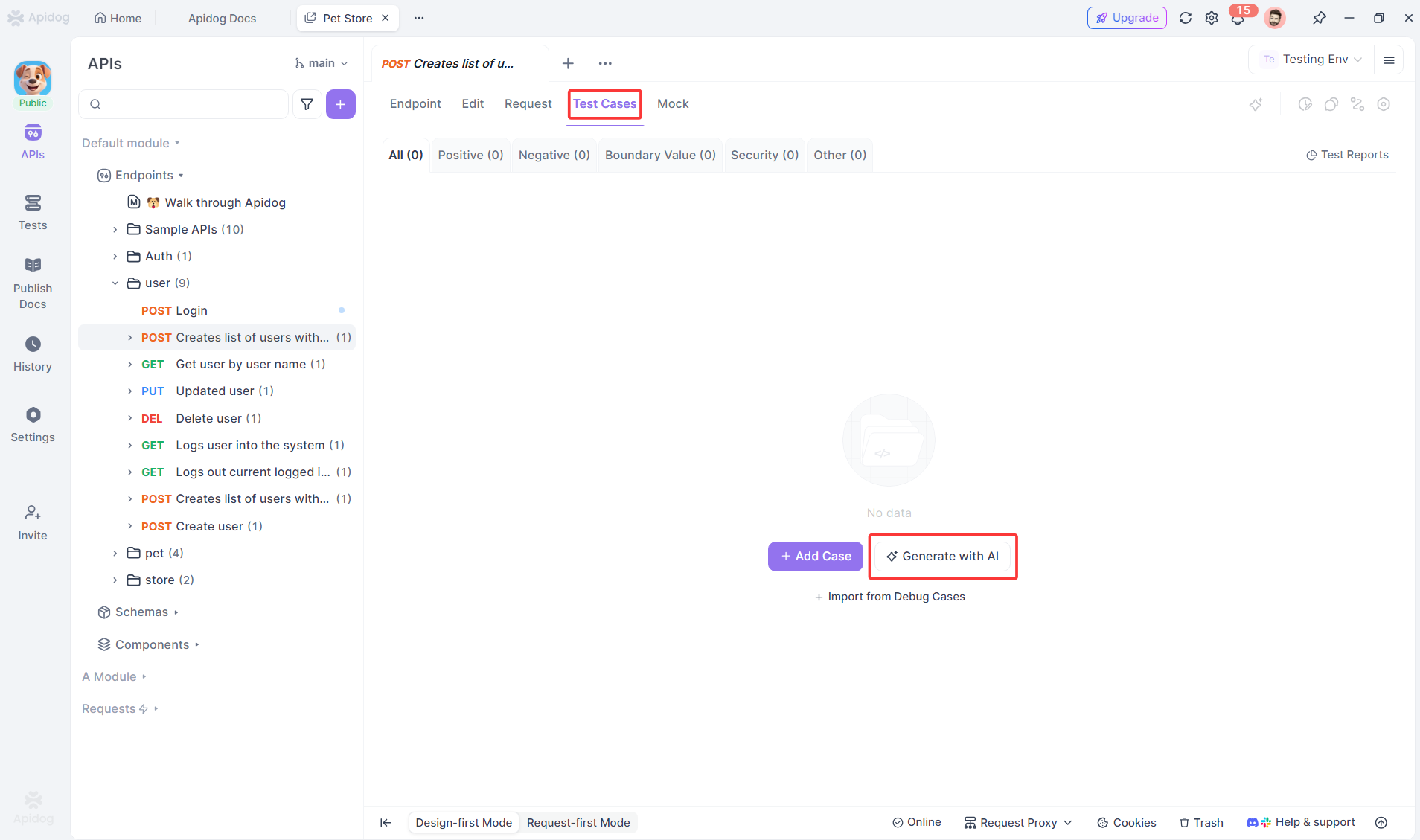

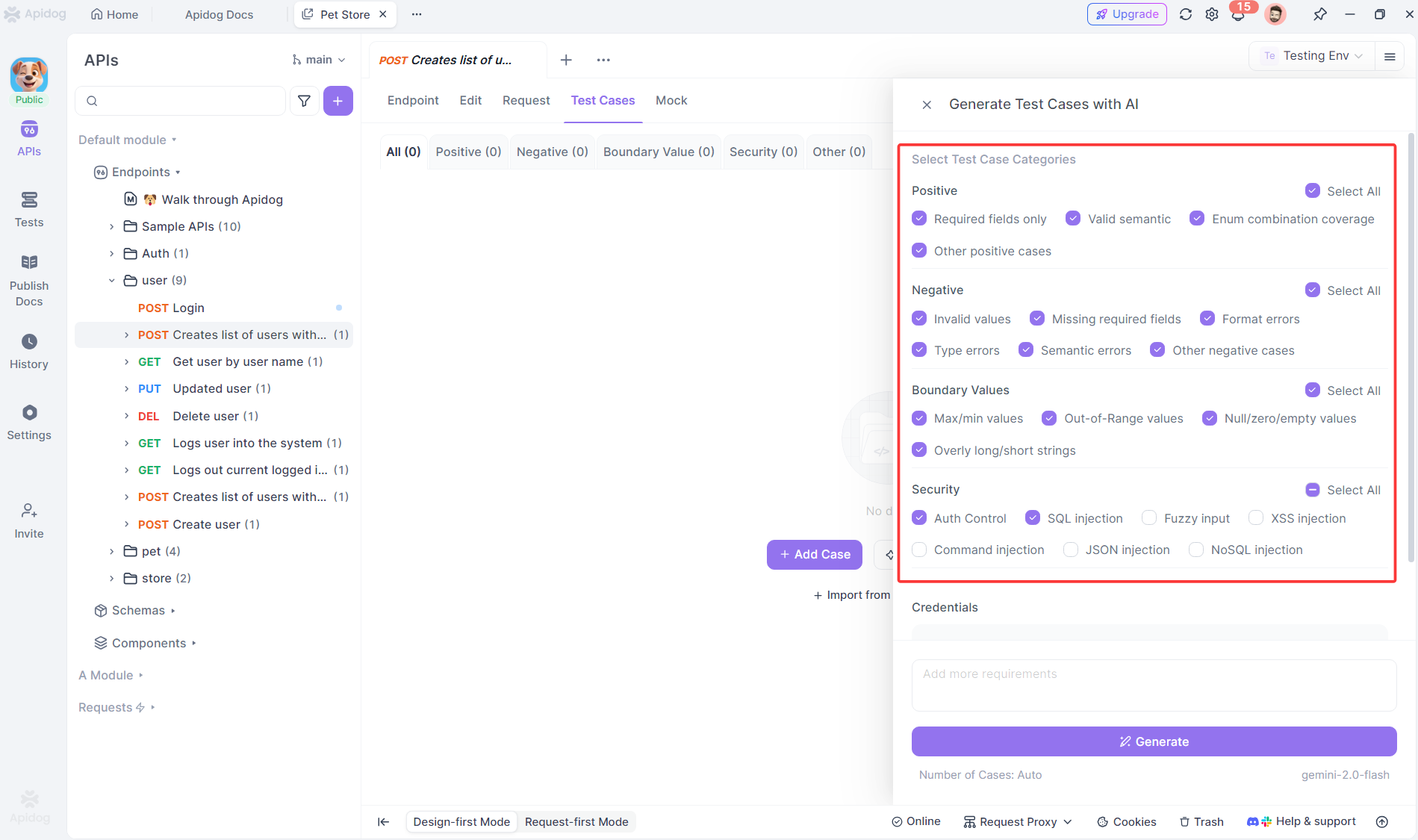

- Apidog: Spezialisiert auf API-Testagenten, die Tests aus Spezifikationen mithilfe von KI generieren und ausführen

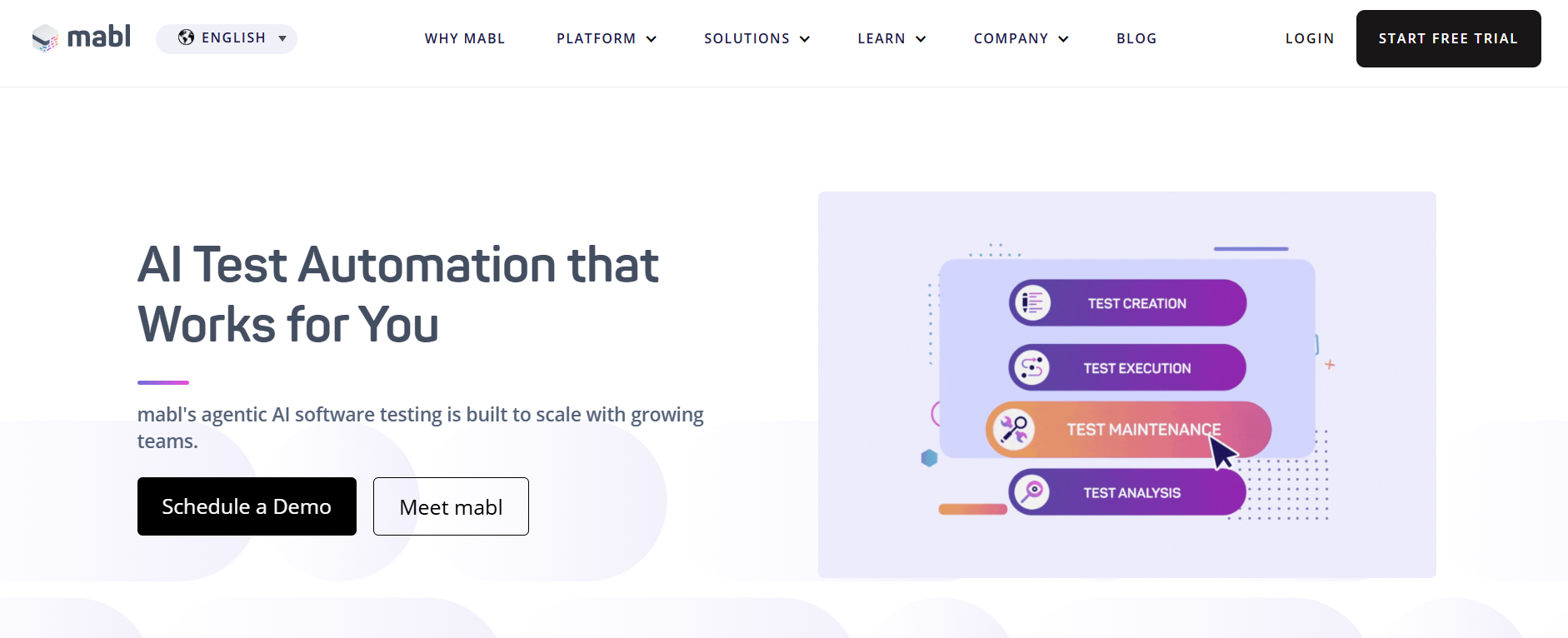

- Mabl: Low-Code-Plattform mit selbstheilenden UI-Tests

- Functionize: Cloud-basiertes autonomes Testen mit NLP-Testgenerierung

Open-Source-Frameworks

- Playwright + KI-Modelle: Benutzerdefinierte Agenten, die GPT-5 / Sonnet 4.5 zur Generierung und Wartung von Tests verwenden

- Cypress mit ML-Plugins: Community-getriebene selbstheilende Erweiterungen

Spezialisierte Tools

- Apidog: API-First-Agentic-Testing, das Testfälle aus OpenAPI-Spezifikationen generiert und autonom ausführt

// Beispiel: Apidog KI-Agent generiert API-Tests

const apidog = require('apidog-ai');

// Agent liest API-Spezifikation und generiert umfassende Tests

const testSuite = await apidog.agent.analyzeSpec('openapi.yaml');

// Agent priorisiert basierend auf Risiko

const prioritizedTests = await apidog.agent.rankByRisk(testSuite);

// Agent führt aus und passt sich an

const results = await apidog.agent.run(prioritizedTests, {

selfHeal: true,

parallel: 10,

maxRetries: 3

});

Wie Agentic AI Testing durchgeführt wird: Der Workflow

Schritt 1: Agent nimmt Anwendungskontext auf

Der Agent scannt Ihre:

- OpenAPI-Spezifikationen

- Datenbankschemata

- Frontend-Code (React-Komponenten, Formulare)

- Historische Testergebnisse

- Produktionsprotokolle

Schritt 2: Agent generiert Teststrategie

Mithilfe eines verbundenen LLM (Claude, GPT-4) erstellt der Agent:

- Happy-Path-Tests: 40% der Suite

- Edge-Case-Tests: 35% der Suite (Grenzwerte, ungültige Eingaben)

- Negative Tests: 15% (Sicherheit, Fehlerbehandlung)

- Explorative Tests: 10% (ungewöhnliche Benutzerabläufe)

Schritt 3: Agent führt Tests autonom aus

Der Agent:

- Verwaltet den Lebenszyklus von Testdaten

- Handhabt die Authentifizierung

- Passt sich an UI-Änderungen an (selbstheilende Selektoren)

- Wiederholt instabile Tests mit exponentiellem Backoff

- Erfasst detaillierte Protokolle und Traces

Schritt 4: Agent analysiert Ergebnisse

Über Bestehen/Nichtbestehen hinaus, der Agent:

- Generiert Fehlerberichte mit Reproduktionsschritten

- Erstellt Videoaufzeichnungen von Fehlern

- Schlägt die Grundursache basierend auf Stack-Traces vor

- Identifiziert Lücken in der Testabdeckung

Schritt 5: Agent aktualisiert Strategie

Basierend auf den Ergebnissen, der Agent:

- Entfernt ineffektive Tests

- Erstellt neue Tests für übersehene Pfade

- Passt Risikobewertungen für zukünftige Priorisierung an

Vor- und Nachteile von Agentic AI Testing

| Vorteile | Nachteile |

|---|---|

| Massive Abdeckung: Testet Tausende von Szenarien, die manuell unmöglich wären | Erstkonfiguration: Erfordert API-Schlüssel, Umgebungskonfiguration |

| Selbstheilung: Passt sich automatisch an UI-Änderungen an | Lernkurve: Teams müssen das Agentenverhalten verstehen |

| Geschwindigkeit: Führt 1000x mehr Tests in gleicher Zeit aus | Kosten: Rechen- und LLM-API-Kosten können sich summieren |

| Konsistenz: Keine menschlichen Fehler oder Ermüdung | Komplexe Szenarien: Kann bei sehr kreativem Testdesign Schwierigkeiten haben |

| Dokumentation: Generiert lebende Testspezifikationen | Debugging: Agentenentscheidungen können ohne gute Protokollierung undurchsichtig sein |

| 24/7-Betrieb: Kontinuierliches Testen ohne Aufsicht | Sicherheit: Agenten benötigen Zugriff auf Testumgebungen und Daten |

Wie Apidog Agentic AI Testing ermöglicht

Während es allgemeine agentische Plattformen gibt, spezialisiert sich Apidog auf API-Testagenten, die sofortigen Mehrwert ohne komplexe Einrichtung liefern.

Automatische Testfallgenerierung

Der KI-Agent von Apidog liest Ihre OpenAPI-Spezifikation und erstellt umfassende Tests:

# API-Spezifikation

paths:

/api/users:

post:

requestBody:

required: true

content:

application/json:

schema:

type: object

properties:

email:

type: string

format: email

name:

type: string

minLength: 1

Intelligente Testausführung

Apidog-Agenten führen nicht nur Tests aus – sie optimieren die Ausführung:

// Agent priorisiert basierend auf Risiko

const executionPlan = {

runOrder: ['critical-path', 'high-risk', 'medium-risk', 'low-risk'],

parallelism: 10,

selfHeal: true,

retryFlaky: {

enabled: true,

maxAttempts: 3,

backoff: 'exponential'

}

};

Adaptive Wartung

Wenn sich Ihre API ändert, erkennt der Apidog-Agent dies und aktualisiert die Tests:

- Neuer Endpunkt? Agent generiert Tests automatisch

- Feld entfernt? Agent entfernt abhängige Tests

- Typ geändert? Agent passt Validierungs-Assertions an

Häufig gestellte Fragen

F1: Wird Agentic AI Testing QA-Teams ersetzen?

Antw: Nein – es wertet sie auf. QA-Ingenieure werden zu Teststrategen, die Agenten trainieren, deren Ergebnisse überprüfen und sich auf exploratives Testen konzentrieren. Agenten übernehmen die repetitive Ausführung, Menschen die kreative Risikoanalyse.

F2: Wie vertraue ich darauf, was der Agent testet?

Antw: Apidog bietet vollständige Audit-Protokolle der Agentenentscheidungen: warum er Tests ausgewählt hat, was er beobachtet hat, wie er sich angepasst hat. Sie können vom Agenten generierte Testsuiten vor der Ausführung überprüfen und genehmigen.

F3: Können Agenten komplexe Geschäftslogik testen?

Antw: Ja, aber sie benötigen einen reichhaltigen Kontext. Füttern Sie sie mit User Stories, Akzeptanzkriterien und Geschäftsregeln. Je mehr Kontext, desto besser ist das Testdesign des Agenten.

F4: Was, wenn der Agent kritische Fehler übersieht?

Antw: Beginnen Sie mit vom Agenten generierten Tests als Basislinie und fügen Sie dann von Menschen entworfene Tests für bekannte Risikobereiche hinzu. Im Laufe der Zeit lernt der Agent aus übersehenen Fehlern und verbessert die Abdeckung.

F5: Wie handhabt Apidog die Authentifizierung in Agentic Tests?

Antw: Apidog-Agenten verwalten die Authentifizierung automatisch – sie kümmern sich um Token-Aktualisierung, OAuth-Flows und die Rotation von Anmeldeinformationen. Sie definieren die Authentifizierung einmal, und der Agent verwendet sie in allen Tests.

Fazit

Agentic AI Testing stellt die nächste Evolutionsstufe der Qualitätssicherung dar – den Übergang von skriptgesteuerter Automatisierung zu intelligenter, autonomer Validierung. Indem repetitive Testausführungen an Agenten delegiert werden, erreichen Teams Abdeckungsniveaus, die mit manuellen Ansätzen unmöglich wären, während menschliche Tester freigestellt werden, sich auf strategische Qualitätsrisiken zu konzentrieren.

Die Technologie ist heute verfügbar. Tools wie Apidog machen sie ohne massive Infrastrukturinvestitionen zugänglich. Beginnen Sie klein: Lassen Sie einen Agenten Tests für einen API-Endpunkt generieren, überprüfen Sie seine Arbeit und sehen Sie die Ergebnisse. Wenn das Vertrauen wächst, erweitern Sie das agentische Testen auf Ihre gesamte Anwendung.

Die Zukunft des Testens besteht nicht darin, dass mehr Menschen mehr Skripte schreiben – es sind intelligentere Agenten, die mit Menschen zusammenarbeiten, um Software zu entwickeln, die in der Praxis tatsächlich funktioniert. Diese Zukunft ist Agentic AI Testing, und es verändert bereits, wie moderne Teams qualitativ hochwertigen Code ausliefern.