Sora 2 của OpenAI nổi bật như một công cụ mạnh mẽ kết hợp các lời nhắc văn bản với tính năng đồng bộ hóa âm thanh tiên tiến để tạo ra các clip chân thực. Các nhà phát triển thường tìm cách khai thác công nghệ này đồng thời tránh các yếu tố gây mất tập trung về mặt hình ảnh như hình mờ (watermark), vốn có thể làm giảm tính chuyên nghiệp của các ứng dụng. May mắn thay, việc sử dụng API Sora 2 mang đến một con đường để tạo ra các sản phẩm sạch hơn, đặc biệt khi được tích hợp với các công cụ quản lý API mạnh mẽ.

button

Bài viết này khám phá các khía cạnh kỹ thuật của Sora 2, tập trung vào việc sử dụng API và các chiến lược để loại bỏ hình mờ. Bạn sẽ học cách thiết lập môi trường, thực hiện các lệnh gọi API và áp dụng các phương pháp hậu xử lý. Ngoài ra, hướng dẫn còn bao gồm các ví dụ thực tế và mẹo tối ưu hóa để nâng cao các dự án của bạn.

Tìm hiểu về Sora 2 và các khả năng của nó

OpenAI đã phát hành Sora 2 vào ngày 30 tháng 9 năm 2025, đánh dấu một bước tiến đáng kể trong công nghệ tạo video. Mô hình này được xây dựng dựa trên Sora gốc bằng cách tích hợp các mô phỏng vật lý chính xác hơn, hoạt ảnh chân thực và âm thanh đồng bộ. Ví dụ, Sora 2 hiển thị chính xác các kịch bản phức tạp như quả bóng rổ nảy ra khỏi bảng rổ hoặc một vận động viên thể dục dụng cụ thực hiện các động tác phức tạp. Các nhà phát triển tận dụng các tính năng này để tạo nội dung động cho các ứng dụng trong giải trí, giáo dục và tiếp thị.

Sora 2 hoạt động như một mô hình dựa trên khuếch tán (diffusion-based) giúp biến các lời nhắc văn bản thành video dài tới 20 giây, với độ phân giải đạt 1080p ở các cấp cao hơn. Nó hỗ trợ nhiều phong cách từ chủ nghĩa hiện thực điện ảnh đến thẩm mỹ anime. Tuy nhiên, các sản phẩm chính thức từ ứng dụng và trang web Sora thường bao gồm các hình mờ (watermark) hiển thị để chỉ ra việc tạo ra bằng AI, theo chính sách AI có trách nhiệm của OpenAI. Các hình mờ này xuất hiện dưới dạng lớp phủ chuyển động hoặc siêu dữ liệu được nhúng, có thể hạn chế khả năng sử dụng trong các môi trường thương mại.

Chuyển sang phiên bản API, Sora 2 cung cấp sự linh hoạt cao hơn. API, hiện có sẵn ở dạng xem trước cho các nhà phát triển, cho phép truy cập theo chương trình vào các điểm cuối tạo video mà không bị ràng buộc bởi ứng dụng dành cho người tiêu dùng. Bạn truy cập nó thông qua nền tảng của OpenAI, yêu cầu một khóa API và có thể là một gói đăng ký Pro để có các tính năng nâng cao như độ phân giải cao hơn và không có hình mờ tích hợp trong một số cấu hình nhất định. Theo tài liệu dành cho nhà phát triển, các điểm cuối API tập trung vào các yêu cầu chuyển văn bản thành video, nơi bạn chỉ định các tham số như lời nhắc (prompt), thời lượng và phong cách.

Các nền tảng như Replicate và ComfyUI cung cấp các phiên bản lưu trữ của API Sora 2, cho phép xuất video không có hình mờ thông qua giao diện của chúng. Các giải pháp thay thế này tích hợp liền mạch với các công cụ như Apidog, công cụ xử lý xác thực và định dạng yêu cầu. Bằng cách sử dụng API, bạn bỏ qua việc đóng dấu hình mờ mặc định được áp dụng trong cấp ứng dụng miễn phí, mặc dù một số triển khai vẫn nhúng siêu dữ liệu. Tuy nhiên, cách tiếp cận này cho phép bạn tạo ra các video sạch theo nhu cầu của mình.

Truy cập API Sora 2: Điều kiện tiên quyết và Thiết lập

Trước khi tạo video, bạn phải đảm bảo quyền truy cập vào API Sora 2. OpenAI triển khai khả năng truy cập API cho các nhà phát triển có tài khoản hoạt động, thường ưu tiên những người có gói đăng ký Pro hoặc doanh nghiệp. Bắt đầu bằng cách đăng nhập vào nền tảng nhà phát triển OpenAI tại platform.openai.com. Tại đó, bạn tạo một khóa API trong phần Khóa API. Đảm bảo tài khoản của bạn đáp ứng các yêu cầu để truy cập bản xem trước Sora 2, điều này có thể bao gồm việc tham gia danh sách chờ hoặc xác minh trường hợp sử dụng của bạn.

Sau khi được phê duyệt, bạn cấu hình môi trường phát triển của mình. Cài đặt các thư viện cần thiết, chẳng hạn như OpenAI Python SDK, bằng cách sử dụng pip: pip install openai. Thư viện này đơn giản hóa các tương tác API. Đối với người dùng JavaScript, gói Node.js cung cấp chức năng tương tự. Ngoài ra, nếu bạn chọn các nhà cung cấp bên thứ ba như Replicate, hãy đăng ký trên trang web của họ và lấy mã thông báo API.

Bảo mật đóng một vai trò quan trọng ở đây. Luôn lưu trữ khóa API của bạn trong các biến môi trường thay vì mã hóa cứng (hardcoding) nó, để ngăn chặn việc lộ thông tin. Ví dụ, trong Python, hãy sử dụng os.environ['OPENAI_API_KEY'] = 'your-key'. Thực hành này bảo vệ thông tin đăng nhập của bạn trong các dự án hợp tác.

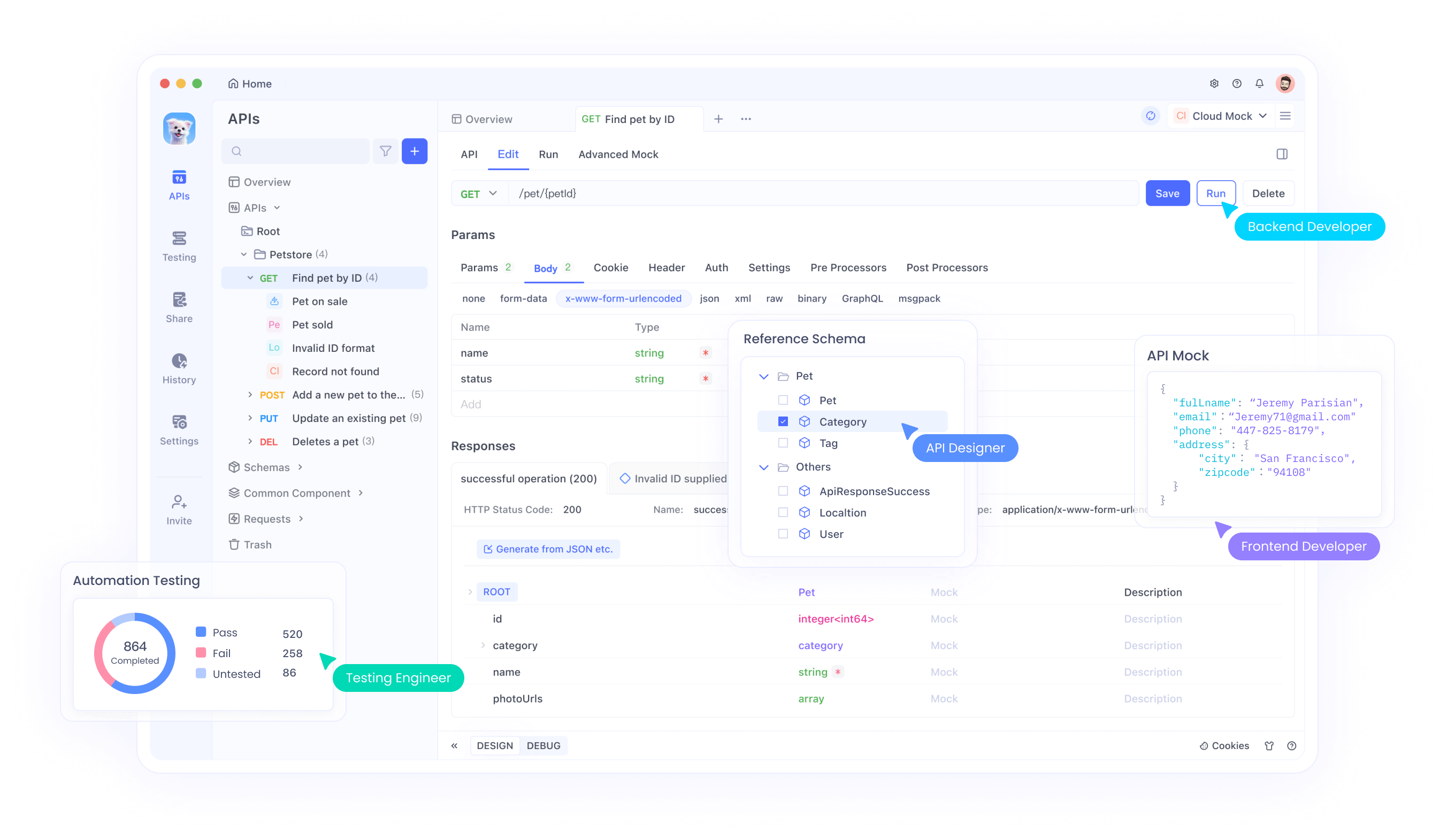

Bây giờ, hãy tích hợp Apidog vào thiết lập của bạn. Với tư cách là một công cụ client API toàn diện, Apidog vượt trội trong việc kiểm thử và lập tài liệu các điểm cuối của OpenAI, bao gồm cả Sora 2. Tải xuống và cài đặt Apidog từ trang web chính thức của họ. Khi khởi chạy, hãy tạo một dự án mới và nhập thông số kỹ thuật API của OpenAI bằng cách dán URL schema OpenAPI hoặc tải lên một tệp JSON. Apidog tự động tạo các điểm cuối cho các mô hình như Sora 2, cho phép bạn tùy chỉnh các yêu cầu với các tham số như tên mô hình ("sora-2") và lời nhắc đầu vào.

Giao diện của Apidog tương tự như Postman nhưng cung cấp các tính năng nâng cao như kiểm thử tự động và mocking. Bạn thêm khóa API của mình vào tiêu đề ủy quyền (authorization header), thường là dưới dạng mã thông báo Bearer. Kiểm tra một điểm cuối đơn giản, như danh sách các mô hình, để xác minh kết nối: Gửi yêu cầu GET đến /v1/models và xác nhận Sora 2 xuất hiện trong phản hồi. Bước này đảm bảo thiết lập của bạn hoạt động chính xác trước khi tiến hành tạo video.

Cấu hình Apidog cho các yêu cầu API Sora 2

Với môi trường đã sẵn sàng, bạn sẽ đi sâu vào các khả năng của Apidog cho Sora 2. Tạo một bộ sưu tập API mới dành riêng cho việc tạo video. Trong đó, thêm một yêu cầu POST đến điểm cuối Sora 2, thường là /v1/video/generations hoặc tương tự, dựa trên tài liệu của OpenAI. Đặt phần thân yêu cầu (request body) ở định dạng JSON.

Các tham số chính bao gồm:

model: Chỉ định "sora-2" để gọi phiên bản mới nhất.prompt: Một mô tả văn bản chi tiết, ví dụ: "Một con mèo đang thực hiện cú nhảy ba vòng trên băng với âm thanh meo meo đồng bộ."duration: Tính bằng giây, tối đa 20.resolution: Các tùy chọn như "720p" hoặc "1080p" dành cho người dùng Pro.style: "realistic" (chân thực), "cinematic" (điện ảnh), hoặc "anime".

Apidog cho phép bạn tham số hóa chúng để có thể tái sử dụng. Ví dụ, sử dụng các biến như {{prompt}} để kiểm tra nhiều kịch bản một cách nhanh chóng. Ngoài ra, hãy bật các biến môi trường để chuyển đổi giữa các khóa API thử nghiệm và sản xuất.

Để xử lý các phản hồi không đồng bộ—vì việc tạo video có thể mất vài phút—bạn cấu hình webhooks hoặc polling trong Apidog. Thiết lập một tập lệnh để kiểm tra trạng thái tạo video thông qua yêu cầu GET đến điểm cuối ID công việc. Tự động hóa này giúp tiết kiệm thời gian và đảm bảo bạn truy xuất các video đã hoàn thành một cách hiệu quả.

Hơn nữa, Apidog hỗ trợ viết script bằng JavaScript cho các hành động trước và sau yêu cầu. Viết một script để xác thực độ dài của lời nhắc trước khi gửi, ngăn ngừa lỗi. Ví dụ:

if (pm.variables.get('prompt').length > 1000) {

throw new Error('Prompt too long');

}

Biện pháp bảo vệ kỹ thuật này giúp tăng cường độ tin cậy. Sau khi cấu hình, hãy gửi yêu cầu đầu tiên của bạn và theo dõi phản hồi, thường bao gồm URL video hoặc tệp được mã hóa base64.

Tạo video bằng API Sora 2: Các ví dụ từng bước

Bây giờ bạn thực hiện các tạo video thực tế. Bắt đầu với một lời nhắc cơ bản để thử nghiệm. Trong Apidog, điền vào phần thân (body):

{

"model": "sora-2",

"prompt": "A bustling city street at dusk with pedestrians and cars, ambient street sounds included.",

"duration": 10,

"resolution": "720p"

}

Gửi yêu cầu. API sẽ xử lý và trả về một ID công việc. Thực hiện polling điểm cuối trạng thái cứ sau 10 giây cho đến khi "completed" (hoàn thành). Truy xuất URL video từ phản hồi.

Để sử dụng nâng cao, hãy tích hợp cameos—một tính năng cho phép các yếu tố trong thế giới thực như hình ảnh của một người. Tải lên một video tham chiếu thông qua yêu cầu biểu mẫu đa phần (multipart form request) trong Apidog. Phần thân (body) có thể trông như sau:

{

"model": "sora-2",

"prompt": "The uploaded person giving a TED talk on AI.",

"cameo_video": "base64-encoded-video",

"audio_sync": true

}

Apidog xử lý tải tệp gốc, giúp việc này trở nên liền mạch.

Tuy nhiên, các sản phẩm đầu ra vẫn có thể chứa hình mờ nếu sử dụng cấp tiêu chuẩn. Quyền truy cập API Pro, dành cho người đăng ký ChatGPT Pro, thường cung cấp các tùy chọn tải xuống không có hình mờ. Kiểm tra cấp độ đăng ký của bạn; nâng cấp sẽ mở khóa tính năng này.

Để tối ưu hóa các lời nhắc, hãy thử nghiệm với các chi tiết. Thêm các mô tả vật lý như "cú nhảy bất chấp trọng lực" để tận dụng thế mạnh mô phỏng của Sora 2. Theo dõi các chỉ số sử dụng trong phân tích của Apidog để duy trì trong giới hạn tỷ lệ (rate limits), thường là 500 lượt tạo mỗi tháng cho quyền truy cập ưu tiên.

Các chiến lược loại bỏ hình mờ khỏi video Sora 2

Ngay cả khi có quyền truy cập API, một số video vẫn bao gồm hình mờ. Bạn giải quyết vấn đề này thông qua hậu xử lý. Đầu tiên, hãy hiểu các loại hình mờ: lớp phủ hiển thị (logo chuyển động) và siêu dữ liệu vô hình (tiêu chuẩn C2PA).

Để loại bỏ hình mờ hiển thị, hãy sử dụng các công cụ dựa trên AI. Vmake AI, một dịch vụ trực tuyến miễn phí, sử dụng học sâu để phát hiện và xóa các hình mờ chuyển động. Tải video Sora 2 của bạn lên, chọn khu vực hình mờ và xử lý. Công cụ này giữ nguyên chất lượng bằng cách điền lại các phần đã xóa bằng các pixel theo ngữ cảnh.

Ngoài ra, hãy sử dụng các thư viện mã nguồn mở như OpenCV trong Python. Tải video:

import cv2

cap = cv2.VideoCapture('sora_video.mp4')

width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

out = cv2.VideoWriter('clean_video.mp4', cv2.VideoWriter_fourcc(*'mp4v'), fps, (width, height))

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# Detect and mask watermark (custom logic, e.g., ROI cropping or ML model)

clean_frame = remove_watermark(frame) # Implement function

out.write(clean_frame)

cap.release()

out.release()

Triển khai remove_watermark bằng cách sử dụng một mô hình được huấn luyện trước từ Hugging Face, chẳng hạn như một mạng phân đoạn được huấn luyện trên các tập dữ liệu hình mờ.

Đối với siêu dữ liệu, hãy loại bỏ các thẻ C2PA bằng FFmpeg: ffmpeg -i input.mp4 -codec copy -bsf:v "filter_units=remove_types=6" output.mp4. Lệnh này loại bỏ các bộ lọc luồng bit cụ thể mà không cần mã hóa lại.

Tuy nhiên, hãy xem xét các hàm ý pháp lý. Các điều khoản của OpenAI cấm can thiệp vào các tín hiệu nguồn gốc (provenance signals), nhưng đối với việc sử dụng nội bộ hoặc khi được phép, các phương pháp này vẫn có thể áp dụng. Luôn ghi công nội dung do AI tạo ra một cách có đạo đức.

Tích hợp điều này vào quy trình làm việc của Apidog, tự động hóa hậu xử lý thông qua các tập lệnh. Sau khi truy xuất URL video, hãy tải xuống và chạy mã loại bỏ.

Các kỹ thuật nâng cao để tối ưu hóa API Sora 2

Để nâng cao cách sử dụng của bạn, hãy xâu chuỗi nhiều lệnh gọi API. Tạo một video cơ bản, sau đó phối lại nó với một lời nhắc tiếp theo: "Mở rộng cảnh trước đó với một bước ngoặt đầy kịch tính." Sử dụng ID công việc làm tham chiếu trong các yêu cầu tiếp theo.

Ngoài ra, hãy tích hợp các cải tiến âm thanh. Sora 2 tự động đồng bộ hóa hiệu ứng âm thanh, nhưng bạn có thể tinh chỉnh bằng cách chỉ định "bao gồm nhạc nền dàn nhạc" trong các lời nhắc.

Điều chỉnh hiệu suất bao gồm việc nhóm các yêu cầu. Apidog hỗ trợ các bộ sưu tập để chạy nhiều thử nghiệm đồng thời, lý tưởng cho các thử nghiệm lời nhắc A/B.

Hơn nữa, hãy theo dõi chi phí. Giá API Sora 2 bắt đầu từ 0,05 đô la mỗi giây video cho gói tiêu chuẩn, với gói Pro có mức giá cao hơn cho các tính năng cao cấp. Theo dõi thông qua bảng điều khiển của OpenAI và đặt cảnh báo trong Apidog.

Để có khả năng mở rộng, hãy triển khai trong môi trường sản xuất. Sử dụng các hàm đám mây như AWS Lambda để xử lý các lệnh gọi API, được kích hoạt bởi đầu vào của người dùng. Bảo mật bằng các cổng API.

Các phương pháp hay nhất và khắc phục sự cố cho Sora 2 với Apidog

Áp dụng các phương pháp này để tối đa hóa hiệu quả. Đầu tiên, xác thực đầu vào một cách nghiêm ngặt—các lời nhắc kém sẽ tạo ra video chất lượng thấp. Sử dụng các bài kiểm tra xác nhận của Apidog để kiểm tra mã trạng thái phản hồi (200 cho thành công).

Khắc phục các sự cố thường gặp: Nếu xác thực thất bại, hãy tạo lại khóa của bạn. Đối với giới hạn tỷ lệ (rate limits), hãy triển khai exponential backoff trong các tập lệnh:

import time

def api_call_with_retry(func, max_retries=5):

for attempt in range(max_retries):

try:

return func()

except Exception as e:

if 'rate_limit' in str(e):

time.sleep(2 ** attempt)

else:

raise

Lỗi mạng? Chuyển sang cài đặt proxy của Apidog.

Hơn nữa, hãy cộng tác bằng cách chia sẻ các dự án Apidog thông qua các liên kết, đảm bảo sự đồng bộ của nhóm về các cấu hình Sora 2.

Nghiên cứu điển hình: Các ứng dụng thực tế của Sora 2 không có hình mờ

Hãy xem xét một công ty tiếp thị sử dụng API Sora 2 để tạo các clip quảng cáo. Họ tạo video không có hình mờ cho các bài thuyết trình của khách hàng, tích hợp Apidog để lặp lại nhanh chóng.

Trong giáo dục, giáo viên tạo ra các bài học hoạt hình. Sau khi loại bỏ hình mờ, video được nhúng một cách sạch sẽ vào các nền tảng như YouTube.

Những ví dụ này minh họa tính linh hoạt của Sora 2 khi không bị cản trở bởi hình mờ.

Triển vọng và cập nhật trong tương lai cho API Sora 2

OpenAI tiếp tục phát triển Sora 2, với các kế hoạch mở rộng như thời lượng dài hơn và tích hợp tốt hơn. Hãy cập nhật thông tin qua blog của họ.

Apidog thường xuyên bổ sung các tính năng, chẳng hạn như tạo yêu cầu được hỗ trợ bởi AI, bổ sung cho những tiến bộ của Sora 2.

Tóm lại, việc thành thạo Sora 2 mà không có hình mờ bao gồm quyền truy cập API, sự hỗ trợ của Apidog và các kỹ thuật loại bỏ có mục tiêu. Thực hiện các bước này để tạo ra các video chất lượng chuyên nghiệp một cách hiệu quả.

button