Các kỹ sư của DeepSeek đã phát hành DeepSeek-V3.1-Terminus như một bản nâng cấp lặp đi lặp lại cho mô hình V3.1 của họ, giải quyết các vấn đề do người dùng báo cáo đồng thời khuếch đại các thế mạnh cốt lõi. Phiên bản này tập trung vào các cải tiến thực tế mà các nhà phát triển đánh giá cao trong các ứng dụng thực tế, chẳng hạn như đầu ra ngôn ngữ nhất quán và chức năng tác tử mạnh mẽ. Khi các mô hình AI phát triển, các nhóm như DeepSeek ưu tiên những cải tiến giúp tăng độ tin cậy mà không cần đại tu nền tảng. Do đó, DeepSeek-V3.1-Terminus nổi lên như một công cụ hoàn chỉnh cho các tác vụ từ tạo mã đến suy luận phức tạp.

Bản phát hành này nhấn mạnh cam kết của DeepSeek đối với đổi mới nguồn mở. Mô hình hiện có trên Hugging Face, cho phép truy cập ngay lập tức để thử nghiệm. Các kỹ sư xây dựng dựa trên nền tảng V3.1, giới thiệu các tinh chỉnh giúp nâng cao hiệu suất trên các điểm chuẩn. Kết quả là, người dùng ít gặp phải những phiền toái hơn, chẳng hạn như phản hồi pha trộn tiếng Trung-Anh hoặc các ký tự thất thường, những điều trước đây đã cản trở các tương tác liền mạch.

Tìm hiểu Kiến trúc của DeepSeek-V3.1-Terminus

Các kiến trúc sư của DeepSeek thiết kế DeepSeek-V3.1-Terminus với khung Mixture of Experts (MoE) lai, phản ánh cấu trúc của phiên bản tiền nhiệm, DeepSeek-V3. Cách tiếp cận này kết hợp các thành phần dày đặc và thưa thớt, cho phép mô hình chỉ kích hoạt các chuyên gia liên quan cho các tác vụ cụ thể. Do đó, nó đạt được hiệu quả cao, xử lý các truy vấn với chi phí tính toán giảm so với các mô hình dày đặc hoàn toàn.

Về cốt lõi, mô hình tự hào có 685 tỷ tham số, được phân phối trên các mô-đun chuyên gia. Các kỹ sư sử dụng các loại tensor BF16, F8_E4M3 và F32 cho các tham số này, tối ưu hóa cả độ chính xác và tốc độ. Tuy nhiên, một vấn đề đáng chú ý liên quan đến việc chiếu đầu ra tự chú ý không hoàn toàn tuân thủ định dạng tỷ lệ UE8M0 FP8, mà DeepSeek dự định sẽ giải quyết trong các phiên bản sắp tới. Lỗi nhỏ này không làm giảm đáng kể chức năng tổng thể nhưng làm nổi bật tính chất lặp đi lặp lại của việc phát triển mô hình.

Hơn nữa, DeepSeek-V3.1-Terminus hỗ trợ cả chế độ suy nghĩ và không suy nghĩ. Ở chế độ suy nghĩ, mô hình tham gia vào suy luận đa bước, dựa trên logic nội bộ để xử lý các vấn đề phức tạp. Ngược lại, chế độ không suy nghĩ ưu tiên phản hồi nhanh cho các truy vấn đơn giản. Tính hai mặt này bắt nguồn từ việc huấn luyện sau trên một điểm kiểm tra V3.1-Base mở rộng, kết hợp phương pháp mở rộng ngữ cảnh dài hai pha. Các nhà phát triển thu thập thêm các tài liệu dài để củng cố bộ dữ liệu, mở rộng các giai đoạn huấn luyện để xử lý ngữ cảnh tốt hơn.

Những cải tiến chính trong DeepSeek-V3.1-Terminus so với các phiên bản trước

Các kỹ sư của DeepSeek đã tinh chỉnh DeepSeek-V3.1-Terminus bằng cách giải quyết phản hồi từ bản phát hành V3.1, dẫn đến những cải tiến hữu hình. Chủ yếu, họ giảm thiểu sự không nhất quán về ngôn ngữ, loại bỏ sự pha trộn tiếng Trung-Anh thường xuyên và các ký tự ngẫu nhiên đã làm phiền các đầu ra trước đây. Thay đổi này đảm bảo các phản hồi rõ ràng hơn, chuyên nghiệp hơn, đặc biệt trong môi trường đa ngôn ngữ.

Ngoài ra, nâng cấp tác tử nổi bật như một bước tiến lớn. Các Tác tử Mã hóa (Code Agents) hiện xử lý các tác vụ lập trình với độ chính xác cao hơn, trong khi các Tác tử Tìm kiếm (Search Agents) cải thiện hiệu quả truy xuất. Những cải tiến này bắt nguồn từ dữ liệu huấn luyện tinh chỉnh và các mẫu cập nhật, cho phép mô hình tích hợp các công cụ một cách liền mạch hơn.

So sánh điểm chuẩn cho thấy những lợi ích này về mặt định lượng. Ví dụ, ở chế độ suy luận không sử dụng công cụ, điểm MMLU-Pro tăng từ 84.8 lên 85.0, và GPQA-Diamond cải thiện từ 80.1 lên 80.7. Humanity's Last Exam chứng kiến một bước nhảy vọt đáng kể từ 15.9 lên 21.7, thể hiện hiệu suất mạnh mẽ hơn trên các đánh giá đầy thách thức. LiveCodeBench vẫn gần như ổn định ở mức 74.9, với những biến động nhỏ trong Codeforces và Aider-Polyglot.

Chuyển sang sử dụng công cụ tác tử, mô hình còn vượt trội hơn nữa. BrowseComp tăng từ 30.0 lên 38.5, và SimpleQA tăng từ 93.4 lên 96.8. SWE Verified tiến lên 68.4 từ 66.0, SWE-bench Multilingual lên 57.8 từ 54.5, và Terminal-bench lên 36.7 từ 31.3. Mặc dù BrowseComp-zh giảm nhẹ, xu hướng tổng thể cho thấy độ tin cậy vượt trội.

Hơn nữa, DeepSeek-V3.1-Terminus đạt được những điều này mà không làm giảm tốc độ. Nó phản hồi nhanh hơn một số đối thủ cạnh tranh trong khi duy trì chất lượng tương đương với DeepSeek-R1 trên các điểm chuẩn khó. Sự cân bằng này xuất phát từ việc huấn luyện sau tối ưu hóa, kết hợp dữ liệu ngữ cảnh dài để tổng quát hóa tốt hơn.

Các điểm chuẩn hiệu suất và đánh giá cho DeepSeek-V3.1-Terminus

Các nhà đánh giá đánh giá DeepSeek-V3.1-Terminus trên nhiều điểm chuẩn khác nhau, cho thấy thế mạnh của nó trong suy luận và tích hợp công cụ. Trong suy luận không có công cụ, mô hình đạt 85.0 điểm trên MMLU-Pro, thể hiện khả năng ghi nhớ kiến thức rộng. GPQA-Diamond đạt 80.7, cho thấy sự thành thạo trong các câu hỏi cấp độ sau đại học.

Hơn nữa, Humanity's Last Exam ở mức 21.7 làm nổi bật khả năng xử lý tốt hơn các chủ đề bí truyền. Các điểm chuẩn mã hóa như LiveCodeBench (74.9) và Aider-Polyglot (76.1) thể hiện tiện ích thực tế, mặc dù Codeforces giảm xuống 2046, cho thấy các lĩnh vực cần tinh chỉnh thêm.

Chuyển sang các kịch bản tác tử, điểm 38.5 của BrowseComp phản ánh khả năng điều hướng web nâng cao. Điểm gần như hoàn hảo 96.8 của SimpleQA nhấn mạnh độ chính xác trong việc giải quyết truy vấn. Các bộ SWE-bench, bao gồm Verified (68.4) và Multilingual (57.8), khẳng định năng lực kỹ thuật phần mềm của nó. Terminal-bench ở mức 36.7 cho thấy khả năng trong các tương tác dòng lệnh.

So sánh, DeepSeek-V3.1-Terminus vượt trội hơn V3.1 ở hầu hết các chỉ số, đạt lợi thế chi phí 68 lần với sự đánh đổi hiệu suất tối thiểu. Nó cạnh tranh với các mô hình nguồn đóng về hiệu quả, khiến nó trở nên lý tưởng cho các ứng dụng kinh doanh.

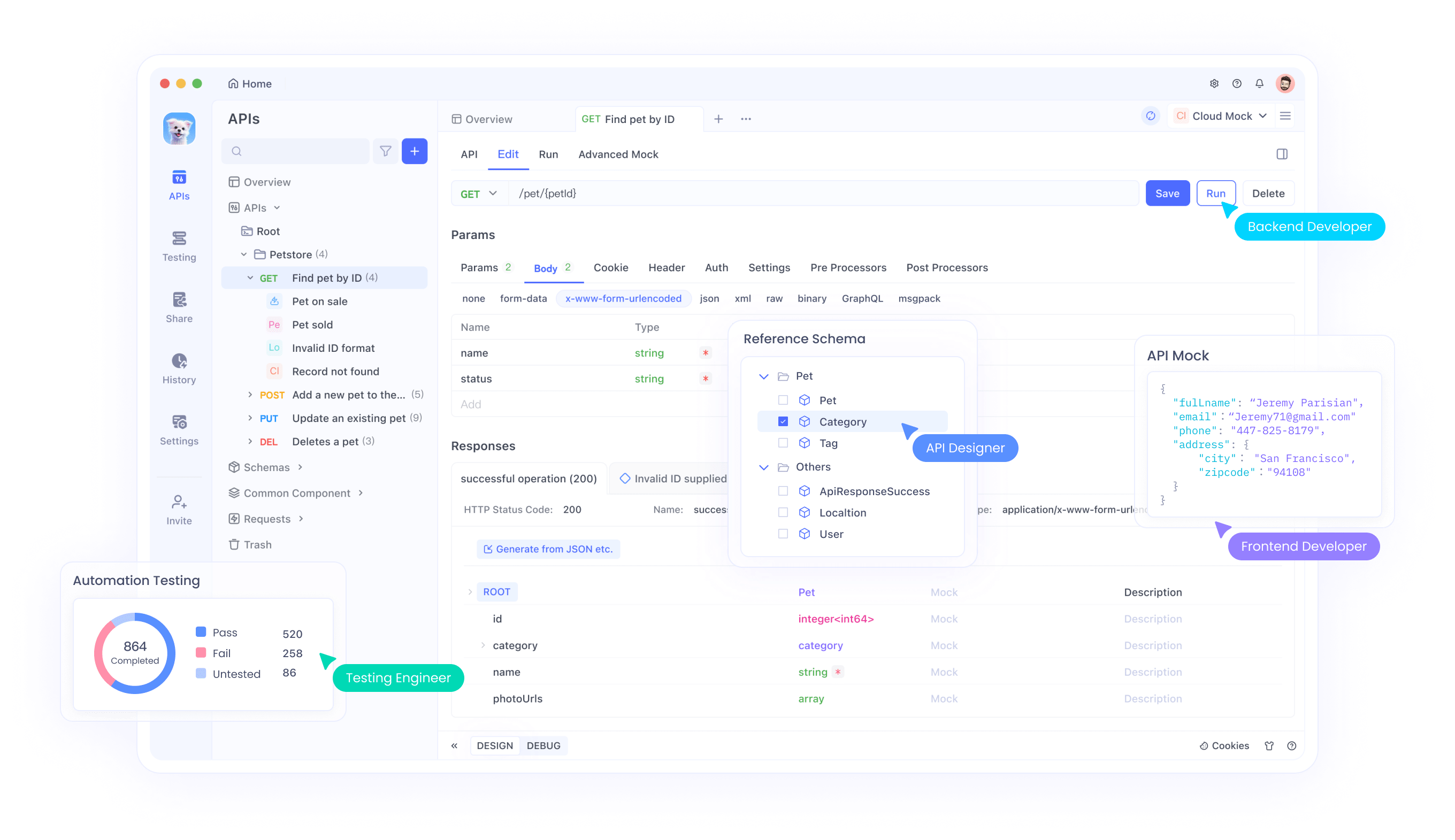

Tích hợp DeepSeek-V3.1-Terminus với API và các công cụ như Apidog

Các nhà phát triển tích hợp DeepSeek-V3.1-Terminus thông qua API tương thích OpenAI của nó, đơn giản hóa việc áp dụng. Họ chỉ định 'deepseek-chat' cho chế độ không suy nghĩ hoặc 'deepseek-reasoner' cho chế độ suy nghĩ.

Để bắt đầu, người dùng tạo khóa API trên nền tảng DeepSeek. Với Apidog, họ thiết lập môi trường bằng cách nhập URL cơ sở (https://api.deepseek.com) và lưu khóa dưới dạng biến. Thiết lập này tạo điều kiện thuận lợi cho việc kiểm thử các hoàn thành trò chuyện và gọi hàm.

Hơn nữa, Apidog hỗ trợ gỡ lỗi, cho phép các nhà phát triển xác minh phản hồi một cách hiệu quả. Để gọi hàm, họ định nghĩa các công cụ trong các yêu cầu, cho phép mô hình gọi các hàm bên ngoài một cách linh hoạt.

Giá cả vẫn cạnh tranh ở mức 1.68 đô la cho mỗi triệu token đầu ra, khuyến khích sử dụng rộng rãi. Các tích hợp mở rộng sang các khung như Geneplore AI hoặc AI/ML API, hỗ trợ các hệ thống đa tác tử.

So sánh với các mô hình AI cạnh tranh

DeepSeek-V3.1-Terminus cạnh tranh hiệu quả với các mô hình như DeepSeek-R1, đạt chất lượng tương đương trong suy luận trong khi phản hồi nhanh hơn. Nó vượt trội hơn V3.1 trong việc sử dụng công cụ, với mức tăng BrowseComp là 8.5 điểm.

So với các tùy chọn độc quyền, nó cung cấp khả năng truy cập nguồn mở và hiệu quả chi phí. Ví dụ, nó đạt hiệu suất cấp Sonnet trong các điểm chuẩn.

Hơn nữa, các chế độ lai của nó cung cấp tính linh hoạt không có ở một số đối thủ cạnh tranh. Do đó, nó thu hút các nhà phát triển có ngân sách hạn chế đang tìm kiếm các tính năng mạnh mẽ.

Chiến lược triển khai cho DeepSeek-V3.1-Terminus

Các kỹ sư triển khai mô hình cục bộ bằng cách sử dụng kho lưu trữ DeepSeek-V3. Đối với đám mây, các nền tảng như AWS Bedrock lưu trữ nó.

Mã suy luận tối ưu hóa trong kho lưu trữ hỗ trợ thiết lập. Do đó, khả năng mở rộng phù hợp với nhiều môi trường khác nhau.

Các tính năng nâng cao: Gọi hàm và Tích hợp công cụ

Các nhà phát triển triển khai gọi hàm bằng cách định nghĩa các lược đồ trong các yêu cầu API. Điều này cho phép các tương tác động, như truy vấn cơ sở dữ liệu.

Apidog hỗ trợ kiểm thử các tính năng này, đảm bảo tích hợp mạnh mẽ.

Phân tích chi phí và Mẹo tối ưu hóa

Với chi phí mỗi token thấp, DeepSeek-V3.1-Terminus mang lại giá trị. Tối ưu hóa bằng cách chọn chế độ một cách khôn ngoan—không suy nghĩ cho các tác vụ đơn giản.

Theo dõi việc sử dụng thông qua Apidog để quản lý chi phí hiệu quả.

Phản hồi của người dùng và sự đón nhận của cộng đồng

Người dùng hoan nghênh bản phát hành, ghi nhận những cải tiến về độ ổn định. Một số mong đợi V4, phản ánh kỳ vọng cao.

Các diễn đàn như Reddit sôi nổi với các cuộc thảo luận về thế mạnh tác tử của nó.

Kết luận: Nắm bắt DeepSeek-V3.1-Terminus trong phát triển AI

DeepSeek-V3.1-Terminus tinh chỉnh khả năng AI, cung cấp cho các nhà phát triển một công cụ mạnh mẽ, hiệu quả. Những cải tiến của nó về tác tử và ngôn ngữ mở đường cho các ứng dụng đổi mới. Khi các nhóm áp dụng nó, mô hình tiếp tục phát triển, được thúc đẩy bởi đóng góp của cộng đồng.