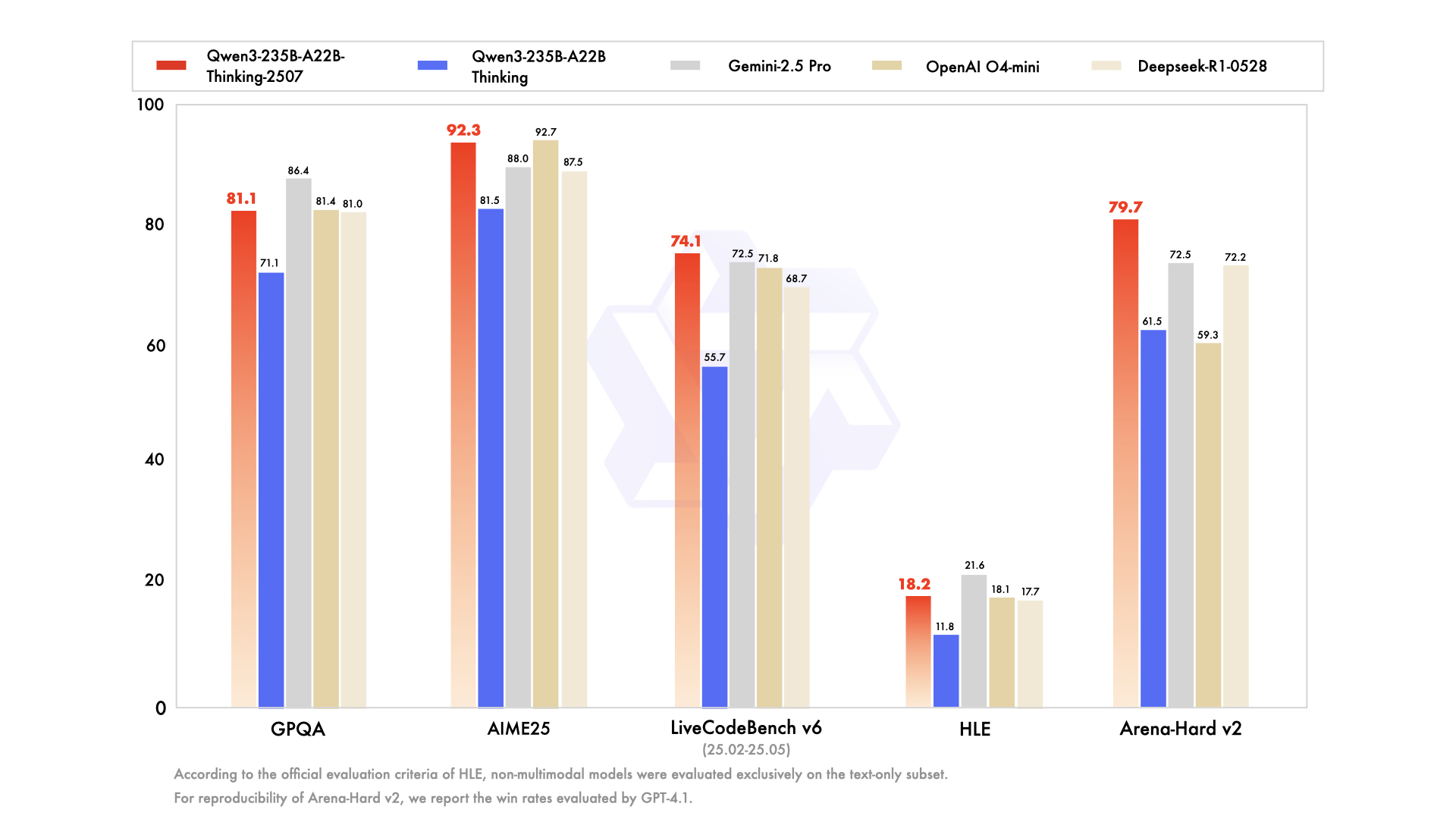

Açık kaynaklı yapay zeka topluluğu için bugün harika bir gün daha; özellikle bu anlarda gelişiyor, yeni teknoloji harikalarını hevesle parçalarına ayırıyor, test ediyor ve üzerine inşa ediyor. Temmuz 2025'te Alibaba'nın Qwen ekibi, performans ölçütlerini yeniden tanımlamaya hazır güçlü yeni bir model ailesi olan Qwen3 serisinin lansmanıyla böyle bir olayı tetikledi. Bu sürümün merkezinde büyüleyici ve son derece özel bir varyant yatıyor: Qwen3-235B-A22B-Thinking-2507.

Bu model sadece bir başka artımlı güncelleme değil; derinlemesine muhakeme yeteneklerine sahip yapay zeka sistemleri oluşturmaya yönelik kasıtlı ve stratejik bir adımı temsil ediyor. Adı bile, mantık, planlama ve çok adımlı problem çözmeye odaklanıldığının bir niyet beyanıdır. Bu makale, Qwen3-Thinking'in mimarisine, amacına ve potansiyel etkisine derinlemesine bir bakış sunarak, daha geniş Qwen3 ekosistemindeki yerini ve yapay zeka gelişiminin geleceği için ne anlama geldiğini inceliyor.

Geliştirici Ekibinizin maksimum verimlilikle birlikte çalışması için entegre, Hepsi Bir Arada bir platform mu istiyorsunuz?

Apidog tüm taleplerinizi karşılar ve Postman'ı çok daha uygun bir fiyata değiştirir!

Qwen3 Ailesi: Son Teknolojiye Çok Yönlü Bir Yaklaşım

Thinking modelini anlamak için öncelikle doğduğu bağlamı takdir etmek gerekir. Yalıtılmış olarak değil, kapsamlı ve stratejik olarak çeşitli bir Qwen3 model ailesinin parçası olarak ortaya çıktı. Qwen serisi, yüz milyonları bulan indirme geçmişi ve Hugging Face gibi platformlarda 100.000'den fazla türev model oluşturan canlı bir topluluk yetiştirerek şimdiden büyük bir takipçi kitlesi edinmiştir.

Qwen3 serisi, her biri farklı alanlara özel olarak tasarlanmış birkaç temel varyant içermektedir:

- Qwen3-Instruct: Çok çeşitli konuşma ve görev odaklı uygulamalar için tasarlanmış genel amaçlı bir talimat takip modeli. Örneğin,

Qwen3-235B-A22B-Instruct-2507varyantı, açık uçlu görevlerde kullanıcı tercihlerine gelişmiş uyumu ve geniş bilgi kapsamı ile dikkat çekmektedir. - Qwen3-Coder: Ajan kodlama için özel olarak tasarlanmış bir dizi model. Bunların en güçlüsü olan devasa 480 milyar parametreli model, açık kaynak kod üretimi ve yazılım geliştirme otomasyonu için yeni bir standart belirliyor. Ajan yeteneklerini daha iyi kullanmak için Qwen Code adlı bir komut satırı aracıyla bile birlikte geliyor.

- Qwen3-Thinking: Analizimizin odak noktası, basit talimat takibi veya kod üretiminin ötesine geçen karmaşık bilişsel görevler için uzmanlaşmıştır.

Bu aile yaklaşımı, sofistike bir stratejiyi ortaya koyuyor: tek, monolitik bir modelin her işi yapmaya çalışması yerine, Alibaba, geliştiricilerin kendi özel ihtiyaçları için doğru temeli seçmelerine olanak tanıyan bir dizi özel araç sunuyor.

Qwen3-235B-A22B-Thinking-2507'nin Düşünme Kısmından Bahsedelim

Modelin adı, Qwen3-235B-A22B-Thinking-2507, altında yatan mimarisini ve tasarım felsefesini ortaya koyan bilgilerle doludur. Hadi parça parça inceleyelim.

Qwen3: Bu, modelin Qwen serisinin üçüncü nesline ait olduğunu, önceki modellerin bilgi ve gelişmelerine dayandığını gösterir.235B-A22B(Uzman Karışımı - MoE): Bu, en kritik mimari detaydır. Model, her parametrenin her tek hesaplama için kullanıldığı yoğun bir 235 milyar parametreli ağ değildir. Bunun yerine, bir Uzman Karışımı (MoE) mimarisi kullanır.Thinking: Bu son ek, modelin uzmanlaşmasını belirtir; mantıksal çıkarım ve adım adım analizi ödüllendiren veriler üzerinde ince ayar yapılmıştır.2507: Bu bir sürüm etiketidir, muhtemelen Temmuz 2025'i temsil eder ve modelin yayınlanma veya eğitim tamamlama tarihini belirtir.

MoE mimarisi, bu modelin güç ve verimlilik kombinasyonunun anahtarıdır. Uzmanlaşmış "uzmanlardan"—daha küçük sinir ağlarından—oluşan, bir "geçit ağı" veya "yönlendirici" tarafından yönetilen büyük bir ekip olarak düşünülebilir. Herhangi bir giriş jetonu için, yönlendirici bilgiyi işlemek üzere en ilgili uzmanların küçük bir alt kümesini dinamik olarak seçer.

Qwen3-235B-A22B durumunda, özellikler şunlardır:

- Toplam Parametreler (`235B`): Bu, mevcut tüm uzmanlara dağıtılmış geniş bilgi deposunu temsil eder. Model toplamda 128 farklı uzman içerir.

- Aktif Parametreler (`A22B`): Herhangi bir tek çıkarım geçişi için, geçit ağı 8 uzmanı etkinleştirmek üzere seçer. Bu aktif uzmanların birleşik boyutu yaklaşık 22 milyar parametredir.

Bu yaklaşımın faydaları çok büyüktür. Modelin 235B parametreli bir modelin geniş bilgisine, nüansına ve yeteneklerine sahip olmasını sağlarken, hesaplama maliyeti ve çıkarım hızı çok daha küçük 22B parametreli yoğun bir modele daha yakın olur. Bu, böyle büyük bir modeli bilgi derinliğinden ödün vermeden dağıtmayı ve çalıştırmayı daha uygulanabilir hale getirir.

Teknik Özellikler ve Performans Profili

Yüksek seviyeli mimarinin ötesinde, modelin detaylı özellikleri yetenekleri hakkında daha net bir tablo çizmektedir.

- Model Mimarisi: Uzman Karışımı (MoE)

- Toplam Parametreler: ~235 Milyar

- Aktif Parametreler: Jeton başına ~22 Milyar

- Uzman Sayısı: 128

- Jeton Başına Etkinleştirilen Uzmanlar: 8

- Bağlam Uzunluğu: Model **128.000 jetonluk bir bağlam penceresini** destekler. Bu, son derece uzun belgeleri, tüm kod tabanlarını veya uzun konuşma geçmişlerini, girişin başındaki önemli bilgileri kaybetmeden işlemesine ve üzerinde akıl yürütmesine olanak tanıyan büyük bir gelişmedir.

- Jetonlayıcı (Tokenizer): 150.000'den fazla jetonluk bir kelime hazinesine sahip özel bir Bayt Çifti Kodlama (BPE) jetonlayıcı kullanır. Bu büyük kelime hazinesi boyutu, güçlü çok dilli eğitiminin bir göstergesidir ve İngilizce, Çince, Almanca, İspanyolca ve diğer birçok dilin yanı sıra programlama dillerinden metinleri verimli bir şekilde kodlamasına olanak tanır.

- Eğitim Verisi: Eğitim kümesinin tam bileşimi tescilli olsa da, bir

Thinkingmodeli kesinlikle muhakemeyi teşvik etmek için tasarlanmış özel bir veri karışımı üzerinde eğitilmiştir. Bu veri kümesi standart web metninin çok ötesine geçecek ve muhtemelen şunları içerecektir: - Akademik ve Bilimsel Makaleler: Karmaşık bilimsel ve matematiksel muhakemeyi özümsemek için arXiv, PubMed ve diğer araştırma depoları gibi kaynaklardan büyük hacimli metinler.

- Mantıksal ve Matematiksel Veri Kümeleri: Adım adım çözümler gerektiren kelime problemleri içeren GSM8K (İlkokul Matematiği) ve MATH veri kümesi gibi veri kümeleri.

- Programlama ve Kod Problemleri: Kod üretimi yoluyla mantıksal akıl yürütmeyi test eden HumanEval ve MBPP gibi veri kümeleri.

- Felsefi ve Hukuki Metinler: Yoğun, soyut ve yüksek düzeyde yapılandırılmış mantıksal argümanları anlamayı gerektiren belgeler.

- Düşünce Zinciri (CoT) Verisi: Modelin bir cevaba ulaşmak için "adım adım nasıl düşüneceği"nin açıkça gösterildiği sentetik olarak oluşturulmuş veya insan tarafından derlenmiş örnekler.

Bu derlenmiş veri karışımı, `Thinking` modelini `Instruct` kardeşinden ayıran şeydir. Sadece yardımcı olmak için eğitilmemiştir; titiz olmak için eğitilmiştir.

"Düşünme"nin Gücü: Karmaşık Bilişe Odaklanma

Qwen3-Thinking modelinin vaadi, tarihsel olarak büyük dil modelleri için büyük zorluklar teşkil eden sorunları ele alma yeteneğinde yatmaktadır. Bunlar, basit desen eşleştirme veya bilgi alımının yetersiz kaldığı görevlerdir. "Düşünme" uzmanlığı, aşağıdaki gibi alanlarda yeterliliği işaret etmektedir:

- Çok Adımlı Muhakeme: Bir sorguyu mantıksal adımlar dizisine ayırmayı gerektiren sorunları çözme. Örneğin, birden fazla piyasa değişkenine dayalı bir iş kararının finansal sonuçlarını hesaplama veya belirli fiziksel kısıtlamalar verildiğinde bir merminin yörüngesini planlama.

- Mantıksal Çıkarım: Bir dizi öncülü analiz etme ve geçerli bir sonuç çıkarma. Bu, bir mantık tablosu bulmacasını çözmeyi, bir metindeki mantıksal yanılgıları belirlemeyi veya yasal veya sözleşmesel bir bağlamda bir dizi kuralın sonuçlarını belirlemeyi içerebilir.

- Stratejik Planlama: Bir hedefe ulaşmak için bir eylem dizisi geliştirme. Bunun karmaşık oyun oynamada (satranç veya Go gibi), iş stratejisi simülasyonlarında, tedarik zinciri optimizasyonunda ve otomatik proje yönetiminde uygulamaları vardır.

- Nedensel Çıkarım: Metinde açıklanan karmaşık bir sistem içinde neden-sonuç ilişkilerini belirlemeye çalışma, modellerin sıklıkla zorlandığı bilimsel ve analitik muhakemenin temel taşı.

- Soyut Muhakeme: Soyut kavramları ve benzetmeleri anlama ve manipüle etme. Bu, yaratıcı problem çözme ve gerçek insan düzeyinde zeka için esastır, somut gerçeklerin ötesine geçerek aralarındaki ilişkilere odaklanır.

Model, genel bilgi ve problem çözme için MMLU (Büyük Çok Görevli Dil Anlayışı) ve matematiksel muhakeme için yukarıda bahsedilen GSM8K ve MATH gibi bu gelişmiş bilişsel yetenekleri özel olarak ölçen kıyaslamalarda üstün başarı göstermek üzere tasarlanmıştır.

Erişilebilirlik, Kuantizasyon ve Topluluk Katılımı

Bir modelin gücü, ancak erişilebilir ve kullanılabilir olduğunda anlamlıdır. Açık kaynak taahhüdüne sadık kalarak, Alibaba, `Thinking` varyantı da dahil olmak üzere Qwen3 ailesini Hugging Face ve ModelScope gibi platformlarda geniş çapta kullanıma sunmuştur.

Bu ölçekte bir modeli çalıştırmak için gereken önemli hesaplama kaynaklarının farkında olarak, kuantize edilmiş versiyonlar da mevcuttur. **`Qwen3-235B-A22B-Thinking-2507-FP8`** modeli bunun önemli bir örneğidir. FP8 (8-bit kayan nokta), modelin bellek ayak izini önemli ölçüde azaltan ve çıkarım hızını artıran son teknoloji bir kuantizasyon tekniğidir.

Etkisini inceleyelim:

- Standart 16-bit hassasiyette (BF16/FP16) 235B parametreli bir model, en büyük kurumsal düzeydeki sunucu kümeleri dışındaki herkes için yasaklayıcı bir miktar olan **470 GB'tan fazla VRAM** gerektirecektir.

- Ancak **FP8 kuantize edilmiş versiyonu**, bu gereksinimi **250 GB'ın altına** düşürür. Hala önemli olsa da, bu, modeli araştırma kurumları, start-up'lar ve hatta üst düzey tüketici veya profesyonel donanımlarla donatılmış çoklu GPU iş istasyonlarına sahip bireyler için mümkün kılar.

Bu, gelişmiş muhakemeyi çok daha geniş bir kitleye erişilebilir kılar. Yönetilen hizmetleri tercih eden kurumsal kullanıcılar için modeller, Alibaba'nın bulut platformlarına da entegre edilmektedir. Model Studio aracılığıyla API erişimi ve Alibaba'nın amiral gemisi yapay zeka asistanı Quark'a entegrasyon, teknolojinin her ölçekte kullanılabileceğini garanti eder.

Sonuç: Yeni Bir Problem Sınıfı İçin Yeni Bir Araç

Qwen3-235B-A22B-Thinking-2507'nin piyasaya sürülmesi, yapay zeka modeli performansının sürekli yükselen grafiğindeki sadece bir başka nokta değildir. Yapay zeka gelişiminin gelecekteki yönü hakkında bir beyandır: monolitik, genel amaçlı modellerden, güçlü, özel araçlardan oluşan çeşitli bir ekosisteme doğru bir kayış. Verimli bir Uzman Karışımı mimarisi kullanarak, Alibaba, 235 milyar parametreli bir ağın geniş bilgisine ve 22 milyar parametreli bir modelin göreceli hesaplama dostluğuna sahip bir model sunmuştur.

Bu modeli özellikle "Düşünme" için ince ayar yaparak, Qwen ekibi dünyaya en zorlu analitik ve muhakeme zorluklarını çözmeye adanmış bir araç sunuyor. Araştırmacıların karmaşık verileri analiz etmelerine yardımcı olarak bilimsel keşfi hızlandırma, işletmelerin daha iyi stratejik kararlar almasını sağlama ve eşi benzeri görülmemiş bir gelişmişlikle planlayabilen, çıkarım yapabilen ve akıl yürütebilen yeni nesil akıllı uygulamalar için temel bir katman görevi görme potansiyeline sahiptir. Açık kaynak topluluğu derinliklerini tam olarak keşfetmeye başladıkça, Qwen3-Thinking, daha yetenekli ve gerçekten akıllı yapay zeka arayışında kritik bir yapı taşı olmaya adaydır.

Geliştirici Ekibinizin maksimum verimlilikle birlikte çalışması için entegre, Hepsi Bir Arada bir platform mu istiyorsunuz?

Apidog tüm taleplerinizi karşılar ve Postman'ı çok daha uygun bir fiyata değiştirir!