เคยสงสัยไหมว่าแอปพลิเคชันสมัยใหม่สามารถปรับขนาดได้อย่างง่ายดายโดยที่คุณไม่ต้องจัดการเซิร์ฟเวอร์แม้แต่เครื่องเดียวได้อย่างไร นั่นคือความมหัศจรรย์ของ serverless APIs—ซึ่งเป็นตัวเปลี่ยนเกมในวงการคลาวด์คอมพิวติ้งที่กำลังปรับเปลี่ยนวิธีการที่เราสร้างและปรับใช้บริการแบ็กเอนด์ หากคุณเป็นนักพัฒนาที่เบื่อหน่ายกับการจัดเตรียมเซิร์ฟเวอร์ หรือเจ้าของธุรกิจที่กำลังมองหาการปรับขนาดที่คุ้มค่า serverless APIs อาจเป็นเพื่อนสนิทคนใหม่ของคุณ ในการเจาะลึกครั้งนี้ เราจะมาไขโครงสร้างพื้นฐานเบื้องหลัง serverless APIs ชั่งน้ำหนักข้อดีข้อเสียของมัน ชี้ให้เห็นเครื่องมือยอดนิยม เปรียบเทียบกับแบ็กเอนด์แบบ serverful ดั้งเดิม สำรวจการทดสอบด้วย Apidog และตอบคำถามสำคัญว่า: เมื่อไหร่ที่คุณควรใช้ serverless? จากข้อมูลเชิงลึกของผู้เชี่ยวชาญ เราจะมาวิเคราะห์ในเชิงเทคนิคและดูว่าทำไม serverless APIs จึงได้รับความนิยมอย่างถล่มทลายในปี 2025

ต้องการแพลตฟอร์มแบบครบวงจร All-in-One สำหรับทีมพัฒนาของคุณเพื่อทำงานร่วมกันด้วย ประสิทธิภาพสูงสุด หรือไม่?

Apidog ตอบสนองทุกความต้องการของคุณ และ มาแทนที่ Postman ในราคาที่ย่อมเยากว่ามาก!

ทำความเข้าใจโครงสร้างพื้นฐานและสถาปัตยกรรมของ Serverless APIs

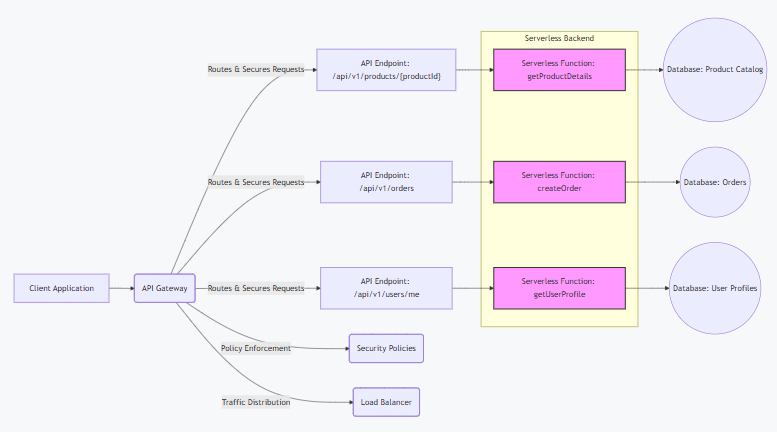

โดยแก่นแท้แล้ว serverless API คือ API ที่สร้างขึ้นบนระบบคลาวด์คอมพิวติ้งแบบ serverless ซึ่งผู้ให้บริการคลาวด์จะจัดการโครงสร้างพื้นฐานแบ็กเอนด์ ทำให้นักพัฒนาสามารถมุ่งเน้นไปที่โค้ดได้เพียงอย่างเดียว แตกต่างจากระบบดั้งเดิม serverless APIs ทำงานบนแพลตฟอร์ม Function as a Service (FaaS) โดยรันโค้ดในคอนเทนเนอร์แบบ stateless ที่ถูกเรียกใช้โดยเหตุการณ์ต่างๆ เช่น คำขอ HTTP

ในทางเทคนิค สถาปัตยกรรมจะหมุนรอบการประมวลผลแบบขับเคลื่อนด้วยเหตุการณ์ (event-driven computing) เมื่อคำขอเข้าถึงปลายทาง serverless API ของคุณ ผู้ให้บริการ (เช่น AWS Lambda) จะสร้างคอนเทนเนอร์ขึ้นมา รันฟังก์ชันของคุณ และปรับขนาดโดยอัตโนมัติตามความต้องการ นี่ใช้โมเดลการจ่ายตามการใช้งาน (pay-per-use)—ซึ่งหมายความว่าไม่มีเซิร์ฟเวอร์ที่ไม่ได้ใช้งาน จึงไม่มีค่าใช้จ่ายที่สูญเปล่า องค์ประกอบสำคัญได้แก่:

- API Gateway: ทำหน้าที่เป็นจุดเข้าใช้งาน จัดการการเราต์, การยืนยันตัวตน (เช่น JWT หรือ OAuth), การจำกัดอัตราการเรียกใช้ (rate limiting) และการแปลงคำขอ ตัวอย่างเช่น AWS API Gateway ทำงานร่วมกับ Lambda เพื่อแคชการตอบสนองสำหรับความหน่วงต่ำ

- FaaS Layer: โค้ดของคุณจะอยู่ที่นี่ในรูปของฟังก์ชัน แต่ละฟังก์ชันจะถูกแยกออกจากกัน โดยมีเวลาการรันที่จำกัด (เช่น 15 นาทีบน Lambda) เพื่อส่งเสริมการออกแบบแบบไมโครเซอร์วิส

- Backend Services: Serverless APIs เชื่อมต่อกับฐานข้อมูลที่มีการจัดการ เช่น DynamoDB (NoSQL) หรือ Aurora Serverless (SQL), ที่เก็บข้อมูลเช่น S3 และคิวเช่น SQS สำหรับการประมวลผลแบบอะซิงโครนัส

- Scaling Mechanics: ผู้ให้บริการใช้กลุ่มการปรับขนาดอัตโนมัติ (auto-scaling groups) และตัวกระจายโหลด (load balancers) ภายใต้ระบบ สำหรับทราฟฟิกสูง คอนเทนเนอร์จะถูกจำลองข้ามโซนความพร้อมใช้งาน (availability zones) เพื่อให้มั่นใจว่าระบบทำงานได้ 99% ผ่านการสำรองข้อมูล (redundancy)

เมื่อเทียบกับสถาปัตยกรรมแบบ monolithic, serverless APIs จะถูกแยกย่อยออกเป็นฟังก์ชันย่อยๆ ทำให้สามารถปรับขนาดได้อย่างอิสระ อย่างไรก็ตาม สิ่งนี้ทำให้เกิดปัญหา cold starts—ความหน่วงเริ่มต้น (50-500ms) เมื่อฟังก์ชันเริ่มทำงานจากสถานะไม่ได้ใช้งาน กลยุทธ์ในการบรรเทาปัญหารวมถึง provisioned concurrency (การเตรียมฟังก์ชันให้พร้อมใช้งานล่วงหน้า) หรือการใช้เครื่องมือ warmers เช่น AWS Lambda Warmer

โดยสรุปแล้ว สถาปัตยกรรม serverless API จะช่วยลดความซับซ้อนของระบบปฏิบัติการ, เครือข่าย และการจัดเตรียม ทำให้คุณสามารถปรับใช้โค้ดเป็นฟังก์ชันที่ตอบสนองต่อทริกเกอร์ต่างๆ ได้ มันเป็นแบบ event-driven, stateless และมีความยืดหยุ่นสูง แต่ต้องมีการออกแบบอย่างรอบคอบเพื่อหลีกเลี่ยงการผูกติดกับผู้ให้บริการรายใดรายหนึ่ง (vendor lock-in)

ข้อดีและข้อเสียของ Serverless APIs

Serverless APIs ไม่ใช่ยาวิเศษ แต่ข้อดีของมันมักจะเหนือกว่าข้อเสียสำหรับกรณีการใช้งานหลายอย่าง มาดูรายละเอียดในเชิงเทคนิคกัน

ข้อดี

- ประสิทธิภาพด้านต้นทุน: จ่ายเฉพาะเวลาที่รันงานเท่านั้น (เช่น Lambda คิดค่าบริการ $0.20 ต่อล้านคำขอ + $0.0000166667/GB-วินาที) ไม่มีค่าใช้จ่ายสำหรับเวลาที่ไม่ได้ใช้งาน เหมาะสำหรับทราฟฟิกที่ผันผวน—ประหยัดได้สูงสุดถึง 90% เมื่อเทียบกับ EC2 instances ที่ทำงานตลอดเวลา

- การปรับขนาดอัตโนมัติ: จัดการกับปริมาณการใช้งานที่พุ่งสูงขึ้นได้อย่างราบรื่น; Lambda ปรับขนาดได้ถึง 1,000 การรันพร้อมกันต่อภูมิภาคโดยค่าเริ่มต้น โดยมีขีดจำกัดสูงสุดที่ 3,000 ไม่จำเป็นต้องจัดเตรียมด้วยตนเอง

- เวลาออกสู่ตลาดเร็วขึ้น: มุ่งเน้นไปที่โค้ด ไม่ใช่โครงสร้างพื้นฐาน ปรับใช้ฟังก์ชันได้ในไม่กี่วินาทีผ่าน CLI (เช่น

aws lambda update-function-code) ซึ่งช่วยเร่งกระบวนการ CI/CD - ความยืดหยุ่นในตัว: ผู้ให้บริการมีการปรับใช้แบบ multi-AZ, การลองใหม่โดยอัตโนมัติ และ dead-letter queues สำหรับเหตุการณ์ที่ล้มเหลว

- ระบบนิเวศการรวม: เชื่อมต่อกับบริการต่างๆ ได้ง่าย เช่น S3 (สำหรับทริกเกอร์ไฟล์) หรือ DynamoDB (สำหรับสตรีมข้อมูล) ซึ่งช่วยให้สถาปัตยกรรมแบบ event-driven ทำงานได้

ข้อเสีย

- Cold Starts: ความหน่วงที่พุ่งสูงขึ้น (สูงสุด 10 วินาทีสำหรับฟังก์ชันที่ซับซ้อน) เมื่อปรับขนาดจากศูนย์ วิธีแก้ไขเช่น provisioned concurrency เพิ่มค่าใช้จ่าย ($0.035/GB-ชั่วโมง)

- Vendor Lock-In: คุณสมบัติเฉพาะของผู้ให้บริการ (เช่น Lambda Layers) ทำให้การย้ายระบบทำได้ยาก ใช้มาตรฐานเช่น OpenFaaS เพื่อความสามารถในการพกพา

- ข้อจำกัดในการรัน: การหมดเวลา (สูงสุด 15 นาที), หน่วยความจำ (10GB) และขนาดเพย์โหลด (6MB sync) จำกัดงานที่ใช้เวลานาน—ใช้ Step Functions สำหรับการจัดระเบียบ

- ความท้าทายในการดีบัก: ลักษณะการกระจายตัวทำให้การติดตามทำได้ยาก; เครื่องมือเช่น X-Ray ($0.0001/trace) ช่วยได้ แต่เพิ่มความซับซ้อน

- การจัดการสถานะ: ฟังก์ชันแบบ stateless ต้องการที่เก็บข้อมูลภายนอก (เช่น Redis) ซึ่งเพิ่มความหน่วงและค่าใช้จ่ายสำหรับแอปพลิเคชันแบบ stateful

โดยรวมแล้ว serverless APIs เหมาะอย่างยิ่งสำหรับปริมาณงานที่มาเป็นช่วงๆ (bursty) และขับเคลื่อนด้วยเหตุการณ์ (event-driven) แต่ก็อาจไม่เหมาะกับแอปพลิเคชันที่มีปริมาณงานสูงคงที่

เครื่องมือและแพลตฟอร์มยอดนิยมสำหรับ Serverless APIs

การสร้าง serverless APIs ทำได้ง่ายขึ้นด้วยแพลตฟอร์มและเครื่องมือเหล่านี้ ซึ่งแต่ละอย่างมีคุณสมบัติเฉพาะตัวสำหรับความต้องการที่แตกต่างกัน

- AWS Lambda + API Gateway: ผู้บุกเบิกแห่งวงการ serverless Lambda รันโค้ดได้ใน 15+ ภาษา โดยมี Gateway จัดการการเราต์ ราคา: $0.20/ล้านคำขอ ข้อดี: การรวมเข้ากับ AWS อย่างลึกซึ้ง ข้อเสีย: Cold starts

- Google Cloud Functions + API Gateway: ขับเคลื่อนด้วยเหตุการณ์ รองรับ Node.js/Python/Go ราคา: $0.40/ล้านการเรียกใช้ ข้อดี: Cold starts เร็ว (ผ่าน Firestore) ข้อเสีย: จำกัดอยู่กับระบบนิเวศของ Google

- Azure Functions + API Management: ฟังก์ชันที่เรียกใช้ด้วยเวลาใน C#/Java/JS ราคา: $0.20/ล้านการรัน ข้อดี: รองรับไฮบริดคลาวด์ ข้อเสีย: มีความซับซ้อนในการเรียนรู้มากกว่า

- Vercel Serverless Functions: ฟังก์ชัน Edge สำหรับแอป Next.js ราคา: ระดับฟรี (100GB-ชั่วโมง/เดือน) ข้อดี: เครือข่าย Edge ทั่วโลก ข้อเสีย: ผูกติดกับการโฮสต์ของ Vercel

- Cloudflare Workers: ที่เก็บข้อมูล KV สำหรับสถานะ ราคา: $0.30/ล้านคำขอ ข้อดี: ไม่มี cold starts ข้อเสีย: จำกัด CPU 10ms

เครื่องมืออย่าง Serverless Framework (สำหรับการปรับใช้หลายคลาวด์) หรือ SAM (เฉพาะ AWS) ช่วยให้การจัดระเบียบง่ายขึ้น สำหรับ GraphQL, Apollo Server บน Lambda เป็นที่นิยม

Serverless เทียบกับ Serverful Backends: การเปรียบเทียบเชิงเทคนิค

Serverless (FaaS) และ serverful (VMs/คอนเทนเนอร์แบบดั้งเดิม) แตกต่างกันในการจัดการ, การปรับขนาด และต้นทุน นี่คือรายละเอียด:

- การจัดการ: Serverless จะซ่อนโครงสร้างพื้นฐาน—ไม่ต้องแพตช์ OS หรือปรับสมดุลโหลด Serverful ต้องการการควบคุมเต็มรูปแบบ (เช่น การจัดระเบียบ Kubernetes)

- การปรับขนาด: Serverless ปรับขนาดอัตโนมัติตามคำขอ (จากศูนย์ถึงหลายพันในไม่กี่วินาที) Serverful ต้องการกลุ่มการปรับขนาดแบบแมนนวล/อัตโนมัติ พร้อมความล่าช้าในการจัดเตรียม

- โมเดลต้นทุน: Serverless: จ่ายตามการใช้งาน (เช่น GB-วินาทีของ Lambda) Serverful: ค่าใช้จ่ายคงที่สำหรับอินสแตนซ์ที่ทำงานตลอดเวลา (เช่น $0.10/ชั่วโมงของ EC2)

- ประสิทธิภาพ: Serverless มีความเสี่ยงเรื่อง cold starts; serverful ให้ความหน่วงที่สม่ำเสมอ แต่สิ้นเปลืองทรัพยากรในช่วงทราฟฟิกต่ำ

- การจัดการสถานะ: Serverless เป็นแบบ stateless (ใช้ DB ภายนอก); serverful รองรับแอปพลิเคชันแบบ stateful โดยกำเนิด

- กรณีการใช้งาน: Serverless สำหรับไมโครเซอร์วิส/APIs; serverful สำหรับแอปพลิเคชันแบบ monolithic หรือที่ใช้การประมวลผลสูง

ในการทดสอบมาตรฐาน serverless อาจถูกกว่า 50% สำหรับโหลดที่ไม่ต่อเนื่อง แต่ช้ากว่า 20% เนื่องจากเวลาเริ่มต้น เลือกตามรูปแบบทราฟฟิก—แนวทางไฮบริดจะผสมผสานทั้งสองอย่าง

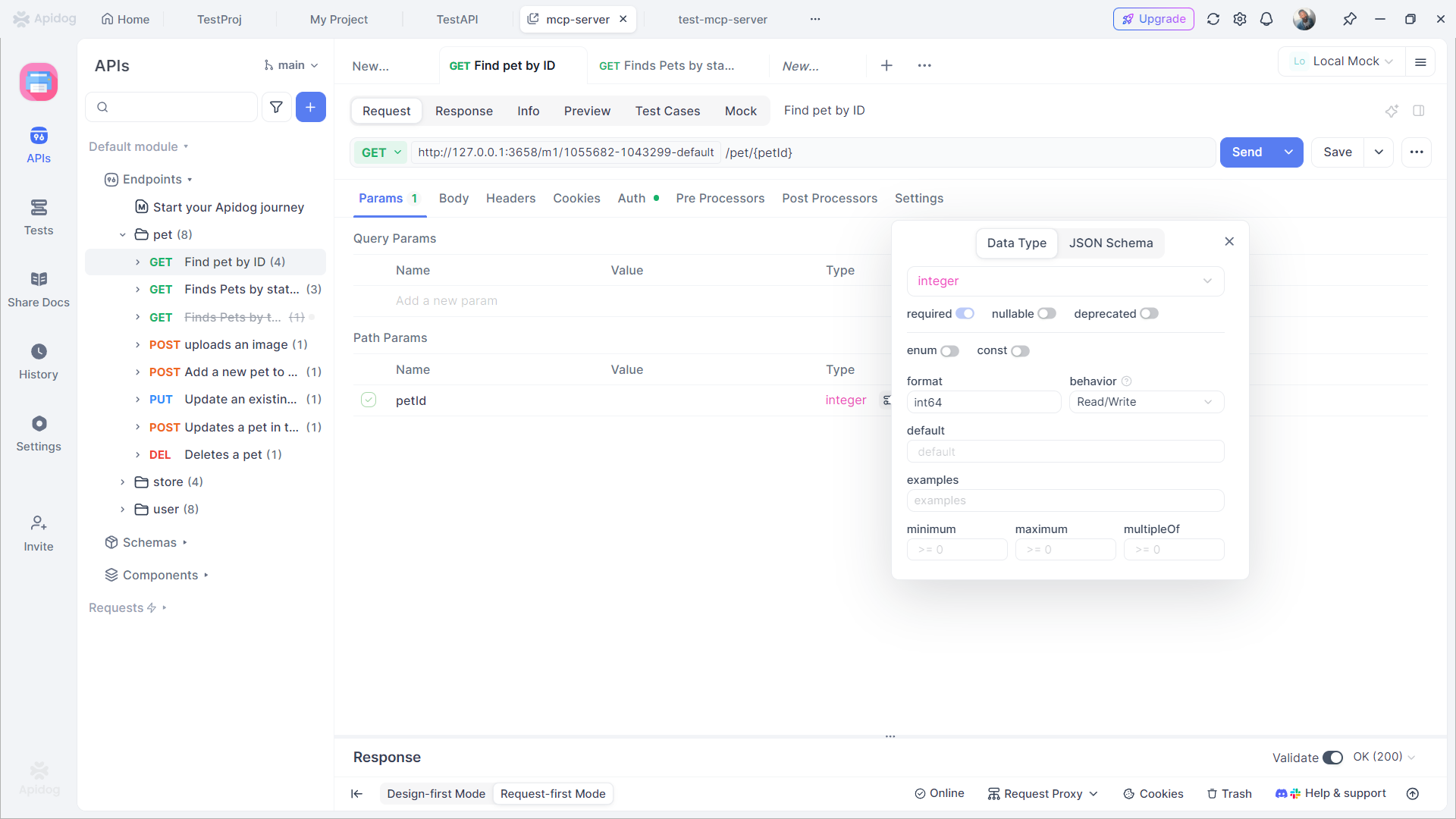

การทดสอบ Serverless APIs ด้วย Apidog

การทดสอบ serverless APIs เป็นสิ่งสำคัญเพื่อให้มั่นใจในความน่าเชื่อถือ และ Apidog เป็นเครื่องมือชั้นนำสำหรับสิ่งนี้ แพลตฟอร์มแบบครบวงจรนี้รองรับการออกแบบด้วยภาพ, การ ทดสอบ อัตโนมัติ และ Mock servers

Apidog ช่วยทดสอบ Serverless APIs ได้อย่างไร

- Visual Assertions: กำหนด enums และตรวจสอบการตอบสนองด้วยภาพ—ไม่จำเป็นต้องใช้โค้ด

- Unlimited Runs: รันคอลเลกชันได้ไม่จำกัดฟรี ไม่เหมือน Postman ที่จำกัด 25 ครั้ง/เดือน

- CI/CD Integration: เชื่อมต่อกับไปป์ไลน์เช่น Jenkins สำหรับการทดสอบอัตโนมัติเมื่อปรับใช้

- Mocking: สร้างข้อมูลที่สอดคล้องกับ enum สำหรับการทดสอบแบบออฟไลน์

- AI Assistance: สร้างการทดสอบอัตโนมัติจากคำสั่ง เช่น "Test enum for user_status."

ข้อดี: การซิงค์แบบเรียลไทม์ของ Apidog ช่วยตรวจจับปัญหาได้ตั้งแต่เนิ่นๆ และการเชื่อมต่อฐานข้อมูลช่วยทดสอบโฟลว์แบบ stateful ราคาเริ่มต้นฟรี โดย Pro อยู่ที่ $9/เดือน—ถูกกว่า Postman

เมื่อไหร่ที่คุณควรใช้ Serverless APIs?

Serverless APIs นำเสนอแนวทางที่ทันสมัยในการสร้างและปรับใช้แอปพลิเคชัน แต่ไม่ใช่โซลูชันที่เหมาะกับทุกสถานการณ์ การทำความเข้าใจจุดแข็งและข้อจำกัดของมันเป็นสิ่งสำคัญในการใช้ประโยชน์จากมันได้อย่างมีประสิทธิภาพ นี่คือรายละเอียดว่าเมื่อใดควรพิจารณา Serverless APIs พร้อมคำอธิบายโดยละเอียด:

- ทราฟฟิกผันผวน: Serverless เหมาะอย่างยิ่งสำหรับแอปพลิเคชันที่มีรูปแบบทราฟฟิกที่ไม่แน่นอนหรือพุ่งสูงขึ้นเป็นช่วงๆ ตัวอย่างเช่น แพลตฟอร์มอีคอมเมิร์ซในช่วงลดราคาแฟลชเซลล์ หรือเว็บไซต์ลงทะเบียนกิจกรรมที่ประสบปัญหาการใช้งานที่พุ่งสูงขึ้นอย่างกะทันหัน ฟังก์ชัน Serverless จะปรับขนาดขึ้นโดยอัตโนมัติเพื่อรองรับความต้องการ และ ปรับขนาดลงเหลือศูนย์ เมื่อไม่ได้ใช้งาน ทำให้คุณจ่ายเฉพาะการใช้งานจริงเท่านั้น แทนที่จะต้องจัดเตรียมโครงสร้างพื้นฐานที่ทำงานตลอดเวลาและมีราคาแพง

- การสร้างต้นแบบและ MVP อย่างรวดเร็ว: หากคุณต้องการทดสอบแนวคิดหรือสร้างผลิตภัณฑ์ขั้นต่ำที่ใช้งานได้ (MVP) อย่างรวดเร็ว serverless ช่วยให้คุณสามารถปรับใช้ฟังก์ชันได้ในไม่กี่วินาที ความคล่องตัวนี้ช่วยเร่งการทดลอง ลดเวลาออกสู่ตลาด และช่วยให้ทีมสามารถพัฒนาต่อยอดจากความคิดเห็นของผู้ใช้จริง โดยไม่ต้องลงทุนในโครงสร้างพื้นฐานที่ซับซ้อน

- แอปพลิเคชันแบบขับเคลื่อนด้วยเหตุการณ์: Serverless มีความเป็นเลิศในสถาปัตยกรรมแบบขับเคลื่อนด้วยเหตุการณ์ กรณีการใช้งานรวมถึงการประมวลผลข้อมูล IoT (เช่น การจัดการทริกเกอร์เซ็นเซอร์), การจัดการ webhook (เช่น การตอบสนองต่อเหตุการณ์ GitHub หรือ Stripe) และการจัดระเบียบไมโครเซอร์วิส ฟังก์ชันจะถูกเรียกใช้เมื่อเกิดเหตุการณ์ขึ้นอย่างแม่นยำ ทำให้มั่นใจได้ถึงการใช้ทรัพยากรอย่างมีประสิทธิภาพและลดความซับซ้อนของเวิร์กโฟลว์ที่อิงเหตุการณ์

- การเพิ่มประสิทธิภาพต้นทุนสำหรับปริมาณงานที่ไม่ต่อเนื่อง: หากแอปพลิเคชันของคุณใช้เวลาส่วนใหญ่ไม่ได้ใช้งาน (เช่น 80% หรือมากกว่า) serverless สามารถลดต้นทุนได้อย่างมาก เซิร์ฟเวอร์แบบดั้งเดิมมีค่าใช้จ่ายแม้ในขณะที่ไม่ได้ใช้งาน แต่ serverless ใช้โมเดลการจ่ายตามการรันงาน สิ่งนี้ทำให้ประหยัดสำหรับแอปที่มีทราฟฟิกต่ำ, งานแบตช์ หรือการทำงานเบื้องหลังที่รันเป็นช่วงๆ

- ทีมที่มีทรัพยากร DevOps จำกัด: องค์กรที่มีทรัพยากร DevOps จำกัดจะได้รับประโยชน์จากโครงสร้างพื้นฐานที่มีการจัดการของ serverless ผู้ให้บริการคลาวด์จัดการการปรับขนาด, การแพตช์ และการบำรุงรักษา ทำให้นักพัฒนาสามารถมุ่งเน้นไปที่โค้ดได้เพียงอย่างเดียว สิ่งนี้ช่วยลดภาระการดำเนินงานและเร่งวงจรการพัฒนา ทำให้ทีมขนาดเล็กสามารถส่งมอบฟีเจอร์ได้เร็วขึ้น

เมื่อใดที่ควรหลีกเลี่ยง Serverless APIs:

Serverless อาจไม่เหมาะสำหรับ:

- กระบวนการที่ทำงานนาน: ฟังก์ชันโดยทั่วไปมีข้อจำกัดด้านเวลา (เช่น 15 นาทีบน AWS Lambda) ทำให้ไม่เหมาะสำหรับงานต่างๆ เช่น การเข้ารหัสวิดีโอ หรือการส่งออกข้อมูลขนาดใหญ่

- แอปพลิเคชันแบบ stateful: Serverless ถูกออกแบบมาให้เป็นแบบ stateless; หลีกเลี่ยงการใช้สำหรับแอปที่ต้องการการเชื่อมต่อแบบถาวรหรือสถานะในหน่วยความจำ (เช่น WebSocket servers)

- ความต้องการความหน่วงต่ำมาก: Cold starts (ความล่าช้าเมื่อเริ่มต้นฟังก์ชัน) สามารถทำให้เกิดความหน่วงได้ ดังนั้นควรหลีกเลี่ยง serverless สำหรับระบบเรียลไทม์ที่ต้องการเวลาตอบสนองที่สม่ำเสมอภายใต้ 50ms

คำตัดสินสุดท้าย

เริ่มต้นเล็กๆ ด้วยการสร้างต้นแบบไมโครเซอร์วิสหรือปลายทาง API เพียงจุดเดียว วัดประสิทธิภาพ ต้นทุน และความสามารถในการปรับขนาดในบริบทเฉพาะของคุณ Serverless เป็นเครื่องมือที่ทรงพลังสำหรับกรณีการใช้งานที่เหมาะสม—นำมาใช้เพื่อการพัฒนาที่คล่องตัว, ปริมาณงานที่ผันผวน และความต้องการที่ขับเคลื่อนด้วยเหตุการณ์ แต่ควรใช้ควบคู่กับโครงสร้างพื้นฐานแบบดั้งเดิมสำหรับความต้องการแบบ stateful หรือประสิทธิภาพสูง ด้วยการปรับ serverless ให้สอดคล้องกับเป้าหมายทางสถาปัตยกรรมของคุณและทดสอบ API ของคุณด้วย Apidog คุณจะสามารถเพิ่มประสิทธิภาพและนวัตกรรมได้สูงสุด