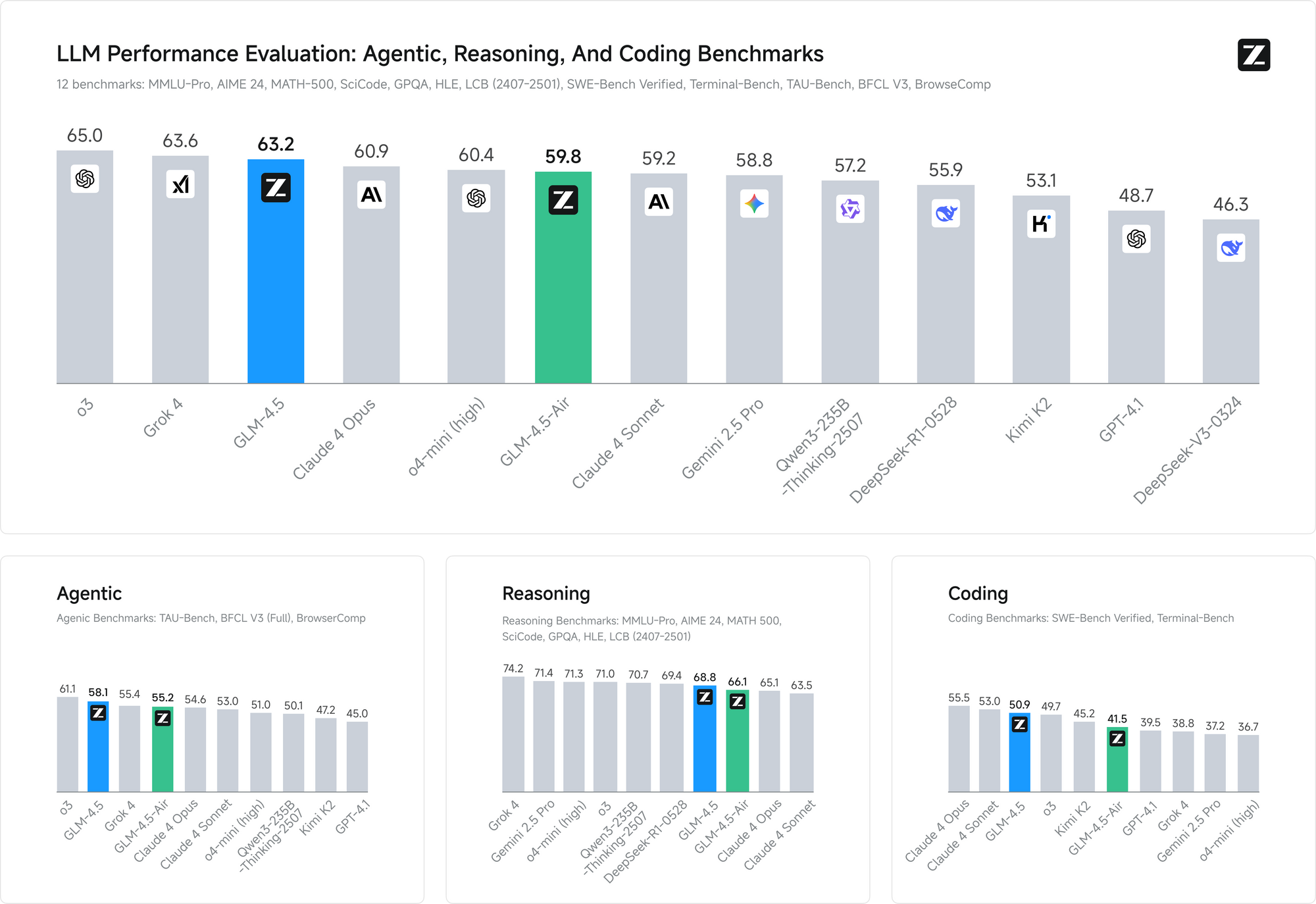

ภูมิทัศน์ AI แบบโอเพนซอร์สเพิ่งได้เห็นการเปลี่ยนแปลงครั้งใหญ่ Z.ai บริษัท AI สัญชาติจีนที่เคยรู้จักกันในชื่อ Zhipu ได้เปิดตัว GLM-4.5 และ GLM-4.5 Air โดยให้คำมั่นว่าจะแซงหน้า DeepSeek พร้อมทั้งกำหนดมาตรฐานใหม่สำหรับประสิทธิภาพและการเข้าถึงของ AI โมเดลเหล่านี้เป็นมากกว่าการปรับปรุงเล็กน้อย แต่เป็นภาพสะท้อนของการคิดใหม่พื้นฐานว่าการให้เหตุผลแบบไฮบริดและความสามารถในการเป็นเอเจนต์ควรทำงานอย่างไรในสภาพแวดล้อมการผลิต

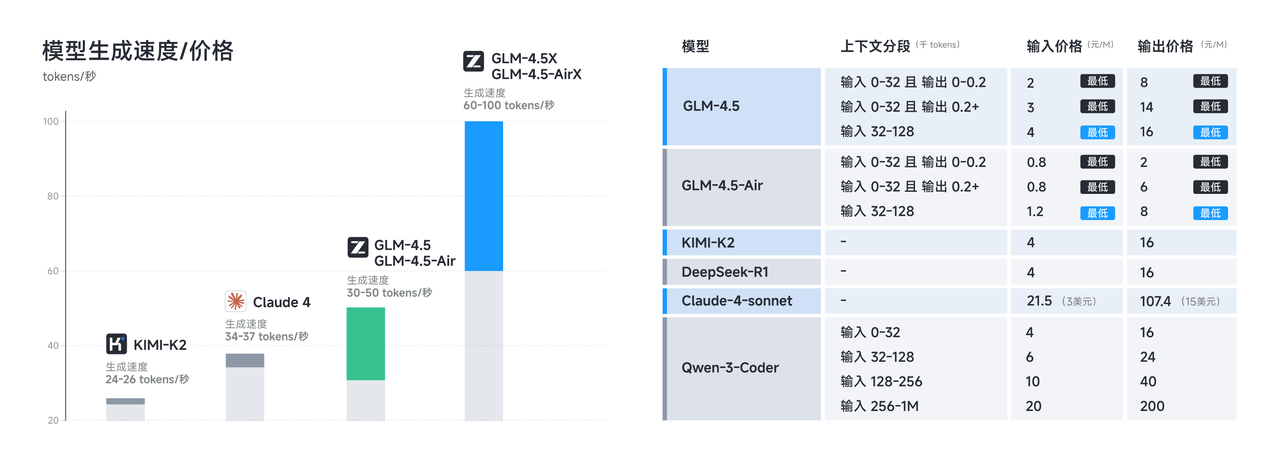

การเปิดตัวครั้งนี้เกิดขึ้นในช่วงเวลาสำคัญที่นักพัฒนาต้องการทางเลือกที่คุ้มค่าสำหรับโมเดลที่เป็นกรรมสิทธิ์มากขึ้น โดยไม่ลดทอนความสามารถ ทั้ง GLM-4.5 และ GLM-4.5 Air ตอบสนองความต้องการนี้ผ่านนวัตกรรมสถาปัตยกรรมที่ซับซ้อนซึ่งเพิ่มประสิทธิภาพสูงสุดในขณะที่ยังคงรักษาประสิทธิภาพที่ล้ำสมัยในงานด้านการให้เหตุผล การเขียนโค้ด และงานหลายรูปแบบ

ทำความเข้าใจการปฏิวัติสถาปัตยกรรม GLM-4.5

ซีรีส์ GLM-4.5 แสดงถึงการเปลี่ยนแปลงที่สำคัญจากสถาปัตยกรรม Transformer แบบดั้งเดิม GLM-4.5 สร้างขึ้นบนสถาปัตยกรรมที่พัฒนาขึ้นเองทั้งหมด และมีประสิทธิภาพ SOTA ในโมเดลโอเพนซอร์สผ่านนวัตกรรมหลักหลายประการที่ทำให้แตกต่างจากคู่แข่ง

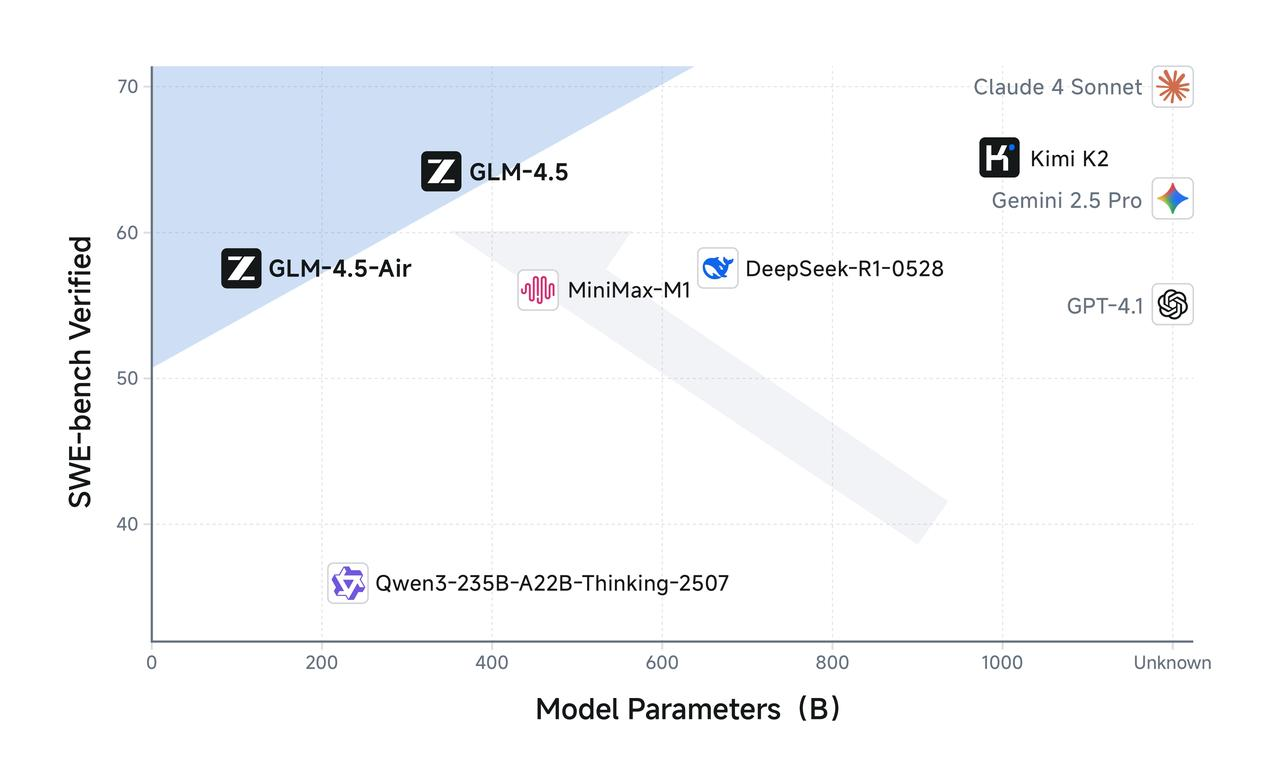

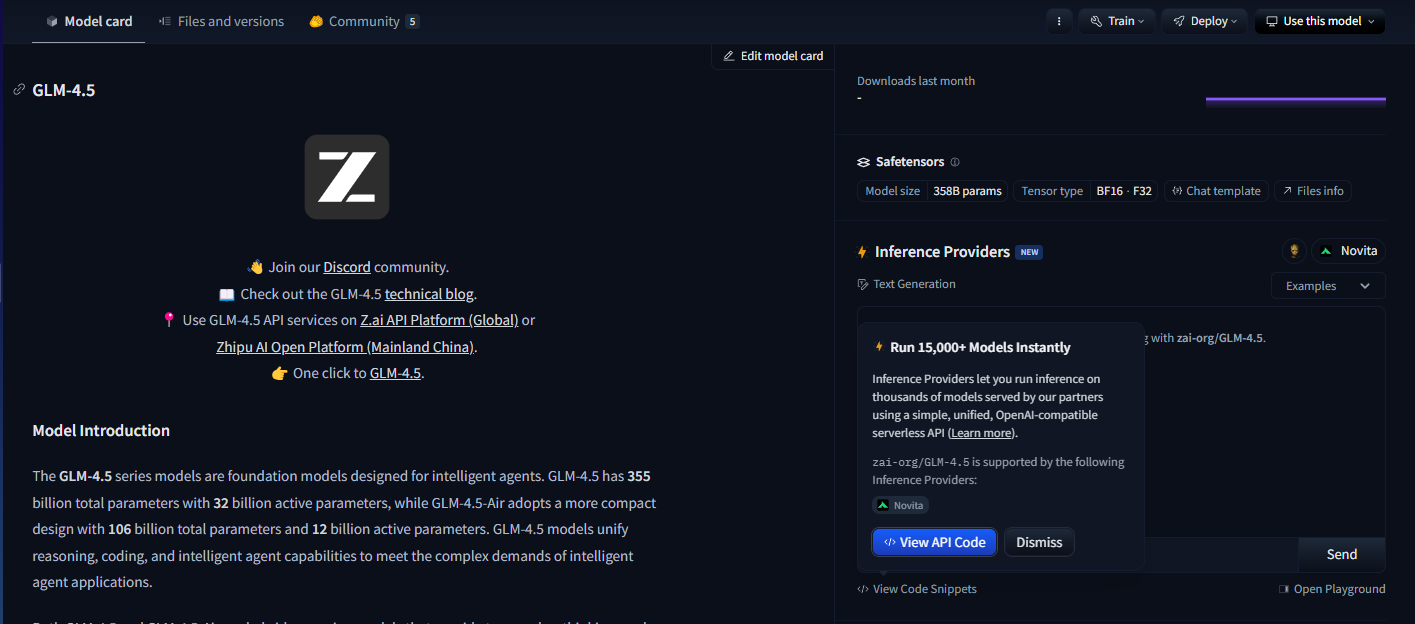

GLM-4.5 มีพารามิเตอร์ทั้งหมด 355 พันล้านตัว โดยมีพารามิเตอร์ที่ใช้งานอยู่ 32 พันล้านตัว ในขณะที่ GLM-4.5-Air ใช้การออกแบบที่กะทัดรัดกว่า โดยมีพารามิเตอร์ทั้งหมด 106 พันล้านตัว และพารามิเตอร์ที่ใช้งานอยู่ 12 พันล้านตัว การกำหนดค่าพารามิเตอร์นี้สะท้อนให้เห็นถึงความสมดุลที่ระมัดระวังระหว่างประสิทธิภาพการคำนวณและความสามารถของโมเดล ทำให้ทั้งสองโมเดลสามารถให้ประสิทธิภาพที่น่าประทับใจในขณะที่ยังคงรักษาต้นทุนการอนุมานที่สมเหตุสมผล

โมเดลเหล่านี้ใช้สถาปัตยกรรม Mixture of Experts (MoE) ที่ซับซ้อนซึ่งจะเปิดใช้งานเฉพาะชุดย่อยของพารามิเตอร์ในระหว่างการอนุมาน ทั้งคู่ใช้การออกแบบ Mixture of Experts เพื่อประสิทธิภาพสูงสุด ทำให้ GLM-4.5 สามารถประมวลผลงานที่ซับซ้อนโดยใช้เพียง 32 พันล้านพารามิเตอร์จากทั้งหมด 355 พันล้านพารามิเตอร์ ในขณะเดียวกัน GLM-4.5 Air ยังคงรักษาความสามารถในการให้เหตุผลที่เทียบเท่ากันด้วยพารามิเตอร์ที่ใช้งานอยู่เพียง 12 พันล้านตัวจากพารามิเตอร์ทั้งหมด 106 พันล้านตัว

แนวทางสถาปัตยกรรมนี้แก้ไขปัญหาที่เร่งด่วนที่สุดประการหนึ่งในการปรับใช้โมเดลภาษาขนาดใหญ่โดยตรง นั่นคือค่าใช้จ่ายในการคำนวณของการอนุมาน โมเดลหนาแน่นแบบดั้งเดิมจำเป็นต้องเปิดใช้งานพารามิเตอร์ทั้งหมดสำหรับการดำเนินการอนุมานทุกครั้ง ทำให้เกิดภาระการคำนวณที่ไม่จำเป็นสำหรับงานที่ง่ายกว่า ซีรีส์ GLM-4.5 แก้ปัญหานี้ผ่านการกำหนดเส้นทางพารามิเตอร์อัจฉริยะที่จับคู่ความซับซ้อนของการคำนวณกับข้อกำหนดของงาน

นอกจากนี้ โมเดลยังรองรับหน้าต่างบริบทอินพุตสูงสุด 128k และเอาต์พุต 96k ซึ่งให้ความสามารถในการจัดการบริบทที่สำคัญซึ่งช่วยให้การให้เหตุผลแบบยาวที่ซับซ้อนและการวิเคราะห์เอกสารที่ครอบคลุม หน้าต่างบริบทที่ขยายนี้มีประโยชน์อย่างยิ่งสำหรับแอปพลิเคชันเอเจนต์ที่โมเดลต้องรักษาความตระหนักรู้ถึงปฏิสัมพันธ์หลายขั้นตอนที่ซับซ้อน

ลักษณะประสิทธิภาพที่ปรับให้เหมาะสมของ GLM-4.5 Air

GLM-4.5 Air กลายเป็นแชมป์ด้านประสิทธิภาพของซีรีส์นี้ ซึ่งออกแบบมาโดยเฉพาะสำหรับสถานการณ์ที่ทรัพยากรการคำนวณจำเป็นต้องได้รับการจัดการอย่างระมัดระวัง GLM-4.5-Air เป็นโมเดลพื้นฐานที่ออกแบบมาโดยเฉพาะสำหรับแอปพลิเคชัน AI agent ซึ่งสร้างขึ้นบนสถาปัตยกรรม Mixture-of-Experts (MoE) ที่ให้ความสำคัญกับความเร็วและการเพิ่มประสิทธิภาพทรัพยากรโดยไม่ลดทอนความสามารถหลัก

รุ่น Air แสดงให้เห็นว่าการลดพารามิเตอร์อย่างรอบคอบสามารถรักษาคุณภาพของโมเดลในขณะที่ปรับปรุงความเป็นไปได้ในการปรับใช้ได้อย่างมาก ด้วยพารามิเตอร์ทั้งหมด 106 พันล้านตัวและพารามิเตอร์ที่ใช้งานอยู่ 12 พันล้านตัว GLM-4.5 Air สามารถเพิ่มประสิทธิภาพได้อย่างน่าทึ่งซึ่งส่งผลโดยตรงต่อการลดต้นทุนการอนุมานและเวลาตอบสนองที่เร็วขึ้น

ข้อกำหนดหน่วยความจำเป็นอีกด้านหนึ่งที่ GLM-4.5 Air โดดเด่น GLM-4.5-Air ต้องการหน่วยความจำ GPU 16GB (INT4 quantized ที่ประมาณ 12GB) ทำให้องค์กรที่มีข้อจำกัดด้านฮาร์ดแวร์ปานกลางสามารถเข้าถึงได้ ปัจจัยการเข้าถึงนี้มีความสำคัญอย่างยิ่งต่อการนำไปใช้อย่างแพร่หลาย เนื่องจากทีมพัฒนาจำนวนมากไม่สามารถหาเหตุผลเข้าข้างตนเองสำหรับค่าใช้จ่ายโครงสร้างพื้นฐานที่เกี่ยวข้องกับโมเดลขนาดใหญ่กว่าได้

การเพิ่มประสิทธิภาพขยายไปไกลกว่าประสิทธิภาพพารามิเตอร์บริสุทธิ์เพื่อครอบคลุมการฝึกอบรมเฉพาะสำหรับงานที่เน้นเอเจนต์ ได้รับการปรับให้เหมาะสมอย่างกว้างขวางสำหรับการใช้เครื่องมือ การท่องเว็บ การพัฒนาซอฟต์แวร์ และการพัฒนาส่วนหน้า ทำให้สามารถรวมเข้ากับเอเจนต์การเขียนโค้ดได้อย่างราบรื่น ความเชี่ยวชาญนี้หมายความว่า GLM-4.5 Air มอบประสิทธิภาพที่เหนือกว่าในงานพัฒนาเชิงปฏิบัติเมื่อเทียบกับโมเดลวัตถุประสงค์ทั่วไปที่มีขนาดใกล้เคียงกัน

เวลาแฝงในการตอบสนองมีความสำคัญอย่างยิ่งในแอปพลิเคชันแบบโต้ตอบที่ผู้ใช้คาดหวังการตอบสนองเกือบจะทันที การลดจำนวนพารามิเตอร์ของ GLM-4.5 Air และไปป์ไลน์การอนุมานที่ปรับให้เหมาะสมช่วยให้เวลาตอบสนองน้อยกว่าหนึ่งวินาทีสำหรับข้อความค้นหาส่วนใหญ่ ทำให้เหมาะสำหรับแอปพลิเคชันแบบเรียลไทม์ เช่น การเติมโค้ด การดีบักแบบโต้ตอบ และการสร้างเอกสารสด

การนำการให้เหตุผลแบบไฮบริดไปใช้และประโยชน์

ลักษณะเด่นของโมเดล GLM-4.5 ทั้งสองรุ่นคือความสามารถในการให้เหตุผลแบบไฮบริด ทั้ง GLM-4.5 และ GLM-4.5-Air เป็นโมเดลการให้เหตุผลแบบไฮบริดที่ให้สองโหมด: โหมดการคิดสำหรับการให้เหตุผลที่ซับซ้อนและการใช้เครื่องมือ และโหมดไม่คิดสำหรับการตอบสนองทันที สถาปัตยกรรมสองโหมดนี้แสดงถึงนวัตกรรมพื้นฐานในวิธีที่โมเดล AI จัดการงานด้านการรับรู้ประเภทต่างๆ

โหมดการคิดจะเปิดใช้งานเมื่อโมเดลพบปัญหาที่ซับซ้อนซึ่งต้องใช้การให้เหตุผลหลายขั้นตอน การใช้เครื่องมือ หรือการวิเคราะห์ที่ขยายออกไป ในระหว่างโหมดการคิด โมเดลจะสร้างขั้นตอนการให้เหตุผลระดับกลางที่นักพัฒนาสามารถมองเห็นได้ แต่ซ่อนจากผู้ใช้ปลายทาง ความโปร่งใสนี้ช่วยให้สามารถดีบักและเพิ่มประสิทธิภาพกระบวนการให้เหตุผลในขณะที่ยังคงรักษาอินเทอร์เฟซผู้ใช้ที่สะอาด

ในทางกลับกัน โหมดไม่คิดจะจัดการกับข้อความค้นหาที่ตรงไปตรงมาซึ่งได้รับประโยชน์จากการตอบสนองทันทีโดยไม่มีค่าใช้จ่ายในการให้เหตุผลที่ขยายออกไป โมเดลจะพิจารณาโดยอัตโนมัติว่าจะใช้โหมดใดตามความซับซ้อนของข้อความค้นหาและบริบท เพื่อให้มั่นใจถึงการใช้ทรัพยากรที่เหมาะสมที่สุดในกรณีการใช้งานที่หลากหลาย

แนวทางไฮบริดนี้แก้ปัญหาความท้าทายที่เกิดขึ้นอย่างต่อเนื่องในระบบ AI ที่ใช้งานจริง: การรักษาสมดุลระหว่างความเร็วในการตอบสนองกับคุณภาพการให้เหตุผล โมเดลแบบดั้งเดิมจะเสียสละความเร็วเพื่อการให้เหตุผลที่ครอบคลุม หรือให้การตอบสนองที่รวดเร็วแต่อาจจะตื้น ระบบไฮบริดของ GLM-4.5 ช่วยขจัดข้อแลกเปลี่ยนนี้โดยการจับคู่ความซับซ้อนของการให้เหตุผลกับข้อกำหนดของงาน

ทั้งคู่มีโหมดการคิดสำหรับงานที่ซับซ้อนและโหมดไม่คิดสำหรับการตอบสนองทันที สร้างประสบการณ์ผู้ใช้ที่ราบรื่นซึ่งปรับให้เข้ากับความต้องการทางปัญญาที่แตกต่างกัน นักพัฒนาสามารถกำหนดค่าพารามิเตอร์การเลือกโหมดเพื่อปรับสมดุลระหว่างความเร็วและความลึกของการให้เหตุผลตามข้อกำหนดของแอปพลิเคชันเฉพาะ

โหมดการคิดมีประโยชน์อย่างยิ่งสำหรับแอปพลิเคชันเอเจนต์ที่โมเดลต้องวางแผนการดำเนินการหลายขั้นตอน ประเมินตัวเลือกการใช้เครื่องมือ และรักษาการให้เหตุผลที่สอดคล้องกันตลอดการโต้ตอบที่ขยายออกไป ในขณะเดียวกัน โหมดไม่คิดช่วยให้มั่นใจถึงประสิทธิภาพการตอบสนองสำหรับข้อความค้นหาที่เรียบง่าย เช่น การค้นหาข้อเท็จจริงหรือการเติมโค้ดที่ตรงไปตรงมา

ข้อมูลจำเพาะทางเทคนิคและรายละเอียดการฝึกอบรม

รากฐานทางเทคนิคที่รองรับความสามารถอันน่าประทับใจของ GLM-4.5 สะท้อนให้เห็นถึงความพยายามทางวิศวกรรมที่กว้างขวางและวิธีการฝึกอบรมที่เป็นนวัตกรรม โมเดลที่ได้รับการฝึกอบรมด้วยโทเค็น 15 ล้านล้านโทเค็น พร้อมรองรับหน้าต่างบริบทอินพุตสูงสุด 128k และเอาต์พุต 96k แสดงให้เห็นถึงขนาดและความซับซ้อนที่จำเป็นสำหรับประสิทธิภาพที่ล้ำสมัย

การดูแลจัดการข้อมูลการฝึกอบรมเป็นปัจจัยสำคัญในคุณภาพของโมเดล โดยเฉพาะอย่างยิ่งสำหรับแอปพลิเคชันเฉพาะทาง เช่น การสร้างโค้ดและการให้เหตุผลแบบเอเจนต์ คลังข้อมูลการฝึกอบรม 15 ล้านล้านโทเค็นประกอบด้วยแหล่งข้อมูลที่หลากหลาย รวมถึงที่เก็บโค้ด เอกสารทางเทคนิค ตัวอย่างการให้เหตุผล และเนื้อหาหลายรูปแบบที่ช่วยให้เข้าใจได้อย่างครอบคลุมในโดเมนต่างๆ

ความสามารถของหน้าต่างบริบททำให้ GLM-4.5 แตกต่างจากโมเดลคู่แข่งหลายตัว GLM-4.5 มีความยาวบริบท 128k และความสามารถในการเรียกใช้ฟังก์ชันดั้งเดิม ทำให้สามารถวิเคราะห์แบบยาวที่ซับซ้อนและการสนทนาหลายรอบโดยไม่มีการตัดบริบท หน้าต่างบริบทเอาต์พุต 96k ช่วยให้โมเดลสามารถสร้างการตอบสนองที่ครอบคลุมโดยไม่มีข้อจำกัดความยาวเทียม

การเรียกใช้ฟังก์ชันดั้งเดิมแสดงถึงข้อได้เปรียบทางสถาปัตยกรรมอีกประการหนึ่งที่ช่วยลดความจำเป็นในการจัดเรียงภายนอก โมเดลสามารถเรียกใช้เครื่องมือและ API ภายนอกได้โดยตรงซึ่งเป็นส่วนหนึ่งของกระบวนการให้เหตุผล สร้างเวิร์กโฟลว์เอเจนต์ที่มีประสิทธิภาพและเชื่อถือได้มากขึ้น ความสามารถนี้มีความสำคัญอย่างยิ่งสำหรับแอปพลิเคชันการผลิตที่โมเดลต้องโต้ตอบกับฐานข้อมูล บริการภายนอก และเครื่องมือพัฒนา

กระบวนการฝึกอบรมประกอบด้วยการเพิ่มประสิทธิภาพเฉพาะสำหรับงานเอเจนต์ ทำให้มั่นใจว่าโมเดลจะพัฒนาความสามารถที่แข็งแกร่งในการใช้เครื่องมือ การให้เหตุผลหลายขั้นตอน และการบำรุงรักษาบริบท สถาปัตยกรรมแบบรวมสำหรับการให้เหตุผล การเขียนโค้ด และเวิร์กโฟลว์การรับรู้-การดำเนินการหลายรูปแบบช่วยให้การเปลี่ยนผ่านระหว่างประเภทงานต่างๆ ภายในปฏิสัมพันธ์เดียวเป็นไปอย่างราบรื่น

การวัดประสิทธิภาพยืนยันประสิทธิภาพของแนวทางการฝึกอบรมเหล่านี้ ในการวัดประสิทธิภาพทั้งสอง GLM-4.5 มีประสิทธิภาพเทียบเท่ากับ Claude ในการประเมินความสามารถของเอเจนต์ แสดงให้เห็นถึงความสามารถในการแข่งขันกับโมเดลที่เป็นกรรมสิทธิ์ชั้นนำในขณะที่ยังคงรักษาการเข้าถึงแบบโอเพนซอร์ส

ข้อดีของการอนุญาตให้ใช้สิทธิ์และการปรับใช้เชิงพาณิชย์

การอนุญาตให้ใช้สิทธิ์แบบโอเพนซอร์สแสดงถึงหนึ่งในข้อได้เปรียบในการแข่งขันที่สำคัญที่สุดของ GLM-4.5 ในภูมิทัศน์ AI ปัจจุบัน โมเดลพื้นฐาน โมเดลไฮบริด (การคิด/ไม่คิด) และเวอร์ชัน FP8 ทั้งหมดได้รับการเผยแพร่เพื่อการใช้งานเชิงพาณิชย์และพัฒนาต่อยอดโดยไม่จำกัดภายใต้ใบอนุญาต MIT ซึ่งให้อิสระอย่างไม่เคยมีมาก่อนสำหรับการปรับใช้เชิงพาณิชย์

แนวทางการอนุญาตให้ใช้สิทธิ์นี้ช่วยขจัดข้อจำกัดหลายประการที่จำกัดโมเดลโอเพนซอร์สอื่นๆ องค์กรสามารถแก้ไข แจกจ่าย และนำ GLM-4.5 ไปใช้ในเชิงพาณิชย์ได้โดยไม่มีค่าธรรมเนียมใบอนุญาตหรือข้อจำกัดการใช้งาน ใบอนุญาต MIT แก้ไขข้อกังวลเชิงพาณิชย์ที่มักจะทำให้การปรับใช้ AI ขององค์กรซับซ้อน

วิธีการเข้าถึงที่หลากหลายและการรวมแพลตฟอร์ม

GLM-4.5 และ GLM-4.5 Air นำเสนอช่องทางการเข้าถึงที่หลากหลายแก่นักพัฒนา โดยแต่ละช่องทางได้รับการปรับให้เหมาะสมสำหรับกรณีการใช้งานและข้อกำหนดทางเทคนิคที่แตกต่างกัน การทำความเข้าใจตัวเลือกการปรับใช้เหล่านี้ช่วยให้ทีมสามารถเลือกวิธีการรวมที่เหมาะสมที่สุดสำหรับแอปพลิเคชันเฉพาะของตนได้

เว็บไซต์ทางการและการเข้าถึง API โดยตรง

วิธีการเข้าถึงหลักคือการใช้แพลตฟอร์มอย่างเป็นทางการของ Z.ai ที่ chat.z.ai ซึ่งมีอินเทอร์เฟซที่ใช้งานง่ายสำหรับการโต้ตอบกับโมเดลได้ทันที อินเทอร์เฟซบนเว็บนี้ช่วยให้สามารถสร้างต้นแบบและทดสอบได้อย่างรวดเร็วโดยไม่ต้องมีการรวมทางเทคนิค นักพัฒนาสามารถประเมินความสามารถของโมเดล ทดสอบกลยุทธ์วิศวกรรมพรอมต์ และตรวจสอบกรณีการใช้งานก่อนที่จะนำ API ไปใช้

การเข้าถึง API โดยตรงผ่านปลายทางอย่างเป็นทางการของ Z.ai ให้ความสามารถในการรวมระดับการผลิตพร้อมเอกสารและการสนับสนุนที่ครอบคลุม API อย่างเป็นทางการให้การควบคุมพารามิเตอร์โมเดลอย่างละเอียด รวมถึงการเลือกโหมดการให้เหตุผลแบบไฮบริด การใช้หน้าต่างบริบท และตัวเลือกการจัดรูปแบบการตอบสนอง

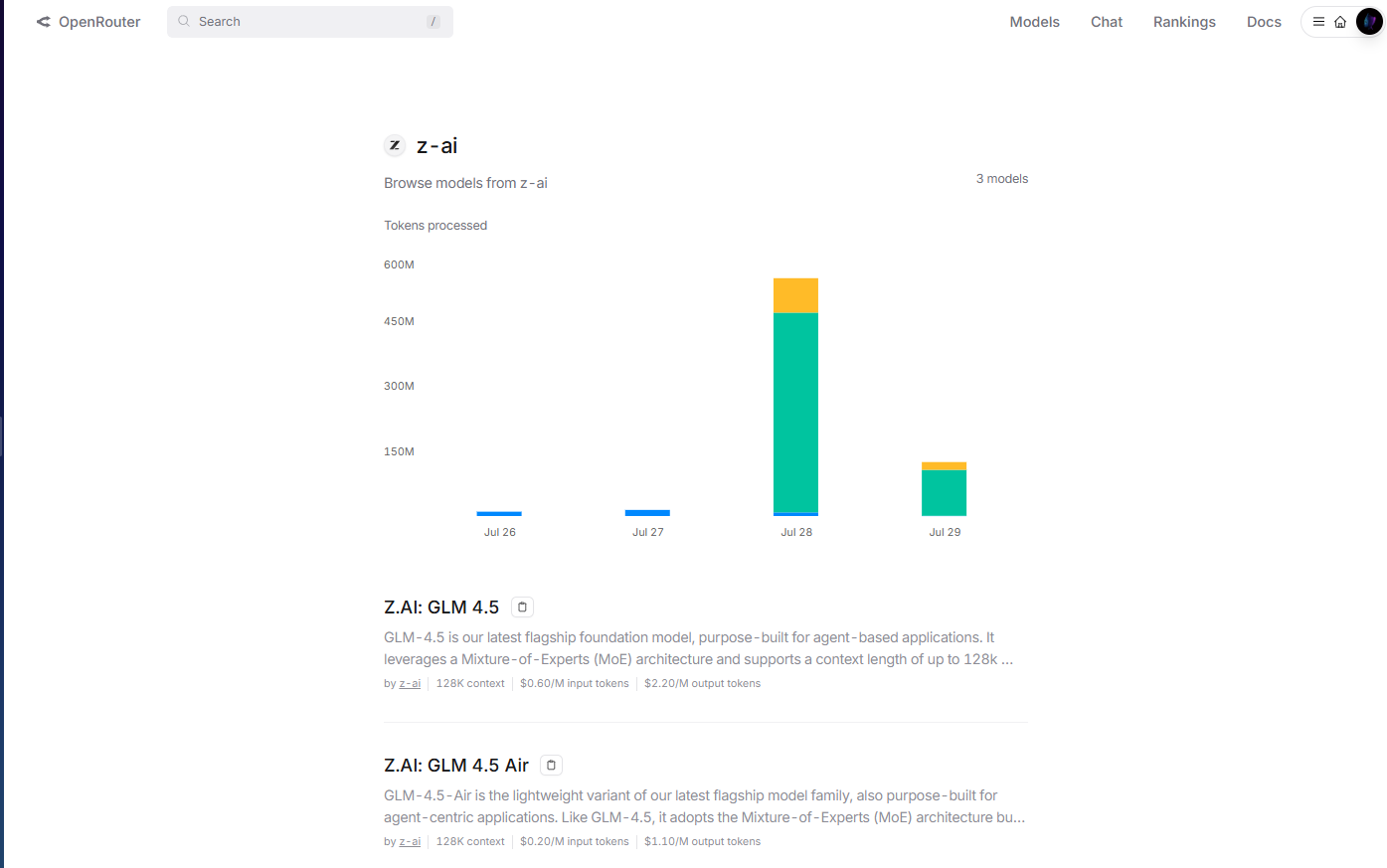

การรวม OpenRouter เพื่อการเข้าถึงที่ง่ายขึ้น

OpenRouter ให้การเข้าถึง โมเดล GLM-4.5 ที่คล่องตัวผ่านแพลตฟอร์ม API แบบรวมที่ openrouter.ai/z-ai วิธีการรวมนี้มีประโยชน์อย่างยิ่งสำหรับนักพัฒนาที่ใช้โครงสร้างพื้นฐานหลายโมเดลของ OpenRouter อยู่แล้ว เนื่องจากช่วยลดความจำเป็นในการจัดการคีย์ API และรูปแบบการรวมที่แยกต่างหาก

การนำ OpenRouter ไปใช้จะจัดการการรับรองความถูกต้อง การจำกัดอัตรา และการจัดการข้อผิดพลาดโดยอัตโนมัติ ซึ่งช่วยลดความซับซ้อนในการรวมสำหรับทีมพัฒนา นอกจากนี้ รูปแบบ API ที่เป็นมาตรฐานของ OpenRouter ยังช่วยให้สามารถสลับโมเดลและทดสอบ A/B ระหว่าง GLM-4.5 และโมเดลอื่นๆ ที่มีอยู่ได้อย่างง่ายดายโดยไม่ต้องแก้ไขโค้ด

การจัดการต้นทุนมีความโปร่งใสมากขึ้นผ่านระบบการเรียกเก็บเงินแบบรวมของ OpenRouter ซึ่งให้การวิเคราะห์การใช้งานโดยละเอียดและการควบคุมการใช้จ่ายในผู้ให้บริการโมเดลหลายราย แนวทางแบบรวมศูนย์นี้ช่วยลดความซับซ้อนในการจัดการงบประมาณสำหรับองค์กรที่ใช้โมเดล AI หลายตัวในแอปพลิเคชันของตน

Hugging Face Hub สำหรับการปรับใช้โอเพนซอร์ส

Hugging Face Hub โฮสต์ โมเดล GLM-4.5 โดยมีบัตรโมเดลที่ครอบคลุม เอกสารทางเทคนิค และตัวอย่างการใช้งานที่ขับเคลื่อนโดยชุมชน แพลตฟอร์มนี้มีความสำคัญอย่างยิ่งสำหรับนักพัฒนาที่ต้องการรูปแบบการปรับใช้โอเพนซอร์ส หรือต้องการการปรับแต่งโมเดลที่กว้างขวาง

การรวม Hugging Face ช่วยให้สามารถปรับใช้ในเครื่องโดยใช้ไลบรารี Transformers ทำให้องค์กรสามารถควบคุมการโฮสต์โมเดลและความเป็นส่วนตัวของข้อมูลได้อย่างสมบูรณ์ นักพัฒนาสามารถดาวน์โหลดน้ำหนักโมเดลได้โดยตรง นำไปป์ไลน์การอนุมานแบบกำหนดเองไปใช้ และเพิ่มประสิทธิภาพการกำหนดค่าการปรับใช้สำหรับสภาพแวดล้อมฮาร์ดแวร์เฉพาะ

ตัวเลือกการปรับใช้แบบโฮสต์เอง

องค์กรที่มีข้อกำหนดด้านความเป็นส่วนตัวของข้อมูลที่เข้มงวดหรือความต้องการโครงสร้างพื้นฐานเฉพาะทางสามารถปรับใช้โมเดล GLM-4.5 โดยใช้การกำหนดค่าแบบโฮสต์เอง ใบอนุญาต MIT ช่วยให้สามารถปรับใช้ได้อย่างไม่จำกัดในสภาพแวดล้อมคลาวด์ส่วนตัว โครงสร้างพื้นฐานในองค์กร หรือสถาปัตยกรรมแบบไฮบริด

การปรับใช้แบบโฮสต์เองให้การควบคุมพฤติกรรมของโมเดล การกำหนดค่าความปลอดภัย และรูปแบบการรวมสูงสุด องค์กรสามารถนำระบบการรับรองความถูกต้องแบบกำหนดเอง โครงสร้างพื้นฐานการตรวจสอบเฉพาะทาง และการเพิ่มประสิทธิภาพเฉพาะโดเมนไปใช้ได้โดยไม่มีการพึ่งพาภายนอก

การปรับใช้แบบคอนเทนเนอร์โดยใช้ Docker หรือ Kubernetes ช่วยให้สามารถนำไปใช้แบบโฮสต์เองที่ปรับขนาดได้ซึ่งสามารถปรับให้เข้ากับความต้องการปริมาณงานที่แตกต่างกันได้ รูปแบบการปรับใช้เหล่านี้มีประโยชน์อย่างยิ่งสำหรับองค์กรที่มีความเชี่ยวชาญในการจัดการคอนเทนเนอร์อยู่แล้ว

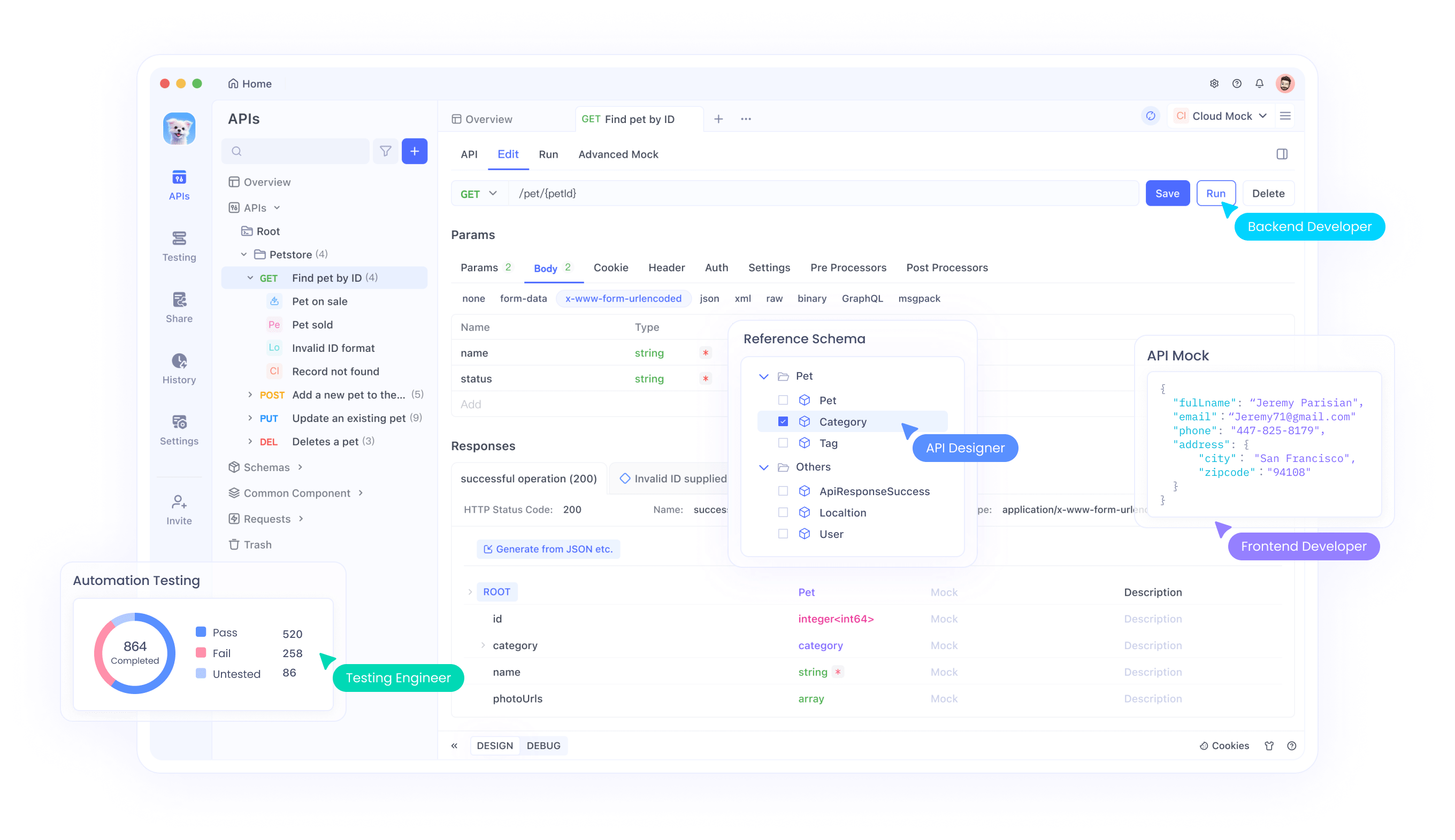

การรวมเข้ากับเวิร์กโฟลว์การพัฒนาโดยใช้ Apidog

การพัฒนา AI สมัยใหม่ต้องการเครื่องมือที่ซับซ้อนเพื่อจัดการการรวมโมเดล การทดสอบ และเวิร์กโฟลว์การปรับใช้ได้อย่างมีประสิทธิภาพในวิธีการเข้าถึงที่หลากหลายเหล่านี้ Apidog มีความสามารถในการจัดการ API ที่ครอบคลุมซึ่งช่วยปรับปรุงการรวม GLM-4.5 โดยไม่คำนึงถึงแนวทางการปรับใช้ที่เลือก

เมื่อนำโมเดล GLM-4.5 ไปใช้ในแพลตฟอร์มต่างๆ ไม่ว่าจะผ่าน OpenRouter, การเข้าถึง API โดยตรง, การปรับใช้ Hugging Face หรือการกำหนดค่าแบบโฮสต์เอง นักพัฒนาจะต้องตรวจสอบประสิทธิภาพในกรณีการใช้งานที่หลากหลาย ทดสอบการกำหนดค่าพารามิเตอร์ที่แตกต่างกัน และตรวจสอบให้แน่ใจว่าการจัดการข้อผิดพลาดเชื่อถือได้ กรอบการทดสอบ API ของ Apidog ช่วยให้สามารถประเมินการตอบสนองของโมเดล ลักษณะเวลาแฝง และรูปแบบการใช้ทรัพยากรได้อย่างเป็นระบบในวิธีการปรับใช้ทั้งหมดเหล่านี้

ความสามารถในการสร้างเอกสารของแพลตฟอร์มมีประโยชน์อย่างยิ่งเมื่อปรับใช้ GLM-4.5 ผ่านวิธีการเข้าถึงหลายวิธีพร้อมกัน นักพัฒนาสามารถสร้างเอกสาร API ที่ครอบคลุมโดยอัตโนมัติ ซึ่งรวมถึงตัวเลือกการกำหนดค่าโมเดล แผนผังอินพุต/เอาต์พุต และตัวอย่างการใช้งานเฉพาะสำหรับความสามารถในการให้เหตุผลแบบไฮบริดของ GLM-4.5 ใน OpenRouter, API โดยตรง และการปรับใช้แบบโฮสต์เอง

คุณสมบัติการทำงานร่วมกันภายใน Apidog ช่วยอำนวยความสะดวกในการแบ่งปันความรู้ระหว่างทีมพัฒนาที่ทำงานกับการนำ GLM-4.5 ไปใช้ สมาชิกในทีมสามารถแบ่งปันการกำหนดค่าการทดสอบ จัดทำเอกสารแนวทางปฏิบัติที่ดีที่สุด และทำงานร่วมกันในรูปแบบการรวมที่เพิ่มประสิทธิภาพของโมเดลให้สูงสุด

ความสามารถในการจัดการสภาพแวดล้อมช่วยให้มั่นใจถึงการปรับใช้ GLM-4.5 ที่สอดคล้องกันในสภาพแวดล้อมการพัฒนา การจัดเตรียม และการผลิต ไม่ว่าทีมจะใช้บริการที่มีการจัดการของ OpenRouter การรวม API โดยตรง หรือการนำไปใช้แบบโฮสต์เอง นักพัฒนาสามารถรักษากำหนดค่าแยกต่างหากสำหรับสภาพแวดล้อมที่แตกต่างกันในขณะที่มั่นใจถึงรูปแบบการปรับใช้ที่ทำซ้ำได้

กลยุทธ์การนำไปใช้และแนวปฏิบัติที่ดีที่สุด

การปรับใช้โมเดล GLM-4.5 ให้ประสบความสำเร็จต้องพิจารณาข้อกำหนดโครงสร้างพื้นฐาน เทคนิคการเพิ่มประสิทธิภาพ และรูปแบบการรวมที่เพิ่มประสิทธิภาพของโมเดลให้สูงสุดอย่างรอบคอบ องค์กรควรประเมินกรณีการใช้งานเฉพาะของตนเทียบกับความสามารถของโมเดลเพื่อกำหนดการกำหนดค่าการปรับใช้ที่เหมาะสมที่สุด

ข้อกำหนดด้านฮาร์ดแวร์แตกต่างกันอย่างมากระหว่าง GLM-4.5 และ GLM-4.5 Air ทำให้องค์กรสามารถเลือกรุ่นที่ตรงกับข้อจำกัดโครงสร้างพื้นฐานของตนได้ ทีมที่มีโครงสร้างพื้นฐาน GPU ที่แข็งแกร่งสามารถใช้โมเดล GLM-4.5 เต็มรูปแบบเพื่อความสามารถสูงสุด ในขณะที่สภาพแวดล้อมที่มีทรัพยากรจำกัดอาจพบว่า GLM-4.5 Air ให้ประสิทธิภาพที่เพียงพอด้วยต้นทุนโครงสร้างพื้นฐานที่ลดลง

การปรับแต่งโมเดลเป็นอีกหนึ่งข้อพิจารณาที่สำคัญสำหรับองค์กรที่มีข้อกำหนดเฉพาะ ใบอนุญาต MIT ช่วยให้สามารถปรับแต่งโมเดลได้อย่างครอบคลุม ทำให้ทีมสามารถปรับ GLM-4.5 สำหรับแอปพลิเคชันเฉพาะโดเมนได้ อย่างไรก็ตาม การปรับแต่งต้องมีการดูแลจัดการชุดข้อมูลอย่างรอบคอบและความเชี่ยวชาญในการฝึกอบรมเพื่อให้ได้ผลลัพธ์ที่ดีที่สุด

การกำหนดค่าโหมดไฮบริดต้องมีการปรับพารามิเตอร์อย่างรอบคอบเพื่อรักษาสมดุลระหว่างความเร็วในการตอบสนองกับคุณภาพการให้เหตุผล แอปพลิเคชันที่มีข้อกำหนดเวลาแฝงที่เข้มงวดอาจต้องการค่าเริ่มต้นโหมดไม่คิดที่เข้มงวดกว่า ในขณะที่แอปพลิเคชันที่ให้ความสำคัญกับคุณภาพการให้เหตุผลอาจได้รับประโยชน์จากเกณฑ์โหมดการคิดที่ต่ำกว่า

รูปแบบการรวม API ควรใช้ความสามารถในการเรียกใช้ฟังก์ชันดั้งเดิมของ GLM-4.5 เพื่อสร้างเวิร์กโฟลว์เอเจนต์ที่มีประสิทธิภาพ แทนที่จะนำเลเยอร์การจัดเรียงภายนอกไปใช้ นักพัฒนาสามารถพึ่งพาความสามารถในการใช้เครื่องมือในตัวของโมเดลเพื่อลดความซับซ้อนของระบบและปรับปรุงความน่าเชื่อถือ

ข้อควรพิจารณาด้านความปลอดภัยและการจัดการความเสี่ยง

การปรับใช้โมเดลโอเพนซอร์สเช่น GLM-4.5 นำมาซึ่งข้อควรพิจารณาด้านความปลอดภัยที่องค์กรต้องแก้ไขผ่านกลยุทธ์การจัดการความเสี่ยงที่ครอบคลุม การมีน้ำหนักโมเดลช่วยให้สามารถตรวจสอบความปลอดภัยได้อย่างละเอียด แต่ก็ต้องมีการจัดการอย่างระมัดระวังเพื่อป้องกันการเข้าถึงโดยไม่ได้รับอนุญาตหรือการใช้งานในทางที่ผิด

ความปลอดภัยในการอนุมานโมเดลจำเป็นต้องป้องกันอินพุตที่เป็นอันตรายที่อาจส่งผลกระทบต่อพฤติกรรมของโมเดล หรือดึงข้อมูลที่ละเอียดอ่อนจากข้อมูลการฝึกอบรม องค์กรควรนำการตรวจสอบอินพุต การกรองเอาต์พุต และระบบตรวจจับความผิดปกติไปใช้เพื่อระบุปฏิสัมพันธ์ที่อาจมีปัญหา

ความปลอดภัยของโครงสร้างพื้นฐานการปรับใช้มีความสำคัญอย่างยิ่งเมื่อโฮสต์โมเดล GLM-4.5 ในสภาพแวดล้อมการผลิต แนวทางปฏิบัติที่ดีที่สุดด้านความปลอดภัยมาตรฐาน รวมถึงการแยกเครือข่าย การควบคุมการเข้าถึง และการเข้ารหัส ใช้กับการปรับใช้โมเดล AI เช่นเดียวกับแอปพลิเคชันแบบดั้งเดิม

ข้อควรพิจารณาด้านความเป็นส่วนตัวของข้อมูลจำเป็นต้องให้ความสนใจอย่างรอบคอบต่อการไหลของข้อมูลระหว่างแอปพลิเคชันและโมเดล GLM-4.5 องค์กรต้องมั่นใจว่าอินพุตข้อมูลที่ละเอียดอ่อนได้รับการป้องกันที่เหมาะสม และเอาต์พุตของโมเดลไม่ได้เปิดเผยข้อมูลที่เป็นความลับโดยไม่ได้ตั้งใจ

ความปลอดภัยของห่วงโซ่อุปทานขยายไปถึงที่มาของโมเดลและการตรวจสอบความสมบูรณ์ องค์กรควรตรวจสอบผลรวมของโมเดล ตรวจสอบแหล่งที่มาของการดาวน์โหลด และใช้การควบคุมที่ทำให้มั่นใจว่าโมเดลที่ปรับใช้ตรงกับการกำหนดค่าที่ตั้งใจไว้

ลักษณะโอเพนซอร์สของ GLM-4.5 ช่วยให้สามารถตรวจสอบความปลอดภัยได้อย่างครอบคลุม ซึ่งให้ข้อได้เปรียบเหนือโมเดลที่เป็นกรรมสิทธิ์ซึ่งคุณสมบัติความปลอดภัยยังไม่ชัดเจน องค์กรสามารถวิเคราะห์สถาปัตยกรรมโมเดล ลักษณะข้อมูลการฝึกอบรม และช่องโหว่ที่อาจเกิดขึ้นผ่านการตรวจสอบโดยตรง แทนที่จะพึ่งพาการยืนยันความปลอดภัยของผู้ขาย

บทสรุป

GLM-4.5 และ GLM-4.5 Air แสดงถึงความก้าวหน้าครั้งสำคัญในความสามารถของ AI แบบโอเพนซอร์ส โดยให้ประสิทธิภาพที่แข่งขันได้ในขณะที่ยังคงรักษาการเข้าถึงและความยืดหยุ่นที่เป็นตัวกำหนดโครงการโอเพนซอร์สที่ประสบความสำเร็จ Z.ai ได้เปิดตัวโมเดลพื้นฐานรุ่นต่อไปคือ GLM-4.5 ซึ่งมีประสิทธิภาพ SOTA ในโมเดลโอเพนซอร์สผ่านนวัตกรรมสถาปัตยกรรมที่แก้ไขปัญหาความท้าทายในการปรับใช้ในโลกแห่งความเป็นจริง

สถาปัตยกรรมการให้เหตุผลแบบไฮบริดแสดงให้เห็นว่าการออกแบบที่รอบคอบสามารถขจัดข้อแลกเปลี่ยนแบบดั้งเดิมระหว่างความเร็วในการตอบสนองกับคุณภาพการให้เหตุผลได้อย่างไร นวัตกรรมนี้เป็นแม่แบบสำหรับการพัฒนาโมเดลในอนาคตที่ให้ความสำคัญกับประโยชน์ใช้สอยในทางปฏิบัติมากกว่าประสิทธิภาพการวัดผลบริสุทธิ์

ข้อได้เปรียบด้านประสิทธิภาพต้นทุนทำให้ GLM-4.5 เข้าถึงได้สำหรับองค์กรที่ก่อนหน้านี้พบว่าความสามารถ AI ขั้นสูงมีราคาแพงเกินไป การรวมกันของต้นทุนการอนุมานที่ลดลงและการอนุญาตให้ใช้สิทธิ์ที่อนุญาตสร้างโอกาสสำหรับการปรับใช้ AI ในอุตสาหกรรมและขนาดองค์กรที่หลากหลาย