มาทำความเข้าใจกัน: ผู้ช่วยเขียนโค้ด AI อย่าง GitHub Copilot นั้นยอดเยี่ยมมาก แต่ค่าสมัครสมาชิกอาจทำให้กระเป๋าเงินของคุณพร่องได้ พบกับ DeepSeek R1—โมเดลภาษาโอเพนซอร์สฟรีที่เทียบเท่า GPT-4 และ Claude 3 ในด้านการให้เหตุผลและงานเขียนโค้ด จับคู่กับ Cline ซึ่งเป็นปลั๊กอิน VS Code ที่เปลี่ยน AI นี้ให้เป็นตัวแทนการเขียนโค้ดเต็มรูปแบบ และคุณก็จะได้ชุดเครื่องมือที่ทรงพลังซึ่งเขียน แก้ไขข้อบกพร่อง และแม้แต่ ดำเนินการโค้ด โดยอัตโนมัติ—ทั้งหมดนี้โดยไม่ต้องเสียเงินสักบาท

ในคู่มือนี้ ฉันจะแนะนำคุณตลอดทุกสิ่งที่คุณจำเป็นต้องรู้ ตั้งแต่การติดตั้ง Cline ไปจนถึงการปรับแต่ง DeepSeek R1 สำหรับโปรเจกต์ของคุณ มาเริ่มกันเลย!

อะไรที่ทำให้ DeepSeek R1 พิเศษ?

1. ฟรี (ใช่ จริงๆ!)

ต่างจากโมเดลที่เป็นกรรมสิทธิ์ DeepSeek R1 เป็นโอเพนซอร์สเต็มรูปแบบและใช้งานเชิงพาณิชย์ได้ ไม่มีข้อจำกัดด้านโทเค็น ไม่มีค่าธรรมเนียมแอบแฝง—มีเพียงพลัง AI ที่แท้จริง

2. ประสิทธิภาพที่เทียบเท่ากับโมเดลแบบชำระเงิน

DeepSeek R1 เก่งในด้านการเขียนโค้ด คณิตศาสตร์ และการให้เหตุผลเชิงตรรกะ ตัวอย่างเช่น รุ่นพารามิเตอร์ 32B นั้นทำได้ดีกว่า o1-mini ของ OpenAI ในเกณฑ์มาตรฐานการสร้างโค้ด และโมเดล 70B นั้นเทียบเท่ากับ Claude 3.5 Sonnet ในงานที่ซับซ้อน

3. ตัวเลือกการปรับใช้ที่ยืดหยุ่น

เรียกใช้ในเครื่องเพื่อความเป็นส่วนตัวและความเร็ว หรือใช้ API ราคาไม่แพงของ DeepSeek (เริ่มต้นที่ $0.01 ต่อล้านโทเค็น) สำหรับการเข้าถึงบนคลาวด์

การตั้งค่า DeepSeek R1 ใน VS Code ด้วย Cline

ขั้นตอนที่ 1: ติดตั้งปลั๊กอิน Cline

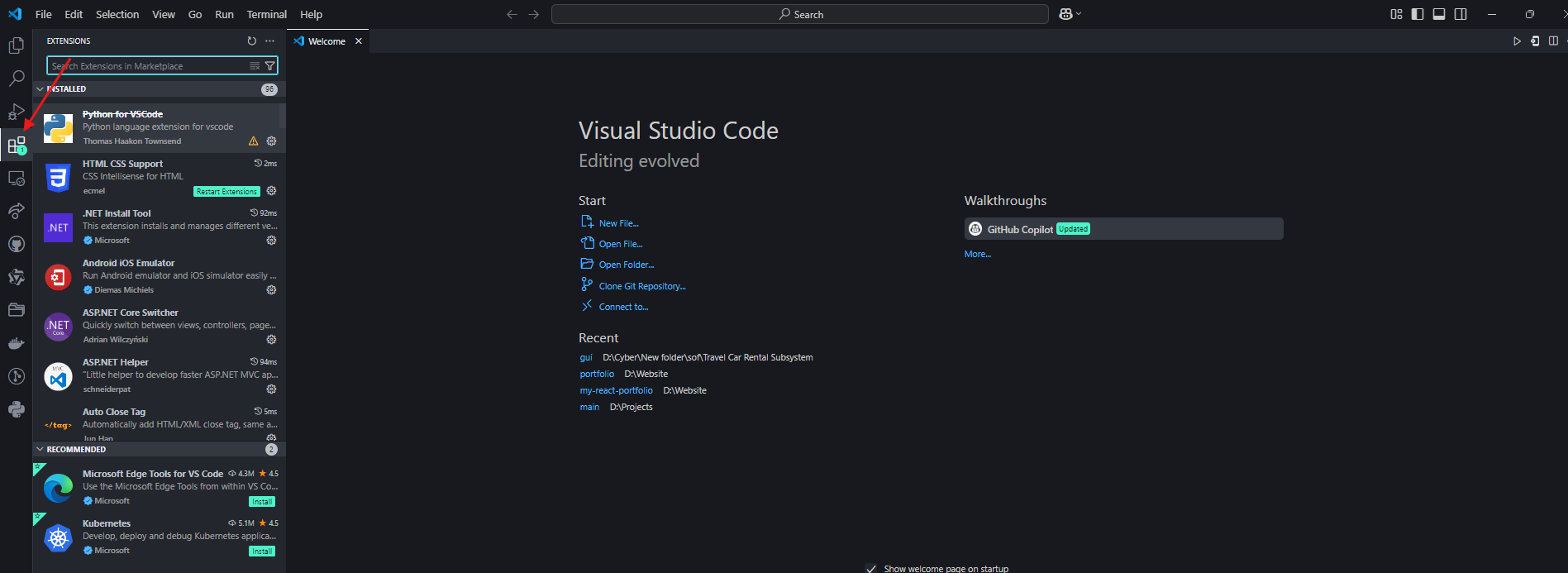

- เปิด VS Code แล้วไปที่แท็บ Extensions

2. ค้นหา “Cline” แล้วติดตั้ง

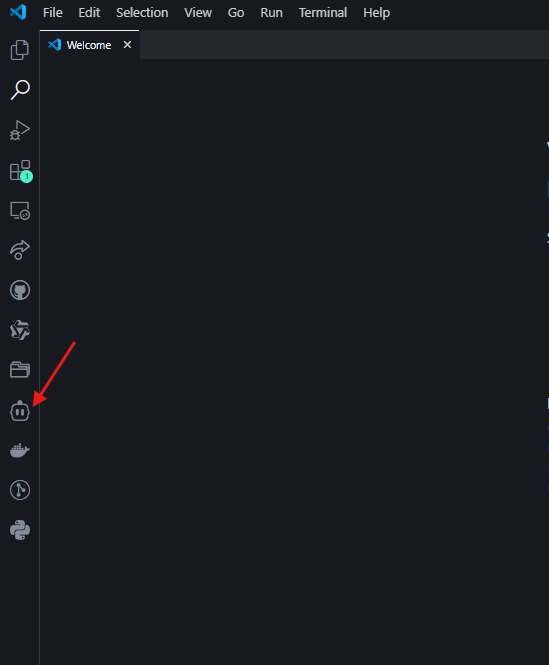

3. คลิกไอคอนหุ่นยนต์ในแถบด้านข้างซ้ายเพื่อเปิดใช้งาน Cline

ขั้นตอนที่ 2: เลือกเวิร์กโฟลว์ DeepSeek R1 ของคุณ

ตัวเลือก A: การตั้งค่าในเครื่อง (ฟรี เน้นความเป็นส่วนตัว)

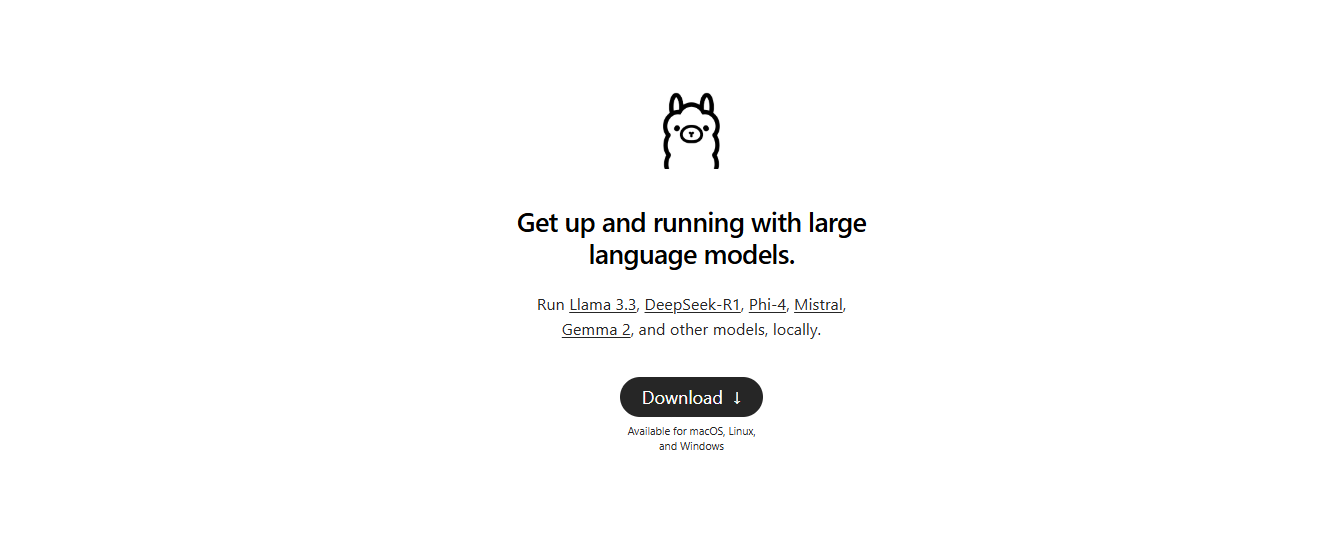

- ติดตั้ง Ollama: ดาวน์โหลดได้จาก ollama.com เพื่อจัดการโมเดล AI ในเครื่อง

2. ดึงโมเดล: ในเทอร์มินัลของคุณ ให้รัน:

ollama pull deepseek-r1:14b # สำหรับฮาร์ดแวร์ระดับกลาง (เช่น RTX 3060)

โมเดลขนาดเล็กกว่า เช่น 1.5b ทำงานได้สำหรับงานพื้นฐาน แต่แนะนำให้ใช้ 14B+ สำหรับการเขียนโค้ด

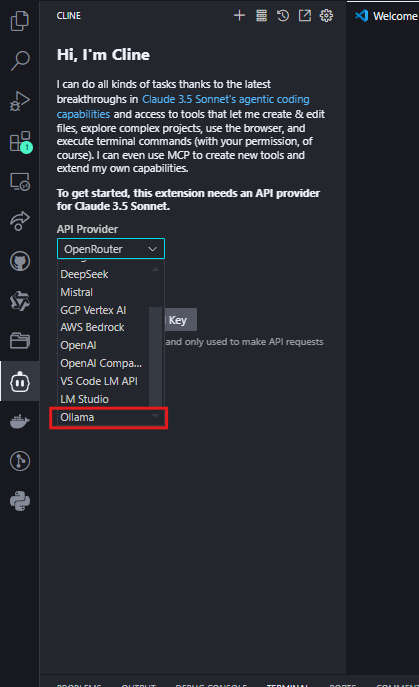

- กำหนดค่า Cline:

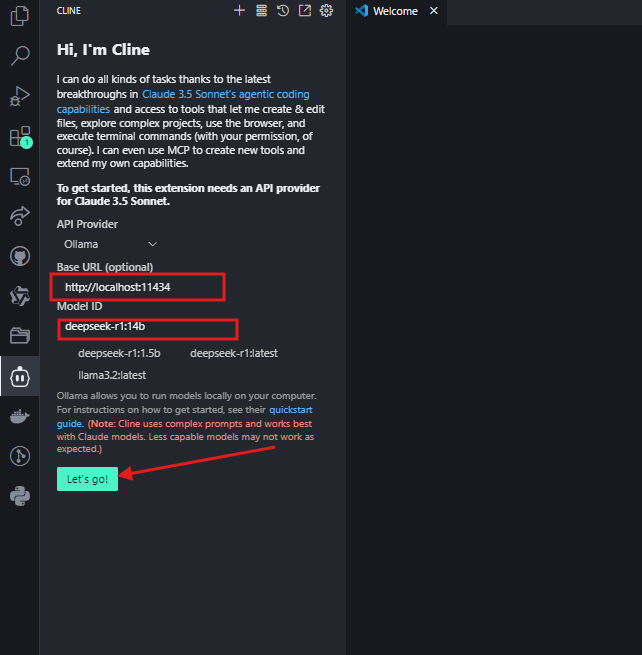

- ตั้งค่าผู้ให้บริการ API เป็น “Ollama”

- ป้อน

http://localhost:11434เป็น Base URL และเลือกโมเดลของคุณ (เช่นdeepseek-r1:14b)

คลิก "Lets go" แล้วคุณก็สามารถใช้งานได้

ตัวเลือก B: การผสานรวม OpenRouter (การสลับโมเดลที่ยืดหยุ่น)

สำหรับนักพัฒนาที่ต้องการเข้าถึงโมเดล AI หลายรายการ (รวมถึง DeepSeek R1) ผ่าน API key เดียว OpenRouter นำเสนอโซลูชันที่คล่องตัว ซึ่งเหมาะอย่างยิ่งหากคุณต้องการเปรียบเทียบเอาต์พุตกับโมเดลอย่าง GPT-4 หรือ Claude เป็นครั้งคราว แต่ต้องการ DeepSeek R1 เป็นค่าเริ่มต้นของคุณ

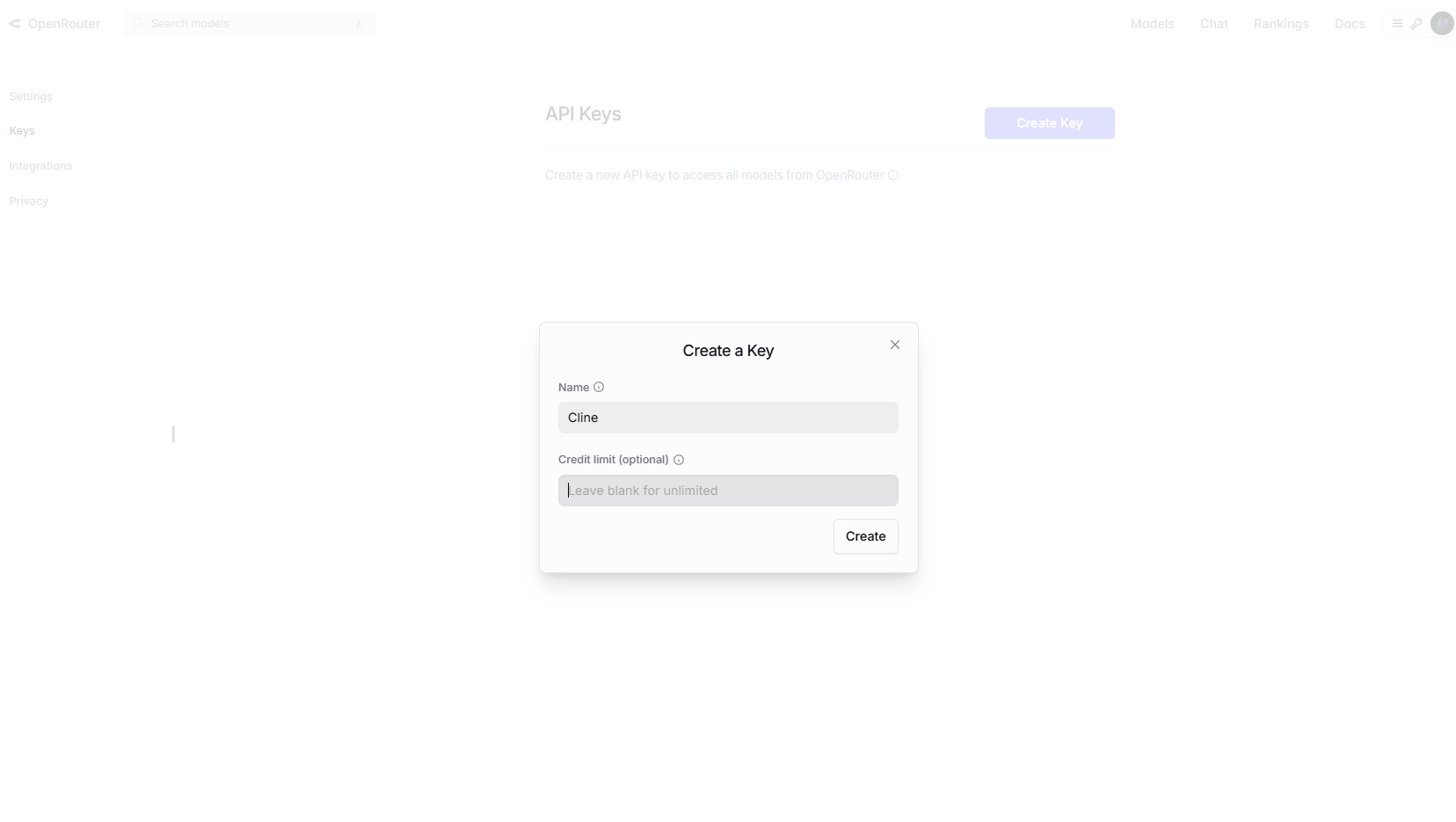

ขั้นตอนที่ 1: รับ OpenRouter API Key ของคุณ

- ไปที่ OpenRouter.ai แล้วลงทะเบียน

- ไปที่ API Keys แล้วสร้างคีย์ใหม่

ตัวเลือก: เปิดใช้งานขีดจำกัดการใช้จ่ายในการตั้งค่าบัญชีเพื่อควบคุมค่าใช้จ่าย

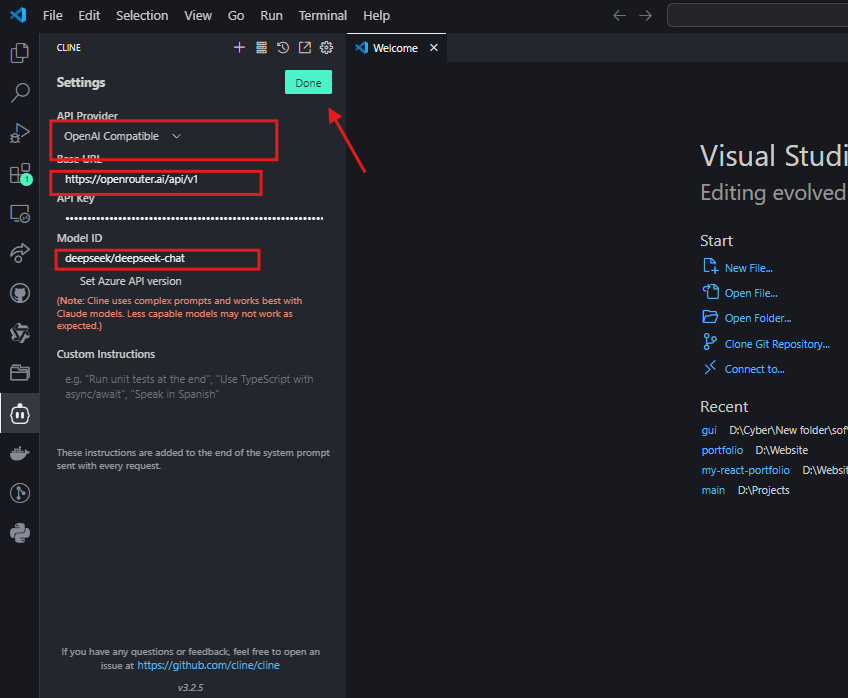

ขั้นตอนที่ 2: กำหนดค่า Cline สำหรับ OpenRouter

- ใน VS Code ให้เปิดการตั้งค่าของ Cline

- เลือก “OpenAI-Compatible” เป็นผู้ให้บริการ API

- ตั้งค่า Base URL เป็น

https://openrouter.ai/api/v1 - วาง OpenRouter API key ของคุณ

- ในช่อง Model ID ให้ป้อน

deepseek/deepseek-chat

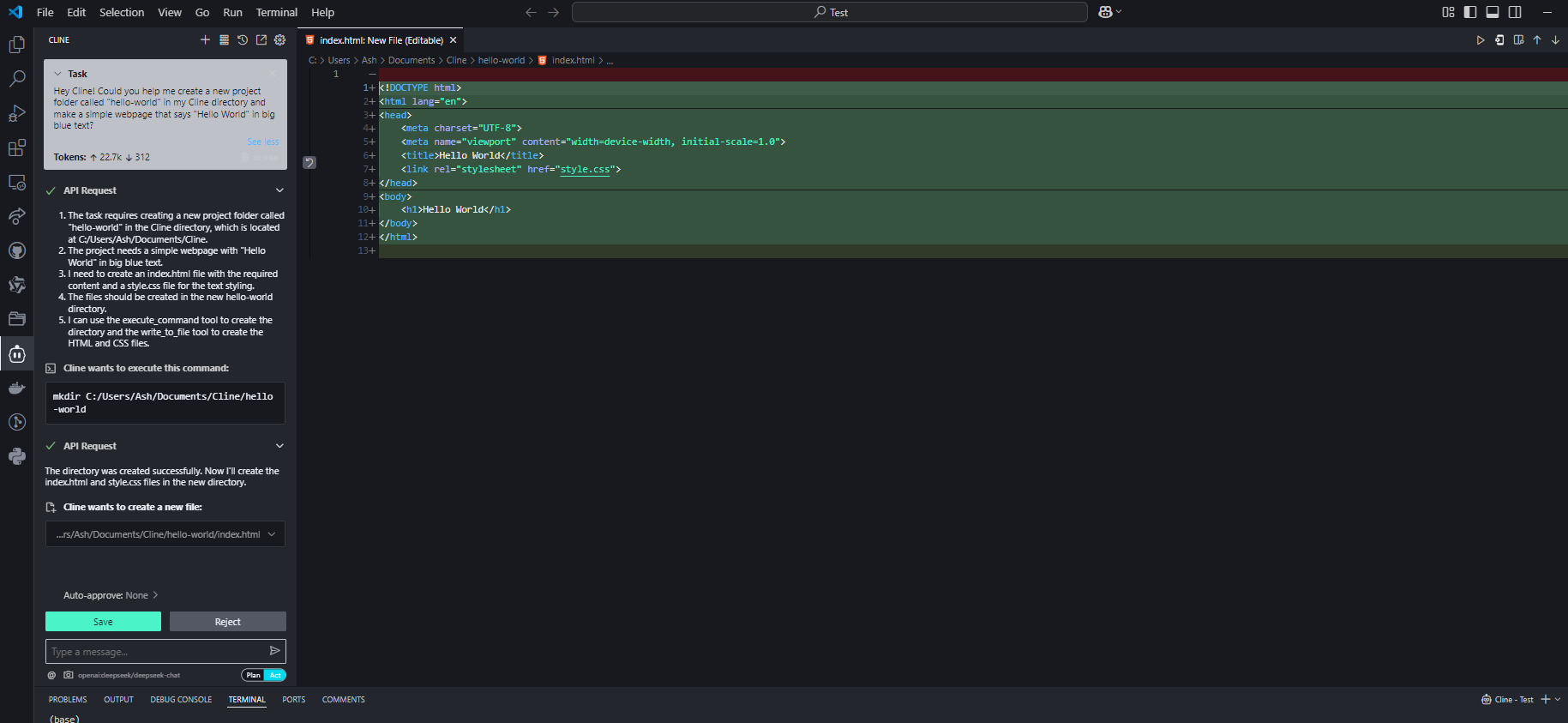

ขั้นตอนที่ 3: ทดสอบการผสานรวม

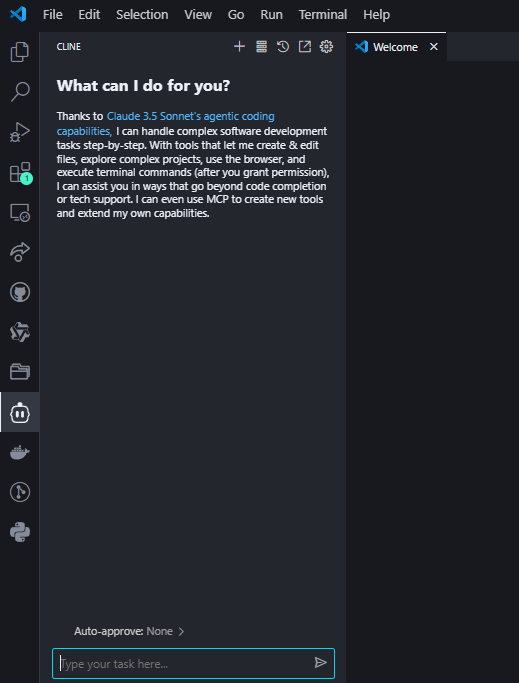

ถามคำถามเกี่ยวกับการเขียนโค้ดกับ Cline เพื่อยืนยันการตั้งค่า:

หากกำหนดค่าอย่างถูกต้อง DeepSeek R1 จะสร้างโค้ดพร้อมคำอธิบายในอินเทอร์เฟซของ Cline

ทำไมต้องเลือก OpenRouter?

- การเข้าถึงหลายโมเดล: สลับระหว่าง DeepSeek R1 และโมเดลอื่นๆ อีก 50+ รายการ (เช่น GPT-4, Claude) ได้อย่างง่ายดายโดยไม่ต้องกำหนดค่า API ใหม่

- ความโปร่งใสของต้นทุน: ติดตามการใช้โทเค็นในทุกโมเดลในแดชบอร์ดเดียว

- การสนับสนุนสำรอง: กำหนดเส้นทางคำขอไปยังโมเดลสำรองโดยอัตโนมัติหาก API ของ DeepSeek R1 มีภาระมากเกินไป

ข้อควรพิจารณาด้านต้นทุน

ในขณะที่ราคาของ OpenRouter สำหรับ DeepSeek R1 สอดคล้องกับต้นทุน API โดยตรง (~$0.01 ต่อล้านโทเค็นอินพุต) ให้ตรวจสอบ หน้าการกำหนดราคา ของพวกเขาเสมอเพื่อดูอัตราแบบเรียลไทม์ สำหรับผู้ใช้จำนวนมาก การเรียกเก็บเงินแบบรวมของ OpenRouter สามารถลดความซับซ้อนในการจัดการค่าใช้จ่ายได้

เคล็ดลับสำหรับมืออาชีพในการปรับปรุงประสิทธิภาพ

1. ขนาดโมเดลเทียบกับฮาร์ดแวร์

| Model | RAM ที่ต้องการ | GPU ที่แนะนำ |

|---|---|---|

| 1.5B | 4GB | Integrated |

| 7B | 8–10GB | NVIDIA GTX 1660 |

| 14B | 16GB+ | RTX 3060/3080 |

| 70B | 40GB+ | RTX 4090/A100 |

เคล็ดลับ: โมเดลที่ถูกควอนไทซ์ (เช่น Q4_K_M.gguf) ลดการใช้ VRAM ลง 30% โดยไม่สูญเสียคุณภาพมากนัก

2. การออกแบบพร้อมท์

- สำหรับโค้ด: รวมคำแนะนำที่ชัดเจน เช่น “ใช้ Python 3.11 และคำแนะนำประเภท”

- สำหรับการแก้ไขข้อบกพร่อง: วางบันทึกข้อผิดพลาดและถามว่า “อธิบายข้อผิดพลาดนี้และแก้ไข”

การแก้ไขปัญหาทั่วไป

1. การตอบสนองที่ช้า

- แก้ไข: เปลี่ยนไปใช้โมเดลที่เล็กลง หรือเปิดใช้งานการเร่งความเร็ว GPU ใน Ollama ด้วย

OLLAMA_GPU_LAYERS=12

2. ภาพหลอนหรือคำตอบที่ออกนอกประเด็น

- แก้ไข: ใช้พร้อมท์ที่เข้มงวดกว่า (เช่น “ตอบโดยใช้บริบทที่ให้ไว้เท่านั้น”) หรืออัปเกรดเป็นโมเดลที่ใหญ่กว่า เช่น 32B

3. Cline เพิกเฉยต่อบริบทไฟล์

- แก้ไข: ระบุเส้นทางไฟล์แบบเต็มเสมอ (เช่น

/src/components/Login.jsx) แทนการอ้างอิงที่ไม่ชัดเจน

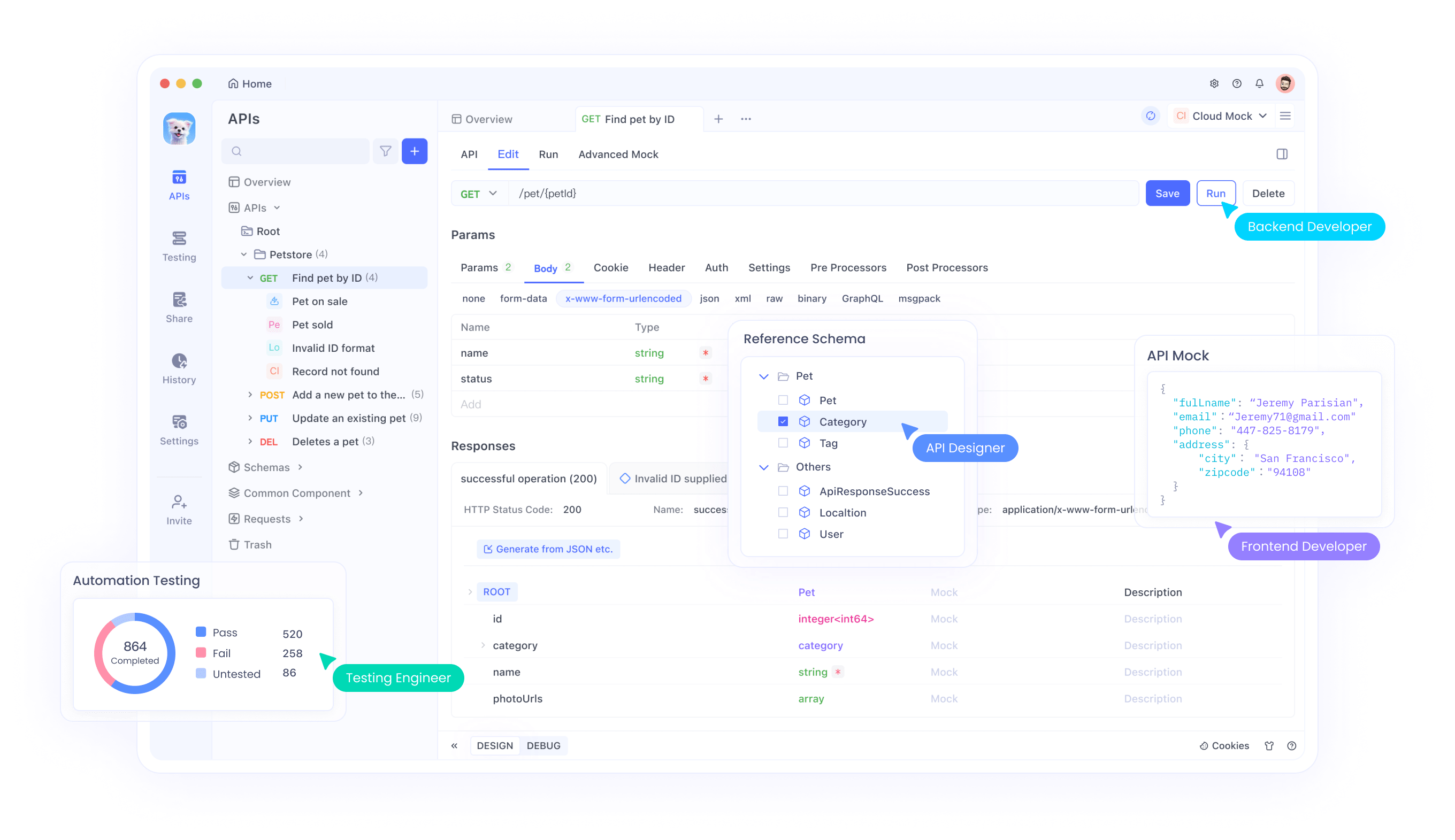

กรณีการใช้งานขั้นสูงด้วยการผสานรวม Apidog

เมื่อการตั้งค่า DeepSeek R1 + Cline ของคุณทำงานอยู่ ให้ใช้ Apidog เพื่อ:

- ทดสอบ API Endpoint: ตรวจสอบความถูกต้องของการตอบสนองของ DeepSeek โดยทางโปรแกรม

- ทำงานอัตโนมัติ: เชื่อมโยงการสร้างโค้ดของ Cline กับการเรียก API (เช่น ปรับใช้สคริปต์ที่สร้างขึ้นกับ AWS)

- ตรวจสอบประสิทธิภาพ: ติดตามเวลาแฝงและความแม่นยำเมื่อเวลาผ่านไป

สรุป: ทำไมชุดค่าผสมนี้จึงชนะ

DeepSeek R1 และ Cline ไม่ได้เป็นเพียงเครื่องมือเท่านั้น แต่เป็นรูปแบบการเปลี่ยนแปลง คุณจะได้รับความฉลาดระดับ GPT-4 โดยไม่มีค่าใช้จ่าย ควบคุมความเป็นส่วนตัวได้อย่างเต็มที่ และเวิร์กโฟลว์ที่ให้ความรู้สึกเหมือนการจับคู่กับนักพัฒนาอาวุโส

พร้อมที่จะเพิ่มพลังให้กับการเขียนโค้ดของคุณแล้วหรือยัง?

- ติดตั้ง Cline และ Ollama

- เลือกโมเดล DeepSeek R1 ของคุณ

- สร้างสิ่งมหัศจรรย์—แล้วแจ้งให้ฉันทราบว่ามันเป็นอย่างไรบ้าง!

อย่าลืม ดาวน์โหลด Apidog เพื่อปรับปรุงการทดสอบ API และระบบอัตโนมัติให้คล่องตัว มันเป็นเพื่อนคู่คิดที่สมบูรณ์แบบสำหรับการเดินทางเขียนโค้ดที่ขับเคลื่อนด้วย AI ของคุณ!