Desenvolvedores buscam constantemente ferramentas avançadas que otimizem as tarefas de codificação, e a OpenAI entrega com o GPT-5-Codex-Mini. Este modelo representa uma evolução compacta da série GPT-5-Codex, oferecendo desempenho com custo-benefício para fluxos de trabalho de codificação agentic. Engenheiros o integram para lidar com tarefas como geração de código, depuração e gerenciamento de repositórios sem sacrificar capacidades essenciais. No entanto, acessar sua API requer etapas específicas, que este guia detalha.

A transição de assistentes de codificação tradicionais para os impulsionados por IA marca uma mudança significativa, mas pequenos ajustes na configuração produzem melhorias substanciais na produtividade. Portanto, compreender a base do modelo é crucial.

Compreendendo o GPT-5-Codex-Mini: Capacidades e Arquitetura

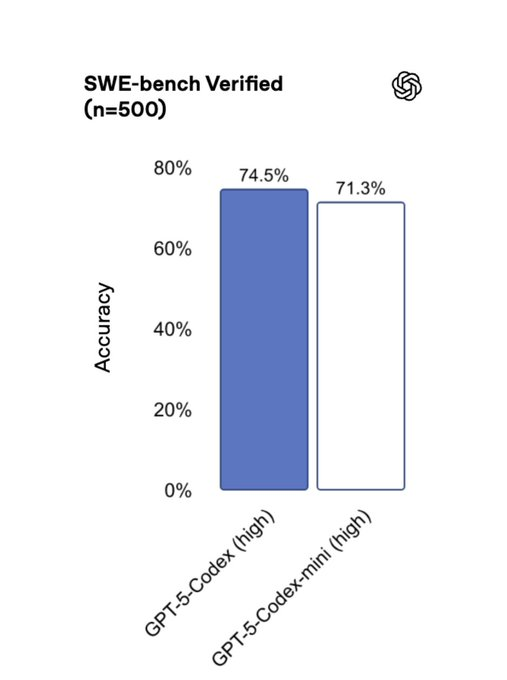

Os engenheiros da OpenAI projetaram o GPT-5-Codex-Mini como uma variante mais leve do GPT-5-Codex, priorizando a eficiência para cenários de codificação bem definidos. O modelo se destaca na geração de código front-end, depuração de grandes repositórios e na realização de refatorações em linguagens como Python, JavaScript e Go. Ao contrário de sua contraparte maior, o GPT-5-Codex-Mini consome menos recursos, permitindo aproximadamente quatro vezes mais uso por alocação de crédito.

Tecnicamente, a arquitetura se baseia em redes neurais baseadas em transformadores, otimizadas para eficiência de tokens. Ele processa entradas com tempo de raciocínio dinâmico – rápido para consultas simples, mas estendido para tarefas complexas envolvendo múltiplas iterações. Por exemplo, ao refatorar uma base de código de 3.000 linhas, o modelo itera por implementações, executa testes e valida dependências autonomamente.

O GPT-5-Codex-Mini se integra perfeitamente com ferramentas como o Codex CLI e extensões de IDE. Desenvolvedores o ativam no VS Code ou Cursor para pré-visualizar mudanças localmente, aproveitando trechos de código selecionados para sugestões sensíveis ao contexto. Essa abordagem reduz o comprimento dos prompts e acelera os tempos de resposta, permitindo que as equipes mantenham a continuidade do fluxo de trabalho.

No entanto, os usuários devem notar a ligeira troca de capacidade: embora ele lide com a maioria das tarefas agentic de forma eficaz, integrações complexas multilíngues podem exigir a mudança para o GPT-5-Codex completo. Consequentemente, avaliar as necessidades do seu projeto com antecedência garante a seleção ideal do modelo.

Pré-requisitos para Acessar a API do GPT-5-Codex-Mini

Acessar a API do GPT-5-Codex-Mini exige preparação cuidadosa. Primeiro, os desenvolvedores verificam o status de sua conta OpenAI. A OpenAI estrutura o acesso através de níveis de uso, variando de 1 a 5, com modelos como o GPT-5-Codex-Mini disponíveis em todos os níveis, mas sujeitos à verificação da organização para recursos avançados.

Você começa criando uma conta OpenAI, caso não tenha uma. Navegue até a plataforma OpenAI e inscreva-se usando um e-mail válido. Em seguida, complete o processo de verificação da organização, que envolve o envio de detalhes comerciais ou comprovante de identidade. Esta etapa desbloqueia o acesso a modelos verificados, incluindo capacidades de streaming na API de Respostas.

Além disso, obtenha uma chave de API no painel. Faça login, acesse a seção de chaves de API e gere uma nova chave. Armazene-a com segurança, pois ela autentica todas as requisições. Sem esta chave, os endpoints permanecem inacessíveis.

Além disso, certifique-se de que seu ambiente de desenvolvimento suporte as bibliotecas necessárias. Instale o SDK Python da OpenAI via pip: pip install openai. Este pacote facilita as chamadas de API, lidando com a autenticação e a formatação de payload automaticamente.

Transitando para os requisitos de hardware, uma conexão de internet estável e recursos computacionais suficientes provam ser essenciais, especialmente para processamento em lote. Embora o GPT-5-Codex-Mini otimize para eficiência, o uso de alto volume se beneficia de configurações baseadas em nuvem.

Inscrição nos Planos da OpenAI e Habilitação do Acesso à API

A OpenAI oferece planos em camadas que influenciam a disponibilidade do GPT-5-Codex-Mini. Assinantes do ChatGPT Plus obtêm acesso básico, adequado para sessões de codificação ocasionais. No entanto, para uso extensivo, faça upgrade para os planos Pro, Business ou Enterprise. Estes fornecem limites de taxa mais altos — recentemente aumentados em 50% — e processamento prioritário.

Para habilitar o acesso à API, vincule sua conta ChatGPT à plataforma de desenvolvedor. Faça login com suas credenciais, e o sistema sincronizará automaticamente os direitos de acesso. Para usuários apenas de API, compre créditos diretamente se exceder os limites incluídos.

Além disso, monitore os anúncios de programas beta. Como o suporte à API para o GPT-5-Codex-Mini foi lançado recentemente, entre nas listas de espera através dos fóruns da comunidade OpenAI. Participe das prévias para desenvolvedores para obter acesso antecipado, fornecendo feedback que molda futuras iterações.

Uma vez ativado, teste a conectividade. Envie uma requisição simples para o endpoint /models para listar os modelos disponíveis, confirmando que o GPT-5-Codex-Mini aparece. Esta etapa de verificação previne problemas de integração posteriores.

Consequentemente, alinhar seu plano com a escala do projeto maximiza o valor, pois os níveis superiores oferecem créditos expandidos e latência reduzida.

Gerando e Gerenciando Sua Chave de API da OpenAI

A segurança é a pedra angular das interações de API, então gere sua chave com responsabilidade. No painel da OpenAI, selecione "API keys" e clique em "Create new secret key". Nomeie-a de forma descritiva, como "GPT-5-Codex-Mini-Project", para fácil gerenciamento.

Armazene a chave em variáveis de ambiente em vez de codificá-la diretamente. Em Python, use os.environ['OPENAI_API_KEY'] para carregá-la dinamicamente. Esta prática mitiga os riscos de exposição.

Além disso, rotacione as chaves periodicamente. A OpenAI permite revogar chaves antigas sem interromper sessões ativas, garantindo a conformidade com os protocolos de segurança.

Adicionalmente, implemente limitação de taxa em sua aplicação. Monitore o uso através do painel para evitar exceder os níveis, o que poderia acionar restrições temporárias.

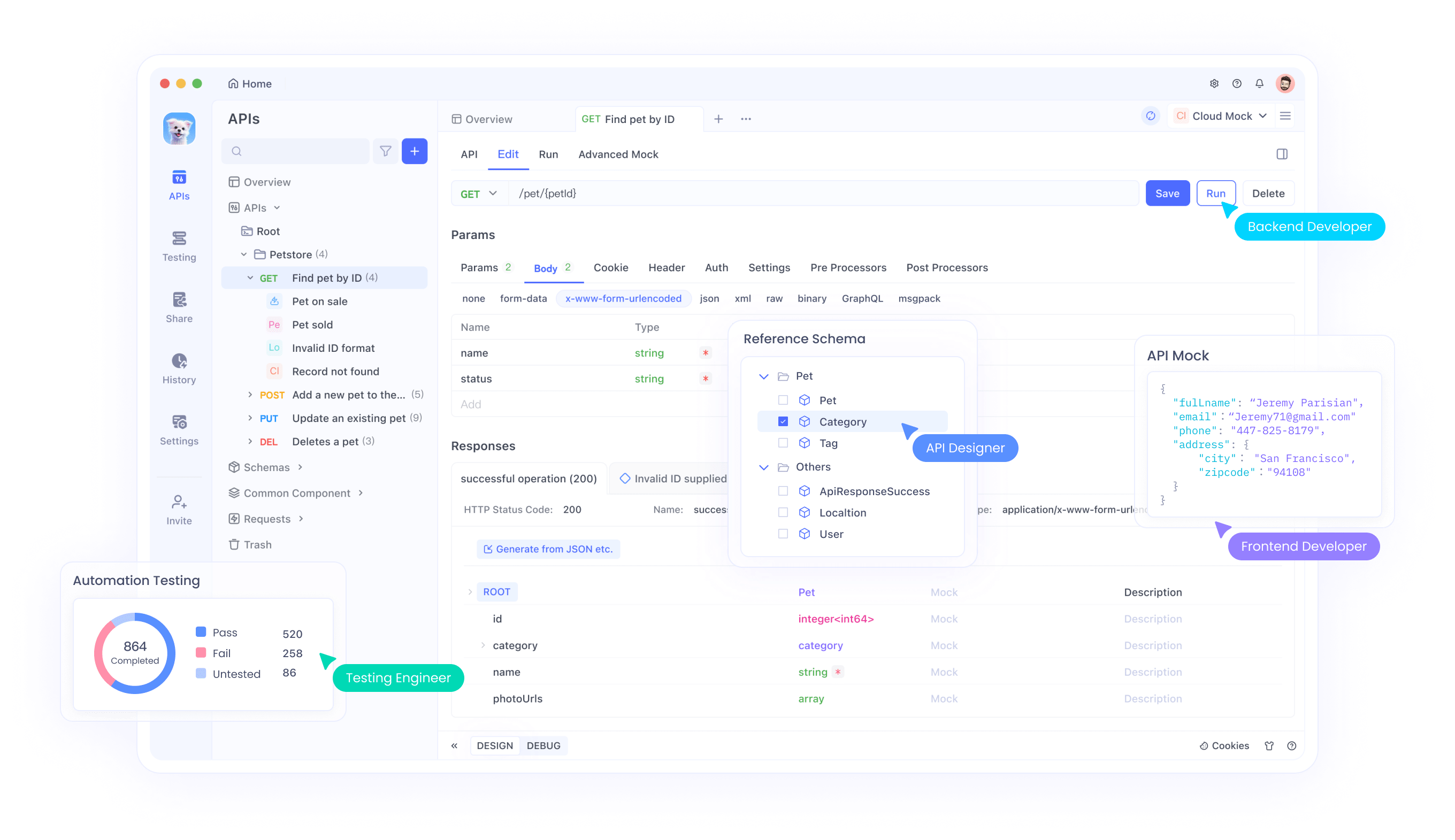

Transitando para as ferramentas, o Apidog simplifica o gerenciamento de chaves. Seu cofre seguro armazena credenciais, automatizando a autenticação em ambientes de teste. Assim, os desenvolvedores se concentram na codificação em vez de tarefas administrativas.

Integrando o GPT-5-Codex-Mini ao Seu Fluxo de Trabalho de Desenvolvimento

A integração começa com a seleção do endpoint apropriado. Use a API de Conclusões de Chat para consultas gerais ou a API de Respostas para tarefas agentic. Especifique "gpt-5-codex-mini" como o parâmetro do modelo no corpo da sua requisição.

Por exemplo, crie um script Python para gerar código:

import openai

openai.api_key = os.getenv('OPENAI_API_KEY')

response = openai.ChatCompletion.create(

model="gpt-5-codex-mini",

messages=[

{"role": "system", "content": "You are a helpful coding assistant."},

{"role": "user", "content": "Write a Python function to sort a list using quicksort."}

]

)

print(response.choices[0].message['content'])

Esta chamada retorna código otimizado, aproveitando a eficiência do modelo.

Além disso, incorpore contexto de arquivos. Anexe trechos de código ou diagramas aos prompts, aumentando a precisão para cenários de depuração.

No entanto, otimize os prompts para brevidade. O GPT-5-Codex-Mini tem o melhor desempenho com instruções concisas, reduzindo o consumo de tokens.

Adicionalmente, lide com respostas assincronamente para aplicações em tempo real. Use o modo de streaming para receber saídas parciais, melhorando a experiência do usuário em integrações de IDE.

Consequentemente, testes iterativos refinam a integração, revelando nuances de desempenho específicas para o seu caso de uso.

Usando o Apidog para Testar e Otimizar Chamadas da API GPT-5-Codex-Mini

O Apidog surge como um poderoso aliado para testes de API. Baixe-o gratuitamente e importe as especificações da API da OpenAI. Crie coleções para os endpoints do GPT-5-Codex-Mini, definindo requisições com variáveis para parâmetros dinâmicos.

Engenheiros simulam cenários enviando requisições simuladas. Por exemplo, teste limites de taxa agrupando chamadas, analisando tempos de resposta e taxas de erro.

Além disso, os recursos de colaboração do Apidog permitem que as equipes compartilhem conjuntos de testes, garantindo uma integração consistente em todos os projetos.

Transitando para a otimização, use suas análises para identificar gargalos. Monitore o uso de tokens e ajuste os prompts de acordo, estendendo a vida útil de seus créditos.

Além disso, integre o Apidog com pipelines de CI/CD. Automatize testes para mudanças na API, detectando descontinuações precocemente.

Assim, o Apidog transforma o acesso bruto à API em um fluxo de trabalho simplificado, ampliando os benefícios do GPT-5-Codex-Mini.

Melhores Práticas para Engenharia de Prompt com GPT-5-Codex-Mini

Prompts eficazes geram saídas superiores. Estruture-os com papéis claros: sistema para diretrizes, usuário para tarefas. Inclua exemplos para guiar o estilo, como "Siga os padrões PEP 8".

Além disso, divida tarefas complexas em etapas. Instrua o modelo a raciocinar sequencialmente, melhorando a precisão para refatorações.

No entanto, evite sobrecarregar os prompts. O GPT-5-Codex-Mini prospera com entradas focadas, então segmente grandes requisições.

Adicionalmente, aproveite a integração de ferramentas. Habilite a pesquisa na web ou a execução de código em prompts para respostas dinâmicas.

Consequentemente, a experimentação regular refina as técnicas, adaptando-se aos pontos fortes do modelo.

Lidando com Limites de Taxa e Escalando o Uso

A OpenAI impõe limites de taxa para garantir acesso justo. Usuários Plus desfrutam de cotas básicas, enquanto os níveis Pro oferecem filas de prioridade.

Monitore o uso via cabeçalhos da API, que informam as requisições restantes. Implemente o recuo exponencial para novas tentativas, prevenindo riscos de banimento.

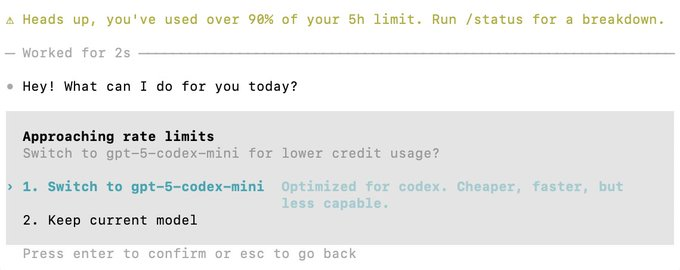

Além disso, mude para o GPT-5-Codex-Mini ao se aproximar dos limites, pois ele estende as sessões sem interrupções.

Transitando para a escalabilidade, distribua as chamadas entre múltiplas chaves para aplicativos de alto volume. Planos Enterprise suportam isso nativamente.

Assim, o gerenciamento proativo sustenta o desempenho, apoiando o crescimento.

Conclusão: Maximizando o Valor do GPT-5-Codex-Mini

Acessar e integrar o GPT-5-Codex-Mini transforma os fluxos de trabalho de codificação. Siga estas etapas para aproveitar seu poder de forma eficiente.

Lembre-se, ferramentas como o Apidog aprimoram a experiência — baixe-o gratuitamente hoje.

Em última análise, a aplicação consistente gera ganhos profundos de produtividade.