Desenvolvedores confiam cada vez mais em modelos avançados de IA para aprimorar a eficiência da codificação, automatizar fluxos de trabalho complexos e construir aplicações inteligentes. O Claude Opus 4.5 da Anthropic surge como uma solução líder nesse espaço, oferecendo desempenho superior em engenharia de software, tarefas agenticas e raciocínio multi-passo. Este modelo estabelece novos padrões de referência em codificação e uso de computador no mundo real, tornando-o essencial para equipes técnicas que lidam com projetos em nível de produção.

Este guia equipa você com o conhecimento técnico para aproveitar o Claude Opus 4.5 de forma eficaz. Abordamos a configuração, a mecânica central da API, configurações avançadas e estratégias de otimização. Ao seguir estas etapas, você posiciona suas aplicações para alavancar a janela de contexto de 200 mil tokens do modelo, uso aprimorado de ferramentas e gerenciamento eficiente de tokens. Consequentemente, você alcança ciclos de desenvolvimento mais rápidos e recursos impulsionados por IA mais confiáveis.

O que é o Claude Opus 4.5?

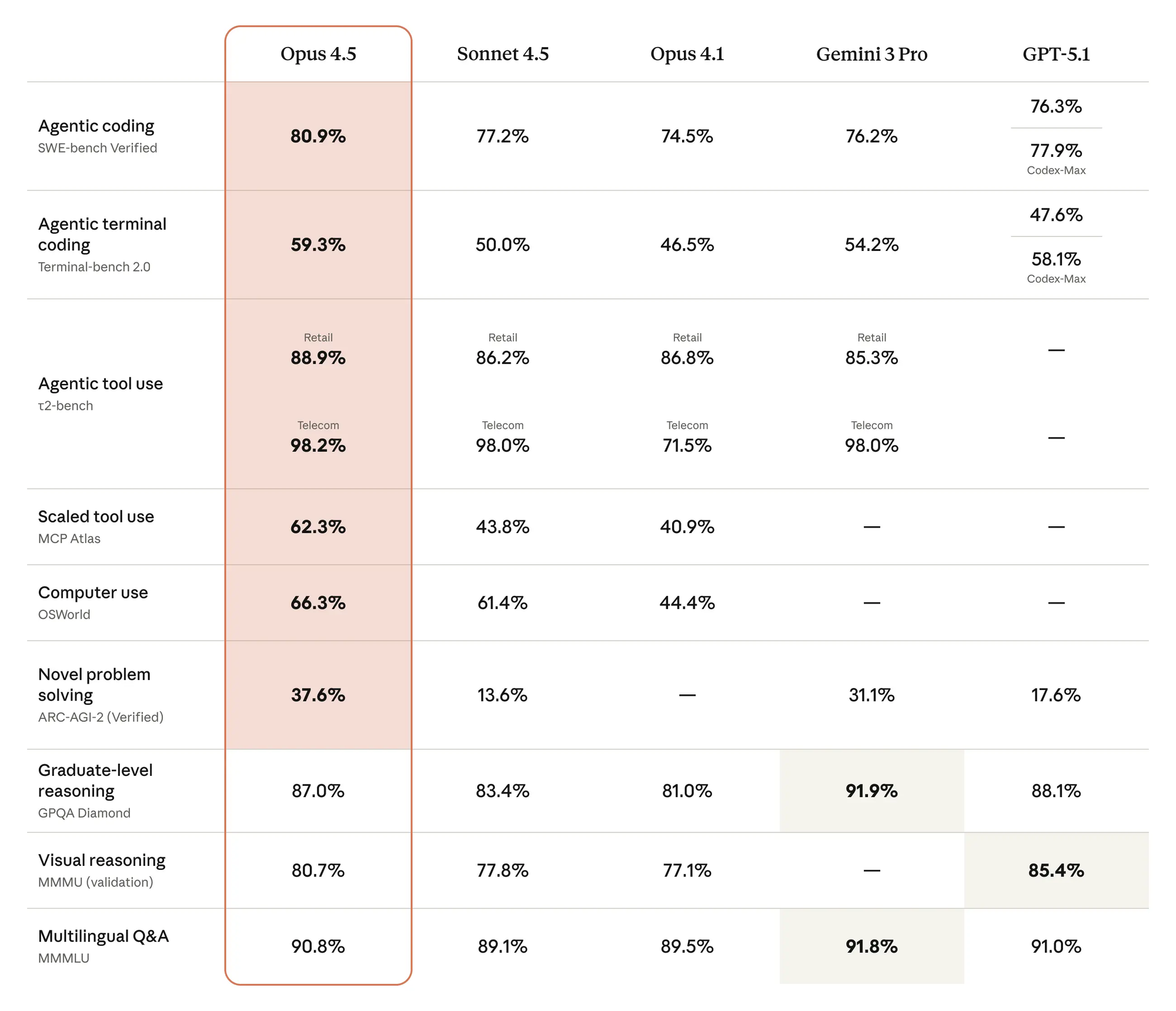

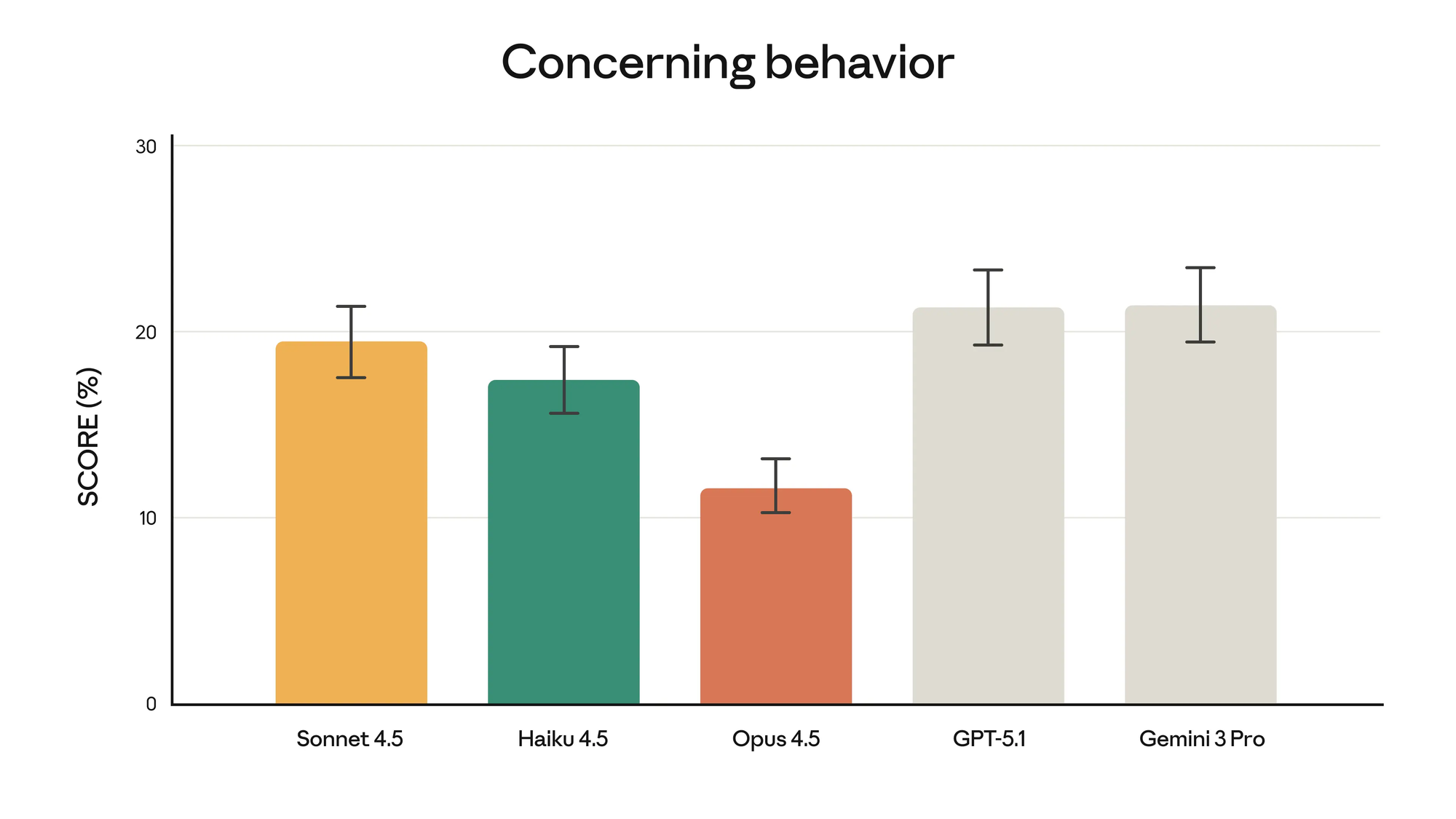

Os engenheiros da Anthropic projetaram o Claude Opus 4.5 como seu modelo principal, priorizando profundidade no raciocínio, precisão na codificação e autonomia agentica. Esta iteração baseia-se em versões anteriores, incorporando avanços no processamento de visão, precisão matemática e resolução de ambiguidades. Por exemplo, o modelo se destaca no tratamento de compensações em cenários complexos, como modificar itinerários de voo em simulações empresariais ou depurar grandes bases de código sem orientação explícita.

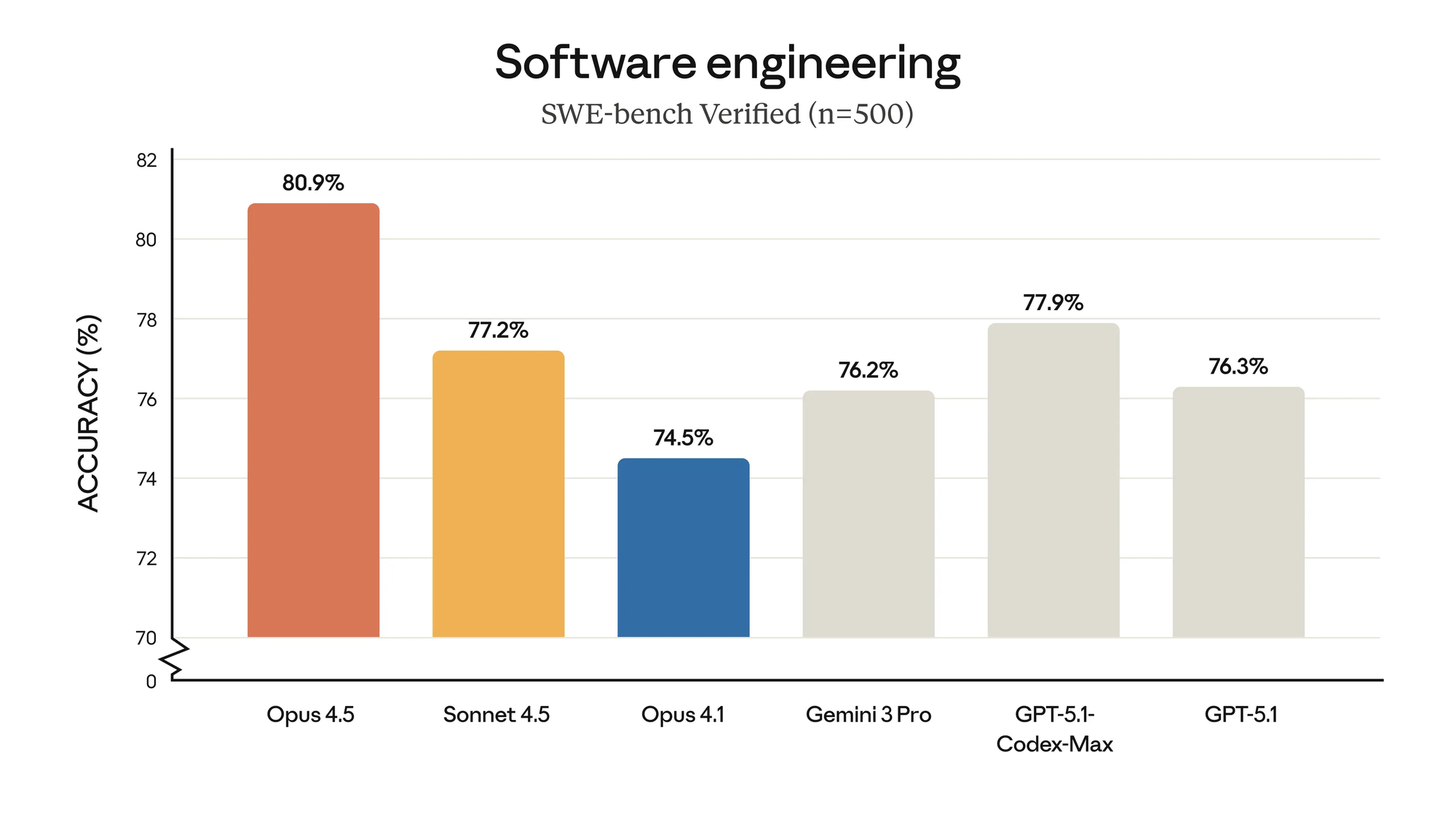

As principais capacidades incluem resultados de ponta no SWE-bench Verified, onde supera os antecessores em até 4,3 pontos percentuais, utilizando 48% menos tokens de saída com esforço máximo.

Os desenvolvedores acessam esses pontos fortes através da API Claude, que suporta uma janela de contexto de 200 mil tokens — ideal para análise de formato longo ou revisões de código de múltiplos arquivos. Além disso, o modelo se integra perfeitamente com plataformas em nuvem como Amazon Bedrock, Google Vertex AI e Microsoft Foundry, permitindo implantações escaláveis.

O preço reflete seu posicionamento premium: US$ 5 por milhão de tokens de entrada e US$ 25 por milhão de tokens de saída, com economia via cache de prompts (até 90%) e processamento em lote (50%). No entanto, esses custos ressaltam a necessidade de padrões de uso precisos, os quais abordaremos posteriormente. Em essência, o Claude Opus 4.5 capacita os desenvolvedores a construir agentes que gerenciam projetos de ponta a ponta, desde o planejamento inicial até a execução, com supervisão humana mínima.

Configurando seu Ambiente de Desenvolvimento

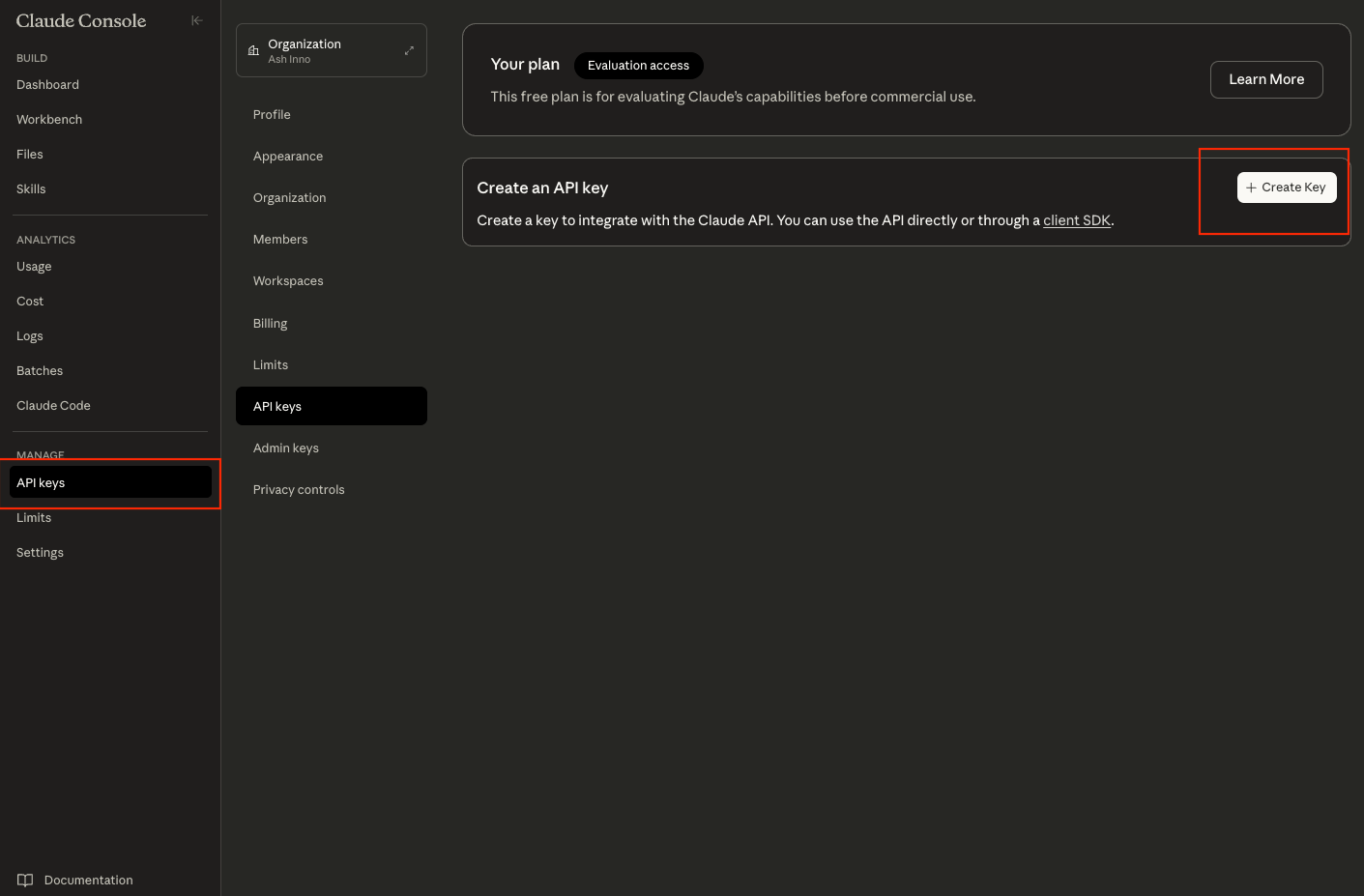

Você começa preparando um ambiente robusto para interagir com a API Claude. Primeiro, obtenha uma chave de API no Anthropic Console em console.anthropic.com. Cadastre-se ou faça login, navegue até a seção "API Keys" e gere uma nova chave. Armazene-a com segurança — use variáveis de ambiente como export ANTHROPIC_API_KEY='your-key-here' em seu terminal ou arquivos .env na raiz do seu projeto.

Em seguida, instale o SDK oficial da Anthropic, que abstrai as complexidades HTTP e gerencia as retentativas. Para Python, execute pip install anthropic. Esta biblioteca suporta chamadas síncronas e assíncronas, essenciais para aplicações de alto desempenho. Da mesma forma, desenvolvedores Node.js executam npm install @anthropic-ai/sdk. Verifique a instalação importando o módulo: em Python, import anthropic; client = anthropic.Anthropic(api_key=os.getenv('ANTHROPIC_API_KEY')).

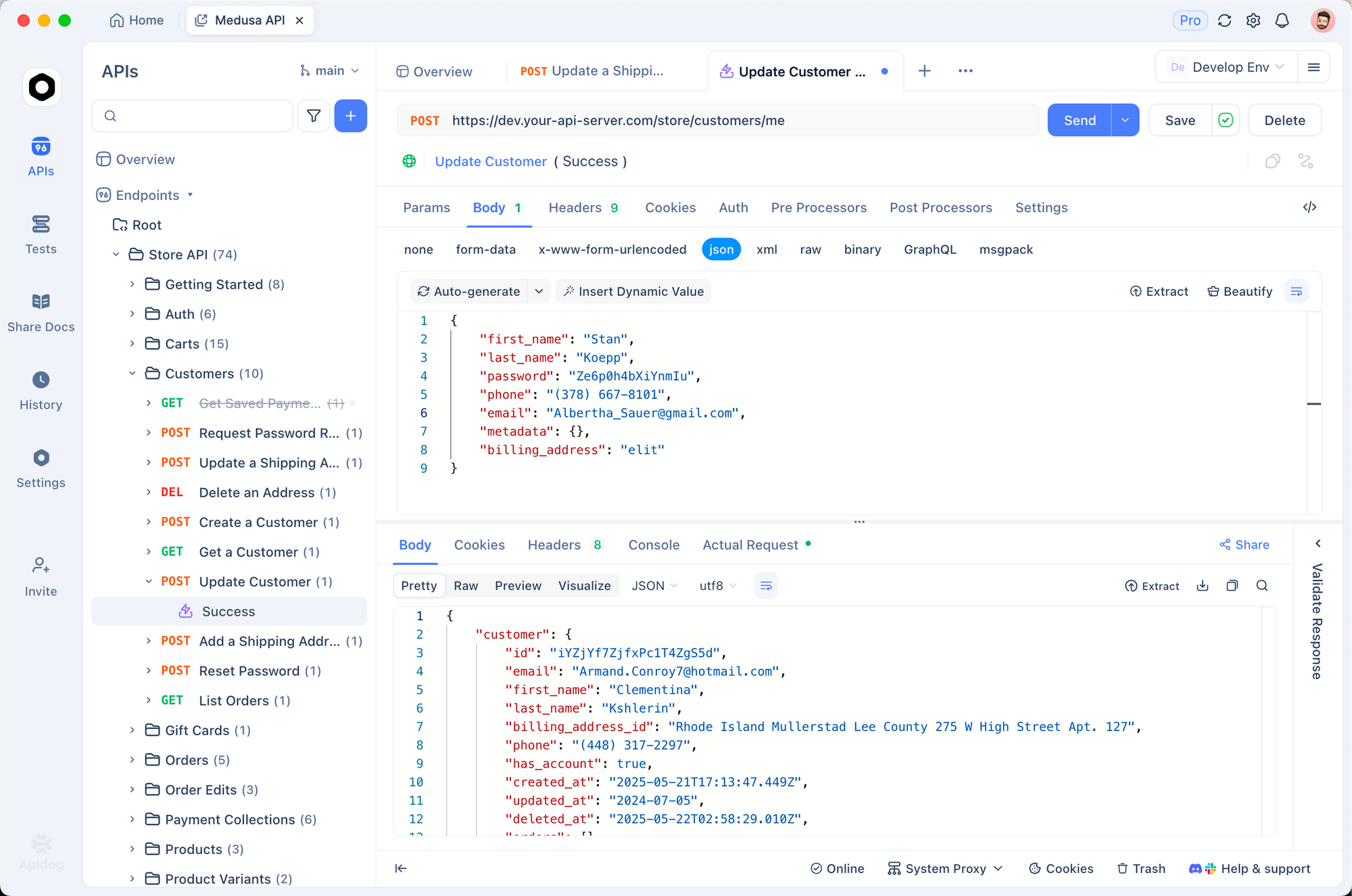

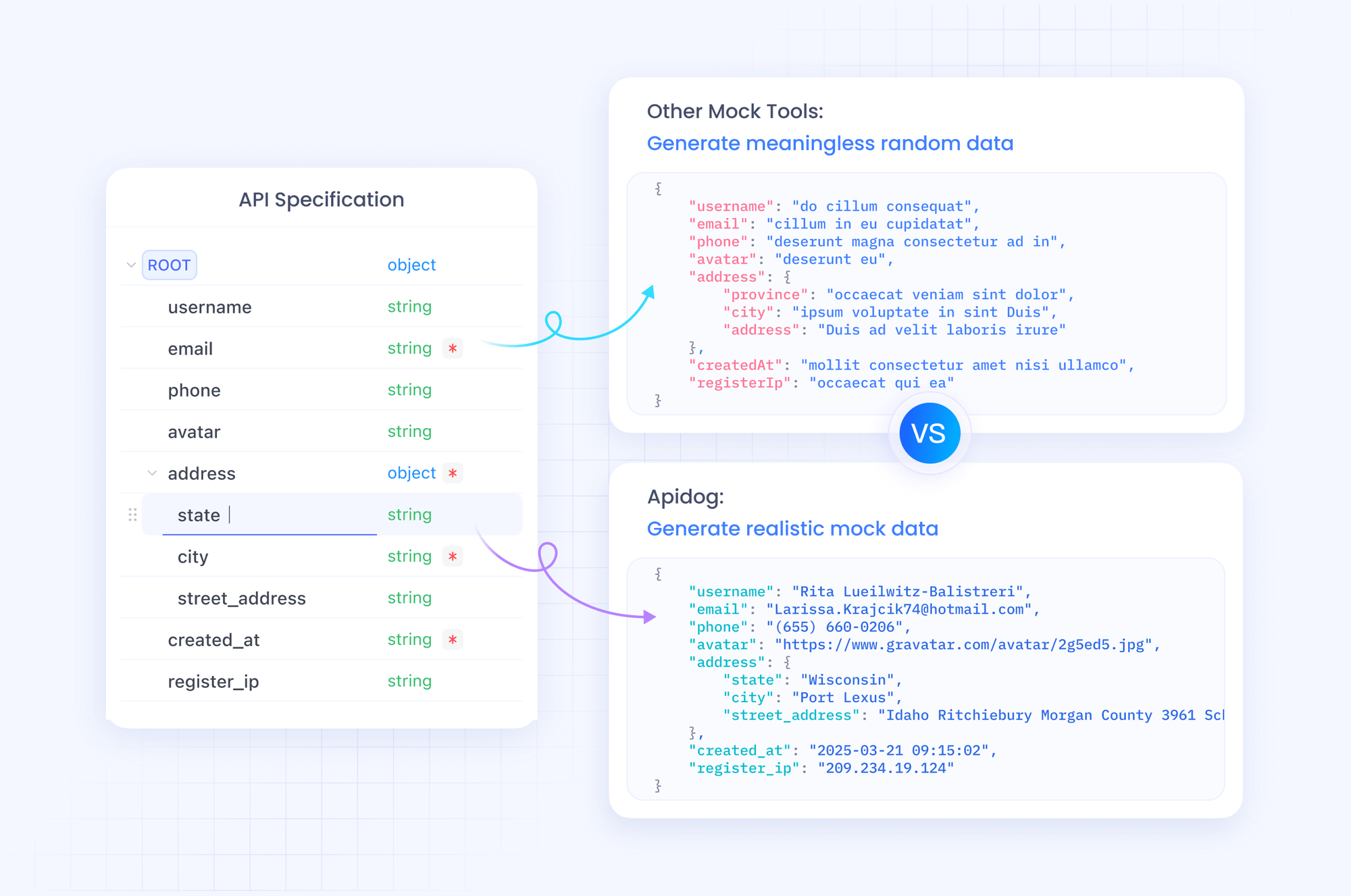

Para testes, integre o Apidog desde cedo. Esta ferramenta gera comandos curl e coleções Postman a partir de seus experimentos com o SDK, garantindo consistência entre as equipes. Importe sua chave de API para as variáveis de ambiente do Apidog e crie uma nova requisição para o endpoint /v1/messages. Essa preparação evita armadilhas comuns como erros de autenticação, permitindo que você se concentre na engenharia de prompts.

Uma vez configurado, confirme a conectividade com uma simples verificação de saúde (health check). Envie uma requisição básica para validar sua chave e rede. Esta etapa confirma que seu ambiente lida com os limites de taxa da API — inicialmente 50 requisições por minuto para modelos Opus, escalável com os níveis de uso.

Autenticação e Fundamentos da API

A Anthropic impõe a autenticação via tokens Bearer, um mecanismo padrão inspirado em OAuth2. Inclua sua chave de API no cabeçalho Authorization como Bearer ${ANTHROPIC_API_KEY} para cada requisição. A URL base é https://api.anthropic.com/v1, com o endpoint principal /messages para conclusões de chat.

As requisições seguem uma estrutura de payload JSON. Defina um campo model especificando claude-opus-4-5-20251101, o identificador exato para esta versão. Adicione um array messages contendo pares de função-conteúdo: prompts de sistema definem diretrizes comportamentais, enquanto mensagens de usuário acionam respostas. Por exemplo:

{

"model": "claude-opus-4-5-20251101",

"max_tokens": 1024,

"messages": [

{"role": "user", "content": "Explain quantum entanglement in simple terms."}

]

}

O SDK simplifica isso: em Python, client.messages.create(model="claude-opus-4-5-20251101", max_tokens=1024, messages=[{"role": "user", "content": "Your prompt here"}]). As respostas retornam um array content com deltas de texto para streaming, ou blocos completos para modo em lote.

Os limites de taxa são aplicados por organização: o Opus 4.5 limita a 10.000 tokens por minuto inicialmente, com picos de até 50.000. Monitore através de cabeçalhos de resposta como x-ratelimit-remaining. Se excedido, implemente um backoff exponencial em seu código — o SDK lida com isso nativamente com retry_on=anthropic.RetryStatus.SERVER_ERROR.

As melhores práticas de segurança incluem a rotação trimestral de chaves e a restrição delas a faixas de IP específicas no console. Assim, você mantém a conformidade em ambientes corporativos enquanto dimensiona as chamadas de API.

Fazendo Sua Primeira Requisição à API

Execute sua requisição inaugural para compreender o ritmo da API. Comece com uma consulta direta que teste a capacidade de raciocínio do modelo. Em Python:

import anthropic

import os

client = anthropic.Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.messages.create(

model="claude-opus-4-5-20251101",

max_tokens=500,

messages=[

{"role": "user", "content": "Write a Python function to compute Fibonacci numbers up to n=20."}

]

)

print(response.content[0].text)

Este código invoca o modelo, que gera código eficiente aproveitando a memoização — demonstrando sua aptidão para codificação. A resposta chega em menos de 2 segundos com esforço padrão, com tokens de saída em torno de 150 para resultados concisos.

Para streaming, adicione stream=True à chamada. Isso produz deltas incrementais, ideais para UIs em tempo real. Analise-os através de um loop de gerador:

stream = client.messages.stream(

model="claude-opus-4-5-20251101",

max_tokens=500,

messages=[{"role": "user", "content": "Your streaming prompt"}]

)

for text in stream:

print(text.content[0].text, end="", flush=True)

O Apidog complementa isso visualizando streams em seu visualizador de respostas, destacando o consumo de tokens. Experimente aqui para refinar os prompts antes da produção.

Lide com erros proativamente. Um status 429 indica limitação de taxa (throttling); capture com blocos try-except. Da mesma forma, 400s sinalizam JSON malformado — valide payloads usando o verificador de esquema do Apidog. Através desses fundamentos, você constrói uma base para integrações mais intrincadas.

Recursos Avançados: Controle de Esforço e Gerenciamento de Contexto

O Claude Opus 4.5 introduz o parâmetro effort, um divisor de águas para equilibrar velocidade e profundidade. Defina-o como "low" (baixo), "medium" (médio) ou "high" (alto) nas requisições: baixo prioriza respostas rápidas (latência sub-segundo), enquanto alto aloca computação estendida para saídas detalhadas, impulsionando benchmarks como o SWE-bench em 15 pontos.

Incorpore-o assim:

response = client.messages.create(

model="claude-opus-4-5-20251101",

effort="high",

max_tokens=2000,

messages=[{"role": "user", "content": "Analyze tradeoffs in microservices vs. monoliths for a fintech app."}]

)

Com esforço alto, o modelo emprega scratchpads intercalados e um orçamento de pensamento de 64K, resultando em tabelas detalhadas de prós e contras. No entanto, isso aumenta os custos — o esforço médio geralmente é suficiente para 80% das tarefas, igualando a eficiência do Sonnet 4.5 com 76% menos tokens.

O gerenciamento de contexto segue o mesmo princípio. A janela de 200K acomoda repositórios inteiros; use o SDK de compactação do lado do cliente para resumir trocas anteriores. Instale via pip install anthropic-compaction e, em seguida:

from anthropic.compaction import compact_context

compacted = compact_context(previous_messages)

# Append to new messages array

Este recurso se destaca em loops agenticos, onde os agentes mantêm a memória entre as sessões. Para sistemas multi-agentes, defina subagentes via chamadas de ferramentas, permitindo que o Opus 4.5 orquestre equipes — por exemplo, um para pesquisa, outro para validação.

Transitando para ferramentas, o Opus 4.5 suporta definições avançadas. Declare esquemas JSON para funções como consultas a bancos de dados:

{

"name": "get_user_data",

"description": "Fetch user profile",

"input_schema": {"type": "object", "properties": {"user_id": {"type": "string"}}}

}

O modelo invoca ferramentas de forma autônoma, analisando argumentos e injetando resultados em acompanhamentos. Isso permite fluxos de trabalho híbridos, como agentes encadeados por API para varreduras de cibersegurança.

Integrando Ferramentas e Construindo Agentes

O uso de ferramentas eleva o Claude Opus 4.5 a patamares agenticos. Defina ferramentas no array tools das requisições. O modelo decide a invocação com base no contexto, gerando chamadas formatadas em XML para precisão.

Exemplo: Integrar uma ferramenta de API de clima.

tools = [

{

"name": "get_weather",

"description": "Retrieve current weather for a city",

"input_schema": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

]

response = client.messages.create(

model="claude-opus-4-5-20251101",

max_tokens=1000,

tools=tools,

messages=[{"role": "user", "content": "Plan a trip to Paris; check weather."}]

)

Se o modelo chamar a ferramenta, extraia de response.stop_reason == "tool_use", execute externamente e anexe a saída como uma mensagem de resultado da ferramenta. Faça um loop até a conclusão para a execução completa do agente.

Para uso em computador, habilite recursos beta via cabeçalhos. Isso permite inspeção de tela e automação, com a Ferramenta Zoom para análise em nível de pixel — crucial para depuração de UI.

O Apidog simplifica o teste de ferramentas: simule endpoints em seu simulador e, em seguida, exporte para o código SDK. Essa abordagem iterativa refina a confiabilidade do agente, reduzindo chamadas alucinadas.

Em configurações multi-agentes, aproveite as ferramentas de memória para persistência de estado. Armazene fatos importantes em uma ferramenta de memory, consultada por subagentes. Consequentemente, os sistemas lidam com tarefas complexas como auditorias de software, onde um agente planeja e outros executam.

Tratamento de Erros e Melhores Práticas

Aplicações robustas antecipam falhas. Implemente um tratamento de erros abrangente para as peculiaridades da API. Para erros 4xx, registre o error.type (por exemplo, "invalid_request") e tente novamente com payloads corrigidos. Use a biblioteca tenacity para decoradores:

from tenacity import retry, stop_after_attempt, wait_exponential

@retry(stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=4, max=10))

def safe_api_call(prompt):

return client.messages.create(model="claude-opus-4-5-20251101", messages=[{"role": "user", "content": prompt}])

Monitore o uso de tokens via usage nas respostas — entrada, saída e acertos de cache. Defina orçamentos dinamicamente: se a saída exceder 80% de max_tokens, trunque e resuma.

As melhores práticas incluem engenharia de prompt com tags XML para estrutura: <thinking>Reason step-by-step</thinking><output>Final answer</output>. Isso guia o modelo, especialmente com baixo esforço. Além disso, habilite a segurança via prompts system que impõem diretrizes éticas.

Para produção, agrupe requisições para reduzir custos: coloque consultas não urgentes em fila e processe em grupos de 100. Armazene prompts frequentes em cache para economizar 90%. Audite regularmente as saídas para alinhamento — o Opus 4.5 resiste a injeções, mas valide dados sensíveis.

Otimizando Desempenho e Custo

A otimização garante uso sustentável. Perfile as requisições com as análises do Apidog: rastreie latência, gasto de tokens e taxas de sucesso. Identifique gargalos, como prompts verbosos, e condense-os usando compactação.

Aproveite o cache de prompts: marque prefixos reutilizáveis com cache_control: {"type": "ephemeral"}. Em acertos, pague apenas 25% pelos inputs. Para agentes, persista o cache entre as chamadas para manter o contexto de forma acessível.

Escale com padrões assíncronos. Em Node.js:

const { Anthropic } = require('@anthropic-ai/sdk');

const anthropic = new Anthropic({ apiKey: process.env.ANTHROPIC_API_KEY });

async function parallelRequests(prompts) {

const promises = prompts.map(p =>

anthropic.messages.create({ model: 'claude-opus-4-5-20251101', messages: [{role: 'user', content: p}] })

);

return Promise.all(promises);

}

Isso lida com ramificações de agentes concorrentes de forma eficiente. Com alto esforço, limite o orçamento de pensamento para 32K para controle de custos sem sacrificar a qualidade.

Avalie seu setup contra as linhas de base: o Opus 4.5 alcança 72,5% no SWE-bench, então teste avaliações personalizadas. Ajuste o esforço por tarefa — baixo para ideação, alto para verificação.

Conclusão

Você agora possui as ferramentas para integrar a API Claude Opus 4.5 em sua stack de forma eficaz. Desde a configuração inicial até a orquestração de agentes, este guia delineia um caminho para alavancar suas forças em codificação e raciocínio. Lembre-se, pequenos refinamentos — como cache ou ajuste de esforço — geram ganhos substanciais em desempenho e economia.

Experimente iterativamente, usando o Apidog para validar cada camada. À medida que você constrói, monitore as atualizações da Anthropic para aprimoramentos. Em última análise, o Claude Opus 4.5 transforma o desenvolvimento de trabalho manual em inteligência orquestrada. Comece a implementar hoje e veja seus projetos escalarem com precisão.