OpenAI는 2025년 11월 19일 GPT-5.1-Codex-Max를 출시하며 소프트웨어 개발을 위한 에이전트형 AI에 있어 중요한 진전을 이루었습니다. 이 모델은 이전 세대 모델이 일관성 없이 처리했던 지속적이고 장기적인 코딩 작업에 탁월합니다. 또한, 개발자들은 이제 이 모델을 Codex 환경에 원활하게 통합하여, 수백만 토큰에 걸쳐 컨텍스트 압축을 통해 여러 시간 동안 자율적인 작업을 수행할 수 있게 되었습니다.

이 가이드에서는 실제 시나리오에서 GPT-5.1-Codex-Max에 액세스하고 적용하는 방법을 정확히 설명합니다. 환경을 구성하고, 효과적인 프롬프트를 작성하며, 추론 노력을 활용하고, 긴 컨텍스트 세션을 처리하는 방법을 배울 수 있습니다.

GPT-5.1-Codex-Max란 무엇인가요? 주요 기능 및 아키텍처

OpenAI는 GPT-5.1-Codex-Max를 Codex 제품군의 정점으로 내세웁니다. 엔지니어들은 소프트웨어 엔지니어링, 수학, 연구 및 컴퓨터 사용 분야의 에이전트형 작업에 대해 광범위하게 훈련된 업데이트된 기본 추론 모델을 기반으로 이를 구축했습니다.

GPT-5.1과 같은 범용 모델과 달리, 이 변형 모델은 코딩 에이전트에 특화되어 최적화되었습니다. 토큰 제한에 가까워질 때 필수 정보를 요약하고 유지하는 기술인 컨텍스트 압축에 대한 기본 지원을 도입합니다. 결과적으로 이 모델은 수백만 토큰에 걸친 세션에서도 일관성을 유지하며, 내부 테스트에서는 종종 몇 시간 또는 24시간 이상 자율적으로 작동했습니다.

GPT-5.1-Codex-Max는 Windows 특정 환경에 대한 훈련을 통합하여, macOS 및 Linux를 선호했던 이전 모델들의 오랜 공백을 메웠습니다. 또한 CLI 워크플로우에서 협업을 향상시켜 대화형 세션의 강력한 파트너가 됩니다.

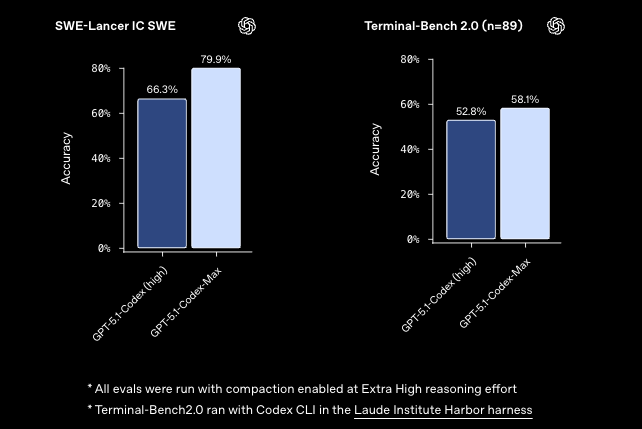

벤치마크 성능은 이러한 개선 사항을 강조합니다. 예를 들어:

- SWE-bench Verified (n=500)에서 'xhigh' 추론 노력 시 77.9%의 문제 해결률을 달성합니다.

- SWE-Lancer IC SWE에서 79.9%를 기록합니다.

- Terminal-Bench 2.0에서 58.1%에 도달합니다.

이 수치들은 GPT-5.1-Codex를 상당한 차이로 능가하며, 동등한 노력 수준에서 종종 30% 더 적은 "사고 토큰"을 사용합니다. 따라서 개발자들은 정확성을 희생하지 않고도 더 빠른 반복 작업을 경험할 수 있습니다.

GPT-5.1-Codex-Max 액세스: 요금제, 인터페이스 및 초기 설정

GPT-5.1-Codex-Max는 주로 OpenAI의 Codex 플랫폼을 통해 액세스할 수 있으며, 이 플랫폼은 고급 에이전트형 사용을 위해 이전 GitHub Copilot 통합을 대체했습니다.

먼저, 자격 요건을 갖춘 요금제(ChatGPT Plus, Pro, Business, Education 또는 Enterprise)를 구독하고 있는지 확인하십시오. 출시 시점부터 이 모델은 해당 티어에 즉시 배포되며 다음을 포함한 Codex 인터페이스의 기본 모델이 됩니다.

- Codex CLI (오픈 소스 로컬 에이전트)

- IDE 확장 프로그램 (VS Code, JetBrains)

- 클라우드 기반 Codex 웹 인터페이스

- 코드 검토 도구

시작하려면, 로컬에 설치된 Codex CLI를 업데이트하세요:

codex update

이 명령은 GPT-5.1-Codex-Max를 지원하는 최신 버전을 가져옵니다. 다음으로, 활성 모델을 확인하세요:

codex config model

`gpt-5.1-codex-max`가 기본값으로 나열된 것을 볼 수 있습니다. 하지만 필요에 따라 세션별로 이를 재정의할 수 있습니다.

API 사용자들을 위해 OpenAI는 출시 직후 `gpt-5.1-codex-max` 모델 ID로 직접 액세스를 제공했습니다. 요금은 이전 Codex 모델과 동일하지만, 요금 제한은 티어별로 다릅니다. 엔터프라이즈 사용자는 맞춤 할당량을 위해 영업팀에 문의하십시오.

GPT-5.1-Codex-Max 호출을 위한 API 엔드포인트를 테스트할 때 Apidog는 매우 유용합니다. OpenAI의 OpenAPI 스키마를 Apidog로 직접 가져와 오프라인 개발을 위한 모의 서버를 생성하고, 추가 스크립트 작성 없이 어설션 기반 테스트를 자동화할 수 있습니다.

GPT-5.1-Codex-Max로 Codex CLI 마스터하기: 단계별 구성

Codex CLI는 로컬에서 안전한 에이전트형 워크플로우를 위해 GPT-5.1-Codex-Max를 활용하는 가장 강력한 방법입니다.

아직 설치하지 않았다면 먼저 CLI를 설치하세요:

npm install -g @openai/codex-cli

또는 OpenAI 다운로드에서 독립 실행형 바이너리를 사용하세요.

API 키로 인증하세요:

codex auth login

이렇게 하면 키가 안전하게 저장됩니다. 이제 프로젝트 디렉토리에서 새 세션을 시작하세요:

cd my-large-codebase

codex session new

CLI는 자동으로 GPT-5.1-Codex-Max를 선택합니다. 그런 다음 다음과 같은 자연어 명령을 내릴 수 있습니다:

전체 인증 모듈을 OAuth 2.1과 새로고침 토큰 회전을 사용하도록 리팩토링하고, 모든 종속성을 업데이트하며, 포괄적인 테스트를 추가하세요.

모델은 리포지토리를 분석하고, diff를 통해 변경 사항을 제안하며, 테스트를 반복적으로 실행하고, 통과할 때까지 수정을 적용합니다. 압축 덕분에 컨텍스트 손실 없이 100만 토큰을 초과하는 코드베이스도 처리할 수 있습니다.

또한, 복잡한 리팩토링을 위해 'xhigh' 추론을 활성화하세요:

codex config reasoning_effort xhigh

이는 확장된 사고 시간을 할당하여 전체 스택 기능 구현 또는 취약점 수정과 같은 장기적인 작업에서 우수한 결과를 도출합니다.

GPT-5.1-Codex-Max를 위한 프롬프트 엔지니어링 전략

효과적인 사용을 위해서는 정밀한 프롬프트 엔지니어링이 필요합니다. 모델이 명확한 목표, 제약 조건, 단계별 지시에 잘 반응하므로 입력을 계층적으로 구성해야 합니다.

예를 들어, 시스템 수준의 서문으로 세션을 시작하세요:

캔버스 그래픽스, 작은 정책 기울기 컨트롤러, 메트릭, 그리고 SVG 네트워크 시각화 도구를 포함하는 대화형 CartPole RL 샌드박스를 렌더링하는 단일 독립 실행형 브라우저 앱을 생성하세요.

기능

모델이 카트 폴에서 더 잘하도록 정책을 실제로 훈련할 수 있어야 합니다.

모델이 훈련 중이거나 추론 중일 때 활성화/가중치 시각화 도구

에피소드의 단계, 이 에피소드의 보상

마지막 생존 시간 및 최고 생존 시간(단계)

그런 다음 명령을 자연스럽게 연결하세요. 또한 내장 도구를 활용하세요: 모델은 허용된 경우 파일 작업, Git 명령, 테스트 러너 및 외부 API를 기본적으로 호출합니다.

GPT-5.1-Codex-Max를 IDE 및 CI/CD 파이프라인에 통합하기

CLI 외에도 공식 Codex 확장을 통해 GPT-5.1-Codex-Max를 VS Code에 포함할 수 있습니다.

마켓플레이스에서 설치한 다음, 설정에서 모델을 선택하세요. 기능은 다음과 같습니다:

- 전체 프로젝트 인식을 통한 인라인 제안

- 자율적인 PR 생성

- 파일 전반의 문제를 추적하는 심층 디버깅 세션

CI/CD에서는 자동화된 코드 검토를 위해 Codex CLI를 스크립팅합니다:

# GitHub Action 예시

- name: Codex Review

run: codex review pr ${{ github.event.pull_request.number }} --model gpt-5.1-codex-max --effort xhigh

이는 문제를 조기에 발견하여 대규모로 표준을 적용합니다.

Apidog로 OpenAI API 상호 작용 테스트하기: 모범 사례

GPT-5.1-Codex-Max 사용을 확장함에 따라 강력한 API 테스트가 필수적입니다. Apidog는 요청 설계, 응답 유효성 검사 및 회귀 테스트 스위트 자동화를 위한 통합 환경을 제공함으로써 이 분야에서 뛰어납니다.

OpenAI의 API 사양을 Apidog로 가져오는 것으로 시작합니다:

- 새 프로젝트를 생성합니다.

- URL에서 가져오기:

https://raw.githubusercontent.com/openai/openai-openapi/master/openapi.yaml gpt-5.1-codex-max를 모델 매개변수로 사용하도록 엔드포인트를 업데이트합니다.

다음으로, 다른 API 키(개발, 스테이징, 프로덕션)를 위한 환경을 정의합니다. Apidog의 시각적 편집기를 사용하면 도구 호출과 함께 복잡한 채팅 완성을 작성한 다음, 어설션을 위한 사전 및 사후 스크립트를 실행할 수 있습니다.

예를 들어, 긴 컨텍스트 처리를 테스트합니다:

- 10만 토큰을 초과하는 프롬프트를 보냅니다.

- 응답 일관성 및 압축 트리거를 어설션합니다.

Apidog는 모의 서버를 자동으로 생성하여 프론트엔드 팀이 완전한 배포 전에 GPT-5.1-Codex-Max 엔드포인트에 대해 프로토타입을 만들 수 있도록 합니다. 또한, 내장된 JMeter와 유사한 자동화 기능은 수천 개의 시나리오를 실행하여 토큰 오버플로우 또는 추론 드리프트 문제를 포착합니다.

고급 사용 사례: 장기적인 작업 및 에이전트형 워크플로우

GPT-5.1-Codex-Max는 지속적인 추론이 필요한 시나리오에서 진정으로 빛을 발합니다.

한 가지 일반적인 적용 사례는 프로젝트 규모의 리팩토링입니다. 모델을 모노레포에 지정하고 다음과 같이 지시합니다:

전체 코드베이스를 React 17에서 React 19로 마이그레이션하고, 동시 모드를 구현하며, 번들 크기를 30% 최적화하세요.

에이전트는 자율적으로 작동하여 브랜치를 생성하고, 빌드를 실행하고, 실패를 수정하며, PR을 제출합니다. 종종 사람이 며칠 걸리는 작업을 8시간 이내에 완료합니다.

또 다른 강점은 사이버 보안 지원(방어 전용)입니다. OpenAI의 안전 장치를 준수하면서 리포지토리에서 취약점을 스캔하고, 패치를 제안하며, 수정 사항을 검증합니다.

연구 중심 코딩에서는 허용된 함수 호출을 통해 외부 도구와 결합할 수 있습니다. 예를 들어, 데이터베이스 또는 클라우드 서비스와 통합하여 엔드투엔드 데이터 파이프라인을 구축할 수 있습니다.

성능 최적화 및 비용 관리

적절한 추론 노력을 선택하여 기능과 효율성의 균형을 맞출 수 있습니다:

- 빠른 검토를 위한

medium - 표준 작업을 위한

high - 첨단 과제를 위한

xhigh

OpenAI 대시보드를 통해 사용량을 모니터링하세요. 압축은 긴 세션에서 전체 토큰을 20-40% 감소시켜 비용을 절감합니다.

비용이 많이 드는 호출을 프로토타입화할 때, Apidog의 모의 기능을 사용하여 과거 데이터를 기반으로 GPT-5.1-Codex-Max 응답을 시뮬레이션하세요. 이는 개발 중에 크레딧을 절약해줍니다.

제한 사항 및 책임 있는 사용

강점에도 불구하고 GPT-5.1-Codex-Max는 OpenAI의 중간 사이버 보안 준비 수준에 머물러 있습니다. 따라서 공격적인 보안 작업은 피하십시오. 또한, 매우 새로운 영역에서는 환각 현상이 발생할 수 있으므로 항상 출력을 확인하십시오.

속도 제한을 엄격히 준수하고, 프로덕션 배포 시에는 휴먼 인 더 루프(human-in-the-loop)를 구현하십시오.

결론: GPT-5.1-Codex-Max로 개발 워크플로우를 향상시키세요

GPT-5.1-Codex-Max는 2025년에 AI 지원 코딩이 달성할 수 있는 것을 재정의합니다. 이제 이전에는 불가능했던 규모로 리팩토링, 디버깅 및 혁신하는 다시간 자율 에이전트를 조율할 수 있습니다.

작게 시작하세요: Codex CLI를 설치하고, 간단한 리팩토링을 실행한 다음, 전체 프로젝트로 확장하세요. Apidog와 함께 사용하여 완벽한 API 테스트를 수행하면, 전통적인 방법보다 훨씬 빠른 개발 스택을 만들 수 있습니다.

소프트웨어 엔지니어링의 미래가 오늘 도착했습니다. GPT-5.1-Codex-Max를 구성하고 그 차이를 직접 경험해보세요.