OpenAIは2025年11月19日、GPT-5.1-Codex-Maxを発表しました。これは、ソフトウェア開発におけるエージェントAIの大きな進歩を示すものです。このモデルは、以前の世代では一貫性のなかった持続的で長時間にわたるコーディングタスクに優れています。さらに、開発者はこれをCodex環境にシームレスに統合できるようになり、数百万のトークンにわたるコンテキスト圧縮により、数時間にわたる自律的な操作を可能にします。

このガイドでは、GPT-5.1-Codex-Maxを実際のシナリオでどのようにアクセスし、適用するかを正確に説明します。環境設定、効果的なプロンプトの作成、推論努力の活用、長文コンテキストセッションの処理について解説します。

GPT-5.1-Codex-Maxとは?主な機能とアーキテクチャ

OpenAIは、GPT-5.1-Codex-MaxをCodexファミリーの頂点と位置付けています。エンジニアは、ソフトウェアエンジニアリング、数学、研究、コンピューター利用におけるエージェントタスクで広範囲にわたって学習された、更新された基礎推論モデルに基づいてこれを構築しています。

GPT-5.1のような汎用モデルとは異なり、このバリアントはコーディングエージェントに特化して最適化されています。トークン制限に近づいたときに不可欠な情報を要約して保持するコンテキスト圧縮というテクニックをネイティブにサポートしています。その結果、モデルは数百万トークンにわたるセッション全体で一貫性を維持し、内部テストでは数時間、あるいは24時間以上自律的に動作することもあります。

GPT-5.1-Codex-Maxは、以前のモデルがmacOSとLinuxを優遇していた長年のギャップを解消し、Windows固有の環境での学習を取り入れています。また、CLIワークフローでのコラボレーションも強化し、インタラクティブなセッションの強力なパートナーとなっています。

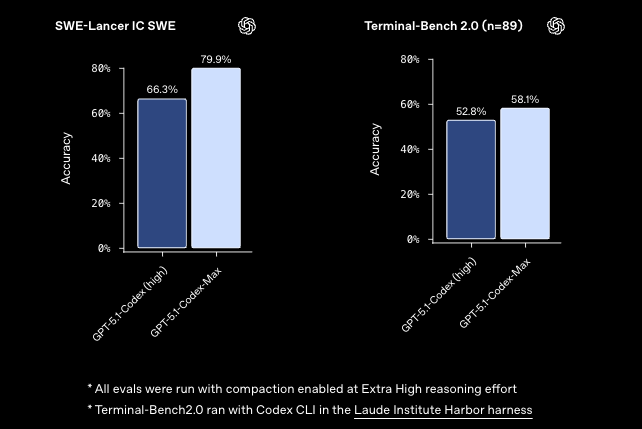

ベンチマーク性能はこれらの進歩を裏付けています。例えば:

- SWE-bench Verified (n=500) では、「xhigh」推論努力で77.9%の解決率を達成します。

- SWE-Lancer IC SWEでは、79.9%を記録します。

- Terminal-Bench 2.0では、58.1%に達します。

これらの数値は、GPT-5.1-Codexを顕著な差で上回り、同等の努力レベルで思考トークンを30%削減することがよくあります。したがって、開発者は精度を犠牲にすることなく、より迅速なイテレーションを経験できます。

GPT-5.1-Codex-Maxへのアクセス:プラン、インターフェース、初期設定

GPT-5.1-Codex-Maxへは、主にOpenAIのCodexプラットフォームを通じてアクセスします。これは、高度なエージェント利用のための以前のGitHub Copilot統合を置き換えるものです。

まず、対象となるプラン(ChatGPT Plus、Pro、Business、Education、またはEnterprise)に加入していることを確認してください。発表時点では、このモデルはこれらのティアですぐにデプロイされ、以下のCodexインターフェースでデフォルトとなります。

- Codex CLI(オープンソースのローカルエージェント)

- IDE拡張機能(VS Code、JetBrains)

- クラウドベースのCodexウェブインターフェース

- コードレビューツール

始めるには、ローカルにインストールされているCodex CLIを更新します。

codex update

このコマンドは、GPT-5.1-Codex-Maxをサポートする最新バージョンをプルします。次に、アクティブなモデルを確認します。

codex config model

gpt-5.1-codex-maxがデフォルトとして表示されます。ただし、必要に応じてセッションごとにこれを上書きできます。

APIユーザー向けには、OpenAIは発表直後にモデルID gpt-5.1-codex-maxで直接アクセスを展開しました。価格設定は以前のCodexモデルに準拠していますが、レート制限はティアによって異なります。Enterpriseユーザーはカスタムクォータについて営業担当者に連絡してください。

GPT-5.1-Codex-Max呼び出し用のAPIエンドポイントをテストする際、Apidogは非常に役立ちます。OpenAIのOpenAPIスキーマをApidogに直接インポートし、オフライン開発用のモックサーバーを生成し、アサーションベースのテストを自動化できます。これらすべてを、追加のスクリプトを記述することなく行えます。

GPT-5.1-Codex-MaxでCodex CLIを習得する:ステップバイステップの設定

Codex CLIは、ローカルでセキュアなエージェントワークフローのためにGPT-5.1-Codex-Maxを活用する最も強力な方法です。

まだインストールしていない場合は、まずCLIをインストールします。

npm install -g @openai/codex-cli

または、OpenAIのダウンロードからスタンドアロンバイナリを使用します。

APIキーで認証します。

codex auth login

これはキーを安全に保存します。次に、プロジェクトディレクトリで新しいセッションを開始します。

cd my-large-codebase

codex session new

CLIは自動的にGPT-5.1-Codex-Maxを選択します。その後、次のような自然言語コマンドを発行します。

認証モジュール全体をOAuth 2.1とリフレッシュトークンローテーションを使用するようにリファクタリングし、すべての依存関係を更新し、包括的なテストを追加してください。

モデルはリポジトリを分析し、差分を介して変更を提案し、テストを繰り返し実行し、合格するまで修正を適用します。圧縮機能のおかげで、100万トークンを超えるコードベースでもコンテキストを失うことなく処理します。

さらに、複雑なリファクタリングには「xhigh」推論を有効にします。

codex config reasoning_effort xhigh

これにより、長期間にわたるタスク(フルスタック機能の実装や脆弱性修復など)で優れた結果を生み出すため、拡張された思考時間が割り当てられます。

GPT-5.1-Codex-Maxのためのプロンプトエンジニアリング戦略

効果的な使用には、正確なプロンプトエンジニアリングが必要です。モデルは明示的な目標、制約、段階的な指示によく反応するため、入力を階層的に構成します。

例えば、システムレベルのプレアンブルでセッションを開始します。

canvasグラフィック、小さなポリシー勾配コントローラー、メトリクス、SVGネットワークビジュアライザーを備えた、単一の自己完結型ブラウザアプリを生成してください。

機能

モデルがCartPoleでより良く動作するようにポリシーを実際に訓練できる必要があります。

モデルの訓練中または推論中にアクティベーション/重みを視覚化するビジュアライザー

エピソード内のステップ、このエピソードの報酬

最後の生存時間と最高の生存時間(ステップ数)

次に、コマンドを自然に連鎖させます。さらに、組み込みツールを活用します。モデルは、許可された場合にファイル操作、gitコマンド、テストランナー、外部APIをネイティブに呼び出します。

IDEとCI/CDパイプラインへのGPT-5.1-Codex-Maxの統合

CLIを超えて、GPT-5.1-Codex-Maxを公式のCodex拡張機能を通じてVS Codeに組み込むことができます。

マーケットプレイスからインストールし、設定でモデルを選択します。機能には以下が含まれます。

- プロジェクト全体を認識するインラインサジェスト

- 自律的なPR生成

- ファイル間の問題を追跡する詳細なデバッグセッション

CI/CDでは、Codex CLIをスクリプト化して自動コードレビューを行います。

# GitHub Action の例

- name: Codex Review

run: codex review pr ${{ github.event.pull_request.number }} --model gpt-5.1-codex-max --effort xhigh

これにより、問題を早期に検出し、大規模な標準化を強制します。

Apidogを使用したOpenAI APIインタラクションのテスト:ベストプラクティス

GPT-5.1-Codex-Maxの使用が拡大するにつれて、堅牢なAPIテストが不可欠になります。Apidogは、リクエストの設計、応答の検証、回帰テストスイートの自動化のための統合環境を提供することで、ここで優れた能力を発揮します。

まず、OpenAIのAPI仕様をApidogにインポートします。

- 新しいプロジェクトを作成します。

- URLからインポート:

https://raw.githubusercontent.com/openai/openai-openapi/master/openapi.yaml - エンドポイントを更新して、モデルパラメーターとして

gpt-5.1-codex-maxを使用するようにします。

次に、異なるAPIキー(開発、ステージング、本番)用の環境を定義します。Apidogのビジュアルエディタを使用すると、ツール呼び出しを伴う複雑なチャット補完を作成し、アサーションのために前処理スクリプトと後処理スクリプトを実行できます。

例えば、長文コンテキスト処理をテストします。

- 10万トークンを超えるプロンプトを送信します。

- 応答の一貫性と圧縮トリガーをアサートします。

Apidogはモックサーバーを自動生成するため、フロントエンドチームは本番デプロイメント前にGPT-5.1-Codex-Maxエンドポイントに対するプロトタイプ作成が可能です。さらに、組み込みのJMeterのような自動化機能は、数千のシナリオを実行し、トークンオーバーフローや推論のドリフトの問題を検出します。

高度なユースケース:長期間タスクとエージェントワークフロー

GPT-5.1-Codex-Maxは、持続的な推論を必要とするシナリオで真価を発揮します。

一般的なアプリケーションの1つは、プロジェクト規模のリファクタリングです。モデルをモノリポに向けて、次のように指示します。

コードベース全体をReact 17からReact 19に移行し、同時モードを実装し、バンドルサイズを30%最適化してください。

エージェントは自律的に動作し、ブランチを作成し、ビルドを実行し、失敗を修正し、PRを提出します。人間が数日かかる作業を8時間未満で完了することもあります。

もう1つの強みは、サイバーセキュリティ支援(防御のみ)にあります。OpenAIの安全対策を遵守しながら、リポジトリをスキャンして脆弱性を検出し、パッチを提案し、修正を検証します。

研究指向のコーディングでは、許可された関数呼び出しを介して外部ツールと組み合わせます。例えば、データベースやクラウドサービスと統合して、エンドツーエンドのデータパイプラインを構築します。

パフォーマンスの最適化とコスト管理

適切な推論努力を選択することで、機能と効率のバランスを取ることができます。

medium:迅速なレビュー用high:標準的なタスク用xhigh:最先端の課題用

OpenAIダッシュボードを通じて利用状況を監視します。圧縮により、長時間のセッションでは全体のトークンが20~40%削減され、コストが削減されます。

高価な呼び出しをプロトタイプする際には、Apidogのモック機能を使用して過去のデータに基づいてGPT-5.1-Codex-Maxの応答をシミュレートします。これにより、開発中のクレジットを節約できます。

制限事項と責任ある利用

GPT-5.1-Codex-Maxは、その強みにもかかわらず、OpenAIのMediumレベルのサイバーセキュリティ対応態勢下にあります。そのため、攻撃的なセキュリティタスクは避けてください。また、極めて新しい領域では幻覚が発生する可能性があるため、常に結果を検証してください。

レート制限を厳守し、本番環境でのデプロイメントにはヒューマン・イン・ザ・ループを実装してください。

結論:GPT-5.1-Codex-Maxで開発ワークフローを向上させる

GPT-5.1-Codex-Maxは、2025年におけるAI支援コーディングが達成できることを再定義します。これにより、これまで不可能だった規模でリファクタリング、デバッグ、イノベーションを行うマルチ時間の自律エージェントを調整できるようになります。

小規模から始めてください。Codex CLIをインストールし、簡単なリファクタリングを実行してから、フルプロジェクトに拡張してください。堅牢なAPIテストのためにApidogと組み合わせれば、従来のメソッドを凌駕する開発スタックを構築できます。

ソフトウェアエンジニアリングの未来は今日到来しました。GPT-5.1-Codex-Maxを設定して、その違いを直接体験してください。