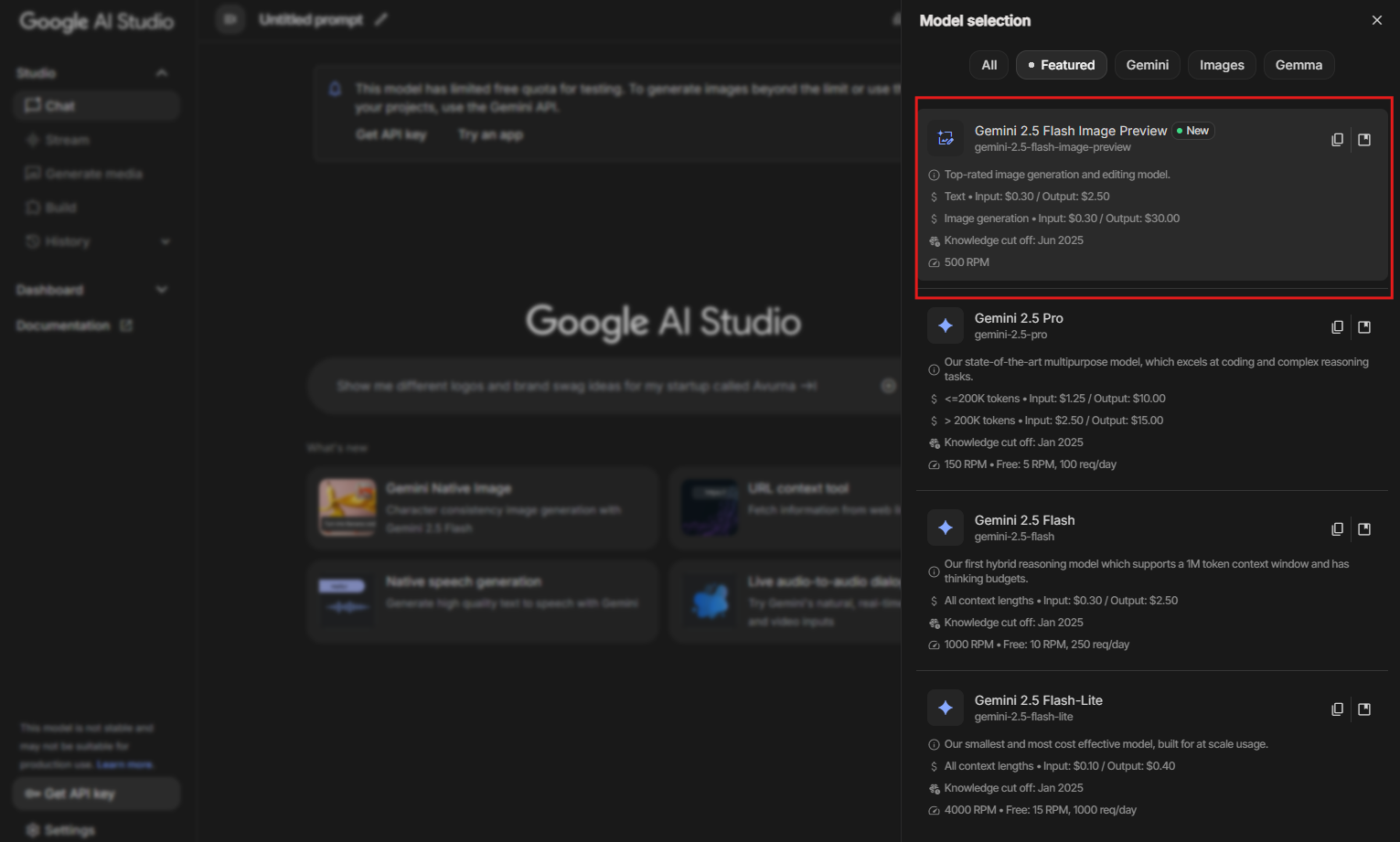

Googleは最近、AI駆動の画像編集における画期的な技術であるNano Bananaを発表しました。これは、一貫性と創造性において新たな基準を打ち立てるものです。正式名称はGemini 2.5 Flash Image Previewであるこの機能により、ユーザーは驚くべき精度で画像を生成および編集し、複数の修正を経ても被写体の類似性を維持できます。エンジニアや開発者は現在、Gemini APIを通じてこの機能にアクセスでき、簡単な写真補正から複雑なシーン構成まで、さまざまなタスクのためにカスタムアプリケーションへの統合が可能になっています。

AIモデルが進化するにつれて、Nano Bananaのようなツールは、クリエイターがデジタル画像における限界を押し広げることを可能にします。この記事では、Nano BananaをAPI経由で使用するための技術的な側面について、初期設定から高度なテクニックまでをガイドします。開発者はこのモデルを活用して、テキストプロンプトを視覚的に一貫した編集に変換するアプリケーションを構築しており、以下のセクションで各ステップを詳しく説明します。

Nano BananaとGemini 2.5 Flash Image Previewの理解

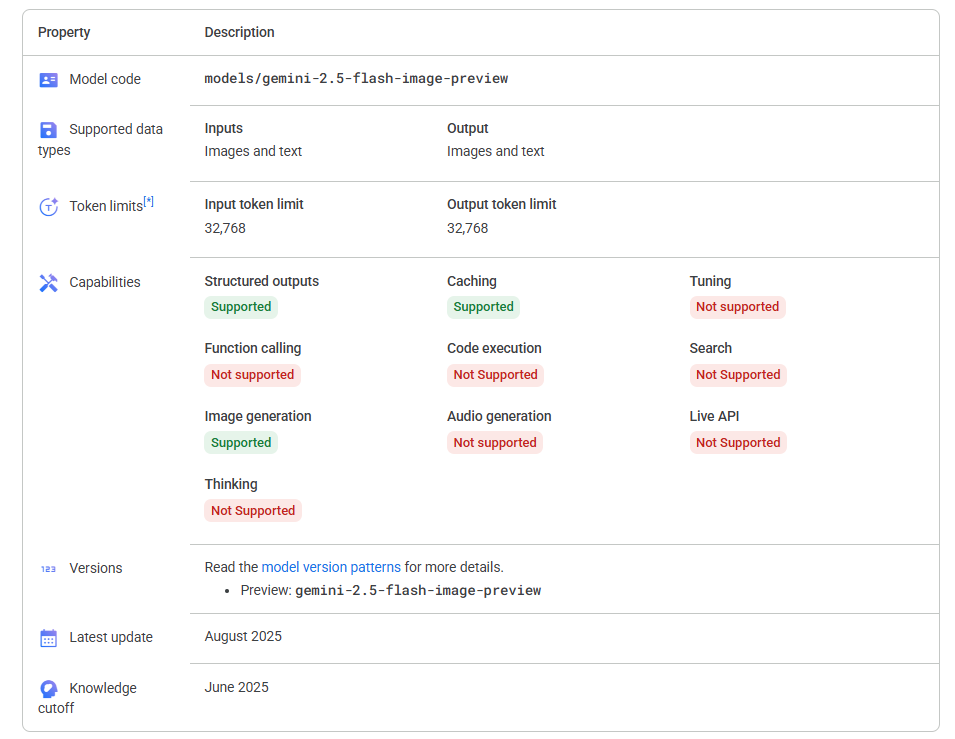

Nano Bananaは、画像生成と編集に特化したGoogleのマルチモーダルAIにおける最新の進歩を表しています。「Nano Banana」という用語は、Gemini 2.5 Flash Imageモデルの遊び心のある愛称として機能し、過度な計算負荷なしに高忠実度の結果を提供するその効率的で軽量な設計を強調しています。従来の画像編集ツールとは異なり、このモデルはキャラクターの一貫性を維持することに優れており、広範な変更後も顔、ポーズ、詳細が元の被写体に忠実であることを保証します。

さらに、Gemini-2-5-flash-image-previewは推論能力を統合しており、モデルが編集を適用する前に「考える」ことを可能にします。これにより、歪んだ特徴や不一致な照明といった一般的な落とし穴を回避した出力が得られます。例えば、モデルに人物の服装をカジュアルからフォーマルに変更するように指示すると、顔の表情や体のプロポーションをシームレスに維持します。

このモデルのアーキテクチャは、以前のGeminiのイテレーションに基づいて構築されており、視覚言語処理の強化が組み込まれています。テキストプロンプトと画像を組み合わせた入力などをサポートし、編集を繰り返し洗練できるマルチターンインタラクションを可能にします。GoogleはNano Bananaを画像編集ベンチマークのリーダーとして位置づけており、一貫性と品質において競合他社を凌駕しています。

さらに、このモデルには、AI生成コンテンツを示す可視および不可視の透かし(SynthID)などの組み込みの安全対策が含まれています。これにより、特に真正性が重要視されるプロフェッショナルな環境での倫理的な使用が促進されます。開発者は、ビジュアルの迅速なプロトタイピングがワークフローを加速するeコマース、デザイン、コンテンツ作成のアプリケーションにNano Bananaを採用しています。

Nano Banana APIを使用するための前提条件

Nano Bananaを実装する前に、セットアップが必須要件を満たしていることを確認してください。まず、Gemini APIはVertex AIまたはGoogle AI Studioを通じて動作するため、Google Cloudアカウントを取得してください。このプラットフォームは、Gemini-2-5-flash-image-previewへのアクセスと、API呼び出しのクォータ管理を提供します。

次に、プログラミング言語のサポートを確認します。APIはPython、JavaScript、Java、Go、RESTに対応していますが、Pythonはその豊富なライブラリのため、初心者にとって最も簡単です。pipを介してGoogle Generative AI SDKをインストールしてください: pip install google-generativeai。

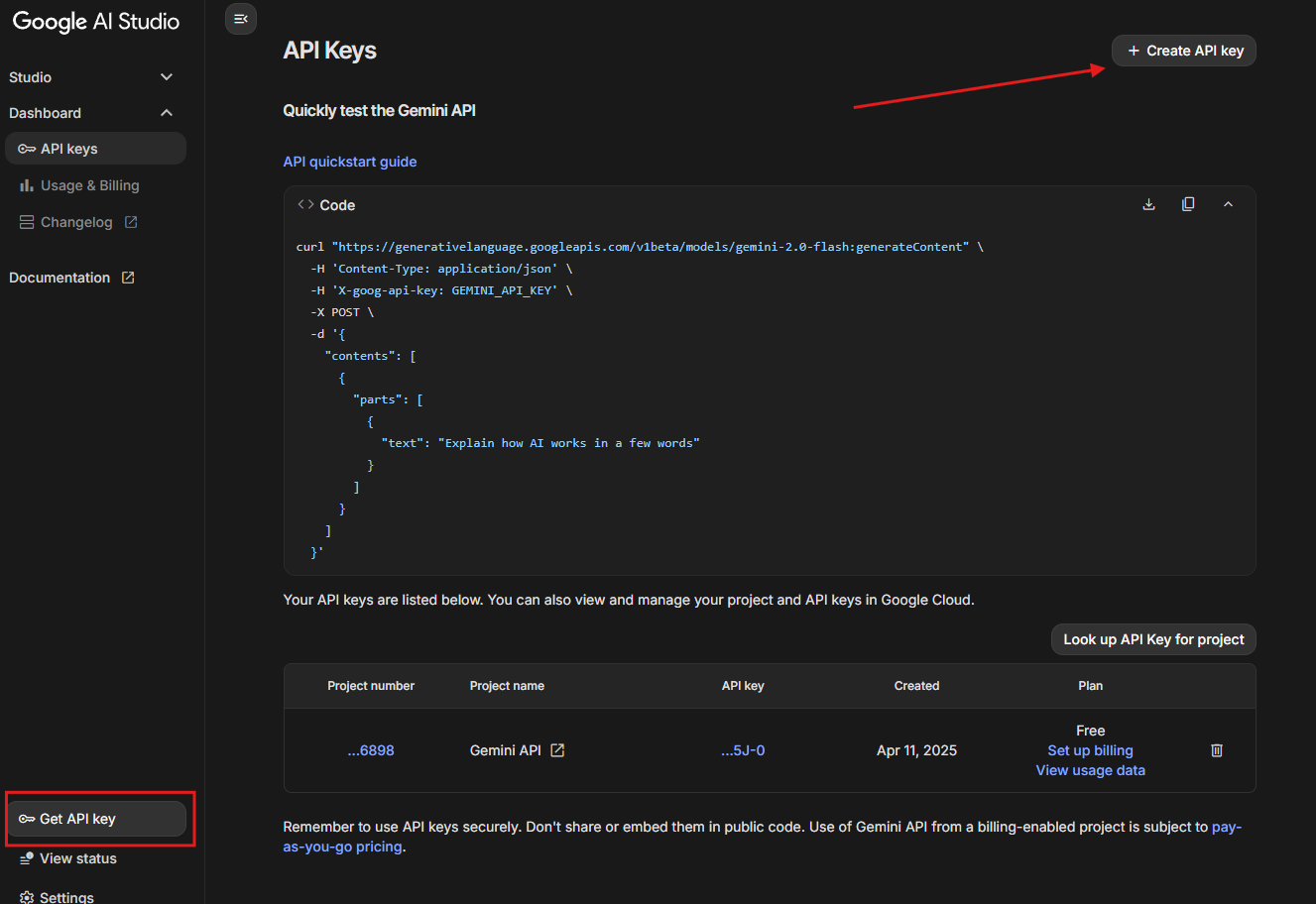

さらに、APIキーを使用して環境を準備します。Google AI Studioに移動し、Geminiサービスに制限されたキーを生成します。

セキュリティのベストプラクティスでは、このキーを環境変数に保存し、コードリポジトリでの公開を防ぐことが求められます。

さらに、画像形式に慣れておきましょう。Nano Bananaは、JPEG、PNG、およびbase64エンコードされた画像を入力として受け入れ、同様の形式で出力します。特にバッチ処理の場合、システムがファイルI/Oを効率的に処理できることを確認してください。

最後に、使用制限を確認してください。無料ティアでは1分あたりのリクエストが制限されていますが、有料プランは本番環境向けにスケールします。開発中のスロットリングを避けるために、これらを監視してください。

Gemini-2-5-Flash-Image-Previewの開発環境をセットアップする

エンジニアは、Nano Bananaを効果的に統合するために、環境を体系的に設定します。利用可能な場合は、Googleの画像編集クイックスタートなどのスターターリポジトリをクローンすることから始めます。これにより、認証と基本的な呼び出しのためのボイラープレートコードが提供されます。

次に、必要なモジュールをインポートします。Pythonでは、import google.generativeai as genaiを使用し、genai.configure(api_key=os.getenv('API_KEY'))で設定します。このステップでセッションを認証します。

さらに、モデルを明示的に選択します: model = genai.GenerativeModel('gemini-2.5-flash-image-preview')。これは、画像に最適化されたNano Bananaのバリアントを対象としています。

テストを強化するために、Apidogを組み込みます。公式サイトからダウンロードしてインストールし、Gemini APIエンドポイント用の新しいプロジェクトを作成します。Apidogを使用すると、リクエストのモック、ヘッダーの検査、エラーのシミュレーションが可能になり、Nano Bananaとのインタラクションをデバッグする際に非常に役立ちます。

実際には、venvを使用して仮想環境をセットアップし、依存関係を分離します。これにより、他のプロジェクトとの競合を防ぎ、再現性を維持できます。

Nano BananaへのAPIアクセスを取得する

Googleは開発者向けにAPIアクセスを合理化しています。まずGoogle AI Studioで、コードに移行する前にノーコードインターフェースでGemini-2-5-flash-image-previewを試してみてください。

準備ができたら、Google CloudコンソールでVertex AI APIを有効にします。安全なアクセスのために、サービスアカウントに「Vertex AI User」などのロールを割り当てます。

さらに、課金処理も行います。初期トライアルは無料ですが、継続的に使用する場合は課金を有効にしてください。Googleは新規ユーザー向けにクレジットを提供しており、参入障壁を下げています。

エンタープライズ設定の場合、高スループットアプリケーション向けにNano BananaをスケーリングするVertex AIのマネージドエンドポイントを検討してください。

Gemini-2-5-Flash-Image-Previewによる画像生成の基本的なAPI呼び出し

開発者はシンプルなプロンプトで画像生成を開始します。リクエストを構築します: response = model.generate_content(["未来的な設定のナノバナナの画像を生成してください。"])。モデルはテキストを処理し、base64エンコードされた画像を返します。

次に、出力をデコードして保存します: import base64; with open('output.png', 'wb') as f: f.write(base64.b64decode(response.parts[0].inline_data.data))。

さらに、不適切なコンテンツをフィルタリングするための安全設定を組み込みます: safety_settings = [{'category': 'HARM_CATEGORY_HATE_SPEECH', 'threshold': 'BLOCK_MEDIUM_AND_ABOVE'}]。

これらの呼び出しをApidogでテストするには、エンドポイントをhttps://generativelanguage.googleapis.com/v1beta/models/gemini-2.5-flash-image-preview:generateContentに設定し、ヘッダーにAPIキーを追加します。

Nano Bananaを使用した高度な画像編集テクニック

Nano Bananaは編集シナリオで輝きを放ちます。画像をアップロードし、プロンプトを入力します: response = model.generate_content([{'inline_data': {'mime_type': 'image/png', 'data': base64.b64encode(open('input.png', 'rb').read()).decode()}}, "背景をビーチに変更してください。"])。

さらに、会話履歴を維持することでマルチターン編集を有効にします: 繰り返し洗練するためにchat = model.start_chat(history=[previous_response])を使用します。

画像をブレンドする: 複数の入力を提供し、ポートレートと風景を結合するなどのブレンドを指示します。

スタイルを適用する: 「このオブジェクトにバナナの皮のテクスチャを適用してください」とプロンプトを入力し、Nano Bananaのクリエイティブコントロールを活用します。

フレームを順次編集することでビデオ生成を組み込みますが、これにはカスタムスクリプトが必要です。

効率的なAPIテストのためのApidogの統合

ApidogはNano Bananaのワークフローを強化します。Geminiエンドポイントのコレクションを作成し、プロンプトをパラメータ化し、自動テストを実行します。

例えば、Apidogでテストケースをスクリプト化し、画像編集の応答を検証し、SynthIDの透かしを確認します。

この統合により、ApidogがJSON応答を視覚化し、認証をシームレスに処理するため、開発時間が短縮されます。

Gemini-2-5-Flash-Image-PreviewのPythonコード例

ここに、編集を示す完全なスクリプトがあります:

import os

import base64

import google.generativeai as genai

genai.configure(api_key=os.getenv('GEMINI_API_KEY'))

model = genai.GenerativeModel('gemini-2.5-flash-image-preview')

with open('banana.jpg', 'rb') as img_file:

img_data = base64.b64encode(img_file.read()).decode()

prompt = "Edit this banana image to make it nano-sized in a lab setting."

response = model.generate_content([{'inline_data': {'mime_type': 'image/jpeg', 'data': img_data}}, prompt])

generated_img = base64.b64decode(response.parts[0].inline_data.data)

with open('edited_nano_banana.png', 'wb') as out:

out.write(generated_img)

このコードは、バナナ画像をアップロードし、編集を適用し、結果を保存します。

バッチ処理用に拡張する: 画像とプロンプトのリストをループします。

クォータ超過や無効な入力に対しては、try-exceptブロックを使用してエラーを適切に処理します。

Nano Banana APIのベストプラクティスと制限事項

APIクォータを遵守するために、コードにレート制限を導入してください。コストを最適化するために、繰り返しのクエリに対して応答をキャッシュしてください。

さらに、入力を検証する: より良い結果を得るために、画像がサイズ制限(通常4MB)以内であること、およびプロンプトが簡潔であることを確認してください。

制限事項には、複雑なシーンでの時折の一貫性の欠如や、地域的な利用制限が含まれます。Nano Bananaは、明確で記述的なプロンプトで最高のパフォーマンスを発揮します。

Gemini-2-5-flash-image-previewのようなモデルは急速に進化するため、Google DeepMindのチャンネルを通じて更新を監視してください。

結論

Nano Bananaは、Gemini 2.5 Flash Image Preview APIを通じて、開発者向けの画像編集に革命をもたらします。このガイドに従うことで、一貫性と創造性におけるその強みを活用した堅牢なソリューションを実装できます。Apidogのようなツールは効率を大幅に向上させることを忘れないでください。今すぐダウンロードして、APIインタラクションを向上させましょう。

実験するにつれて、プロンプトのわずかな調整がアウトプットに大きな改善をもたらします。Nano Bananaの可能性を最大限に引き出すために、探求を続けてください。