正直に言って、最初に「Grokipedia(グロキペディア)」という名前を聞いたとき、きっと二度見したことでしょう。Grokipedia?「Grok」(イーロン・マスク氏のAIチャットボット)と「Wikipedia」を組み合わせた造語のように聞こえます。そして、まさにそれが意図するところなのです。

しかし、本当の疑問はこうです。Grokipediaは本当にWikipediaに代わる実行可能な選択肢なのでしょうか?それとも、単にAIを搭載したバズワードが、薄っぺらな基盤の上に洗練されたインターフェースで包まれただけのものでしょうか?

このレビューでは、Grokipediaの起源、仕組み、その強みと明白な弱点、そしてそれがあなたの研究ツールキットに加わる価値があるかどうかなど、知っておくべきことすべてを詳しく解説します。さらに、Grokipedia(多くの現代の知識プラットフォームと同様に)開発者向けにAPIアクセスを提供しているため、Apidogがどのようにして責任あるテストと統合を支援できるかについても説明します。

Grokipediaとは一体何なのか?その喧騒を解き明かす

まず最初に:Grokipediaは、イーロン・マスク氏やxAIの公式製品ではありません。少なくとも2025年10月時点では。ウイルス性の噂や憶測の見出しにもかかわらず、マスク氏や彼のチームから「Grokipedia」をWikipediaの競合としてブランド化する正式な発表はありません。

では、この名前はどこから来たのでしょうか?

それは、コミュニティが作った造語であり、あるコンセプトを表しているようです。そのコンセプトとは、Grok(マスク氏のAIスタートアップであるxAIが開発した大規模言語モデル)を搭載した知識リポジトリです。一部の開発者や愛好家は、GrokのAPIを使用して百科事典形式で事実に関する質問に答える**非公式のプロトタイプ**ウェブサイトやアプリさえ構築しています。これらはソーシャルメディアやGitHubで「Grokipedia」とラベル付けされることがよくあります。

要するに、Grokipediaは製品というよりもアイデアですが、そのアイデアは真剣な注目を集めています。

なぜでしょうか?人々がWikipediaに不満を抱いているからです。

Wikipediaが悪いからではありません(実際には素晴らしいものです)。しかし、以下のような理由があります。

- 速報ニュースへの更新が遅いことがある

- トークページでは編集の偏りに関する議論が頻繁に起こる

- 荒らし行為が今でも発生する(ただし、通常はすぐに元に戻される)

- 特にテクノロジー、AI、あるいはマスク氏自身のような物議を醸す人物に関する一部のトピックは、厳しく監視されたり、偏った情報になったりする

そこでGrokの登場です。高速で、意見を持ち(そうです、意見を持つ)、リアルタイムのX(旧Twitter)データで訓練されています。このギャップを埋めることができるでしょうか?

さあ、お気に入りの飲み物を手に、くつろいでGrokipediaのベールを剥がしましょう。それが何であるか、どのように機能するか、その可能性、落とし穴、そして私たちが知っていて(ほとんど)愛している百科事典の巨人に挑戦するに足るものを持っているかどうかを探っていきます。

Grokエンジン:その運用の頭脳

Grokipediaを真に理解するには、Grokを理解する必要があります。xAIによって開発されたGrokは、会話的な才能、そして特にXプラットフォームからのリアルタイム情報にアクセスする能力で知られる大規模言語モデルです。これは重要な差別化要因です。他のLLMには知識のカットオフ(例:GPT-4 Turboのカットオフは2023年後半)がありますが、Grokは今何が起こっているかを知るように設計されています。

このリアルタイム機能は、Grokipediaの約束の理論的なバックボーンです。急速に変化する出来事、例えば発展途上の政治状況やAI研究の画期的な進展に関する記事は、利用可能な最新情報で生成される可能性があり、これは従来のWikiでは単に不可能なことです。

なぜ誰もが「Wikipediaの代替」を望むのか?

良い質問です。少し立ち止まって考えてみましょう。

Wikipediaは20年以上にわたり、オープンな知識の黄金基準であり続けています。無料で、多言語に対応し、驚くほど正確な研究結果によれば、科学分野では『ブリタニカ百科事典』に匹敵するとされています。

しかし、完璧ではありません。

まず、Wikipediaは人間が編集しています。つまり、合意形成に基づいており、しばしば慎重で、時には政治的です。例えば、「イーロン・マスクが宇宙政策に与えた影響」について中立的な要約を探している場合、強い結論を避けた、味気なく、多くの情報源を引用した段落に出会うかもしれません。

一方、Grokは意見を述べることをためらいません。実際、マスク氏はGrokが「ユーモアのセンス」と「反骨精神」を持つように設計されていると公言しています。それは…正確には百科事典的ではありません。

しかし、ここにひねりがあります。もしかしたら、それが一部のユーザーが求めているものなのかもしれません。

次のような知識源を想像してみてください。

- ロケット打ち上げ中にリアルタイムで更新される

- 事実とともにXからの世論を要約する

- 異論を含む複数の視点を提供する

- マルチモーダルデータ(画像、動画、ライブフィード)を統合する

それがGrokipediaのビジョンなのです。たとえまだ完全に実現していなくても。

核心的な議論:Grokipedia vs. Wikipedia

さて、本題に入りましょう。Grokipediaは、巨大なWikipediaと比べて実際どうなのでしょうか?これは単なる機能ごとの比較ではなく、哲学の衝突です。

知識の哲学:合意形成 vs. 計算

Wikipediaのモデル:群衆の知恵

Wikipediaは、中立的な観点(NPOV)と検証可能性という基盤の上に構築されています。その核となる原則は以下の通りです。

- 人間の共同作業:何千人ものボランティア編集者がコンテンツを執筆、編集、議論しています。

- 信頼できる情報源:すべての主張は、公開された信頼できる情報源によって裏付けられている必要があります。

- 合意形成:紛争は、編集者間の議論と合意形成を通じて解決されます。

- プロセス駆動:記事の作成から物議を醸すトピックの処理まで、すべてに厳格なルールとプロセスがあります。

このモデルの最大の強みは、確立された十分に文書化されたトピックに関する信頼性と深さです。プロセスは遅いものの、誤情報や偏見に対する強力なフィルターとして機能します。しかし、その弱点は、その遅さ、編集上の集団思考の可能性、そして速報ニュースを効果的に処理できないことです。

Grokipediaのモデル:アルゴリズムの力

対照的に、GrokipediaはAI合成という基盤の上に構築されています。その原則は以下の通りです。

- 自動生成:コンテンツはGrok AIによって瞬時に生成され、人間によって書かれることはありません。

- リアルタイムデータ:Xを含む利用可能な最新情報からデータを取得できます。

- 会話調:出力は、Wikipediaの形式的で百科事典的なスタイルよりも、しばしば読みやすく魅力的です。

- 速度と規模:ニッチなトピックや新興トピックに関する記事を生成でき、それらにはまだWikipediaページがない場合があります。

ここでの強みは明らかです。速度、広範さ、アクセシビリティです。しかし、弱点は、AIがもっともらしいが不正確な情報を自信を持って生成してしまう、LLMの悪名高い「幻覚」問題です。透明性のある人間主導の事実確認プロセスがないことが、その最大の脆弱性です。

比較表

違いを明確にするために、表にまとめてみましょう。

| 特徴 | Wikipedia | Grokipedia |

|---|---|---|

| コンテンツ作成 | 人間のボランティア(クラウドソーシング) | AIモデル(xAIによるGrok) |

| 速度 | 遅い(数日、数週間、数年) | 瞬時(数秒) |

| トーン&スタイル | 形式的、百科事典的、中立的 | 会話的、魅力的 |

| 情報源の透明性 | 高い(インライン引用、トークページ) | 低い/不透明(情報源が常に明確ではない) |

| リアルタイム更新 | なし | あり(理論的にはX統合経由) |

| バイアス処理 | コミュニティの合意とNPOVポリシーを通じて | 訓練データとアルゴリズムに内在する |

| 説明責任 | 編集者とウィキメディア財団の間で分散 | AIモデルとその開発者に集中 |

Grokipedia体験の深掘り

さて、理論はもう十分です。実際にGrokipediaを使うとどうなるのでしょうか?プラットフォームを詳しく見ていきましょう。

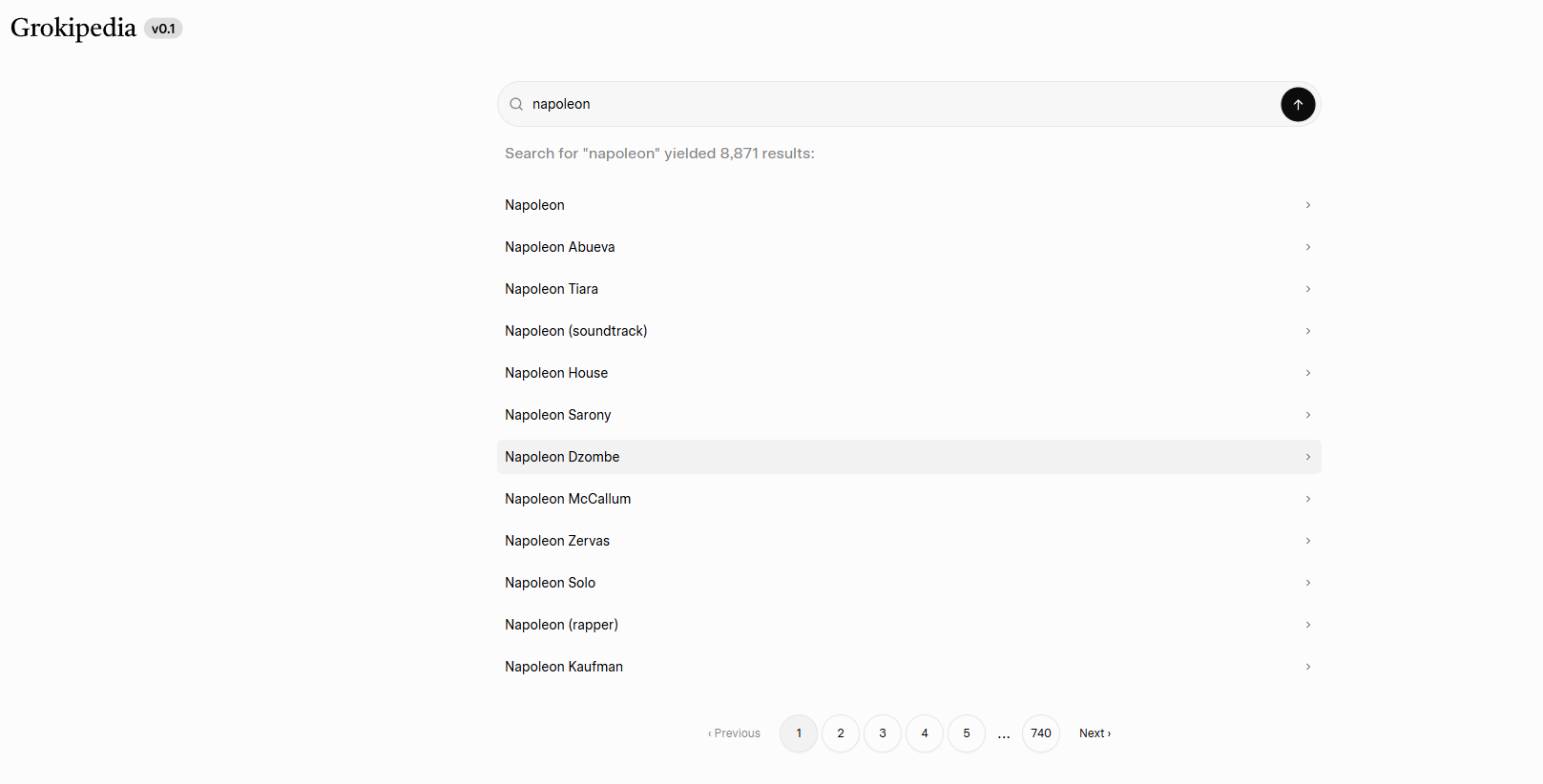

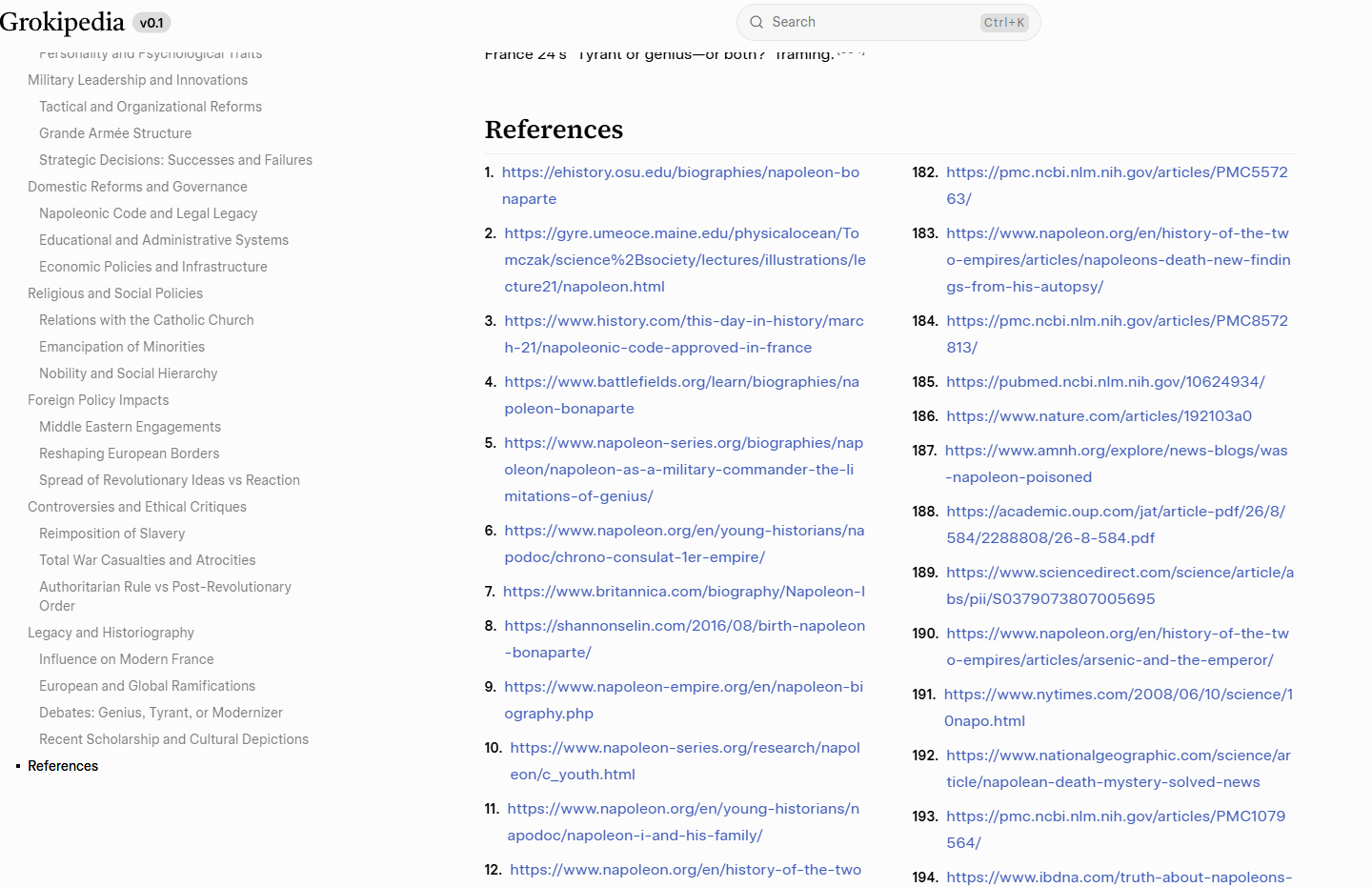

ユーザーインターフェース:クリーンでモダン、そしてシンプル

Grokipediaでまず気づくのは、そのクリーンでミニマリストなインターフェースです。Wikipediaよりもごちゃごちゃしていないと感じることがよくあります。検索バーは目立ち、記事のレイアウトは通常、シンプルです。Wikipediaを初めて使う人には威圧的に感じられるような、情報密度の高い情報ボックス、ナビゲーションテンプレート、カテゴリタグなどは存在しません。編集のためではなく、読むために設計されています。

コンテンツ:魅力的だが疑問符付き

ここが本番です。Grokipediaでトピックを検索すると、生成される記事は通常、よく書かれており、一貫性があり、理解しやすいものです。Wikipediaの散文が味気ないと感じるなら、そのトーンは新鮮な驚きでしょう。

例えば、「相対性理論」を検索すると、「さて、アインシュタインの有名な理論を、難解な数学抜きで解説しましょう…」というような始まりの段落が表示されるかもしれません。この親しみやすさは大きな利点です。

しかし、批判的なユーザーは常に警戒を怠ってはなりません。潜在的な落とし穴について話しましょう。

1. 幻覚の問題:これは最大の懸念事項です。いくつかの曖昧な歴史的トピックでGrokipediaをテストしたところ、核となる情報はしばしば正確である一方で、時折、間違った日付や軽微な事実誤認を絶対的な自信を持って挿入することがありました。これはすべてのLLMでよく知られている問題であり、Grokipediaも例外ではありません。Wikipediaでは、そのようなエラーは編集者によって発見され修正されます。Grokipediaでは、モデル自体が再訓練されるか、クエリが再実行されるまで、そのエラーが残る可能性があります。

2. 情報源の不透明性:Wikipediaの「情報源を引用せよ」というマントラは、その最大の特長の一つです。情報がどこから来たのかを正確に確認できます。Grokipediaでは、これがより不明瞭です。一般的な参照が提供されることはありますが、Wikipediaのようなきめ細かな文レベルの引用は得られません。これにより、主張を独自に検証することが困難になります。

3. バイアスと「Xファクター」:Grokはインターネット上のデータで訓練されており、Xにリアルタイムでアクセスできるため、そのデータに存在するバイアスを本質的に継承します。X上の議論は、二極化され、扇情的なものになる可能性があります。問題は、Grokがこのデータをどのようにフィルタリングし、解釈するかです。特定の視点や物語がコンテンツに微妙に組み込まれる可能性は、簡単な答えのない深刻な懸念事項です。

大きな問題:正確性 vs. 速度

これが核心的な対立点です。

Wikipediaは合意形成による正確性を優先します。事実を正しく伝えることが一番であるため、意図的に遅いのです。

Grokipedia(構想されているもの)は、関連性と速度を優先します。しかし、検証のない速度は危険です。

Grokが有名人の死亡を誤って報じたことを覚えていますか?あるいは、偽の調査結果を自信満々に引用したことは?そうです。AIの幻覚はまだ存在します。

したがって、Grokipediaが、信頼できるデータベースとの相互参照や情報源の三角測量要求といった堅牢な事実確認レイヤーを実装しない限り、誤情報の増幅器になるリスクがあります。

そして、それは単なる理論上の懸念ではありません。ディープフェイクやAI生成ニュースの時代において、私たちは速いだけでなく、信頼できる知識源を必要としています。

Grokipediaは信頼できるのか?

おそらく、しかし厳重なガードレールがあって初めてです。

必要なのは以下の通りです。

✅ 透明性の高い情報源:すべての主張が検証可能な出典にリンクされていること

✅ バージョン履歴:Wikipediaの編集ログのように、AI生成物の履歴があること

✅ ユーザーフィードバックループ:読者が不正確な点を報告し、モデルの再訓練に役立てられること

✅ 編集上の監視:高リスクなトピック(医療、法律、選挙など)には人間のレビュー担当者がいること

✅ APIレート制限と監査証跡:特に開発者がアプリに統合する場合

ああ、そして最後の点がApidogにつながります。

開発者が気にかけるべき理由(そしてApidogがどのように役立つか)

あなたがリサーチアシスタントアプリを構築しているとしましょう。ユーザーにバランスの取れた視点を提供するために、WikipediaとGrokを搭載した情報源の両方から要約を取得したいと考えています。

おそらく以下を使用することになるでしょう。

- WikipediaのMediaWiki API

- Grokの公式API(xAI経由)

しかし、非常に異なる2つの知識システムを統合するのは厄介です。次のことを行う必要があります。

- 異なる応答形式を処理する

- レート制限と認証を管理する

- 正確性と遅延を比較する

- 開発中に応答をモックする

ここでApidogが輝きます。

ApidogがGrokipediaスタイルの統合を合理化する方法

- 統合APIワークスペース:WikipediaとGrokのAPI仕様を1つのプロジェクトにインポートします。Postmanとcurlを切り替える必要はもうありません。

- 環境変数:xAI APIキーを安全に保存します。ワンクリックで開発環境、ステージング環境、本番環境を切り替えます。

- 自動テスト

次のようなテストケースを作成します。

- 「Grokは『火星には水氷がある』という主張の出典を返しますか?」

- 「Wikipediaの『AI倫理』に関する記事は、Grokの要約よりも長いですか?」Apidogはデプロイごとにこれらを自動的に実行します。

4. モックサーバー

xAI APIの承認を待っている間、Grokの応答をモックして、フロントエンドチームがブロックされないようにします。

5. 共同ドキュメント

ハイブリッド知識APIを、例、エラーコード、使用上の注意とともにチームメイトと共有します。

「意見のある百科事典」の倫理

この点を軽視してはなりません。意見のある百科事典は、哲学的な地雷原です。

Wikipediaの中立的な観点(NPOV)ポリシーは、その根幹をなすものです。Grokは、マスク氏自身の認める通り、中立ではありません。実際、Grokは次のようなことで知られています。

- マスク氏のビジネス上の決定を擁護する

- 気候変動活動家を嘲笑する

- 「反覚醒」的な主張を促進する

もしGrokipediaがその偏見を受け継ぐなら、それは百科事典ではなく、検索バー付きのプロパガンダ機関です。それが役に立たないという意味ではありません。しかし、ユーザーは何を得ているのかを知る必要があります。Grokipediaに次のような切り替え機能があったらどうでしょう。

- 「標準モード」(バランスの取れた要約)

- 「Grokモード」(生の、フィルターなしのAIの見解)

- 「学術モード」(査読済みの情報源のみ)

そのような透明性があれば、より役立つものになるかもしれません。

SEO対決:Grokipedia vs. Wikipedia

技術的なSEOの観点から見ると、Wikipediaが優位に立つのは以下の理由からです。

- ドメインオーソリティが桁外れに高い

- すべてのページがロングテールキーワードに最適化されている

- 内部リンクが巧みである

- Googleが特集スニペットの情報源として信頼している

Grokipediaがウェブサイトとして存在する場合、AIを活用して以下を行わない限り、苦戦するでしょう。

- セマンティックなFAQセクションを自動生成する

- スキーママークアップを動的に更新する

- ユーザーごとにパーソナライズされた記事バージョンを作成する(ただし、これは共有可能性を損なう)

しかし、ここで重要なのは、Grokipediaのほとんどの使用はウェブサイト経由ではないということです。それは以下の方法で行われるでしょう。

- Grokチャットボット(X Premium上)

- アプリ内のAPI統合

- 音声アシスタント(「Grok、量子コンピューティングを説明して」)

そのような世界では、従来のSEOは重要ではなく、APIの信頼性と応答の品質が重要になります。そして、繰り返しになりますが、Apidogはそれを最適化するのに役立ちます。

今後の展望:可能性と落とし穴

では、Grokipediaは今後どうなるのでしょうか?早期採用者のためのニッチなツールとして終わる運命にあるのか、それともWikipediaの王座に挑戦する真のチャンスがあるのでしょうか?

破壊の可能性

- ニッチで新興のトピック:Wikipediaには注目度ガイドラインがあります。あなたの地元のインディーズバンドや超具体的なソフトウェアライブラリは、掲載基準を満たさないかもしれません。Grokipediaは、これらのトピックに関する有用な記事を瞬時に生成し、大きなギャップを埋めることができます。

- 学習と説明:その会話スタイルは、強力な学習ツールとなる可能性があります。複雑な科学的または哲学的な概念を、より分かりやすい方法で説明できます。

- 「生きている百科事典」:世界の出来事とともにリアルタイムで更新される知識ベースの約束は、信じられないほど魅力的です。最新の進路や被害報告を含む、発達中のハリケーンに関する記事を想像してみてください。

困難な課題

- 信頼の欠如:これがGrokipediaにとって最大の課題です。20年以上にわたってWikipediaが築き上げてきたのと同じレベルの信頼を、どのようにして構築するのでしょうか?幻覚の問題を解決し、情報源の透明性を高めることは不可欠です。

- 収益化と持続可能性:Wikipediaは寄付によって運営されています。Grokipediaはどのようにして持続するのでしょうか?広告?サブスクリプションモデル?XやxAIとの関連性は、より大きなエコシステムの一部である可能性を示唆していますが、その長期的なビジネスモデルは不明確です。

- コミュニティの構築:Wikipediaの秘訣はソフトウェアではありません。そのコミュニティです。Grokipediaは現在、一方通行です。AIが生成したものを消費するだけです。AIの出力を導き、修正し、検証するための人間の監視者コミュニティを構築できるでしょうか?ハイブリッドモデルが最善の道かもしれません。

結論:Grokipediaを使うべきか?

2025年後半現在、公式のGrokipediaは存在しません。存在するものは次の通りです。

- コンセプト

- ファン作成のデモ

- 憶測に満ちたテクノロジー記事

とはいえ、そのアイデアは強力であり、おそらく避けられないものです。xAIまたは競合他社が、リアルタイムのAIネイティブ知識ベースを1〜2年以内に立ち上げることを期待してください。

それまでは:

- 検証済みの詳細な知識にはWikipediaを使用する

- 迅速な状況把握にはGrok(X Premium経由)を使用する

- AIの出力を聖典として扱わない—常に相互参照する

- 開発者であれば、責任を持ってプロトタイプを作成する—そして、統合が堅牢であることを保証するためにApidogのようなツールを使用する

最終的な評決:Grokipediaは未来なのか?

この詳細な考察の後、私の結論はこうです。

Grokipediaはまだ「Wikipediaキラー」ではなく、直接的な意味で「イーロン・マスクのWikipedia」と呼ぶのは誤解を招きます。しかし、それを無視するのは間違いでしょう。それは、おそらくもっと重要な何か、つまり知識がどのように創造され、配布されるかを私たちが想像する方法における根本的な変化を表しています。

Wikipediaは、Web 2.0の人間協調モデルの頂点を表しています。Grokipediaは、大胆で欠点はあるものの、Web3/AIネイティブモデルの魅力的で初期段階のプロトタイプです。

今のところ、学術研究や唯一の真実の情報源としてGrokipediaを信頼することはありません。微妙なエラーのリスクがまだ高すぎます。人間中心で情報源が検証可能なモデルを持つWikipediaは、真剣な調査のためのより信頼できるリソースであり続けています。

しかし、Grokipediaは、トピックの迅速で読みやすい概要を得るため、ニッチな主題を探求するため、そしてAIが知識キュレーションという複雑なタスクにどのように取り組み始めているかを見るための素晴らしいツールです。それは、情報とのインタラクションがよりダイナミックで即時的になる未来の片鱗を垣間見せてくれます。

理想的なシナリオは、どちらかのプラットフォームが「勝利する」ことではなく、両方のモデルが共存し、互いに学び合う未来かもしれません。おそらくWikipediaは、編集者がコンテンツをより速く作成するのを助けるためにAIツールを統合するでしょう。おそらくGrokipediaは、正確性を向上させるために人間のフィードバックレイヤーを統合するでしょう。

では、Grokipediaを使うべきでしょうか?もちろんです。探求し、その限界を試し、その出力に批判的になりましょう。しかし、それが何であるかを見てください。それは、百科事典の次の進化における強力な初期段階の実験です。知識に関する会話は変化しており、Grokipediaは非常に興味深い新しい声をその議論に投げかけたばかりです。