あるチームは、アプリケーションコードの生成をAIに大きく依存していました。これは現在「バイブコーディング」と呼ばれる行為です。デプロイから1週間以内に、彼らのサーバーは侵害されました。このインシデントを共有した開発者は、脆弱性が予測可能だったため、攻撃ベクトルを即座に推測できました。この記事では、何が問題だったのか、AI生成コードがセキュリティの悪用に対してなぜ特に脆弱なのかを解説し、AI支援プロジェクトを本番環境に投入する前に保護するための具体的なチェックリストを提供します。

ボタン

インシデント:何が起こったのか

この話は2026年1月にRedditのr/webdevコミュニティに投稿され、すぐに400以上の高評価を獲得し、激しい議論を巻き起こしました。ある開発者が、同僚2人が「バイブコーディング」—ChatGPT、Claude、CursorなどのAIコード生成ツールを使用して、手作業でのレビューを最小限に抑えながらアプリケーションを迅速に構築する手法—を採用した際に、自社で何が起こったかを共有しました。

チームは興奮していました。彼らは迅速にリリースしました。AIはデータベースクエリから認証フローまで、すべてを処理しました。デプロイの時期が来ると、AIは最初のリリースにバージョン番号「16.0.0」を提案しました—この詳細は後に暗い皮肉のように思われるでしょう。

デプロイから1週間後、サーバーはハッキングされました。

この話を共有した開発者は驚きませんでした。コードベースを見て、AIが導入した複数のセキュリティ脆弱性を即座に特定できました。攻撃者もそれらを見つけていたのです。

これは単独のインシデントではありません。セキュリティ研究者たちは、「合成された脆弱性」—言語モデルがどのように訓練され、コーディングタスクにどのようにアプローチするかという理由から、AI生成コードにほぼ独占的に現れるセキュリティ上の欠陥—について警告してきました。

AI生成コードが脆弱である理由

AIコーディングアシスタントは、膨大なパブリックコードのリポジトリで訓練されています。これにより、いくつかのセキュリティ上の盲点が生まれます。

1. 訓練データに脆弱なコードが含まれている

GitHub、Stack Overflow、およびチュートリアルウェブサイトには、何百万行もの安全でないコードが含まれています。学習目的で書かれた例は、セキュリティに関する考慮事項を省略していることがよくあります。非推奨のパターンは訓練データに残っています。AIはこれらすべてを等しく学習します。

AIに認証コードを書くように依頼すると、CSRF保護が欠けていた2018年のチュートリアルからのパターンや、単純化のためにパスワードを平文で保存していたStack Overflowの回答を再現する可能性があります。

2. AIは「安全」ではなく「動作すること」を最適化する

言語モデルは、プロンプトを満たすコードを生成します。ログインエンドポイントを要求すれば、AIはユーザーをログインさせるものを作成します。その実装がSQLインジェクションに耐えるか、パスワードを適切にハッシュ化するか、セッショントークンを検証するかは、主要な目標にとって二次的なことです。

これは、経験豊富な開発者の考え方とは根本的に異なります。セキュリティ意識の高い開発者は、各ステップで「これはどのように悪用される可能性があるか?」と問いかけます。AIアシスタントは、この敵対的な考え方を自然には適用しません。

3. コンテキストウィンドウの制限が全体的なセキュリティを妨げる

セキュリティ脆弱性は、しばしばコンポーネント間の相互作用から生じます。あるファイルに認証チェックが存在し、別のファイルのデータベースクエリが認証が既に行われたと仮定している場合があります。AIがファイルごと、または関数ごとにコードを生成する場合、常にこのセキュリティコンテキストを維持できるとは限りません。

4. 開発者はAIの出力に過度に依存しすぎる

これは人間的要因です。自信があり有能に見えるAIからコードが提供されると、開発者はジュニアチームメンバーからのコードに対して行うような慎重なレビューをスキップしがちです。「バイブコーディング」のアプローチは、これを明確に受け入れています:素早く生成し、素早く出荷し、後で修正する。

問題は、攻撃者が最初にセキュリティ脆弱性を見つけてしまうと、しばしば「後で修正する」ことができない点です。

AI生成APIにおける最も一般的な7つのセキュリティホール

AI生成コードリポジトリとセキュリティ監査の分析に基づくと、以下の脆弱性が最も頻繁に現れます。

1. 入力検証の欠如または不十分さ

AI生成のエンドポイントは、サニタイズなしにユーザー入力を直接受け入れることがよくあります。

// AI-generated: Vulnerable to injection

app.post('/search', (req, res) => {

const query = req.body.searchTerm;

db.query(`SELECT * FROM products WHERE name LIKE '%${query}%'`);

});

修正には、パラメータ化されたクエリ、入力長の制限、および文字の検証が必要です—これらはAIがしばしば省略するステップです。

2. 壊れた認証フロー

一般的な問題は次のとおりです。

- トークンがhttpOnlyクッキーではなくlocalStorageに保存されている

- トークンの有効期限がない

- 脆弱または予測可能なセッションID

- ログイン試行に対するレート制限がない

- 有効期限のないパスワードリセットトークン

3. 過剰なデータ公開

AIは、特定のフィールドを選択するのではなく、データベースオブジェクト全体を返す傾向があります。

// AI-generated: Returns sensitive fields

app.get('/user/:id', (req, res) => {

const user = await User.findById(req.params.id);

res.json(user); // Includes passwordHash, internalNotes, etc.

});

4. 認証チェックの欠如

AIは動作するエンドポイントを作成しますが、リクエストしているユーザーが権限を持っているかどうかを確認するのを忘れます。

// AI-generated: No ownership verification

app.delete('/posts/:id', async (req, res) => {

await Post.deleteOne({ _id: req.params.id });

res.json({ success: true });

});

// Any authenticated user can delete any post

5. 安全でない依存関係

AIは、既知の脆弱性をチェックすることなく、人気のあるパッケージを提案することがよくあります。

// AI suggests outdated package with CVEs

const jwt = require('jsonwebtoken'); // Version not specified

明示的なバージョン固定と脆弱性スキャンがなければ、プロジェクトは初日からセキュリティ負債を抱えることになります。

6. ハードコードされたシークレットと認証情報

これはAI生成コードで驚くほど頻繁に現れます。

// AI-generated: Secret in source code

const stripe = require('stripe')('sk_live_abc123...');

AIは、説明目的でハードコードされたキーが一般的であるチュートリアルや例から学習します。

7. セキュリティヘッダーの欠如

AIが生成したExpress、Flask、またはRailsアプリケーションには、通常以下のものが欠けています。

- CORS設定(または過度に許容的なCORS)

- Content-Security-Policyヘッダー

- X-Frame-Options

- レート制限ミドルウェア

- HTTPSの強制

AIアシストプロジェクトのためのセキュリティテストチェックリスト

AI生成コードを含むプロジェクトをデプロイする前に、このチェックリストを確認してください。

認証と認可

- [ ] すべてのエンドポイントは、適切な場所で認証を要求する

- [ ] 認可チェックは、ユーザーが要求されたリソースを所有しているか、アクセスできるかを確認する

- [ ] パスワードはbcrypt、Argon2、または同様のもの(コストファクター≥10)でハッシュ化されている

- [ ] セッショントークンは暗号学的にランダムであり、有効期限がある

- [ ] ログイン失敗の試行にはレート制限がある

- [ ] パスワードリセットトークンは使い捨てで時間制限がある

- [ ] JWTには有効期限が含まれており、サーバー側で検証される

入力検証

- [ ] すべてのユーザー入力は、タイプ、長さ、およびフォーマットが検証されている

- [ ] データベースクエリはパラメータ化されたステートメントを使用する

- [ ] ファイルアップロードは、タイプ、サイズを検証し、マルウェアをスキャンする

- [ ] URLとリダイレクトは許可リストに対して検証される

- [ ] JSON/XMLパーサーにはサイズ制限が設定されている

データ保護

- [ ] API応答は必要なフィールドのみを返す

- [ ] 機密データは保存時に暗号化されている

- [ ] データベースの認証情報はコードではなく環境変数を使用する

- [ ] シークレットは適切なシークレット管理システムに保存されている

- [ ] ログにはパスワード、トークン、または個人識別情報(PII)が含まれていない

トランスポートセキュリティ

- [ ] 本番環境ではHTTPSが強制されている

- [ ] HSTSヘッダーが設定されている

- [ ] TLS 1.2+が必要である

- [ ] 安全なクッキーにはSecureおよびHttpOnlyフラグがある

API固有のセキュリティ

- [ ] レート制限により乱用が防止される

- [ ] CORSは特定のオリジンに対して設定されており、

*ではない - [ ] APIバージョニングにより、安全でないエンドポイントを非推奨にできる

- [ ] エラーメッセージは内部の詳細情報を漏洩しない

- [ ] GraphQLにはクエリの深さ/複雑さの制限がある

依存関係

- [ ] すべてのパッケージには特定のバージョンピンが設定されている

- [ ]

npm audit/pip check/ または類似のツールで重大な脆弱性が表示されない - [ ] 依存関係の自動更新が設定されている

- [ ] 放棄または保守されていないパッケージがない

デプロイ前にAPIセキュリティをテストする方法

手動レビューだけでは不十分です。AIが導入し、あなたのレビューで見逃した脆弱性を捕捉する体系的なテストが必要です。

ステップ1:自動セキュリティスキャン

一般的な脆弱性を発見するために設計されたツールを使用してください。

# For Node.js projects

npm audit --audit-level=high

# For Python projects

pip-audit

# For container images

trivy image your-app:latest

ステップ2:APIセキュリティテスト

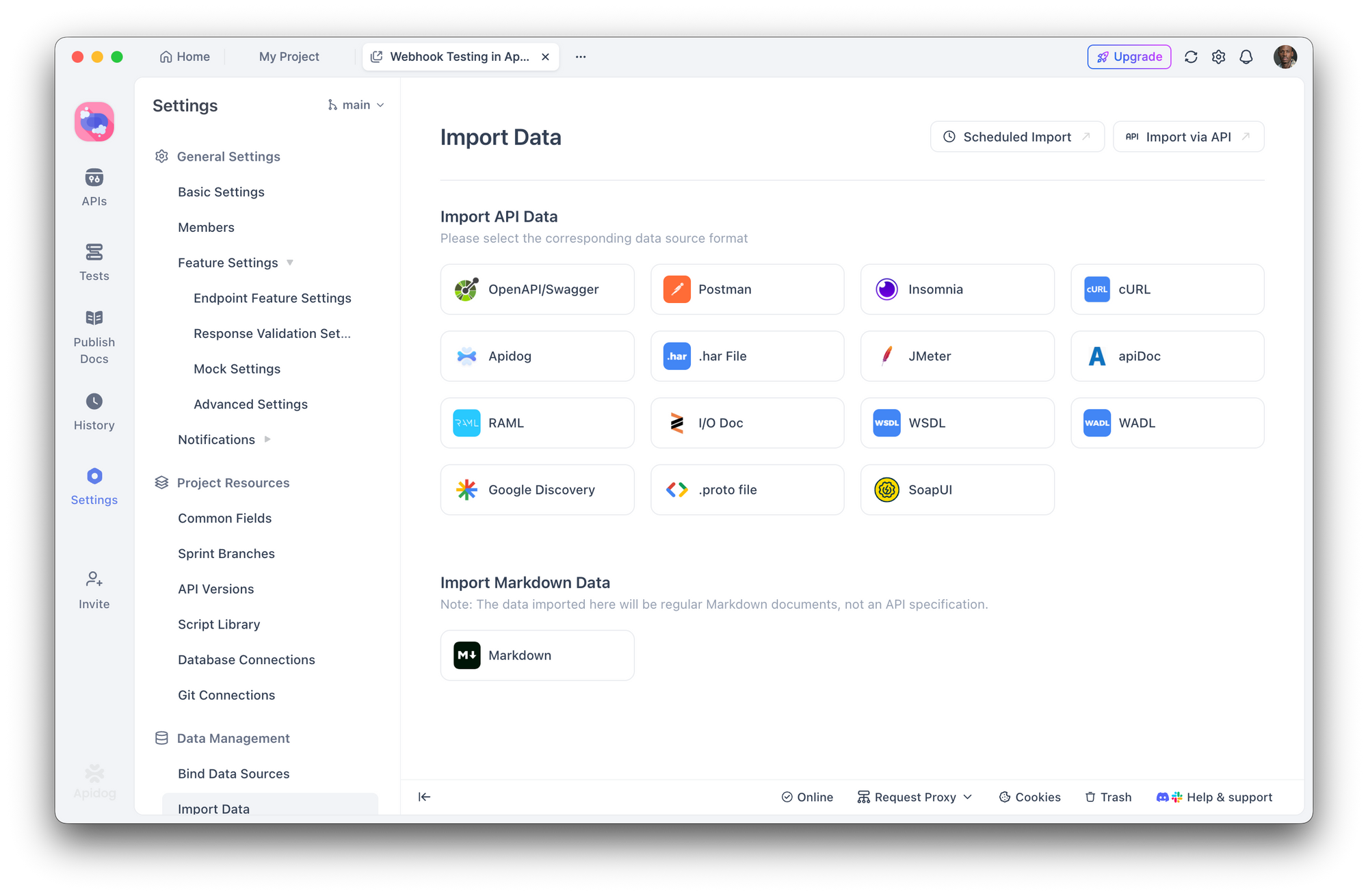

ここでApidogが不可欠になります。各エンドポイントを手動でテストする代わりに、次のことができます。

- API仕様をインポートする(OpenAPI/Swagger)か、Apidogにエンドポイントを検出させる

2. 次を確認するセキュリティテストシナリオを作成する:

- 認証がない場合は401を返す

- 不正なユーザーがリソースにアクセスした場合は403を返す

- 無効な入力の場合は安全なエラーメッセージとともに400を返す

- SQLインジェクションの試みがブロックされる

- 各デプロイメントの前に自動テストスイートを実行する

- CI/CDと統合し、リグレッションを捕捉する

Apidogのビジュアルテストビルダーを使用すれば、セキュリティテストを一から書く必要はありません。「応答に「password」が含まれていないこと」や「認証トークンなしのリクエストは401を返すこと」といったアサーションを定義し、APIの全範囲にわたって実行できます。

ステップ3:ペネトレーションテストシミュレーション

攻撃者のようにAPIをテストしてください。

- エンドポイントを列挙する - 隠された、または文書化されていないルートはないか?

- 認証バイパスをテストする - 有効なトークンなしで保護されたルートにアクセスできるか?

- インジェクション攻撃を試みる - すべての入力フィールドでSQL、NoSQL、コマンドインジェクションを試す

- IDOR(不適切なオブジェクト参照)を確認する - ユーザーAがIDを変更してユーザーBのデータにアクセスできるか?

- レート制限を悪用する - 毎秒1000リクエストを送信するとどうなるか?

Apidogのテストシナリオを使用すると、これらの攻撃を体系的にシミュレートし、デプロイメント間の比較のために結果を保存できます。

ステップ4:セキュリティヘッダー監査

応答ヘッダーを確認してください。

curl -I https://your-api.com/endpoint

次のものを探してください。

Strict-Transport-SecurityX-Content-Type-Options: nosniffX-Frame-Options: DENYContent-Security-Policy

AIツールを用いたセキュリティファーストのワークフローの構築

AIコーディングアシスタントはなくなることはないでしょう—むしろ、ますます強力になっています。解決策はそれらを避けることではなく、ワークフローにセキュリティを組み込むことです。

セキュリティのためのプロンプトエンジニアリング

AIを使用してコードを生成する際は、セキュリティに関する考慮事項を明示的に要求してください。

代わりに:

「ユーザー登録エンドポイントを作成する」

尋ねる:

「入力検証、コストファクター12のbcryptを使用したパスワードハッシュ化、タイミング攻撃からの保護、レート制限、およびメールの存在情報を漏洩しない適切なエラー処理を備えたユーザー登録エンドポイントを作成する」

必須のレビュー段階

AI生成コードが通過しなければならないワークフローを確立してください。

- 人間によるレビュー - このコードは意図したとおりに動作するか?

- 自動リンティング - セキュリティプラグインを備えたESLint、Pylint

- セキュリティスキャン - Snyk, npm audit, OWASP dependency check

- APIテスト - セキュリティ要件を検証するApidogテストスイート

- ステージングデプロイメント - 現実的な環境で統合テストを実行する

AIコードを信頼できない入力として扱う

これが重要な考え方の転換です。AIからのコードは、未知の貢献者からのコードと同じ懐疑心を持って扱われるべきです。レビューなしにランダムなプルリクエストからのコードをデプロイしますか?同じ基準をAI生成コードにも適用してください。

結論

デプロイから1週間後に発生したサーバーハックは、洗練された攻撃者やゼロデイエクスプロイトによって引き起こされたものではありませんでした。AIツールが日常的に導入し、「バイブコーディング」の実践が日常的に見逃す、一般的な脆弱性が原因でした。

AIコード生成は強力です。開発を加速させ、複雑なタスクを身近なものにします。しかし、体系的なセキュリティテストがなければ、そのスピードは負債となります。

Apidogのようなツールは、API全体でセキュリティ要件を定義し自動化することで、セキュリティテストを実用的なものにします。目標はAI支援開発を遅らせることではなく、AI生成コードが必要とする検証レイヤーを構築することです。ボタン

あなたのサーバーは、コードが人間によって書かれたかAIによって書かれたかを気にしません。ただ、そのコードが安全であるかどうかだけを気にします。