Pengembang dan penggemar AI semakin beralih ke model generatif yang kuat seperti Wan 2.2 untuk membuat video sinematik dari input sederhana. Model ini menonjol karena arsitektur Mixture-of-Experts (MoE) yang meningkatkan kapasitas tanpa mengorbankan kecepatan. Ketika Anda menggabungkan API Wan 2.2 (dengan LoRA), Anda mendapatkan kemampuan untuk menyempurnakan output untuk gaya atau gerakan tertentu, menjadikannya ideal untuk pembuatan video yang disesuaikan.

Apa Itu Wan 2.2?

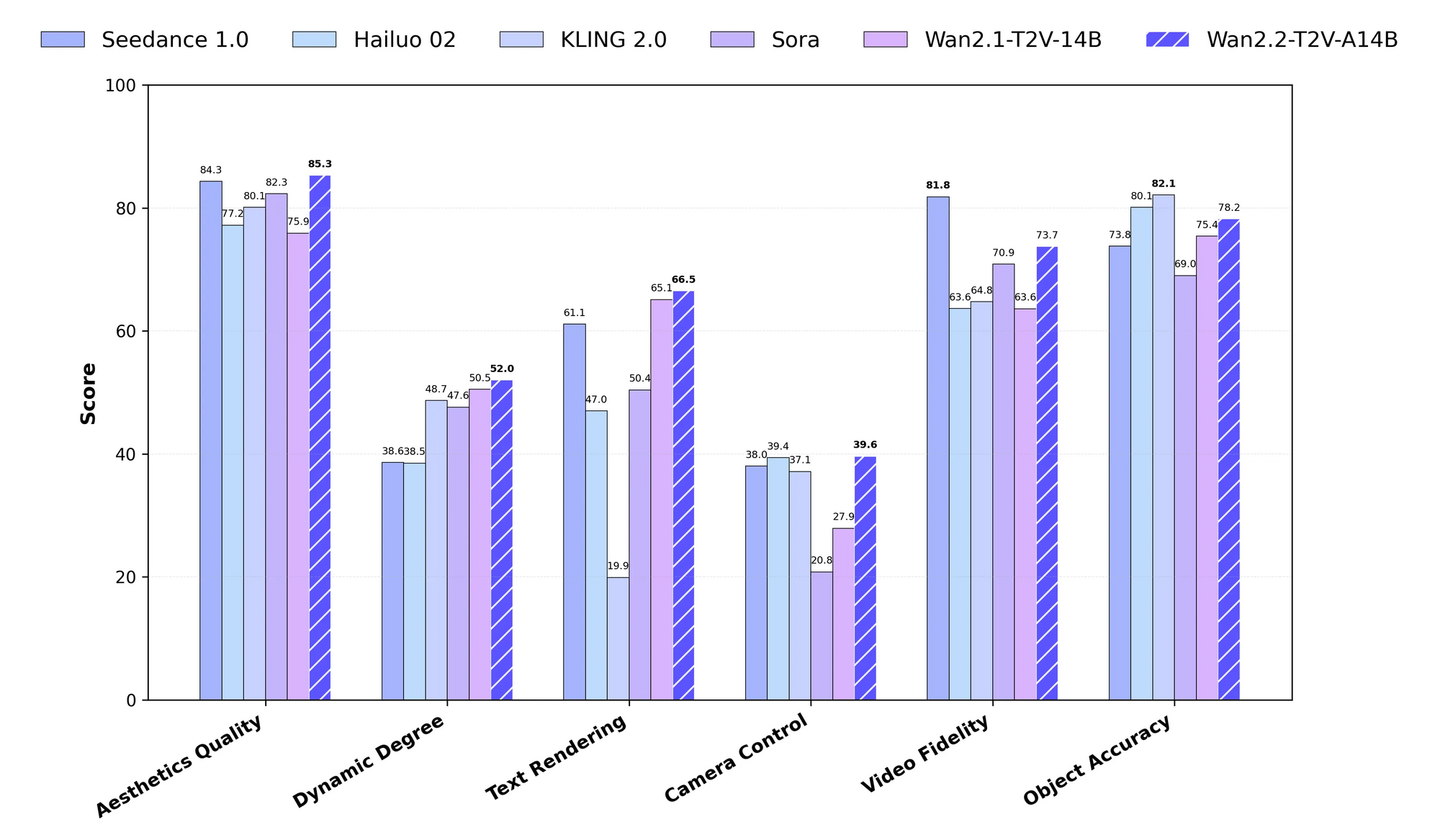

Wan 2.2 merupakan model generatif video skala besar sumber terbuka canggih yang dikembangkan oleh tim Wan. Para insinyur mendesainnya untuk menangani tugas-tugas kompleks seperti pembuatan teks-ke-video (T2V), gambar-ke-video (I2V), dan ucapan-ke-video (S2V). Model ini menggunakan kerangka kerja Mixture-of-Experts (MoE), yang membagi proses denoisifikasi dalam model difusi di antara para ahli khusus. Misalnya, ahli dengan noise tinggi mengelola timestep awal, sementara yang dengan noise rendah menyempurnakan tahap selanjutnya. Pendekatan ini menghasilkan total 27 miliar parameter, dengan hanya 14 miliar yang aktif per langkah inferensi, memastikan efisiensi.

Selain itu, Wan 2.2 menggabungkan estetika sinematik melalui kumpulan data terkualifikasi yang menekankan pencahayaan, komposisi, dan nada warna. Data pelatihan berkembang secara signifikan dari versi sebelumnya, termasuk 65,6% lebih banyak gambar dan 83,2% lebih banyak video, yang meningkatkan kompleksitas gerakan dan pemahaman semantik. Anda dapat mengakses varian seperti model TI2V berparameter 5B, yang menghasilkan video 720P pada 24 FPS pada perangkat keras konsumen seperti RTX 4090.

Aspek API terutama terwujud melalui skrip seperti generate.py di repositori resmi, tetapi platform hosting memperluasnya ke endpoint berbasis web. Oleh karena itu, Anda memilih antara eksekusi lokal untuk kontrol penuh atau layanan cloud untuk skalabilitas saat bekerja dengan API Wan 2.2 (dengan LoRA).

Apa Itu LoRA dalam Konteks Wan 2.2?

LoRA, atau Low-Rank Adaptation, berfungsi sebagai metode fine-tuning yang efisien parameter untuk model besar seperti Wan 2.2. Pengembang menerapkan LoRA untuk mengadaptasi model dasar ke kumpulan data spesifik tanpa melatih ulang seluruh arsitektur. Dalam Wan 2.2, LoRA menargetkan bobot transformer, memungkinkan Anda menyuntikkan gaya, karakter, atau gerakan kustom ke dalam pembuatan video.

Misalnya, Anda melatih LoRA pada kumpulan data bidikan orbital untuk mengkhususkan varian I2V dalam membuat gerakan kamera berputar. Dokumentasi resmi memperingatkan agar tidak menggunakan LoRA yang dilatih pada Wan 2.2 untuk tugas-tugas tertentu seperti animasi karena potensi ketidakstabilan, tetapi alat komunitas mengatasi hal ini. Platform seperti fal.ai mengintegrasikan LoRA langsung ke dalam API mereka, di mana Anda menentukan jalur ke bobot LoRA dan faktor penskalaan.

Akibatnya, menggabungkan LoRA ke dalam API Wan 2.2 (dengan LoRA) mengurangi biaya pelatihan dan memungkinkan kustomisasi cepat. Anda menggabungkan adaptor LoRA pada waktu inferensi, menjaga efisiensi model dasar sambil mencapai output yang ditargetkan.

Mengapa Menggunakan API Wan 2.2 dengan LoRA?

Anda memilih API Wan 2.2 (dengan LoRA) untuk menyeimbangkan kekuatan dan fleksibilitas dalam aplikasi AI video. Fine-tuning tradisional membutuhkan sumber daya besar, tetapi LoRA meminimalkan ini dengan hanya memperbarui matriks peringkat rendah. Metode ini mengurangi penggunaan memori dan waktu pelatihan, membuatnya dapat diakses oleh pengembang individu.

Selain itu, struktur MoE Wan 2.2 melengkapi LoRA dengan memungkinkan adaptasi spesifik ahli. Anda membuat video dengan estetika atau gerakan yang ditingkatkan yang sulit dihasilkan oleh model biasa. Misalnya, dalam pembuatan konten, Anda menggunakan LoRA untuk mempertahankan gaya karakter yang konsisten di seluruh adegan.

API yang di-hosting memperkuat manfaat ini dengan memindahkan komputasi ke cloud. Layanan seperti fal.ai menangani pekerjaan berat, sehingga Anda fokus pada prompt dan parameter. Oleh karena itu, kombinasi ini cocok untuk prototyping, produksi, dan eksperimen, terutama saat Anda mengintegrasikan alat seperti Apidog untuk manajemen API yang mulus.

Bagaimana Cara Menyiapkan Lingkungan Anda untuk Penggunaan Lokal API Wan 2.2?

Anda memulai dengan mengkloning repositori Wan 2.2 dari GitHub. Jalankan perintah git clone https://github.com/Wan-Video/Wan2.2.git di terminal Anda, lalu navigasikan ke direktori dengan cd Wan2.2. Selanjutnya, instal dependensi menggunakan pip install -r requirements.txt. Untuk tugas S2V, tambahkan pip install -r requirements_s2v.txt.

Pastikan sistem Anda menjalankan PyTorch versi 2.4.0 atau lebih tinggi. Anda juga menginstal Hugging Face CLI dengan pip install "huggingface_hub[cli]" untuk unduhan model. Tetapkan variabel lingkungan jika Anda berencana menggunakan ekstensi prompt, seperti export DASH_API_KEY=your_key untuk integrasi Dashscope.

Untuk pengaturan multi-GPU, konfigurasikan Fully Sharded Data Parallel (FSDP) dan DeepSpeed Ulysses. Anda mengaktifkannya dengan flag seperti --dit_fsdp dan --ulysses_size 8. Pengguna GPU tunggal mengaktifkan optimisasi memori melalui --offload_model dan --convert_model_dtype. Pengaturan ini mempersiapkan Anda untuk menjalankan skrip generate.py, inti dari API Wan 2.2 lokal (dengan LoRA).

Bagaimana Cara Mengunduh dan Menginstal Model Wan 2.2?

Anda mengunduh model dari Hugging Face atau ModelScope. Untuk varian T2V-A14B, gunakan huggingface-cli download Wan-AI/Wan2.2-T2V-A14B --local-dir ./Wan2.2-T2V-A14B. Ulangi ini untuk varian lain seperti I2V-A14B atau TI2V-5B.

Tempatkan checkpoint di direktori yang sesuai. Model 14B membutuhkan VRAM yang substansial—sekitar 80GB untuk inferensi multi-GPU—sementara TI2V 5B cocok pada kartu 24GB. Setelah mengunduh, verifikasi file untuk menghindari kerusakan.

Jika Anda menemui masalah, beralihlah ke mirror ModelScope untuk wilayah dengan batasan akses. Langkah ini memastikan Anda memiliki model dasar yang siap sebelum menerapkan adaptor LoRA di API Wan 2.2 (dengan LoRA).

Bagaimana Cara Menggunakan Skrip Generate.py untuk Tugas Dasar di Wan 2.2?

Anda memanggil skrip generate.py untuk melakukan generasi. Untuk tugas T2V sederhana pada satu GPU, jalankan python generate.py --task t2v-A14B --size 1280x720 --ckpt_dir ./Wan2.2-T2V-A14B --offload_model True --convert_model_dtype --prompt "Two anthropomorphic cats in comfy boxing gear fight intensely on a spotlighted stage.".

Sesuaikan parameter untuk mode lain. Dalam I2V, tambahkan --image examples/i2v_input.JPG. Untuk S2V, sertakan --audio examples/audio_input.wav dan aktifkan TTS dengan --enable_tts. Eksekusi multi-GPU menggunakan torchrun --nproc_per_node=8 generate.py dengan flag FSDP.

Perintah-perintah ini membentuk tulang punggung API Wan 2.2 lokal (dengan LoRA). Anda bereksperimen dengan prompt dan ukuran untuk menyempurnakan output, beralih dengan mulus ke integrasi LoRA untuk kustomisasi tingkat lanjut.

Bagaimana Cara Melatih LoRA untuk Wan 2.2?

Anda melatih LoRA menggunakan alat komunitas seperti AI Toolkit atau trainer Trooper.AI. Pertama, siapkan kumpulan data Anda—kurasi video atau gambar yang selaras dengan gaya target Anda. Untuk LoRA I2V, fokuslah pada klip spesifik gerakan seperti bidikan orbital.

Siapkan lingkungan trainer pada platform seperti RunPod untuk akses GPU. Muat bobot dasar Wan 2.2 ke direktori yang diharapkan. Konfigurasikan hyperparameter: atur tingkat pembelajaran ke 1e-5, ukuran batch ke 1, dan epoch ke 10-20 tergantung pada ukuran kumpulan data.

Jalankan skrip pelatihan, pantau metrik kerugian. Alat seperti pustaka PEFT dari Hugging Face memfasilitasi ini, memungkinkan Anda menyimpan LoRA sebagai file .safetensors. Setelah dilatih, Anda menerapkan adaptor ini dalam generasi, meningkatkan API Wan 2.2 (dengan LoRA) untuk tugas-tugas khusus.

Bagaimana Cara Menerapkan LoRA dalam Generasi Lokal Wan 2.2?

Anda mengintegrasikan LoRA dalam pengaturan lokal melalui ComfyUI atau skrip kustom. Di ComfyUI, gunakan node LoadLoRAModelOnly antara pemuat model dan sampler. Tentukan jalur LoRA dan kekuatannya (misalnya, 0.8).

Untuk generate.py, fork komunitas atau ekstensi menambahkan dukungan LoRA, karena versi resminya tidak memiliki integrasi langsung. Alternatifnya, gunakan pipeline Diffusers untuk mode animasi, memuat LoRA dengan pipe.load_lora_weights("path/to/lora").

Aplikasi ini mengubah output standar menjadi video yang disesuaikan. Oleh karena itu, Anda mencapai konsistensi dalam gaya atau gerakan, menjadikan API Wan 2.2 (dengan LoRA) lebih serbaguna untuk penggunaan produksi.

Apa Saja Layanan Hosting Terbaik untuk API Wan 2.2 dengan LoRA?

Anda mengakses API Wan 2.2 (dengan LoRA) yang di-hosting melalui platform seperti fal.ai. Endpoint mereka di https://api.fal.ai/v1/fal-ai/wan/v2.2-a14b/text-to-video/lora mendukung LoRA secara native. Daftar untuk mendapatkan kunci API dan konfigurasikan di klien Anda.

Layanan lain termasuk WaveSpeed.ai untuk LoRA I2V dan Trooper.AI untuk pelatihan. Ini menghilangkan kebutuhan perangkat keras lokal, meningkatkan resolusi tinggi dengan mudah. Akibatnya, Anda membuat prototipe lebih cepat, berintegrasi dengan alat seperti Apidog untuk manajemen permintaan.

Bagaimana Cara Mengautentikasi dan Mengirim Permintaan ke API fal.ai Wan 2.2?

Anda mengautentikasi dengan menetapkan variabel lingkungan FAL_KEY. Instal klien fal-ai dengan npm install --save @fal-ai/client untuk JavaScript, atau gunakan yang setara dalam Python.

Kirim permintaan POST dengan payload JSON yang menyertakan prompt dan array loras. Contoh: {"prompt": "A cyberpunk cityscape at night", "loras": [{"path": "https://example.com/loras/cyberpunk.safetensors", "scale": 0.8}]}.

Pantau respons untuk URL video. Proses ini memanfaatkan API Wan 2.2 (dengan LoRA) di lingkungan cloud, memastikan kinerja yang andal.

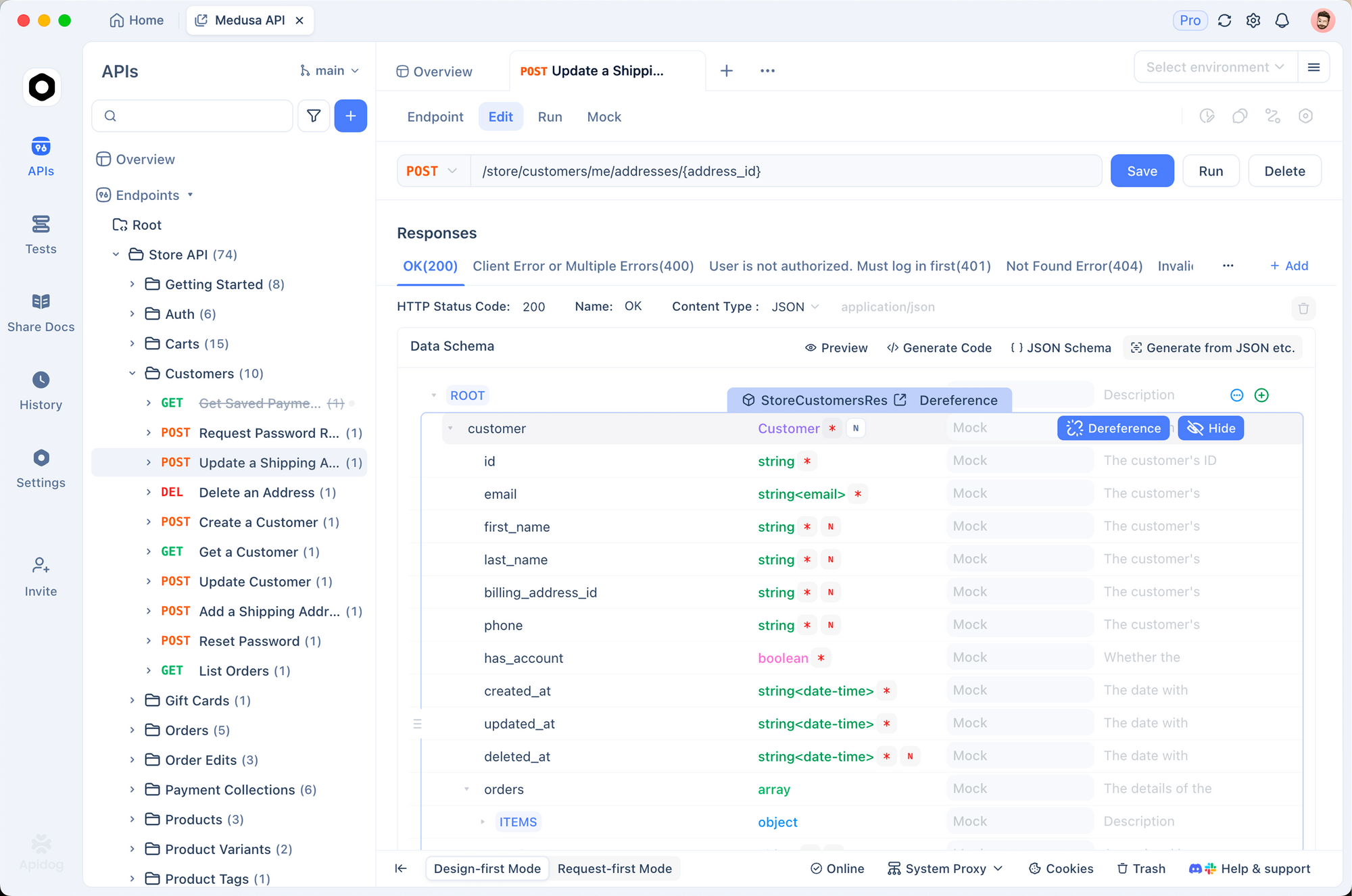

Bagaimana Cara Menggunakan Apidog untuk Menguji API Wan 2.2 dengan LoRA?

Anda memulai dengan menginstal Apidog dan membuat proyek API baru. Impor detail endpoint fal.ai, atur metode ke POST dan URL ke jalur LoRA text-to-video.

Tambahkan header untuk autentikasi, seperti Authorization: Key your_fal_key. Di tab body, buat JSON dengan parameter prompt dan LoRA. Kirim permintaan dan periksa respons, yang menyertakan tautan video yang dihasilkan.

Fitur Apidog seperti variabel lingkungan dan validasi respons memperlancar proses debugging. Misalnya, Anda menyimpan konfigurasi LoRA umum sebagai koleksi. Dengan demikian, Apidog meningkatkan alur kerja Anda saat menguji API Wan 2.2 (dengan LoRA), memungkinkan iterasi cepat.

Parameter Apa Saja yang Harus Anda Sesuaikan di API Wan 2.2 dengan LoRA?

Anda menyesuaikan parameter kunci untuk mengoptimalkan output. Atur num_inference_steps ke 27 untuk keseimbangan, atau lebih tinggi untuk kualitas. Skala panduan seperti 3.5 memengaruhi kepatuhan terhadap prompt.

Untuk LoRA, sesuaikan scale antara 0.5-1.0 untuk mengontrol kekuatan adaptor. Opsi resolusi termasuk 720p, sementara FPS berkisar dari 4-60. Aktifkan akselerasi untuk generasi yang lebih cepat, meskipun mungkin mengurangi fidelitas.

Selain itu, gunakan prompt negatif untuk menghindari elemen yang tidak diinginkan. Penyesuaian ini menyempurnakan API Wan 2.2 (dengan LoRA), beradaptasi dengan kebutuhan proyek spesifik.

Bagaimana Cara Menangani Input Multi-Modal di Wan 2.2 dengan LoRA?

Anda menggabungkan gambar atau audio dengan menentukan --image atau --audio dalam skrip lokal, atau bidang yang setara di API yang di-hosting. Terapkan LoRA untuk meningkatkan ini, seperti menata gaya output I2V.

Di fal.ai, tambahkan image_url untuk mode TI2V. LoRA mengadaptasi fusi, memastikan video yang koheren. Oleh karena itu, Anda membuat konten dinamis seperti karakter animasi, memanfaatkan potensi penuh API Wan 2.2 (dengan LoRA).

Apa Saja Teknik Optimisasi Tingkat Lanjut untuk Inferensi Wan 2.2?

Anda menggunakan optimisasi memori seperti offloading model dan konversi dtype untuk berjalan pada perangkat keras terbatas. Untuk multi-GPU, FSDP mendistribusikan shard secara efisien.

Dalam pengaturan yang di-hosting, antrekan permintaan asinkron untuk menangani batch. Gunakan ekspansi prompt dengan LLM untuk memperkaya input. Teknik-teknik ini mempercepat API Wan 2.2 (dengan LoRA), membuatnya cocok untuk aplikasi real-time.

Bagaimana Cara Mengintegrasikan API Wan 2.2 dengan LoRA ke dalam Aplikasi?

Anda membangun aplikasi dengan membungkus panggilan API dalam layanan backend. Misalnya, buat server Node.js yang memproksi permintaan fal.ai, menambahkan LoRA berdasarkan input pengguna.

Tangani webhook untuk pekerjaan yang berjalan lama, memberi tahu pengguna setelah selesai. Integrasikan dengan frontend untuk pembuatan video interaktif. Integrasi ini menyematkan API Wan 2.2 (dengan LoRA) ke dalam alat seperti platform konten.

Contoh Apa Saja yang Menunjukkan Wan 2.2 dengan LoRA dalam Tindakan?

Pertimbangkan untuk membuat adegan cyberpunk: Gunakan prompt "Jalanan bercahaya neon dengan mobil terbang" dan LoRA yang dilatih pada seni distopia. Outputnya menghasilkan video bergaya dengan detail yang ditingkatkan.

Contoh lain: Latih LoRA pada gerakan tari untuk S2V, menyinkronkan audio dengan koreografi. Kasus-kasus ini mengilustrasikan penggunaan praktis API Wan 2.2 (dengan LoRA).Bagaimana Cara Memecahkan Masalah Umum dengan API Wan 2.2 dan LoRA?

Anda mengatasi kesalahan kekurangan memori dengan mengaktifkan flag offload atau mengurangi resolusi. Jika LoRA menyebabkan ketidakstabilan, kurangi skala atau latih ulang dengan kumpulan data yang stabil.

Untuk kegagalan API, periksa autentikasi dan validitas parameter di Apidog. Masalah jaringan memerlukan logika percobaan ulang. Dengan demikian, Anda menyelesaikan masalah secara efisien, menjaga operasi tetap lancar dengan API Wan 2.2 (dengan LoRA).Pengembangan Masa Depan Apa yang Mungkin Memengaruhi Wan 2.2 dengan LoRA?

Para peneliti terus mengembangkan model difusi, berpotensi mengintegrasikan varian LoRA yang lebih efisien. Kontribusi komunitas mungkin menambahkan dukungan LoRA native ke skrip resmi.

Layanan hosting dapat memperluas modalitas. Tetap terbarui memastikan Anda memanfaatkan evolusi dalam API Wan 2.2 (dengan LoRA).

Kesimpulan

Anda sekarang memiliki pemahaman menyeluruh tentang cara mengakses dan menggunakan API Wan 2.2 (dengan LoRA). Dari pengaturan lokal hingga API yang di-hosting, dan dengan alat seperti Apidog, Anda dapat membuat video yang mengesankan. Terapkan teknik-teknik ini untuk berinovasi dalam pembuatan konten berbasis AI.