Menjalankan model bahasa besar (LLMs) secara lokal menawarkan privasi, kontrol, dan efisiensi biaya yang tak tertandingi. Model Gemma 3 QAT (Pelatihan yang Sadar Kuantisasi) dari Google, yang dioptimalkan untuk GPU konsumen, terintegrasi dengan mulus dengan Ollama, sebuah platform ringan untuk menerapkan LLMs. Panduan teknis ini membimbing Anda melalui pengaturan dan menjalankan Gemma 3 QAT dengan Ollama, memanfaatkan API untuk integrasi, dan pengujian dengan Apidog, alternatif unggul untuk alat pengujian API tradisional. Apakah Anda seorang pengembang atau penggemar AI, tutorial langkah demi langkah ini memastikan Anda memanfaatkan kemampuan multimodal Gemma 3 QAT secara efisien.

Mengapa Menjalankan Gemma 3 QAT dengan Ollama?

Model Gemma 3 QAT, tersedia dalam ukuran parameter 1B, 4B, 12B, dan 27B, dirancang untuk efisiensi. Berbeda dengan model standar, varian QAT menggunakan kuantisasi untuk mengurangi penggunaan memori (misalnya, ~15GB untuk 27B di MLX) sambil mempertahankan kinerja. Ini menjadikannya ideal untuk penerapan lokal pada perangkat keras yang sederhana. Ollama menyederhanakan proses dengan mengemas bobot model, konfigurasi, dan ketergantungan ke dalam format yang ramah pengguna. Bersama-sama, mereka menawarkan:

- Privasi: Simpan data sensitif di perangkat Anda.

- Penghematan Biaya: Hindari biaya API cloud yang berulang.

- Fleksibilitas: Kustomisasi dan integrasi dengan aplikasi lokal.

Selain itu, Apidog meningkatkan pengujian API, menyediakan antarmuka visual untuk memantau respons API Ollama, melampaui alat seperti Postman dalam kemudahan penggunaan dan debugging waktu nyata.

Prasyarat untuk Menjalankan Gemma 3 QAT dengan Ollama

Sebelum memulai, pastikan pengaturan Anda memenuhi persyaratan ini:

- Perangkat Keras: Komputer dengan GPU (NVIDIA lebih disukai) atau CPU yang kuat. Model yang lebih kecil (1B, 4B) dapat berjalan di perangkat yang kurang kuat, sementara 27B membutuhkan sumber daya yang signifikan.

- Sistem Operasi: macOS, Windows, atau Linux.

- Penyimpanan: Ruang yang cukup untuk unduhan model (misalnya, 27B membutuhkan ~8.1GB).

- Keterampilan Baris Perintah Dasar: Memahami perintah terminal.

- Koneksi Internet: Diperlukan awalnya untuk mengunduh Ollama dan model Gemma 3 QAT.

Selain itu, instal Apidog untuk menguji interaksi API. Antarmukanya yang disederhanakan menjadikannya pilihan yang lebih baik daripada perintah curl manual atau alat kompleks.

Panduan Langkah-demi-Langkah untuk Menginstal Ollama dan Gemma 3 QAT

Langkah 1: Instal Ollama

Ollama adalah tulang punggung dari pengaturan ini. Ikuti langkah-langkah ini untuk menginstalnya:

Unduh Ollama:

- Kunjungi ollama.com/download.

- Pilih penginstal untuk OS Anda (macOS, Windows, atau Linux).

- Untuk Linux, jalankan:

curl -fsSL https://ollama.com/install.sh | sh

Verifikasi Instalasi:

- Buka terminal dan jalankan:

ollama --version

- Pastikan Anda menggunakan versi 0.6.0 atau lebih tinggi, karena versi yang lebih lama mungkin tidak mendukung Gemma 3 QAT. Tingkatkan jika perlu melalui manajer paket Anda (misalnya, Homebrew di macOS).

Mulai Server Ollama:

- Jalankan server dengan:

ollama serve

- Server berjalan di

localhost:11434secara default, memungkinkan interaksi API.

Langkah 2: Tarik Model Gemma 3 QAT

Model Gemma 3 QAT tersedia dalam berbagai ukuran. Periksa daftar lengkap di ollama.com/library/gemma3/tags. Untuk panduan ini, kita akan menggunakan model 4B QAT karena keseimbangan antara kinerja dan efisiensi sumber daya.

Unduh Model:

- Di terminal baru, jalankan:

ollama pull gemma3:4b-it-qat

- Ini mengunduh model kuantisasi 4-bit 4B (~3.3GB). Harapkan proses ini memakan waktu beberapa menit, tergantung pada kecepatan internet Anda.

Verifikasi Unduhan:

- Daftar model yang tersedia:

ollama list

- Anda harus melihat

gemma3:4b-it-qatdalam keluaran, mengonfirmasi bahwa model sudah siap.

Langkah 3: Optimalkan untuk Kinerja (Opsional)

Untuk perangkat yang terbatas sumber daya, optimalkan model lebih lanjut:

- Jalankan:

ollama optimize gemma3:4b-it-qat --quantize q4_0

- Ini menerapkan kuantisasi tambahan, mengurangi jejak memori dengan kehilangan kualitas minimal.

Menjalankan Gemma 3 QAT: Mode Interaktif dan Integrasi API

Sekarang Ollama dan Gemma 3 QAT telah diatur, jelajahi dua cara untuk berinteraksi dengan model: mode interaktif dan integrasi API.

Mode Interaktif: Berbicara dengan Gemma 3 QAT

Mode interaktif Ollama memungkinkan Anda untuk bertanya kepada Gemma 3 QAT langsung dari terminal, ideal untuk pengujian cepat.

Mulai Mode Interaktif:

- Jalankan:

ollama run gemma3:4b-it-qat

- Ini memuat model dan membuka prompt.

Uji Model:

- Ketikkan sebuah pertanyaan, misalnya, “Jelaskan rekursi dalam pemrograman.”

- Gemma 3 QAT memberikan respons dengan jawaban yang rinci dan kontekstual, memanfaatkan jendela konteks 128K-nya.

Kemampuan Multimodal:

- Untuk tugas visi, berikan jalur gambar:

ollama run gemma3:4b-it-qat "Deskripsikan gambar ini: /path/to/image.png"

- Model memproses gambar dan mengembalikan deskripsi, menunjukkan keahliannya dalam multimodal.

Integrasi API: Membangun Aplikasi dengan Gemma 3 QAT

Bagi pengembang, API Ollama memungkinkan integrasi yang mulus ke dalam aplikasi. Gunakan Apidog untuk menguji dan mengoptimalkan interaksi ini.

Mulai Server API Ollama:

- Jika belum berjalan, jalankan:

ollama serve

Kirim Permintaan API:

- Gunakan perintah curl untuk menguji:

curl http://localhost:11434/api/generate -d '{"model": "gemma3:4b-it-qat", "prompt": "Apa ibu kota Prancis?"}'

- Responsnya adalah objek JSON yang berisi output Gemma 3 QAT, misalnya,

{"response": "Ibu kota Prancis adalah Paris."}.

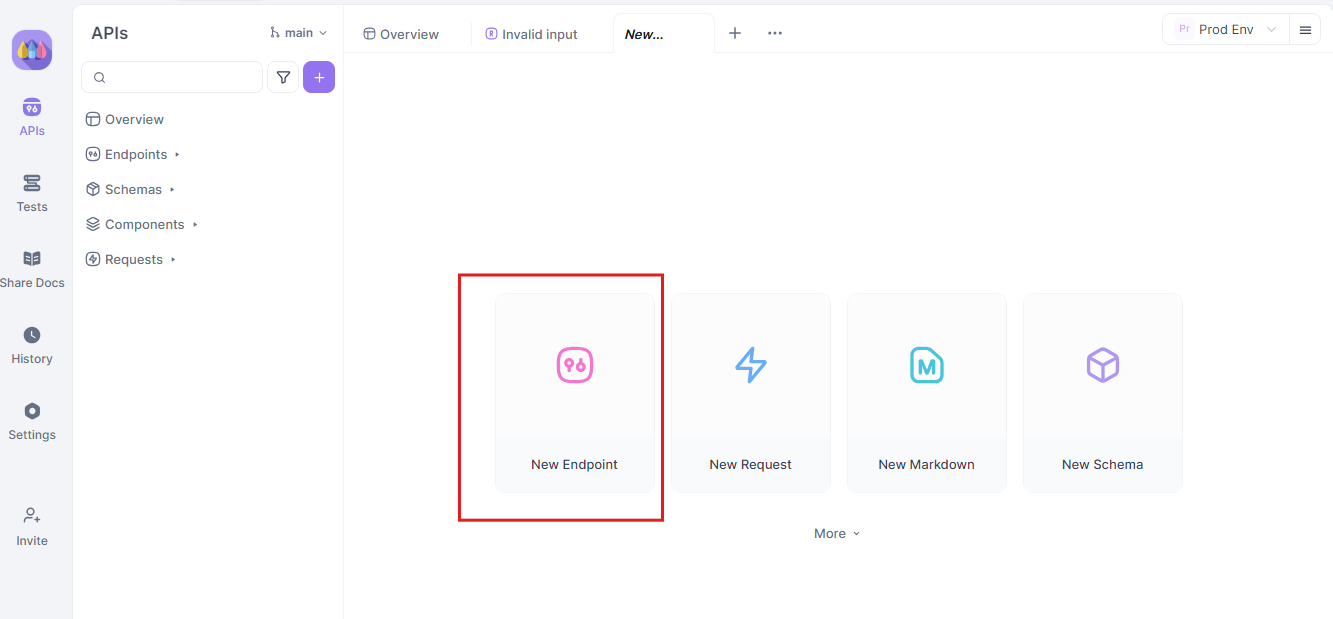

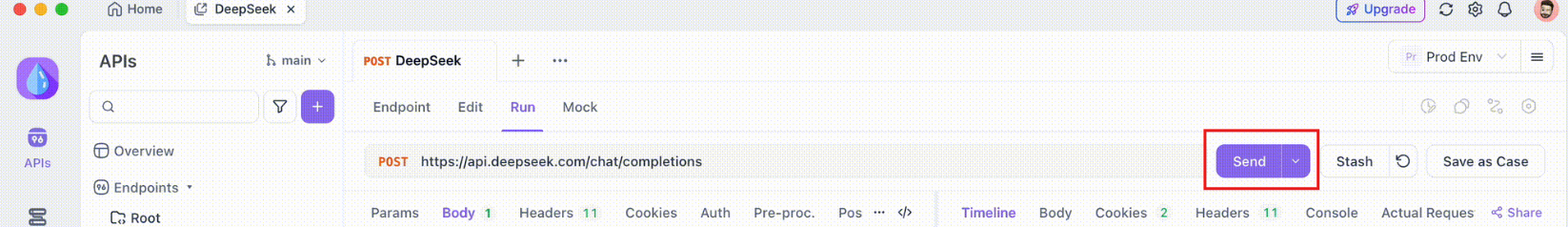

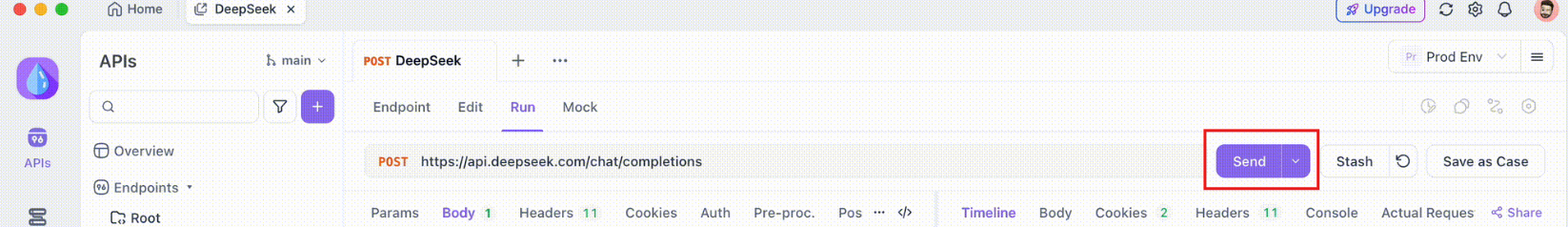

Uji dengan Apidog:

- Buka Apidog (unduh dari tombol di bawah).

- Buat permintaan API baru:

- Endpoint:

http://localhost:11434/api/generate

- Payload:

{

"model": "gemma3:4b-it-qat",

"prompt": "Jelaskan teori relativitas."

}

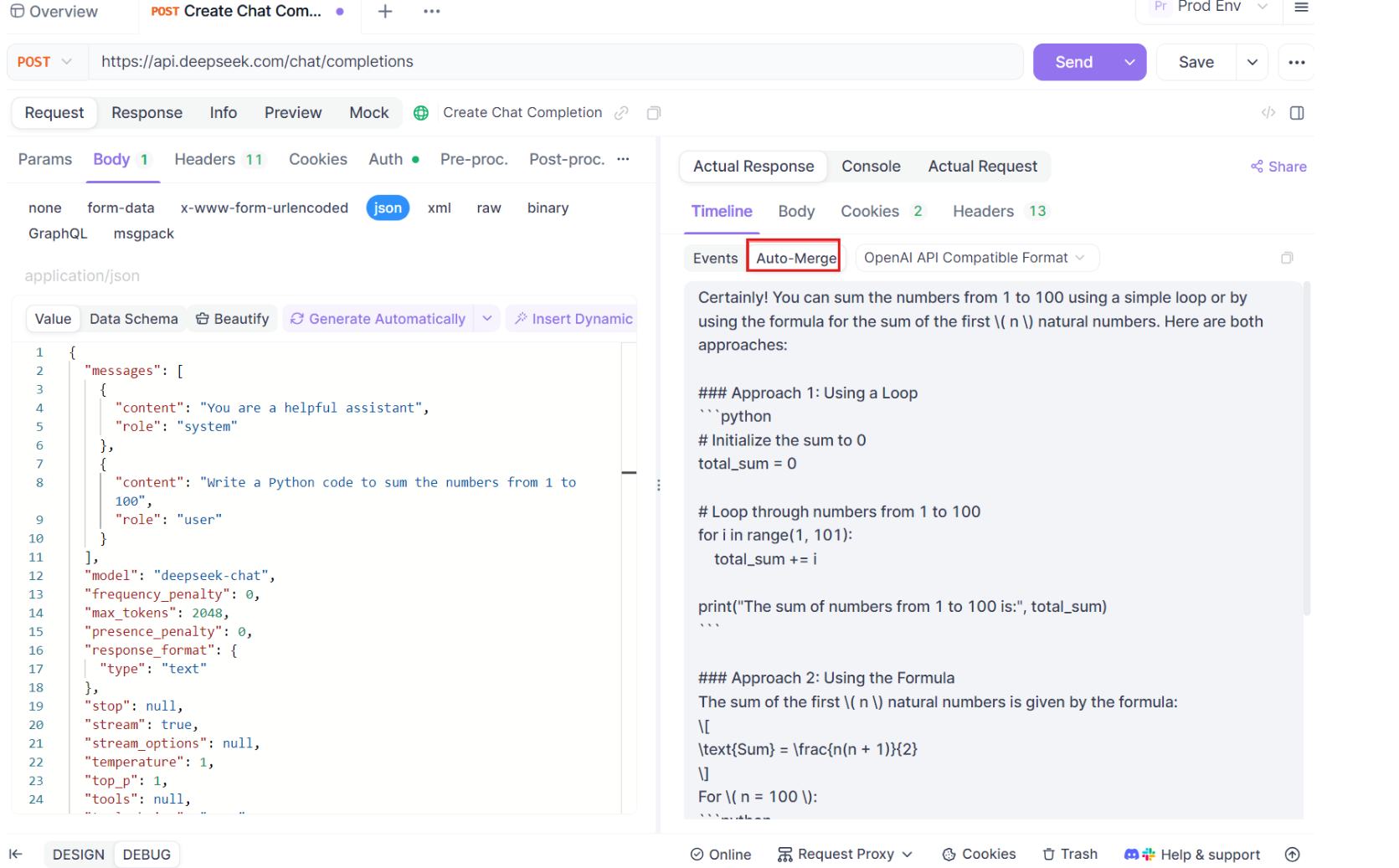

- Kirim permintaan dan pantau respons di timeline waktu nyata Apidog.

- Gunakan ekstraksi JSONPath Apidog untuk mengurai respons secara otomatis, fitur yang lebih unggul dibandingkan alat seperti Postman.

Respons Streaming:

- Untuk aplikasi waktu nyata, aktifkan streaming:

curl http://localhost:11434/api/generate -d '{"model": "gemma3:4b-it-qat", "prompt": "Tulis puisi tentang AI.", "stream": true}'

- Fitur Auto-Merge Apidog mengkonsolidasikan pesan yang dialirkan, menyederhanakan debugging.

Membangun Aplikasi Python dengan Ollama dan Gemma 3 QAT

Untuk menunjukkan penggunaan praktis, berikut adalah skrip Python yang mengintegrasikan Gemma 3 QAT melalui API Ollama. Skrip ini menggunakan pustaka ollama-python untuk kesederhanaan.

Instal Pustaka:

pip install ollama

Buat Skrip:

import ollama

def query_gemma(prompt):

response = ollama.chat(

model="gemma3:4b-it-qat",

messages=[{"role": "user", "content": prompt}]

)

return response["message"]["content"]

# Contoh penggunaan

prompt = "Apa manfaat menjalankan LLM secara lokal?"

print(query_gemma(prompt))

Jalankan Skrip:

- Simpan sebagai

gemma_app.pydan eksekusi:

python gemma_app.py

- Skrip ini mengajukan pertanyaan ke Gemma 3 QAT dan mencetak responsnya.

Uji dengan Apidog:

- Replikasi panggilan API di Apidog untuk memverifikasi output skrip.

- Gunakan antarmuka visual Apidog untuk menyesuaikan payload dan memantau kinerja, memastikan integrasi yang kuat.

Memecahkan Masalah Umum

Meski kesederhanaan Ollama, masalah mungkin muncul. Berikut adalah solusinya:

- Model Tidak Ditemukan:

- Pastikan Anda telah menarik model:

ollama pull gemma3:4b-it-qat

- Masalah Memori:

- Tutup aplikasi lain atau gunakan model yang lebih kecil (misalnya, 1B).

- Respons Lambat:

- Tingkatkan GPU Anda atau terapkan kuantisasi:

ollama optimize gemma3:4b-it-qat --quantize q4_0

- Kesalahan API:

- Verifikasi server Ollama berjalan di

localhost:11434. - Gunakan Apidog untuk debugging permintaan API, memanfaatkan pemantauan waktu nyata untuk menemukan masalah.

Untuk masalah yang persisten, konsultasikan komunitas Ollama atau sumber dukungan Apidog.

Tips Lanjutan untuk Mengoptimalkan Gemma 3 QAT

Untuk memaksimalkan kinerja:

Gunakan Akselerasi GPU:

- Pastikan Ollama mendeteksi GPU NVIDIA Anda:

nvidia-smi

- Jika tidak terdeteksi, instal ulang Ollama dengan dukungan CUDA.

Kustomisasi Model:

- Buat

Modelfileuntuk menyesuaikan parameter:

FROM gemma3:4b-it-qat

PARAMETER temperature 1

SYSTEM "Anda adalah asisten teknis."

- Terapkan:

ollama create custom-gemma -f Modelfile

Skala dengan Cloud:

- Untuk penggunaan perusahaan, terapkan Gemma 3 QAT di Google Cloud’s GKE dengan Ollama, menyesuaikan sumber daya sesuai kebutuhan.

Mengapa Apidog Menonjol

Sementara alat seperti Postman populer, Apidog menawarkan keunggulan yang berbeda:

- Antarmuka Visual: Menyederhanakan konfigurasi endpoint dan payload.

- Pemantauan Waktu Nyata: Melacak kinerja API secara instan.

- Auto-Merge untuk Streaming: Mengkonsolidasikan respons yang dialirkan, ideal untuk API Ollama.

- Ekstraksi JSONPath: Mengotomatiskan penguraian respons, menghemat waktu.

Unduh Apidog secara gratis di apidog.com untuk meningkatkan proyek Gemma 3 QAT Anda.

Kesimpulan

Menjalankan Gemma 3 QAT dengan Ollama memberdayakan pengembang untuk menerapkan LLM yang kuat dan multimodal secara lokal. Dengan mengikuti panduan ini, Anda telah menginstal Ollama, mengunduh Gemma 3 QAT, dan mengintegrasikannya melalui mode interaktif dan API. Apidog meningkatkan proses, menawarkan platform yang superior untuk menguji dan mengoptimalkan interaksi API. Baik membangun aplikasi atau bereksperimen dengan AI, pengaturan ini memberikan privasi, efisiensi, dan fleksibilitas. Mulailah menjelajahi Gemma 3 QAT hari ini, dan manfaatkan Apidog untuk memperlancar alur kerja Anda.