Pengembang terus mencari model bahasa yang efisien dan berkinerja tinggi untuk membangun aplikasi cerdas. API MiniMax M2.1 menonjol sebagai opsi yang tangguh, terutama untuk alur kerja agen dan tugas pengodean yang kompleks.

Anda memulai dengan memahami model itu sendiri. Selanjutnya, Anda menjelajahi metode akses. Terakhir, Anda menerapkan integrasi praktis.

Apa itu MiniMax M2.1 dan Mengapa Menggunakan API-nya?

MiniMax M2.1 mewakili kemajuan terbaru dari MiniMax AI, dirilis sebagai model sumber terbuka yang dioptimalkan untuk kemampuan agen. Pengembang memanfaatkannya untuk membuat aplikasi otonom yang menangani pengembangan perangkat lunak multibahasa, perencanaan multi-langkah, dan penggunaan alat dengan ketahanan yang luar biasa.

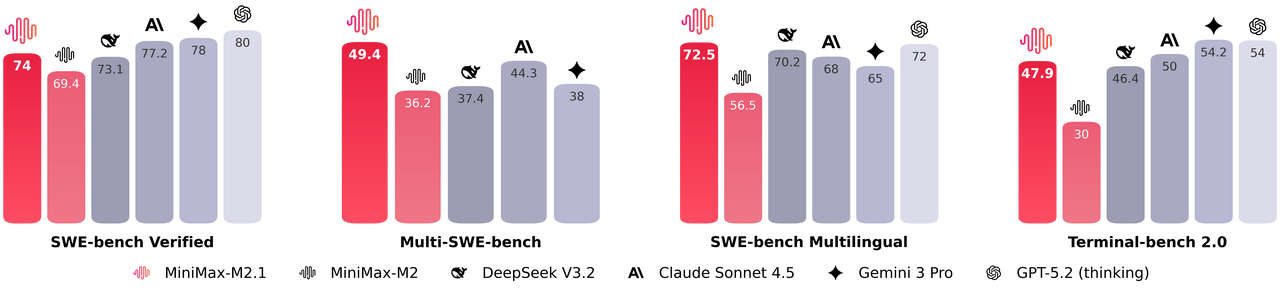

Selain itu, MiniMax M2.1 mengaktifkan serangkaian parameter ringkas selama inferensi, memberikan kinerja mendekati batas sambil menjaga latensi rendah. Model ini unggul dalam tolok ukur seperti SWE-bench Verified dan VIBE, seringkali menyamai atau melampaui model proprietary dalam stabilitas pengodean dan mengikuti instruksi. Selain itu, model ini mendukung demonstrasi canggih, termasuk menghasilkan animasi 3D interaktif, aplikasi seluler asli, dan dasbor data real-time.

Anda memilih MiniMax M2.1 ketika Anda membutuhkan transparansi dan kontrol. Terlebih lagi, bobot sumber terbukanya memungkinkan penyebaran lokal melalui Hugging Face, tetapi API yang di-hosting menawarkan akses instan tanpa pengelolaan infrastruktur.

MiniMax M2.1 vs GLM-4.7: Model Mana yang Sesuai dengan Kebutuhan Anda?

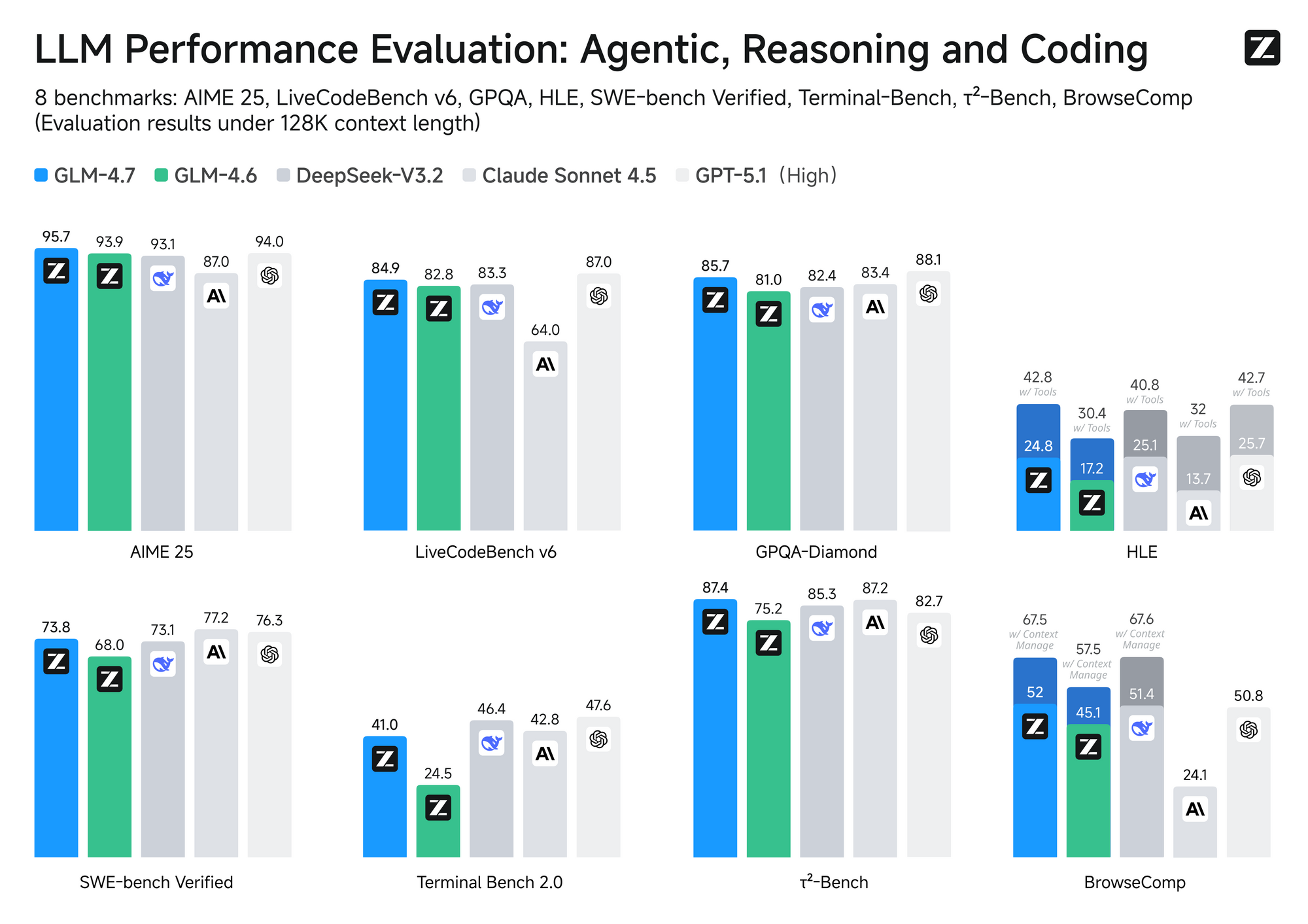

Pengembang sering membandingkan MiniMax M2.1 dengan GLM-4.7, pesaing open-weight terkemuka lainnya dari Z.ai. Kedua model menargetkan pengodean dan penalaran, namun keduanya berbeda dalam arsitektur, efisiensi, dan biaya.

MiniMax M2.1 menggunakan desain Mixture-of-Experts (MoE) dengan aktivasi selektif—biasanya sekitar 10B parameter aktif dari kumpulan yang lebih besar. Pendekatan ini memastikan inferensi yang cepat dan biaya operasional yang lebih rendah. Sebaliknya, GLM-4.7 memanfaatkan MoE penuh dengan 358B parameter, mendukung jendela konteks 200K token yang masif dan fitur-fitur asli seperti kontrol pemikiran tingkat giliran.

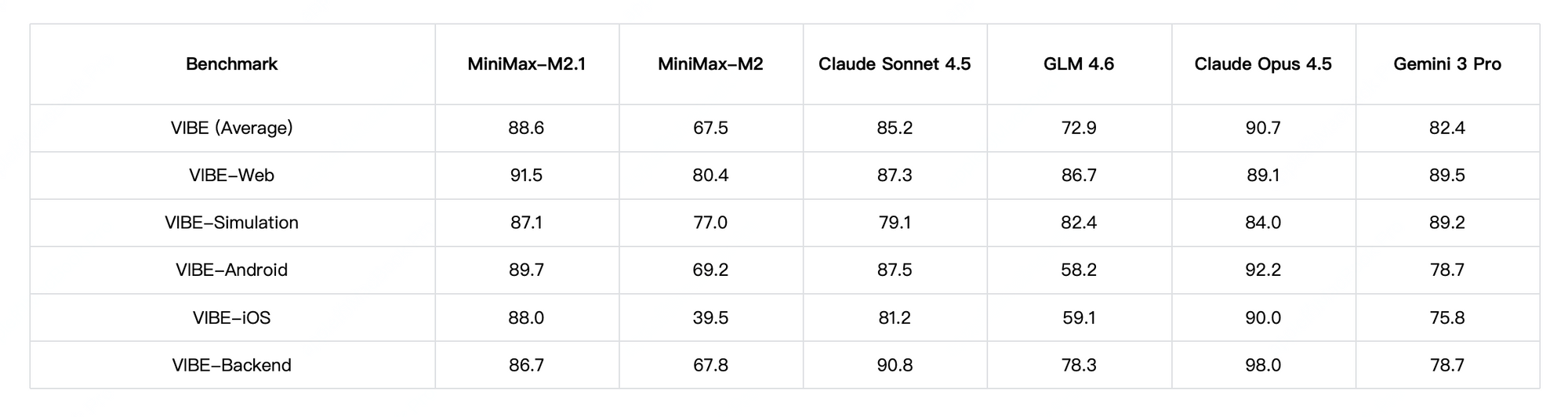

Dari segi kinerja, MiniMax M2.1 unggul dalam tugas-tugas agen dan perencanaan jangka panjang, mencapai skor tinggi pada VIBE (rata-rata 88,6) dan menunjukkan stabilitas superior dalam penggunaan alat. Tes komunitas menunjukkan bahwa ia mengungguli versi GLM sebelumnya dalam pengodean kreatif dan otonomi multi-alat. Namun, GLM-4.7 lebih unggul dalam tolok ukur penalaran murni dan keluaran terstruktur, dengan hasil kuat pada SWE-bench (73,8%).

Harga memainkan peran kunci. Model MiniMax, termasuk pendahulunya seperti M2, biasanya membebankan biaya sekitar $0,30–$0,315 per juta token masukan dan $1,20–$1,26 per juta token keluaran di platform resmi. GLM-4.7, tersedia melalui Z.ai atau penyedia seperti OpenRouter, mulai dari sekitar $0,44–$0,60 masukan dan $1,74–$2,20 keluaran per juta token—seringkali lebih tinggi, meskipun langganan mengurangi tarif efektif.

Oleh karena itu, Anda memilih MiniMax M2.1 untuk aplikasi agen yang hemat biaya dan berkecepatan tinggi. Sebagai alternatif, Anda memilih GLM-4.7 ketika konteks yang diperluas atau mode berpikir yang presisi terbukti penting.

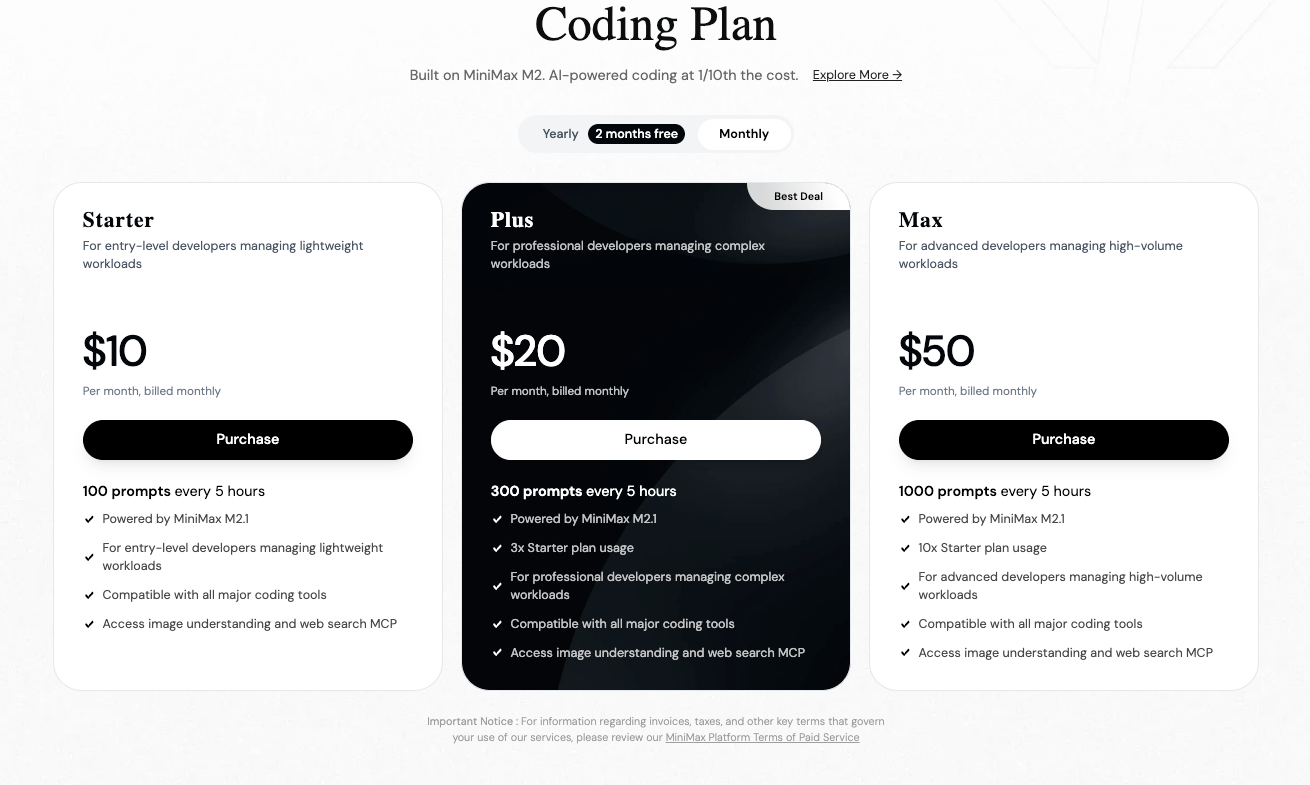

Bagaimana Cara Mendaftar ke Platform API MiniMax?

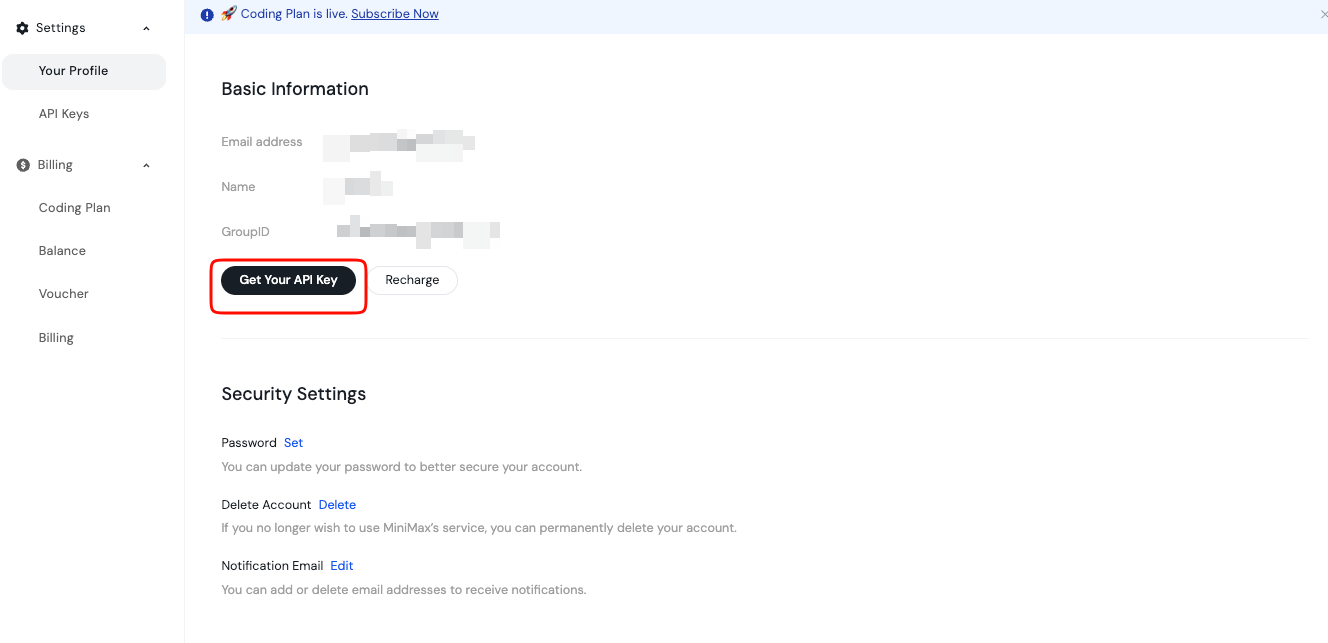

Anda memulai akses dengan membuat akun di MiniMax Open Platform. Daftar menggunakan email atau metode pilihan Anda.

Setelah verifikasi, Anda masuk dan melanjutkan ke dasbor. Di sini, Anda mengelola kunci API dan penagihan. Platform ini mendukung endpoint global dan spesifik wilayah, jadi Anda memilih berdasarkan lokasi Anda untuk latensi optimal.

Selain itu, Anda meninjau bagian dokumentasi lebih awal. Bagian-bagian tersebut mencakup ketersediaan model, batas laju, dan praktik terbaik. Anda menyimpan kunci ini dengan aman, mungkin di variabel lingkungan atau pengelola rahasia. Jangan pernah mengeksposnya dalam kode sisi klien.

Selanjutnya, Anda mengisi ulang saldo Anda jika diperlukan melalui halaman Penagihan. MiniMax beroperasi dengan model bayar sesuai penggunaan, memastikan Anda mengontrol biaya dengan tepat.

Apa itu Endpoint API MiniMax M2.1 dan Struktur Permintaannya?

API MiniMax menawarkan kompatibilitas dengan format populer, termasuk gaya OpenAI dan Anthropic. Untuk pembuatan teks dengan M2.1, Anda menargetkan endpoint penyelesaian obrolan.

Biasanya, URL dasar muncul sebagai https://api.minimax.io atau varian regional. Anda menentukan nama model, seperti "MiniMax-M2.1", dalam payload permintaan Anda.

Permintaan POST standar mencakup header untuk otorisasi dan jenis konten. Anda mengatur Authorization: Bearer YOUR_API_KEY dan Content-Type: application/json.

Badan permintaan mengikuti format array pesan, mirip dengan LLM lainnya. Anda menyertakan peran sistem, pengguna, dan asisten sesuai kebutuhan.

Selain itu, Anda menyesuaikan parameter seperti suhu, max_tokens, top_p, dan pilihan alat untuk menyempurnakan keluaran.

Bagaimana Cara Mengirim Permintaan Pertama Anda ke API MiniMax M2.1?

Anda menguji API dengan cepat menggunakan curl untuk verifikasi.

Berikut adalah contoh dasar:

curl https://api.minimax.io/v1/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "MiniMax-M2.1",

"messages": [

{"role": "system", "content": "Anda adalah asisten pengodean yang membantu."},

{"role": "user", "content": "Tulis fungsi Python untuk menghitung bilangan Fibonacci."}

],

"temperature": 0.7,

"max_tokens": 512

}'

Perintah ini mengembalikan respons JSON dengan penyelesaian yang dihasilkan. Anda memeriksa array pilihan untuk balasan dari asisten.

Selain itu, Anda mengaktifkan streaming untuk keluaran real-time dengan menambahkan "stream": true.

Bagaimana Anda Bisa Menggunakan Python untuk Berinteraksi dengan API MiniMax M2.1?

Pengembang Python lebih memilih pustaka untuk kesederhanaan. Meskipun MiniMax menyediakan kompatibilitas, Anda menggunakan SDK OpenAI resmi dengan URL dasar kustom.

Pertama, instal paketnya:

pip install openai

Kemudian, konfigurasikan klien:

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.minimax.io/v1" # Sesuaikan jika diperlukan

)

response = client.chat.completions.create(

model="MiniMax-M2.1",

messages=[

{"role": "system", "content": "Anda adalah pengembang ahli."},

{"role": "user", "content": "Jelaskan alur kerja agen."}

],

temperature=0.8

)

print(response.choices[0].message.content)

Kode ini menangani permintaan secara efisien. Anda dapat memperluasnya dengan penanganan kesalahan dan percobaan ulang untuk penggunaan produksi.

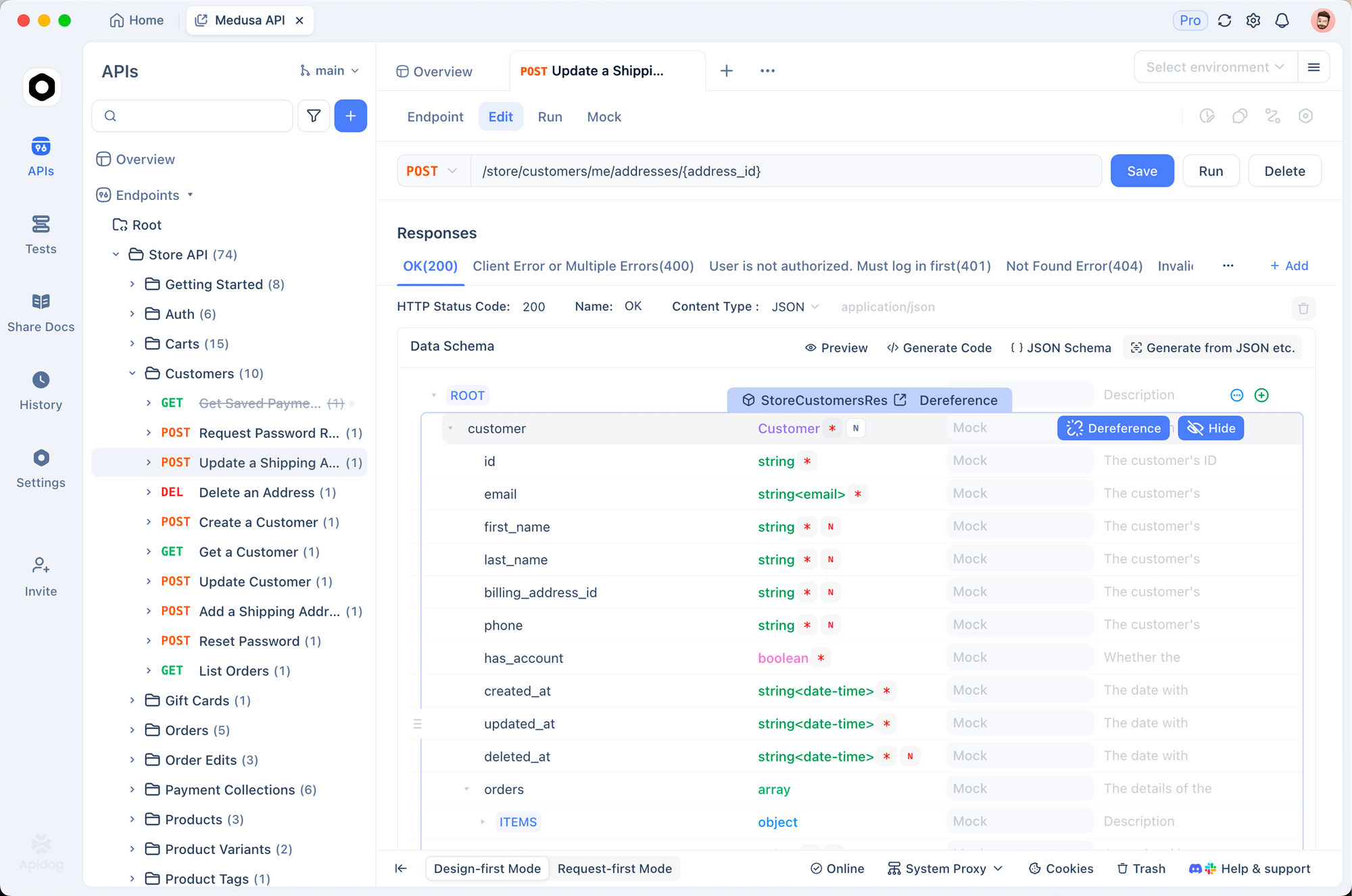

Mengapa Menggunakan Apidog untuk Menguji dan Mengelola Panggilan API MiniMax M2.1?

Menguji API secara manual menjadi membosankan seiring pertumbuhan proyek. Apidog menyederhanakan proses ini secara signifikan.

Anda mengimpor dokumentasi MiniMax atau membuat koleksi secara manual di Apidog. Kemudian, Anda mengatur variabel lingkungan untuk kunci API Anda.

Apidog mendukung pengiriman permintaan, melihat respons terformat, dan melakukan mocking endpoint. Selain itu, ia secara otomatis menghasilkan kode klien dalam berbagai bahasa.

Misalnya, Anda men-debug penggunaan token atau streaming respons secara visual. Ini menghemat waktu berjam-jam dibandingkan dengan perintah curl mentah.

Selain itu, Apidog terintegrasi dengan pipeline CI/CD, memastikan perilaku API yang konsisten.

Bagaimana Anda Menangani Pemanggilan Alat dan Fitur Lanjutan di MiniMax M2.1?

MiniMax M2.1 mendukung pemanggilan alat bawaan, yang penting untuk aplikasi agen. Anda mendefinisikan alat dalam payload permintaan.

Model memutuskan kapan harus memanggilnya, mengembalikan panggilan terstruktur. Aplikasi Anda menjalankan alat dan menambahkan hasilnya sebagai pesan asisten.

Loop ini memungkinkan penalaran multi-langkah. Selanjutnya, Anda memanfaatkan pemikiran berselang-seling untuk jejak penalaran yang transparan.

Apa Praktik Terbaik untuk Batas Laju dan Penanganan Kesalahan?

MiniMax menerapkan batas laju untuk menjaga kualitas layanan. Anda memantau header seperti x-ratelimit-remaining dalam respons.

Terapkan exponential backoff untuk percobaan ulang pada kesalahan 429. Selain itu, Anda menangkap kegagalan otentikasi (401) dan permintaan tidak valid (400).

Pencatatan permintaan dan respons membantu debugging. Anda melacak penggunaan melalui dasbor untuk menghindari kejutan.

Kesimpulan: Mulai Bangun dengan MiniMax M2.1 Hari Ini

Anda sekarang memiliki pengetahuan untuk mengakses dan memanfaatkan API MiniMax M2.1 secara efektif. Daftar di platform, hasilkan kunci Anda, dan kirim permintaan—baik melalui curl, Python, atau Apidog.

Model ini memberdayakan Anda untuk membangun agen canggih dan alat pengodean dengan biaya bersaing. Bereksperimenlah dengan bebas, bandingkan dengan alternatif seperti GLM-4.7, dan tingkatkan proyek Anda.

Apidog meningkatkan alur kerja Anda lebih lanjut dengan menyediakan alat pengujian yang canggih. Unduh secara gratis dan percepat pengembangan Anda.