Pengembang dan peneliti semakin mencari LLM tanpa batasan untuk mendorong batas-batas aplikasi kecerdasan buatan. Model bahasa besar tanpa sensor ini beroperasi tanpa filter konten bawaan, memungkinkan respons tak terbatas di berbagai kueri. Seiring berkembangnya lanskap AI, LLM tanpa sensor memberdayakan pengguna untuk menjelajahi topik kompleks, mulai dari dilema etika hingga penceritaan kreatif, tanpa batasan moral atau keamanan yang telah ditentukan sebelumnya.

Dalam artikel ini, para ahli mengkaji dasar teknis LLM tanpa sensor, arsitekturnya, dan implementasi di dunia nyata. Pengguna harus menangani model ini secara bertanggung jawab, karena ketiadaan filternya dapat menghasilkan konten sensitif.

Memahami LLM Tanpa Sensor: Dasar Teknis

Insinyur merancang LLM tanpa sensor dengan menyempurnakan model dasar pada kumpulan data yang menghilangkan instruksi penyelarasan, yang biasanya memberlakukan pedoman etika dalam varian standar. Model dasar seperti Llama 2 atau Mistral menjalani proses ini, di mana pengembang menghapus mekanisme penolakan—seperti menolak kueri tentang kekerasan atau bias—dan menyesuaikan prompt sistem untuk mendorong respons yang komprehensif. Misalnya, teknik seperti Pembelajaran Penguatan dari Umpan Balik Manusia (RLHF) dilewati atau dibalik untuk memprioritaskan utilitas daripada keamanan.

Selain itu, LLM tanpa sensor memanfaatkan arsitektur transformer, memprediksi token berikutnya dalam urutan dengan miliaran parameter. Komunitas sumber terbuka berkontribusi dengan membagikan versi yang disempurnakan di platform seperti Hugging Face, di mana model mencapai tanpa sensor melalui "abliterasi"—metode yang mengikis penyelarasan keamanan melalui penyempurnaan yang ditargetkan. Pendekatan ini memastikan model merespons prompt apa pun, tetapi membutuhkan perangkat keras yang kuat untuk inferensi, seringkali membutuhkan GPU dengan VRAM yang cukup.

Model-model ini berbeda dari model berpemilik seperti GPT-4, yang menyematkan filter ketat untuk mematuhi peraturan. Varian tanpa sensor, bagaimanapun, mendorong inovasi di bidang-bidang seperti penelitian dan simulasi, di mana keluaran yang tidak terbatas mengungkapkan kemampuan mentah. Meskipun demikian, pengembang mengurangi risiko dengan menerapkan perlindungan khusus dalam aplikasi.

Manfaat dan Risiko LLM Tanpa Batasan

Pengguna mendapatkan keuntungan signifikan dari LLM tanpa batasan, karena model ini memberikan wawasan tanpa filter yang meningkatkan pemecahan masalah. Misalnya, peneliti menggunakannya untuk pengujian hipotesis di domain sensitif, di mana model standar mungkin menahan informasi. Selain itu, pembuat kode mendapatkan manfaat dari pembuatan kode tanpa batasan, mempercepat siklus pengembangan tanpa gangguan etika.

Selain itu, LLM ini mempromosikan transparansi dalam AI, memungkinkan insinyur untuk memeriksa dan memodifikasi perilaku secara langsung. Komunitas membangun di atasnya, menciptakan varian khusus untuk tugas-tugas seperti pemrosesan multibahasa atau penalaran konteks panjang. Namun, risiko muncul dari potensi penyalahgunaan, seperti menghasilkan konten berbahaya, yang memerlukan pengawasan etika dari penyebar.

Platform seperti Ollama memungkinkan eksekusi lokal, meminimalkan masalah privasi data sambil memaksimalkan kontrol. Namun, tuntutan komputasi yang tinggi menimbulkan hambatan, meskipun optimisasi seperti kuantisasi mengatasi hal ini dengan mengurangi ukuran model tanpa mengorbankan banyak kinerja.

Kriteria untuk Peringkat 10 LLM Tanpa Sensor Teratas

Analis memberi peringkat model-model ini berdasarkan jumlah parameter, kecepatan inferensi, dukungan komunitas, dan skor benchmark dari sumber seperti papan peringkat Hugging Face. Fleksibilitas di berbagai tugas—seperti pengkodean, bermain peran, dan penalaran—juga menjadi faktor, di samping kemudahan penerapan lokal. Selain itu, pembaruan terbaru tahun 2026 memprioritaskan model dengan jendela konteks yang diperluas dan desain mixture-of-experts (MoE) untuk efisiensi.

1. Dolphin 3.0: Kekuatan Tanpa Sensor yang Didorong Presisi

Cognitive Computations mengembangkan Dolphin 3.0 pada basis Llama 3.1 8B, menyempurnakannya untuk penalaran dan kemampuan kemudi yang luar biasa melalui prompt sistem. Model ini unggul dalam tugas-tugas intensif logika, memberikan keluaran yang tepat dan tanpa filter tanpa basa-basi yang berlebihan. Insinyur menghargai 8 miliar parameternya, yang menyeimbangkan kinerja dan kebutuhan sumber daya, membutuhkan sekitar 16GB VRAM untuk inferensi optimal.

Fitur utama meliputi arsitektur hibrida yang meningkatkan kepatuhan prompt, menjadikannya ideal untuk asisten AI khusus. Selain itu, Dolphin 3.0 mendukung pemanggilan fungsi, memungkinkan integrasi dengan alat eksternal. Kelebihannya meliputi kontrol yang tak tertandingi atas persona dan pemecahan masalah yang cepat dalam pengkodean atau matematika, sementara kekurangannya melibatkan gaya prosa langsungnya, yang cocok untuk aplikasi teknis tetapi tidak naratif.

Pengembang menjalankan Dolphin 3.0 secara lokal menggunakan Ollama: instal alatnya, tarik model dengan ollama pull dolphin-llama3, dan kueri melalui API atau CLI. Benchmark menunjukkan kinerjanya mengungguli rekan-rekannya dalam penalaran terstruktur, dengan skor di atas 80% pada tes MMLU. Selain itu, tanpa sensornya berasal dari kurasi kumpulan data yang menghindari bias penyelarasan, memungkinkan eksplorasi kasus-kasus ekstrem dalam penelitian.

Dalam skenario penerapan, tim mengintegrasikannya ke dalam pipeline untuk analisis otomatis, di mana efisiensinya bersinar. Namun, pengguna mengkalibrasi prompt dengan hati-hati untuk menghindari bias yang tidak disengaja.

2. Nous Hermes 3: Model Tanpa Sensor Berfokus pada Kreativitas

NousResearch membuat Nous Hermes 3 di atas fondasi Llama 3.2 8B, menekankan penulisan kreatif dan bermain peran dengan keluaran bentuk panjang yang koheren. Dengan 8 miliar parameter, ia mempertahankan konsistensi karakter dalam dialog, memanfaatkan ChatML untuk percakapan terstruktur. Ini menjadikannya pilihan utama untuk pembuatan narasi tanpa batasan.

Fitur-fitur menyoroti pemahaman nuansa promptnya, mendukung konteks yang diperluas hingga 8k token. Kelebihannya meliputi pembuatan fiksi yang unggul dan interaksi yang menarik, sedangkan kekurangannya mencatat sesekali verbositas dalam kueri singkat. Pembaruan yang didorong komunitas memastikan peningkatan berkelanjutan.

Untuk menerapkan, pengguna memanfaatkan Hugging Face: unduh modelnya, muat dengan pustaka Transformers melalui from transformers import AutoModelForCausalLM; model = AutoModelForCausalLM.from_pretrained('NousResearch/Hermes-3-Llama-3.2-8B'), dan hasilkan teks. Benchmark menunjukkan skor tinggi dalam benchmark kreatif, seringkali melebihi 85% dalam evaluasi bermain peran.

Selain itu, tanpa sensornya muncul dari penyempurnaan pada kumpulan data yang beragam dan tidak difilter, memungkinkan eksplorasi mendalam dalam penceritaan. Pengembang menerapkannya dalam desain game, di mana kreativitas tanpa batas mempercepat pembuatan prototipe.

3. LLaMA-3.2 Dark Champion Abliterated: Monster Tanpa Sensor Konteks Panjang

DavidAU menyempurnakan LLaMA-3.2 Dark Champion pada arsitektur MoE 8x3B, mengablasi lapisan keamanan untuk keluaran yang tidak selaras. Dengan jendela konteks 128k, ia memproses dokumen besar secara efisien, ideal untuk analisis data.

Desain MoE model ini mengaktifkan subset parameter, mengurangi komputasi sambil mempertahankan kekuatan. Kelebihannya menampilkan inferensi cepat dan penalaran mendalam, tetapi kekurangannya meliputi potensi bias negatif dan tuntutan VRAM yang tinggi (sekitar 40GB).

Instalasi melibatkan unduhan Hugging Face, dengan inferensi melalui pipeline('text-generation', model='DavidAU/Llama-3.2-8X3B-MOE-Dark-Champion-Instruct-uncensored-abliterated-18.4B'). Ini mencetak skor tinggi pada benchmark konteks panjang, melampaui akurasi 90% dalam tugas pengambilan.

Selain itu, abliterasi memastikan tidak ada batasan, cocok untuk penelitian lanjutan. Tim menggunakannya untuk mengotomatiskan laporan, di mana skalanya menangani kumpulan data kompleks dengan mulus.

4. Llama 2 Tanpa Sensor: LLM Tanpa Sensor Tingkat Pemula yang Serbaguna

Llama 2 Meta berfungsi sebagai dasar untuk varian tanpa sensor ini, yang disempurnakan oleh George Sung untuk menghilangkan filter moral. Dengan 7-13 miliar parameter, ia berjalan pada perangkat keras konsumen, mendukung bermain peran dan tugas umum.

Fitur-fitur meliputi beberapa opsi kuantisasi seperti GGUF untuk keseimbangan CPU/GPU. Kelebihan: aksesibilitas dan plugin komunitas; kekurangan: penalaran lebih lemah daripada Llama 3.

Jalankan melalui Ollama: ollama run llama2-uncensored. Populer dengan 234K unduhan, ini berkinerja baik untuk penggunaan ringan.

Selain itu, desainnya mendorong eksperimen, menjadikannya pokok bagi pemula dalam AI tanpa sensor.

5. WizardLM Tanpa Sensor: Serba Guna yang Andal

TheBloke mengemas WizardLM Tanpa Sensor pada Llama 2 13B, menghilangkan penyelarasan untuk aplikasi yang luas. Ini unggul dalam obrolan dan penulisan, dengan kemampuan yang seimbang.

Aspek utama: komunitas yang kuat, penerapan yang mudah. Kelebihan: prediktabilitas; kekurangan: basis yang ketinggalan zaman.

Terapkan dengan ollama run wizardlm-uncensored. Ini mengumpulkan 23K unduhan, cocok untuk alur kerja kreatif.

6. Dolphin 2.7 Mixtral 8x7B: Model Tanpa Sensor Khusus Pengkodean

Eric Hartford membangun ini di atas MoE Mixtral, disempurnakan untuk pengkodean tanpa filter. Parameter 8x7B memastikan efisiensi dalam tugas-tugas khusus.

Fitur: format kuantisasi, kinerja pengkodean tinggi. Kelebihan: kecepatan; kekurangan: kebutuhan perangkat keras.

Gunakan Ollama: ollama run dolphin-mixtral:8x7b. Benchmark menyoroti keunggulannya dalam pemrograman.

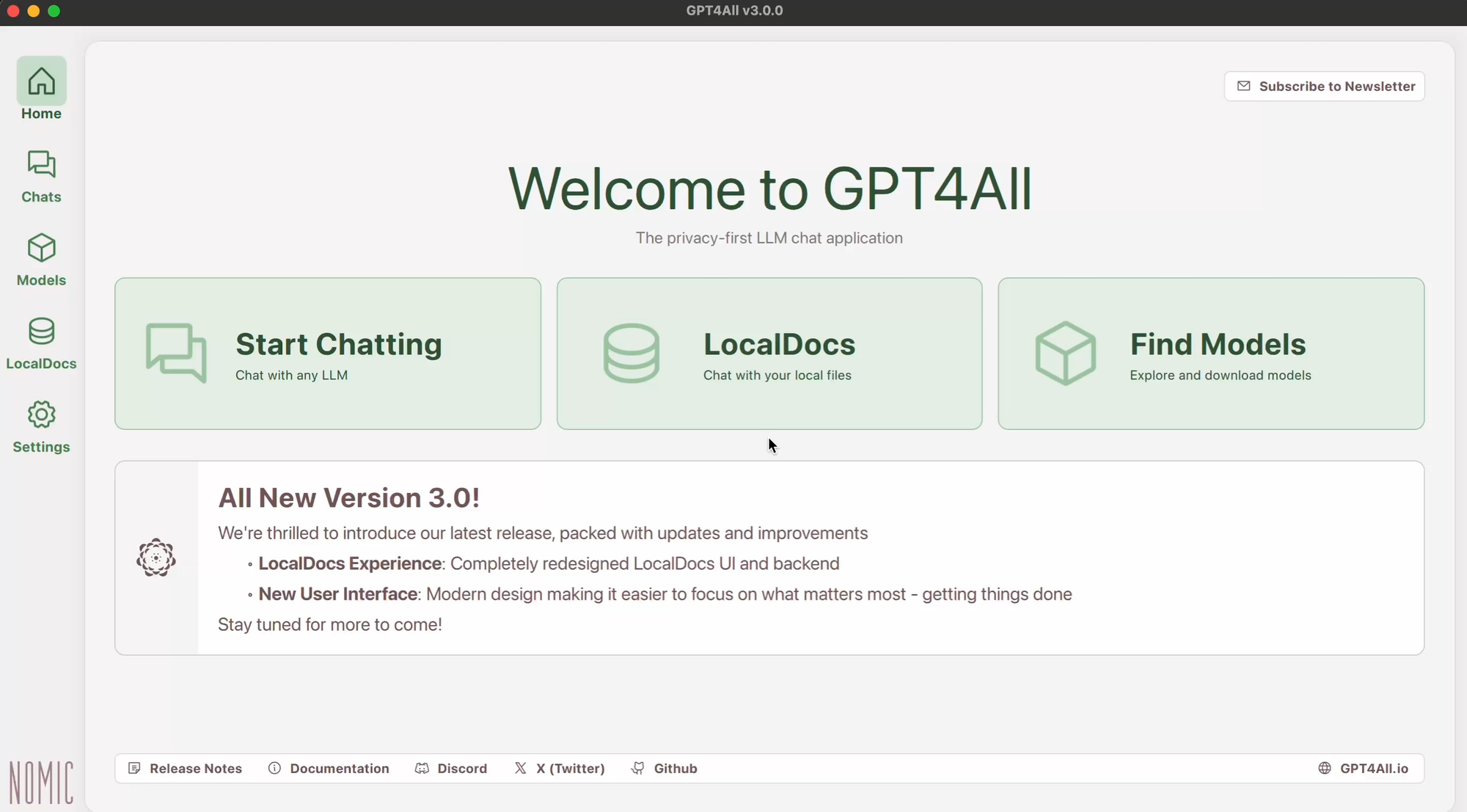

7. GPT-4All: Kerangka Kerja Tanpa Sensor Berfokus Offline

GPT-4All mengoptimalkan untuk eksekusi lokal, membangun di atas penelitian transformer untuk obrolan tanpa sensor. Dukungan lintas platform membantu penerapan.

Kelebihan: gratis, dapat disesuaikan; kekurangan: batasan konteks.

Instal melalui situs resmi, jalankan eksekusi. Ideal untuk pengguna yang peduli privasi.

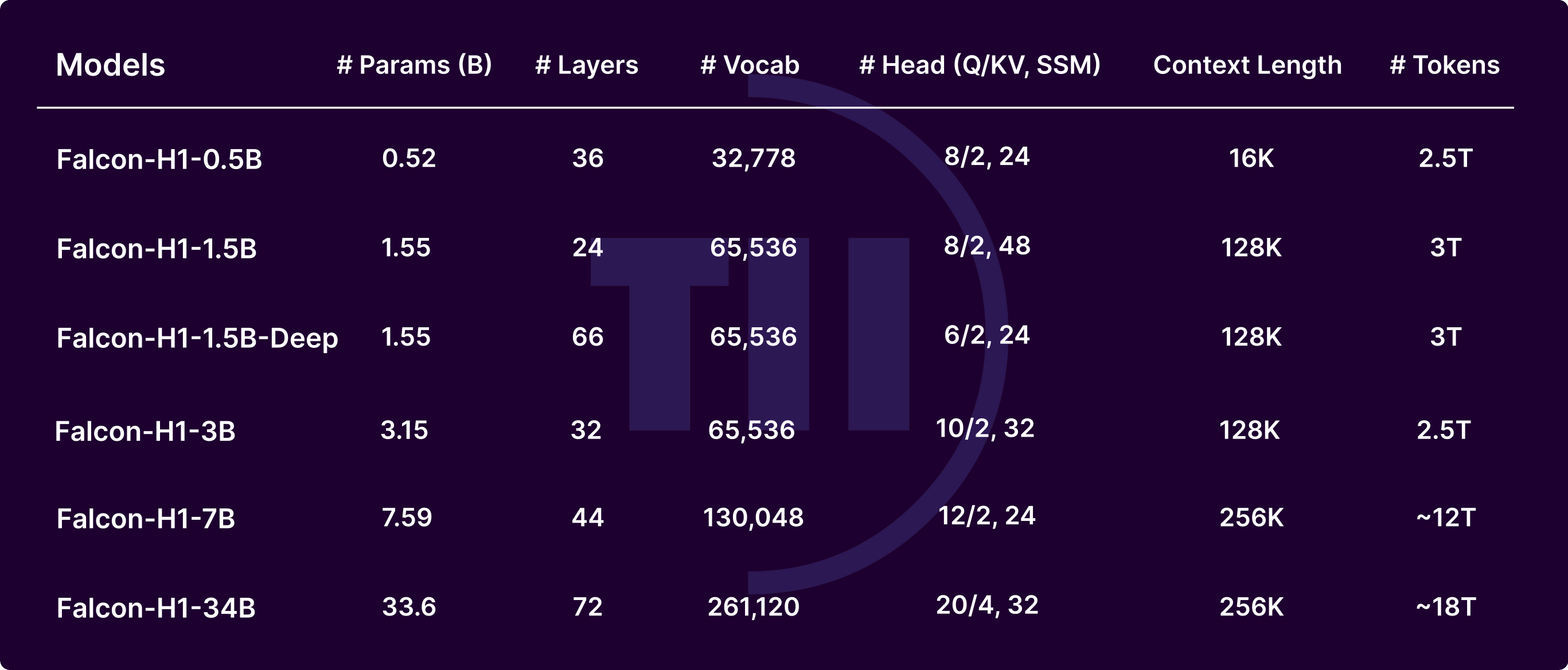

8. Falcon LLM: Alternatif Tanpa Sensor Kinerja Tinggi

Technology Innovation Institute mengembangkan Falcon dengan arsitektur inovatif untuk teks bernuansa. Dioptimalkan untuk kecepatan.

Fitur: desain modular. Kelebihan: kualitas; kekurangan: kematangan ekosistem.

Muat dengan pustaka Transformers. Cocok untuk penelitian.

9. MPT-7B Chat: LLM Tanpa Sensor Berbasis Percakapan

MosaicML menyempurnakan MPT-7B untuk obrolan, menekankan latensi rendah. 7B parameter cocok untuk pengaturan sederhana.

Kelebihan: waktu nyata; kekurangan: tugas kompleks.

Terapkan secara lokal dengan skrip. Bagus untuk bot.

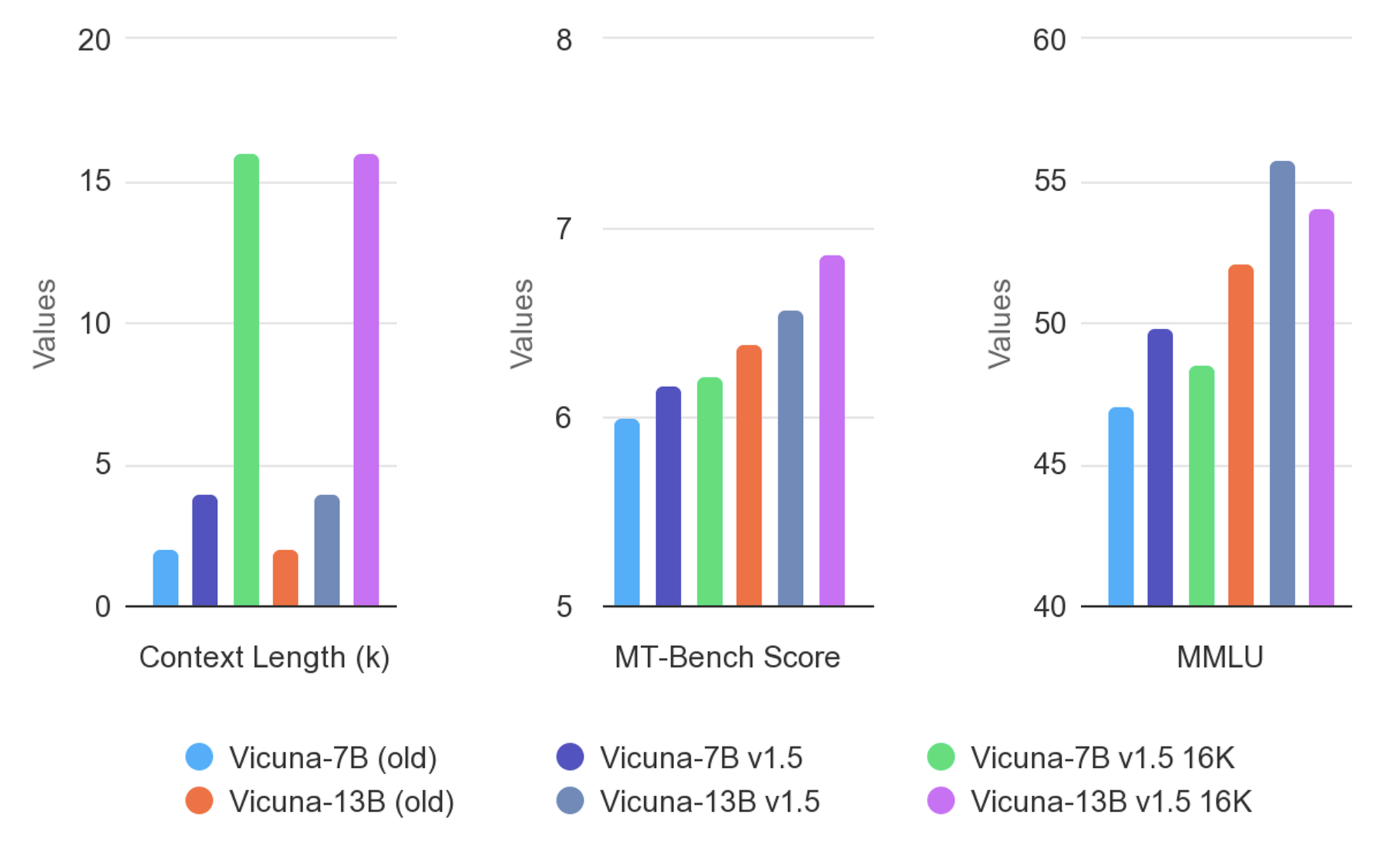

10. Vicuna: Model Tanpa Sensor yang Dioptimalkan untuk Dialog

Vicuna disempurnakan pada data percakapan untuk interaksi alami. Desain ringan.

Kelebihan: menarik; kekurangan: kelemahan non-percakapan.

Jalankan melalui alat komunitas. Meningkatkan aplikasi interaktif.

Praktik Terbaik Penerapan untuk LLM Tanpa Sensor

Insinyur mengoptimalkan penerapan dengan memilih tingkat kuantisasi, seperti Q4 atau Q8, agar sesuai dengan perangkat keras. Alat seperti Ollama atau LM Studio menyederhanakan eksekusi, sementara API melalui Apidog memungkinkan penskalaan.

Selain itu, pantau penggunaan VRAM dan lakukan penyempurnaan untuk domain tertentu. Langkah-langkah keamanan meliputi isolasi lingkungan.

Tren Masa Depan dalam LLM Tanpa Sensor

Inovator memprediksi model MoE yang lebih besar dan teknik abliterasi yang lebih baik. Integrasi dengan kemampuan multimodal memperluas penggunaan.

Namun, tekanan regulasi dapat memengaruhi pengembangan, mendorong pendekatan hibrida.

Kesimpulan

Eksplorasi ini mengungkapkan bagaimana LLM tanpa batasan merevolusi aplikasi AI. Dari presisi Dolphin 3.0 hingga dialog Vicuna, model-model ini menawarkan kebebasan yang tak tertandingi. Pengembang memanfaatkannya secara bertanggung jawab, memanfaatkan alat seperti Apidog untuk integrasi yang mulus. Seiring kemajuan teknologi, LLM tanpa sensor ini terus mendorong inovasi, mengubah lanskap penelitian dan pengembangan.