Para pengembang yang membangun aplikasi cerdas sering menghadapi tantangan dalam mengintegrasikan model-model mutakhir seperti GPT-5.2 ke dalam alur kerja mereka. Dirilis oleh OpenAI sebagai batas terbaru dalam kemampuan AI, GPT-5.2 mendorong batas dalam pembuatan kode, persepsi gambar, dan penalaran multi-langkah. Anda mengintegrasikannya bukan hanya untuk bereksperimen, tetapi untuk menyebarkan solusi yang tangguh dan skalabel yang menangani tugas-tugas profesional yang kompleks. Namun, kedalaman API—mulai dari pemilihan varian hingga penyetelan parameter—menuntut pendekatan yang terstruktur. Di situlah alat seperti Apidog berperan, menyederhanakan desain, pengujian, dan dokumentasi API sehingga Anda fokus pada inovasi daripada pekerjaan rutin.

Memahami GPT-5.2: Kemampuan Inti dan Mengapa Penting bagi Pengembang

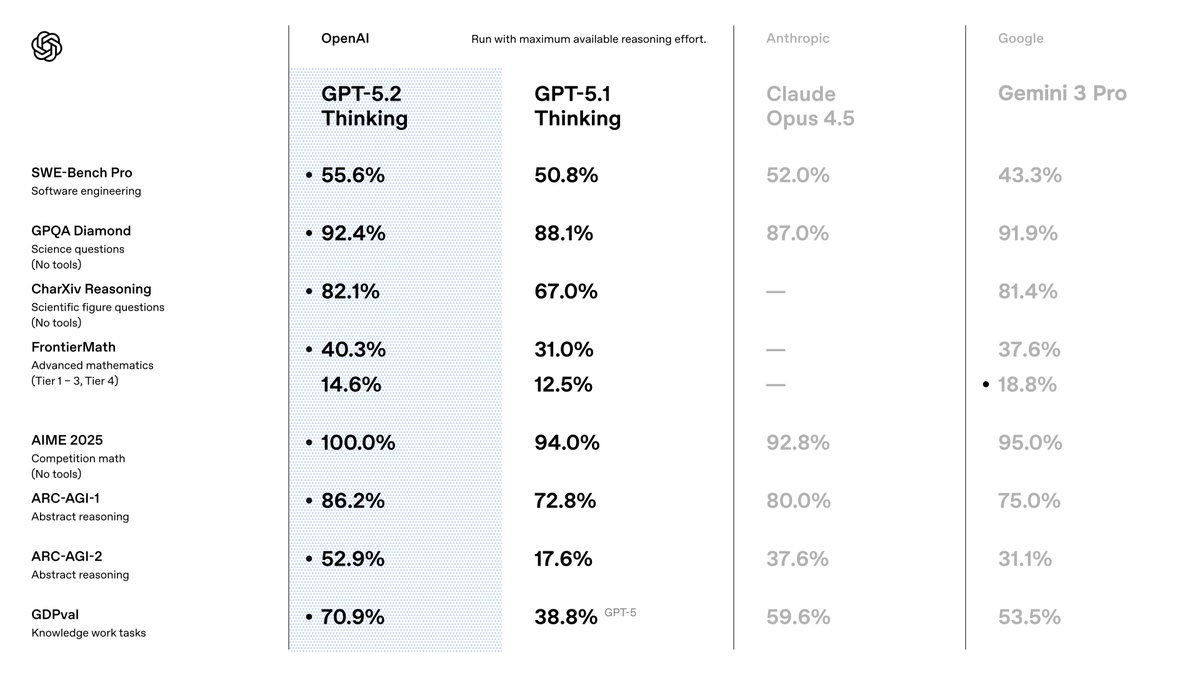

Anda memilih GPT-5.2 karena mengungguli pendahulunya dalam presisi dan efisiensi. OpenAI memposisikannya sebagai suite yang dioptimalkan untuk pekerjaan berbasis pengetahuan, di mana ia mencapai hasil terbaik di seluruh tolok ukur. Misalnya, ia mencetak 80,0% pada SWE-Bench Verified untuk tugas coding, yang berarti Anda menghasilkan solusi perangkat lunak yang lebih akurat dengan iterasi yang lebih sedikit. Selain itu, kemampuan visinya mengurangi separuh tingkat kesalahan dalam penalaran bagan, memungkinkan aplikasi seperti alat visualisasi data otomatis.

Beralih dari GPT-5.1, Anda akan melihat peningkatan dalam faktualitas—30% lebih sedikit halusinasi pada kueri yang diaktifkan pencarian—dan penanganan konteks panjang, dengan akurasi hampir sempurna hingga 256k token. Fitur-fitur ini penting karena mengurangi kebutuhan pasca-pemrosesan dalam alur kerja Anda. Anda juga mendapatkan manfaat dari panggilan alat yang ditingkatkan, dengan skor 98,7% pada tolok ukur multi-giliran, yang menyederhanakan sistem agen.

Bagi pengguna API, GPT-5.2 terintegrasi dengan mulus ke dalam ekosistem OpenAI yang sudah ada. Anda mengaksesnya melalui API Chat Completions atau Responses, mendukung parameter seperti `temperature` untuk kontrol kreativitas. Namun, keberhasilan bergantung pada pemilihan varian yang tepat. Kita akan membahasnya selanjutnya.

Menjelajahi Varian GPT-5.2: Sesuaikan Performa dengan Kebutuhan Anda

GPT-5.2 menawarkan varian yang menyeimbangkan kecepatan, kedalaman, dan biaya, memungkinkan Anda untuk mencocokkan perilaku model dengan tuntutan tugas. Tidak seperti model monolitik, opsi-opsi ini—Instant, Thinking, dan Pro—memberikan fleksibilitas. Anda mengaktifkannya melalui pengenal model tertentu dalam permintaan API Anda.

Mulailah dengan GPT-5.2 Instant (gpt-5.2-chat-latest). Varian ini memprioritaskan latensi rendah untuk interaksi sehari-hari, seperti pencarian informasi cepat atau penulisan teknis. Para pengembang menyukainya untuk chatbot atau asisten waktu nyata, di mana waktu respons di bawah 200 ms terbukti penting. Ini menangani terjemahan dan panduan dengan akurasi yang disempurnakan, menjadikannya ideal untuk aplikasi yang menghadap konsumen.

Selanjutnya, pertimbangkan GPT-5.2 Thinking (gpt-5.2). Anda menggunakannya untuk analisis yang lebih dalam, seperti ringkasan dokumen panjang atau perencanaan logis. Mesin penalaran ini unggul dalam matematika dan pengambilan keputusan, menyelesaikan 40,3% masalah FrontierMath. Gunakan parameter reasoning di sini—atur ke 'high' atau 'xhigh'—untuk memperkuat kualitas output pada kueri kompleks. Misalnya, dalam alat manajemen proyek, ia mengatur alur kerja multi-langkah dengan kesalahan minimal.

Terakhir, GPT-5.2 Pro (gpt-5.2-pro) menargetkan kinerja elit pada domain yang menantang. Ia membanggakan 93,2% pada GPQA Diamond untuk pertanyaan sains dan unggul dalam pemrograman dengan lebih sedikit kegagalan kasus tepi. Anda menyimpannya untuk prototipe R&D atau lingkungan berisiko tinggi, seperti pemodelan keuangan, di mana presisi lebih penting daripada kecepatan.

Gambar yang Anda bagikan menyoroti sakelar untuk ini, termasuk mode "Max", "Mini", "High", "Low", dan "Fast". Ini selaras dengan upaya penalaran: 'none' untuk respons instan, 'low' untuk tugas dasar, hingga 'xhigh' untuk analisis menyeluruh. Anda mengalihkannya melalui parameter API, memastikan model beradaptasi secara dinamis. Misalnya, beralih ke "Max High Fast" untuk sesi coding yang seimbang yang memprioritaskan kecepatan tanpa mengorbankan kedalaman.

Dengan memilih varian secara cermat, Anda mengoptimalkan penggunaan sumber daya. Sekarang, Anda mengatur akses untuk membuat panggilan ini.

Menyiapkan Akses API GPT-5.2 Anda: Otentikasi dan Persiapan Lingkungan

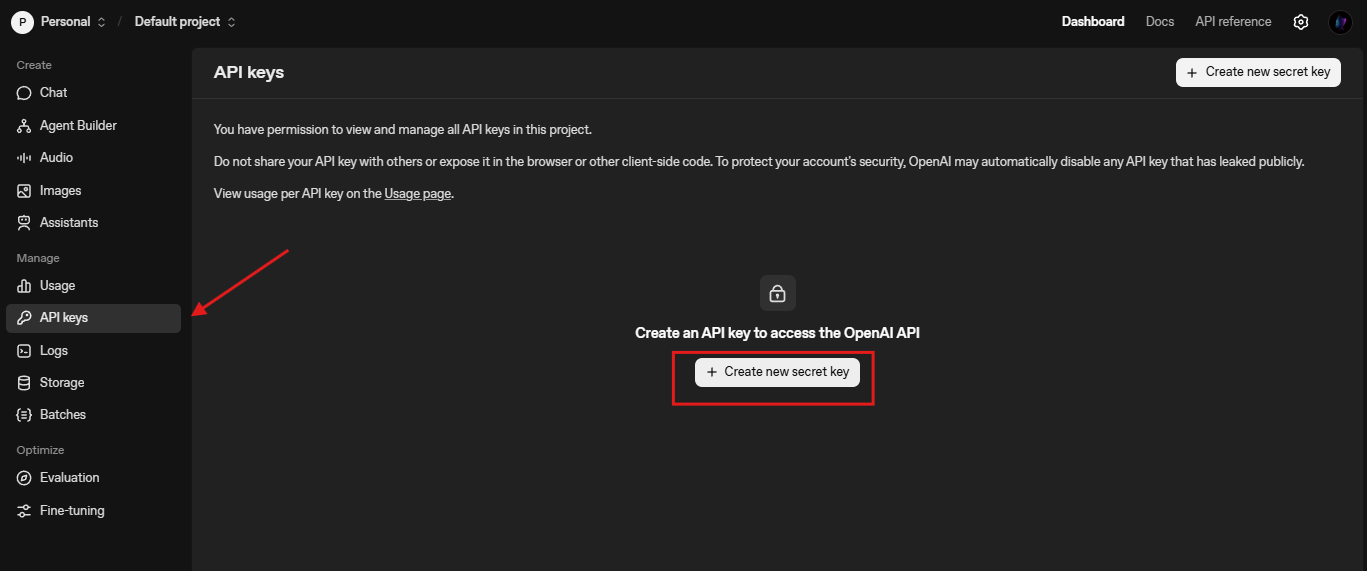

Anda memulai integrasi dengan mengamankan kredensial API. OpenAI membutuhkan kunci API, yang Anda buat dari dasbor platform. Navigasi ke platform.openai.com, buat akun jika diperlukan, dan terbitkan kunci di bawah "API Keys."

Selanjutnya, instal OpenAI Python SDK. Jalankan pip install openai di terminal Anda. Pustaka ini menangani permintaan HTTP, percobaan ulang, dan streaming secara otomatis. Untuk pengguna Node.js, npm install openai menyediakan fungsionalitas serupa. Anda mengimpornya sebagai berikut:

from openai import OpenAI

client = OpenAI(api_key=os.getenv("OPENAI_API_KEY"))

Uji konektivitas dengan penyelesaian sederhana:

response = client.chat.completions.create(

model="gpt-5.2-chat-latest",

messages=[{"role": "user", "content": "Explain quantum entanglement briefly."}]

)

print(response.choices[0].message.content)

Panggilan ini memverifikasi pengaturan. Jika terjadi kesalahan, periksa batas laju (default 3.500 RPM untuk Tingkat 1) atau validitas kunci. Anda juga mengonfigurasi URL dasar untuk endpoint kustom, seperti /compact untuk konteks yang diperluas: client = OpenAI(base_url="https://api.openai.com/v1", api_key=...).

Dengan dasar-dasar yang sudah ada, Anda dapat mulai menyusun permintaan.

Menyusun Permintaan API GPT-5.2 yang Efektif: Parameter dan Praktik Terbaik

Anda membuat permintaan menggunakan endpoint Chat Completions (/v1/chat/completions). Payload mencakup model, messages, dan parameter opsional seperti temperature (0-2 untuk determinisme) dan max_tokens (hingga 4096 output).

Untuk spesifik GPT-5.2, sertakan reasoning_effort untuk mengontrol kedalaman:

response = client.chat.completions.create(

model="gpt-5.2",

messages=[{"role": "user", "content": "Write a Python function for Fibonacci sequence."}],

reasoning_effort="high", # Aligns with "Max High" toggle

temperature=0.7,

max_tokens=500

)

Ini menghasilkan kode dengan penalaran langkah demi langkah, mengurangi bug. Anda merangkai pesan untuk percakapan, mempertahankan konteks di setiap giliran. Untuk tugas visi, unggah gambar melalui content dengan type "image_url":

messages = [

{"role": "user", "content": [

{"type": "text", "text": "Describe this chart's trends."},

{"type": "image_url", "image_url": {"url": "https://example.com/chart.png"}}

]}

]

Praktik terbaik termasuk pengelompokan permintaan untuk penghematan biaya dan penggunaan streaming (stream=True) untuk UI real-time. Pantau penggunaan token dengan usage dalam respons untuk menyempurnakan prompt. Selain itu, aktifkan alat untuk panggilan fungsi—definisikan skema untuk API eksternal, dan GPT-5.2 akan mengeksekusinya secara otonom.

Untuk menguji ini secara efisien, integrasikan Apidog. Ini melakukan mock endpoint OpenAI, memungkinkan Anda mensimulasikan varian tanpa mencapai kuota langsung.

Mengintegrasikan GPT-5.2 dengan Apidog: Menyederhanakan Pengujian dan Dokumentasi

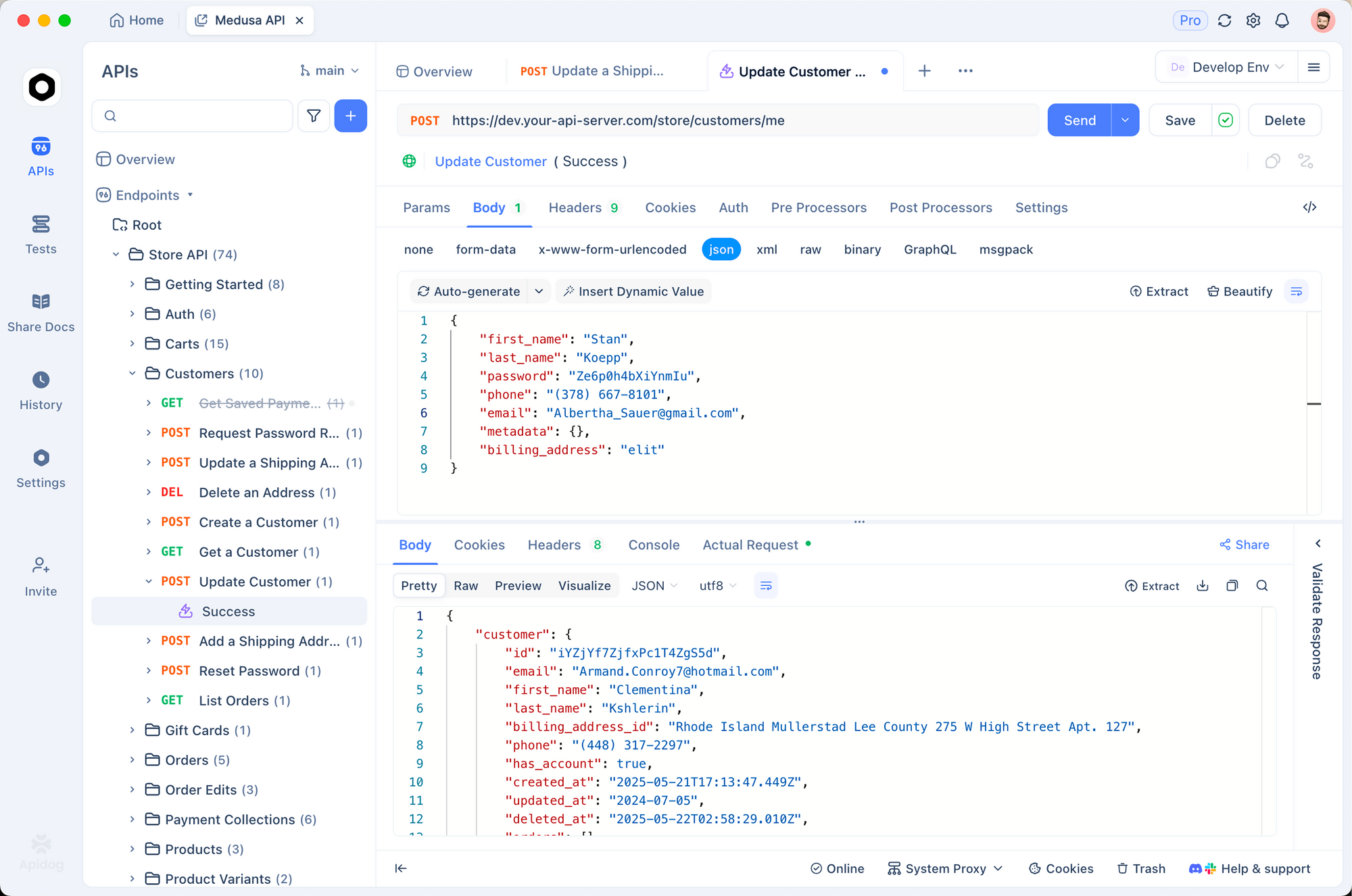

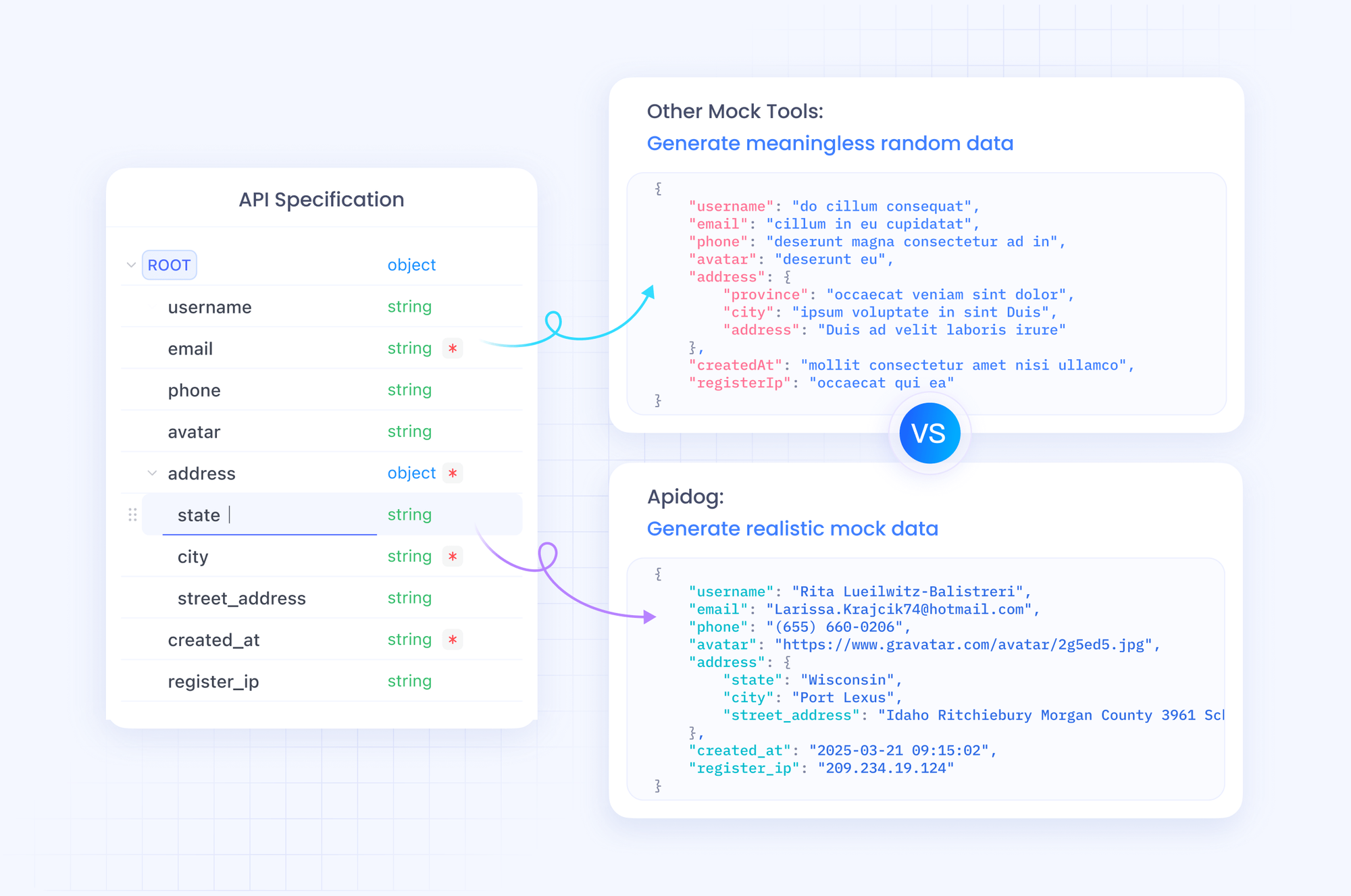

Apidog mengubah cara Anda mengelola alur kerja API GPT-5.2. Sebagai platform all-in-one, ia mendukung impor spesifikasi OpenAPI, pembangunan permintaan, dan pengujian otomatis. Anda mengimpor skema OpenAI ke Apidog, lalu mendesain koleksi untuk panggilan GPT-5.2.

Mulailah dengan membuat proyek baru di Apidog. Tambahkan permintaan HTTP ke https://api.openai.com/v1/chat/completions, atur header (Authorization: Bearer YOUR_KEY, Content-Type: application/json), dan tempelkan contoh body. Alihkan variabel untuk model seperti "gpt-5.2-pro" untuk membandingkan output secara berdampingan.

Kekuatan Apidog terletak pada server mock-nya. Anda menghasilkan respons palsu yang meniru struktur JSON GPT-5.2, ideal untuk pengembangan offline. Misalnya, simulasikan respons "Max Extra High" dengan jejak penalaran terperinci. Jalankan pengujian dengan asersi pada jumlah token atau tingkat halusinasi.

Selain itu, dokumentasikan API Anda dengan editor bawaan Apidog. Hasilkan dokumen interaktif yang digunakan rekan kerja untuk menjelajahi endpoint. Ekspor ke Postman atau HAR untuk portabilitas. Dalam produksi, Apidog memantau panggilan, memberikan peringatan tentang anomali seperti latensi tinggi dalam mode "Low Fast".

Dengan mengintegrasikan Apidog ke dalam proses Anda, Anda mempercepat iterasi. Unduh secara gratis dan impor permintaan GPT-5.2 pertama Anda—rasakan perbedaannya dalam hitungan menit.

Harga API GPT-5.2: Menyeimbangkan Biaya dan Kemampuan secara Strategis

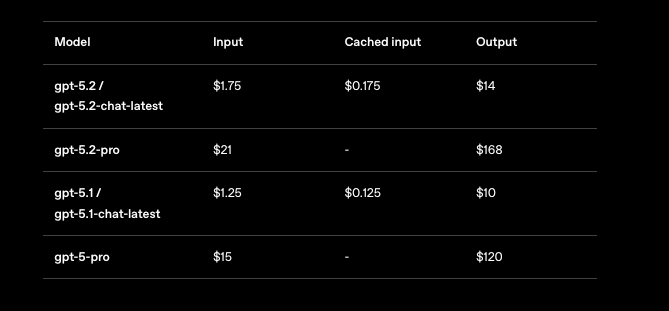

Anda tidak dapat mengabaikan harga saat menskalakan aplikasi GPT-5.2. OpenAI menyusun biaya per juta token, dengan tingkatan yang mencerminkan volume penggunaan. Untuk GPT-5.2 Instant (gpt-5.2-chat-latest), perkirakan $1,75 per 1 juta token masukan dan $14 per 1 juta token keluaran. Masukan yang di-cache turun menjadi $0,175—penghematan 90%—mendorong konteks yang diulang.

GPT-5.2 Thinking (gpt-5.2) mencerminkan tarif ini, menjadikannya hemat biaya untuk tugas-tugas yang seimbang. Namun, GPT-5.2 Pro (gpt-5.2-pro) menuntut lebih banyak: $21 per 1 juta input dan $168 per 1 juta output. Harga premium ini mencerminkan akurasinya yang superior pada kueri tingkat pro, tetapi Anda harus mengevaluasi ROI dengan cermat.

Secara keseluruhan, GPT-5.2 terbukti efisien dalam penggunaan token, seringkali menurunkan total pengeluaran dibandingkan GPT-5.1 untuk output berkualitas. Anda melacaknya melalui penganalisis penggunaan di dasbor. Untuk perusahaan, negosiasikan tingkatan khusus. Alat seperti Apidog membantu memperkirakan biaya dengan mencatat aliran token yang disimulasikan.

Memahami angka-angka ini, Anda akan melanjutkan ke contoh-contoh praktis.

Contoh Praktis: Pembuatan Kode dan Tugas Visi dengan GPT-5.2

Anda menerapkan GPT-5.2 dalam skenario nyata. Pertimbangkan pembuatan kode: Prompt untuk komponen React dengan manajemen state.

response = client.chat.completions.create(

model="gpt-5.2",

messages=[{"role": "user", "content": "Build a React todo list with useReducer."}],

reasoning_effort="medium"

)

Outputnya menghasilkan kode yang bersih, beranotasi—80% sesuai dengan tolok ukur. Anda menyempurnakan dengan berulang: Lanjutkan dengan "Optimalkan untuk performa."

Untuk visi, analisis tangkapan layar. Unggah mockup UI dan tanyakan: "Sarankan peningkatan aksesibilitas." GPT-5.2 mengidentifikasi masalah seperti kontras warna, memanfaatkan tingkat kesalahannya yang telah dikurangi separuhnya.

Dalam agen multi-alat, definisikan fungsi untuk kueri basis data. GPT-5.2 mengorkestrasi panggilan, mengurangi latensi pada agen-mega dengan 20+ alat.

Contoh-contoh ini menunjukkan keserbagunaan. Namun, kesalahan bisa terjadi—tangani dengan percobaan ulang dan fallback.

Menangani Kesalahan dan Kasus Batas dalam Panggilan API GPT-5.2

Anda mungkin mengalami batas laju atau parameter tidak valid. Lingkupi panggilan dalam try-except:

try:

response = client.chat.completions.create(...)

except openai.RateLimitError:

time.sleep(60) # Backoff

response = client.chat.completions.create(...)

Untuk halusinasi, verifikasi silang dengan alat pencarian. Dalam konteks panjang, gunakan /compact untuk mengompresi riwayat. Pantau bias dalam aplikasi sensitif, terapkan filter.

Apidog membantu di sini: Skrip pengujian untuk skenario kesalahan, memastikan ketahanan.

Optimasi Lanjutan: Menskalakan GPT-5.2 untuk Produksi

Anda melakukan penskalaan dengan menyempurnakan prompt dan menggunakan API Asisten untuk thread persisten. Terapkan caching untuk input berulang. Untuk aplikasi global, arahkan melalui server edge.

Integrasikan dengan framework seperti LangChain: Rangkaian GPT-5.2 dengan penyimpanan vektor untuk sistem RAG.

Terakhir, tetaplah terbarui—OpenAI berulang dengan cepat.

Kesimpulan: Kuasai API GPT-5.2 dan Bangun Masa Depan

Anda kini memiliki alat untuk menggunakan GPT-5.2 secara efektif. Mulai dari pemilihan varian hingga pengujian yang ditingkatkan Apidog, terapkan langkah-langkah ini untuk meningkatkan proyek Anda. Harga tetap terjangkau untuk penggunaan yang bijaksana, membuka kemampuan yang dulu hanya tersedia untuk laboratorium.

Bereksperimenlah hari ini: Prototipkan agen GPT-5.2 dan ukur keuntungannya. Bagikan hasil karya Anda di komentar—tantangan apa yang Anda hadapi? Untuk pembahasan lebih mendalam, jelajahi dokumen OpenAI. Bangun dengan berani.