Anda memerlukan alat yang efisien untuk menghasilkan gambar berkualitas tinggi dari perintah teks dalam aplikasi modern. API Z-Image langsung menjawab kebutuhan ini. Pengembang mengakses model teks-ke-gambar yang kuat melalui antarmuka tanpa biaya yang menghasilkan gambar fotorealistik dengan cepat. API ini memanfaatkan model Z-Image-Turbo sumber terbuka dari tim Tongyi-MAI Alibaba, yang beroperasi di bawah lisensi Apache 2.0. Anda mendapatkan manfaat dari inferensi di bawah satu detik pada perangkat keras yang sesuai, menjadikannya ideal untuk fitur real-time di aplikasi web, alat seluler, atau alur kerja otomatis.

Selanjutnya, Anda akan menjelajahi dasar sumber terbuka Z-Image-Turbo. Kemudian, Anda akan mendapatkan wawasan tentang metode akses API dan mengonfirmasi struktur harga gratisnya. Terakhir, Anda akan menerapkan integrasi praktis. Langkah-langkah ini membekali Anda untuk menyebarkan kemampuan pembuatan gambar secara efektif.

Memahami Model Sumber Terbuka Z-Image-Turbo

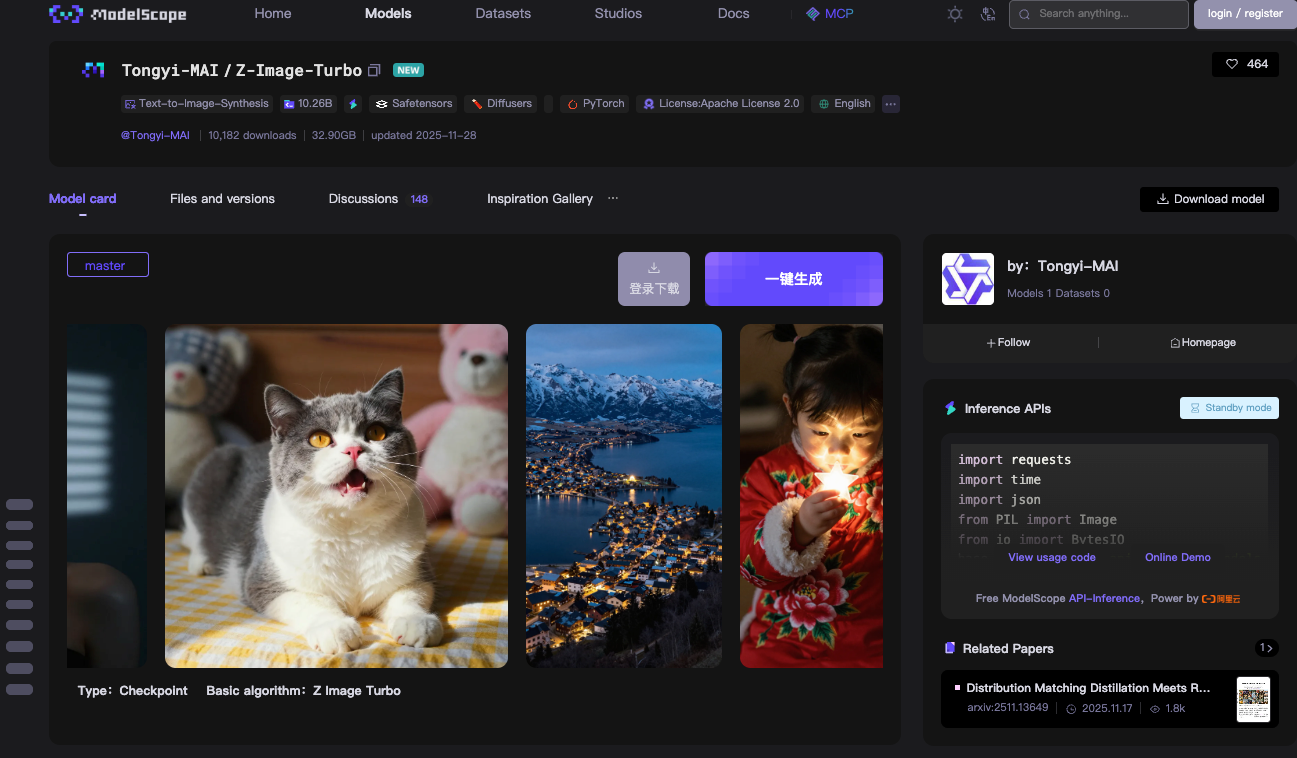

Anda memulai dengan teknologi inti di balik API Z-Image: model Z-Image-Turbo. Tim Tongyi-MAI Alibaba merilis model 6 miliar parameter ini sebagai sumber terbuka penuh di bawah Apache 2.0. Lisensi ini mengizinkan penggunaan komersial, modifikasi, dan distribusi tanpa batasan, yang mempercepat adopsi di lingkungan produksi.

Z-Image-Turbo dibangun di atas arsitektur Scalable Single-Stream Diffusion Transformer (S3-DiT). Model dual-stream tradisional memisahkan pemrosesan teks dan gambar, yang membuang parameter. Namun, S3-DiT menggabungkan token teks, token semantik visual, dan token VAE gambar menjadi satu aliran terpadu. Desain ini memaksimalkan efisiensi. Hasilnya, model ini muat dalam VRAM 16GB pada GPU konsumen seperti kartu seri NVIDIA RTX 40. Anda mencapai ini tanpa mengorbankan kualitas keluaran.

Model ini unggul dalam sintesis gambar fotorealistik. Model ini menghasilkan pemandangan, potret, dan lanskap yang detail dari prompt deskriptif. Misalnya, prompt seperti "danau gunung yang tenang saat senja dengan papan nama bilingual dalam bahasa Inggris dan Cina" menghasilkan visual yang tajam dan sesuai konteks. Z-Image-Turbo menangani instruksi kompleks dengan baik, berkat Prompt Enhancer terintegrasinya. Komponen ini menyempurnakan input untuk kepatuhan yang lebih baik, mengurangi artefak yang umum pada model difusi sebelumnya.

Kecepatan inferensi menjadi keunggulan Z-Image-Turbo. Ini hanya membutuhkan 8 Number of Function Evaluations (NFE), setara dengan 9 langkah inferensi dalam praktiknya. Pada GPU H800 perusahaan, Anda akan melihat latensi di bawah satu detik—seringkali di bawah 500ms per gambar. Pengaturan konsumen mencapai 2-5 detik, tergantung pada perangkat keras. Efisiensi ini berasal dari teknik distilasi seperti Decoupled-DMD dan DMDR, yang mengompresi model dasar Z-Image sambil mempertahankan kinerja.

Anda mengunduh bobot model dari repositori ModelScope atau Hugging Face. Cabang master menyertakan file checkpoint total sekitar 24GB. Kompatibilitas PyTorch memastikan integrasi yang luas. Untuk pengujian lokal, Anda menginstal dependensi melalui pip: torch, torchvision, dan modelscope>=1.18.0. Skrip pipeline dasar memuat model dan menghasilkan gambar dalam waktu kurang dari 10 baris kode.

Pertimbangkan contoh ini untuk inferensi lokal:

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

import torch

device = "cuda" if torch.cuda_is_available() else "cpu"

pipe = pipeline(Tasks.text_to_image_synthesis, model="Tongyi-MAI/Z-Image-Turbo", device=device)

output = pipe({

"text": "A photorealistic golden retriever playing in a sunlit park, 1024x1024",

"width": 1024,

"height": 1024,

"num_inference_steps": 9

})

output["output_imgs"][0].save("generated_image.png")

Kode ini menginisialisasi pipeline, memproses prompt, dan menyimpan hasilnya. Anda melihat parameter num_inference_steps: 9— ini memicu distilasi 8 langkah untuk kecepatan optimal. Skala panduan tetap 0.0, karena varian Turbo melewati panduan bebas pengklasifikasi untuk mempertahankan kecepatan.

Benchmark mengonfirmasi daya saing Z-Image-Turbo. Di AI Arena Alibaba, ia mendapat skor tinggi dalam evaluasi preferensi manusia berbasis Elo, mengungguli banyak rekan sumber terbuka dalam fotorealisme dan fidelitas teks. Dibandingkan dengan model seperti Stable Diffusion 3, ia menggunakan lebih sedikit langkah dan memori, namun memberikan detail yang sebanding.

Namun, ada batasan. Model ini memprioritaskan kecepatan daripada resolusi ekstrem; mendorong di atas 1536x1536 dapat menyebabkan keburaman tanpa penyesuaian. Model ini juga tidak memiliki pengeditan gambar-ke-gambar asli dalam varian Turbo—itu akan menjadi tanggung jawab rilis Z-Image-Edit yang akan datang. Namun demikian, untuk tugas teks-ke-gambar, Z-Image-Turbo menyediakan dasar yang kokoh dan mudah diakses.

Anda memperluas model ini melalui API Z-Image, yang menghostingnya di infrastruktur ModelScope. Pergeseran dari lokal ke cloud ini menghilangkan beban penyiapan. Akibatnya, Anda fokus pada logika aplikasi daripada optimasi perangkat keras.

Mengakses API Z-Image Gratis: Penyiapan Langkah demi Langkah

Anda beralih dengan mulus ke integrasi API. API Z-Image beroperasi melalui layanan inferensi ModelScope, yang menghosting Z-Image-Turbo untuk panggilan jarak jauh. Penyiapan ini membutuhkan konfigurasi minimal, namun memberikan keandalan tingkat perusahaan.

Pertama, Anda mendaftar di platform ModelScope. Buat akun dengan email atau kredensial GitHub Anda. Setelah masuk, navigasikan ke bagian API di bawah profil Anda. Hasilkan Token ModelScope—ini berfungsi sebagai kunci otentikasi Bearer Anda. Simpan dengan aman, karena semua permintaan memerlukannya di header Otorisasi.

Endpoint API berpusat pada pemrosesan asinkron, yang sesuai untuk kebutuhan throughput tinggi. Anda mengirimkan tugas generasi melalui POST ke https://api-inference.modelscope.cn/v1/images/generations. Respons akan segera mengembalikan task_id. Kemudian, Anda melakukan polling https://api-inference.modelscope.cn/v1/tasks/{task_id} setiap 5-10 detik hingga selesai. Desain ini mencegah timeout pada generasi yang panjang, meskipun kecepatan Z-Image-Turbo menjaga waktu tunggu tetap singkat—biasanya 5-15 detik dari awal hingga akhir.

Header utama meliputi:

Authorization: Bearer {your_token}Content-Type: application/jsonX-ModelScope-Async-Mode: true(untuk pengiriman)X-ModelScope-Task-Type: image_generation(untuk pemeriksaan status)

Isi permintaan menentukan parameter seperti ID model, prompt, dimensi, dan langkah. Anda menyetel "model": "Tongyi-MAI/Z-Image-Turbo" untuk menargetkan varian ini. Dimensi default adalah 1024x1024, tetapi Anda menyesuaikan height dan width untuk rasio aspek kustom. Pertahankan guidance_scale: 0.0 dan num_inference_steps: 9 untuk hasil terbaik.

Contoh curl lengkap menggambarkan prosesnya:

# Langkah 1: Kirim tugas

curl -X POST "https://api-inference.modelscope.cn/v1/images/generations" \

-H "Authorization: Bearer YOUR_TOKEN" \

-H "Content-Type: application/json" \

-H "X-ModelScope-Async-Mode: true" \

-d '{

"model": "Tongyi-MAI/Z-Image-Turbo",

"prompt": "A futuristic cityscape at night with neon signs in Chinese and English",

"height": 1024,

"width": 1024,

"num_inference_steps": 9,

"guidance_scale": 0.0

}'

# Ekstrak task_id dari respons, cth., {"task_id": "abc123"}

# Langkah 2: Periksa status

curl -X GET "https://api-inference.modelscope.cn/v1/tasks/abc123" \

-H "Authorization: Bearer YOUR_TOKEN" \

-H "X-ModelScope-Task-Type: image_generation"

Saat berhasil, respons status menyertakan "task_status": "SUCCEED" dan array output_images dengan URL yang dapat diunduh. Anda mengambil gambar melalui GET, menyimpannya sebagai PNG atau JPEG.

Untuk alternatif sinkron, ModelScope menawarkan demo online di modelscope.cn/aigc/imageGeneration. Pilih Z-Image-Turbo sebagai model default. Mode Cepat menghasilkan gambar tanpa parameter, sedangkan Mode Lanjutan mengekspos kontrol penuh. Antarmuka ini berfungsi untuk pembuatan prototipe, tetapi Anda lebih memilih API untuk otomatisasi.

Penanganan kesalahan terbukti penting. Kode umum termasuk 401 (token tidak valid), 429 (batas laju), dan 500 (masalah server). Terapkan percobaan ulang dengan exponential backoff dalam kode produksi. Batas laju berkisar antara 10-20 permintaan per menit untuk tingkatan gratis, meskipun kuota yang tepat bervariasi berdasarkan akun.

Anda mengintegrasikan API ini ke berbagai lingkungan. Pengembang Python menggunakan requests untuk panggilan HTTP, seperti yang ditunjukkan sebelumnya. Pengguna Node.js memanfaatkan axios untuk polling berbasis promise. Bahkan fungsi tanpa server di AWS Lambda atau Vercel dapat dengan mudah diimplementasikan, mengingat payload yang ringan.

Apidog meningkatkan fase akses ini. Impor spesifikasi API ke Apidog, yang secara otomatis menghasilkan dokumentasi dan kasus uji. Anda mensimulasikan respons, merantai permintaan untuk polling, dan mengekspor koleksi untuk berbagi tim. Platform ini mengurangi waktu debugging, memungkinkan Anda fokus pada rekayasa prompt.

Melalui langkah-langkah ini, Anda membangun koneksi yang andal ke API Z-Image. Sekarang, Anda akan memeriksa harganya untuk mengonfirmasi efektivitas biaya.

Harga dan Kuota untuk API Z-Image

Anda mengonfirmasi keterjangkauan selanjutnya. API Z-Image tidak membebankan biaya untuk inferensi. ModelScope menyediakan komputasi gratis tanpa batas untuk panggilan Z-Image-Turbo, seperti yang diumumkan di postingan X resmi mereka. Model tanpa biaya ini mencakup hosting, bandwidth, dan sumber daya GPU—sebuah hal langka di antara layanan AI AI.

Namun, kuota berlaku untuk mencegah penyalahgunaan. Akun gratis menghadapi batas lunak: sekitar 50-100 generasi per jam, direset secara berkala. Anda memantau penggunaan melalui dasbor ModelScope. Melebihi batas akan memicu pembatasan sementara, tetapi Anda dapat meng-upgrade ke tingkatan pro untuk volume yang lebih tinggi jika diperlukan. Paket pro dimulai dengan biaya rendah, tetapi tingkatan gratis sudah cukup untuk sebagian besar pengembang dan penghobi.

Praktik Terbaik untuk Mengoptimalkan Performa API Z-Image

Anda menyempurnakan penggunaan Anda dengan strategi yang ditargetkan. Pertama, pilih parameter optimal. Pertahankan 1024x1024 untuk keseimbangan; tingkatkan resolusi setelah generasi jika diperlukan. Batasi langkah hingga 9—nilai yang lebih tinggi memperlambat inferensi tanpa keuntungan.

Akselerasi perangkat keras meningkatkan hibrida lokal. Aktifkan Flash Attention di Diffuser: pipe.transformer.set_attention_backend("flash"). Ini mengurangi memori sebesar 20-30% pada GPU Ampere.

Rekayasa prompt meningkatkan kualitas. Strukturkan input sebagai "subjek + aksi + lingkungan + gaya." Uji variasi dalam mode mock Apidog untuk berulang dengan cepat.

Praktik keamanan melindungi integrasi. Jangan pernah mengekspos token dalam kode sisi klien; gunakan proxy server. Validasi input untuk mencegah serangan injeksi.

Alat pemantauan melacak metrik. Catat waktu generasi, tingkat keberhasilan, dan penggunaan token. Alat seperti Prometheus mudah diintegrasikan untuk dasbor.

Kesimpulan

Anda sekarang sepenuhnya menguasai API Z-Image. Dari memahami arsitektur sumber terbuka Z-Image-Turbo hingga mengeksekusi panggilan API dan mengoptimalkan alur kerja, panduan ini membekali Anda untuk sukses. Model harga gratis mendemokratisasikan pembuatan gambar tingkat lanjut, sementara alat seperti Apidog menyederhanakan pengembangan.

Terapkan teknik ini dalam proyek Anda berikutnya. Bereksperimenlah dengan prompt, tingkatkan integrasi, dan berkontribusi pada ekosistem. Seiring berkembangnya AI, Z-Image-Turbo menempatkan Anda di garis depan alat yang efisien dan kreatif.