Alibaba lance Qwen3-Max, un modèle de langage étendu phare qui repousse les limites des capacités de l'intelligence artificielle. Ce modèle est issu de la série Qwen, réputée pour ses avancées dans les modèles de fondation ouverts visant l'intelligence artificielle générale. Les développeurs et les chercheurs ont désormais accès à un outil qui excelle dans les tâches complexes, des défis de codage au raisonnement multifacette. Alors que les équipes intègrent Qwen3-Max via son API pour des applications réelles, des tests efficaces deviennent essentiels.

Qwen3-Max s'étend à plus d'un billion de paramètres, entraîné sur 36 billions de jetons, soit le double de Qwen2.5. Il gère les tâches d'agent et suit les instructions avec précision. Bien qu'il démarre sans modes de réflexion explicites, les fonctionnalités à venir ajouteront des améliorations de raisonnement.

Le modèle prend en charge plus de 100 langues, étendant son utilisation mondiale. Alibaba propose un accès API sur son cloud, simplifiant le déploiement.

Spécifications techniques de Qwen3-Max

Alibaba conçoit Qwen3-Max en mettant l'accent sur l'évolutivité et l'efficacité. Le modèle dispose de plus d'un billion de paramètres, le positionnant parmi les plus grands modèles d'IA disponibles via API. Cette taille immense permet au système de traiter de vastes quantités de données pendant le pré-entraînement, ce qui se traduit par de solides capacités de reconnaissance de formes et de génération. Les ingénieurs entraînent Qwen3-Max sur un ensemble de données dépassant 36 billions de jetons, doublant le volume utilisé dans les générations précédentes comme Qwen2.5.

Qwen3-Max dispose d'une fenêtre contextuelle de 262 144 jetons, avec une entrée maximale de 258 048 jetons et une sortie maximale de 65 536 jetons. Ce contexte étendu permet au modèle de gérer des documents longs, des conversations prolongées et des séquences complexes de résolution de problèmes sans perdre de cohérence. Les développeurs en bénéficient dans des applications comme l'analyse de documents ou les dialogues multi-tours. Cependant, l'interface de chat peut imposer des limitations apparentes, mais le modèle sous-jacent prend en charge la pleine capacité via les appels API.

Qwen3-Max fonctionne comme un modèle d'instruction non-réfléchissant dans sa version initiale, privilégiant la génération de réponses directes. Alibaba prévoit d'introduire des fonctionnalités de raisonnement, y compris l'utilisation d'outils et le déploiement en mode lourd, qui promettent des scores de référence quasi parfaits. L'architecture s'inspire de la série Qwen3, intégrant des améliorations en matière de suivi des instructions, de réduction des hallucinations et de support multilingue amélioré. Pour le déploiement, des frameworks comme vLLM et SGLang facilitent un service efficace, prenant en charge le parallélisme tensoriel sur plusieurs GPU.

En termes d'exigences matérielles, Qwen3-Max exige des ressources de calcul substantielles. L'exécuter localement nécessite des configurations haut de gamme, mais l'accès API atténue cela en tirant parti de l'infrastructure cloud d'Alibaba. La tarification suit une structure échelonnée basée sur le volume de jetons : pour 0 à 32K jetons, les coûts d'entrée sont de 1,2 $ par million, de sortie de 6 $ par million ; pour 32K à 128K, 2,4 $ et 12 $ ; et pour 128K à 252K, 3 $ et 15 $. Les nouveaux utilisateurs reçoivent un quota gratuit d'un million de jetons valable 90 jours, encourageant l'expérimentation.

De plus, Qwen3-Max s'intègre aux API compatibles OpenAI, simplifiant la migration depuis d'autres fournisseurs. Cette compatibilité s'étend à la mise en cache du contexte, qui optimise les requêtes répétées et réduit les coûts dans les environnements de production. Néanmoins, pour des opérations stables, les utilisateurs choisissent entre les versions les plus récentes et les versions instantanées pour gérer efficacement les limites de débit.

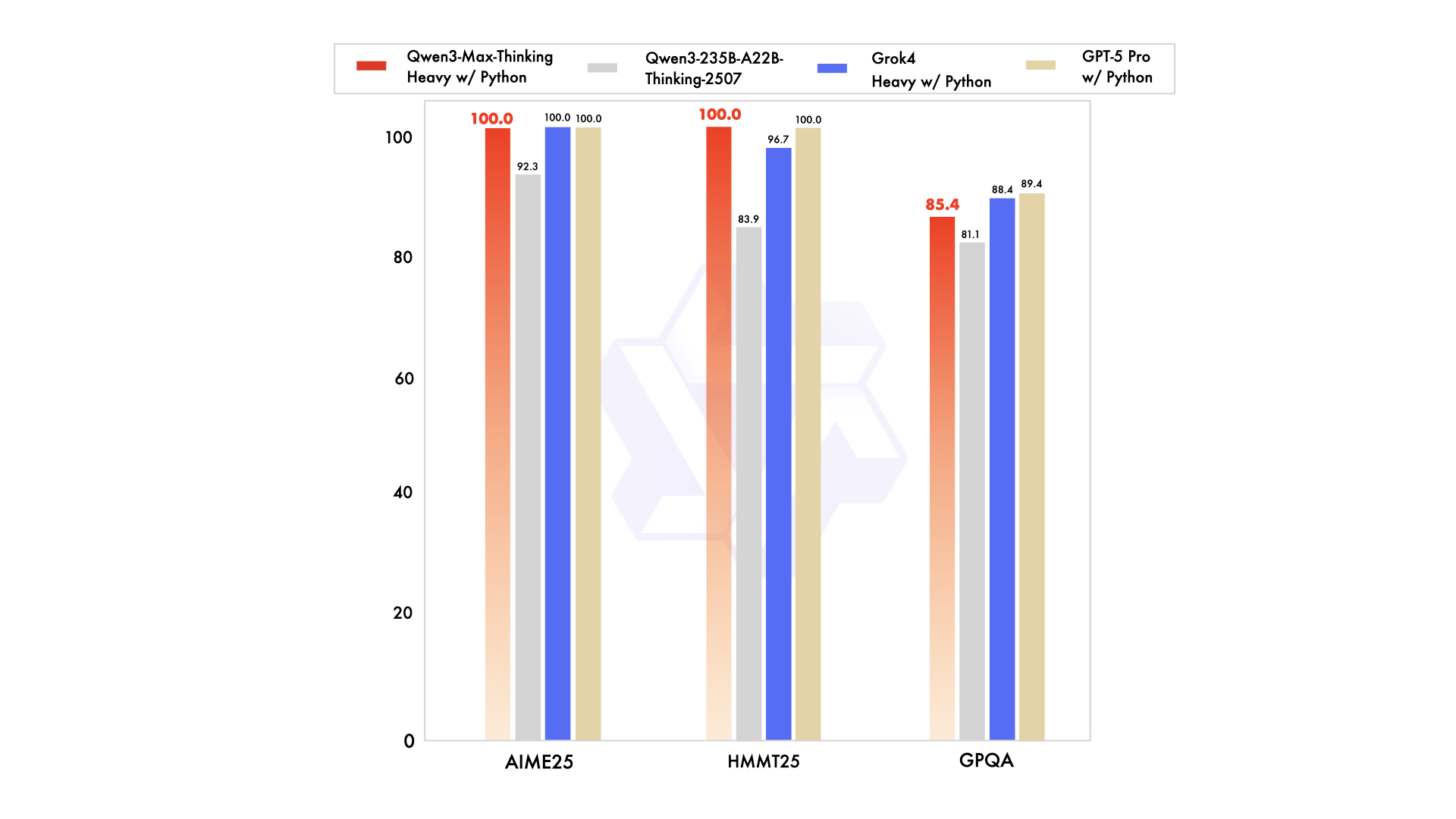

Analyse des performances de référence

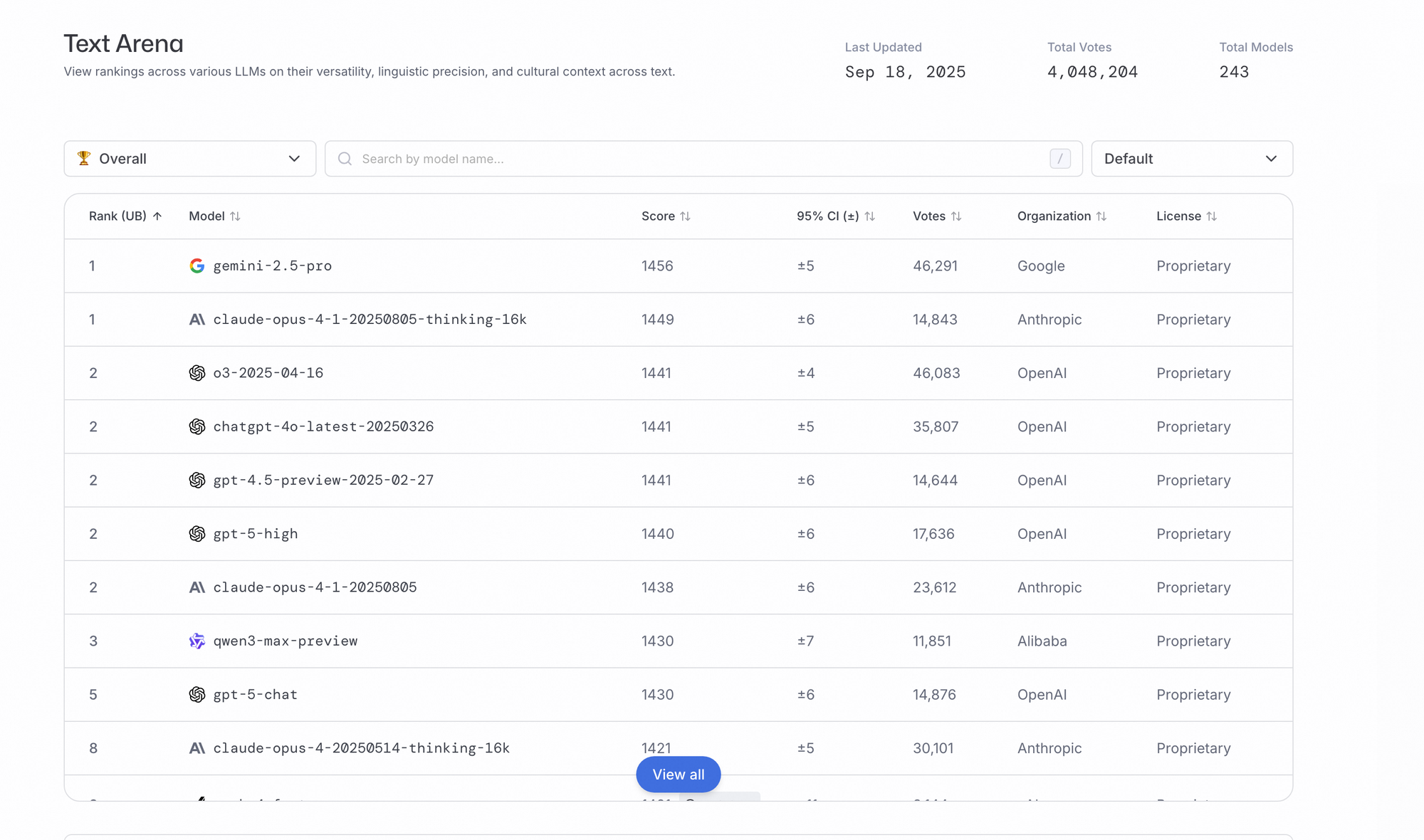

Qwen3-Max démontre des résultats exceptionnels sur plusieurs benchmarks, consolidant sa position de leader en performance IA. Alibaba évalue le modèle sur des tests rigoureux axés sur le codage, les mathématiques et le raisonnement général. Par exemple, sur SuperGPQA, Qwen3-Max-Instruct obtient un score de 65,1, dépassant Claude Opus 4 à 56,5 et DeepSeek-V3.1 à 43,9.

De plus, dans AIME25, un benchmark mathématique exigeant, Qwen3-Max atteint 81,6, nettement devant Qwen3-235B-A22B à 70,3 et d'autres. Cela souligne sa maîtrise dans la résolution de problèmes mathématiques avancés, où la précision et la déduction logique s'avèrent critiques. En passant aux évaluations de codage, LiveCodeBench v6 donne un score de 74,8 pour Qwen3-Max, surpassant des concurrents comme Non-thinking à 52,3.

De plus, Tau2-Bench (Verified) voit Qwen3-Max à 69,6, tandis que SWE-Bench Verified enregistre 72,5, tous deux en tête. Ces scores proviennent de défis de codage réels, où le modèle résout efficacement les problèmes des dépôts GitHub. Alibaba attribue cela à une mise à l'échelle informatique incessante et à des données de pré-entraînement massives.

De plus, Qwen3-Max excelle dans les benchmarks d'agents comme Arena-Hard v2 et LiveBench, se classant constamment au-dessus de Claude Opus 4 et DeepSeek-V3.1. Les tests communautaires révèlent des preuves anecdotiques de comportement de type raisonnement dans des tâches plus difficiles, produisant des réponses structurées malgré sa base non-raisonnante. Cependant, les benchmarks formels confirment sa fiabilité, avec des taux de réussite de 100 % dans des domaines tels que les hallucinations, les connaissances générales et l'éthique.

Les analystes notent que l'augmentation des budgets de réflexion, lorsqu'ils sont activés, améliore les performances dans les domaines des mathématiques, du codage et des sciences. Cette fonctionnalité contrôlée par l'utilisateur, accessible dans l'application Qwen, offre un contrôle granulaire sur la profondeur du raisonnement. Dans l'ensemble, ces métriques soulignent l'efficacité de Qwen3-Max, le classant au 63e centile pour la vitesse et au 34e pour la tarification parmi ses pairs.

Comparaisons avec les modèles d'IA leaders

Qwen3-Max rivalise directement avec des modèles de pointe comme GPT-5, Claude 4 Opus et DeepSeek-V3.1. Dans les tâches de codage, Qwen3-Max surpasse DeepSeek-V3.1 en développement frontend et en conversions Java, bien que les améliorations Python restent modestes. Les retours de la communauté sur des plateformes comme Reddit soulignent son potentiel à égaler ou dépasser GPT-5 Pro avant la fin de l'année.

De plus, face à Claude Opus 4, Qwen3-Max est en tête dans SuperGPQA et AIME25, démontrant des capacités mathématiques et générales plus solides. L'échelle d'un billion de paramètres du modèle offre un avantage en matière de couverture des connaissances à longue traîne, réduisant les hallucinations par rapport à ses prédécesseurs. Cependant, les modes de raisonnement de Claude offrent des avantages dans certains scénarios, que Qwen3-Max abordera avec les mises à jour à venir.

Dans les tâches multilingues, Qwen3-Max prend en charge plus de 100 langues, rivalisant avec Gemini-2.5-Pro et Grok-3. Les benchmarks montrent des résultats compétitifs par rapport à ceux-ci, en particulier en matière de suivi des instructions et d'utilisation d'outils. En termes de prix, Qwen3-Max s'avère plus rentable, avec des tarifs échelonnés inférieurs aux options premium d'OpenAI et d'Anthropic.

De plus, comparé aux modèles à poids ouverts comme Qwen3-235B-A22B, la variante Max améliore les compétences d'agent sans réflexion approfondie, atteignant des scores plus élevés dans SWE-Bench et Tau2-Bench. Cela le positionne comme un hybride entre les forces des sources ouvertes et fermées, bien que sa nature fermée suscite des débats sur l'accessibilité.

Fonctionnalités et capacités clés

Qwen3-Max excelle dans le suivi des instructions pour les chatbots et l'écriture. Des hallucinations réduites garantissent la fiabilité en classification et en éthique.

Les fonctionnalités d'agent gèrent les processus multi-étapes via l'appel d'outils Qwen-Agent. Les réponses rapides conviennent aux applications en temps réel.

Il prend en charge l'appel de fonctions compatible OpenAI. Le contexte long facilite l'analyse des données ; les paramètres améliorent la créativité.

En tant que non-raisonnant, il s'adapte à la pensée structurée. Les futurs budgets de réflexion ajustent les performances du domaine.

Intégration et utilisation de l'API avec Apidog

Les développeurs accèdent à Qwen3-Max principalement via l'API d'Alibaba Cloud, qui prend en charge les points de terminaison compatibles OpenAI. Cette configuration permet une intégration simple dans les applications utilisant des bibliothèques standard. Par exemple, les utilisateurs appellent l'API avec des invites comme "Pourquoi le ciel est-il bleu ?" pour générer des réponses.

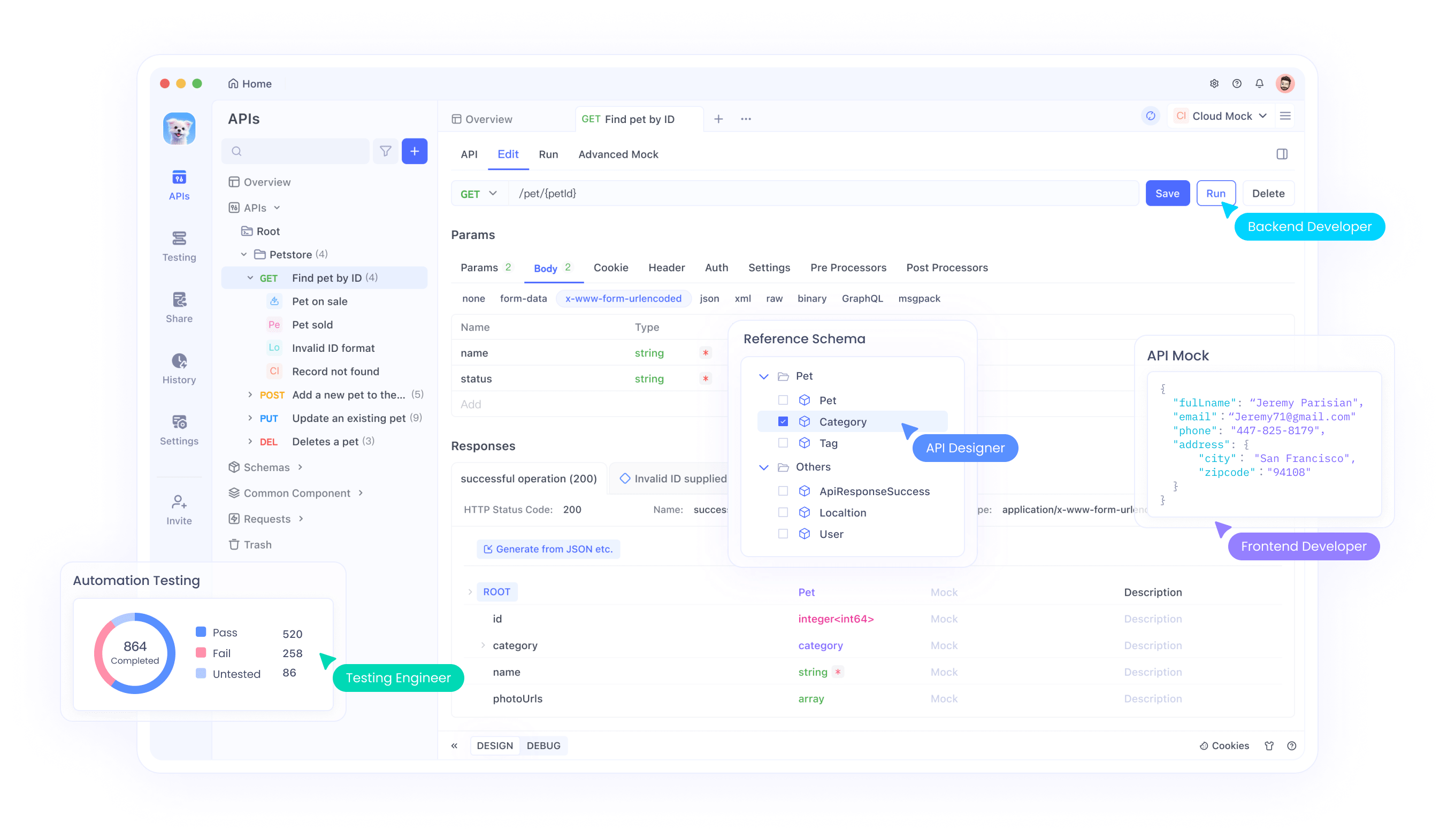

Apidog joue un rôle crucial ici, offrant une plateforme intuitive pour les tests et la gestion d'API. Les ingénieurs utilisent Apidog pour simuler des requêtes, surveiller les réponses et déboguer les intégrations avec Qwen3-Max. Les fonctionnalités de l'outil, telles que l'enchaînement des requêtes et les variables d'environnement, simplifient les flux de travail lors de la gestion de grands volumes de jetons.

De plus, Apidog prend en charge la collaboration, permettant aux équipes de partager des collections d'API pour les projets Qwen3-Max. Pour commencer, téléchargez Apidog gratuitement et importez les spécifications de l'API Qwen à partir de la documentation d'Alibaba. Cela garantit des tests efficaces de fonctionnalités telles que la mise en cache du contexte, qui réduit la latence dans les tâches répétitives.

De plus, les intégrations avec des fournisseurs comme OpenRouter et Vercel AI Gateway élargissent les options. Apidog facilite le basculement entre ceux-ci, assurant la compatibilité et la surveillance des performances à travers les écosystèmes.

Cas d'utilisation de Qwen3-Max

Les organisations appliquent Qwen3-Max dans divers scénarios, tirant parti de ses capacités d'innovation. Dans le développement logiciel, le modèle aide à la génération de code et au débogage, résolvant les problèmes GitHub avec une grande précision sur SWE-Bench. Les développeurs l'intègrent via API pour automatiser les requêtes de tirage ou refactoriser le code existant.

De plus, dans l'éducation, Qwen3-Max résout des problèmes mathématiques avancés, aidant les tuteurs à expliquer des concepts issus des benchmarks AIME25. Son support multilingue permet aux plateformes d'apprentissage mondiales de fournir du contenu dans les langues natives.

Dans les environnements d'entreprise, les fonctionnalités d'agent alimentent les outils d'automatisation, tels que les chatbots pour le service client ou les pipelines d'analyse de données. Les prestataires de soins de santé l'utilisent pour le soutien à la décision éthique, bénéficiant de scores parfaits dans les benchmarks d'éthique.

De plus, les industries créatives utilisent Qwen3-Max pour l'écriture et la génération de contenu, où les hallucinations réduites garantissent des sorties de qualité. Les plateformes de commerce électronique l'intègrent pour des recommandations personnalisées, traitant de longs contextes à partir des historiques des utilisateurs.

Cependant, dans la recherche, les scientifiques explorent son potentiel de raisonnement pour les simulations et les tests d'hypothèses, anticipant des améliorations des modes de pensée.

Conclusion

Qwen3-Max transforme les paysages de l'IA avec sa puissance d'un billion de paramètres et sa domination des benchmarks. Les développeurs exploitent sa puissance via des API, améliorées par des outils comme Apidog pour une intégration efficace. Alors qu'Alibaba affine le modèle, il promet des innovations encore plus grandes en matière de codage, de raisonnement et au-delà. Les équipes adoptent Qwen3-Max aujourd'hui pour rester compétitives dans un domaine en évolution.