Open API change la donne pour les modèles open source en offrant un moyen clair et standardisé de documenter et d'utiliser les API. Cela facilite le travail des développeurs avec des modèles comme GPT-OSS-120B et GPT-OSS-20B, hébergés sur des plateformes comme Hugging Face. Des outils comme Apidog simplifient le développement, les tests et la documentation des API, s'alignant parfaitement avec l'éthique open source.

Cet article explique comment Open API s'intègre aux modèles open source, ses avantages techniques et son potentiel pour stimuler l'innovation.

Pourquoi Open AI a-t-il adopté l'Open Source ?

Historiquement, Open AI a maintenu une position propriétaire, publiant des modèles comme GPT-3 et GPT-4 via des API restreintes. Cependant, les pressions concurrentielles des géants de l'open source comme Llama de Meta et R1 de DeepSeek, associées à la demande de transparence de la communauté, ont provoqué un pivot stratégique. En 2025, Open AI vient de publier des modèles à poids ouverts, en commençant par GPT-OSS-120B et GPT-OSS-20B. Ce changement s'aligne sur les tendances de l'industrie vers l'ouverture, où les développeurs recherchent des modèles personnalisables sans dépendance vis-à-vis d'un fournisseur.

Cette décision reflète une réponse pragmatique aux dynamiques du marché. Les modèles open source réduisent la dépendance aux API basées sur le cloud, diminuent les coûts et permettent un déploiement local. En rendant les poids et les paramètres open source, Open AI permet aux développeurs d'affiner les modèles pour des cas d'utilisation spécifiques, du traitement du langage naturel à la génération de code. De plus, cette initiative répond aux critiques concernant la sécurité et la transparence, car Open AI s'engage à des tests d'intrusion rigoureux et à la publication de fiches modèles pour assurer un déploiement responsable.

Que sont les modèles Open Source d'Open AI ?

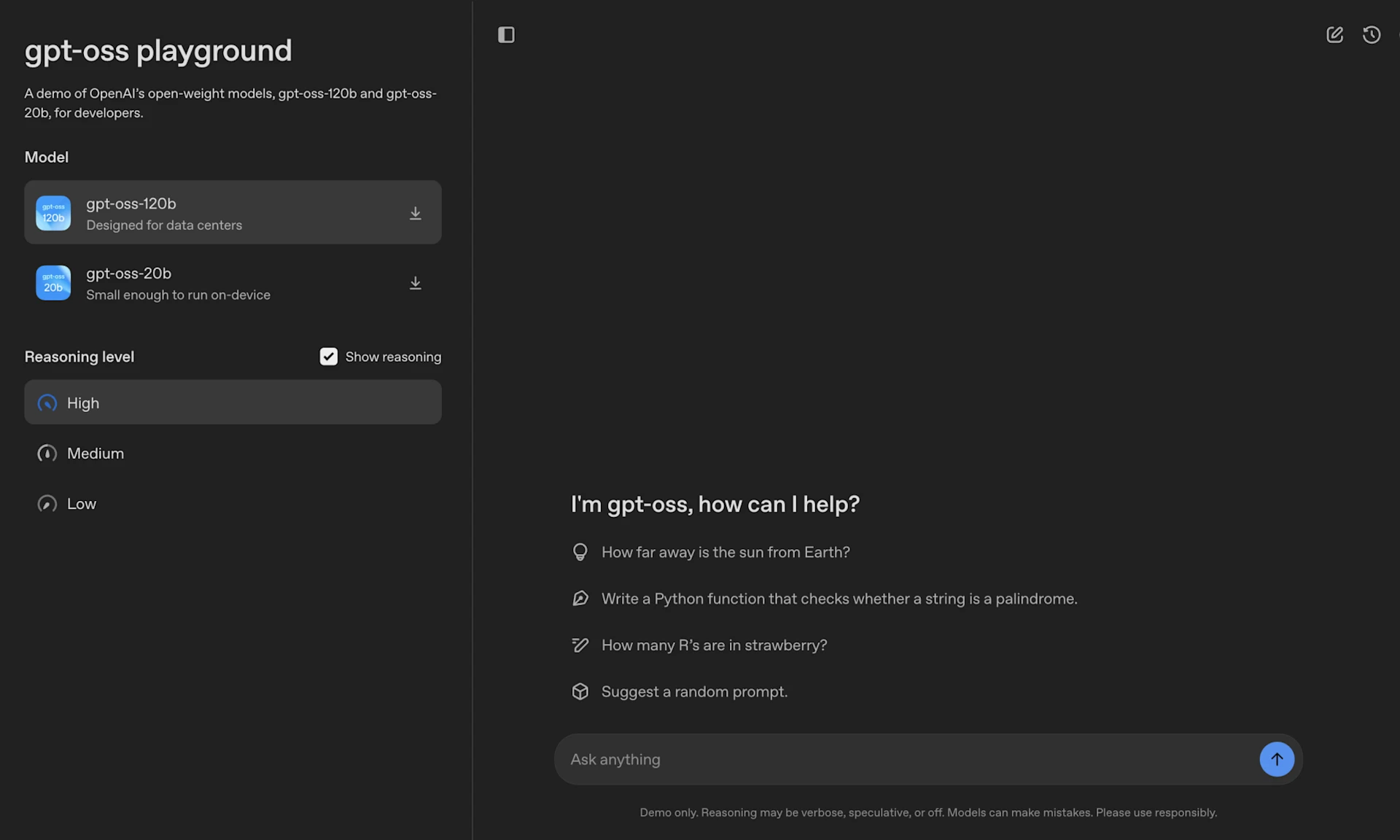

Les offres open source d'Open AI, notamment les GPT-OSS-120B et GPT-OSS-20B, sont hébergées sur des plateformes comme Hugging Face et GitHub. Ces modèles, construits sur une architecture de Mélange d'Experts (MoE), équilibrent performance et efficacité. Le GPT-OSS-120B, avec 120 milliards de paramètres, rivalise avec les modèles propriétaires comme GPT-4 pour les tâches de raisonnement et de langage, tandis que le GPT-OSS-20B cible les environnements à ressources limitées.

Spécifications techniques du GPT-OSS-120B

- Architecture : Mélange d'Experts avec activation parcimonieuse, réduisant la surcharge computationnelle tout en maintenant des performances élevées.

- Paramètres : 120 milliards, optimisés pour des tâches comme la génération de texte, la synthèse et la synthèse de code.

- Données d'entraînement : Ensembles de données organisés, bien que non entièrement divulgués, privilégiant la qualité à la quantité par rapport à des modèles comme DeepSeek R1.

- Licence : MIT, permettant une utilisation commerciale et non commerciale étendue.

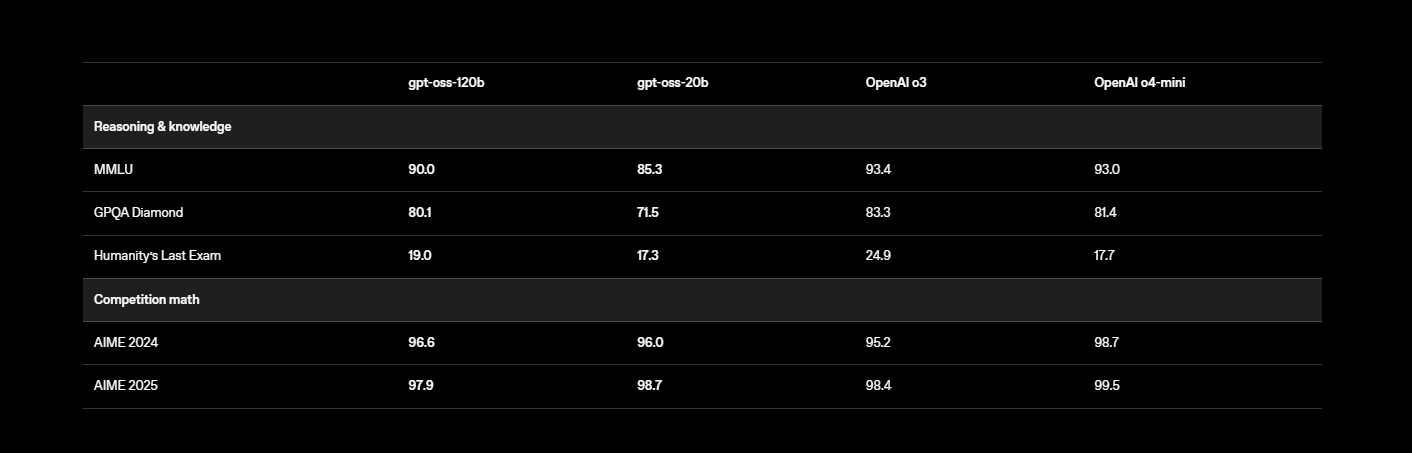

- Performance : Les benchmarks montrent qu'il rivalise avec les modèles propriétaires sur MMLU et MATH, excellant dans les tâches exigeant un raisonnement intensif.

Spécifications techniques du GPT-OSS-20B

- Architecture : MoE réduite, conçue pour l'efficacité sur du matériel modeste.

- Paramètres : 20 milliards, adaptés aux appareils périphériques et aux applications à petite échelle.

- Cas d'utilisation : Idéal pour les chatbots en temps réel, les tâches NLP légères et le prototypage.

- Licence : MIT, assurant la flexibilité pour les développeurs.

- Performance : Égale des modèles plus petits comme Phi-2 en termes d'efficacité, avec une précision compétitive dans la génération de texte.

Ces modèles, accessibles via Hugging Face, aident les développeurs à créer des applications sans dépendre de l'infrastructure cloud d'Open AI. Le site web GPT-OSS fournit des ressources supplémentaires, y compris de la documentation et des forums communautaires.

Comment les modèles Open Source d'Open AI se comparent-ils à leurs concurrents ?

Le paysage de l'IA est encombré de concurrents open source. Llama de Meta, Gemma de Google et R1 de DeepSeek ont établi des références en matière de performance et de rentabilité. Les modèles d'Open AI, cependant, se taillent une niche unique. Par exemple, DeepSeek R1, entraîné pour 5,6 millions de dollars, met l'accent sur un entraînement rentable, mais le GPT-OSS-120B d'Open AI privilégie les capacités de raisonnement, comme en témoignent ses scores MMLU. Pendant ce temps, Llama excelle dans les applications d'entreprise, mais ses données d'entraînement restreintes limitent la transparence par rapport aux fiches modèles d'Open AI.

Benchmarks de performance

- MMLU (Massive Multitask Language Understanding) : Le GPT-OSS-120B obtient des scores comparables à GPT-4, surpassant Llama 3 dans les tâches de raisonnement.

- MATH : Excelle dans la résolution de problèmes mathématiques, rivalisant avec DeepSeek R1.

- Génération de code : Égale Grok-1 de xAI dans la génération de code propre et fonctionnel, comme en témoignent les contributions aux dépôts GitHub.

Coût et Accessibilité

Contrairement aux modèles basés sur le cloud qui facturent par jeton, les modèles open source d'Open AI éliminent les frais d'utilisation. Les développeurs peuvent les déployer localement, réduisant les coûts et améliorant la confidentialité des données. Des outils comme Apidog simplifient l'intégration des API, permettant une interaction transparente avec ces modèles pour des tâches comme la génération de texte en temps réel ou l'analyse de données.

Comment les développeurs peuvent-ils tirer parti des modèles Open Source d'Open AI ?

Les modèles d'Open AI permettent aux développeurs de créer des applications innovantes. La licence MIT autorise la modification et la redistribution, favorisant un écosystème collaboratif. Voici comment les développeurs peuvent exploiter ces modèles :

1. Déploiement local pour la confidentialité et les économies de coûts

L'exécution de GPT-OSS-120B ou GPT-OSS-20B sur du matériel local élimine la dépendance au cloud. Cette approche convient aux entreprises traitant des données sensibles, comme la santé ou la finance. Des frameworks comme TensorFlow ou PyTorch, combinés à la bibliothèque Transformers de Hugging Face, simplifient le déploiement.

2. Affinement pour des cas d'utilisation spécifiques

Les développeurs peuvent affiner les modèles pour des tâches spécifiques à un domaine, telles que l'analyse de documents juridiques ou l'automatisation du service client. Open AI fournit des poids pré-entraînés, réduisant la charge computationnelle de l'entraînement à partir de zéro. Les capacités de test d'API d'Apidog assurent une intégration fluide avec les modèles affinés.

3. Intégration d'API avec Apidog

Pour les applications nécessitant une interaction en temps réel, les développeurs peuvent créer des API pour interfacer avec les modèles GPT-OSS. Apidog simplifie la conception, les tests et la documentation des API, assurant une intégration robuste. Par exemple, un chatbot alimenté par GPT-OSS-20B peut utiliser Apidog pour gérer efficacement les requêtes à volume élevé.

4. Contributions de la communauté

Le dépôt GitHub encourage les contributions de la communauté, des corrections de bugs aux nouvelles fonctionnalités. Cette approche collaborative accélère l'innovation, comme on l'a vu avec l'adoption rapide des modèles basés sur Llama.

Quelles sont les considérations de sécurité et d'éthique ?

La stratégie open source d'Open AI aborde de front les préoccupations de sécurité. Contrairement aux modèles antérieurs critiqués pour des tests de sécurité précipités, les modèles GPT-OSS subissent des tests d'intrusion rigoureux. Le Cadre de Préparation d'Open AI garantit que les risques potentiels, tels que l'utilisation abusive dans les cyberattaques, sont atténués avant la publication. Les fiches modèles offrent une transparence, détaillant les benchmarks et les protocoles de sécurité.

Cependant, les modèles open source posent des défis uniques. Des acteurs malveillants pourraient exploiter les poids des modèles pour des applications nuisibles, comme la génération de désinformation. Open AI y remédie en limitant la divulgation des données d'entraînement et en mettant en œuvre des conditions de licence strictes. Les développeurs doivent adhérer aux directives éthiques, assurant une utilisation responsable dans les environnements de production.

Comment Apidog améliore-t-il l'intégration des modèles Open AI ?

Apidog, une plateforme de collaboration API gratuite, joue un rôle crucial dans l'exploitation des modèles open source d'Open AI. Ses fonctionnalités incluent :

- Conception d'API : Créez des points d'accès pour les interactions avec les modèles, comme la génération de texte ou la synthèse.

- Tests et Débogage : Validez les performances de l'API sous charge, assurant la fiabilité pour les applications en temps réel.

- Documentation : Générez des documents API clairs et conviviaux, simplifiant la collaboration d'équipe.

- Serveurs de maquette (Mock Servers) : Simulez les réponses des modèles pendant le développement, réduisant la dépendance aux instances de modèles en direct.

En intégrant Apidog, les développeurs peuvent créer des applications évolutives avec les modèles GPT-OSS, des chatbots aux générateurs de contenu automatisés. Téléchargez Apidog gratuitement sur apidog.com pour accélérer votre développement IA.

Quel est l'avenir des modèles Open Source d'Open AI ?

L'incursion d'Open AI dans l'open source signale une tendance plus large vers le développement collaboratif de l'IA. À mesure que les entreprises exigent flexibilité et rentabilité, les modèles open source domineront probablement. Open AI prévoit de publier des modèles supplémentaires, incluant potentiellement des LLM capables d'appeler des outils, comme suggéré par les retours de la communauté sur Hacker News. Ces modèles pourraient prendre en charge des tâches comme l'orchestration automatisée de flux de travail ou l'analyse de données avancée.

De plus, la communauté open source stimulera l'innovation. Les contributions au dépôt GitHub de GPT-OSS amélioreront les capacités des modèles, de l'optimisation de la vitesse d'inférence à l'extension du support multilingue. Les partenariats avec des plateformes comme Hugging Face assurent l'accessibilité, tandis que des outils comme Apidog facilitent une intégration transparente.

Défis à venir

Malgré les promesses, des défis subsistent. La transparence des données d'entraînement est un point sensible, car Open AI ne divulgue pas l'intégralité des ensembles de données pour prévenir les risques de réplication. De plus, le déploiement de grands modèles comme GPT-OSS-120B nécessite des ressources computationnelles importantes, ce qui constitue un obstacle pour les petites équipes. Open AI doit équilibrer l'ouverture et la sécurité, garantissant que les modèles restent accessibles tout en étant sécurisés.

Opportunités de croissance

L'approche open source ouvre des portes aux startups et aux chercheurs. En exploitant les modèles GPT-OSS, les petites équipes peuvent rivaliser avec les géants de l'industrie, en créant des applications de niche sans les coûts élevés des API. Les améliorations apportées par la communauté amélioreront encore les performances des modèles, dépassant potentiellement les alternatives propriétaires.

Quel est l'impact des modèles Open AI sur l'écosystème de l'IA ?

Les modèles open source d'Open AI remodèlent le paysage de l'IA. Ils remettent en question la domination des modèles propriétaires, favorisant un écosystème plus inclusif. Les développeurs ont accès à une technologie de pointe, tandis que les entreprises bénéficient de réductions de coûts et de personnalisation. L'effet d'entraînement s'étend à :

- Éducation : Les chercheurs peuvent étudier les architectures de modèles, faisant progresser la théorie de l'IA.

- Startups : L'accès abordable à des modèles puissants uniformise les règles du jeu.

- Entreprises : Le déploiement local assure la souveraineté des données et la conformité.

Le site web GPT-OSS sert de centre de ressources, favorisant la collaboration. À mesure que de plus en plus de développeurs adopteront ces modèles, la communauté de l'IA verra une innovation accélérée, des applications nouvelles aux algorithmes améliorés.

Pourquoi devriez-vous vous intéresser aux modèles Open Source d'Open AI ?

L'initiative open source d'Open AI est plus qu'une étape technique ; c'est un changement de paradigme. Les développeurs gagnent en liberté d'innover, les entreprises réduisent leurs coûts et la communauté stimule le progrès. Des outils comme Apidog amplifient cet impact, simplifiant l'intégration et la mise à l'échelle. Que vous construisiez un chatbot, automatisiez des flux de travail ou exploriez la recherche en IA, ces modèles offrent une flexibilité inégalée.

Pour commencer, explorez les modèles sur Hugging Face ou contribuez au dépôt GitHub. Téléchargez Apidog gratuitement pour optimiser vos flux de travail API et libérer tout le potentiel des modèles open source d'Open AI.