Imaginez un environnement de développement où votre code est conçu par une équipe d'agents d'IA spécialisés. Claude conçoit l'architecture, Gemini écrit les tests et DeepSeek implémente parfaitement les fonctionnalités - le tout fonctionnant en parfaite harmonie. Ce n'est pas une fantaisie futuriste ; c'est la puissance de la pensée séquentielle MCP combinée à OpenRouter. Dans ce guide, nous allons vous montrer comment en faire votre arme secrète pour s'attaquer à des projets complexes.

Qu'est-ce que la pensée séquentielle MCP ?

MCP (Model Context Protocol) Sequential Thinking est une approche révolutionnaire de la résolution de problèmes qui s'attaque aux défis de codage complexes en les décomposant en une série d'étapes claires, logiques et interconnectées. Il s'agit de bien plus que du simple codage ; il s'agit de structurer vos pensées et de tirer parti des forces de différents modèles d'IA à chaque étape du processus de développement. Au lieu de plonger tête baissée dans l'implémentation, MCP Sequential Thinking met l'accent sur :

1. Définition précise du problème : Articuler clairement le problème que vous essayez de résoudre, sans laisser de place à l'ambiguïté.

2. Décomposition des sous-tâches atomiques : Décomposer le problème en sous-tâches plus petites, gérables et indépendantes.

3. Séquencement des dépendances : Identifier et organiser les dépendances entre ces sous-tâches pour assurer un flux d'exécution logique.

4. Flux d'exécution optimisé : Rationaliser l'exécution de ces sous-tâches pour une efficacité et une efficacité maximales.

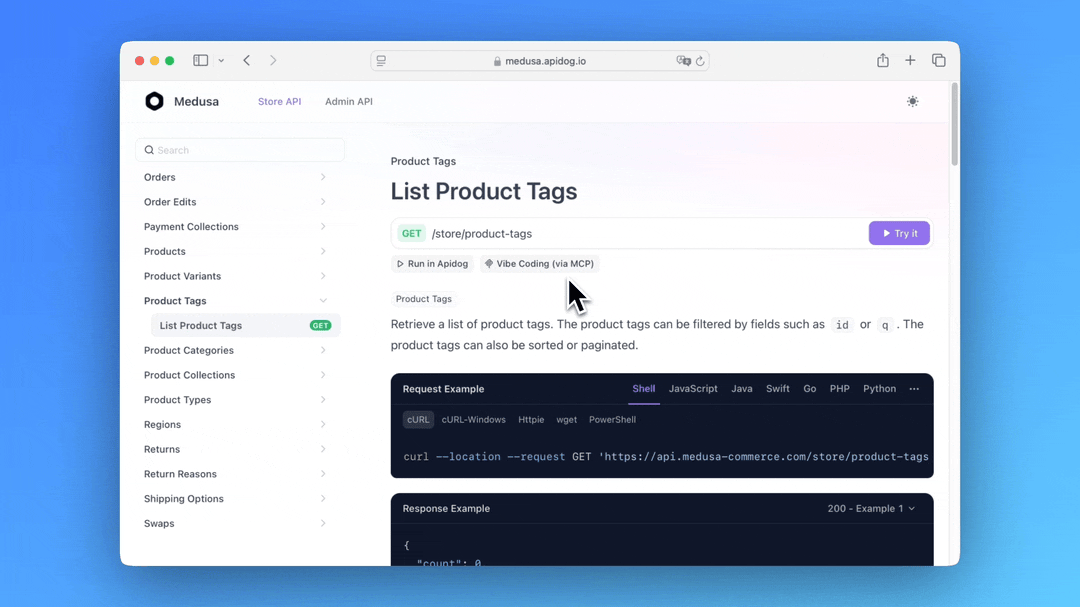

Voici un aperçu rapide de ce qu'offre le serveur Apidog MCP :

- Génère ou modifie du code en fonction de vos spécifications d'API

- Recherche dans le contenu des spécifications de l'API

- Crée des modèles de données et des DTO qui s'alignent de manière transparente sur la conception de votre API

- Ajoute des commentaires et une documentation pertinents basés sur les spécifications de l'API

En agissant comme un pont entre vos projets Apidog et Cursor, le serveur Apidog MCP garantit que votre assistant IA a accès aux conceptions d'API les plus récentes. Cette intégration améliore la fonctionnalité Memory Bank en fournissant des informations d'API structurées que Cursor peut référencer pendant le développement.

Pour en savoir plus, consultez la Documentation ou visitez la page NPM.

De plus, pensez à essayer Apidog, une alternative intégrée, puissante et rentable à Postman !

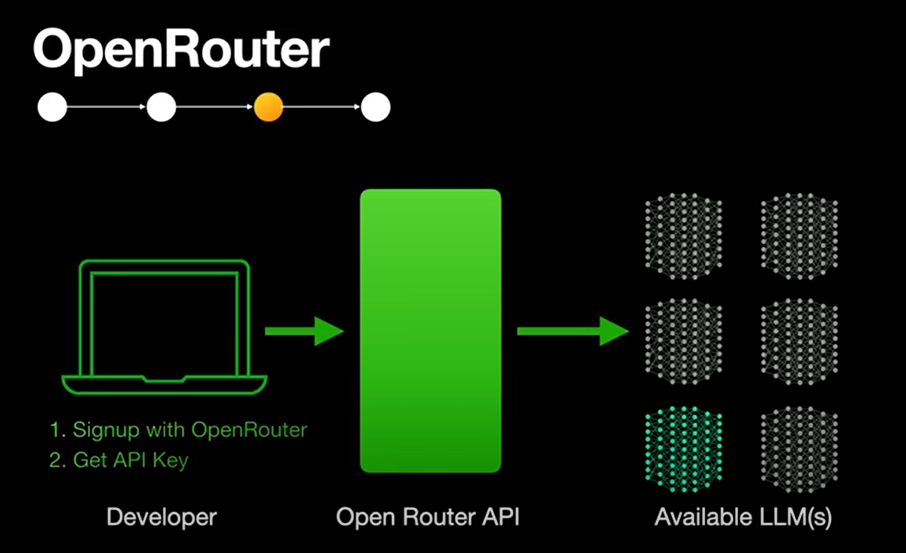

Comment OpenRouter AI améliore ce processus

OpenRouter AI joue un rôle crucial dans l'amélioration de la pensée séquentielle MCP. Il agit comme une passerelle API unifiée, donnant accès à une gamme diversifiée de modèles d'IA (GPT-4, Claude, Mistral, et plus encore). Cela vous permet de tirer parti des forces uniques de différents modèles pour chaque étape de la séquence. OpenRouter AI améliore le processus en :

- Automatisation des étapes de codage répétitives : Vous libère des tâches fastidieuses en générant automatiquement du code boilerplate, en configurant des structures de projet et en configurant des environnements de développement.

- Génération de code boilerplate : Réduit considérablement le temps de développement en créant automatiquement la structure de code de base et les composants initiaux pour chaque tâche.

- Suggérer des optimisations : Fournit des suggestions intelligentes pour améliorer l'efficacité, les performances et la sécurité du code.

- Débogage en temps réel : Aide à identifier et à résoudre rapidement les erreurs grâce à l'analyse du code en temps réel et aux suggestions de débogage intelligentes.

MCP Sequential Thinking 101

Qu'est-ce qui rend cela différent ?

Le codage IA traditionnel implique souvent des conversations à modèle unique, où une seule IA est responsable de l'ensemble de la tâche. En revanche, la pensée séquentielle est comme une chaîne de montage IA :

Task --> [Planner] --> [Researcher] --> [Coder] --> [Reviewer]Exemple concret du fil de discussion du forum :

User: "Build a React dashboard showing real-time crypto prices"

1. Claude-3.5-Sonnet: Creates architecture plan

2. Gemini-2.0-Flash-Thinking: Researches best WebSocket APIs

3. DeepSeek-R1: Implements React components

4. GPT-4-Omni: Reviews code for security flawsComposants clés

1. Réseau de serveurs MCP : Gère le transfert des tâches entre différents modèles d'IA.

2. Passerelle OpenRouter : Achemine les tâches vers le modèle d'IA le plus rentable et le plus approprié.

3. Intégration de l'IDE Cursor : Fournit un contrôle natif du flux de travail directement dans votre environnement de développement.

Configurer la pensée séquentielle MCP et OpenRouter comme un pro

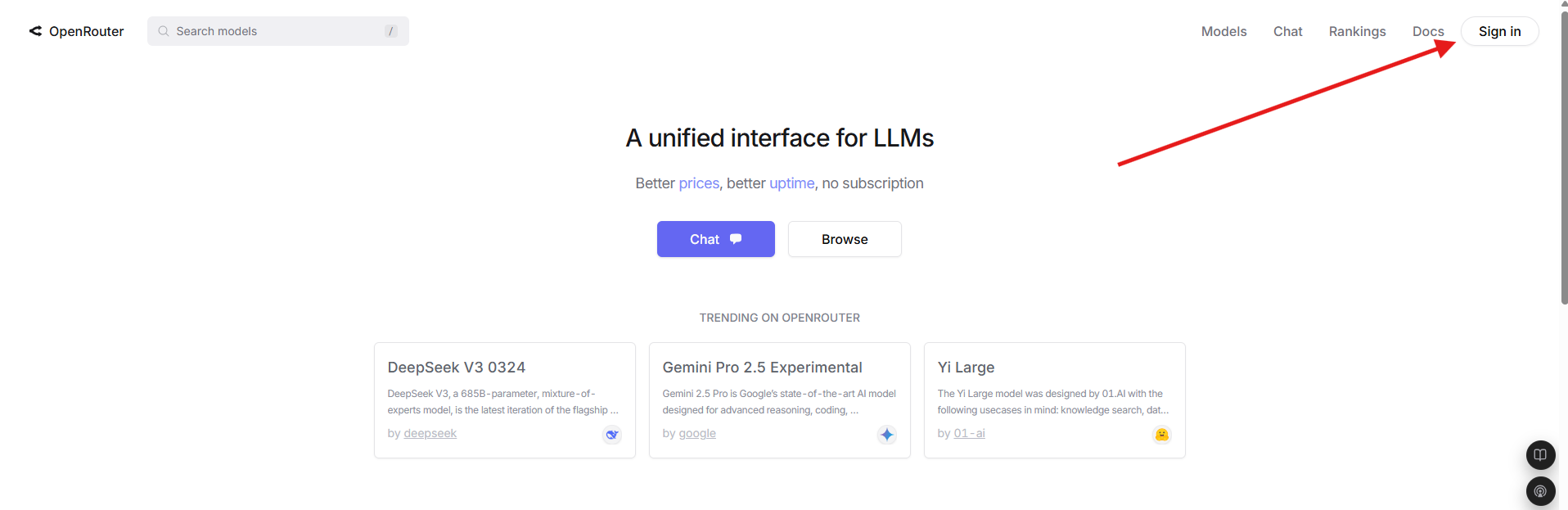

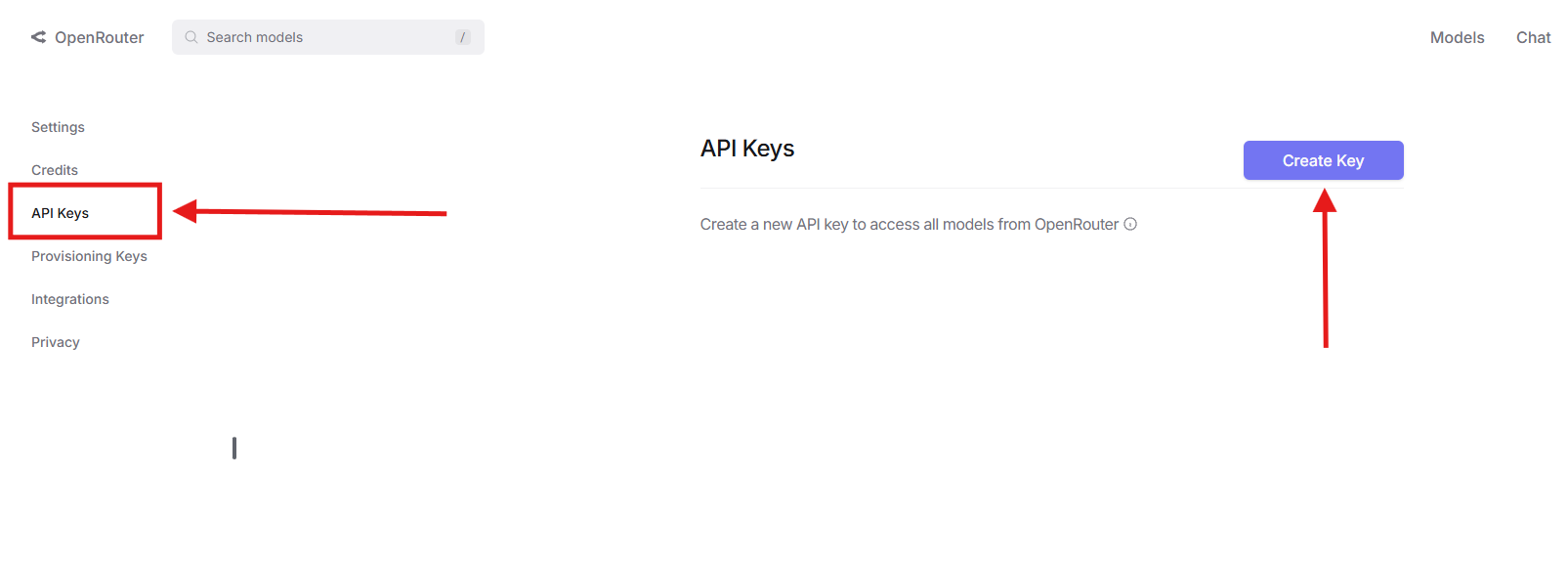

Étape 1 : Obtenez votre clé API OpenRouter

- Visitez OpenRouter.ai

2. Inscrivez-vous → Accédez à Paramètres du compte → Clés API

3. Cliquez sur Créer une clé → Copier dans le presse-papiers

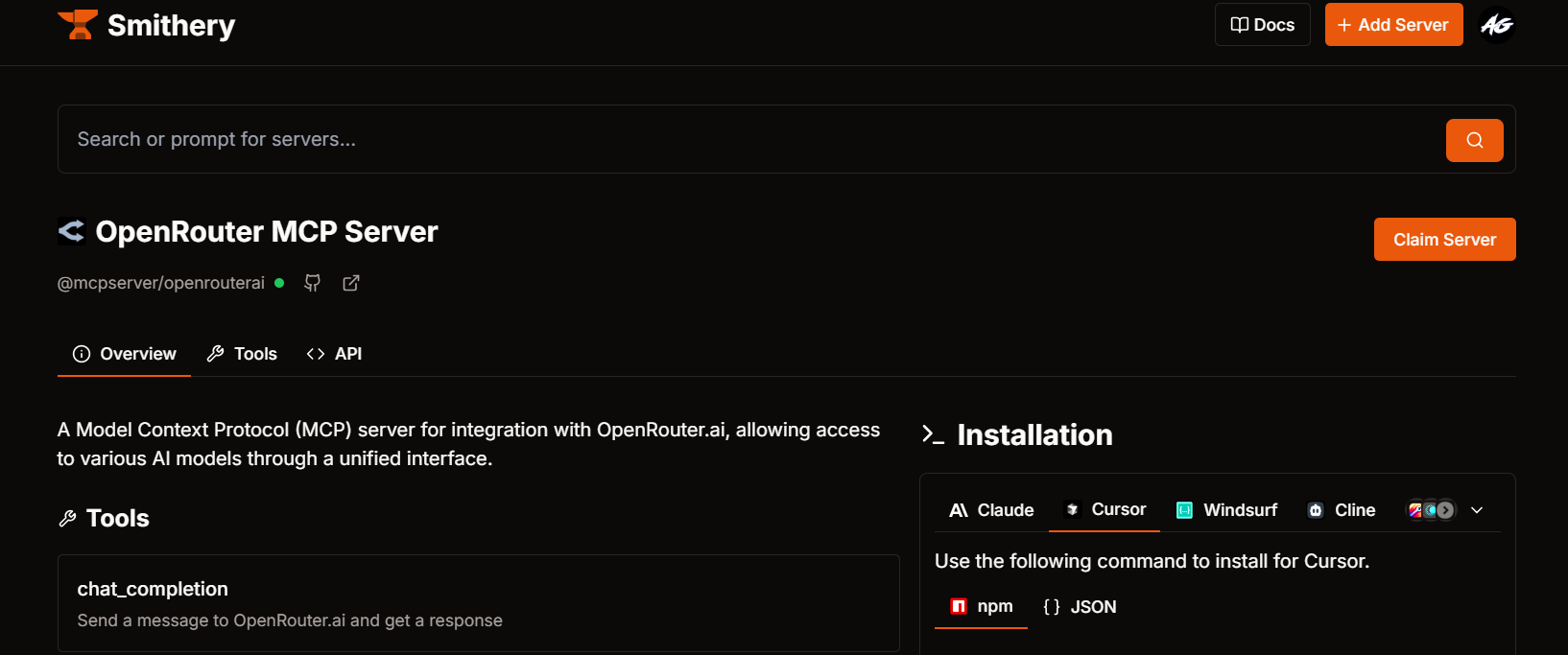

Étape 2 : Configurer OpenRouter dans Smithery AI

- Ouvrez Smithery AI

- Recherchez "OpenRouter MCP"

- Dans le panneau de configuration, collez :

{

"api_key": "your_copied_key",

"default_model": "google/gemini-pro" // Free tier recommended

}

4. Copiez soit :

- Commande NPM :

npx -y @smithery/cli@latest install @mcpserver/openrouterai --client cursor --config "{\"openrouterApiKey\":\"YOUR_API_KEY\",\"openrouterDefaultModel\":\"deepseek/deepseek-chat-v3-0324:free\"}"- ou Configuration JSON (pour une configuration manuelle) :

{

"mcpServers": {

"openrouterai": {

"command": "npx",

"args": [

"-y",

"@smithery/cli@latest",

"run",

"@mcpserver/openrouterai",

"--config",

"{\"openrouterApiKey\":\"YOUR_API_KEY\",\"openrouterDefaultModel\":\"deepseek/deepseek-chat-v3-0324:free\"}"

]

}

}

}

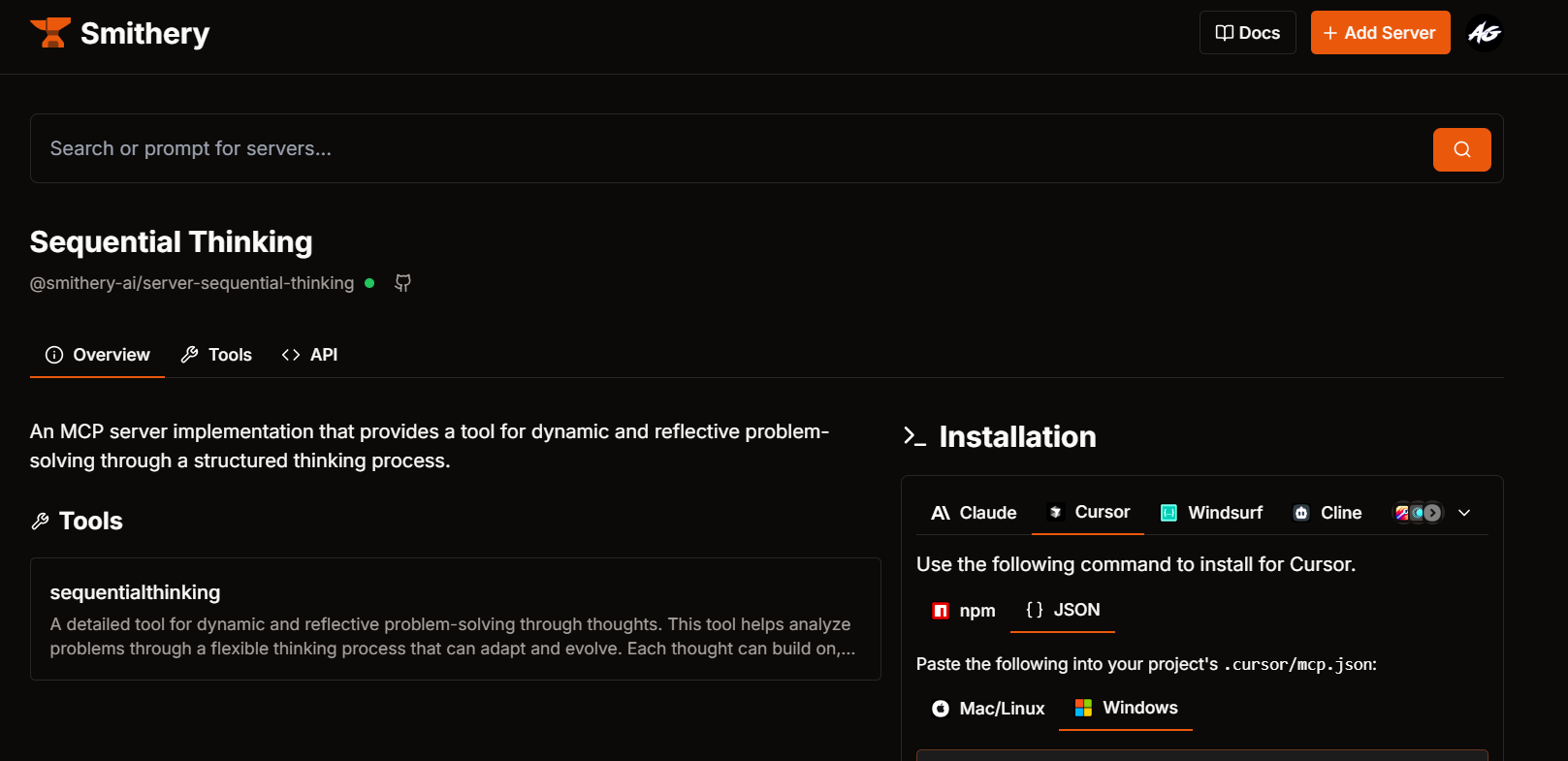

Étape 3 : Ajouter la pensée séquentielle MCP

- Dans Smithery AI, recherchez "Sequential Thinking MCP Server"

- Choisissez votre format préféré :

- Installation rapide NPM :

npx -y @smithery/cli@latest install @smithery-ai/server-sequential-thinking --client cursor --key YOUR_API_KEY- ou Configuration JSON (Avancé) :

{

"mcpServers": {

"server-sequential-thinking": {

"command": "cmd",

"args": [

"/c",

"npx",

"-y",

"@smithery/cli@latest",

"run",

"@smithery-ai/server-sequential-thinking",

"--key",

"YOUR_API_KEY"

]

}

}

}

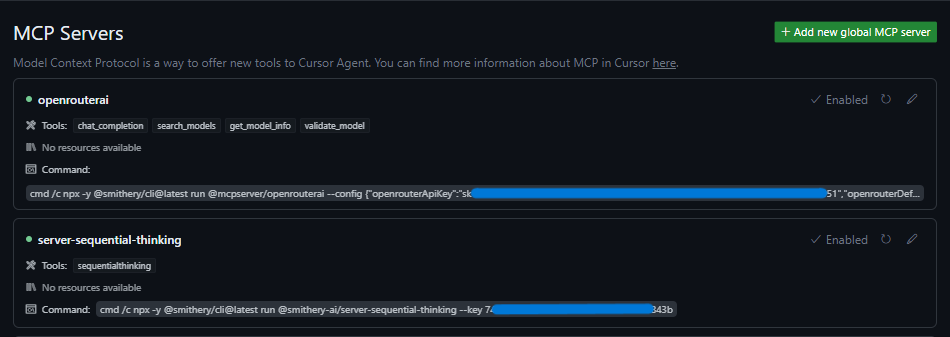

Étape 4 : Activer dans Cursor IDE

Pour les utilisateurs de NPM :

- Ouvrez Cursor → Terminal (

Ctrl + j) - Collez les commandes une à la fois

- Attendez la confirmation ✅ de réussite

Pour les utilisateurs de la configuration JSON :

- Ouvrez les paramètres de Cursor (

Ctrl + shift + j) - Accédez à MCP → Serveurs

- Cliquez sur Ajouter un serveur → Coller JSON

- Enregistrer → Rechercher l'état ● Connecté vert

Vérifiez l'installation :

Après avoir ajouté le serveur, recherchez un point vert à côté de "Sequential Thinking" dans la liste des serveurs MCP, indiquant une connexion réussie.

En suivant ces étapes, vous intégrerez efficacement les serveurs OpenRouter et Sequential Thinking MCP dans Cursor, améliorant ainsi votre environnement de développement avec des outils avancés basés sur l'IA.

Création de votre premier flux de travail OpenRouter et MCP Sequential Thinking

Développement d'un modèle pour les projets React :

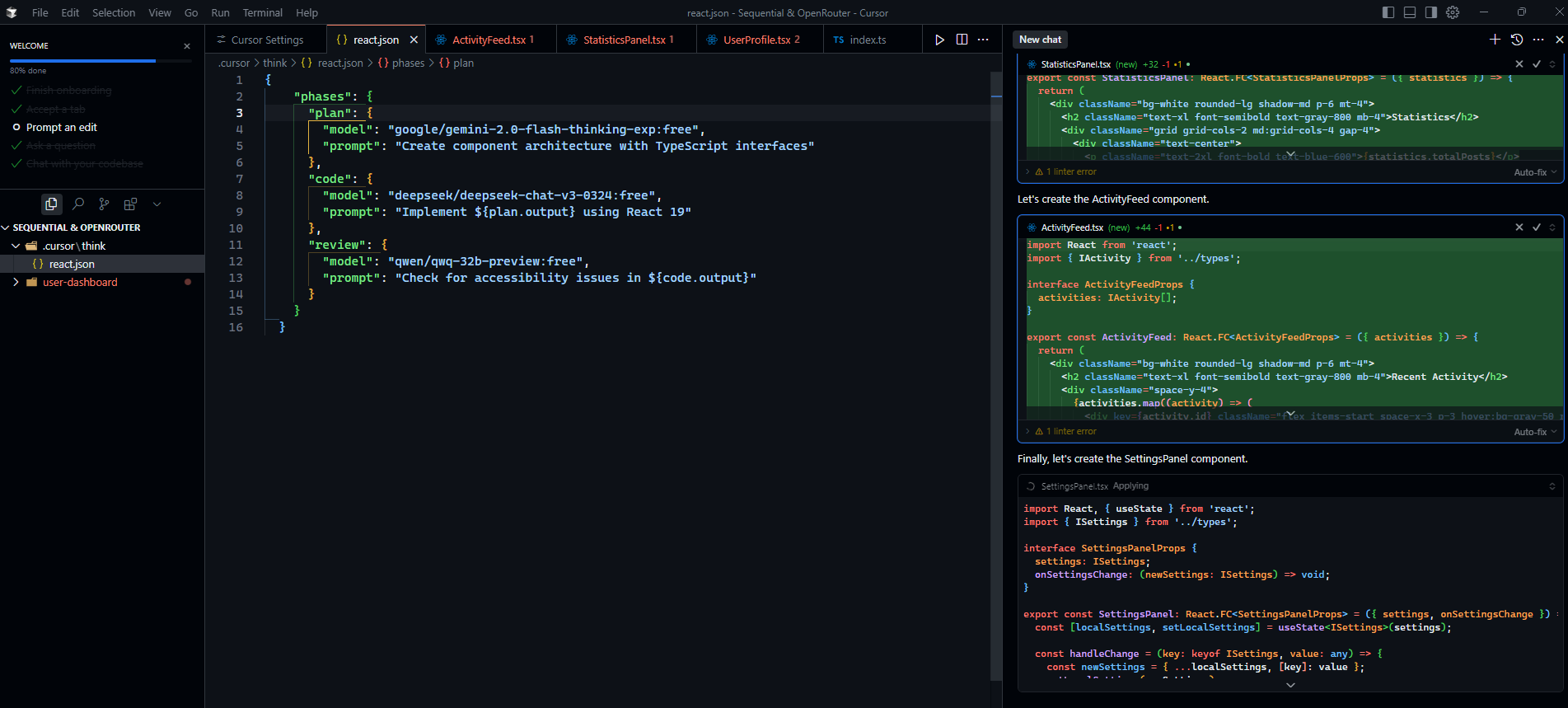

Ouvrez un nouveau projet avec Cursor et créez un fichier nommé .cursor/think/react.json avec le contenu suivant :

{

"phases": {

"plan": {

"model": "google/gemini-2.0-flash-thinking-exp:free",

"prompt": "Create component architecture with TypeScript interfaces"

},

"code": {

"model": "deepseek/deepseek-chat-v3-0324:free",

"prompt": "Implement ${plan.output} using React 19"

},

"review": {

"model": "qwen/qwq-32b-preview:free",

"prompt": "Check for accessibility issues in ${code.output}"

}

}

}Utilisation : Pour exécuter ce flux de travail, exécutez la commande suivante :

/think react "Simple User profile dashboard"Répartition du flux de travail :

- Phase de planification avec Gemini 2.0 Flash Thinking : Utilisez le modèle Gemini 2.0 Flash Thinking pour créer une architecture de composants détaillée avec des interfaces TypeScript. Cette étape garantit une base bien structurée pour votre projet React.

- Phase de codage avec DeepSeek Chat V3 : Implémentez l'architecture planifiée à l'aide de React 19 en tirant parti du modèle DeepSeek Chat V3. Cette phase se concentre sur la traduction de la conception en composants de code fonctionnels.

- Phase de révision avec Qwen 32B Preview : Effectuez une révision approfondie du code implémenté pour identifier et résoudre tout problème d'accessibilité, en vous assurant que l'application est conviviale et conforme aux normes d'accessibilité.

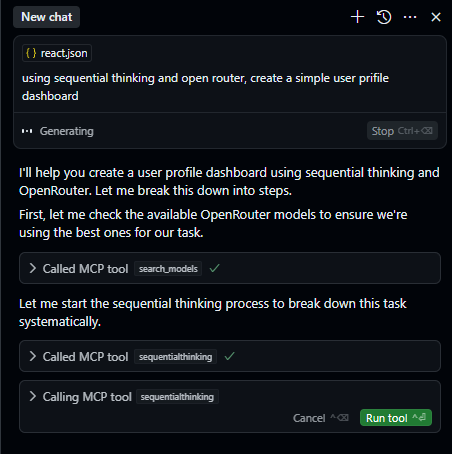

Exécution du code : Lors de l'exécution du flux de travail défini, Cursor engage séquentiellement les outils MCP (Model Context Protocol) spécifiés : Sequential Thinking et OpenRouter AI, pour effectuer les tâches désignées.

Au cours de ce processus, Cursor vous demande votre autorisation explicite avant d'utiliser chaque serveur MCP, vous assurant ainsi de conserver le contrôle sur l'intégration de ces outils dans votre flux de travail de développement.

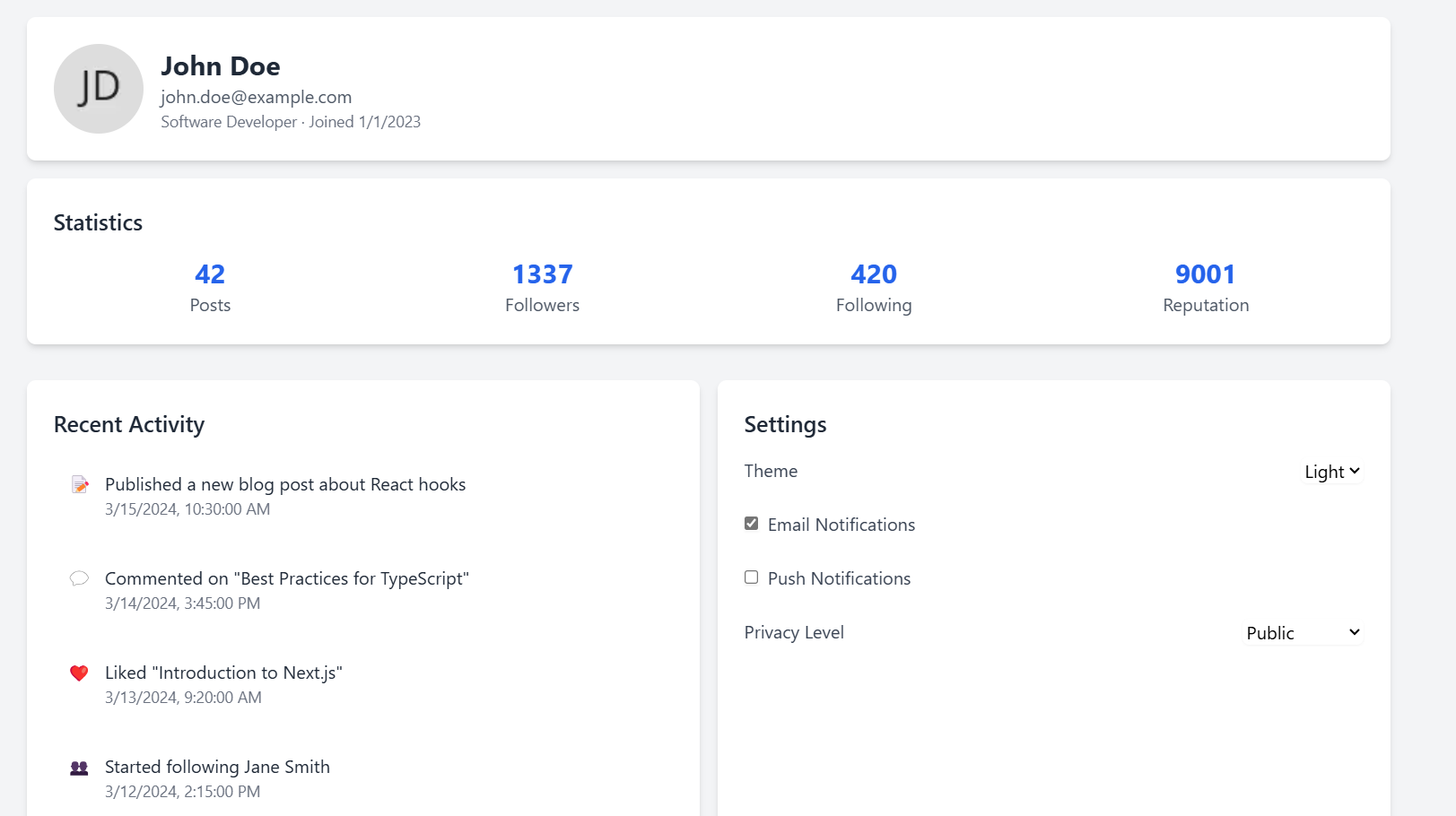

Résultat : Un tableau de bord User-Profile prêt pour la production en quelques minutes, contre les heures ou les jours que vous passeriez si vous deviez le faire manuellement.

Réflexions finales : l'avenir du codage est arrivé

MCP Sequential Thinking n'est pas qu'une tendance ; c'est un changement fondamental dans la façon dont nous abordons le développement logiciel. En tirant parti de la puissance de plusieurs modèles d'IA de manière structurée et efficace, vous pouvez atteindre des niveaux de productivité, de qualité du code et d'innovation sans précédent. Votre code ne sera plus jamais le même. Adoptez l'avenir du développement assisté par l'IA avec MCP Sequential Thinking et libérez tout le potentiel de votre équipe. Les principaux points à retenir sont la capacité de disséquer des projets complexes en tâches plus petites et gérables, d'attribuer ces tâches à des modèles d'IA spécialisés dans ce domaine particulier et de rationaliser l'ensemble du cycle de vie du développement. Avec les progrès continus de l'IA et des outils comme OpenRouter et Cursor, l'avenir du développement logiciel est sans aucun doute lié à MCP Sequential Thinking, ce qui en fait une compétence essentielle pour tout développeur avant-gardiste. 🚀