Êtes-vous désireux de profiter des capacités des modèles de langage Llama avancés de Meta sans dépenser un centime ? Dans ce guide détaillé, nous vous présenterons deux méthodes pratiques pour utiliser l'API Llama gratuitement : en tirant parti d'OpenRouter et de Together AI.

Qu'est-ce que l'API Llama ?

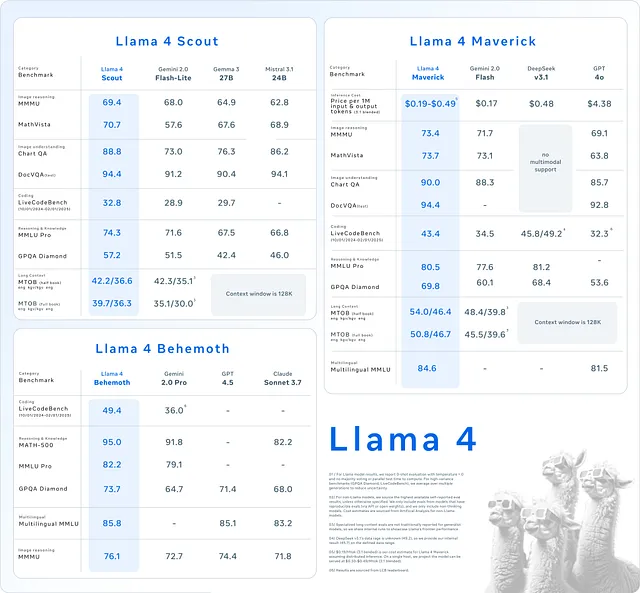

L'API Llama donne accès à la famille de modèles de langage de Meta, y compris Llama 3 et Llama 4. Ces modèles excellent dans des tâches telles que la génération de texte, la compréhension contextuelle et même les applications multimodales impliquant des images. Les développeurs utilisent l'API Llama pour alimenter des applications allant des chatbots aux outils de génération de contenu, le tout sans avoir besoin d'entraîner des modèles à partir de zéro.

Bien que ces modèles soient impressionnants, y accéder implique généralement des coûts, à moins que vous ne sachiez où chercher. Heureusement, des plateformes comme OpenRouter et Together AI offrent un accès gratuit à certains modèles Llama. Dans ce guide, nous couvrirons les deux méthodes, avec des instructions étape par étape et des exemples de code pour vous aider à démarrer.

Pourquoi choisir l'API Llama ?

Avant de passer aux méthodes, examinons pourquoi l'API Llama se démarque. Tout d'abord, elle offre un traitement du langage de premier ordre, permettant aux applications de produire un texte cohérent et semblable à celui d'un humain. Ensuite, les versions plus récentes comme Llama 4 introduisent des fonctionnalités multimodales, permettant au modèle de gérer à la fois le texte et les images, ce qui change la donne pour les projets innovants. Enfin, l'utilisation de l'API permet d'économiser du temps et des ressources par rapport à la création de modèles personnalisés.

Dans cet esprit, explorons comment accéder gratuitement à l'API Llama.

Méthode 1 : Utilisation d'OpenRouter pour accéder gratuitement à l'API Llama

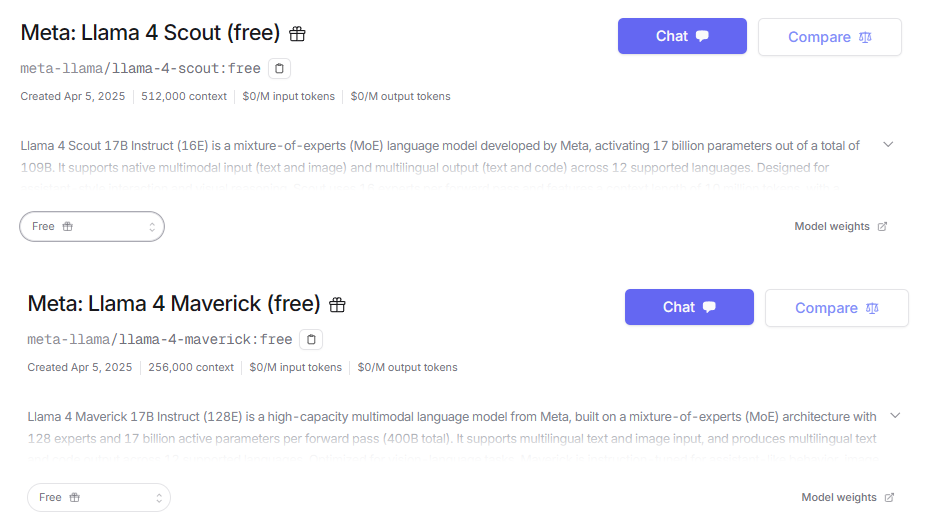

OpenRouter sert de plateforme API unifiée, accordant l'accès à plus de 300 modèles d'IA, y compris la série Llama de Meta. Le meilleur de tout, c'est qu'elle propose un niveau gratuit qui inclut des modèles comme Llama 4 Maverick et Llama 4 Scout. Cela fait d'OpenRouter un point de départ idéal pour les développeurs qui recherchent un accès gratuit à une IA de pointe.

Étape 1 : Inscrivez-vous et obtenez une clé API

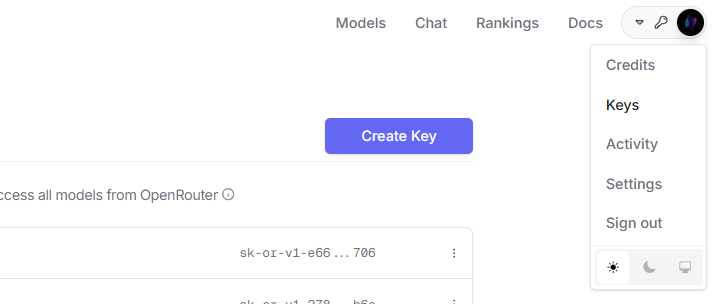

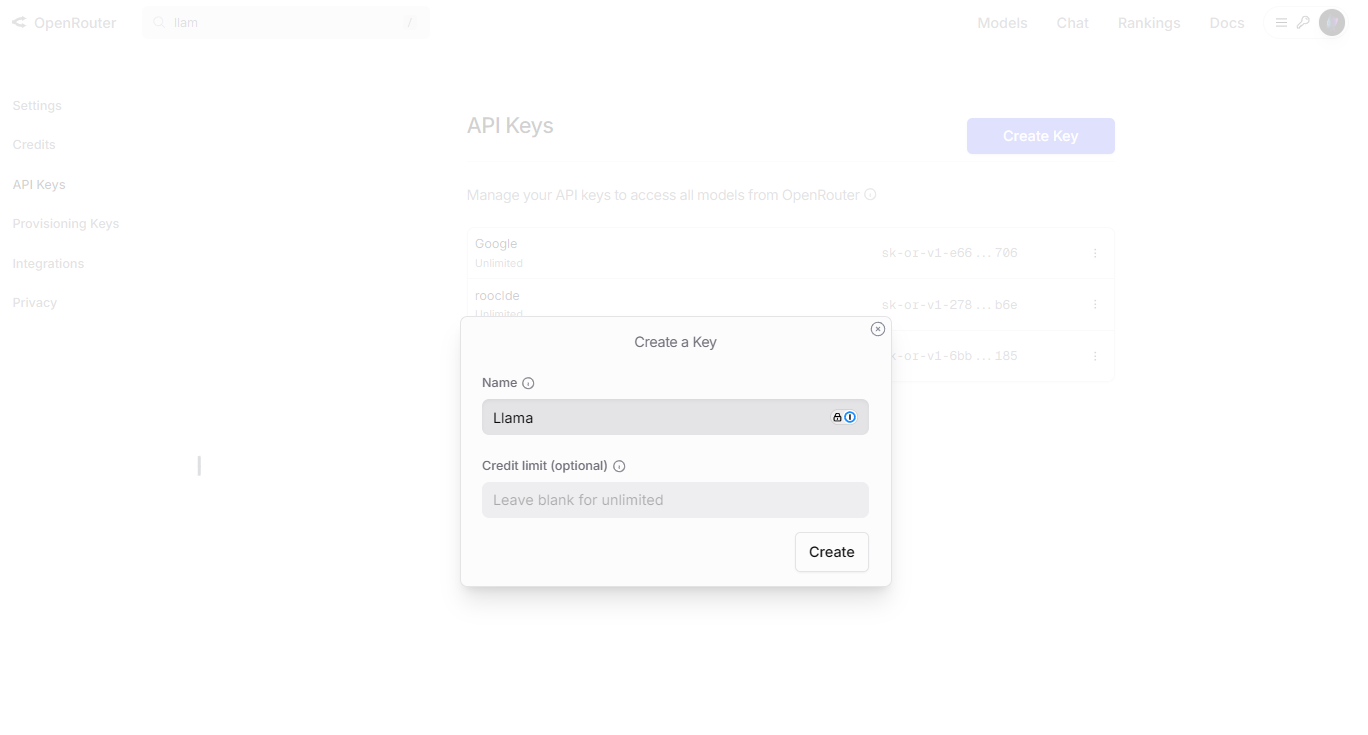

Pour commencer, vous avez besoin d'un compte OpenRouter et d'une clé API. Suivez ces étapes :

Accédez au site Web d'OpenRouter et cliquez sur "Sign Up". Connectez-vous, puis accédez à la section "API Keys" de votre tableau de bord.

Cliquez sur "Create Key", nommez-la (par exemple, "Llama Free Key") et copiez la clé en toute sécurité.

Étape 2 : Configurez votre environnement

Vous aurez besoin d'un langage de programmation et d'une bibliothèque cliente HTTP pour interagir avec l'API. Nous utiliserons Python avec la bibliothèque requests. Installez-la si vous ne l'avez pas déjà fait :

pip install requests

Étape 3 : Envoyez votre première requête

Maintenant, écrivons un script Python pour générer du texte à l'aide du modèle Llama 4 Scout via OpenRouter :

import requests

import json

# Define the endpoint and your API key

API_URL = "https://openrouter.ai/api/v1/chat/completions"

API_KEY = "your_api_key_here" # Replace with your actual key

# Set headers for authentication

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

# Create the payload with model and prompt

payload = {

"model": "meta-llama/llama-4-scout:free",

"messages": [

{"role": "user", "content": "Décrivez l'API Llama en une phrase."}

],

"max_tokens": 50

}

# Send the request

response = requests.post(API_URL, headers=headers, data=json.dumps(payload))

# Handle the response

if response.status_code == 200:

result = response.json()

print(result["choices"][0]["message"]["content"])

else:

print(f"Error: Request failed with status {response.status_code}")

Ce script envoie une invite au modèle Llama 4 Scout et imprime la réponse. Ajustez max_tokens pour contrôler la longueur de la sortie.

Étape 4 : Expérimentez avec les fonctionnalités

OpenRouter prend en charge la personnalisation. Par exemple, ajustez le paramètre temperature pour ajuster la créativité de la réponse, ou explorez les capacités multimodales avec des modèles comme Llama 4 Maverick. Consultez la page des modèles OpenRouter pour plus de détails sur les options disponibles.

Méthode 2 : Utilisation de Together AI pour accéder gratuitement à l'API Llama

Together AI est une autre plateforme hébergeant des modèles Llama, offrant un accès gratuit aux modèles Llama 3 comme Llama 3.2 11B. Cependant, notez que Llama 4 n'est pas gratuit sur Together AI pour le moment, seuls les forfaits payants le débloquent. Si Llama 3 répond à vos besoins, cette méthode fonctionne bien.

Étape 1 : Inscrivez-vous et obtenez une clé API

Commencez par configurer un compte Together AI :

Visitez le site Web de Together AI et accédez à la section "API Keys" et générez une nouvelle clé.

Enregistrez la clé en toute sécurité pour l'utiliser dans vos requêtes.

Étape 2 : Préparez votre environnement

Comme avec OpenRouter, nous utiliserons Python et requests. Installez-le si nécessaire :

pip install requests

Étape 3 : Effectuez un appel API

Voici un script Python pour générer du texte avec le modèle Llama 3 sur Together AI :

import requests

import json

# Define the endpoint and your API key

API_URL = "https://api.together.xyz/inference"

API_KEY = "your_api_key_here" # Replace with your actual key

# Set headers for authentication

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

# Create the payload with model and prompt

payload = {

"model": "llama-3-2-11b-free",

"prompt": "Que fait l'API Llama ?",

"max_tokens": 50,

"temperature": 0.7

}

# Send the request

response = requests.post(API_URL, headers=headers, data=json.dumps(payload))

# Handle the response

if response.status_code == 200:

result = response.json()

print(result["output"]["text"])

else:

print(f"Error: Request failed with status {response.status_code}")

Ce script interroge le modèle Llama 3 et affiche la sortie. Le paramètre temperature équilibre la créativité et la cohérence.

Étape 4 : Connaître les limites

Le niveau gratuit de Together AI a des contraintes, telles que des limites de débit et aucun accès à Llama 4. Consultez la page des modèles Together AI pour comprendre ce qui est disponible et planifier en conséquence.

Optimiser votre expérience avec l'API Llama

Pour maximiser votre succès avec l'API Llama, adoptez ces pratiques :

- Rédigez des invites précises : des invites claires donnent de meilleurs résultats. Testez des variations pour affiner les sorties.

- Suivez l'utilisation : surveillez vos appels API via les tableaux de bord OpenRouter ou Together AI pour rester dans les limites du niveau gratuit.

- Gérez les erreurs : ajoutez des blocs try-except dans votre code pour gérer les échecs avec élégance.

- Mettez en cache les réponses : stockez les résultats de requêtes fréquentes pour réduire l'utilisation de l'API et accélérer votre application.

Ces étapes garantissent l'efficacité et la fiabilité de vos projets.

Dépannage des problèmes courants

Des problèmes peuvent survenir lors de l'utilisation de l'API Llama. Voici comment les résoudre :

- 401 Unauthorized : vérifiez que votre clé API est correcte et incluse dans les en-têtes.

- 429 Too Many Requests : vous avez atteint la limite de débit, attendez ou mettez à niveau votre forfait.

- Invalid Model : vérifiez que le nom du modèle correspond à la documentation du fournisseur.

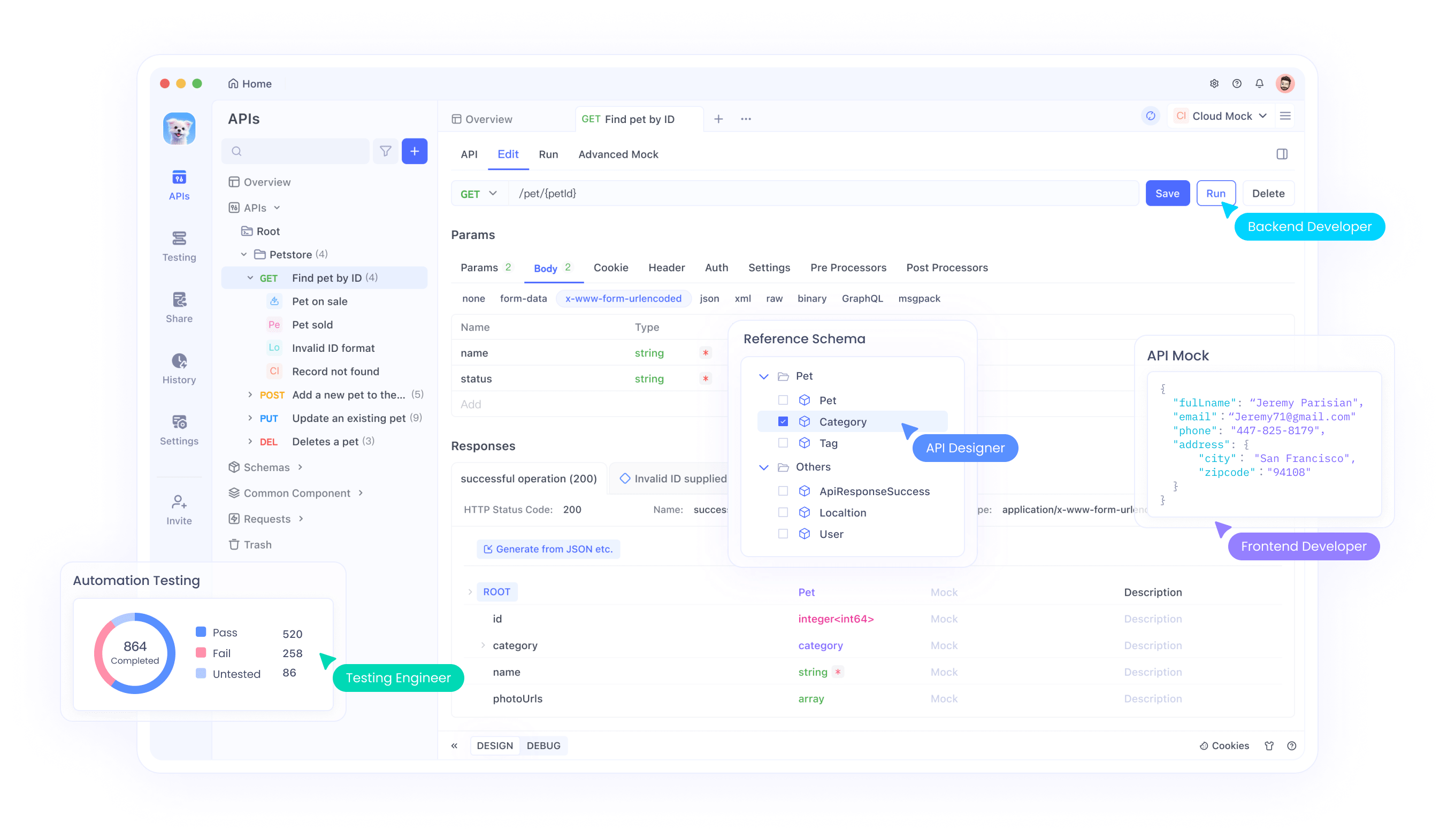

- Bad Payload : vérifiez votre syntaxe JSON. Des outils comme Apidog peuvent vous aider à déboguer cela.

En parlant d'outils, téléchargez Apidog gratuitement pour simplifier les tests et le dépannage de vos appels API, c'est un incontournable pour les développeurs.

Comparaison d'OpenRouter et de Together AI

Les deux plateformes offrent un accès gratuit, mais elles diffèrent :

- Disponibilité des modèles : OpenRouter inclut Llama 4 gratuitement ; Together AI limite l'accès gratuit à Llama 3.

- Facilité d'utilisation : les deux fournissent des API simples, mais la sélection de modèles plus large d'OpenRouter se démarque.

- Évolutivité : Together AI peut pousser des forfaits payants pour des fonctionnalités avancées, tandis que le niveau gratuit d'OpenRouter est plus généreux.

Choisissez en fonction des besoins de votre projet : l'accès à Llama 4 penche vers OpenRouter, tandis que Together AI convient aux utilisateurs de Llama 3.

Cas d'utilisation de l'API Llama

L'API Llama brille dans divers scénarios :

- Chatbots : créez des agents conversationnels avec des réponses naturelles.

- Création de contenu : générez des articles, des résumés ou des légendes.

- Applications multimodales : combinez le traitement du texte et des images avec Llama 4 (via OpenRouter).

Ces applications mettent en valeur la polyvalence de l'API, le tout réalisable gratuitement avec la bonne configuration.

Conclusion

Dans ce guide, nous avons démontré comment utiliser l'API Llama gratuitement via OpenRouter et Together AI. OpenRouter donne accès aux modèles Llama 4, tandis que Together AI propose Llama 3 sur son niveau gratuit. Avec des instructions détaillées et des extraits de code, vous êtes maintenant équipé pour intégrer ces modèles dans vos projets. Commencez à expérimenter dès aujourd'hui et n'oubliez pas d'utiliser des outils comme Apidog pour améliorer votre flux de travail. La puissance de Llama est à vous, utilisez-la à bon escient !