Les développeurs recherchent constamment des outils avancés pour améliorer les applications basées sur l'IA, et GPT-5 Pro se distingue comme un modèle de premier plan pour les tâches de raisonnement complexes. Ce modèle fournit des réponses précises en exploitant un effort de calcul élevé, ce qui le rend idéal pour les scénarios qui exigent exactitude et profondeur. En explorant les moyens d'intégrer cette technologie, considérez les outils qui simplifient le processus.

De plus, cet article examine les méthodes d'accès via deux plateformes principales : OpenAI et OpenRouter. Chacune offre des avantages uniques, de l'intégration directe au routage économique. Vous obtiendrez des informations sur les prérequis, l'authentification, les points d'accès (endpoints) et des exemples de code. En outre, la discussion couvre les structures de tarification sur les deux plateformes, permettant des décisions éclairées. À la fin, vous comprendrez comment de petits choix de configuration influencent la performance globale.

Comprendre GPT-5 Pro : Caractéristiques et Capacités Clés

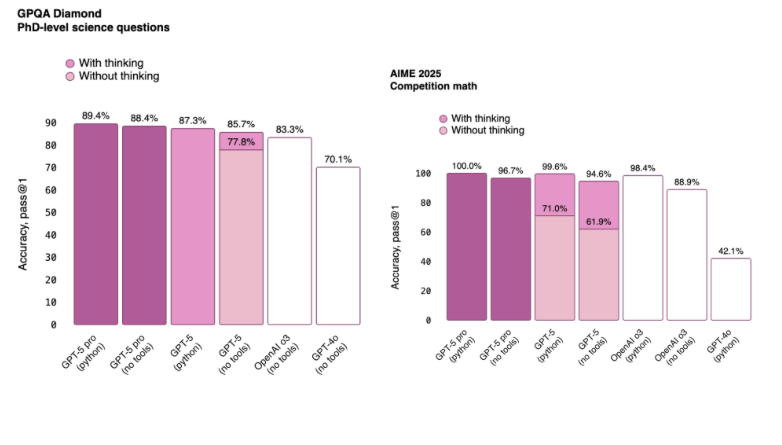

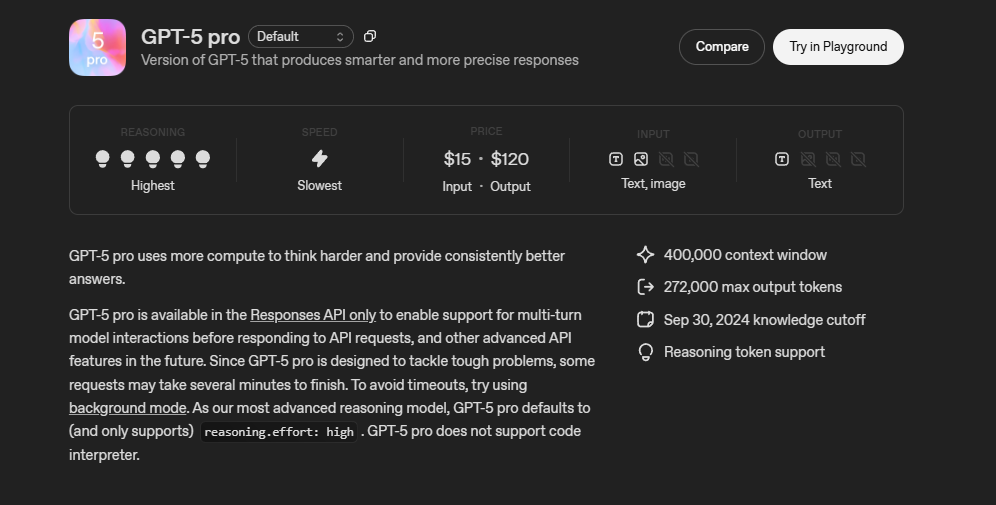

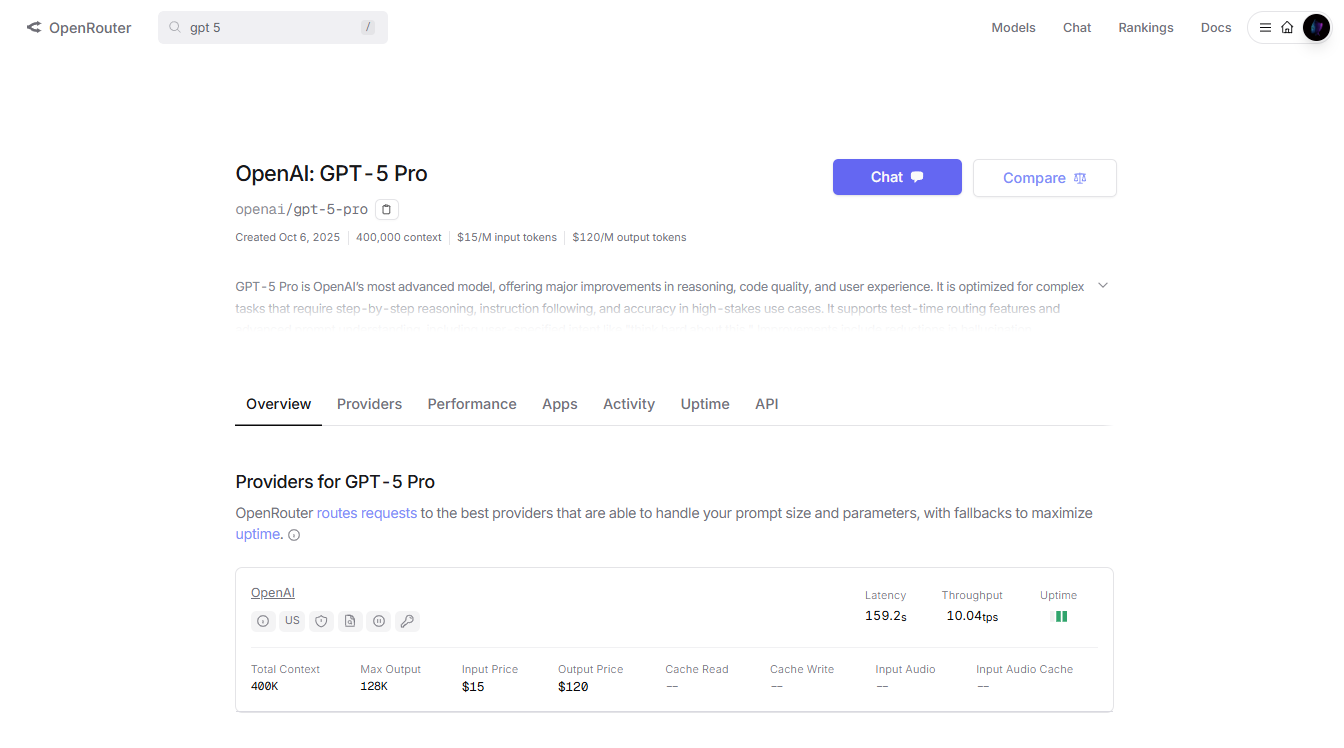

Les ingénieurs conçoivent GPT-5 Pro pour exceller dans les applications exigeantes. Le modèle utilise un effort de raisonnement élevé, le distinguant de ses prédécesseurs. Plus précisément, il utilise par défaut un mode de raisonnement élevé, ce qui garantit une qualité constante des résultats. De plus, il prend en charge une fenêtre contextuelle massive de 400 000 jetons, permettant le traitement d'entrées étendues. Les utilisateurs peuvent générer jusqu'à 272 000 jetons de sortie, facilitant des réponses détaillées.

Ensuite, considérons les modalités. GPT-5 Pro gère efficacement les entrées et sorties textuelles, tout en acceptant également les entrées d'images. Cependant, il ne prend pas en charge l'audio ou la vidéo. Les développeurs apprécient l'inclusion de l'appel de fonctions et des sorties structurées, qui améliorent la programmabilité. D'autre part, des fonctionnalités comme le streaming, le fine-tuning et l'interprétation de code restent indisponibles.

De plus, la date de coupure des connaissances est le 30 septembre 2024, les applications doivent donc en tenir compte lorsqu'elles nécessitent des informations actuelles. Des outils tels que la recherche web s'intègrent parfaitement, augmentant l'utilité. Globalement, ces attributs positionnent GPT-5 Pro comme un choix robuste pour les projets techniques, de la génération de code au raisonnement analytique.

Prérequis pour Accéder à l'API GPT-5 Pro

Avant d'intégrer GPT-5 Pro, vous devez préparer plusieurs éléments essentiels. Tout d'abord, créez un compte sur la plateforme choisie. Pour OpenAI, visitez leur portail développeur et inscrivez-vous.

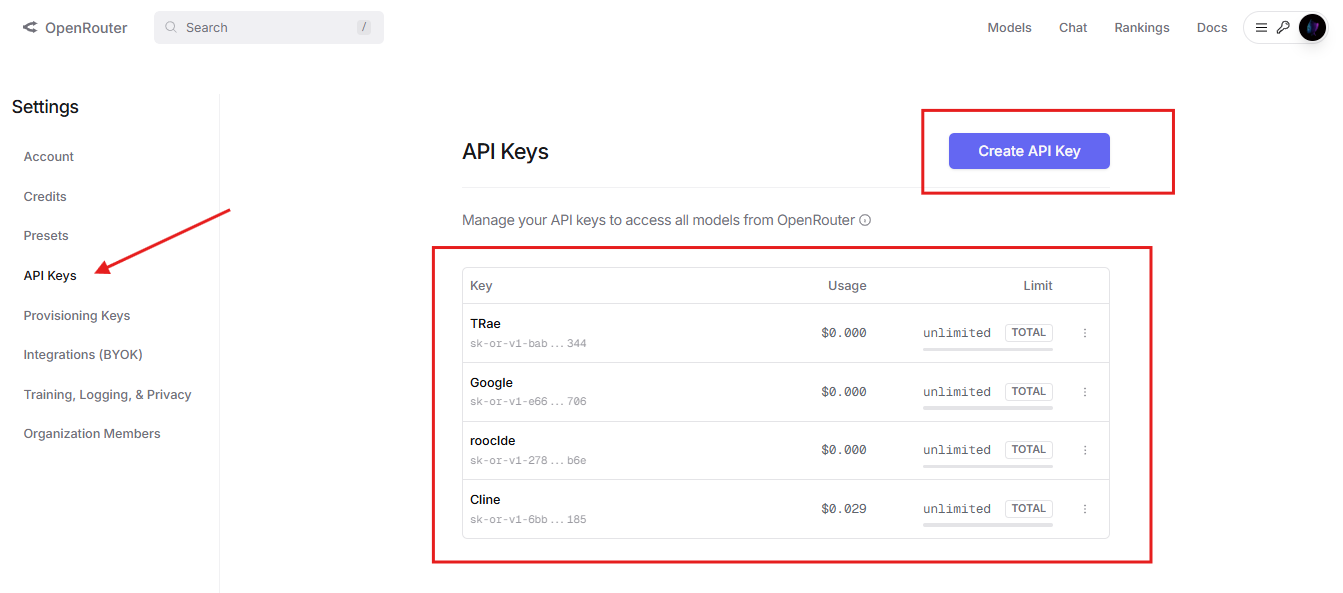

De même, OpenRouter nécessite une inscription pour générer des clés API.

Ensuite, vérifiez votre organisation si vous utilisez OpenAI, car certains modèles exigent cette étape. Les développeurs l'oublient souvent, ce qui entraîne des refus d'accès. De plus, assurez-vous de respecter les politiques d'utilisation, y compris les limites de débit basées sur votre niveau.

Vous avez également besoin de connaissances en programmation dans des langages comme Python ou JavaScript, car les appels API reposent sur ceux-ci. Installez les bibliothèques pertinentes, telles que le SDK OpenAI, pour simplifier les interactions. Cependant, vérifiez toujours la compatibilité, car GPT-5 Pro se concentre sur des points d'accès spécifiques comme l'API de Réponses.

De plus, prévoyez un budget pour les coûts, car une tarification basée sur les jetons s'applique. Suivez l'utilisation pour éviter les surprises. En répondant à ces prérequis, vous établissez une base solide pour un accès API réussi.

Accéder à GPT-5 Pro via la Plateforme OpenAI

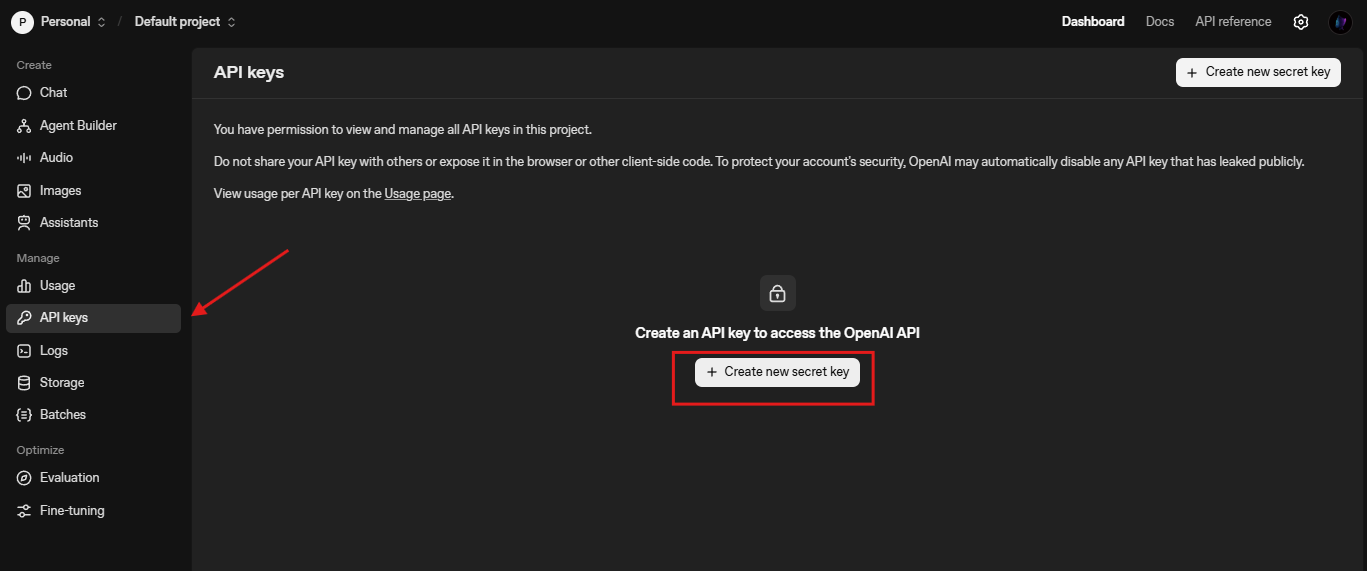

OpenAI offre un accès direct à GPT-5 Pro, permettant une intégration transparente. Vous commencez par obtenir une clé API depuis le tableau de bord de la plateforme. Naviguez vers la section des clés API, générez une nouvelle clé et stockez-la en toute sécurité.

Par la suite, authentifiez les requêtes en utilisant cette clé dans les en-têtes. Par exemple, incluez "Authorization: Bearer VOTRE_CLÉ_API" dans les appels HTTP. Cette étape empêche les accès non autorisés et assure une communication sécurisée.

Maintenant, explorez les points d'accès disponibles. GPT-5 Pro utilise principalement l'API de Réponses à /v1/responses, idéale pour les interactions multi-tours. D'autres points d'accès incluent /v1/chat/completions pour les chats standards et /v1/embeddings pour les représentations vectorielles. Les développeurs sélectionnent les points d'accès en fonction des exigences de la tâche.

Par exemple, pour effectuer un appel de base, vous construisez une requête POST avec des paramètres comme model="gpt-5-pro" et les détails de l'invite. Le système traite les entrées et renvoie des réponses structurées. Cependant, notez que les requêtes complexes peuvent prendre plusieurs minutes, il est donc recommandé d'implémenter un mode d'arrière-plan pour gérer les délais d'attente.

De plus, intégrez des outils comme la recherche web ou la recherche de fichiers pour augmenter les capacités. Vous les spécifiez dans le corps de la requête, améliorant la sortie du modèle. Grâce à ces étapes, vous utilisez efficacement GPT-5 Pro sur OpenAI.

Exemples de Code pour l'Intégration OpenAI

Vous implémentez GPT-5 Pro avec un code simple. Commencez avec Python et la bibliothèque OpenAI. Installez-la via pip : pip install openai.

Ensuite, initialisez le client : from openai import OpenAI; client = OpenAI(api_key="VOTRE_CLÉ_API").

Pour générer une réponse, utilisez : response = client.chat.completions.create(model="gpt-5-pro", messages=[{"role": "user", "content": "Expliquez l'informatique quantique."}]).

Affichez la sortie : print(response.choices[0].message.content).

Cet exemple démontre une utilisation de base. Pour des scénarios avancés, ajoutez un effort de raisonnement : incluez "reasoning": {"effort": "high"} dans les paramètres.

De plus, gérez les erreurs en enveloppant les appels dans des blocs try-except. Enregistrez les en-têtes de limite de débit pour surveiller l'utilisation.

En JavaScript, utilisez l'API fetch : fetch("https://api.openai.com/v1/chat/completions", {method: "POST", headers: {"Authorization": "Bearer VOTRE_CLÉ_API", "Content-Type": "application/json"}, body: JSON.stringify({model: "gpt-5-pro", messages: [{"role": "user", "content": "Résolvez ce problème de mathématiques."}]})}).then(res => res.json()).then(data => console.log(data.choices[0].message.content)).

Ces extraits illustrent une intégration pratique, permettant un prototypage rapide.

Détails de la Tarification sur OpenAI pour GPT-5 Pro

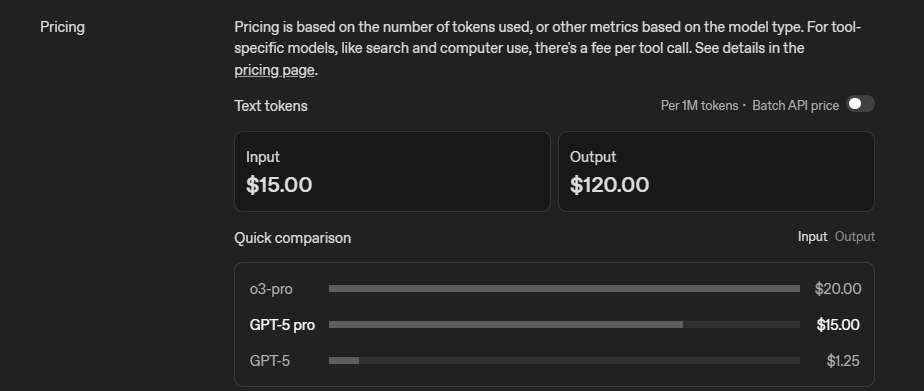

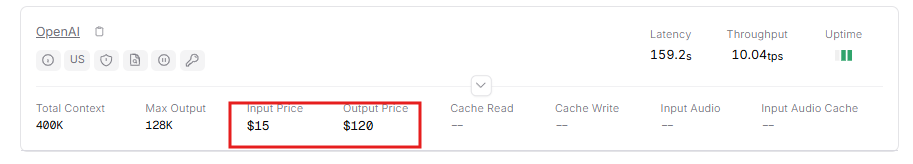

OpenAI structure sa tarification autour des jetons, facturant par million. Pour GPT-5 Pro, les jetons d'entrée coûtent 15 $ par million, tandis que les jetons de sortie atteignent 120 $ par million. L'API Batch offre les mêmes tarifs, favorisant un traitement efficace.

Comparez cela aux modèles connexes. L'entrée GPT-5 coûte 1,25 $ par million, soulignant le positionnement premium de la version Pro. De plus, les appels d'outils entraînent des frais distincts, en fonction de l'utilisation.

Les limites de débit sont liées aux niveaux, influençant indirectement les coûts. Le niveau 1 autorise 500 requêtes par minute et 30 000 jetons par minute. Les niveaux supérieurs, comme le niveau 5, prennent en charge 10 000 requêtes et 30 millions de jetons, adaptés aux besoins des entreprises.

Les développeurs optimisent en minimisant les jetons grâce à des invites concises. Surveillez les tableaux de bord pour suivre les dépenses. Cette approche garantit un accès économique à GPT-5 Pro.

Avantages d'Utiliser OpenRouter pour l'Accès à GPT-5 Pro

OpenRouter simplifie l'accès en acheminant les requêtes à travers les fournisseurs, assurant la fiabilité. Vous bénéficiez d'une API unifiée compatible avec le SDK OpenAI, réduisant les efforts d'adaptation.

De plus, il offre des mécanismes de repli (fallbacks), maintenant la disponibilité pendant les pics de charge. Les développeurs apprécient cela pour les environnements de production.

De plus, OpenRouter peut offrir des réductions sur les modèles, comme 50 % de réduction sur les variantes de GPT-5 lors de promotions. Cela réduit les obstacles à l'expérimentation.

La plateforme agrège plus de 400 modèles, permettant des changements sans modifications de code. Vous spécifiez "openai/gpt-5-pro" dans les requêtes, simplifiant les flux de travail.

Cependant, envisagez les options BYOK (Bring Your Own Key), où vous fournissez vos clés et payez des frais de 5 % après les premières requêtes gratuites. Cette flexibilité séduit les utilisateurs soucieux des coûts.

Globalement, OpenRouter améliore l'accessibilité, rendant GPT-5 Pro plus abordable.

Configurer l'Accès sur OpenRouter

Vous commencez par créer un compte OpenRouter et ajouter des crédits. Visitez la page des crédits pour déposer des fonds, car l'utilisation est déduite de ce solde.

Ensuite, générez une clé API depuis le tableau de bord. Utilisez cette clé à la place de celle d'OpenAI pour la compatibilité.

L'authentification est similaire : incluez "Authorization: Bearer VOTRE_CLÉ_OPENROUTER" dans les en-têtes.

Pour les préférences de routage, ajoutez des en-têtes comme "HTTP-Referer" pour attribuer les applications. Cette étape facultative aide les classements.

De plus, sélectionnez des variantes comme :floor pour l'optimisation des coûts ou :nitro pour la vitesse. Ajoutez-les aux noms de modèles, tels que "openai/gpt-5-pro:floor".

En suivant ces étapes, vous configurez OpenRouter efficacement pour GPT-5 Pro.

Exemples de Code pour l'Intégration OpenRouter

OpenRouter reflète l'API d'OpenAI, donc le code ressemble aux exemples précédents. En Python : from openai import OpenAI; client = OpenAI(base_url="https://openrouter.ai/api/v1", api_key="VOTRE_CLÉ_OPENROUTER").

Ensuite : response = client.chat.completions.create(model="openai/gpt-5-pro", messages=[{"role": "user", "content": "Générez du code pour une application web."}]).

Gérez les sorties de manière identique.

Pour activer les mécanismes de repli, spécifiez plusieurs fournisseurs dans les en-têtes si un routage avancé s'applique.

En JavaScript : ajustez l'URL à "https://openrouter.ai/api/v1/chat/completions".

Ces adaptations assurent des transitions fluides entre les plateformes.

Détails de la Tarification sur OpenRouter pour GPT-5 Pro

La tarification d'OpenRouter varie selon le modèle et le fournisseur. Pour GPT-5 Pro, elle reflète souvent les tarifs d'OpenAI : 15 $ par million de jetons d'entrée et 120 $ par million de jetons de sortie. Cependant, des promotions comme 50 % de réduction sur des modèles similaires réduisent temporairement les coûts.

De plus, des niveaux gratuits existent pour certaines variantes, bien que GPT-5 Pro nécessite généralement des crédits. BYOK ajoute des frais de 5 % après 1 million de requêtes mensuelles.

Comparez cela à OpenAI : le routage d'OpenRouter peut sélectionner des fournisseurs moins chers, ce qui peut économiser de l'argent.

Surveillez les coûts par requête sur leur page de modèles. Cette transparence aide à la planification budgétaire.

Comparaison d'OpenAI et OpenRouter pour l'Accès à GPT-5 Pro

OpenAI offre un contrôle direct, idéal pour les intégrations dédiées. Vous accédez à des fonctionnalités exclusives comme les instantanés pour le verrouillage de version.

Inversement, OpenRouter offre une plus grande variété de modèles et des mécanismes de repli automatiques, améliorant la fiabilité.

En termes de tarification, OpenAI fixe les tarifs de base, tandis qu'OpenRouter introduit des réductions et des optimisations.

Pour l'évolutivité, les niveaux d'OpenAI conviennent aux besoins croissants, mais l'interface unifiée d'OpenRouter accélère le développement.

Choisissez en fonction des priorités : précision avec OpenAI ou flexibilité avec OpenRouter.

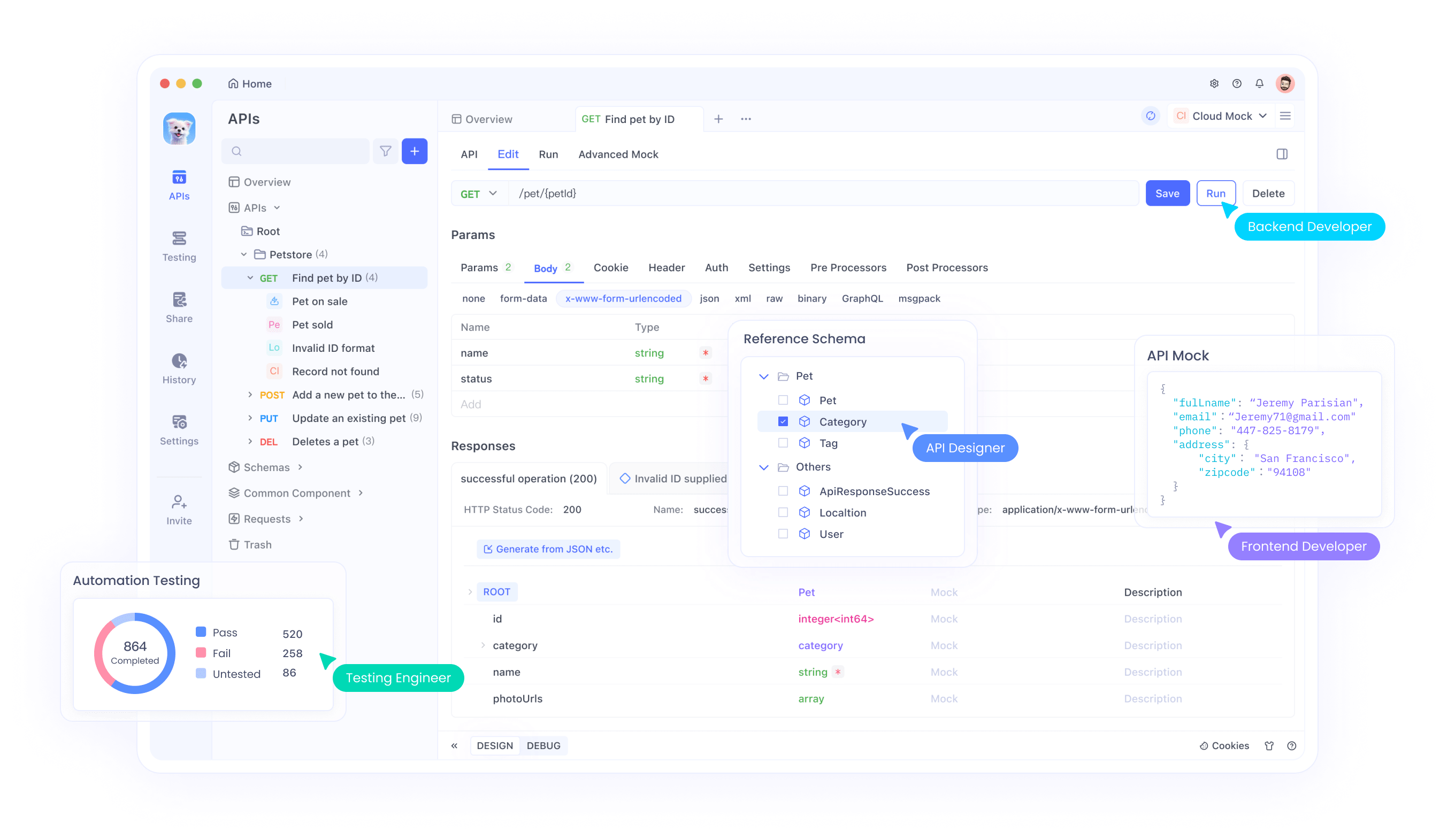

Exploiter Apidog pour les Tests d'API GPT-5 Pro

Apidog simplifie les interactions API, le rendant essentiel pour GPT-5 Pro. Vous créez des collections pour les points d'accès, organisant les requêtes.

Importez les spécifications OpenAPI pour générer automatiquement des tests. Envoyez des appels à /v1/responses et inspectez les réponses.

De plus, les serveurs de maquette (mock servers) simulent les comportements, aidant au développement hors ligne.

Débuguez les problèmes avec des journaux détaillés. Les fonctionnalités de collaboration d'Apidog prennent en charge les flux de travail d'équipe.

Téléchargez Apidog gratuitement pour améliorer votre gestion d'API.

Meilleures Pratiques pour l'Utilisation de l'API GPT-5 Pro

Optimisez les invites pour la concision afin de réduire les coûts. Utilisez le raisonnement élevé avec discernement.

Implémentez des tentatives de réessai pour les erreurs transitoires. Surveillez les métriques via des tableaux de bord.

Sécurisez les clés avec des variables d'environnement. Regroupez les requêtes lorsque c'est possible.

De plus, testez sur différentes plateformes pour identifier les forces.

Ces pratiques maximisent l'efficacité.

Défis Potentiels et Solutions

Les défis incluent les délais d'attente sur les requêtes complexes. Résolvez-les en utilisant le mode d'arrière-plan.

Les limites de débit contraignent l'utilisation ; mettez à niveau les niveaux en conséquence.

Des surprises de tarification surviennent à cause de jetons oubliés ; utilisez des estimateurs.

En anticipant les problèmes, vous atténuez les perturbations.

Techniques d'Intégration Avancées

Incorporez des webhooks pour des réponses asynchrones. Créez des agents avec l'appel de fonctions.

Mettez à l'échelle avec des équilibreurs de charge sur plusieurs plateformes.

Ces techniques débloquent des applications sophistiquées.

Conclusion

L'accès à l'API GPT-5 Pro permet des solutions innovantes. Grâce à OpenAI et OpenRouter, vous naviguez efficacement parmi les options. N'oubliez pas que des outils comme Apidog améliorent le parcours. Mettez en œuvre ces informations pour transformer vos projets.