Le GLM-4.7 de Z.ai se distingue comme un modèle linguistique étendu de pointe dans la série GLM. Les développeurs et les ingénieurs s'appuient sur lui pour ses performances supérieures en matière de programmation, de raisonnement en plusieurs étapes et de flux de travail d'agent. Le modèle gère les tâches complexes avec stabilité et produit des sorties naturelles et de haute qualité, y compris des conceptions front-end visuellement attrayantes.

Le GLM-4.7 s'appuie sur les versions précédentes avec des améliorations dans les benchmarks de codage et l'utilisation d'outils. Il prend en charge une fenêtre contextuelle de 200K tokens, ce qui lui permet de traiter des conversations ou des bases de code étendues sans perdre le fil. Z.ai positionne le GLM-4.7 comme une alternative compétitive aux modèles propriétaires d'OpenAI et d'Anthropic, en particulier dans les scénarios multilingues et d'agent.

Qu'est-ce que GLM-4.7 ? Caractéristiques clés et capacités

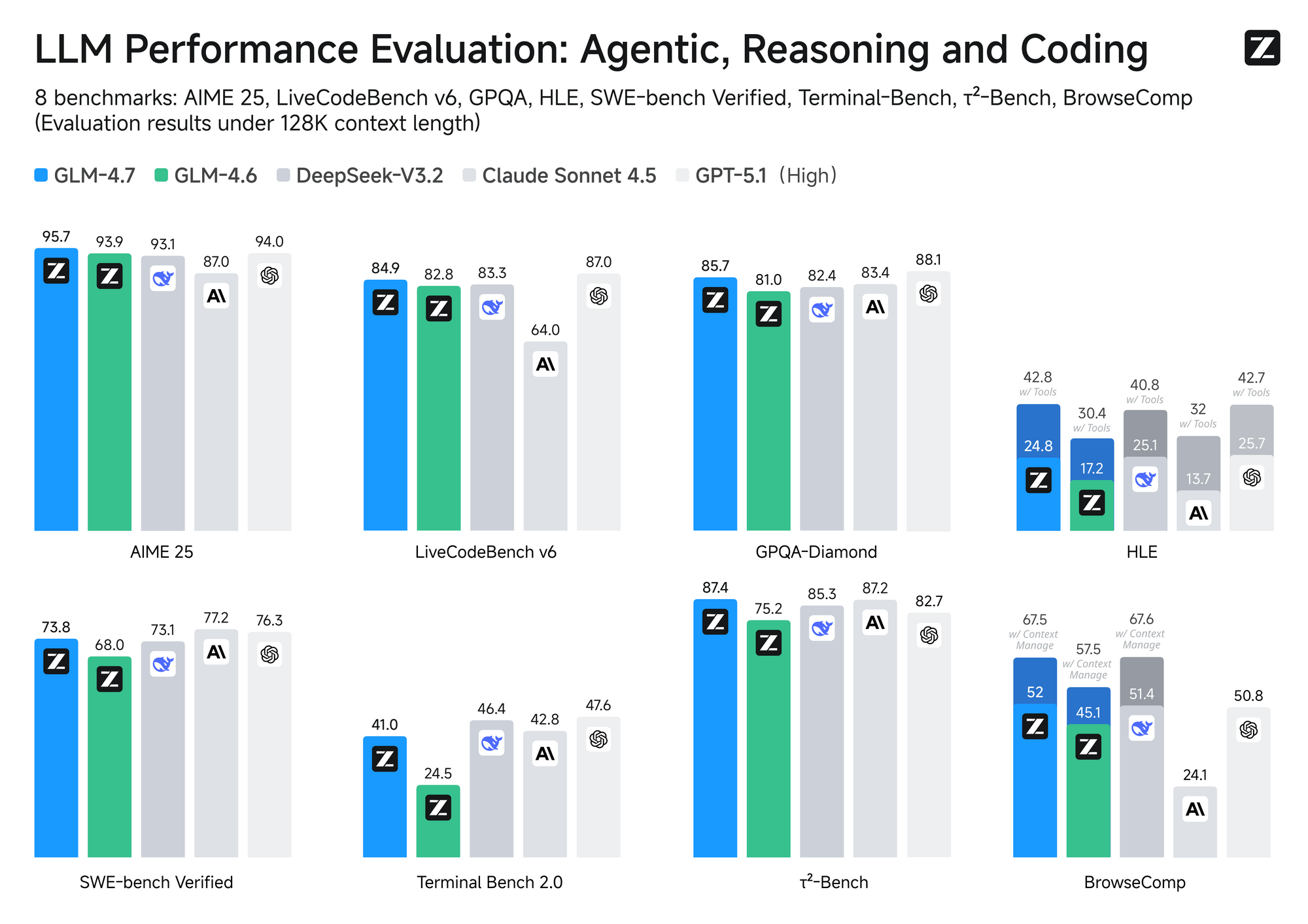

GLM-4.7 utilise une architecture de Mixture-of-Experts (MoE) avec 358 milliards de paramètres. Il excelle dans les tâches de codage de base, obtenant des scores élevés sur des benchmarks tels que SWE-bench (73,8 %) et Terminal Bench 2.0 (41 %). Le modèle prend en charge des modes de pensée qui permettent une profondeur de raisonnement contrôlée – activez-le pour des problèmes complexes ou désactivez-le pour des réponses rapides.

Les fonctionnalités clés incluent :

- Des capacités d'agent améliorées avec appel d'outils natif et navigation web.

- Une génération d'interface utilisateur améliorée pour des interfaces modernes et épurées.

- Un support bilingue (anglais et chinois) avec un fort codage multilingue.

- Un contrôle de la pensée au niveau du tour pour des tâches stables à long terme.

Z.ai publie les poids du modèle sur Hugging Face sous licence MIT, permettant un déploiement local. Pour les utilisateurs de l'API, l'accent reste mis sur l'accès au cloud pour la scalabilité.

Plateforme officielle Z.ai : Accès direct à l'API GLM-4.7

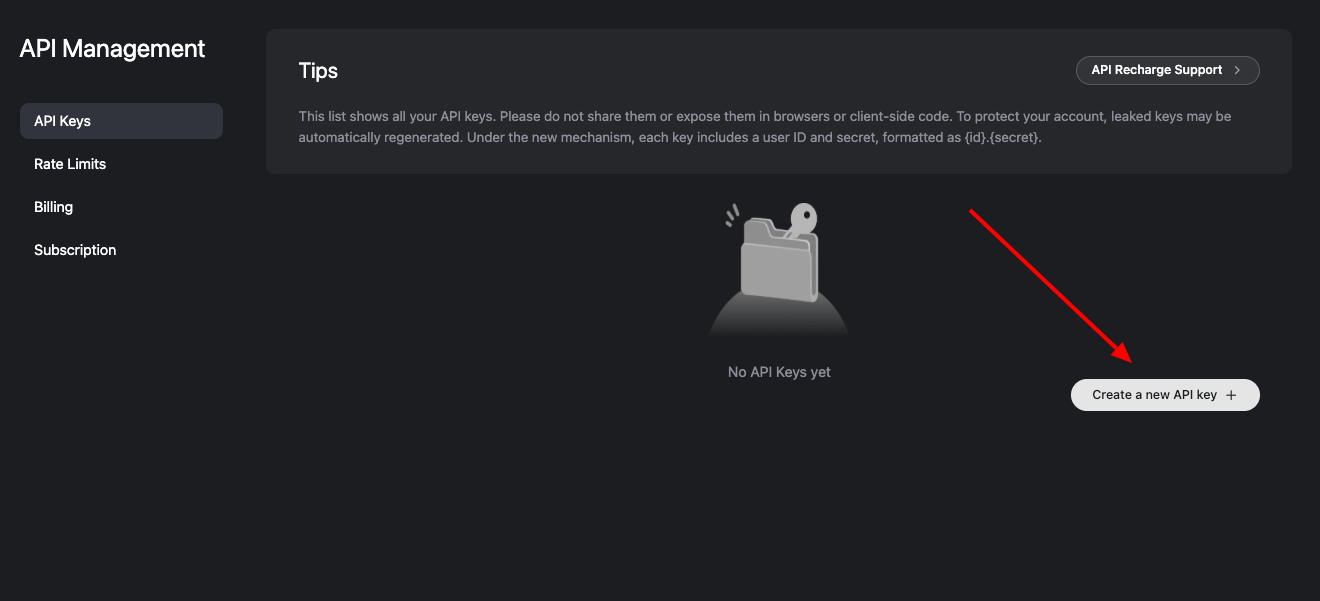

Z.ai fournit le point d'accès principal pour GLM-4.7. Enregistrez-vous sur la plateforme développeur Z.ai pour obtenir une clé API. Ce processus prend quelques minutes et débloque toutes les capacités.

Configuration étape par étape sur Z.ai

Visitez le portail développeur Z.ai et créez un compte.

Naviguez vers la section API et générez votre clé API.

Utilisez le point de terminaison officiel : https://api.z.ai/api/paas/v4/chat/completions.

Authentifiez les requêtes avec l'en-tête Authorization: Bearer VOTRE_CLÉ_API.

L'API suit le format compatible OpenAI. Envoyez des requêtes POST avec des paramètres comme model: "glm-4.7", un tableau messages, et des champs optionnels tels que temperature, max_tokens, et le mode thinking.

Exemple de requête Python utilisant le SDK officiel :

from zai import ZaiClient

client = ZaiClient(api_key="your-api-key")

response = client.chat.completions.create(

model="glm-4.7",

messages=[{"role": "user", "content": "Write a Python script for data analysis."}],

thinking={"type": "enabled"},

max_tokens=4096,

temperature=1.0

)

print(response.choices[0].message.content)

Z.ai prend en charge le streaming pour la sortie en temps réel et les réponses structurées. L'abonnement GLM Coding Plan commence à 3 $/mois, offrant 3 fois l'utilisation à des coûts réduits (offre à durée limitée). Ce plan s'intègre parfaitement avec des outils comme Claude Code et Cline.

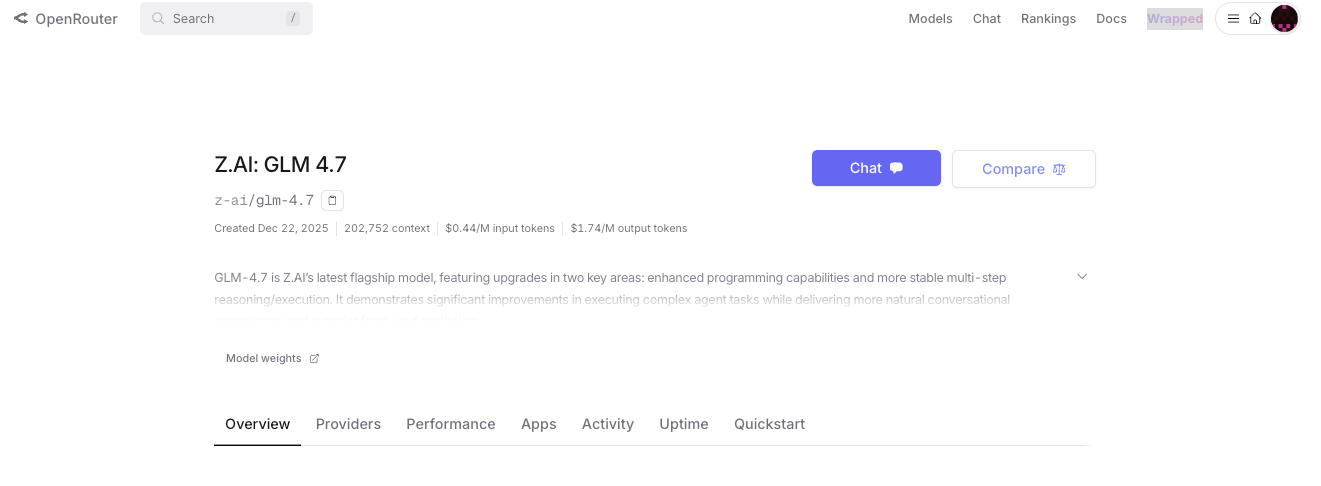

Accéder à GLM-4.7 via OpenRouter : Flexible et économique

OpenRouter regroupe GLM-4.7 de plusieurs fournisseurs, y compris Z.ai, AtlasCloud et Parasail. Cette voie offre des options de secours pour la fiabilité et des prix compétitifs.

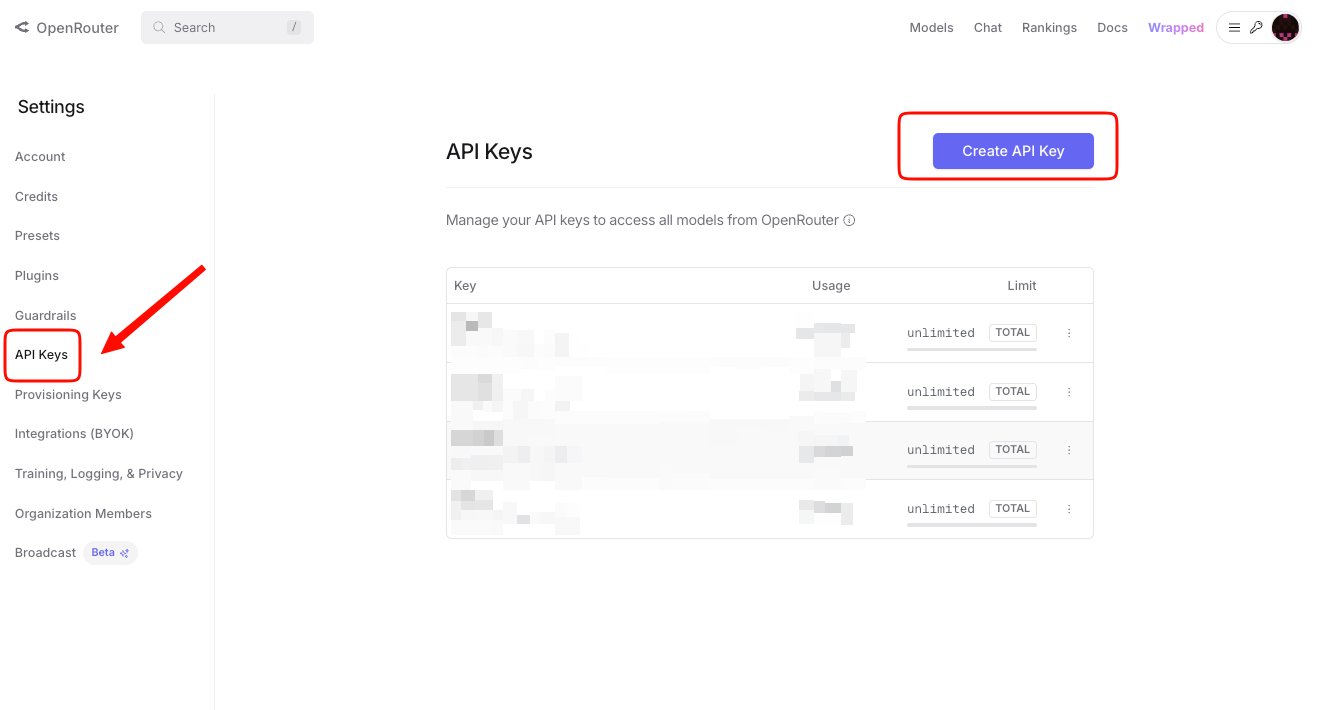

Configuration étape par étape sur OpenRouter

Inscrivez-vous sur OpenRouter et ajoutez des crédits.

Générez une clé API.

Utilisez l'identifiant du modèle : z-ai/glm-4.7.

Envoyez des requêtes au point de terminaison d'OpenRouter (https://openrouter.ai/api/v1/chat/completions).

OpenRouter normalise les réponses et prend en charge le mode de raisonnement. Activez-le avec le paramètre reasoning pour accéder aux détails de la réflexion étape par étape.

Exemple de requête curl :

curl -X POST "https://openrouter.ai/api/v1/chat/completions" \

-H "Authorization: Bearer YOUR_OPENROUTER_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "z-ai/glm-4.7",

"messages": [{"role": "user", "content": "Explain quantum computing basics."}],

"reasoning": true

}'

Comparaison des prix : Z.ai vs OpenRouter

Le plan de codage GLM de Z.ai offre un accès abordable avec des avantages groupés pour les développeurs. OpenRouter propose une tarification par token avec des variations selon le fournisseur.

| Plateforme/Fournisseur | Entrée ( $/M tokens) | Sortie ( $/M tokens) | Notes |

|---|---|---|---|

| Z.ai (Plan de codage GLM) | ~0,60 $ (effectif avec le plan) | ~2,20 $ (effectif avec le plan) | Abonnement à partir de 3 $/mois ; 3× utilisation |

| OpenRouter (AtlasCloud) | 0,44 $ | 1,74 $ | Taux de base le plus bas ; haute disponibilité |

| OpenRouter (Z.ai) | 0,60 $ | 2,20 $ | Fournisseur direct Z.ai |

| OpenRouter (Parasail) | 0,45 $ | 2,10 $ | Tarification équilibrée |

OpenRouter convient aux utilisateurs ayant besoin de flexibilité, tandis que Z.ai séduit ceux qui s'engagent dans l'écosystème. Les deux prennent en charge un contexte de plus de 200K.

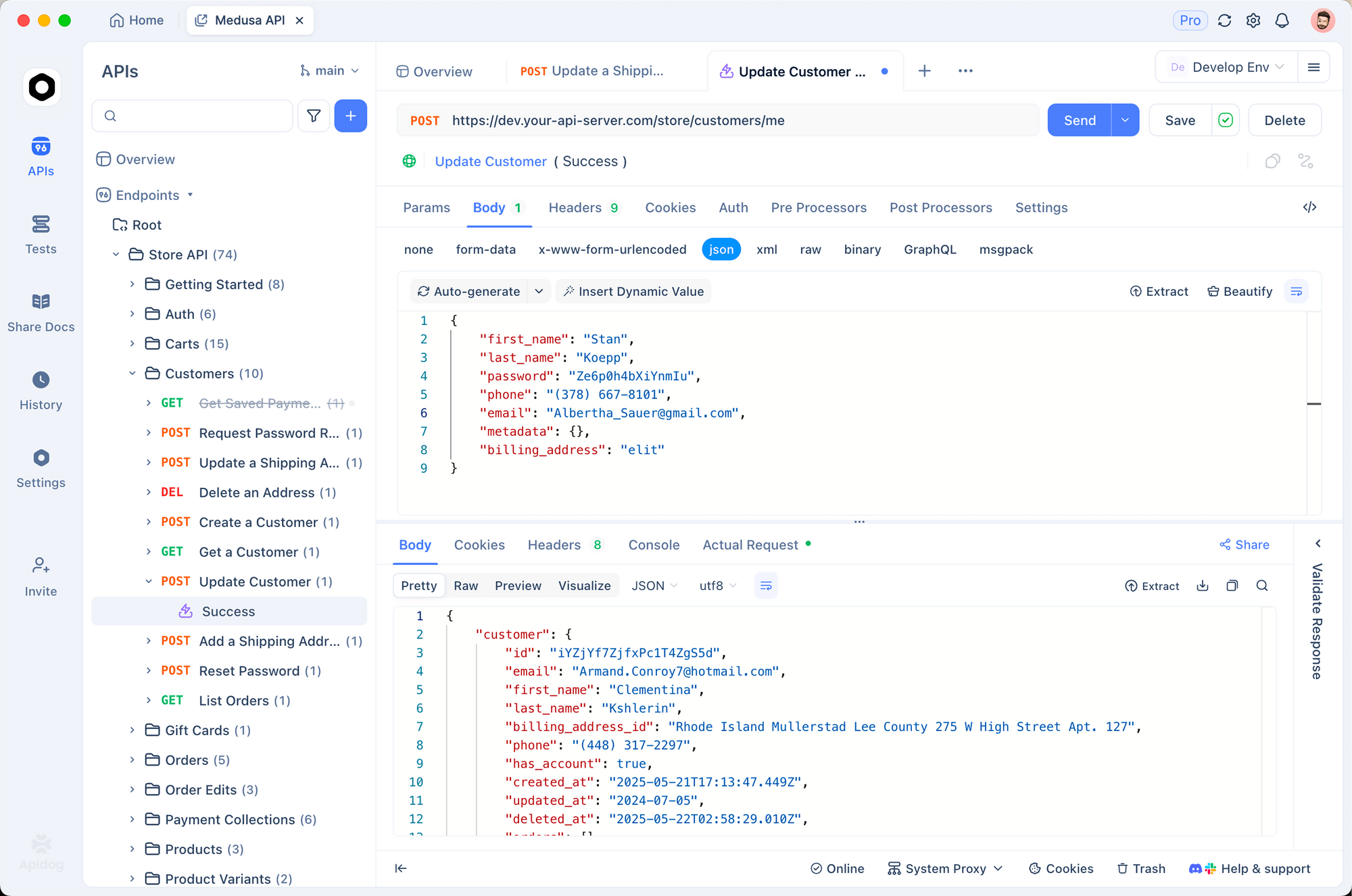

Tester l'API GLM-4.7 avec Apidog : Conseils d'intégration pratiques

Apidog simplifie le travail avec les API grâce à des constructeurs de requêtes visuels et des tests automatisés. Importez la spécification OpenAPI de GLM-4.7 ou créez des collections manuellement.

Apidog suit la latence et les erreurs, aidant à optimiser les invites. Il prend en charge les API compatibles OpenAI, de sorte que le passage entre Z.ai et OpenRouter prend quelques secondes.

Utilisation avancée et bonnes pratiques

Activez le mode de réflexion pour les tâches complexes afin d'améliorer la précision. Utilisez une température plus basse (0,7) pour des sorties déterministes en codage. Surveillez l'utilisation des tokens pour rester dans les limites.

Pour un déploiement local, téléchargez les poids depuis Hugging Face et utilisez vLLM ou SGLang. Cette option élimine les coûts d'API pour une utilisation à fort volume.

Conclusion : Commencez à construire avec GLM-4.7 dès aujourd'hui

GLM-4.7 offre de puissantes capacités pour les applications d'IA modernes. Accédez-y directement sur Z.ai pour des fonctionnalités intégrées ou via OpenRouter pour des économies. Expérimentez avec Apidog pour affiner rapidement vos intégrations.

Téléchargez Apidog gratuitement dès maintenant et testez les requêtes GLM-4.7 en quelques minutes. Les bons outils rendent les API complexes gérables et accélèrent le développement.